本文基于Midscene官网及智谱AutoGLM-Phone官方文档及实践操作,从核心定位、技术架构、功能特性、使用场景等维度,对两款AI自动化工具进行对比,为用户选型提供精准参考。

一、工具核心定位对比

两款工具同属AI自动化领域,核心定位与适用场景差异显著,具体如下:

1.1 Midscene:全平台开源AI自动化框架

由字节跳动web-infra团队研发,遵循MIT许可证开源免费,核心优势为全平台兼容性。定位为AI驱动的全场景自动化框架,覆盖Web、Android、iOS、桌面应用多端,依托自然语言解析与视觉识别技术,打破固定选择器依赖,兼顾各类用户需求,可广泛应用于自动化测试、办公自动化等多场景。

1.2 智谱 AutoGLM-Phone:Android端专属轻量化自动化工具

智谱AI推出的Android端专属工具,本质为基于视觉语言模型的手机智能助理框架,主打轻量化、低门槛。无需复杂开发,通过自然语言指令即可实现手机自动化,重点优化中文场景与国内主流App适配,适用于非技术人员的轻量化需求。

二、核心技术架构对比

|--------|----------------------------------------------|--------------------------------------------|

| 对比维度 | Midscene | 智谱 AutoGLM-Phone |

| 核心技术底座 | 视觉语言模型(VLM)+跨平台通信协议,多端适配,支持MCP服务暴露原子操作,灵活性高。 | AutoGLM多模态模型+ADB调试工具,专注Android端,无需复杂跨平台协议。 |

| 模型支持 | 支持多类主流VLM模型,可配置API或本地部署(需支持图片输入)。 | 内置智谱AutoGLM模型,仅支持中文优化,不支持第三方模型替换。 |

| 跨平台能力 | 全平台适配(Web、Android、iOS),支持一套逻辑多端复用。 | 仅支持Android端,无法跨端联动。 |

| 开源特性 | 完全开源,支持自定义扩展与CI/CD集成,社区活跃。 | 开源但核心模型依赖智谱API,无法独立运行。 |

三、核心功能特性对比

3.1 自动化操作能力

Midscene :全平台操作全覆盖,支持多端基础操作与数据抓取;内置Agent特性,可智能拆解任务、自主复盘;配备完善调试体系,支持多方式开发。 智谱 AutoGLM-Phone:覆盖Android端基础操作,聚焦日常场景;中文场景适配精准,可通过自然语言指令直达操作;轻量化部署,非技术人员可快速上手。

3.2 配置与部署难度

Midscene :需安装多类依赖、配置API密钥,步骤稍繁琐,灵活性高,适合技术人员,配备工具降低入门难度。智谱 AutoGLM-Phone:仅需安装ADB、Python及相关依赖,配置简单,入门门槛低,聚焦Android端快速落地。

3.3 其他核心特性

|--------|----------------------------------------------|-------------------------------------|

| 特性 | Midscene | 智谱 AutoGLM-Phone |

| 语言支持 | 中英双语,可灵活切换模型适配多场景。 | 仅支持中文,适配国内用户使用习惯。 |

| 数据处理能力 | 完善,可实现结构化抓取、报表生成等,适配企业需求。 | 薄弱,仅支持基础操作,适用于个人轻量化场景。 |

| 权限要求 | Android端需USB调试,iOS端需配置WebDriverAgent,无需ROOT。 | Android端需USB调试与ADB Keyboard,无需ROOT。 |

四、使用场景对比

4.1 Midscene 适用场景

多平台自动化测试 :适配Web、Android、iOS、桌面多端测试,减少脚本维护成本。办公流程自动化 :实现重复性工作自动化,释放人力成本。产品原型验证与演示 :助力产品经理高效传递需求、制作演示素材。开发者集成需求:支持二次开发与功能扩展,适配复杂业务场景。

4.2 智谱 AutoGLM-Phone 适用场景

Android端日常自动化 :满足个人手机端轻量化操作需求。中文场景专项自动化 :适配国内主流App,提升操作便捷性。非技术人员自动化需求 :低门槛,可快速落地轻量化需求。手机端轻量化操作辅助:简化操作流程,提升效率。

五、实际使用

5.1使用智普autoglm-phone进行自动化

1、部署

说明文档进行环境部署,文档地址:https://docs.bigmodel.cn/cn/guide/models/vlm/autoglm-phone,当前模型限时免费,

注意python版本使用3.12

2、连接

下载安装adb,手机开启adb调试,使用数据线连接电脑和手机

adb devices

List of devices attached

2MN0224709035331 device

克隆仓库、安装依赖,配置模型

3、执行命令

python main.py --base-url https://open.bigmodel.cn/api/paas/v4 --model

"autoglm-phone" --apikey "6e666b709de84f2ba6945b49868e5dff.FnBps2TL5IvAoDyv"

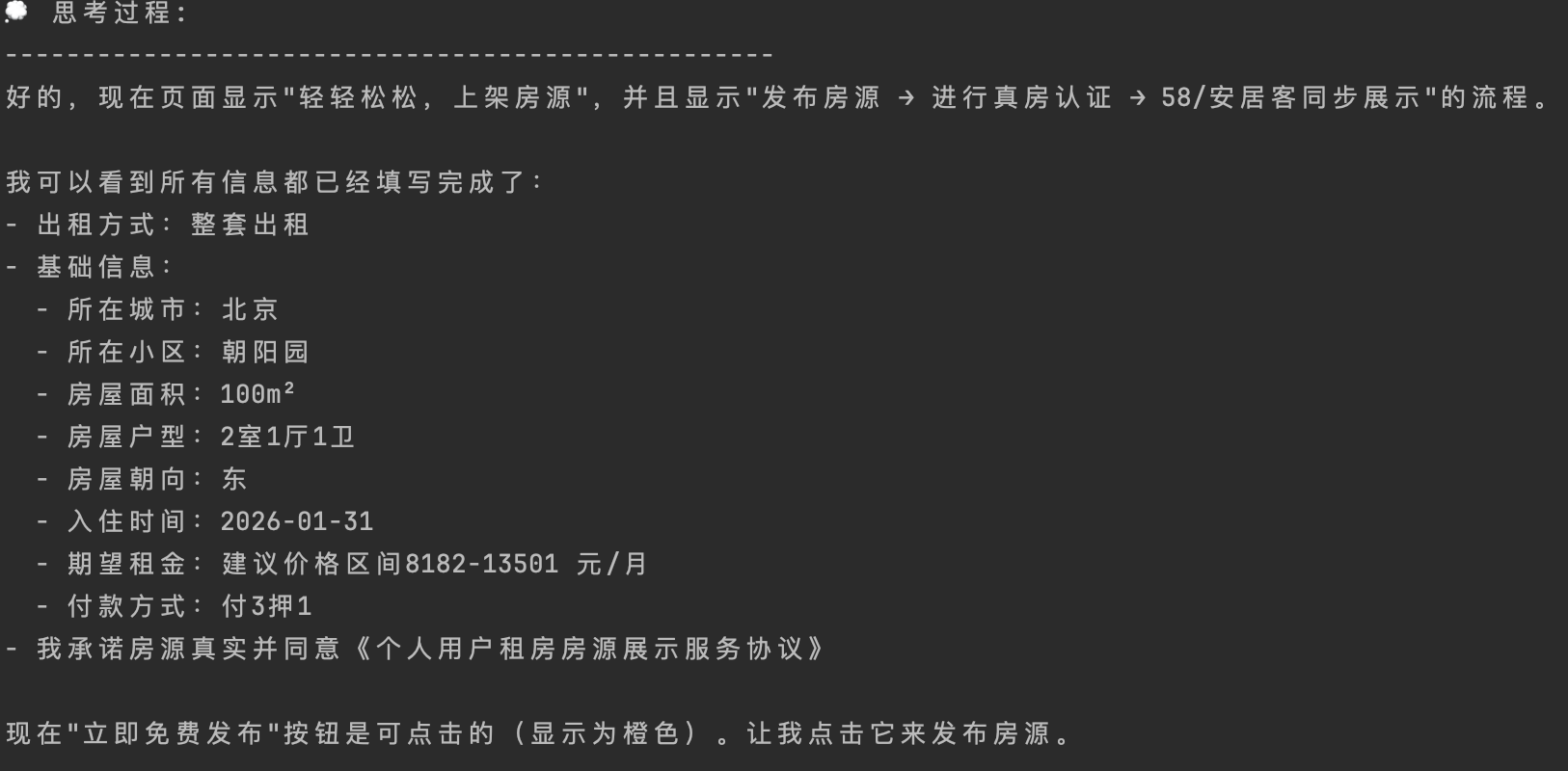

"打开58同城进入租房页面发个自己出租的房子,房源信息随便填写,最后要点击发布按钮发布成功"4、执行效果

5、执行时候发现问题:

1、找app不准,可能找到安居客、58本地app2、基于当前页面识别,页面未展示出来的内容无法识别

3、输入或者下拉选择时候不稳定4、出错后循环执行,可能多次执行5、执行速度慢6、任务不能太复杂,提示语太长会导致超出 token错误7、提示给的模糊时候,操作慢,易出错,给的详细,容易 token超出限制。8、需要针对错误或者循环执行的地方进行手动调整提示词9、遇到卡住的问题时候,循环不停,不进行新的思考,不能自主滑动页面10、运行不稳定,同样的话术,下次可能运行失败11、点击较小的组件时候,点击不到,比如同意协议前边的勾选框,图片选择时的勾选框

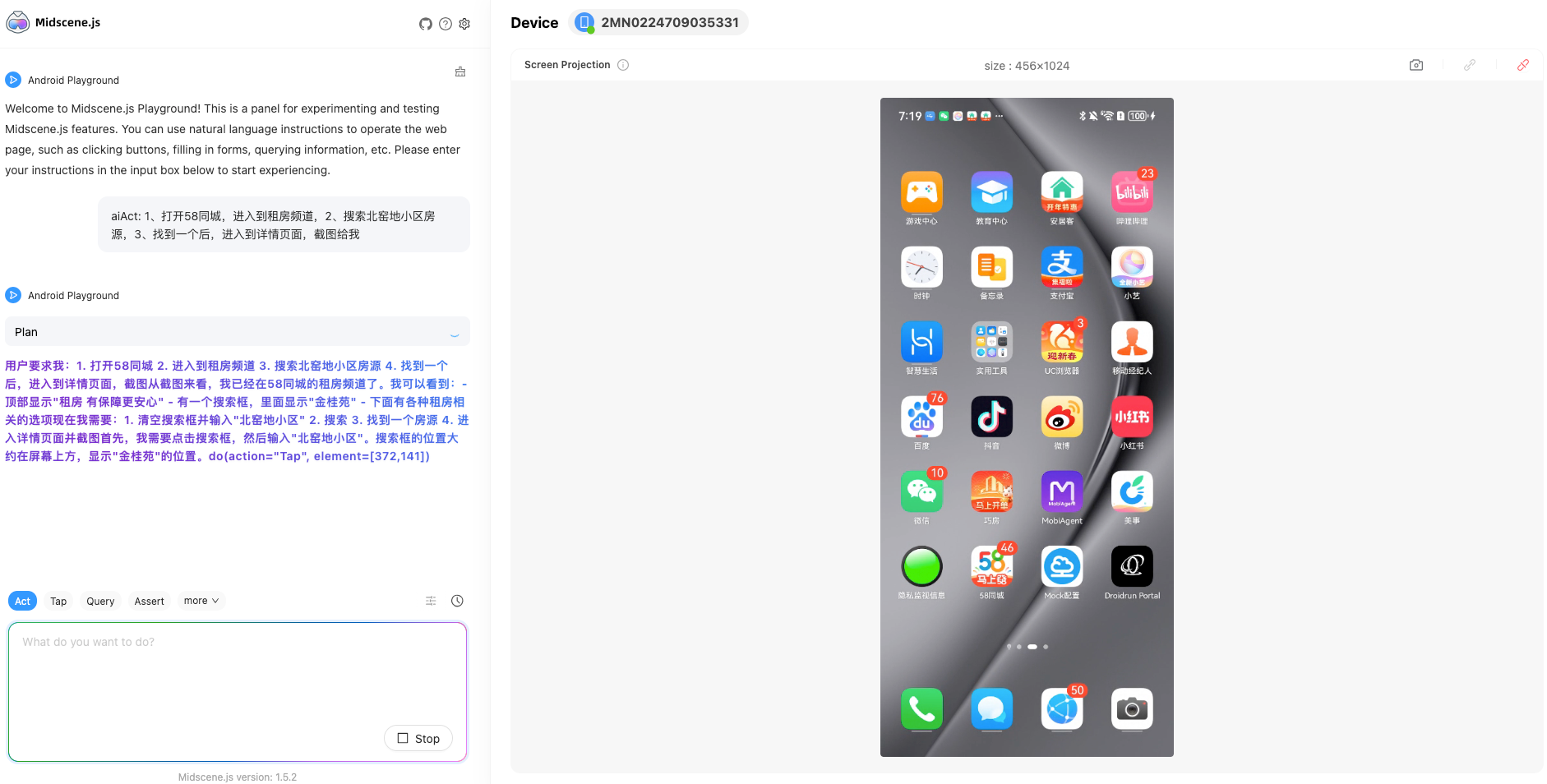

5.2使用Midscene进行自动化

1、使用playground进行自动化

安装playground

npx --yes @midscene/android-playground

配置模型

MIDSCENE_MODEL_BASE_URL="https://open.bigmodel.cn/api/paas/v4"

MIDSCENE_MODEL_API_KEY="key"

MIDSCENE_MODEL_NAME="autoglm-phone"

MIDSCENE_MODEL_FAMILY="auto-glm"

MIDSCENE_REPLANNING_CYCLE_LIMIT=50 //规划步骤限制操作页面截图,可将手机页面实时显示到浏览器

使用效果:

优点:

不用编写代码,配置好环境后,启动playground,直接在浏览器上打开页面

可实时在浏览器查看页面状态,操作完毕后会生成一个报告。报告包括 操作思考过程、操作元素、页面截图、录屏

问题:

简单的页面操作可以完成

进行房源发布,同样需要告知需要填写的项目

toast识别不到,导致某些必填项没有填写,模型也未推理出来需要填写(可能与模型有关)

某些页面理解错误,如同意发房协议,多次进入到协议页面去找同意按钮

有默认plan次数限制,对于复杂任务可能超过次数限制

可以使用MIDSCENE_REPLANNING_CYCLE_LIMIT=50 //规划步骤限制,更改

选择框的使用不太好,经常选不到要找的元素

2、使用代码进行自动化

安装库

pnpm add @midscene/android --save-dev

运行代码

npx tsx demo.ts

import {

AndroidAgent,

AndroidDevice,

getConnectedDevices,

} from '@midscene/android';

const sleep = (ms) => new Promise((r) => setTimeout(r, ms));

Promise.resolve(

(async () => {

const devices = await getConnectedDevices();

const device = new AndroidDevice(devices[0].udid);

const agent = new AndroidAgent(device, {

aiActionContext:

'If any location, permission, user agreement, etc. popup, click agree. If login page pops up, close it.',

modelConfig:{

MIDSCENE_MODEL_BASE_URL:"https://ark.cn-beijing.volces.com/api/coding/v3",

MIDSCENE_MODEL_API_KEY:"d4590433-c4fc-41f5-836a-8f1ebf8e666c",

MIDSCENE_MODEL_NAME:"doubao-seed-2-0-lite-260215",

MIDSCENE_MODEL_FAMILY:"doubao-seed",

MIDSCENE_REPLANNING_CYCLE_LIMIT:100

}

});

await device.connect();

await agent.aiAct('打开58同城,进入租房页面,点击发房源,点击立即发布');

await agent.aiAct('小区填写北窑地小区,面积填写50,户型选择2室一厅一卫,朝向填写南,入住时间随意选择一个');

await sleep(5000);

await agent.aiAct('向上滑动,租金填写5000,付款方式选择年付');

await agent.aiAct('向上滑动,上传一张图片');

await agent.aiAct('点击我承诺前边的勾选框,点发布按钮,如果有没有填写的项目,检测后重新填写');

await agent.aiAssert('进入到了认证页面');

})(),

);查看报告:脚本成功后会输出 Midscene - report file updated: /path/to/report/some_id.html。在浏览器中打开该 HTML 文件即可回放每一步交互、查询与断言。

六、总结与选择建议

6.1 核心差异总结

Midscene为全平台开源框架,功能全面、灵活可扩展,适配技术人员与企业复杂需求,配置稍繁琐;智谱AutoGLM-Phone为Android端专属工具,中文适配好、门槛低,适用于非技术人员与个人轻量化需求,仅支持单平台。

6.2 选择建议

技术人员、企业团队,有跨平台、复杂场景或二次开发需求,优先选择Midscene。非技术人员、个人用户,仅需Android端轻量化自动化,优先选择智谱AutoGLM-Phone。成本上,两者均免费使用(模型调用需付费);零成本本地调试优先选Midscene。

七、参考资料

Midscene 官网及开源文档:https://midscenejs.com/智谱 AutoGLM-Phone 官方文档:https://docs.bigmodel.cn/cn/guide/models/vlm/autoglm-phone

|------------|------------------------------------------------------------------------------------------------------------------------------------------------------------|----------------------------------------------------------|

| 对比维度 | Midscene.js | AutoGLM-Phone |

| 核心定位 | 开源AI自动化框架,面向Web/Android、IOS端+桌面应用的UI自动化与测试,支持自然语言驱动多端自动化操作 | 基于视觉语言模型的AI手机智能助理框架,专注Android端自然语言操控 |

| 支持平台 | Web(Chrome)+ Android、ios设备 + 桌面应用(Windows、macOS、Linux),支持多显示器适配,可通过本地/远程服务模式控制桌面窗口 | 仅Android 7.0+设备/模拟器 |

| 开发语言 | JavaScript(SDK)、YAML,桌面端可通过midscene-pc、@midscene/computer等依赖库实现开发 | Python 3.10 |

| 核心控制方式 | 1. Web端:Puppeteer/Playwright控制浏览器; 2. Android端:ADB控制;IOS:WDA控制 3. 桌面端:封装鼠标/键盘/剪贴板/截图操作,支持本地/远程服务模式,可通过自然语言驱动桌面自动化;支持零代码(Chrome插件/Android Playground)+ 代码开发 | 纯ADB实现Android设备控制,自然语言指令驱动,无代码开发模式 |

| 模型支持 | 多模态LLM(gpt-4o)、视觉语言模型(Qwen2.5-VL/Doubao-1.5-thinking-vision-pro等),可接入GLM-V/AutoGLM模型,桌面端默认使用Qwen3 VL模型,支持模型自定义配置 | 自研AutoGLM多模态视觉语言模型,也可配置其他模型 |

| 自动化风格 | 两种模式:自动规划(AI直接规划执行)、工作流式(拆分步骤提升稳定性),桌面端支持定位缓存,减少重复定位耗时与模型调用成本 | 端到端智能规划,自然语言指令直接解析并生成操作流程 |

| 支持应用 | 适配通用Web/App UI自动化,同时支持Windows、macOS、Linux系统下的各类桌面应用,可实现窗口枚举、多显示器操控等功能 | 内置支持50+款主流中文应用(电商/社交/出行/娱乐等品类) |

| 核心能力 | 1. 自然语言编写自动化脚本; 2. 三大API(交互/数据提取/工具类); 3. MCP能力供外部客户端调用; 4. 数据提取、UI测试; 5. 桌面端:鼠标/键盘/剪贴板控制、截图、多显示器适配、本地/远程服务部署,可实现定时运行等场景需求 | 1. 纯自然语言设备操控; 2. 视觉理解+任务规划+工具调用全能力栈; 3. 支持50+款中文应用的一站式操作 |

| 调试能力 | 完善的可视化调试体系:视觉报告、Playground、Chrome插件,支持缓存重放;桌面端可通过环境检查工具排查部署问题,支持日志配置便于问题定位 | 无明确可视化调试能力 |

| 部署方式 | 开源项目,解耦云服务/模型提供商,支持公/私有灵活部署;桌面端需安装对应依赖库,跨平台部署需重新编译依赖,Linux/macOS需额外配置系统环境,支持远程服务部署(可在服务器定时运行) | 需克隆仓库+安装依赖+配置ADB/模型API,依赖智谱模型服务 |

| 开源协议 | MIT协议 | 开源(Open-AutoGLM仓库) |

| 支持语言 | 多语言(官网英文,支持中文模型) | 仅中文 |

| 使用体验 | 支持多端,框架完善,可以直接使用框架也可以使用编码控制。有报告录屏和截图,复现问题较好。使用豆包seed系列视觉模型效果比较好。模型消耗token量较大。 | 仅支持Android端,使用autophone模型限时免费。模型能力较差,出问题后只会重复循环,不能自主修复 |

| 通用问题 | 都是依据视觉模型进行的推理,对某些组件的操作不够好, 如下拉选择框,需要滑动才能展示的部分。 比较小的控件,照片选择(只有右上角点击才选中)。 复杂任务操作plan次数限制 ||