题目:Inter-class separability loss for weakly supervised mutually exclusive multiclass segmentation of brain tumor lesions

**摘要:**医学图像分割对于诊断和治疗规划是必不可少的,然而完全有监督的深度学习方法需要昂贵的像素级注释。使用类激活映射(CAM)的弱监督语义分割(WSSS)通过利用图像级标签来减少这一负担。虽然二进制CAM已经显示出有希望的结果,但多类CAM仍然没有得到充分的探索,并且由于定位信号弱而导致精度降低。为了解决这一问题,我们提出了一种新的方法,通过利用二进制CAM来指导多类CAM,增强了特征表示、类间边界分割和预测精度,从而改进了多类WSSS。此外,我们还引入了新的类间可分离性损失和一致性损失,旨在通过加强空间一致性和类可分离性来增强多类CAM学习。在脑肿瘤分割(BRATS)数据集上的实验结果表明,该方法显著提高了多类弱监督分割的精度,优于现有的方法。

1、介绍

医学影像数据中结构异常的准确分割是生物标记物量化和疾病严重程度评估的重要步骤。深度学习的最新进展为几种完全监督的二值和多类分割方法产生了令人振奋的结果。然而,这些方法需要像素级的标记来进行训练,这是耗时、费力和昂贵的,因为准确标记所需的专业医学知识13。

弱监督分割(WSS)方法通过使用部分(例如,涂鸦23、点5,6、边界框12、17、19、21或较低级别标签(例如,图像级标签8)来解决该问题,从而最小化对详细像素级注释的需要,并使分割过程更有效。在WSS方法中,基于类激活映射(CAM)的方法生成热图,突出显示 并且对于仅使用图像级别的标签来识别病理结构特别有效。

相关工作:

现有的方法包括使用像素损失函数或局部块相似性约束的像素方法1,2,增强全局一致性的图像方法11,25,以及利用图像间关系来提高分割性能的跨图像技术9,24。在医学图像中,大多数基于CAM的方法已经被开发用于单类分割,将它们扩展到多类设置的工作是有限的7,16。在多类别设置中,上述基于CAM的方法与标签共现作斗争,导致频繁共存的类和空间邻接(共同位置)的相似激活,从而导致在紧密定位的结构中的重叠激活16。WS-MTST7引入聚集损失以促进弱监督多标记肿瘤分割中的空间紧凑性,利用基于transfomer的架构。虽然对邻近的肿瘤区域有效,但这种设计假定每个类别内的空间连续性。在基于CAM的方法中,AME-CAM8使用多出口分类网络来提取不同分辨率的激活图,然后使用注意力机制分层聚集这些激活图以生成高分辨率的二元CAMs。然而,当直接扩展到多类设置时,它无法产生相互排斥的激活,导致分段中显著重叠,因为多类CAMS是独立生成的,缺乏在类之间分开的机制。例如,虽然已经提出了前景背景可分离性损失9,但它不强制多个前景类之间的分离。

贡献:

在这项工作中,为了解决CAM在生成互斥激活方面的局限性,我们提出了一种多类CAM方法,该方法利用二进制CAM作为指导来增强多类CAM的生成,从而改善类的本地化。为了解决多类病变中重叠激活的挑战,我们引入了两个新的损失函数:类间可分离性损失,它减少了这些区域的CAM重叠,以及一致性损失,它确保了二类和多类CAM之间的一致性。我们还对我们的方法与最先进的CAM技术进行了对比,以从具有多类共处、共现标签的医学成像数据的分类网络中提取多类分割结果。

2、方法

问题表述:

设X⊂R为图像空间∀xi∈X,对应的图像级别标签空间为Y∀Yc i∈Y,从而使训练数据{X,Y}。设c=1...C,其中C≥2是异常病变中共现类的数目。在给定多类分割问题的情况下,目标是确定准确的多类凸轮,用于弱监督分割C类共生的病变。

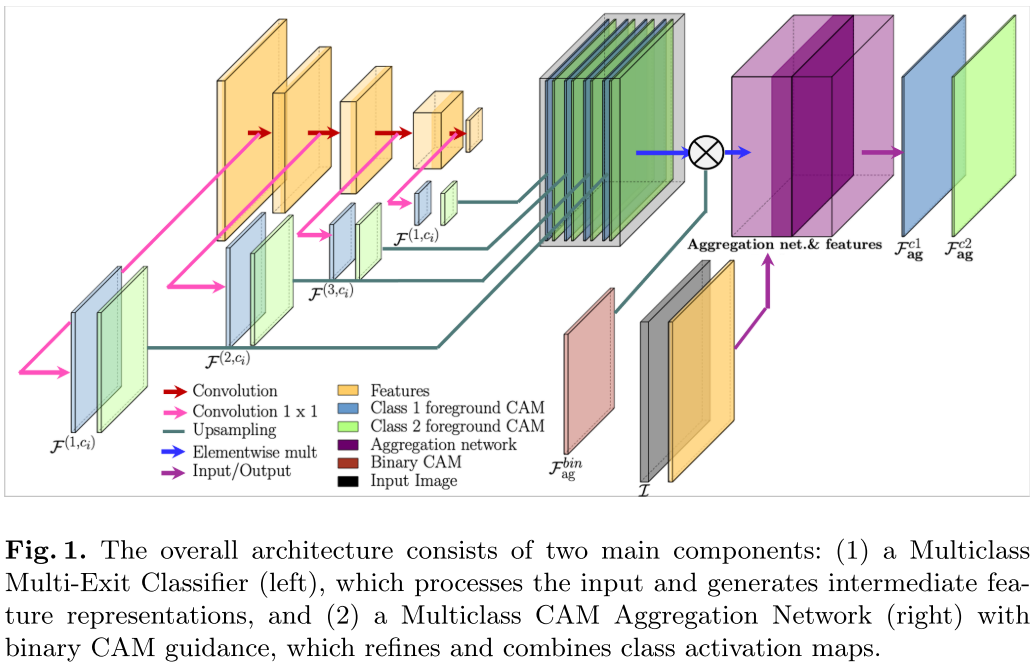

该方法使用图像标号Yci和多类CAM聚合来训练分类模型,以组合来自模型多层的CAM地图。在此,我们还提出了一种新的二值凸轮引导下的多类凸轮求精策略。此外,由于单独使用类特定损失24仅提供前景和背景之间的可分离性,我们还引入了类间可分离性和协议损失来强制前景类之间的互斥。所提出的方法的总体结构如图1所示。

2.1、基于图像级标签的多类分类

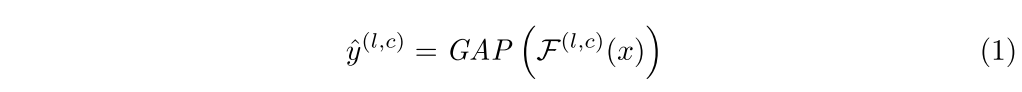

我们使用2D ResNet-18架构来实现多类分类,因为ResNet架构已经显示出令人振奋的结果8。我们使用多出口训练来扩展模型以处理多个类,其中我们在每个残差块之后引入内部分类器,分类器的数量等于类C的数量。这些分类器在不同层为C类生成激活图F(L,c)(X)L。在每个残差块,通过将全局平均池(GAP)应用于激活图来获得预测,其定义如下:

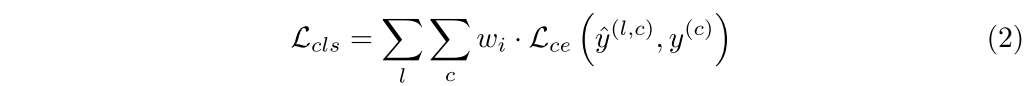

其中F(L,c)(X)表示L第个残差块的c类特征地图。我们使用交叉熵损失LCLS来训练分类模型,

其中y(C)是c类的图像级地面真实标签,wl是每个块损失的权重因子L。为了增强特征表示,我们使用多标签监督对比学习方法来预先训练分类器26。

2.2、多类CAM汇聚网络

虽然我们从L的不同层次获得了不同分辨率的激活图F(L,c)(X),但它们需要聚合成互斥的类特定凸轮。因此,我们将不同层L的F(L,c)(X)向上采样到原始维度,从而得到每个c类的L激活图,作为聚合模块的输入(如图1所示)。由于我们的目标不仅是使单个前景类相互排斥,而且要将所有前景类与背景类分开,因此我们使用二进制CAM来指导后面的任务。因此,我们为整个病变生成二元凸轮Fbin ag(通过训练组合前景类与背景的聚合模型8),以获得大致的病变定位图。这些二元凸轮用作获得最终聚集的互斥多类凸轮(FCAG)的指南。下面解释二进制引导的多类CAM聚集的过程。

我们使用二进制CAM Fbin AG来精化层次化多类激活映射F(L,c)(X)。具体地,对于每个残差块L,使用Fbin Ag如下调制提取的多类激活图F1,c:

其中⊙表示逐个元素的乘法。这确保了多类激活图与整体病变定位保持一致,同时使用稍后在SEC中描述的类间可分离性损失和一致性损失来改善类特定区域的空间一致性。2.3.与WS-MTST7不同,该策略避免了空间紧凑性限制,潜在地允许灵活地表示同一类的多个不相连区域。

为了适应多类别环境下的注意机制,我们修改了8中提出的注意网络A(·),为每个激活图分配特定类别的像素重要性分数S˜(L,c)(JK)。与二进制设置不同,在二进制设置中,只学习一个班级的注意力分数,我们改进的注意力网络为每个班级分配单独的注意力分数。具体地说,网络将被多类激活图屏蔽的图像x作为输入,并如下计算相应的重要性分数:

其中·L L=1表示剩余层之间的通道级联L,N(·)将激活图归一化到范围0,1,⊙表示元素级乘。这种修改确保注意力网络学习每个类别的不同空间重要性模式,从而在多类别设置中实现改进的本地化和分离。因此,最终聚集的类特定激活图Fc ag被获得为Fc ag=P L S˜(L,c)(Jk)⊙˜F(L,c)。

2.3、用于多类CAM学习的损失函数

为了确保有效的多类激活图学习,我们使用了三个损失函数,如下所述。

**特定类别的分离损失:**我们通过将前景-背景可分离性损失24(LPOS,LNEG)分别应用于每一类来扩展多类设置,同时保持类特定的前景一致性。它的表述如下:

直观地,正损失鼓励相似区域(例如,前景-前景或背景-背景)之间的一致性,而负损失强制每个类别的前景和背景特征之间的分离。

这里,vsf,c和vtb,c分别表示S第和第t个实例(图像)中类别c的前景和背景特征表示,并如下计算。

其中P(·)表示投影网络(实现为1×1卷积),其将输入的三通道图像x映射到单通道表示(由图1中的特征表示)以用于下游处理。

**类别间可分离性损失:**为了确保按类别区分,我们将不同类别的前景特征之间的相似度降至最低:

此约束可防止不同类之间的要素表达重叠,从而促进更好的类分离。

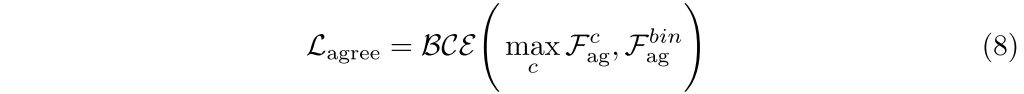

**协议损失:**为了将聚合的多类激活图与二进制激活图对齐,我们引入了基于二进制交叉熵(BCE)函数的一致性损失:

术语Maxc FC AG在每个像素上选择最有信心的类激活,确保多类和二进制分割输出之间的一致性。因此,总损失函数被定义为上述分量的加权和:

其中,λc、λSep和λAgree是控制每个损耗分量的相对重要性的超参数。一旦获得CAMS,我们应用二进制指导的阈值操作,确保多类分割掩码保持在二进制映射范围内。

3、实验设置

**数据集详细信息。**我们使用了脑肿瘤分割(BRATS)2020数据集3,4,18,并使用了来自369名患者的四种模式的多模式MRI扫描:FLAIR、T1、T1ce和T2是公开可用的,其中我们使用T1ce、T2和FLAIR。它为水肿、增强的肿瘤核心和不增强的肿瘤核心提供了地面真实的注释。在我们的研究中,我们将增强和非增强的肿瘤区域合并为一个核心类。培训:验证:测试的比例分别为237:59:73。这一数据集有效地捕捉到了核心和水肿的空间共存和共存的挑战,使其非常适合于评估所提出的方法。

**实施细节。**用MulSupCon26在训练集上对多类分类器进行了预训练。使用ADAM优化器15对分类和聚合模型进行了优化,学习率分别为5E−4和1E−3。使用模型检查点对50个时期进行训练,根据验证损失保存最好的模型。我们将二值和多类凸轮的阈值分别设置为0.4和0.5。总损失函数中使用的损失权重设置为λc=1、λSEP=1和λAgree=5。以上参数均为经验性设置。实验在Intel i9-10980XE CPU、128 GB RAM和两个NVIDIA RTX A6000 GPU(每个都有48 GB内存)上进行。

**评估指标。**我们使用Dice Score、IOU和Hausdorff距离的第95个百分位数(HD95)来评估最终的分割性能。

3.1、实验结果

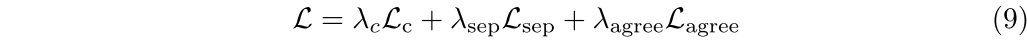

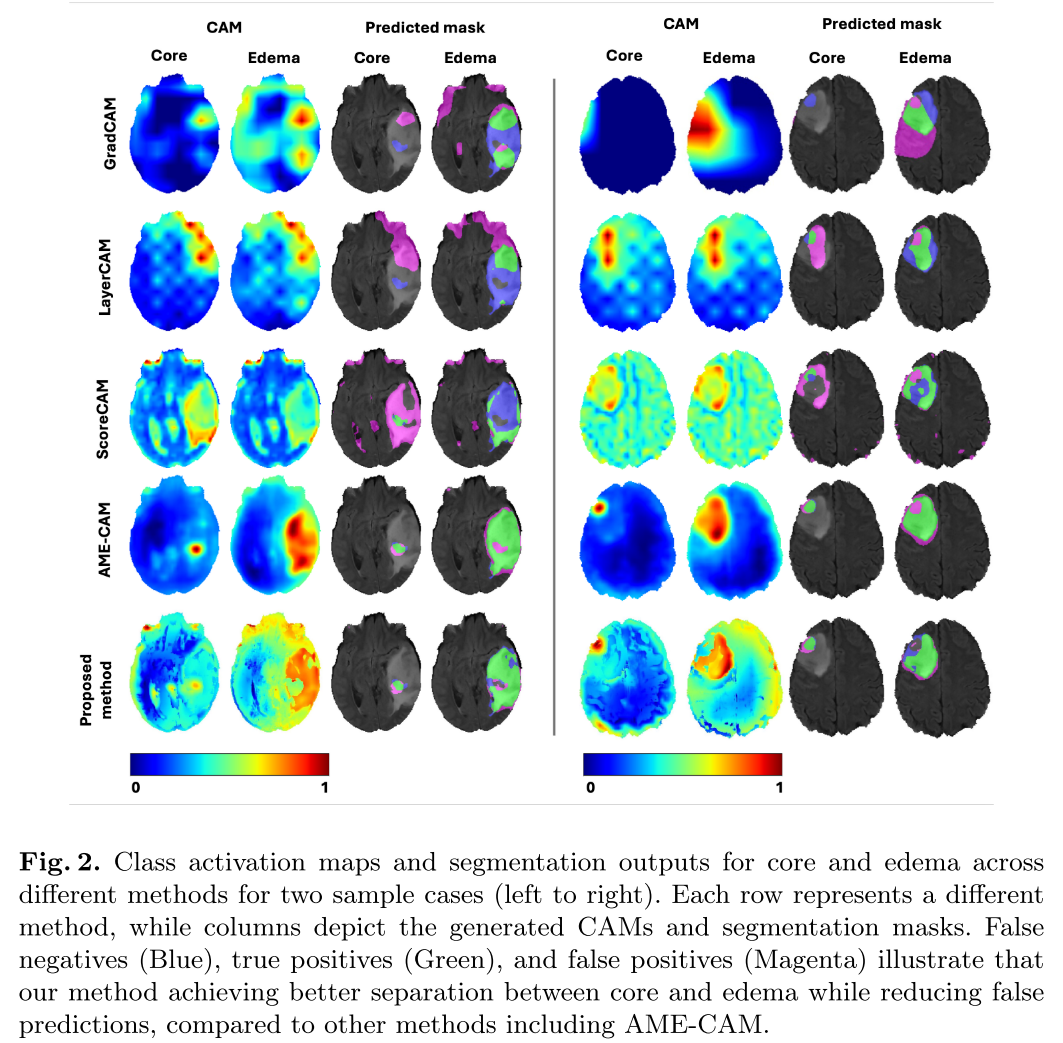

**与最先进的方法进行比较。**我们将我们的方法与现有的基于CAM的方法进行了比较:GradCAM20、LayerCAM14、ScoreCAM22和最先进的方法AME-CAM8。对于AME-CAM,我们针对每一类分别训练分类器和聚集模型,以适应多类问题。现有的基于CAM的方法分割质量差,边界定位不精确,这反映在它们较低的骰子(<;0.700)和IOU分数(<;0.700)和较高的HD95值(>;100)。值得注意的是,这些方法倾向于为两个类产生类似的凸轮,导致预测的类前景显著重叠。尽管AME-CAM显示了改进的空间精度,但用于水肿的CAM图仍然倾向于传播到核心区,如图2所示(第四行;洋红颜色显示假阳性),导致不同类别前景之间的重叠。相反,我们的方法生成互不相容的核心和水肿型前景凸轮,几乎在所有度量上都实现了最佳的分割性能,确保了空间一致和相互排斥的预测。

此外,AME-CAM的一个主要缺点是需要为每个类训练单独的分类器和聚合模型,这使得它的计算成本很高,并且对于具有更多类的数据集的可扩展性较差。相反,我们的方法只使用两个多出口分类器(多类和二进制)和额外的1×1卷积层(每个卷积层用于额外的类),从而在不增加计算开销的情况下有效地处理额外的类。

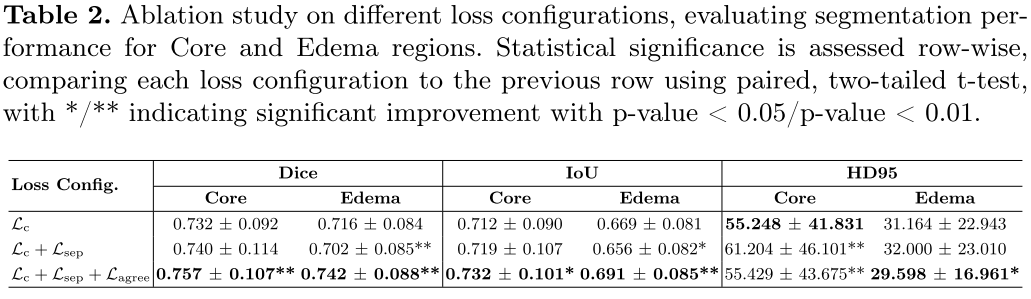

**消融实验。**表2显示了单个损耗分量的添加对所提出方法的性能的影响。在消融研究中采用配对双尾t检验,以确定每个损失分量的增加对改善的意义。

将LSEP添加到基线LC有助于更好地区分核心和水肿级,这反映在水肿级的DICE和IOU上有统计上的显著改善。然而,这种分离带来了轻微的边界不一致,导致肿瘤核心类的HD95显著增加,表明空间精度降低。当进一步合并LAgree时,所有指标的分割质量都会提高。这一损失确保了预测的分割图保持在二进制整个肿瘤掩码内,导致显著更高的DICE和IOU评分,同时还改进了边界定位,如肿瘤核心和水肿级的HD95降低所示。总体而言,分类区域的分离(LSEP)和将它们限制在整个肿瘤区域内(LGRAGE)的组合效果导致了最准确和空间一致的分割。