AutoGen:揭秘微软开源的多智能体协作操作系统

当单个大语言模型(LLM)面对复杂任务捉襟见肘时,一群分工明确、能通过"对话"自主协作的AI智能体,正通过微软开源的AutoGen框架成为现实,它将彻底改变我们构建AI应用的方式。

在人工智能领域,我们正见证一个关键的范式转变:从依赖单一的、全能的大型语言模型(LLM),转向由多个专业化、可协作的智能体(Agent) 组成的系统。这一转变的核心挑战在于如何高效地编排、管理与调试这些智能体之间的复杂交互。微软推出的开源框架 AutoGen ,正是为应对这一挑战而生。它不仅仅是一个"工具箱",更是一个完整的多智能体协作操作系统,旨在通过智能体间的自动化对话,解决那些对单个模型而言过于复杂的任务。

项目介绍:从"独奏"到"交响乐"

AutoGen是微软开源的、通用的多智能体对话框架。其核心设计哲学可以用一个贴切的比喻来理解:构建一个高效运作的"AI公司"。

在这个"公司"里,不同职责的智能体扮演着员工角色。例如,一个"程序员"智能体负责编写代码,一个"审查员"智能体负责检查代码质量,一个"执行员"智能体则负责运行代码并反馈结果。这些"员工"通过框架内置的"通信系统"(消息总线)进行对话协作,共同完成用户提出的复杂需求,比如"分析数据并生成可视化报告"。

AutoGen的魅力在于,它将复杂的LLM工作流简化为智能体间的对话。开发者无需手动管理调用顺序和状态传递,只需定义好智能体的角色和协作规则,剩下的对话、决策乃至工具调用(如执行代码、搜索网络),都可以由智能体们自主完成,并允许人类在关键节点无缝介入。这种模式极大地提升了解决复杂问题的能力、系统的可靠性和开发效率。

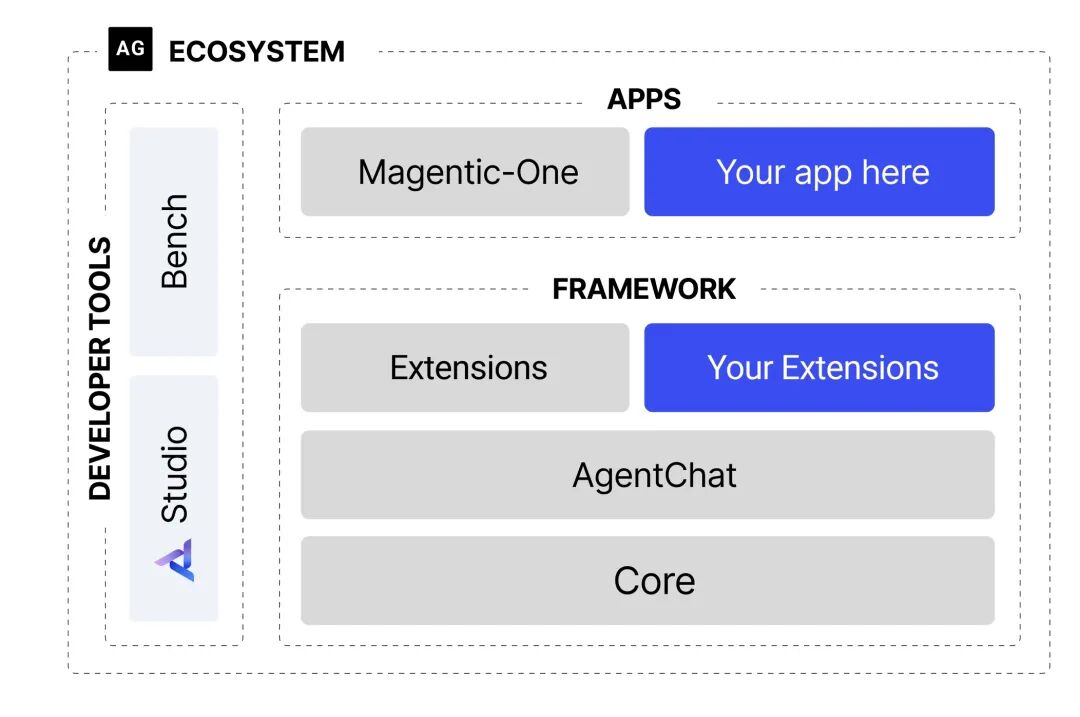

核心架构:模块化与分层设计的智慧

AutoGen的架构设计体现了高度的模块化和清晰的层次分离,使其既强大又灵活。

分层架构解析

AutoGen采用清晰的四层架构,每一层都职责明确:

-

autogen-core(基础设施层) :这是整个框架的基石,相当于公司的"办公楼和通信系统"。它定义了最基础的智能体运行时、消息传递协议和事件驱动模型。其基于Actor模型的设计,确保了每个智能体都是独立的执行单元,天然支持高并发和容错。

-

autogen-agentchat(高层应用层) :这一层提供了预先构建好的、开箱即用的智能体和团队协作模式,如

AssistantAgent(助手)、UserProxyAgent(用户代理)和GroupChat(群聊)。开发者可以直接使用这些"标准化团队"快速搭建应用。 -

autogen-ext(生态集成层):作为连接外部世界的桥梁,它集成了丰富的模型提供商(如OpenAI、Anthropic Claude、Google Gemini及本地Ollama模型)、工具(如代码执行、网页浏览)和存储系统(如向量数据库)。

-

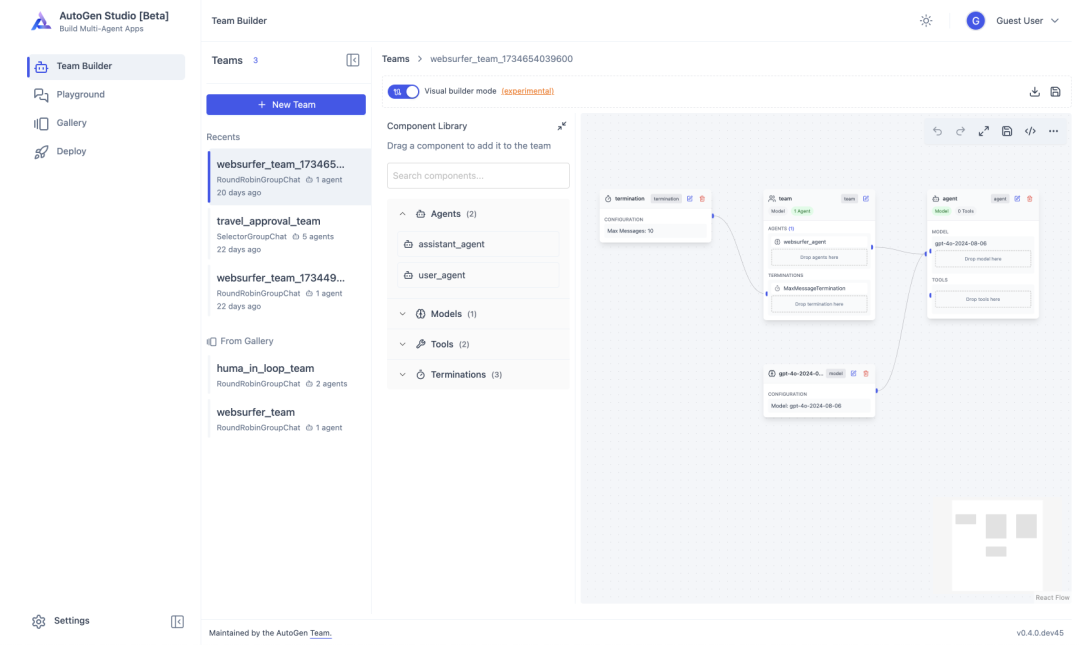

autogen-studio(可视化层) :这是一个革命性的无代码(No-Code)Web IDE。它提供了直观的拖拽界面,让开发者无需编写代码即可设计、调试、部署智能体工作流,极大降低了多智能体系统的入门门槛。

项目组织与核心技术栈

AutoGen项目采用Monorepo(单体仓库)方式进行管理,所有模块在一个仓库中,但保持独立,便于协同开发和版本管理。其技术栈选择现代且高效:

-

编程语言:以Python为主,这是AI社区的事实标准。

-

包管理 :使用uv替代传统的pip,依赖安装速度提升10-100倍,完美支持Monorepo。

-

通信与可观测性:集成gRPC用于高性能分布式通信,并采用OpenTelemetry标准实现分布式追踪,便于调试复杂的多智能体交互。

核心功能与优势:为何选择AutoGen?

与其他AI应用框架相比,AutoGen在多智能体协作这一核心赛道上展现出独特优势:

| 对比维度 | AutoGen | LangChain | CrewAI |

|---|---|---|---|

| 核心范式 | 多智能体协作操作系统 | AI应用组件工具箱 | 固定模式的智能体团队 |

| 协作焦点 | 高度灵活的自定义对话拓扑 ,支持任意复杂协作 | 链式(Chain)或代理(Agent)式调用,协作模式相对简单 | 提供序列、层级等预设协作模式 |

| 架构基础 | 基于Actor模型的事件驱动 ,原生支持分布式 | 基于函数调用的流程编排 | 基于角色分工的团队模拟 |

| 人类参与 | 无缝、灵活的人机交互 ,可在对话任意环节介入 | 通常在设计好的节点进行干预 | 支持人工监督 |

| 调试与可视化 | 提供强大的Studio无代码调试界面 | 依赖第三方或自定义工具 | 调试工具相对基础 |

除了上述对比优势,AutoGen的具体功能亮点还包括:

-

可对话的智能体:每个智能体都有统一的对话接口,可以发送、接收和处理消息,这是协作的基础。

-

混合能力集成 :智能体可以灵活组合LLM能力、人类输入和工具调用。例如,一个智能体可以调用LLM生成代码,另一个智能体负责安全执行它,人类可以在代码执行前进行审核。

-

简化复杂工作流:通过将工作流转化为多轮对话,自动处理错误恢复、迭代优化等复杂逻辑,显著降低了开发难度。

快速开始:从安装到第一个对话

环境安装

安装AutoGen非常简单,使用pip即可完成。建议使用Python 3.10或更高版本。

pip install autogen基础代码示例:双智能体对话

以下是一个经典的"编码助手"场景示例,展示了UserProxyAgent(代表用户,可执行代码)与AssistantAgent(AI助手)如何协作。

from autogen import AssistantAgent, UserProxyAgent

# 1. 配置LLM模型,例如使用Azure OpenAI或本地Ollama

config_list = [

{

"model": "gpt-4",

"api_key": "YOUR_OPENAI_KEY",

}

]

# 2. 创建AI助手智能体

assistant = AssistantAgent(

name="助理",

system_message="你是一个专业的Python程序员。",

llm_config={"config_list": config_list},

)

# 3. 创建用户代理智能体(可执行代码)

user_proxy = UserProxyAgent(

name="用户",

human_input_mode="NEVER", # 设置为自动执行,无需人工每次确认

code_execution_config={"use_docker": False}, # 在本地执行代码(注意安全)

)

# 4. 发起对话任务

user_proxy.initiate_chat(

assistant,

message="请编写一个Python函数,计算斐波那契数列的前n项,并测试n=10的情况。"

)当这段代码运行时,AssistantAgent会生成Python代码,UserProxyAgent会自动执行该代码并将结果(成功输出或错误信息)反馈给助手。助手根据反馈进行调试,直到任务完成。整个过程完全自动化,模拟了程序员编写、运行、调试的完整流程。

实战应用场景

AutoGen的灵活性使其在众多领域具有广泛的应用潜力:

-

智能软件开发:自动完成从需求理解、代码生成、单元测试到漏洞审查的完整开发闭环。

-

复杂数据分析:组织数据收集、清洗、分析和可视化的智能体协同工作,生成深度分析报告。

-

智能客服与决策支持:构建由多个专业客服、查询专家和审核员组成的虚拟团队,处理复杂咨询与交易。

-

科学研究与创意生成:协助科研人员进行文献调研、假设推演,或为创作者提供多角度的头脑风暴和内容评估。

Thoughtworks的技术雷达报告也指出,其团队已成功利用AutoGen为客户构建AI驱动平台,其中不同代理分别负责代码生成、审查和文档摘要等特定技能,展示了其在生产环境中的实用性。

总结与展望

AutoGen代表了构建下一代LLM应用的前沿方向。它通过多智能体对话 这一巧妙的抽象,将复杂问题分解为可管理的、自动化协作的"社交"过程。其模块化的架构 、对人类参与的深度支持 ,以及革命性的AutoGen Studio无代码工具,共同构成了一个强大且易用的生态系统。

尽管在生产环境的极致扩展性和复杂性管理方面仍有持续探索的空间,但AutoGen无疑已经为开发者、企业乃至研究者打开了一扇新的大门。它让我们能够以更高的效率和更低的成本,驾驭多个AI智能体的集体智慧,去解决那些曾经看似不可能自动化的复杂任务。

随着多智能体系统的不断发展,像AutoGen这样致力于降低其开发与调试门槛的框架,将在推动人工智能从"工具"迈向"协作伙伴"的进程中,扮演至关重要的角色。

项目地址: