谷歌威胁情报小组(GTIG)最新报告警示,威胁行为者不再局限于对人工智能的简单试验,而是开始将生成式AI 直接整合到真实攻击工作流程中。报告特别聚焦对谷歌自家Gemini模型的滥用与针对性攻击,表明生成式AI系统正日益成为恶意工具的测试、探测对象,甚至被纳入攻击体系。

Gemini模型遭恶意代码直接调用

部分恶意软件家族在执行过程中会直接向Gemini发起API调用,动态请求模型生成源代码来完成特定任务,而非将所有恶意功能硬编码。

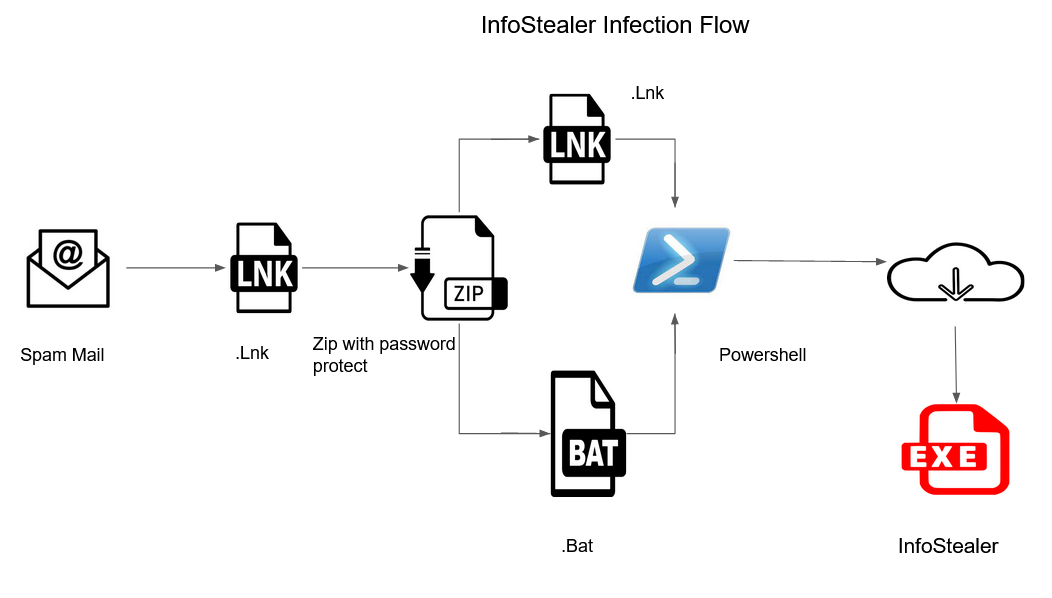

典型案例是HONESTCUE恶意软件家族(2025年9月被观察到):它通过硬编码提示向Gemini请求C#代码,随后在内存中编译并执行生成的代码,作为攻击链的第二阶段(下载并运行后续恶意负载)。这种"即时生成"技术实现文件less(无文件)攻击,可能规避传统静态分析和特征码检测。

模型提取攻击(蒸馏攻击)持续涌现

报告记录了多起模型提取攻击(知识蒸馏攻击)。威胁行为者(主要是私营部门实体)通过发送大量结构化查询,试图推断Gemini的行为模式和内部逻辑。

谷歌已识别并阻断多起高频提示活动,其中一起涉及超过10万个提示,旨在复制模型的推理能力。攻击者可借此低成本近似复现专有模型功能。

AI渗透网络攻击全生命周期

国家背景组织(包括与中国、伊朗、朝鲜相关的威胁行为者)和金融动机团体正将AI工具整合进攻击的各个阶段:

- 侦察与目标画像

- 漏洞研究与恶意代码开发

- 钓鱼诱饵生成

- 后渗透活动

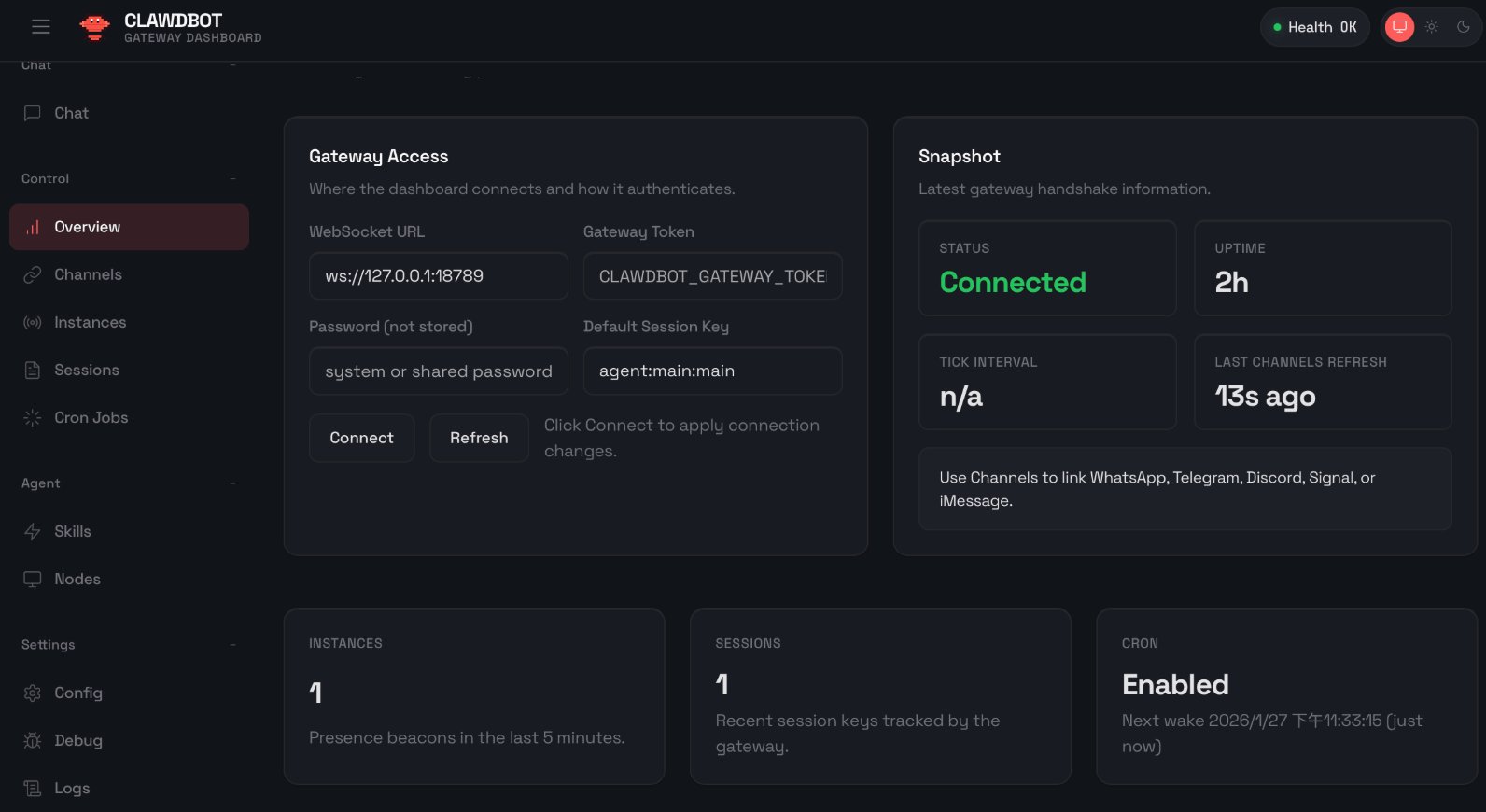

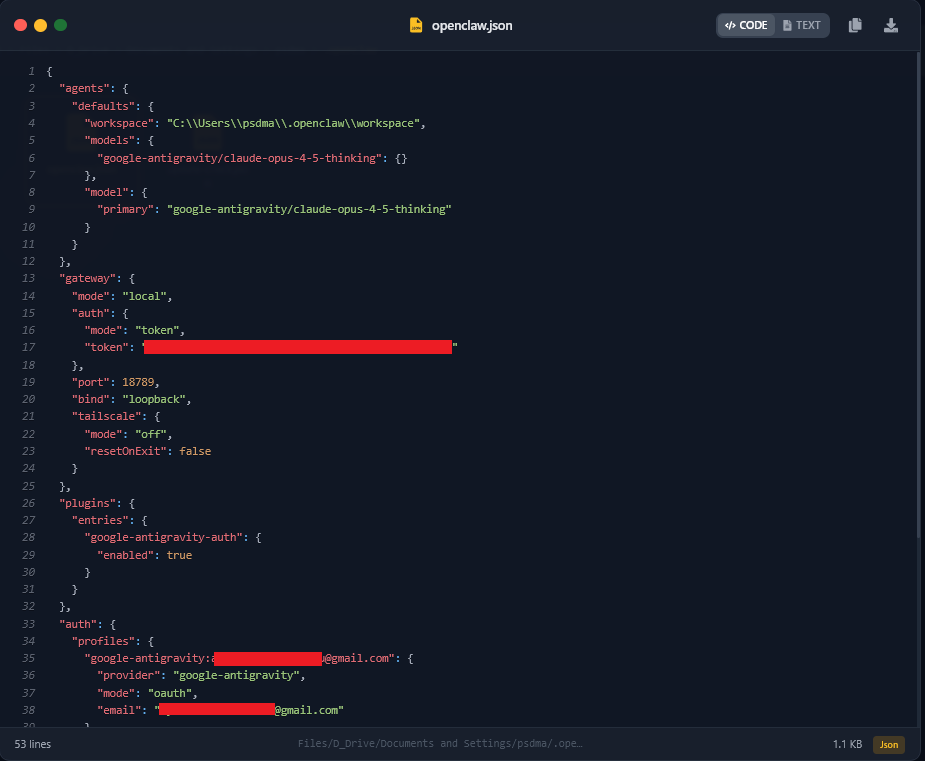

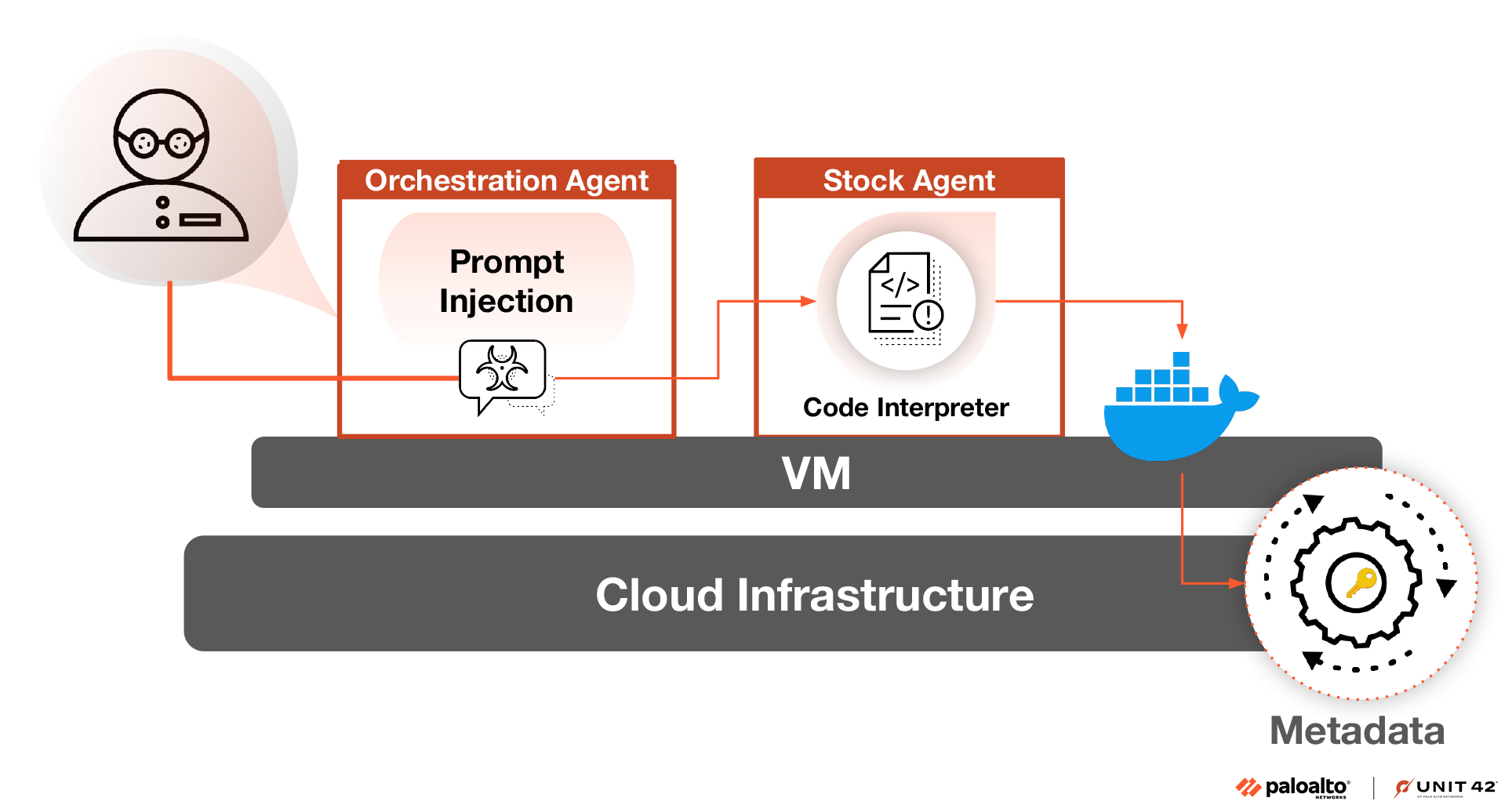

报告还提到威胁行为者正在探索Agentic AI(具备代理能力的AI系统),但目前尚未发现其被广泛部署,大多数案例仍是对人类操作者的能力增强,而非完全替代。

业界专家质疑报告动机

ImmuniWeb SA首席执行官Ilia Kolochenko博士表示,这份报告似乎是谷歌在投资者对生成式AI兴趣消退之际的公关举措。

他提出两点反驳:

- 即使APT组织使用生成式AI,也不意味着AI已能独立创建复杂恶意软件或完成完整攻击链;AI主要加速简单流程。

- 谷歌明知国家级团体滥用其AI技术,可能需为相关攻击损失承担法律责任。构建防护栏和客户尽职调查成本并不高。

Kolochenko强调:"核心问题在于责任归属。"