引言:算力碎片化时代的"异构"困局

在推进企业数字化转型的深水区,AI 视频分析项目常因算力底座的碎片化 而陷入泥潭。一边是数据中心昂贵的 NVIDIA GPU,另一边是边缘侧琳琅满目的国产 NPU(如瑞芯微、华为昇腾、算能等),开发者往往需要针对不同芯片编写不同的推理代码,甚至维护多套软件架构。这种"烟囱式"开发不仅导致了约 95% 的重复造轮子工作,更使得算法在不同硬件间的迁移成本高企。

如何构建一套**"一次开发,处处运行"**的统一架构?YiheCode Server 给出的答案是:硬件抽象层(HAL)与容器化部署。本文将深入剖析该平台如何通过微服务架构,打通 X86 与 ARM 的指令集壁垒,实现 GPU 与 NPU 的统一调度,为企业级应用构建高可用的 AI 视频底座。

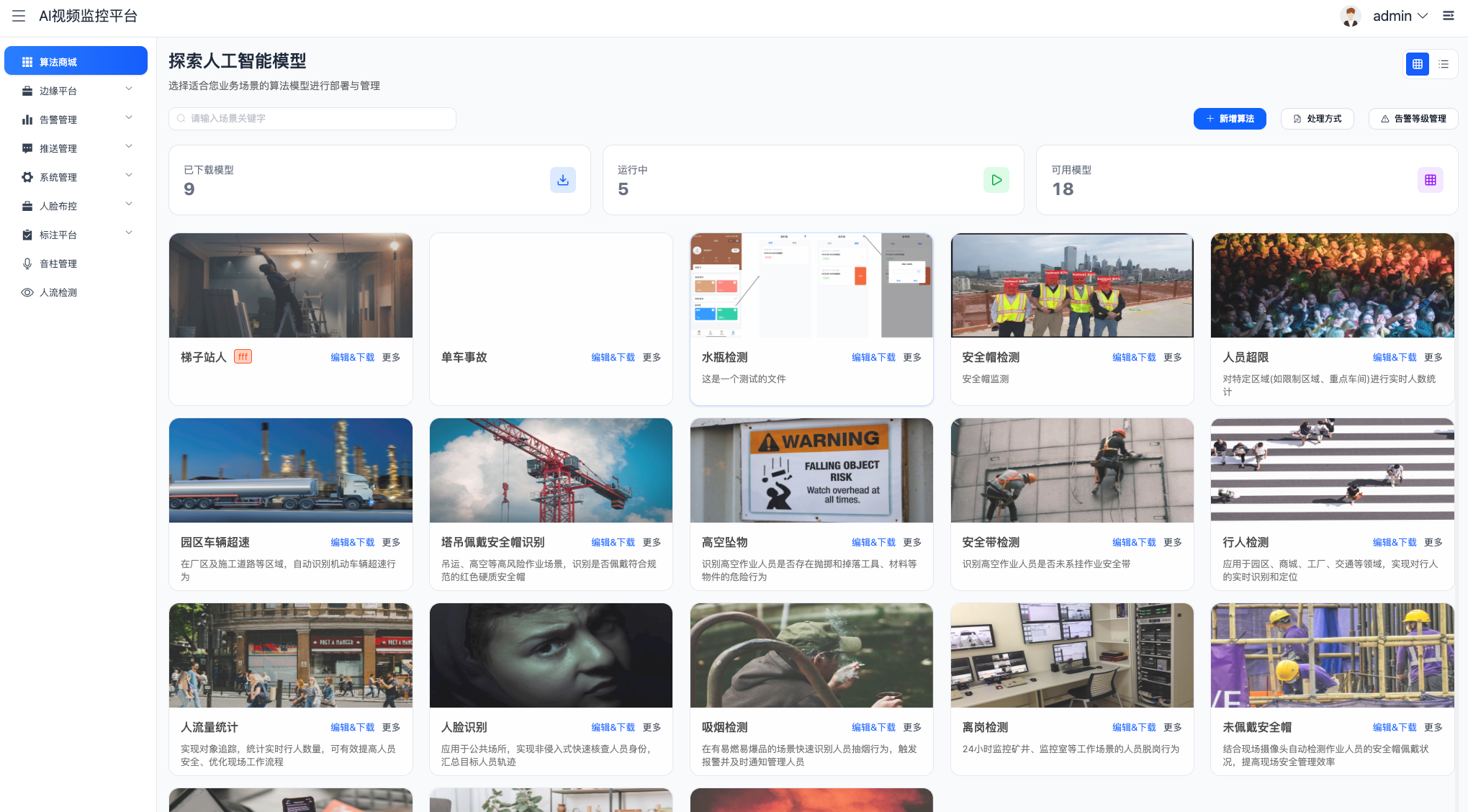

一、 核心架构:微服务与边缘计算的拓扑解耦

YiheCode Server 采用经典的前后端分离 + 边缘协同 架构。后端基于 Spring Boot 2.7 构建管理中枢,前端采用 Vue 2.6 实现可视化操作,而最核心的差异化在于其边缘计算层的设计。

该架构将系统划分为两个核心域:

- 管理域(云端/中心端):负责设备管理、算法商城、告警推送及用户权限控制。

- 计算域(边缘端):负责视频流的拉取、解码、AI 推理及告警触发。

这种解耦设计使得管理服务器可以部署在 X86 架构的虚拟机中,而推理服务器则可以灵活部署在 ARM 架构的边缘盒子上,互不干扰。

1.1 系统交互时序图

text

+-------------------+ +---------------------+

| Vue 前端 (Web) |<--->| Spring Boot 管理端 | <-- X86/ARM 通用

+--------+----------+ +----------+----------+

| (HTTP/WebSocket) | (MQTT/gRPC)

| |

| v

+--------+---------------------------+------------------+

| 边缘计算节点集群 (异构硬件) |

| +----------------+ +----------------+ +--------------+ |

| | ARM NPU 盒子 A | | X86 GPU 服务器 B| | 通用 RTSP 节点| |

| | (瑞芯微/算能) | | (NVIDIA/Intel) | | (ZLMediaKit) | |

| | 实时 AI 推理 | | 高并发 AI 推理 | | 视频流转发 | |

| +----------------+ +----------------+ +--------------+ |

+--------------------------------------------------------+二、 异构部署:X86 与 ARM 的统一纳管

YiheCode Server 的核心亮点在于其对跨平台指令集 的原生支持。平台通过 Docker 容器化技术,屏蔽了底层硬件的差异。

2.1 芯片抽象与统一调度

平台内置了芯片抽象层(Chip Abstraction Layer),能够自动识别接入节点的硬件型号(如 RK3588、BM1684X、NVIDIA Tesla 等)和算力信息。

- 自动匹配:当用户在"算法商城"为某路摄像头分配算法时,系统会根据该路流的分辨率和算法模型(ONNX/RKNN/OM 等)的算力需求,自动匹配具备相应解码和推理能力的边缘节点。

- 动态负载:系统监控节点的 CPU/GPU/NPU 占用率,遵循"最小数原则"将任务分配给负载最低的节点,避免单点过载。

2.2 容器化部署的最佳实践

基于 Docker 的部署方式,使得平台在 X86 和 ARM 环境下的安装配置完全一致。

部署流程示例:

bash

# 1. 拉取通用镜像 (ARM/X86 自动适配)

docker pull yihecode/server:latest

# 2. 启动管理服务 (X86 环境)

docker run -d --name yihe-manager \

-p 8080:8080 \

-v /data/manager/config:/app/config \

yihecode/server:latest

# 3. 启动边缘代理 (ARM 边缘盒子)

docker run -d --name yihe-edge \

--device /dev/dri:/dev/dri \ # 挂载显卡/NPU驱动

-v /data/edge/models:/models \ # 挂载模型目录

yihecode/edge:arm64 # 使用ARM专用镜像三、 边缘协同:算法与硬件的动态绑定

在 YiheCode Server 中,边缘平台模块是实现异构计算的关键。它解决了如何在不同算力设备上运行不同算法的难题。

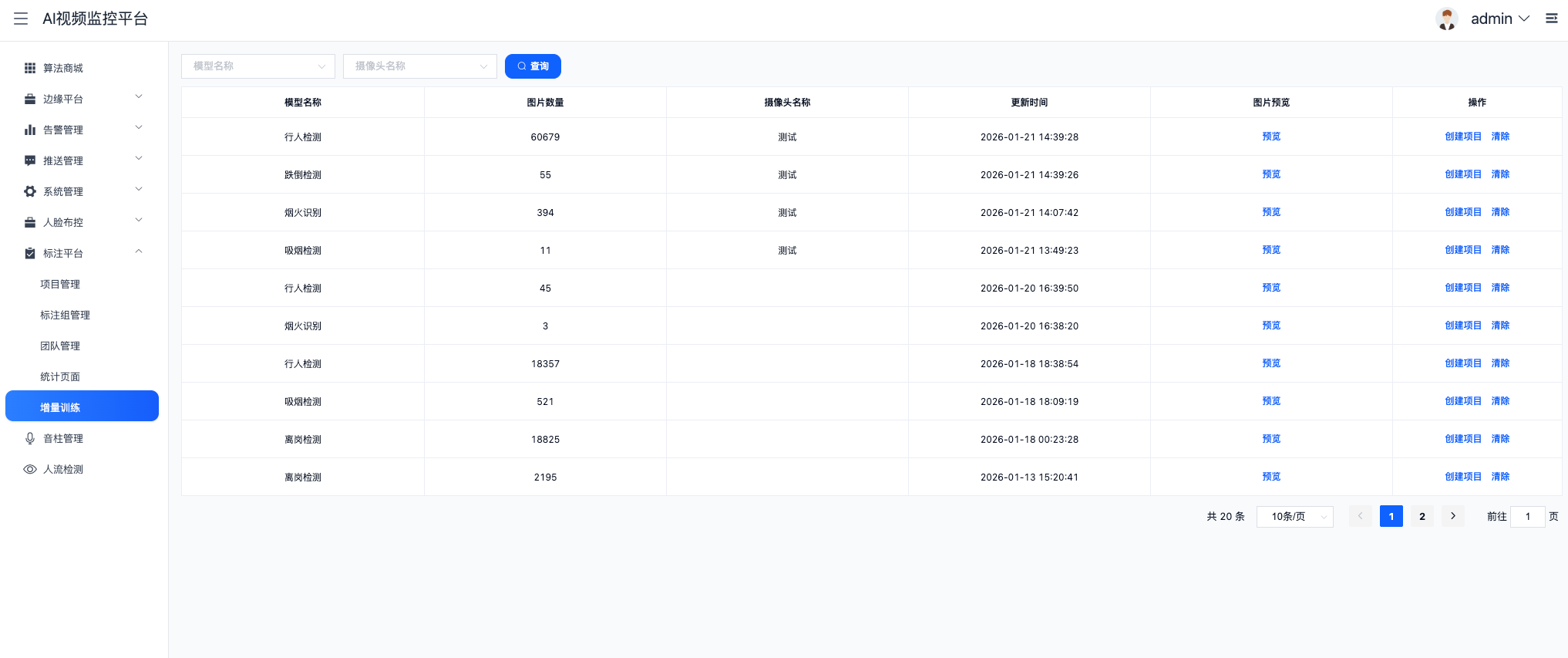

3.1 算法商城的"模型热插拔"

平台通过算法插件化机制,支持不同格式的模型文件共存。

- NPU 优化 :对于国产 ARM 芯片(如瑞芯微),平台优先加载

.rknn格式的模型,利用 NPU 进行低功耗推理。 - GPU 通用 :对于 X86 服务器,平台支持标准的

.onnx或.pb模型,利用 CUDA 进行高并发推理。

配置逻辑(边缘节点配置文件 edge_config.yaml):

yaml

hardware:

arch: "aarch64" # 自动检测架构

device_type: "npu" # 指定为NPU设备

driver:

- "/dev/rknn_accel" # 挂载NPU驱动节点

algorithm_runtime:

# 模型加载优先级策略

load_priority:

- "rknn" # 首选NPU加速格式

- "onnx" # 备选通用格式

- "opencv" # 最后降级为CPU推理

# 算法任务列表

tasks:

- camera_id: "CAM_001"

algorithm: "fire_smoke"

model_path: "/models/fire_rk3588.rknn" # 根据硬件自动选择

interval: 5 # 识别间隔(秒)3.2 智能资源分配策略

系统在分配算法任务时,会进行硬性约束检查:

- 格式兼容性:检查边缘节点是否支持该模型格式(如 CUDA 节点无法运行 RKNN)。

- 资源预留:检查节点剩余内存是否满足模型加载需求。

- 负载均衡:若多个节点均满足条件,选择当前负载最低的节点。

四、 总结

YiheCode Server 通过微服务架构 与容器化技术 ,成功构建了一个兼容 X86 与 ARM 的异构计算平台。

它利用边缘协同 机制,将复杂的芯片适配工作封装在底层,使得上层应用无需关心底层是 NVIDIA 的 GPU 还是 国产的 NPU。对于寻求私有化部署 和全硬件适配的技术决策者而言,这套架构不仅解决了算力碎片化的痛点,更通过标准化的接口,实现了"减少 95% 开发成本"的承诺,是构建企业级 AI 视频中台的理想选择。

架构师建议 :

在部署边缘节点时,请确保 Docker 容器正确挂载了硬件驱动设备(如

/dev/dri或特定的 NPU 节点)。对于 ARM 设备,建议预先在服务器端将通用模型(ONNX)转换为 NPU 专用模型(如 RKNN),以获得最佳的推理性能。