Jetson NVIDIA Jetson 全系列边缘计算芯片进阶指南

- 相关产品介绍

- 开发常用命令汇总

- 它涵盖了从最顶尖的 Blackwell (Thor) 架构到入门级 Maxwell (Nano) 架构的横向对比、软件栈映射以及实战性能分析。

一、 NVIDIA Jetson 家族谱系:从"人形机器人大脑"到"教育入门"

1. 巅峰旗舰:Jetson Thor 系列 (Blackwell 架构)

这是英伟达目前最顶尖的系列,专为具身智能(Humanoid Robotics)和生成式 AI 设计。

-

上市年份: 2024年发布(2025年量产)。

-

代表型号: Jetson AGX Thor (T5000 / T4000)。

-

应用场景: 人形机器人(Project GR00T)、高端医疗机器人、L4/L5 级自动驾驶。

-

核心优势: 算力高达 2070 TFLOPS (FP4)。支持 Transformer Engine 硬件加速,能直接在边缘端跑大语言模型(LLM)。

2. 现代主流:Jetson Orin 系列 (Ampere 架构)

-

当前市场上的绝对中流砥柱,计算能力 CC 8.7。

-

上市年份: 2022 - 2023年。

-

代表型号: AGX Orin (64GB)、Orin NX (16GB)、Orin Nano (8GB)。

-

应用场景: 工业无人机、自动导引车 (AGV)、实时多路 4K 视频分析。

-

核心优势: 相比上一代性能提升达 8 倍,原生支持稀疏化计算。

3. 经典长青:Jetson Xavier 系列 (Volta 架构)

-

计算能力 CC 7.2,首次引入 Tensor Core 的里程碑产品。

-

上市年份: 2018 - 2020年。

-

代表型号: AGX Xavier、Xavier NX。

-

应用场景: 智能交通监测、成熟的工业视觉缺陷检测。

4. 基础教育:Jetson Legacy 系列 (Maxwell/Pascal 架构)

-

型号: Jetson Nano (4GB/2GB)、TX2。

-

上市年份: 2017 - 2019年。

-

应用场景: 创客教育、学生实验、简单的图像分类。

-

痛点: 没有 Tensor Core,不支持 INT8 量化,跑 YOLOv8 非常吃力。

二、 核心参数与软件栈兼容性汇总

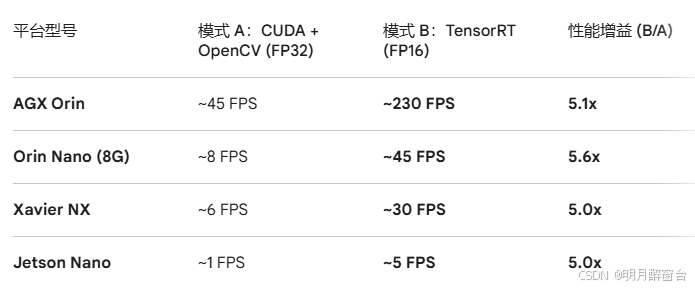

三、 YOLOv8s 性能实测对比 (640x640)

-

以 YOLOv8s (中量级模型) 为例,对比不同平台在不同驱动模式下的表现(估算 FPS):

-

- CUDA+OpenCV: 仅利用了通用的 GPU 核(CUDA Cores),由于缺乏算子融合和内存优化,速度极慢。

-

- TensorRT: 专门调用了硬件中的 Tensor Cores(Nano 除外),并进行了层融合(Layer Fusion),是 Jetson 平台的"唯一正确"打开方式。

四、 常用环境查看命令汇总

在 Jetson 上开发时,这几条命令能帮你快速定位环境状态:

-

- 系统与显卡实时状态 (神器)

bash

#安装 jtop:

pip install jetson-stats

#运行: *(可以直观看到 CPU/GPU 频率、功耗、温度以及已安装的软件版本)*

jtop-

- 查看系统 L4T 与 JetPack 信息

bash

cat /etc/nv_tegra_release-

- 查看 CUDA 版本

bash

nvcc -V-

- 查看 TensorRT 版本

bash

dpkg -l | grep nvinfer-

- 查看 cuDNN 版本

bash

cat /usr/include/cudnn_version.h | grep CUDNN_MAJOR -A 2-

- 查看 Python 环境中的 AI 库

bash

pip list | grep -E "torch|torchvision|ultralytics"- 7.查看ubuntu版本

bash

#最推荐 (显示详细发行信息):

lsb_release -a

#查看系统全面信息 (包括内核版本):

hostnamectl五、 安装路径

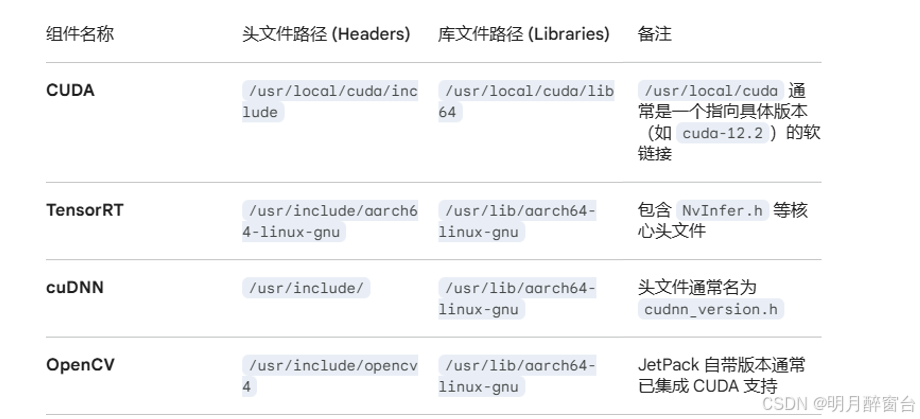

- 在 NVIDIA Jetson 设备的开发过程中,由于大部分核心库都是通过 JetPack 预装的,了解它们的默认物理路径对于配置 CMakeLists.txt、编写 Makefile 或排查 Python 环境问题至关重要。

-

- 核心组件路径汇总表

- 核心组件路径汇总表

- . 查找 TensorRT 版本及路径

bash

dpkg -L libnvinfer-dev | grep h # 查找头文件位置

dpkg -L libnvinfer8 | grep so # 查找动态库位置- 快速定位 trtexec (模型转换神器)

很多开发者找不到 trtexec 在哪,可以直接运行:

bash

find /usr -name trtexec

# 通常结果是:/usr/src/tensorrt/bin/trtexec