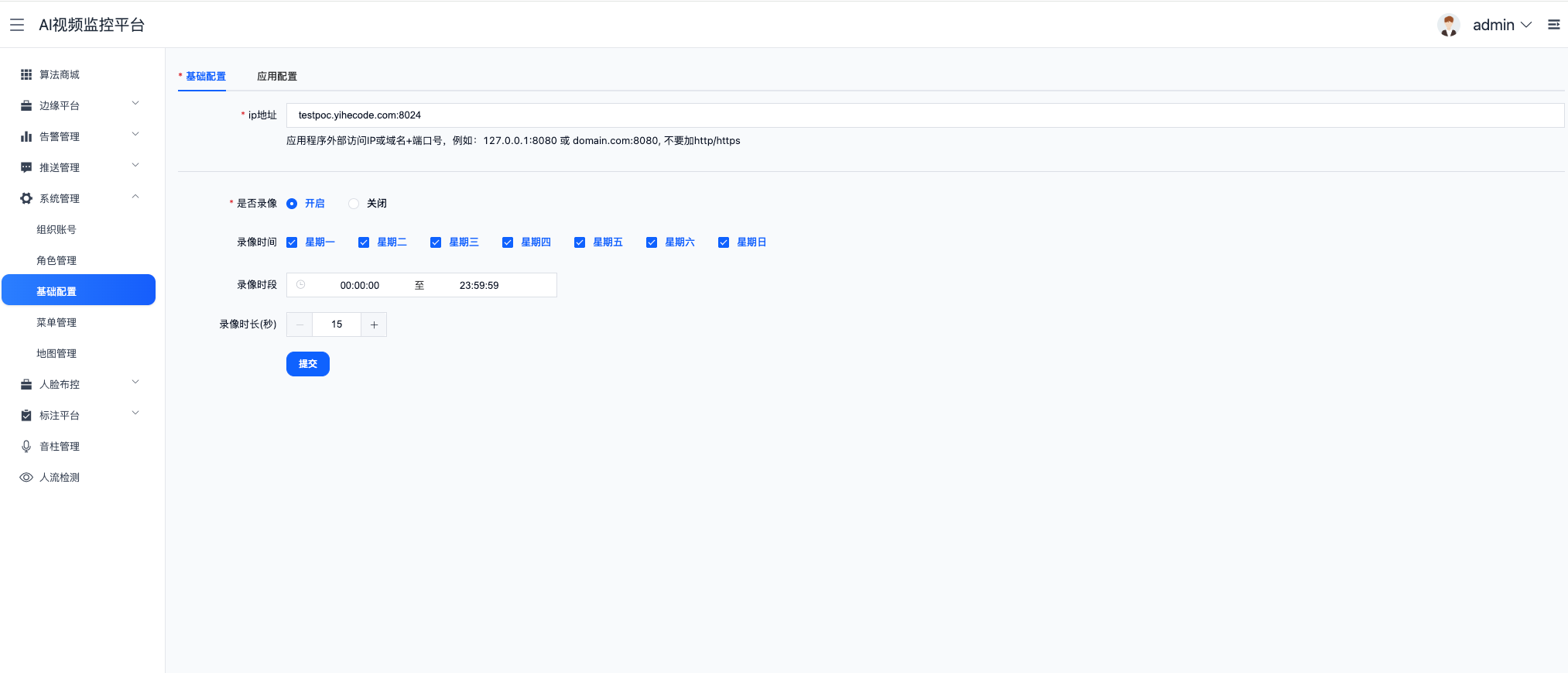

引言:算力孤岛与硬件碎片化的挑战

在构建企业级 AI 视频管理平台时,架构师面临的最大挑战往往不是算法模型的精度,而是"硬件环境的异构性"。项目现场可能同时存在基于 x86 架构的旧款 GPU 服务器、基于 ARM 架构的国产化边缘盒子(如瑞芯微、晶晨等),甚至是不同品牌的 NPU 加速卡。传统的监控软件通常绑定特定的操作系统和硬件驱动,导致企业在扩容时不得不废弃旧设备,或者被迫采购单一昂贵的品牌方案。这种"算力孤岛"现象,不仅增加了硬件投入成本,更让开发团队陷入为不同芯片重复开发 SDK 的泥潭,极大地拖累了项目交付进度。

如何构建一套既能兼容老旧 x86 设备,又能调度新型 ARM 边缘算力的统一平台?YiheCode Server 给出的答案是"软硬解耦 + 容器化调度"。这不仅仅是一个基于 Spring Boot 2.7 + Vue 2.6 的开源项目,更是一个深度集成 ZLMediaKit 流媒体集群与边缘计算管理的异构计算架构。本文将深入解析其如何通过微服务与边缘节点通信技术,实现对多品牌 GPU/NPU 的统一纳管,帮助企业削减约 95% 的硬件适配开发成本。

一、 异构部署架构:从芯片绑定到指令集解耦

YiheCode Server 的核心设计理念在于分层解耦。它将业务逻辑层(Java/Vue)与算力执行层(边缘盒子)彻底分离,从而实现了对底层硬件的"无感"兼容。

1.1 跨平台指令集支持

根据 Gitee 仓库文档,平台支持 x86、ARM 等指令集平台部署。这在架构上意味着:

- 后端业务容器化:Spring Boot 应用被打包为 Docker 镜像,运行在中心服务器(通常是 x86_64)上,负责用户管理、权限控制和任务分发。

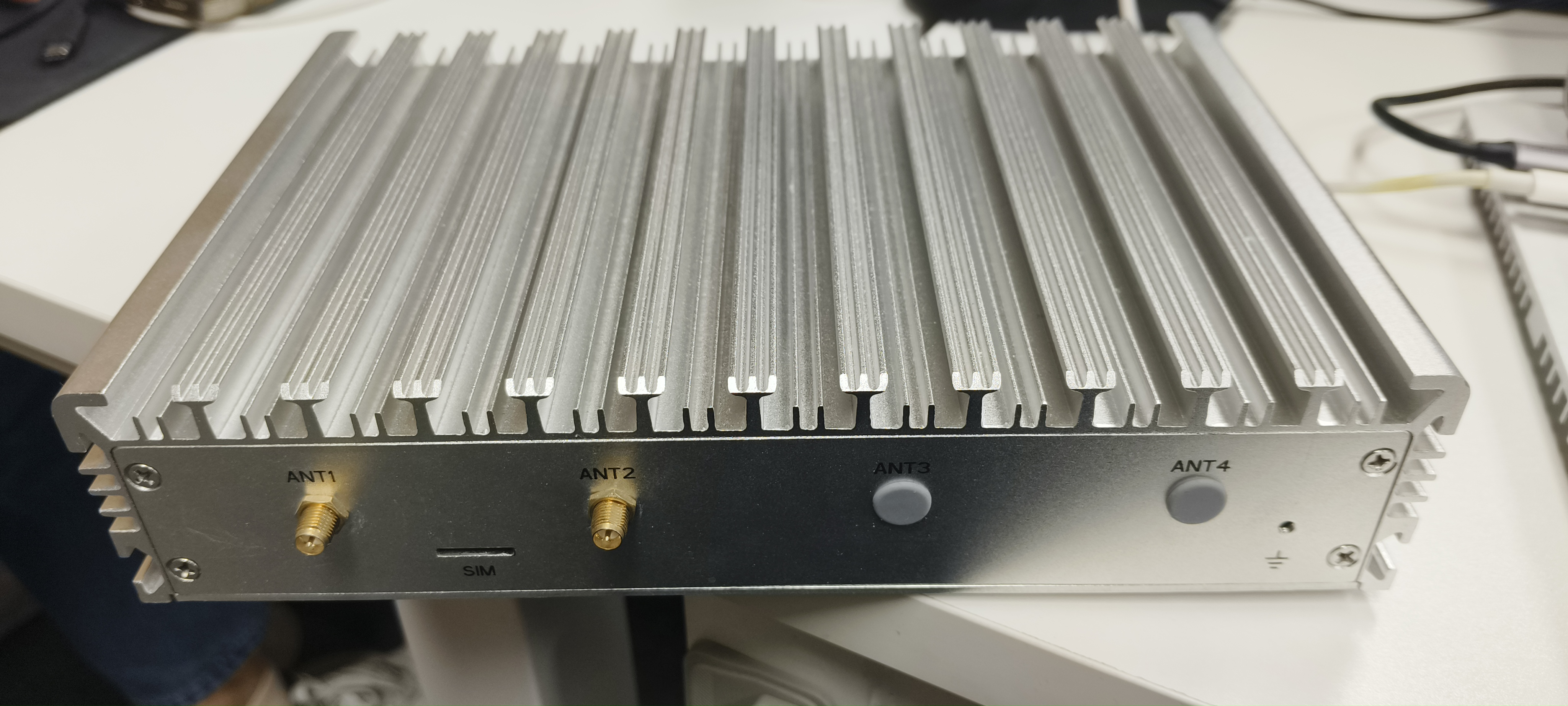

- 边缘算力插件化:具体的视频解码和 AI 推理任务被下放给"边缘盒子"。只要边缘盒子的操作系统(通常是 Linux)能够运行对应的推理引擎(如 ONNX, NCNN, 或厂商私有 SDK),它就能被平台识别并纳入算力池。

1.2 硬件接入矩阵

平台构建了一套灵活的硬件接入体系,适应从云端到边缘的多种场景:

| 硬件类型 | 架构/芯片 | 适用场景 | 技术实现 |

|---|---|---|---|

| 云端服务器 | x86_64 (Intel/AMD) | 大规模流媒体转发、存储 | 基于 Docker 部署 ZLMediaKit,处理 RTSP/RTMP 流 |

| 边缘计算盒 | ARM (Rockchip, Amlogic) | 实时视频分析、本地告警 | 部署轻量级 Agent,负责拉流、推理、回传 |

| 加速卡/NPU | PCIe/M.2 (自定义品牌) | 高密度 AI 推理 | 支持客户定制化 GPU 品牌驱动对接 |

| 通用设备 | Any CPU | 简单的视频预览 | 基于 WebRTC/HLS 的软解码播放 |

二、 核心调度逻辑:ZLMediaKit 流媒体集群与边缘心跳

Gitee 仓库文档详细描述了新系统架构图中关于ZLMediaKit 节点分配与录像控制的逻辑。这是实现高性能异构计算的关键。

2.1 动态负载均衡策略

文档中提到,摄像头新增或国标流接入时,系统会自动按"最小负载"原则指定到一个 ZLM 节点。这种设计允许企业在同一个集群中混合部署高性能 x86 服务器(用于处理 4K 视频流)和低功耗 ARM 设备(用于处理 1080P 视频流)。

边缘节点注册与任务分配逻辑(伪代码):

python

# 伪代码:边缘算力节点注册与心跳

class EdgeNodeManager:

def register_node(self, node_info):

"""

边缘盒子启动时上报硬件信息

node_info: {

"arch": "aarch64", # 架构类型

"chip": "RK3588", # 芯片型号

"npu_type": "RKNPU", # NPU类型

"load": 0.2 # 当前负载

}

"""

db.save_node(node_info)

# 将该节点加入可用算力池

scheduler.add_to_pool(node_info)

def allocate_camera(self, camera_request):

# 1. 查询算力池中负载最低且架构兼容的节点

target_node = scheduler.find_least_loaded_node(

arch=camera_request.get('preferred_arch', 'any')

)

# 2. 下发拉流指令 (RTSP/GB28181)

# ZLMediaKit 节点负责具体的协议交互和流媒体转发

params = build_zlm_params(camera_request)

response = zlm_api.call(target_node, 'addStreamProxy', params)

# 3. 更新数据库映射

db.update_camera_proxy(camera_request.id, target_node.id)

return response2.2 智能录像控制 (Record Control)

文档详细描述了录像控制程序的逻辑:"3.1 录像控制定时 5 分钟判断一次是否录像"。这种基于时间窗口的策略,有效避免了频繁的 I/O 操作,特别适合资源受限的边缘 ARM 设备。

- 逻辑解析 :

- 定时轮询:中心服务每隔 5 分钟检查一次数据库中的"录像任务表"。

- 差异对比:对比当前需要录制的摄像头列表与 ZLM 节点实际拉流的列表。

- 指令下发:如果需要录制但未拉流,中心服务会控制 ZLM 节点开始拉流并录制(MP4/FLV);如果是国标流,通常由算法启动时主动拉流,避免冗余带宽占用。

三、 边缘计算与容器化部署实践

为了实现"全硬件适配",YiheCode Server 采用了标准的云原生部署方案。

3.1 Docker Compose 部署架构

基于文档要求的环境,标准的私有化部署方案如下:

yaml

version: '3.5'

services:

# 1. Web 服务 (业务逻辑,运行在 x86/ARM 皆可)

web-server:

image: openjdk:8-jre

environment:

- SERVER_PORT=8080

depends_on:

- zlm

# 2. ZLMediaKit 流媒体节点 (核心转发,建议运行在 x86)

# 支持多实例横向扩展,每个实例可绑定不同的 CPU 核心

zlm-node:

image: zlmediakit/zlmediakit:master

# 透传设备,以便支持硬件编解码

devices:

- /dev/dri:/dev/dri

ports:

- "1935:1935" # RTMP

- "8554:8554" # RTSP

- "8000:8000/udp" # GB28181 SIP

# 3. 边缘代理 (可选,运行在 ARM 边缘端)

edge-agent:

image: custom/arm64v8-agent

# ARM 设备专用镜像

environment:

- ARCH=aarch64

- EDGE_MODE=true3.2 边缘盒子管理

通过平台的"边缘平台"模块,管理员可以直观地看到不同架构设备的运行状态:

- 芯片识别:自动识别并显示芯片类型(如 1684x, RK3588 等)。

- 版本管理:支持对边缘盒子的算法程序进行远程版本升级与降级,无需现场维护。

- 参数配置:控制识别告警间隔,适应不同算力设备的性能上限。

四、 总结

YiheCode Server 通过ZLMediaKit 流媒体集群 与边缘节点解耦 ,成功构建了一个硬件无关 的 AI 视频底座。

对于技术决策者而言,这套系统最大的价值在于:它将"适配 10 种不同芯片 SDK"的复杂性,转化为"配置 1 套标准 Docker 容器"的简单性。无论是老旧的 x86 服务器,还是最新的 ARM 边缘盒子,都能通过这套系统实现统一调度、统一告警、统一回放。这种"一次开发,处处运行"的异构架构,正是实现"减少 95% 开发成本"并保护企业既有硬件投资的核心所在。

架构师建议 :

在部署大规模异构集群时,建议将 ZLMediaKit 流媒体服务独立部署在物理机或高性能云主机(x86)上,负责核心流媒体转发;而将 AI 推理任务下沉到 ARM 边缘盒子上执行,以降低中心节点的算力压力并节省带宽成本。