在当下的技术领域,Token早已不是陌生词汇------从AI大模型的文本处理、互联网的身份验证,到区块链的权益流转,它贯穿了多个核心场景。2026年3月,国家数据局正式将Token定名为"词元",进一步明确了其在数字时代的价值锚点地位。但对于开发者而言,真正核心的疑问往往是:Token的技术计算方式到底是什么?不同场景下的计算逻辑有何差异?如何规避计算过程中的常见坑?本文将从底层原理、主流算法、多场景计算逻辑及实战注意事项入手,用通俗的语言+实战案例,帮你彻底吃透Token的技术计算。

一、先厘清:Token的核心定义与计算本质

在深入计算方式之前,我们首先要明确:Token(词元)的本质是"数字世界的通用权利凭证或最小处理单元",其计算方式完全取决于应用场景------不同领域的Token,计算逻辑、核心目的截然不同,但核心都是"将人类可理解的信息,转化为计算机可处理、可验证的标准化数据"。

简单来说,Token的计算过程,本质是"编码、计量或加密校验"的过程:

-

AI大模型场景:Token是文本处理的最小单元,计算核心是"文本分词与量化",用于计量算力消耗和文本处理范围;

-

身份验证场景(如JWT):Token是安全凭证,计算核心是"信息加密与签名",用于验证身份合法性;

-

区块链场景:Token是权益载体,计算核心是"哈希运算与共识校验",用于确保权益流转的不可篡改;

-

平台权益场景:Token是福利凭证,计算核心是"规则量化与权益映射",用于关联用户行为与福利价值。

很多开发者容易混淆不同场景的Token计算逻辑,比如将AI Token的分词计算与JWT的加密计算混为一谈,这也是后续开发中出现问题的主要原因。下面我们逐一拆解各场景的核心计算方式。

二、核心场景1:AI大模型中Token的计算方式

当前AI大模型的普及,让"Token计算"成为开发者高频接触的需求------使用豆包、ChatGPT、Kimi等工具时,"按Token计费""上下文窗口限制",本质都是基于Token的计算逻辑。这里的Token计算,核心是"文本分词与量化",目的是将自然语言转化为模型可处理的数字单元。

2.1 核心计算原理:分词器(Tokenizer)的作用

AI大模型无法直接识别原始文本(汉字、英文等),必须通过"分词器"将文本拆解为最小的语义单元(Token),再将其映射为数字ID,才能进行后续的矩阵运算。整个计算流程分为3步:

-

文本输入:开发者输入的提问、待处理的文本(如"如何实现Token加密?");

-

分词处理:分词器通过特定算法,将文本拆分为Token(如"如何""实现""Token""加密""?");

-

数字映射:将每个Token对应到模型词表中的唯一数字ID(如"Token"对应ID:75232),最终以ID数组的形式输入模型。

这里的关键的是:Token不等同于汉字或单词,而是"语义最小单元"------中文中1个Token约等于1个汉字(估算值),英文中1个Token约等于3-4个字母,具体取决于分词算法和模型词表。例如:"unbelievable"可能被拆分为("un""believ""able")3个Token,"机器学习"可能被拆分为1个或2个Token。

2.2 主流分词算法(核心计算逻辑)

Token的分词计算,核心依赖3种主流算法,不同算法的计算逻辑、适用场景差异较大,开发者需根据模型类型选择,具体对比如下:

| 算法名称 | 核心计算逻辑 | 适用场景 | 代表模型 |

|---|---|---|---|

| BPE(字节对编码) | 从字符开始,迭代合并高频邻接字符/子词,构建固定大小词表,兼顾未登录词处理与Token数量控制 | 中英文通用,适合大模型高效处理 | GPT系列、MiniMax M2.5 |

| WordPiece | 基于概率统计,将词拆分为子词,优先拆分高频子词,减少Token数量 | 英文为主,适合NLP任务(如情感分析) | BERT、ERNIE |

| SentencePiece | 不依赖空格分词,支持多语言,将文本视为字符序列,动态拆分Token | 多语言场景(中日韩文等无空格语言) | Gemini系列、Kimi K2.5 |

补充说明:早期的"按词划分""按字符划分"算法已基本被淘汰------按词划分无法处理未登录词(OOV),按字符划分会导致Token数量过多、计算成本飙升,仅在简单场景中偶尔使用。

2.3 实战计算示例(Python)

使用Hugging Face的Tokenizer库,可直接实现Token的分词与ID映射计算,代码示例如下(以GPT-2的BPE分词器为例):

注意:不同模型的分词器计算结果不同,比如同样的文本,SentencePiece分词器可能会将"技术"拆分为1个Token,而BPE分词器可能拆分为2个,这会直接影响Token数量和算力消耗。为了让开发者更直观理解差异,下面补充3种主流模型(GPT-3.5、BERT、Kimi K2.5)的Token计算对比案例,使用相同文本测试,代码及结果如下:

三、核心场景2:身份验证中Token的计算方式

在Web开发、APP开发中,Token(身份令牌)是替代Session+Cookie的主流方案,核心作用是"身份校验与权限控制"。这里的Token计算,核心是"加密签名与校验",目的是确保Token不被篡改、可追溯,常见类型为JWT(JSON Web Token)。

3.1 JWT Token的计算流程(3步加密)

JWT Token的计算过程本质是"三次编码+一次签名",最终生成一串由"."分隔的字符串(格式:Header.Payload.Signature),具体计算步骤如下:

-

Header(头部)计算:指定加密算法(如HS256、RS256)和Token类型,将其转换为Base64编码(可解码,不加密);

-

Payload(载荷)计算:存储核心身份信息(如用户ID、过期时间、权限),同样转换为Base64编码(可解码,不加密,仅用于携带信息);

-

Signature(签名)计算:使用指定的密钥(Secret),对"Header编码+Payload编码"进行哈希加密(如HS256算法),生成不可篡改的签名(核心加密环节);

-

最终拼接:将Header编码、Payload编码、Signature用"."拼接,生成最终的JWT Token。

关键注意点:Base64编码仅用于"转换格式",不具备加密功能,真正的安全保障来自"Signature的哈希加密"------一旦Token被篡改,服务器重新计算签名时会与原签名不一致,直接拒绝请求。

3.2 两种核心加密算法对比(HS256 vs RS256)

JWT Token的签名计算,核心依赖两种加密算法,开发者需根据安全需求选择,具体差异如下:

-

HS256(对称加密):使用同一把密钥(Secret)进行加密和校验,计算速度快,适合单机部署、内部系统;缺点是密钥泄露后,Token可被伪造,安全性较低。

-

RS256(非对称加密):使用"公钥+私钥"成对计算------私钥用于加密签名,公钥用于校验签名,公钥可公开,私钥仅服务器持有;安全性高,适合分布式部署、跨系统调用,但计算速度略慢。

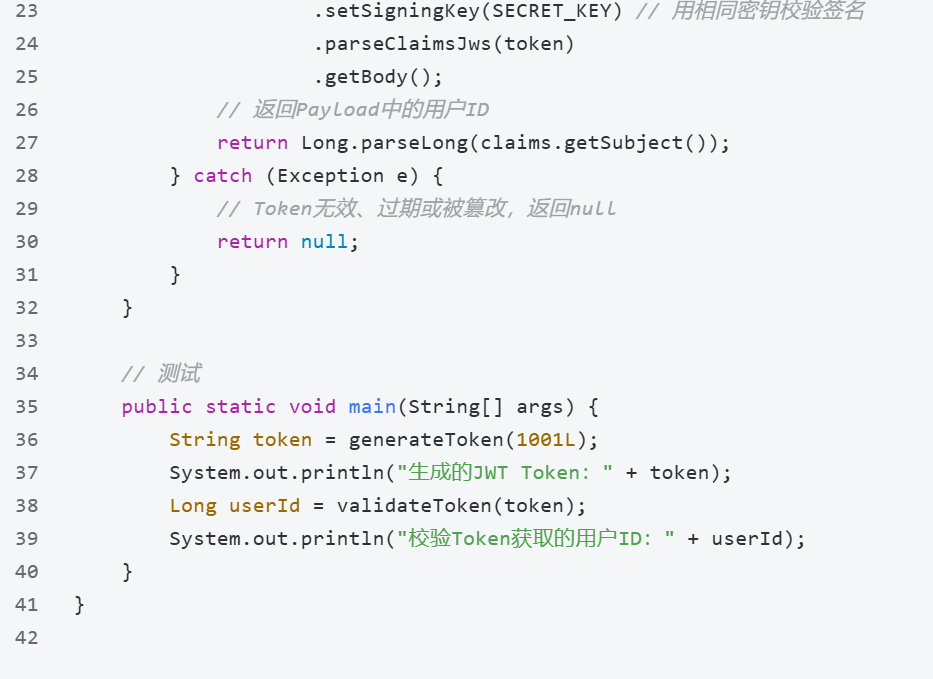

3.3 实战计算示例(Java)

使用JJWT库实现JWT Token的生成与校验(HS256算法),代码示例如下:

四、其他场景Token的计算方式

除了AI和身份验证,Token在区块链、平台权益等场景的计算方式也有差异,简要拆解如下,方便开发者全面理解:

4.1 区块链场景:Token的计算方式

区块链中的Token(通证),计算核心是"哈希运算与共识校验",用于确保权益流转的不可篡改和去中心化:

-

生成计算:通过哈希算法(如SHA-256)对交易信息(用户地址、转账数量、时间戳)进行加密,生成唯一的交易哈希值,作为Token流转的凭证;

-

校验计算:通过共识机制(如PoW、PoS),对全网节点的Token交易哈希进行校验,确保交易合法、不重复、不篡改。

注意:区块链Token的计算与AI、JWT完全不同,其核心是"去中心化校验",而非单纯的分词或加密。

4.2 平台权益场景:Token的计算方式

淘宝淘金币、美团积分、游戏点券等平台权益Token,计算核心是"规则量化与权益映射",逻辑相对简单:

-

生成计算:根据用户行为(如消费、签到、分享),按照预设规则量化Token数量(如消费100元=10个Token);

-

校验计算:通过平台数据库记录Token数量,校验用户兑换权益时的Token有效性(如是否足够、是否过期)。

五、Token计算的常见坑与避坑技巧

在实际开发中,很多问题都源于对Token计算逻辑的误解,总结4个高频坑及避坑技巧,帮你少走弯路:

-

坑1:混淆AI Token的数量单位------将"1k Token"理解为"1KB存储",实际1k=1000个Token,与存储大小无关,仅代表文本处理量;避坑:计算AI Token时,重点关注"输入+输出"的总数量,而非存储大小。

-

坑2:JWT Token泄露密钥------使用HS256算法时,密钥泄露会导致Token被伪造;避坑:生产环境中,密钥需加密存储,定期更换,分布式部署优先使用RS256非对称加密。

-

坑3:忽视Token过期时间------AI Token的上下文窗口、JWT Token的有效期,未及时处理会导致请求失败;避坑:在代码中添加Token过期校验,提前刷新Token。

-

坑4:不同场景Token混用------将AI Token用于身份验证,或将JWT Token用于AI计算,导致逻辑混乱;避坑:明确场景,根据需求选择对应的Token类型和计算方式。

六、总结与展望

Token的技术计算方式,本质是"适配场景的标准化处理"------AI场景侧重"分词与量化",身份验证场景侧重"加密与校验",区块链场景侧重"哈希与共识",不同场景的计算逻辑虽有差异,但核心都是"将信息转化为计算机可处理、可验证的标准化单元"。

随着数字经济的发展,Token的应用场景会愈发广泛,计算方式也会不断优化------比如动态Token化、多模态Token化(将图像、音频转化为Token),未来会成为开发者的必备技能。

对于开发者而言,掌握Token的计算方式,不仅能规避开发中的常见问题,更能理解不同技术场景的底层逻辑,为后续的AI开发、安全开发、区块链开发打下基础。