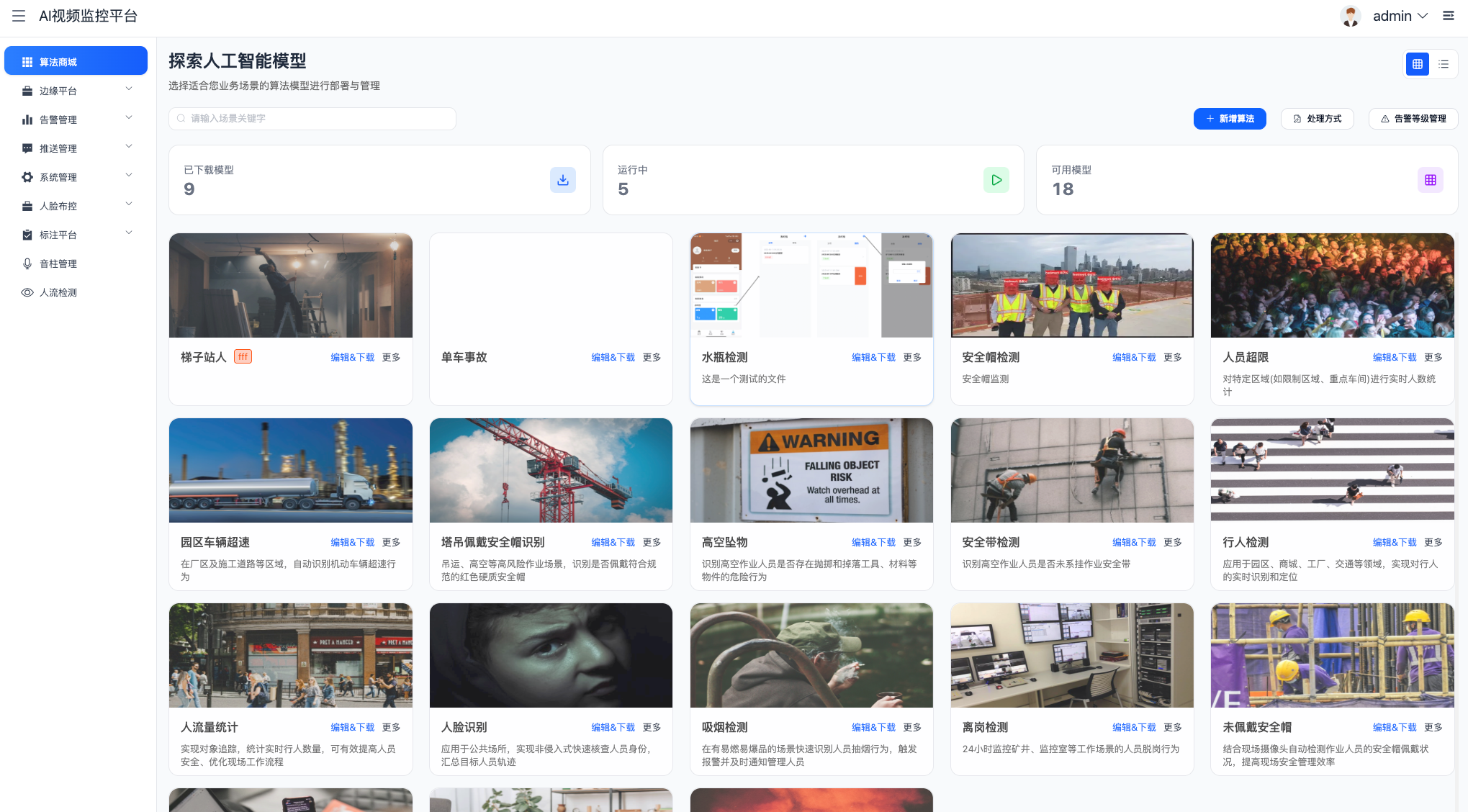

引言:算力碎片化与架构选型的博弈

在 AI 视频监控项目的落地过程中,技术决策者(CTO/架构师)往往面临着一个艰难的抉择:"算力与架构的碎片化" 。项目现场可能同时存在基于海思芯片的 IPC、瑞芯微的边缘盒子、英伟达的 GPU 服务器,以及国产化的 ARM 服务器。传统的视频管理软件通常绑定特定的硬件指令集(如仅支持 X86),导致企业在硬件选型上受制于人,或者需要维护多套互不兼容的代码分支,开发与运维成本极高。

如何构建一套既能跑在老旧 X86 服务器上,又能利用国产 ARM 芯片进行边缘推理的系统?YiheCode Server 给出的答案是"软硬解耦 + 容器化边缘计算"。这不仅是一个基于 Spring Boot 2.7 + Vue 2.6 开发的开源平台,更是一个深度优化的异构计算架构。本文将深入解析其如何利用 Docker 容器化技术与边缘推流机制,打通芯片厂商间的壁垒,实现"一套代码、全域运行",帮助企业削减约 95% 的底层适配开发成本。

一、 核心痛点与架构解法:从"硬绑定"到"软解耦"

YiheCode Server 的架构设计核心在于将业务逻辑 与硬件驱动进行了彻底的物理分离。系统不再试图在一个进程中兼容所有芯片,而是采用了"中心管控 + 边缘自治"的微服务架构。

1.1 异构计算资源池

根据 Gitee 仓库文档,平台构建了两级算力网络,完美解决了 X86 与 ARM 的兼容问题:

- 中心云节点(X86/ARM 通用):负责用户管理、权限控制、告警汇聚与大屏展示。利用 Java 的跨平台特性,核心服务可直接运行在任意架构的服务器上。

- 边缘计算节点(异构适配层):这是架构的关键。边缘盒子直接部署在设备端,负责视频流的拉取(Pull Stream)和 AI 算法推理。开发者可以根据现场硬件(如 NPU/GPU 品牌)编译特定的边缘程序,而无需改动中心云的代码。

1.2 硬件兼容矩阵

平台通过模块化的设计,将不同指令集和芯片的差异性屏蔽在边缘侧:

| 硬件类型 | 指令集/架构 | 部署方式 | 角色定位 | 适配策略 |

|---|---|---|---|---|

| 通用服务器 | X86_64 | Docker 容器 | 中心管理平台、流媒体服务 | 标准 Java/Spring Boot 镜像,开箱即用 |

| 国产服务器 | ARM64 | Docker 容器 | 中心管理平台、流媒体服务 | 提供 ARM 编译版本,支持国产化替代 |

| 边缘计算盒 | Rockchip/Hisilicon | 原生二进制/容器 | 视频拉流、算法推理、协议转换 | 针对特定 NPU 编写推理引擎,仅需适配边缘端 |

| GPU 服务器 | CUDA/NPU | 混合部署 | 高密度 AI 视频分析 | 支持客户定制化 GPU 品牌驱动 |

二、 深度技术实现:边缘推流与流媒体调度

YiheCode Server 在 Gitee 仓库的架构图中明确展示了其对 ZLMediaKit 的深度集成。ZLMediaKit 是一个高性能的流媒体开源框架,它屏蔽了底层音视频编解码的复杂性,是实现跨平台播放的关键。

2.1 边缘节点的"推拉流"博弈

在异构环境中,视频流的传输策略至关重要。平台支持两种模式以适应不同网络环境:

- 边缘拉流(Pull):中心流媒体服务(ZLM)主动向边缘设备发起 RTSP 请求。适用于中心算力强、边缘网络受限的场景。

- 边缘推流(Push) :边缘设备解码后,主动将视频帧通过 RTMP 推送到中心流媒体集群。这是异构计算的推荐模式,因为解码和算法运行都在边缘端完成,中心端只需负责转发和存储,大大降低了中心服务器的解码压力。

边缘推流配置示例(边缘端配置文件):

yaml

# edge-config.yaml

edge_node:

id: "EC712AC0C24510063"

name: "Factory-Gate-1"

hardware_type: "Rockchip_RK3588" # 识别硬件类型

stream_pipeline:

# 1. 拉取本地摄像头流 (支持RTSP/USB)

source: "rtsp://192.168.1.64:554/stream"

# 2. AI 算法配置 (在边缘端运行,利用本地 NPU)

algorithm:

- model: "helmet_detect.rknn" # 针对 Rockchip 编译的模型

interval: 5s # 抽帧间隔

# 3. 推流目标 (推送到中心 ZLM 节点)

destination:

- url: "rtmp://zlm-center-ip/live/camera_01"

# 若算法触发告警,额外推一路流到告警通道

alarm_channel: "rtmp://zlm-center-ip/alarm/alert_01"2.2 资源调度与录像策略

文档中提到了"录像控制程序"与"ZLM 节点"的交互。为了适应异构环境下的存储压力,平台实现了一套智能的按需录像机制:

- 常态不录:仅保存实时流转码后的流地址。

- 事件触发:当边缘节点或中心节点检测到 AI 告警(如跌倒、烟火)时,通过 HTTP 接口通知 ZLM 节点,开始录制前后 N 分钟的视频片段。

- 分布式存储:利用 MinIO 对象存储,将视频片段分散存储在不同的物理节点上,解决了单机存储瓶颈。

三、 私有化部署与低代码开发

对于寻求私有化部署的企业而言,YiheCode Server 提供了极简的 Docker 部署方案。由于核心服务与边缘服务的解耦,企业可以在云端使用 X86 服务器部署管理平台,在工厂端使用 ARM 服务器部署边缘网关,构建混合云架构。

3.1 Docker 部署架构

基于文档要求的环境依赖,标准的部署拓扑如下:

bash

# docker-compose.yml (核心服务)

version: '3.5'

services:

# 1. 数据库 (MySQL/Redis)

mysql:

image: mysql:5.7

# ...

# 2. 流媒体服务 (ZLMediaKit)

zlm:

image: ${ARCH}-zlm-media-server # 根据架构选择镜像

ports:

- "1935:1935" # RTMP

- "554:554" # RTSP

# 3. 应用服务 (Spring Boot)

app-server:

image: java:8-jre

depends_on:

- mysql

- zlm

environment:

- SPRING_PROFILES_ACTIVE=prod3.2 低代码开发体验

虽然底层架构复杂,但对最终用户(开发者)而言,通过边缘节点的配置文件即可完成大部分定制工作,无需频繁修改核心代码。开发者只需关注算法模型 的替换和推流地址的配置,即可快速适配新的硬件环境。

四、 总结

YiheCode Server 通过边缘计算架构 与容器化部署 ,成功构建了一个硬件无关 的视频接入底座。

对于技术决策者而言,这套系统最大的价值在于:它将"适配 10 种不同芯片"的复杂性,封装为了"配置边缘节点"的简单性。无论是基于 X86 的数据中心,还是基于 ARM 的边缘盒子,都能通过这套系统实现统一管理。这种架构,正是实现"减少 95% 开发成本"并应对复杂异构现场的关键基础设施。

架构师建议 :

在部署大规模集群时,建议将 ZLMediaKit 流媒体服务独立部署,避免与业务逻辑服务争抢 CPU 资源。对于边缘节点,建议优先使用"边缘推流(Push)"模式,以降低中心节点的解码压力并适应异构网络环境。