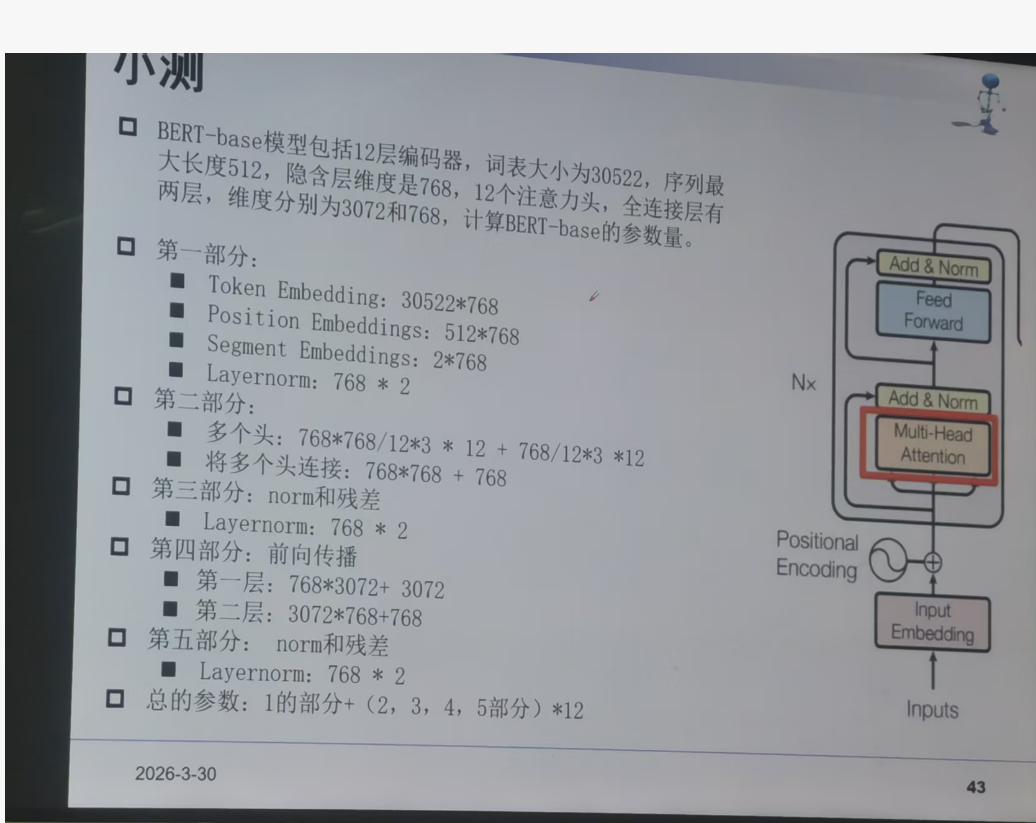

**1. Token Embedding:**嵌入层的作用是将输入的词或标记转换为固定维度的向量。假设词汇表的大小为 V,嵌入向量的维度为 d_model。那么嵌入层的参数量就是 V × d_model

2. 位置编码

(1) Position Embeddings: max_position×d_model

(2) Segment Embeddings: num_segments×d_model

3. Multi-Head Attention: 多头自注意力机制由多个注意力头组成。每个注意力头包括三个线性变换,分别是查询(Query)、键(Key)和值(Value)的变换。假设有 h 个注意力头,每个头的维度为 d_k(通常 d_k = d_model / h)。

对于每个注意力头的查询、键和值的变换,参数量分别是 d_model × d_k。因为有 h 个注意力头,所以总共有 3 × h × d_model × d_k 参数用于这些线性变换。

**4. Layernorm:**残差连接和层归一化(Layer Normalization)部分。层归一化部分的参数量相对较少,每个层归一化有 2 × d_model 个参数(包括一个缩放参数和一个偏移参数)。5.前馈网络: Transformer 中的前馈神经网络通常是位置 - 智能的,每个位置都有相同的结构。它包括两个线性变换,中间有一个激活函数(一般是 ReLU)。假设前馈神经网络的隐藏层维度为 d_ff。

第一个线性变换的参数量是 d_model × d_ff,第二个线性变换的参数量是 d_ff × d_model。因此,前馈神经网络的参数量为 d_model × d_ff + d_ff × d_model + d_model + d_ff (别忘记偏置项)

Transformer参数量

丰海洋2026-04-04 13:47

相关推荐

薛定猫AI几秒前

【深度解析】从无状态 ChatBot 到有状态 AI Companion:大模型记忆系统原理与工程落地泠不丁4 分钟前

React/Next.js 前端开发与治愈系 UI 设计码语智行5 分钟前

Claude Code 免费白嫖 Qwen3.6,Token 无限量阿文的代码库8 分钟前

机器学习之精确率和召回率的关系Raink老师8 分钟前

【AI面试临阵磨枪-100】Harness 与 MCP/A2A 协议、Skill 体系如何集成?我爱cope12 分钟前

【Agent智能体21 | 构建AI工作流的技巧-优化组件的常用方法】x_lrong12 分钟前

AMD 7800xt + WSL2 + ROCm7.2.1 配置AI开发环境逐梦苍穹14 分钟前

我开源了一个Claude Code历史可视化工具:本地Prompt一键浏览、搜索、导出刘国华-平价IT运维课堂17 分钟前

Ubuntu 26.04 LTS 发布,研发与运维需要关注什么?专注搞钱18 分钟前

半导体行业中基于 LSTM 神经网络的 SPC 异常预测实战