尽量说做什么,而不是说不做什么。

(bad)提示:

以下是向客户推荐电影的代理程序。不要询问兴趣。不要询问个人信息。

客户:请根据我的兴趣推荐电影。

代理:输出:

当然,我可以根据你的兴趣推荐电影。你想看什么类型的电影?

你喜欢动作片、喜剧片、爱情片还是其他类型的电影?(good)提示:

以下是向客户推荐电影的代理程序。代理负责从全球热门电影中推荐电影。

它应该避免询问用户的偏好并避免询问个人信息。如果代理没有电影推荐,

它应该回答"抱歉,今天找不到电影推荐。"。

```顾客:请根据我的兴趣推荐一部电影。

客服:输出:

抱歉,我没有关于你兴趣的任何信息。

不过,这是目前全球热门的电影列表:[电影列表]。希望你能找到喜欢的电影!参考:https://help.openai.com/en/articles/6654000-best-practices-for-prompt-engineering-with-openai-api

提示词示例:

让模型给出具体回答的最佳方法之一是改善提示的格式。

输入

Answer the question based on the context below. Keep the answer short and concise. Respond "Unsure about answer" if not sure about the answer.

Context: Teplizumab traces its roots to a New Jersey drug company called Ortho Pharmaceutical. There, scientists generated an early version of the antibody, dubbed OKT3. Originally sourced from mice, the molecule was able to bind to the surface of T cells and limit their cell-killing potential. In 1986, it was approved to help prevent organ rejection after kidney transplants, making it the first therapeutic antibody allowed for human use.

Question: What was OKT3 originally sourced from?

Answer:输出:

Mice.文本分类

到目前为止,你已经使用了简单的指令来执行任务。作为提示词工程师,你需要更擅长提供更好的指令。但这还不是全部!你还会发现,在更困难的用例中,仅仅提供指令是不够的。这就是你需要更多考虑上下文和其他元素(在提示词中使用)的地方。你可以提供的其他元素包括**输入数据** 或**示例**。

提示词:

Classify the text into neutral, negative or positive.

Text: I think the food was okay.

Sentiment:输出:

Sure! Black holes are regions of spacetime where the gravitational force is so strong that

nothing, not even light, can escape from it. They are created when a very massive star

dies and its core collapses in on itself, forming a singularity of infinite density. The

intense gravity of the singularity pulls in all the matter and radiation around it,

creating the black hole.Few-shot COT

即一步步思考,将问题分解,一个个解决,给他提供一个思维链。

zero-shot

tree of thought

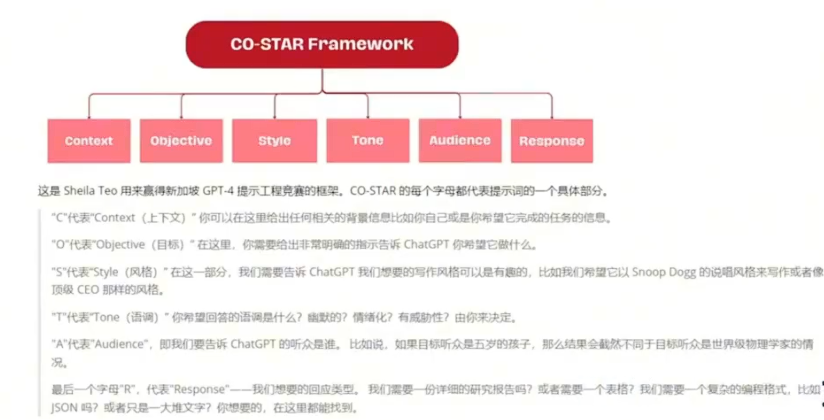

CO-START提示词框架。

即为: 上下文+目标+风格+语调+听众(受众)+回应类型

************** 2026.04.03*************

要精准回答浅层的样本问题,则采取下面方法:

少量样本提示:

对于稍微复杂的任务,想要更精确的回答,可以给一些例子。具体如下:

输入:

这太棒了!// Negative

这太糟糕了!// Positive

哇,那部电影太棒了!// Positive

多么可怕的节目!//输出:

Negative要精准回答有深度的问题,可以采取下面办法:

思维链(CoT)提示: 在最后添加上提示词,'让我们逐步思考'。

- 阶段1:问题聚类:将给定问题划分为几个聚类

- 阶段2:演示抽样:从每组数组中选择一个具有代表性的问题,并使用带有简单启发式的 Zero-Shot-CoT 生成其推理链

推理增强方法:

自我一致性(Self-Consistency ):自我一致性旨在"替换链式思维提示中使用的天真贪婪解码方法"。其想法是通过少样本 CoT 采样多个不同的推理路径 ,并使用生成结果选择最一致的答案(出现结果次数最多的答案)。这有助于提高 CoT 提示在涉及算术和常识推理的任务中的性能。(原理就是让模型在用思维链推理的时候,尽量选择前后一致性强的推理路径,避免过于发散)

理解成一句话:不要相信模型第一次想到的那条推理链,而要让它"多想几种办法",最后用"多数一致"的答案作为输出。

Self-Consistency:不只生成一条推理链,而是生成多条不同的推理链,然后对最终答案做聚合。

参考: