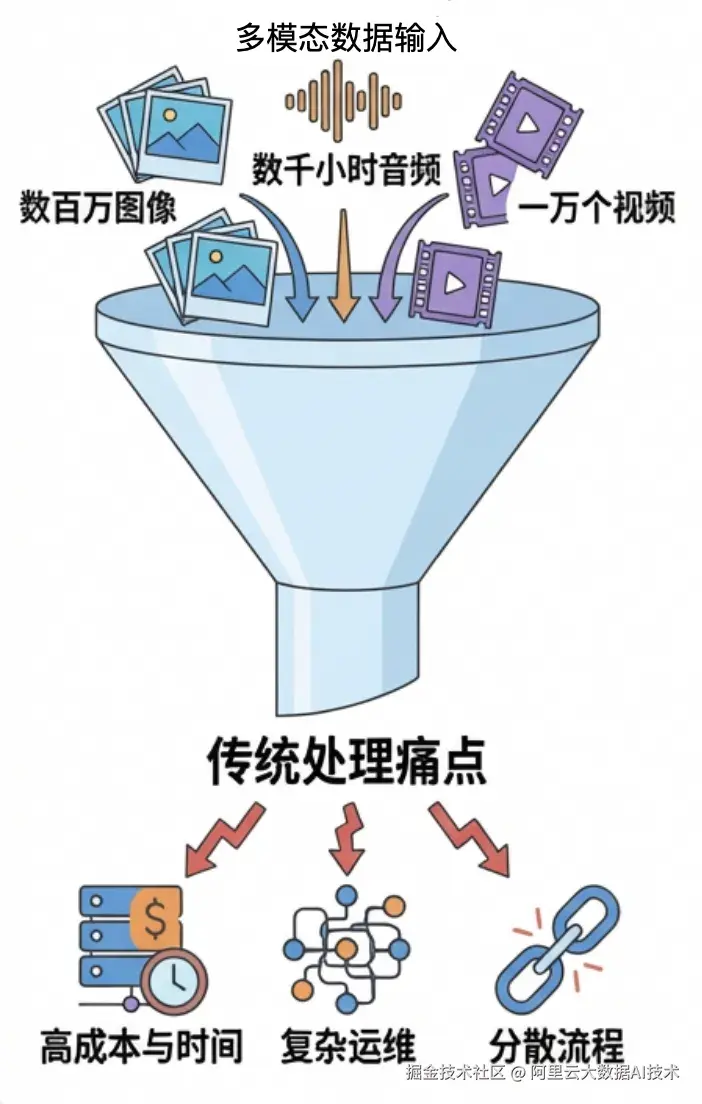

当 AI 大模型需要"看懂"百万张图片、"听懂"千小时音频、"生成"万条视频时,你的数据处理管线准备好了吗?

引言:AI 时代的数据处理之痛

在大模型时代,多模态数据正在成为 AI 训练和推理的核心燃料。无论是自动驾驶、具身智能的海量图片、视频数据处理以及电商的千万级商品图文理解,还是大模型训练前的 PB 级数据预处理,企业都面临着一个共同的挑战:

如何高效、低成本地处理海量非结构化数据?

传统方案的痛点显而易见:

-

自建 CPU、GPU 集群,动辄千万级年费,资源闲置率高

-

自建分布式推理框架,开发周期长,运维成本高

-

数据处理和 AI 推理割裂,中间结果落盘传输,效率低下

-

模型部署复杂,vLLM / TGI 配置调优需要专业知识

MaxCompute MaxFrame 正是为解决这些问题而生------一个全托管 Serverless 的分布式 AI 计算引擎,让全模态数据处理像写原生本地 Python代码一样简单。

MaxFrame 是什么?

MaxFrame 是阿里云 MaxCompute 提供的自研_分布式 AI 计算引擎_,面向大规模、全模态数据处理和离线批量推理场景。它提供了三大核心能力:

一、CU/GU 算力:异构资源管理调度,按需使用,用完即走

MaxFrame 基于 MaxCompute 提供的 CU(CPU 计算资源)、GU (GPU AI计算资源)异构计算资源,提供 Serverless 化的 CPU 及 GPU 异构算力管理、调度能力:

-

零运维:无需自建集群,无需管理 K8s,无需自建推理框架,引擎开箱即用

-

弹性伸缩:从 1CU 到 10wCU、从 1 张 GPU 卡到数千张,按需扩缩容

-

按需付费:用多少算多少,告别资源闲置浪费

-

GU(GPU AI计算资源)配额 :通过简单的

gu_quota参数指定 GPU 资源池,一行配置搞定算力分配

python

# 一行装饰器,指定使用 GPU 算力

@with_running_options(engine="dpe", gu=1, gu_quota="your_gu_quota")

def my_ai_function(batch_df, _ctx=None):

...二、按 Token 计费的 AI Function:大模型推理开箱即用

MaxFrame 内置了 AI Function 能力,预置 Qwen、DeepSeek 等开源模型,同时支持对接百炼商业化旗舰大模型,用户无需关心模型部署和推理服务:

-

按 Token 计费:输入 Token + 输出 Token,费用透明可控

-

零部署成本:无需自行部署 vLLM 或 TGI 推理服务

-

丰富的模型选择:支持文本生成、文本向量化等模型

-

灵活参数控制 :

params、output_type、dimensions等参数精细调优

python

from maxframe.learn.utils import read_odps_model

# 指定使用百炼text-embedding-v4模型

model = o.get_model("text-embedding-v4", project="bigdata_public_modelset")

df = md.read_odps_table("user_feedback_table")

# 调用百炼大模型进行批量推理

result_df = llm.embed(

df["query"],

running_options={"max_tokens": 1024, "verbose": True},

simple=True,

params ={"output_type":"sparse"}

).execute()对比自建方案:省去了模型下载、vLLM 部署、GPU 配置、负载均衡等繁琐步骤,开发效率提升 10 倍以上。

三、全模态全栈数据处理:图像、视频、音频一站式

MaxFrame 提供了覆盖图像、视频、音频的完整全模态处理能力:

| 模态 | 内置能力 | 典型场景 |

|---|---|---|

| 图像 | Image 算子(解码/裁剪/缩放)、Embedding 提取、OCR 识别 | 商品图打标、发票识别、图片向量化 |

| 视频 | 文生视频、视频切帧、内容理解 | 自动驾驶标注、内容审核、AI 视频创作 |

| 音频 | Whisper 语音识别、音频合并、文本转录 | 会议记录、客服质检、语料预处理 |

| 文本 | 文本生成、文本翻译、文本结构化提取、 Embedding | 数据打标、翻译、情感分析 |

为什么选择 MaxFrame?

MaxFrame 核心优势

| 维度 | MaxFrame |

|---|---|

| 基础设施 | 全托管 Serverless,零运维 |

| 算力获取 | CU 弹性伸缩,秒级扩容,CPU、GPU 资源混合调度 |

| 模型部署 | AI Function 大模型服务开箱即用 |

| 算子内置 | 内置图片、音视频等多模态处理算子 |

| 计费方式 | CU/GU 按需 + Token 按量,成本灵活可控 |

| 资源利用率 | 用完即释放,利用率接近 100% |

| 生态集成 | 标准 Python DataFrame 语义 原生集成 MaxCompute 数据 / DLF /DataWorks / OSS 等 |

| 安全合规 | 企业级 SLA,权限/加密/审计 |

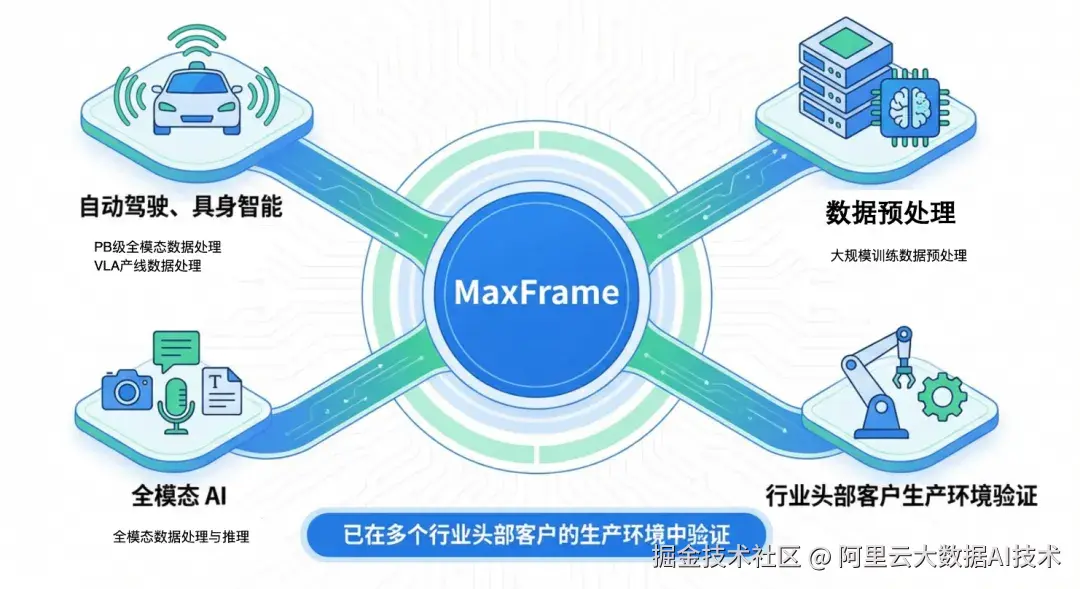

已验证的客户场景

MaxFrame 已在多个行业头部客户的生产环境中验证:

-

自动驾驶、具身智能:PB 级全模态数据处理,VLA 产线数据处理

-

大模型训练:大规模训练数据预处理

-

全模态 AI:全模态数据处理与推理

总结

MaxFrame 通过 CU、GU 异构算力 、Token 计费的 AI Function 、分布式批处理引擎 三大核心能力,为企业提供了一套完整的全模态数据处理解决方案:

-

极简开发:Pandas 风格 API + 装饰器声明式资源管理,10 行代码完成端到端数据处理、模型推理

-

极致弹性:CU/GU 按需分配,从单卡到百按需伸缩,告别资源闲置

-

极低门槛:AI Function 预置主流大模型,按 Token 计费,零部署成本

-

极高安全:RAM 角色授权、STS 临时凭证、企业级 SLA,生产可用

在 AI 时代,数据处理的效率决定了 AI 创新的速度。MaxFrame,让你专注于 AI 创新本身。

了解更多 MaxFrame 能力,请访问:MaxCompute MaxFrame 官方文档

购买与使用MaxCompute 模型计算服务:MaxCompute 模型计算服务

欢迎加入 MaxFrame 用户钉钉群(群号:37130012987),获取技术支持和最新动态。