旧工作流的隐性成本

过去处理一份销售数据,我的标准动作是:

打开Excel → 写VLOOKUP → 调试公式 → 发现数据源格式不对 → 手动清洗 → 重新关联 → 做透视表 → 调图表样式 → 复制到PPT。

一个常规需求,平均消耗2-3小时。更麻烦的是,同样的清洗逻辑,下个月还要重来一遍。

脚本化看似是解药,但写Python脚本的时间成本、维护成本,以及同事协作时的环境配置问题,让"自动化"本身成了新负担。

新范式:自然语言即接口

最近尝试的ExcelAgent,恰好提供了这样一种中间路径。它的核心设计理念很有意思:不用写代码,也不用死记硬背复杂的Excel函数语法,而是直接用业务语言描述你想要什么结果。这种交互方式的转变,本质上是在降低人与工具之间的沟通成本,让注意力重新回归到"要解决什么问题"本身,而非"如何操作工具"。

这款AI数据分析工具的核心能力可以拆解为三个层面。

**1、意图理解层。**当你输入"把这三个分公司的表合并,按产品汇总销售额,找出增长最快的前10个"这样的指令时,系统会在内部完成一系列解析工作------识别出你的操作意图包含合并、分组聚合、排序筛选三个连续动作,自动匹配相应的执行策略,包括选择合适的关联方式、确定聚合函数的类型、设定排序的方向,最终生成可执行的计划并运行。这种黑盒式的处理,对使用者而言是无感知的,你只需要看到结果是否符合预期。

**2、本地计算引擎的设计。**这与市面上很多纯云端的AI工具有本质区别,数据全程在本地完成处理,不会上传到外部服务器。这种架构带来的好处是多方面的:涉及敏感信息时不必担心数据泄露风险,处理百万级行数的运算速度能够接近原生Pandas的性能表现,同时整个工作过程不依赖网络连接的稳定性,即使在离线环境下也能正常使用。

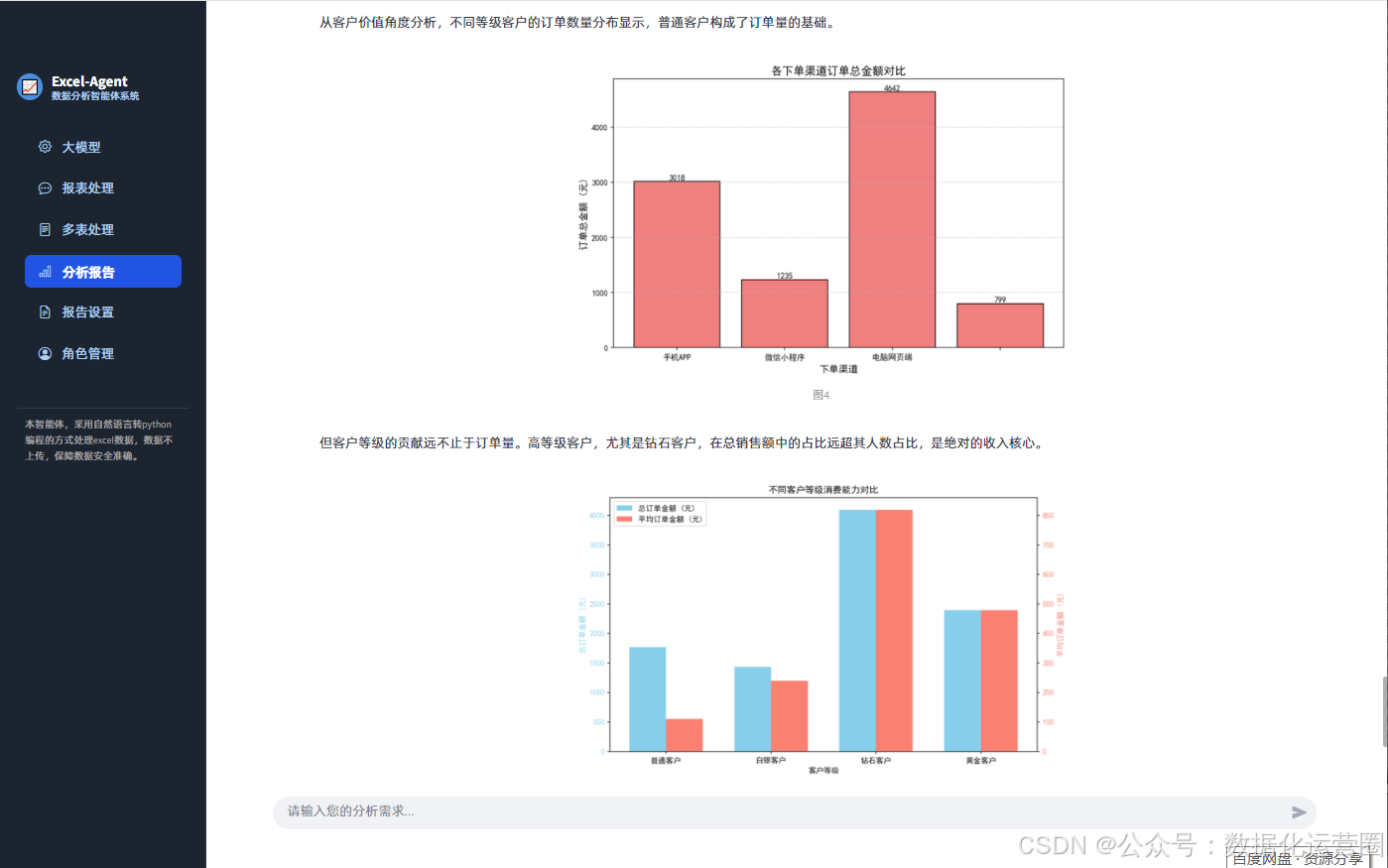

**3、自适应输出机制。**系统会根据数据的特征自动选择最合适的呈现方式,比如识别到时间序列数据就生成折线图,遇到分类对比场景就选用柱状图或条形图,面对占比结构问题时输出饼图或堆叠图。整个过程不需要使用者手动干预图表的配色方案、坐标轴刻度、图例位置等细节,大幅降低了可视化制作的门槛。

实测体验:一个具体场景的效率对比

为了验证这种新工作流的实际效果,我选择了一个日常工作中常见的任务进行测试:清洗一份包含五十万行记录的订单数据,将其与客户信息表进行关联,最终计算各区域在不同月份的复购率指标。

在传统Excel工作流中,这个任务的展开方式大致如下。首先是数据加载环节,五十万行对于Excel而言已经触及性能瓶颈,打开文件时会出现明显卡顿,有时甚至需要分批处理才能正常操作。接着进入清洗阶段,重复订单的识别、缺失手机号的填充,这些操作要么依赖手动筛选,要么需要编写辅助列配合复杂公式来实现。多表关联环节更是痛点所在,VLOOKUP在这种数据规模下运行效率极低,且容易出现匹配错误,调试过程耗时耗力。透视表的配置需要手动拖拽字段、设置计算方式,最后的可视化环节还要反复调整图表样式才能输出可用的结果。整个流程走下来,大约需要三个小时。

如果改用Python脚本方案,虽然处理大规模数据时性能更有保障,但需要投入时间编写数据读取代码、清洗逻辑、合并语句、分组聚合计算,以及调用可视化库生成图表。加上调试和优化的时间,整个过程大约需要一个小时,但这建立在你已经熟悉Pandas和Matplotlib的前提下,对于非技术背景的业务人员而言,这个门槛并不低。

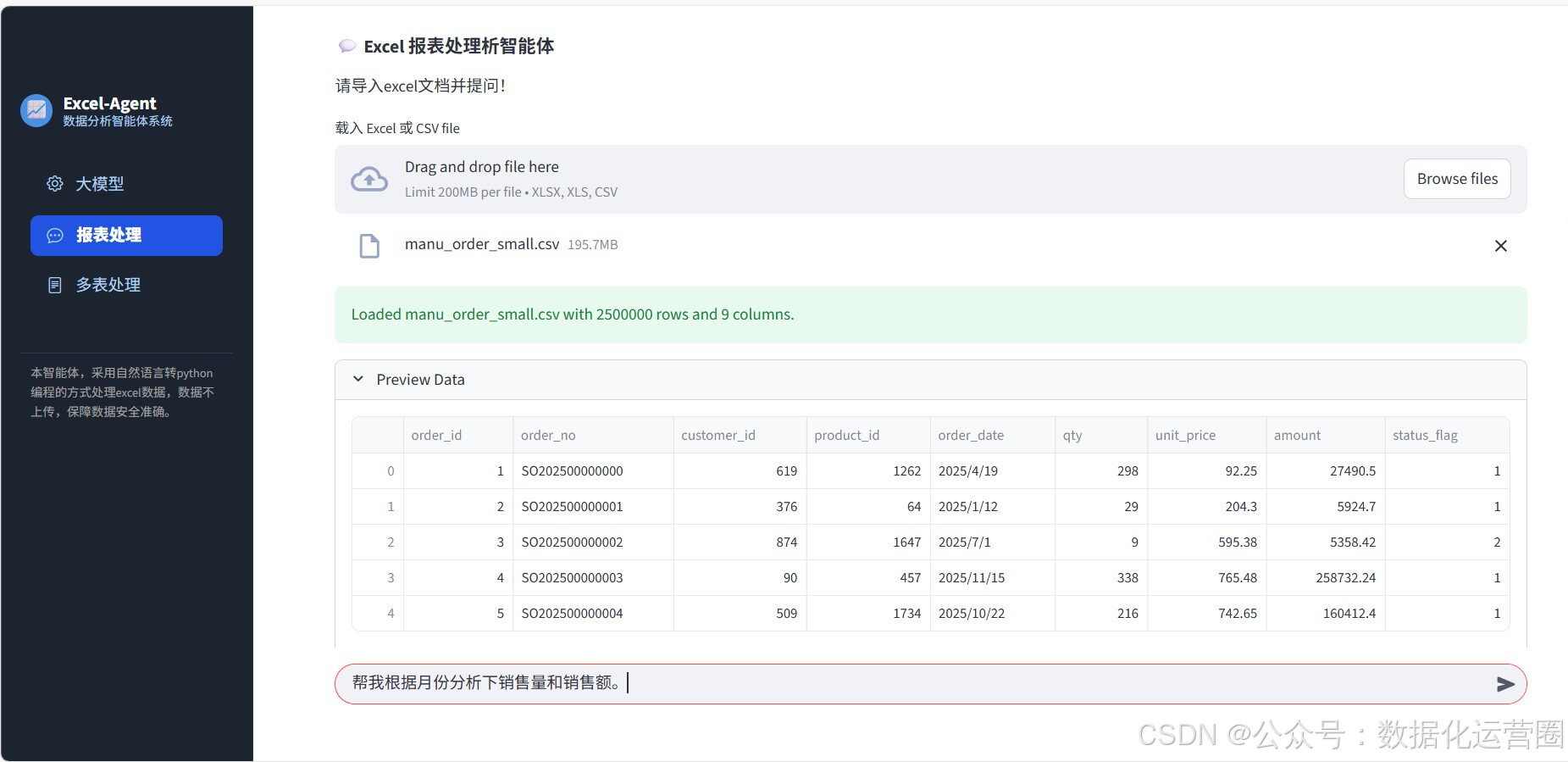

而使用这款AI数据分析工具时,工作流被大幅简化。数据加载只需直接拖拽文件或选择路径即可完成。清洗处理通过自然语言指令"去除重复订单,填充缺失手机号"一键完成。多表关联同样用一句"按客户ID关联信息表"解决。聚合计算环节指令为"按月度和区域计算复购率"。系统会自动生成对应的趋势图,无需手动选择图表类型或调整样式。整个任务从开始到产出可用结果,大约只用了十分钟。这种效率提升并非来自硬件性能的突破,而是源于交互范式的根本转变------从"告诉工具如何一步步执行"变成了"告诉工具我想要什么结果"。

关键设计取舍:为什么坚持本地化

市面上很多AI数据分析工具选择了纯云端的架构,确实带来了随时随地访问的便利性。但ExcelAgent的设计团队似乎对数据隐私问题有着更强的执念,他们选择了一条更难的技术路径------在本地部署计算引擎。这种取舍背后的考量很实际:当处理的数据涉及客户个人信息、企业财务明细、商业敏感数据时,"数据不出域"往往是不可妥协的硬性约束。本地执行的架构让使用者能够同时享受AI带来的便利性,又完整保留对数据的控制权,不必在效率和安全之间做非此即彼的选择。

另一个值得注意的设计选择是"说人话"的交互方式。这个行业的从业者都知道,不是所有人都具备学习Python或钻研高级Excel函数的动力和时间。降低交互门槛的意义远不止于用户体验的优化,它实际上重新定义了数据分析工作的分工边界------让业务人员能够自助解决八成左右的常规需求,技术团队则可以从繁琐的取数、清洗、报表制作中解放出来,专注于剩下两成真正复杂、需要深度技术能力的问题。这种分工的优化,对团队整体效率的提升是结构性的。

适用边界与理性预期

任何工具都有其适用的边界,这款AI数据分析工具也不例外。从实际测试来看,它在以下场景中表现最为出色:数据规模控制在百万行以内,超出这个量级后性能会有明显下降;需求类型相对标准化,集中在数据清洗、多表关联、分组聚合、可视化呈现这几个高频操作;对数据隐私有明确要求,需要本地化处理的场景。

也有一些场景它暂时无法很好地覆盖。如果需求涉及复杂的统计建模,比如回归分析、预测建模、聚类挖掘,仍然需要借助专业的统计工具或编程实现。高度定制化的可视化需求,比如特定的品牌配色规范、非标准的图表类型、复杂的交互式仪表盘,目前也难以完全满足。此外,对于实时流数据的处理,比如需要毫秒级响应的监控场景,这套基于批处理的架构并不适用。

工具观:效率的本质是选择

回顾数据分析工具的演进历史,会发现一条清晰的主线:从手工记账到电子表格,从Excel到Python和R,再到现在的AI辅助------每一代工具都在做两件相同的事,一件是压缩重复劳动所消耗的时间,另一件是降低专业技能对使用者的门槛要求。

这款AI数据分析工具的价值,并不在于它能够替代数据分析师的专业判断力,而在于它把"实现想法"的时间压缩到了最小,从而把"思考策略"的空间释放到了最大。当你不再需要为调试一个公式花费半小时,不再需要在格式调整上消耗大量精力,你自然会有更多的认知资源去关注数据背后的业务逻辑,去挖掘数字背后的洞察。

如果你也厌倦了在公式调试和格式调整中消耗大量精力,如果你也希望把更多时间花在真正有价值的分析思考上,或许值得尝试这样一种新的交互方式。工具的终极意义,从来都是让人更高效地工作,而不是让人更疲惫地与工具搏斗。