Python 日志采集到数据仓库 ETL 流程设计实战:从基础语法到生产级可靠运维

📌 引言:Python 在 ETL 场景下的独特价值

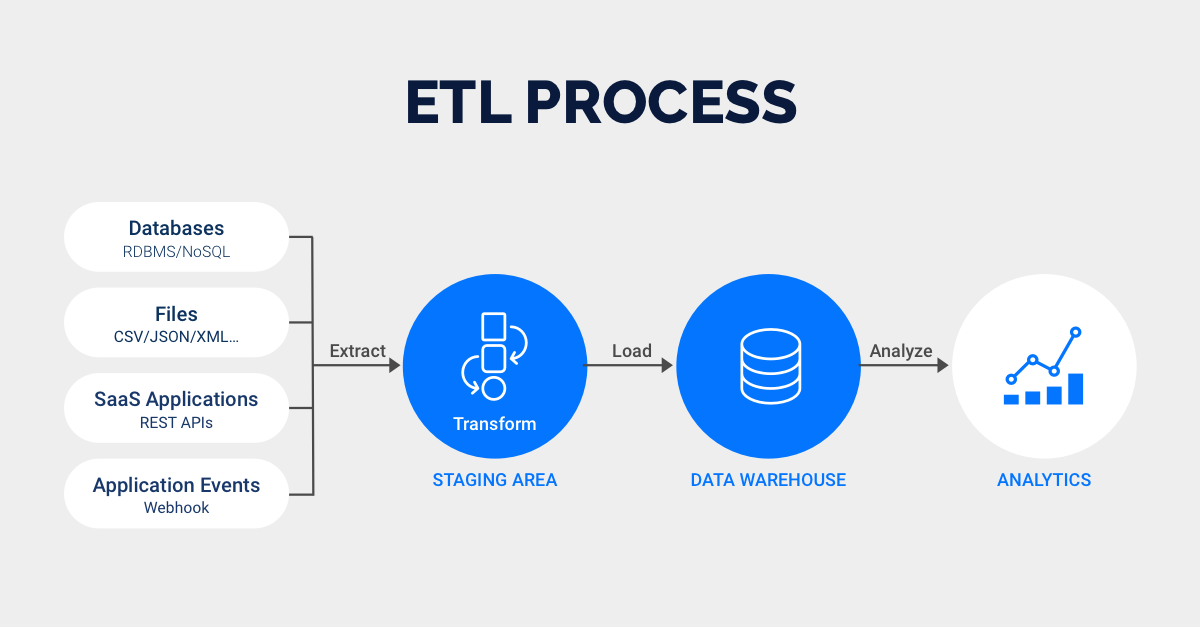

Python 自 1991 年诞生以来,以简洁优雅的语法和强大的生态系统,成为数据工程领域的"胶水语言"。它广泛应用于日志采集、数据处理和仓库构建,尤其在高吞吐量的 ETL(Extract-Transform-Load)流程中,Python 的动态特性与丰富库支持,让复杂日志管道从原型到生产部署变得高效可靠。客观来看,Python 改变了传统数据管道的构建方式,成为 Web 日志、应用事件和系统监控等多场景下的首选工具,帮助企业快速实现从原始日志到可分析数据仓库的转化。

本文基于多年 Python 开发与教学经验,面向初学者普及基础实现,同时为资深开发者提供进阶技巧与实战案例。顺着这个思路,我们将探讨如何利用 Python 设计一个完整的日志采集到数据仓库 ETL 流程,重点解决乱序、重复、脏数据和模式演进等痛点,并分享如何让"今天能跑"的管道变成"半年后还跑得稳"的生产级方案。当前 Python 在数据工程中的应用占比持续上升,利用它打造高质量 ETL,能显著提升数据时效性和业务决策效率。

基础部分:Python 语言精要应用于 ETL 实现

核心语法与数据类型

Python 的内置结构为 ETL 提供了天然支持。字典 (dict)常用于配置映射和元数据存储,列表 (list)处理批量日志记录,集合 (set)快速去重,元组(tuple)确保不可变配置参数。控制流程中的条件判断、循环和异常处理,则直接用于日志解析、数据校验和错误恢复。

以下是一个简单内存日志采集示例,展示动态类型的灵活性:

python

from collections import defaultdict

import json

import time

class BasicLogCollector:

def __init__(self, batch_size: int = 1000):

self.batch_size = batch_size

self.buffer = defaultdict(list) # source -> list of logs

def collect_log(self, source: str, log_entry: dict) -> None:

self.buffer[source].append(log_entry)

if len(self.buffer[source]) >= self.batch_size:

self.flush(source)

def flush(self, source: str):

# 简单转换后打印,实际可写入文件/队列

print(f"Flushing {len(self.buffer[source])} logs from {source}")

self.buffer[source] = []

# 使用示例

collector = BasicLogCollector()

collector.collect_log("app_server", {"timestamp": time.time(), "level": "ERROR", "msg": "test"})这段代码突出 Python 可读性:无需显式类型声明,异常处理可轻松扩展为自定义 ETLError 异常。

函数与面向对象编程

ETL 常用 装饰器 实现非侵入式步骤追踪。函数支持可变参数,面向对象则通过类封装 pipeline,实现继承与多态。

示例:装饰器实现日志处理计时(可扩展到生产):

python

import time

from functools import wraps

from typing import Callable

def etl_step_timer(func: Callable):

@wraps(func)

def wrapper(*args, **kwargs):

start = time.time()

result = func(*args, **kwargs)

end = time.time()

print(f"{func.__name__} 步骤耗时:{end - start:.4f}秒")

return result

return wrapper

@etl_step_timer

def transform_log(logs: list) -> list:

return [log for log in logs if log.get("level") != "DEBUG"] # 简单过滤

print(transform_log([{"level": "INFO"}, {"level": "DEBUG"}]))类继承与多态 可进一步抽象不同阶段:定义抽象基类 ETLStage,子类实现 process() 方法。UML 类图可直观展示继承关系(基类含抽象方法,子类覆盖具体逻辑)。

高级技术与实战进阶

元编程与动态生成

Python 的 type() 和 metaclass 允许动态创建 ETL 算子类,适合配置驱动场景。例如,根据 YAML 配置文件动态生成针对不同日志源的处理类,实现运行时行为定制。

上下文管理器与生成器

with 语句确保资源安全释放,可用于数据库连接或文件句柄管理:

python

class DBContext:

def __init__(self, conn):

self.conn = conn

def __enter__(self):

return self.conn

def __exit__(self, *args):

self.conn.close()

# 使用:with DBContext(get_db_conn()) as conn: ...生成器(yield)则适用于大文件日志流式处理,节省内存。

异步编程与高性能计算

在高并发日志场景中,asyncio + aiokafka 实现异步采集,协程避免阻塞。结合实际案例(如实时应用日志处理),性能远超同步版本。

主流库与生态系统

- Pandas / Polars:Transform 阶段高效数据清洗。

- Airflow / Dagster:编排整个 pipeline(纯 Python 实现)。

- Kafka / Redis:日志采集缓冲。

- Great Expectations / Pydantic :数据质量校验。

NumPy/Pandas 辅助日志分析,PySpark 可扩展到大规模分布式 ETL。

案例实战与最佳实践

项目案例:构建生产级日志到数据仓库 ETL 流程

假设开发一个多源日志 SaaS 系统。从需求分析:支持应用日志、服务器日志采集,目标仓库为 ClickHouse 或 Snowflake,QPS 峰值 10w+。设计方案:Kafka 采集 → Python 消费 → Transform → Load。

追问解答:乱序、重复、脏数据、模式演进怎么处理?

- 乱序处理 :日志携带事件时间戳,使用 Kafka 分区键 + 水位线(watermark)或 Apache Flink 风格的 Python 实现(结合

sortedcontainers)。在 Transform 阶段按时间戳排序后处理。 - 重复处理:采用 idempotency 设计,为每条日志生成唯一 event_id(hash 或 UUID),Load 阶段使用 UPSERT 或 MERGE 语句去重。

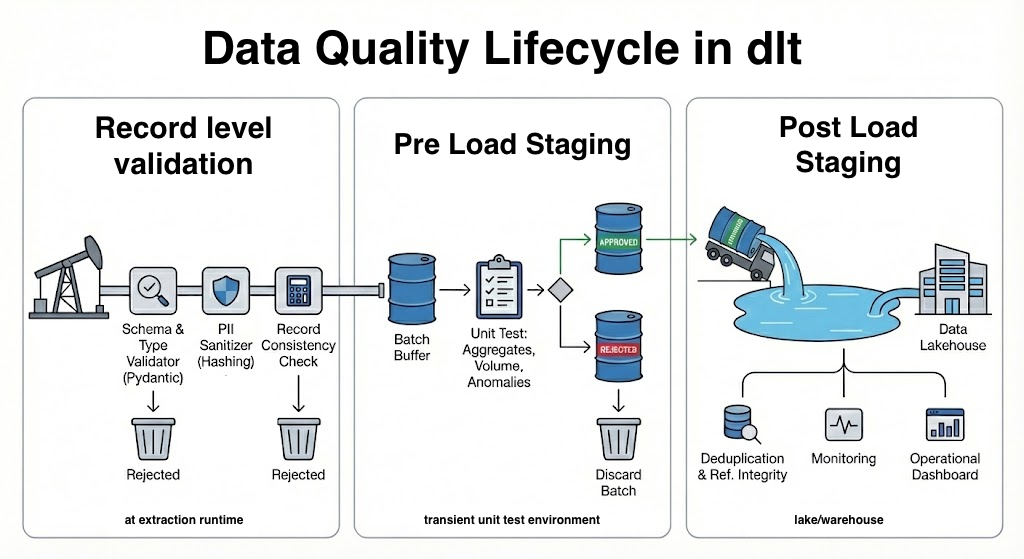

- 脏数据处理:引入 Pydantic 模型校验 + Great Expectations 规则引擎,在 Extract 后立即过滤/报警。脏数据进入 dead-letter queue 供人工审核。

- 模式演进处理:使用 Avro / Parquet + Schema Registry(Confluent 或 Glue),支持 backward/forward compatibility。Transform 层动态映射旧字段到新 schema。

实践案例:你如何让"今天能跑"变成"半年后还跑得稳"?

核心在于幂等性 + 监控 + 版本化 + 数据质量门。

- 所有步骤设计为幂等(可重跑不重复)。

- 集成 Prometheus + Grafana 监控延迟、错误率、数据量。

- Pipeline 版本化(Git 标签 + Airflow DAG 版本)。

- 每阶段添加数据质量 gate:通过才进入下一阶段,否则回滚/报警。

结合个人案例,在一个电商日志项目中,我们从"每天手动修复"进化到"零人工干预半年",靠的就是上述机制 + CI/CD 自动化测试。

如下数据质量生命周期图所示,可视化整个处理流程:

最佳实践

- 代码风格:严格遵循 PEP8,使用 Ruff 格式化。

- 单元测试:pytest + mock Kafka/Pandas,覆盖边界 case(如乱序、脏数据)。

- 性能优化:批量处理 + 向量化操作(Polars 替代 Pandas)。

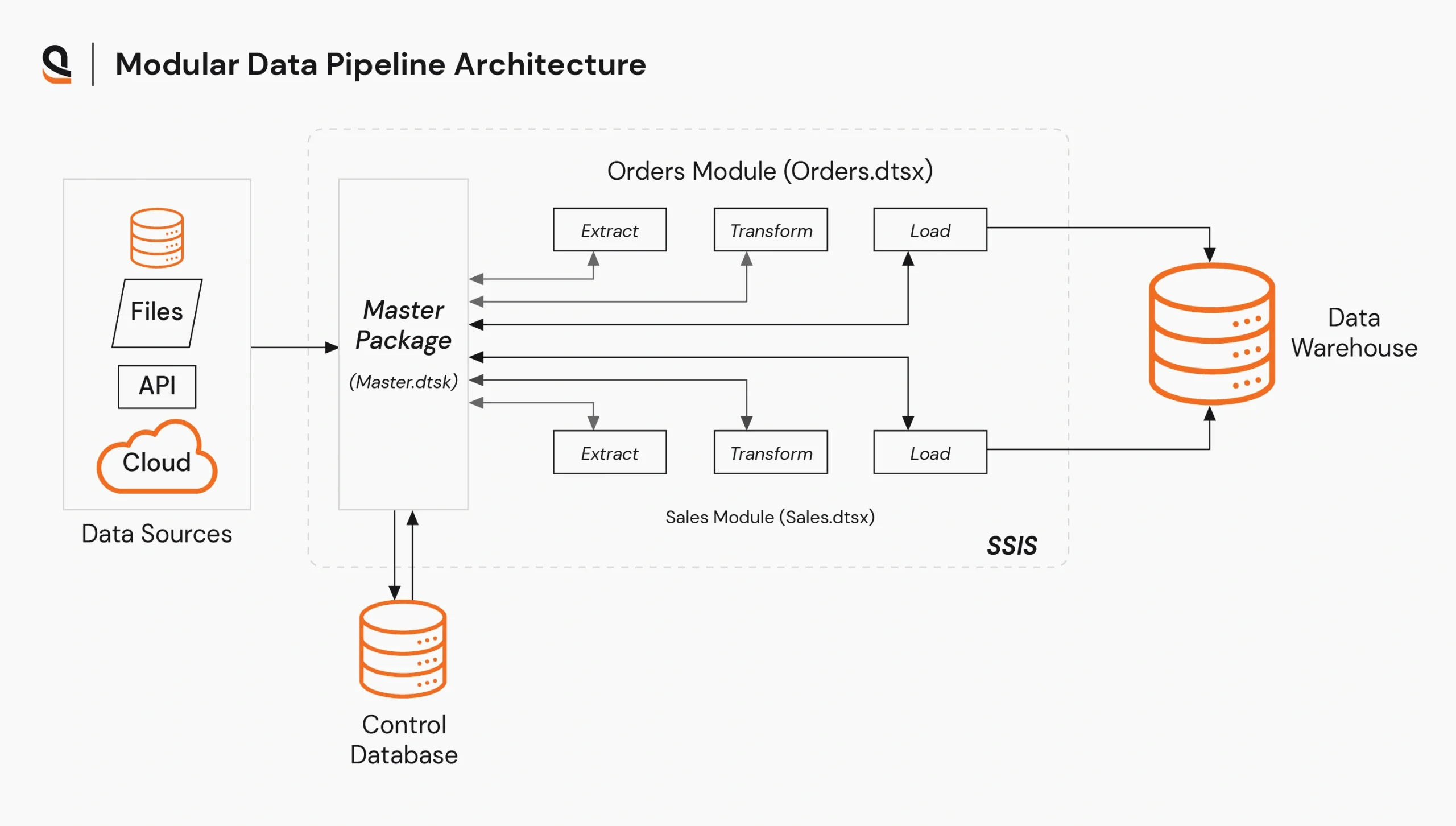

- 模块化 :抽象

ETLPipeline接口,支持策略模式切换采集源。 - 持续集成:GitHub Actions 运行端到端测试和数据一致性校验。

常见问题与解决:内存爆炸 → 切换流式生成器;时钟漂移 → NTP 同步事件时间;schema 漂移 → 自动 schema 演进检测。

前沿视角与未来展望

新技术如 Dagster 的资产导向编程或 dlt(data load tool)让 ETL 配置化更便捷。Python 在 AI 驱动数据管道(如 LLM 解析日志)和物联网边缘采集中的应用增长显著,借助 FastAPI 暴露 pipeline 监控 API,Streamlit 快速搭建运维仪表盘,进一步解放生产力。

社区动态:PyData 大会、dbt Community、GitHub 热门项目(如 apache-airflow、great-expectations)持续演进。未来,Python 可能通过更强的 Polars 引擎和 WebAssembly 支持,进一步提升 ETL 在云原生、Serverless 场景的性能。

总结与互动

回顾全文,Python 以其基础语法灵活性和高级生态,完美支撑从简单日志采集到分布式生产级 ETL 全链路设计。持续实践与迭代,是构建可靠数据管道的关键。

你在日常开发中遇到过哪些日志 ETL 相关的疑难问题?如何解决?面对快速变化的技术生态,你认为 Python ETL 未来还会有哪些变革?欢迎在评论区分享经验,一起构建更稳健的数据技术社区。

附录与参考资料

- Python 官方文档:https://docs.python.org

- PEP 8 风格指南

- Airflow 官方文档、Great Expectations 指南

- 推荐书籍:《流畅的 Python》、《Effective Python》、《Python for Data Analysis》

- 前沿资讯:订阅 PyData 博客、GitHub apache-airflow 项目以及 PyCon 大会信息,帮助读者不断跟进最新动态。

通过本文,希望你能立即动手实践一个 ETL 模块,并在实际项目中不断优化。持续学习,Python 的数据潜力将伴随你前行。