当前超高清图像复原任务中,传统逐像素处理的视觉模型计算成本极高,即便采用聚类中心的稀疏建模方式大幅压缩计算量,也会在特征聚合过程中不可避免地丢失图像边缘、纹理、细微结构等高频细节信息,导致模型只具备全局语义理解能力,却缺失局部精细特征支撑。为了破解高效建模与细节保留无法兼顾的行业难题,SCFM 被设计为专用的特征优化模块,以轻量化机制完成细节修复与特征补强。

基础模型

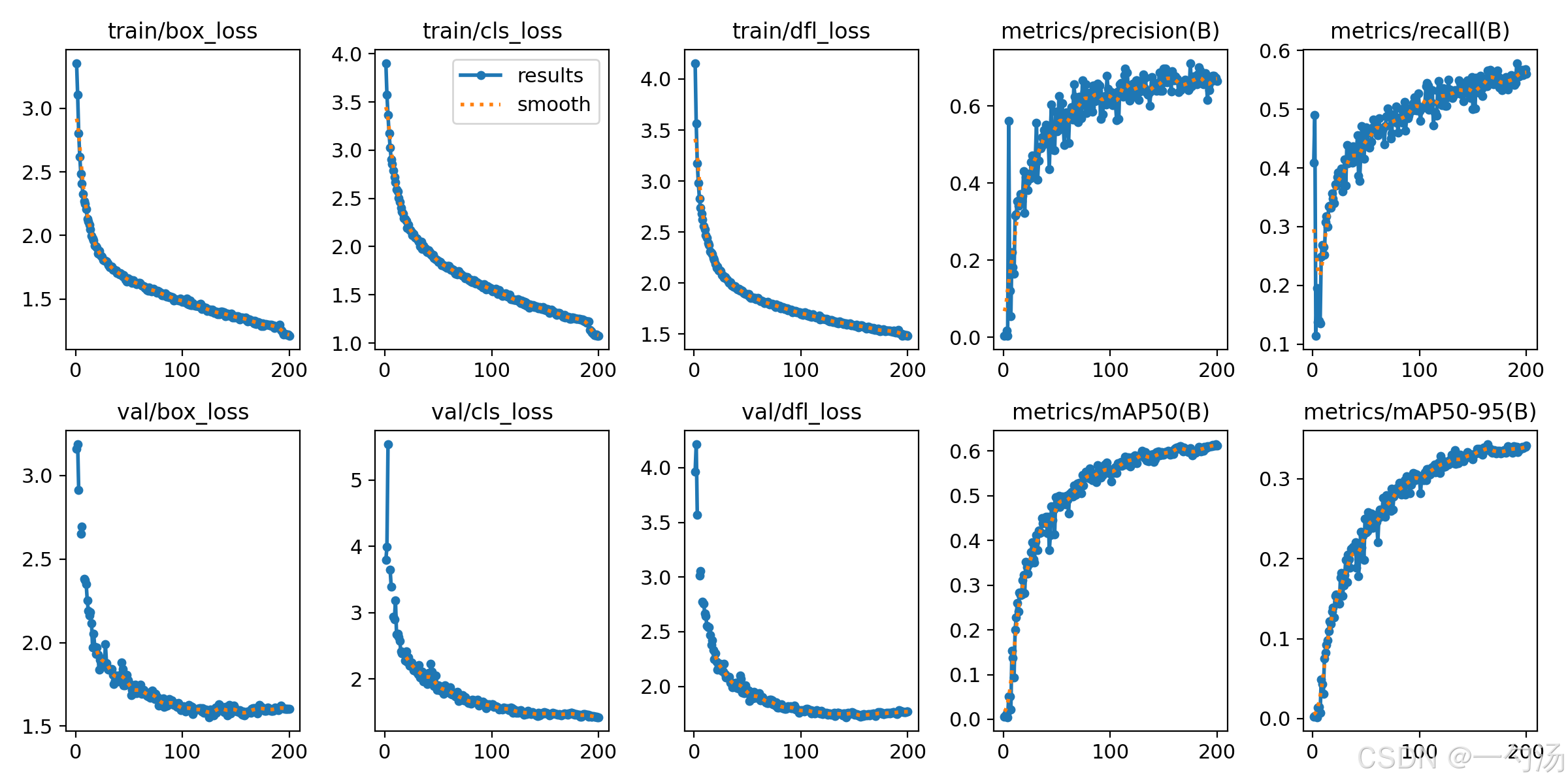

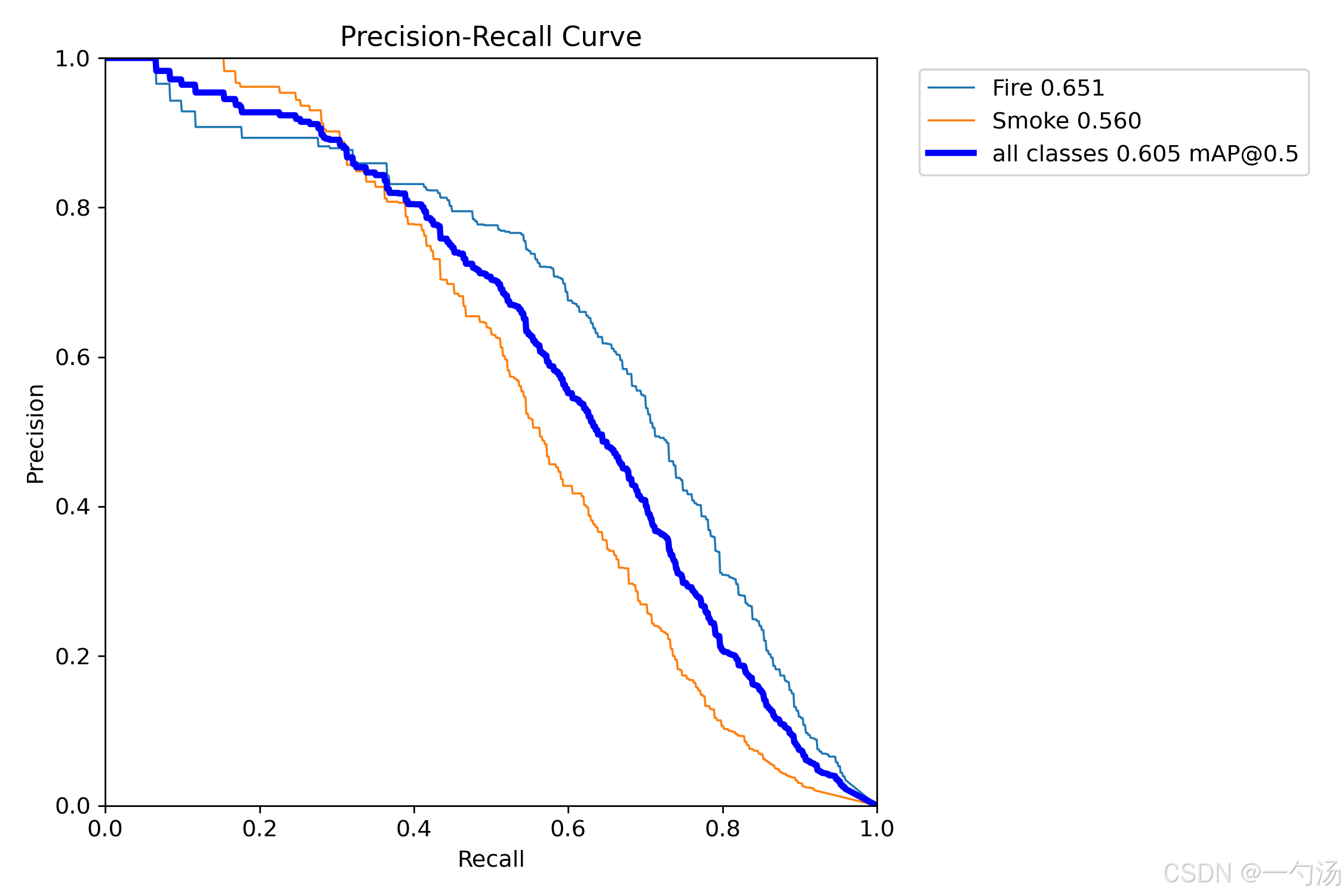

基础模型

改进后的模型

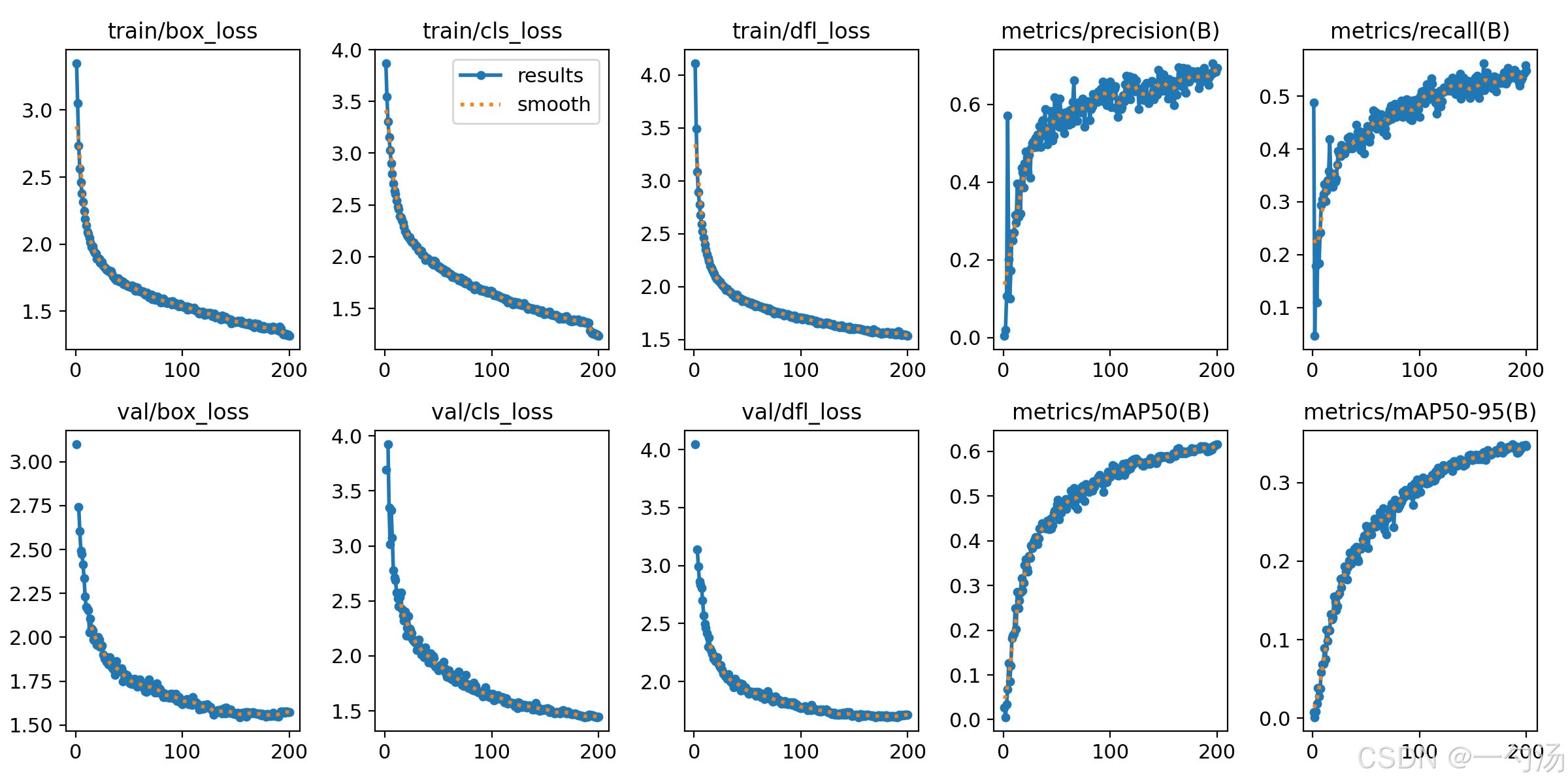

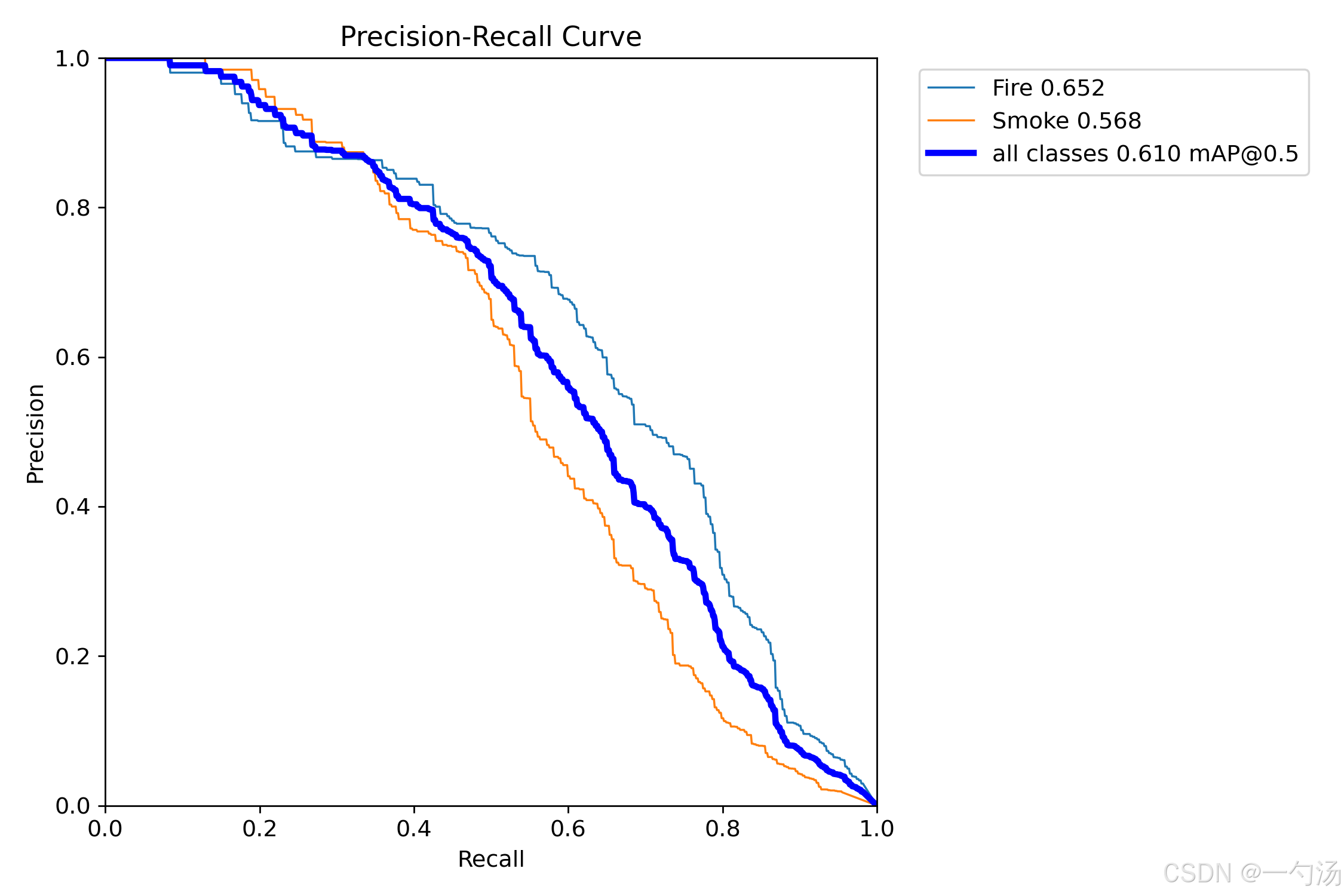

改进后的模型

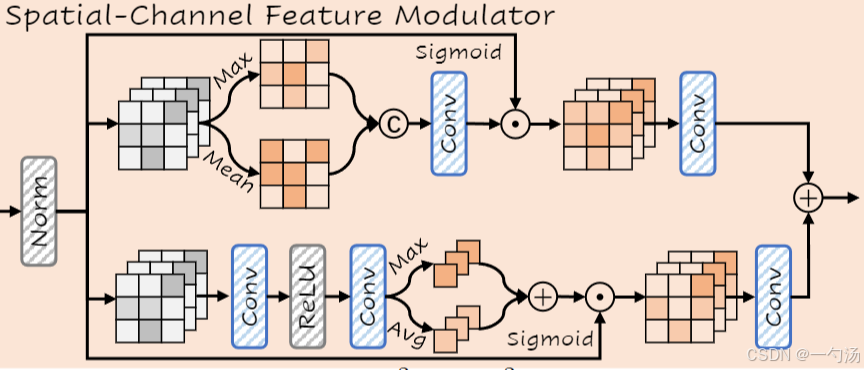

1.SCFM原理

SCFM 采用空间与通道双向独立调制、特征互补融合的核心原理,通过双分支注意力机制对特征进行精细化优化。空间分支聚焦图像的位置分布与局部结构,精准找回聚类建模中损耗的空间细节;通道分支挖掘不同特征通道的语义贡献度,强化有效特征、抑制冗余信息。二者协同工作,在不增加过多计算负担的前提下,将全局聚类特征与局部细节特征完美整合,让特征表达更全面、更精准。

SCFM 采用极简的并行双分支架构,部署灵活、计算高效,整体分为三个功能单元:

-

空间调制单元:对输入特征做空间维度的最大与平均池化,拼接后通过卷积与激活函数生成空间权重,重点增强图像关键区域的细节特征。

-

通道调制单元:先对特征做轻量卷积变换,再通过通道维度的池化与激活生成通道权重,筛选出对任务有价值的核心特征通道。

-

特征融合单元:将空间、通道调制后的特征分别与原始特征加权,最终融合输出完整的优化特征。

2. YOLO与 SCFM的结合

SCFM 轻量化的设计不会增加 YOLO 模型的参数量和推理时间,完全契合 YOLO 实时检测的应用需求。它能有效弥补 YOLO 在特征提取阶段的细节损耗,强化目标特征的表达效果,让小目标、复杂背景下的检测结果更稳定可靠。

3. SCFM代码部分

YOLO11|YOLO12|YOLO26|改进| 空间 - 通道特征调制器SCFM,通过空间与通道双分支注意力协同调节,融合全局与局部特征,弥补丢失细节_哔哩哔哩_bilibili

YOLO26 杀疯了:性能 Double + 无 NMS/DFL,更快更强更轻量的检测「新爹」_哔哩哔哩_bilibili

YOLOv11模型改进讲解,教您如何修改YOLOv11_哔哩哔哩_bilibili

代码获取: YOLOv8_improve/YOLOV12.md at master · tgf123/YOLOv8_improve · GitHub

4. SCFM引入到YOLO26中

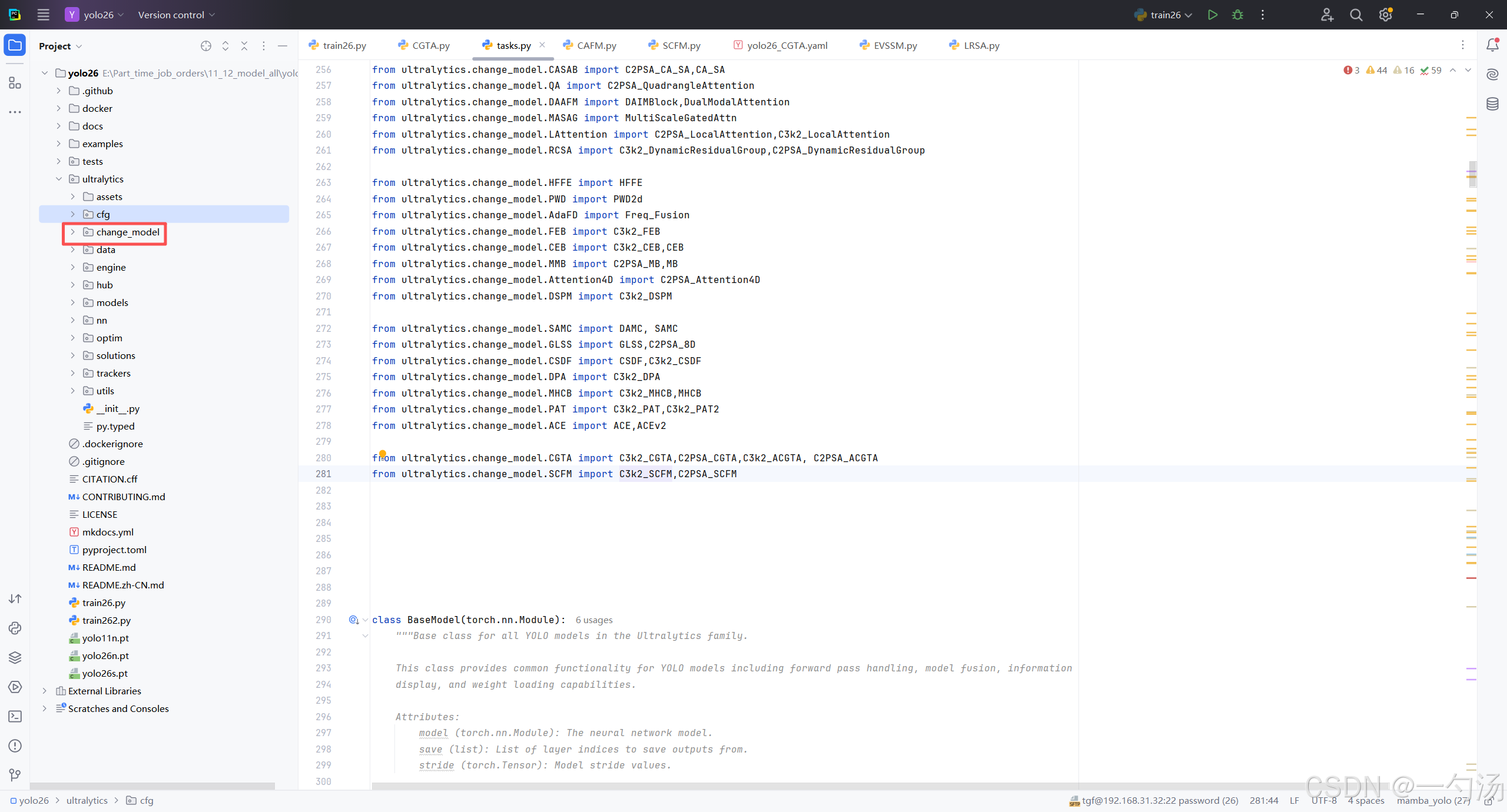

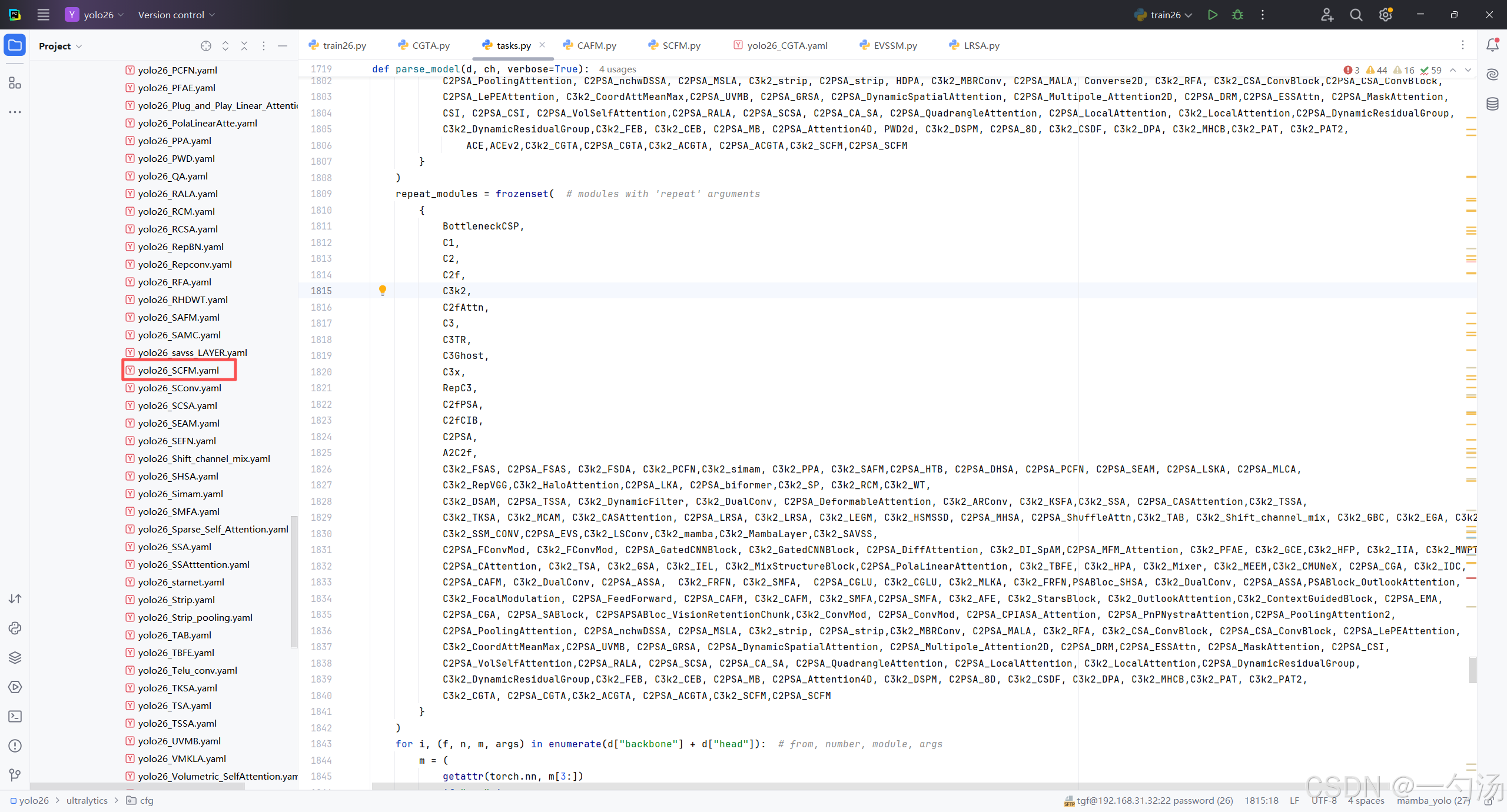

第一: 先新建一个change_model,如下图如所示。

将代码复制到change_model里面

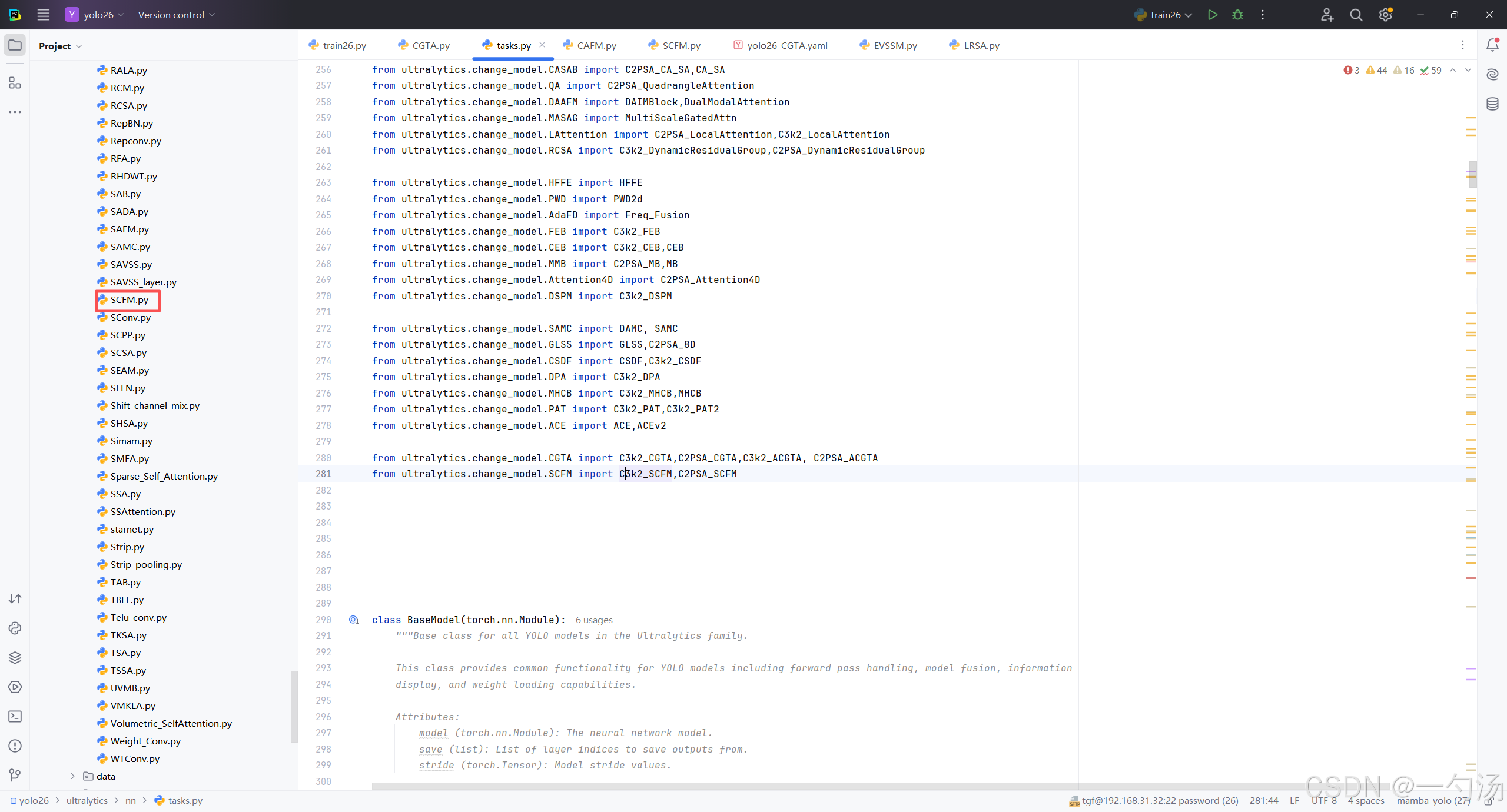

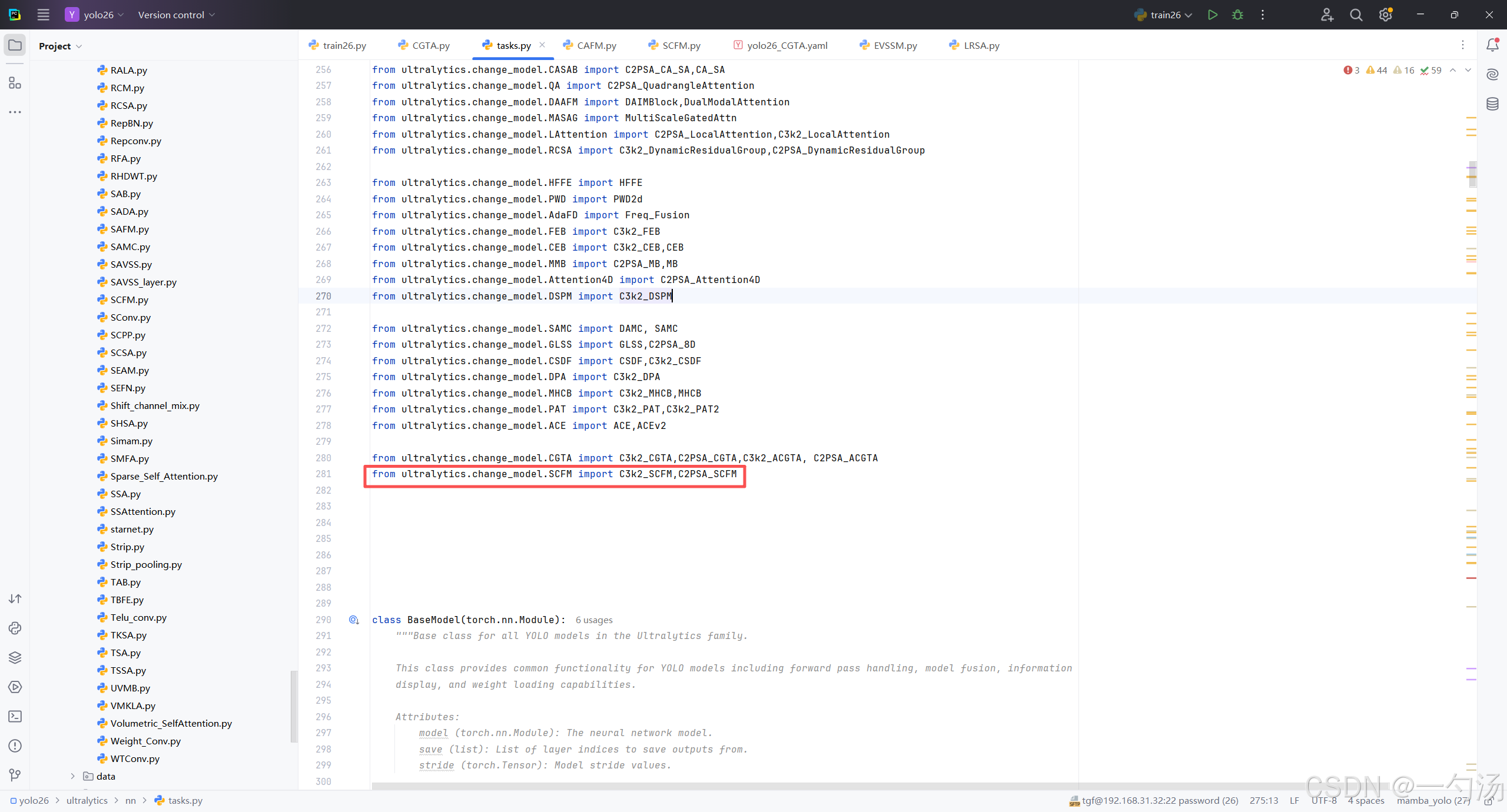

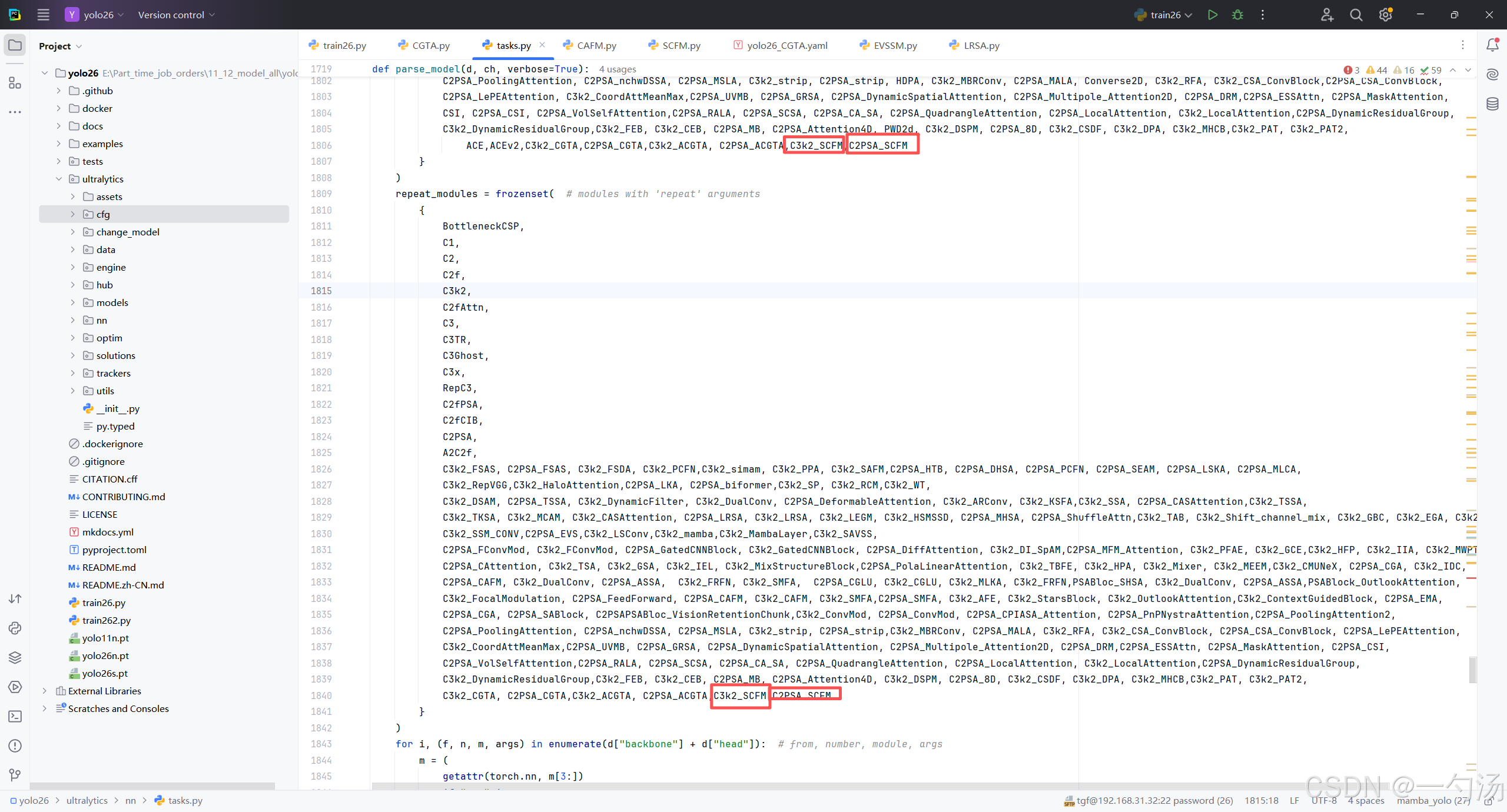

第二:在task.py中导入 包

第三:在task.py中的模型配置部分下面代码

第四:将模型配置文件复制到YOLOV11.YAMY文件中

第五:运行代码

python

from ultralytics.models import NAS, RTDETR, SAM, YOLO, FastSAM, YOLOWorld

if __name__=="__main__":

# 使用自己的YOLOv12.yamy文件搭建模型并加载预训练权重训练模型

model = YOLO(r"/home/tgf/tgf/yolo/model/YOLO26/ultralytics/cfg/models/26/yolo26_SCFM.yaml")

# .load(r'E:\Part_time_job_orders\YOLO_NEW\YOLOv12\yolo12n.pt') # build from YAML and transfer weights

results = model.train(data=r"/home/tgf/tgf/yolo/model/YOLO26/ultralytics/cfg/datasets/VOC_my.yaml",

epochs=300,

imgsz=640,

batch=32,

optimizer="MuSGD",

# cache = False,

# single_cls = False, # 是否是单类别检测

# workers = 0,

# resume=r'D:/model/yolov8/runs/detect/train/weights/last.pt',

amp = True

)