一、软件概述

本软件是一款基于OpenCV开发的图片校正工具,核心功能为:深度学习算法自动定位图片中左右两个区域各4个特征点,分别对两个区域进行透视校正,将倾斜、变形的区域校正为规则矩形,校正完成后自动保存两个区域的校正图,并将其左右拼接为一张完整图片,同时记录所有8个特征点的像素坐标,便于后续复用和验证。

软件适配Ubuntu、Windows等多系统,操作简洁,无需复杂配置,可快速完成图片双区域校正任务,适用于文档扫描、图像预处理等场景;同时支持深度学习算法辅助定位特征点,提升点定位的准确性和效率,减少手动操作误差。

二、软件操作说明

2.1 环境准备

-

依赖安装:软件基于Python、OpenCV和NumPy开发,若启用深度学习算法定位特征点,需额外安装深度学习相关依赖,终端执行以下命令: sudo apt update(Ubuntu系统) pip install opencv-python numpy torch torchvision(深度学习依赖,PyTorch框架)

-

文件准备:将需要校正的图片命名为"test.jpg",放置在与软件脚本(.py文件)相同的文件夹下;若图片名称或路径不同,可修改脚本中"IMG_PATH"参数,指定图片完整路径;启用深度学习算法时,需确保预训练模型文件与脚本同目录(模型配置见算法介绍部分)。

2.2 操作步骤

-

运行软件:打开终端,进入脚本所在文件夹,执行命令"python 脚本名称.py"(替换为实际脚本文件名),启动软件;若脚本支持手动/自动两种模式,可在运行时指定模式(具体命令见脚本注释)。

-

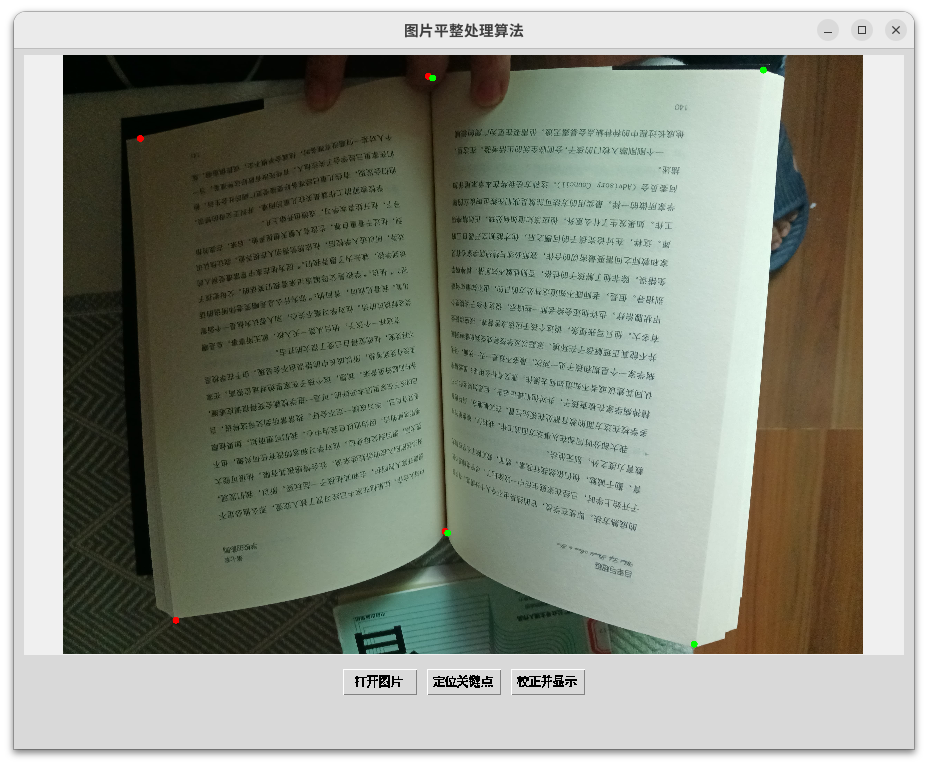

特征点定位(两种模式可选): 深度学习自动定位 启动软件后,软件会自动调用预训练的深度学习模型,对图片进行分析,自动识别并定位左右两个区域的各4个特征点,定位完成后会在图片上用不同颜色标记(左区域红色、右区域绿色),若定位存在偏差,可手动点击调整点位。

-

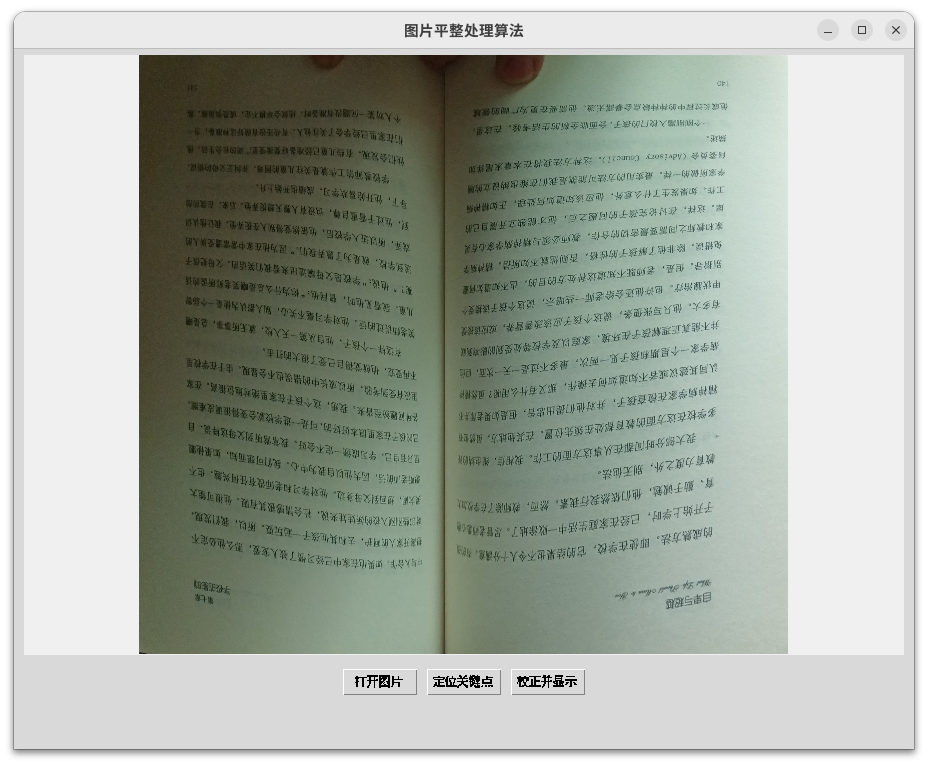

校正与保存: 完成8个点的定位后,软件会自动对左右两个区域分别进行透视校正,左侧校正图保存为"part1.jpg"、右侧校正图保存为"part2.jpg",同时将8个特征点的真实像素坐标写入"points.txt"文件(自动定位的点坐标同样会记录,便于后续验证和调整)。

-

自动拼接与保存: 两个区域的校正完成后,软件会自动将"part1.jpg"和"part2.jpg"按左右顺序拼接(统一两张图片的高度,保证拼接整齐),拼接后的图片保存为"merged.jpg",并弹出拼接结果窗口。

-

退出软件:查看拼接结果后,按键盘"ESC"键或关闭图片窗口,即可退出软件。

2.3 注意事项

-

点的选取/定位顺序必须严格遵循"左上→右上→右下→左下",顺序错误会导致校正后图片扭曲、翻转,无法达到预期效果;自动定位后若需手动调整,需保持该顺序。

-

若图片尺寸过大,软件会自动缩小窗口(最大窗口尺寸由"MAX_WINDOW"参数控制),但选取/定位点的坐标会自动还原为图片原始像素坐标,不影响校正结果。

-

每次运行软件,会清空"points.txt"文件中的历史坐标,重新记录本次定位的8个点坐标;若需保留历史坐标,可修改脚本中"open("points.txt", "w", ...)"为"open("points.txt", "a", ...)"。

-

启用深度学习自动定位时,需确保预训练模型文件完整、环境依赖安装正确,若图片存在模糊、遮挡,可能导致定位偏差,需手动调整。

-

生成的"part1.jpg""part2.jpg""merged.jpg"均保存在脚本所在文件夹,若需修改保存路径,可修改脚本中对应的保存路径参数。

-

深度学习模型对硬件有一定要求,若电脑配置较低,自动定位过程可能会有延迟,建议切换为手动定位模式。

三、算法介绍

3.1 核心算法框架

本软件的核心算法由两部分组成:深度学习特征点定位算法、四点透视校正算法,两者协同工作,实现图片双区域的精准校正;

3.2 深度学习算法(特征点定位)

3.2.1 算法选型

结合图片校正的场景需求(需精准定位区域角点、抗干扰性强、部署便捷),选用基于卷积神经网络(CNN)的特征点检测模型,具体采用轻量化的MobileNet作为 backbone,搭配关键点回归头,兼顾定位精度和运行速度,适合在普通电脑上部署,无需高性能GPU。

选型优势:MobileNet的轻量化特性可减少计算量,提升定位速度;CNN网络能有效提取图片的纹理、边缘特征,可应对图片轻微模糊、光照变化、轻微遮挡等场景,确保特征点定位的准确性;回归头直接输出特征点的像素坐标,无需额外的后处理步骤,简化部署流程。

3.2.2 算法原理

-

数据预处理:将输入图片(test.jpg)进行标准化处理(归一化至0,1区间、调整尺寸至模型输入尺寸),消除光照、尺寸差异对定位结果的影响;同时对图片进行轻微增强(随机翻转、亮度调整),提升模型的泛化能力。

-

特征提取:通过MobileNet网络对预处理后的图片进行特征提取,网络的卷积层、池化层逐步提取图片的低层次特征(边缘、纹理)和高层次特征(区域轮廓),最终输出一张特征图,包含图片的全局和局部特征信息。

-

关键点回归:将特征图输入到回归头中,回归头通过全连接层对特征进行映射,最终输出8个特征点的像素坐标(左区域4个、右区域4个),坐标对应图片原始尺寸,无需额外换算。

-

后处理:对回归输出的坐标进行轻微修正(去除异常值、平滑处理),确保坐标的合理性;同时判断定位的特征点是否符合"左上→右上→右下→左下"的顺序,若不符合,自动调整排序(或提示用户手动调整),为后续透视校正做准备。

3.2.3 模型训练与部署

模型训练:采用自定义数据集(包含各类倾斜、变形的图片,标注左右区域各4个角点坐标)进行训练,损失函数选用均方误差(MSE),用于衡量模型预测坐标与真实标注坐标的偏差,通过梯度下降法迭代优化模型参数,直至模型收敛。

模型部署:训练完成后,将模型保存为.pt格式(PyTorch模型),集成到软件脚本中,运行时直接调用模型,输入图片即可输出8个特征点坐标,部署简单,无需复杂配置。

3.3 四点透视校正算法

3.3.1 算法原理

透视校正是图片校正的核心步骤,其原理是通过建立原始倾斜区域(四边形)与目标规则矩形之间的透视变换关系,将倾斜区域映射为规则矩形,消除透视变形。对于左右两个区域,分别执行以下步骤:

-

坐标转换:将深度学习定位的4个特征点(左/右区域)转换为浮点数格式,作为原始四边形的顶点坐标(顺序:左上→右上→右下→左下)。

-

目标尺寸计算:根据原始四边形的顶点坐标,计算目标矩形的宽度和高度------宽度取原始四边形上下两条边长度的最大值,高度取左右两条边长度的最大值,确保目标矩形能完整包含原始区域,且无拉伸变形。

-

透视变换矩阵计算:通过OpenCV的cv2.getPerspectiveTransform()函数,根据原始顶点坐标和目标矩形顶点坐标((0,0)、(宽度-1,0)、(宽度-1,高度-1)、(0,高度-1)),计算透视变换矩阵M,该矩阵描述了原始区域到目标区域的映射关系。

-

透视变换:调用cv2.warpPerspective()函数,将原始图片与透视变换矩阵M结合,对原始区域进行透视变换,得到校正后的规则矩形图片,完成单个区域的校正。

3.3.2 拼接算法

左右两个区域校正完成后,采用水平拼接算法将两张校正图合并为一张完整图片:首先统一两张图片的高度(取两张图片高度的最大值,对较矮的图片进行拉伸或补黑边处理),保持宽度不变,然后通过numpy的hstack()函数将两张图片水平拼接,确保拼接处整齐,最终保存为merged.jpg。

3.4 算法优势

-

双模式适配:支持深度学习自动定位特征点,自动模式高效,可根据场景需求选择。

-

精度高:深度学习模型能精准定位特征点,结合透视校正算法,可有效消除图片的倾斜、透视变形,校正效果稳定。

-

效率高:轻量化深度学习模型+OpenCV底层优化,定位和校正速度快,普通图片可在1-2秒内完成处理。

-

易用性强:算法集成到软件中,无需用户了解算法细节,通过简单操作即可完成校正任务。