01

文献学习

今天分享的文献是由安徽医科大学第一附属医院超声科张超学等团队于2026年1月10日在肿瘤学领域顶刊《npj Precision Oncology》(中科院1区,IF=8)上发表的研究"Survival prediction and risk stratification in R0-resected ovarian cancer: a multi-modal deep learning approach"即R0切除卵巢癌的生存预测与风险分层:一种多模态深度学习方法,该研究开发了一个名为OvcaSurvivor 的多模态深度学习框架,用于R0切除卵巢癌患者的个体化生存预测与风险分层。该模型整合了全切片图像(WSI) 、超声图像(US) 和临床数据,通过注意力机制与门控融合策略,显著提升了预测性能,并在多中心外部验证中表现出良好的泛化能力。

创新点 :① 构建多模态深度学习框架,创新性地融合全切片图像、超声与临床数据,实现跨模态信息互补与协同预测。② 设计注意力引导的门控融合机制,动态调整各模态权重,增强模型对异质性肿瘤特征的捕捉与解释能力。③首次将计算病理(WSI)与超声影像深度结合,实现对R0切除卵巢癌患者术后生存的精准预测与分层。

临床价值 :① 提供个体化、高精度的生存预测工具,辅助临床医生制定术后治疗与随访策略,推动精准医疗实践。② 实现动态风险分层,能有效区分高/低危患者,为临床试验入组与分层治疗提供可靠依据。③弥补传统分期与单一biomarker的不足,提升预后评估的稳健性与临床实用性,有望改善患者管理结局。

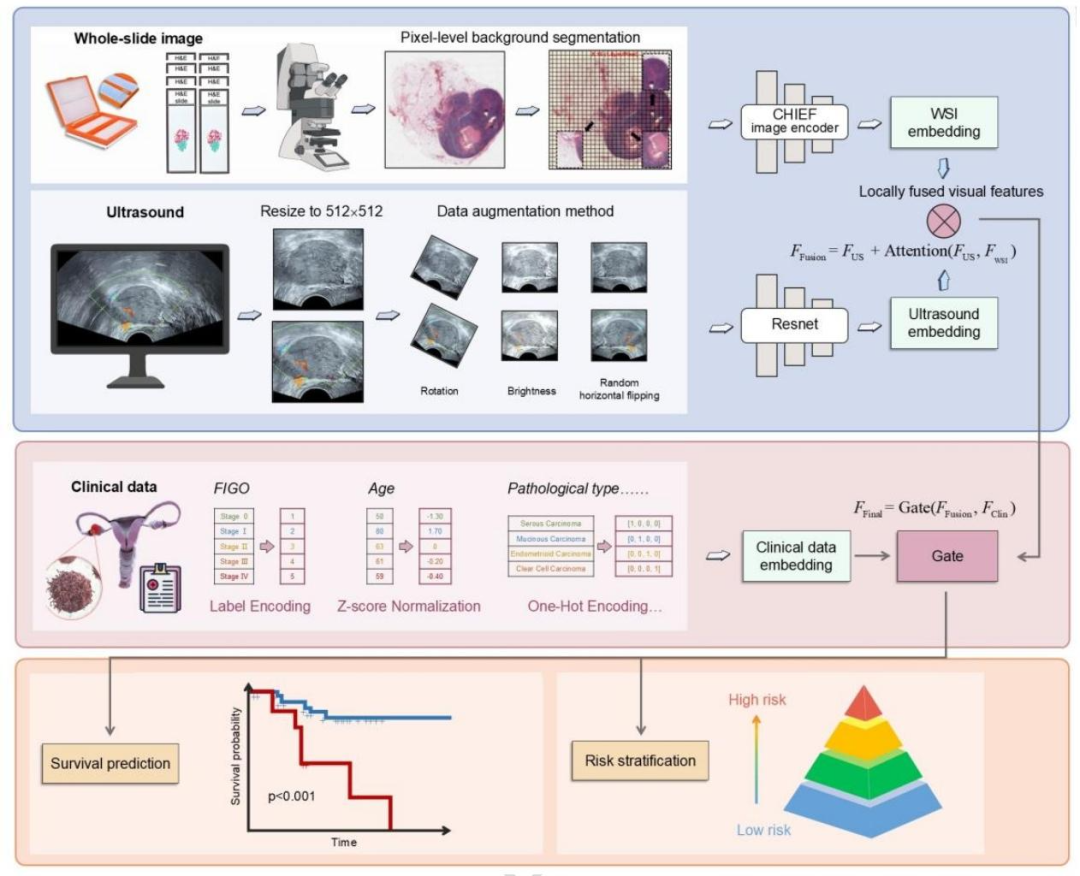

图 6:OvcaSurvivor模型架构示意图

数据预处理阶段:

WSI:像素级背景分割(Otsu阈值法)→裁剪为256×256像素补丁(10×放大);

US:resize至512×512像素→RGB三通道转换→归一化→数据增强(随机水平翻转、±15°旋转等);

临床数据:标签编码、Z-score标准化、独热编码→多维特征向量。

特征提取阶段:

WSI:采用CHIEF网络提取细胞水平形态学特征;

US:采用ResNet50(ImageNet预训练权重微调)提取宏观结构特征;

多模态融合阶段:

局部融合:交叉注意力模块(US特征为Query,WSI特征为Key-Value)→语义对齐;

全局融合:门控单元→自适应分配临床数据与影像特征权重;

**输出阶段:**全连接层→连续风险评分→高低风险分层(p<0.001)+1/3/5年生存预测。

02

研究背景及目的

研究背景

卵巢癌是全球妇科癌症死亡的首要原因,也是女性癌症相关死亡的前六大病因之一,其五年生存率仅约49%,预后依然严峻。尽管R0切除(完全切除)是重要的积极预后因素,但即使在这一亚组中,患者生存结局仍存在显著异质性,凸显出现有预后工具的不足。目前,临床常用的预测模型如基于CT影像的机器学习列线图、SEER数据库驱动的列线图以及基于糖酵解相关基因的风险模型等,虽各有进展,但其预测效能有限(C-index多处于0.70--0.80区间),且普遍存在对肿瘤异质性捕捉不足、特征提取不全面的问题 。FIGO分期系统与组织病理学分级虽为预后分层提供基础,却难以解释同一分期内患者结局的显著差异,且存在一定的主观不一致性。近年来,深度学习在医学影像与病理分析中展现出强大潜力,例如在卵巢癌良恶性鉴别、超声图像分析等方面已取得优于人工诊断的效能,尤其在全切片图像(WSI)分析中,深度学习能够提取人眼难以察觉的形态学预后特征 。然而,现有研究多局限于单一模态(如仅WSI或仅超声),未能实现多源数据的深度融合,从而可能遗漏跨模态的协同生物学信号。因此,开发一种能够整合WSI、超声影像与临床数据的新型多模态深度学习框架,成为提升卵巢癌生存预测精度与实现个体化风险分层的迫切需求。

研究目的

本研究旨在开发并验证一个多模态深度学习框架------OvcaSurvivor,用于提升R0切除卵巢癌患者的生存预测准确性与风险分层能力 。该框架的核心目标是整合三种关键数据源:高分辨率的全切片图像(WSI)、超声影像(US)及临床特征 ,通过先进的神经网络架构(包括用于WSI的CHIEF网络与用于超声的ResNet50)与注意力引导的门控融合机制,实现跨模态特征的语义对齐与自适应权重分配。研究的具体目的包括:第一,构建一个能够同时捕捉微观组织形态(WSI)与宏观影像结构(超声)的多模态融合模型 ,以克服单一模态模型的局限性;第二,通过内部与外部多个独立队列验证模型的预测效能,评价指标包括C-index、时间依赖性AUC及决策曲线分析(DCA);第三,阐明各模态特征在预测中的贡献度,并通过可视化技术(如Grad-CAM与交叉注意力矩阵)解释模型的生物学依据 ;第四,基于模型输出的风险评分,实现对患者的高风险与低风险分层 ,并通过Kaplan-Meier曲线与Cox回归验证其临床实用性;第五,通过消融实验验证所提融合机制(交叉注意力与门控单元)的必要性。最终,该研究旨在为卵巢癌的术后精准管理提供一个稳健、可解释且临床可用的预后工具,推动多模态深度学习在肿瘤预后预测中的实际应用。

03

数据和方法

研究数据

**研究对象:**共纳入543例R0切除卵巢癌患者,来自3个临床中心,分为4个队列:

训练队列(n=261,48.07%):安徽医科大学第一附属医院2018.1-2024.6患者;

内部验证队列(n=66,12.15%):安徽医科大学第一附属医院2012.7-2017.6患者;

外部验证队列1(n=157,28.91%):安徽医科大学第一附属医院高新区院区2016.6-2024.6患者;

外部验证队列2(n=59,10.87%):芜湖市第二人民医院2017.10-2025.3患者。

数据类型:

临床数据:年龄、FIGO分期、淋巴结转移状态、绝经状态、CA125、HE4、Ki67、ROMA指数等;

超声图像:经预处理(resize至512×512像素、数据增强等);

WSI:H&E染色,20×放大扫描,经背景分割后裁剪为256×256像素补丁。

结局指标:总生存期(OS),定义为从诊断到死亡的时间,随访截止至2025年3月25日。

技术方法

(1)模型架构:OvcaSurvivor多模态深度学习框架

特征提取:

WSI特征:采用预训练的CHIEF网络,提取细胞水平形态学特征;

超声特征:采用ResNet50网络,提取肿瘤宏观结构特征(如形态、边界等);

临床特征:经标签编码、Z-score标准化等预处理后,形成多维特征向量。

多模态融合:

局部融合:通过交叉注意力模块实现WSI与超声特征的语义对齐;

全局融合:通过门控单元自适应分配临床数据与影像特征的权重,抑制无关模态噪声。

输出:通过全连接层映射为连续风险评分,以中位数(0.62)为临界值将患者分为高风险组和低风险组。

(2)模型评估方法

主要指标:一致性指数(C-index)、时间依赖性受试者工作特征曲线下面积(AUC);

辅助分析:决策曲线分析(DCA)、Kaplan-Meier(KM)生存分析、多因素Cox回归、亚组分析、消融实验。

04

实验结果

(1)模型性能

OvcaSurvivor表现优异,显著优于单模态及双模态模型:

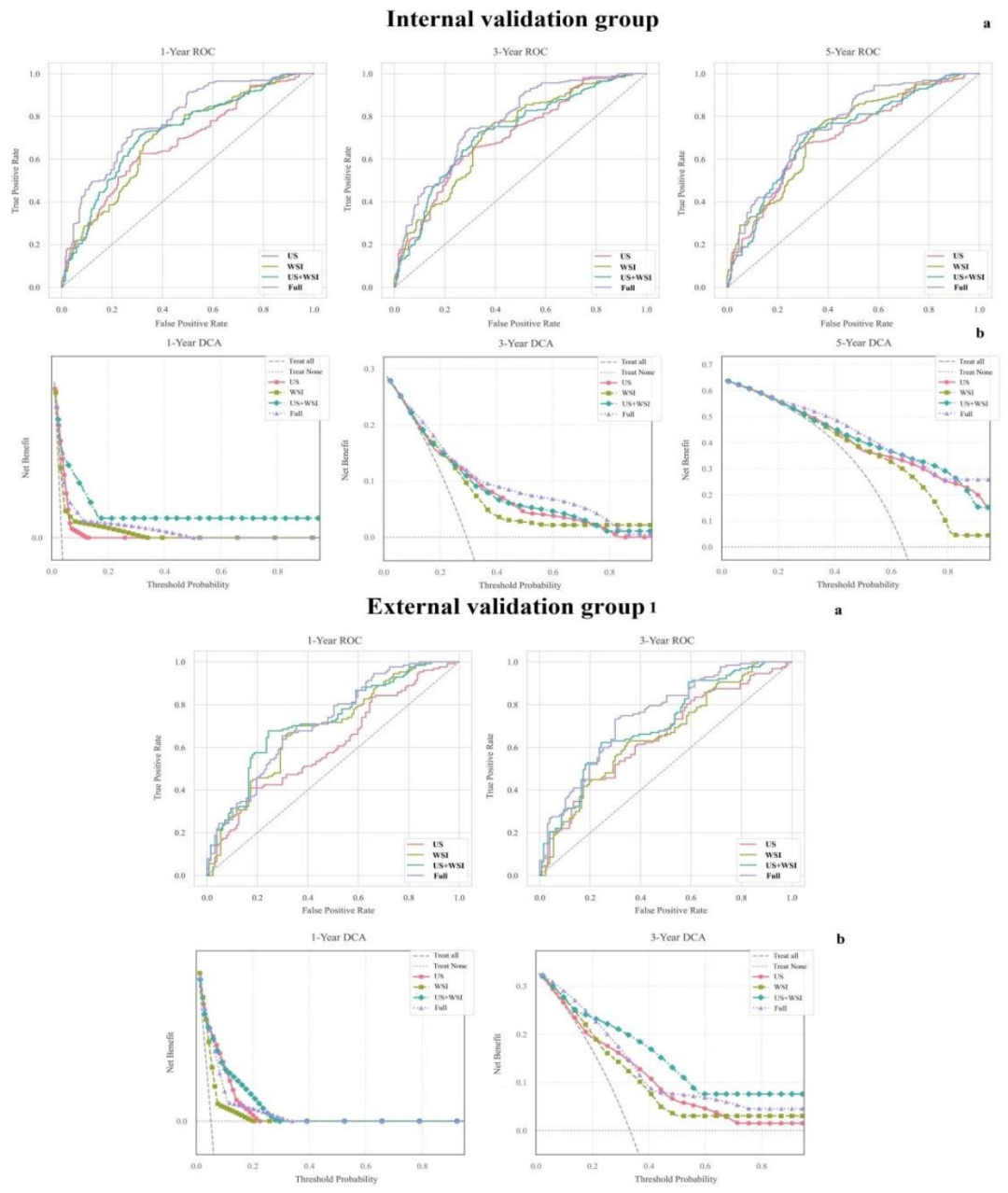

C-index:内部验证0.81(95% CI:0.77-0.85),外部验证1为0.76(95% CI:0.68-0.84),外部验证2为0.70(95% CI:0.69-0.80);

时间依赖性AUC:内部验证1年0.82、3年0.76、5年0.70;外部验证1年0.78、3年0.73;外部验证2年3年0.62、5年0.72。

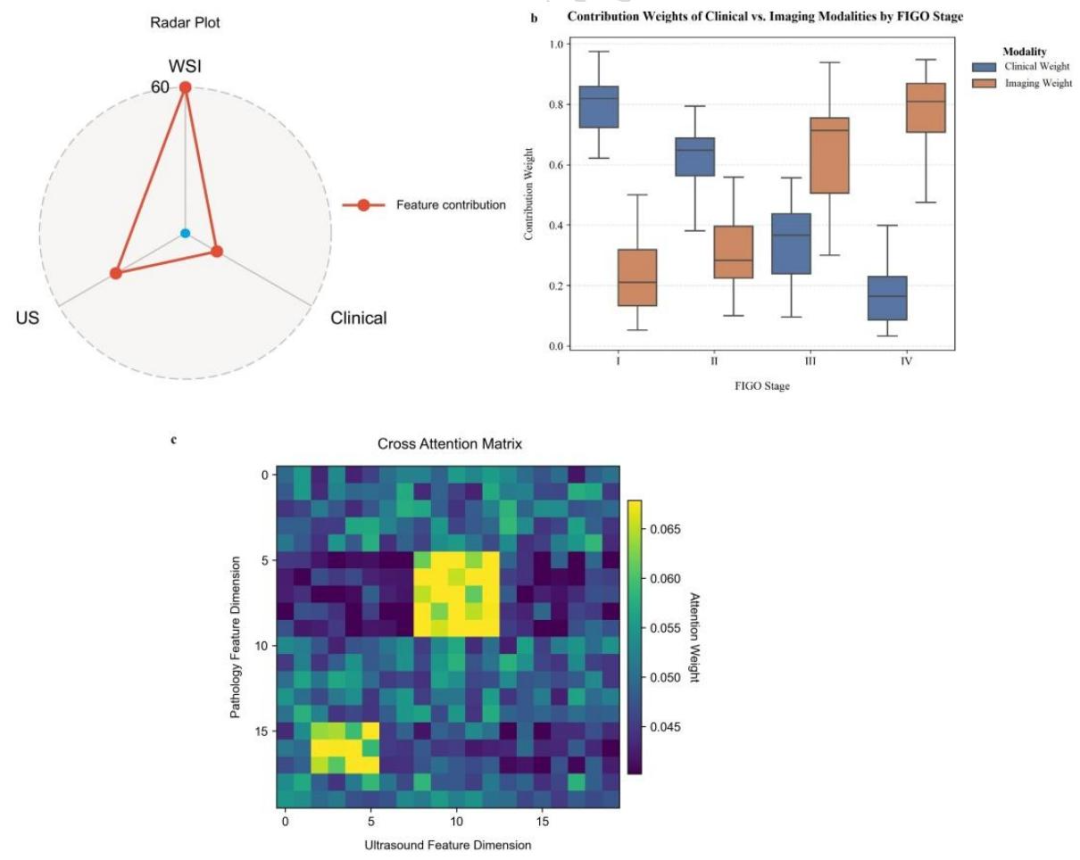

(2)特征贡献

WSI特征对预测的贡献最大,其次为超声特征和临床数据;

特征权重具有阶段适应性:FIGO早期(I-II)依赖临床指标,晚期(III-IV)通过门控机制提升超声和WSI的权重。

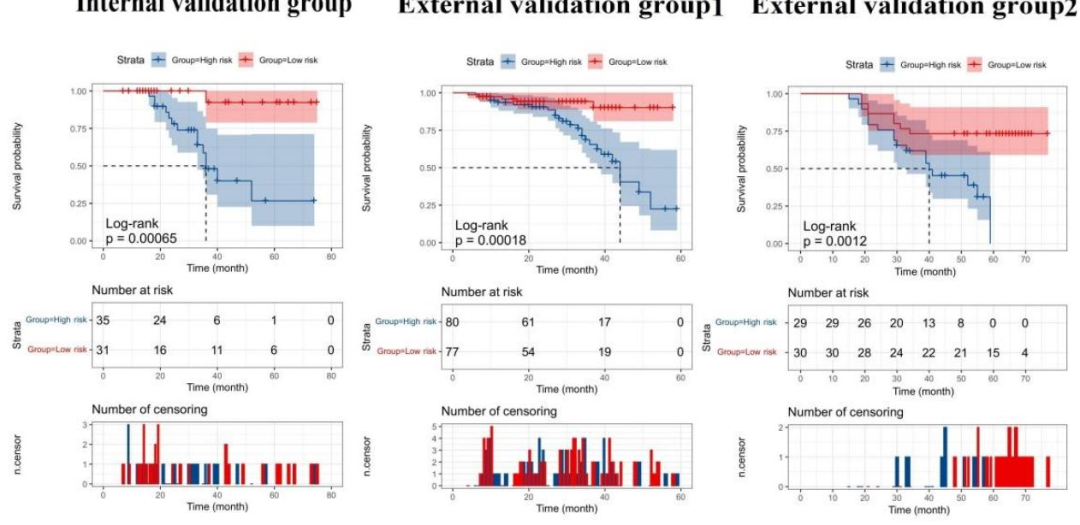

(3)风险分层

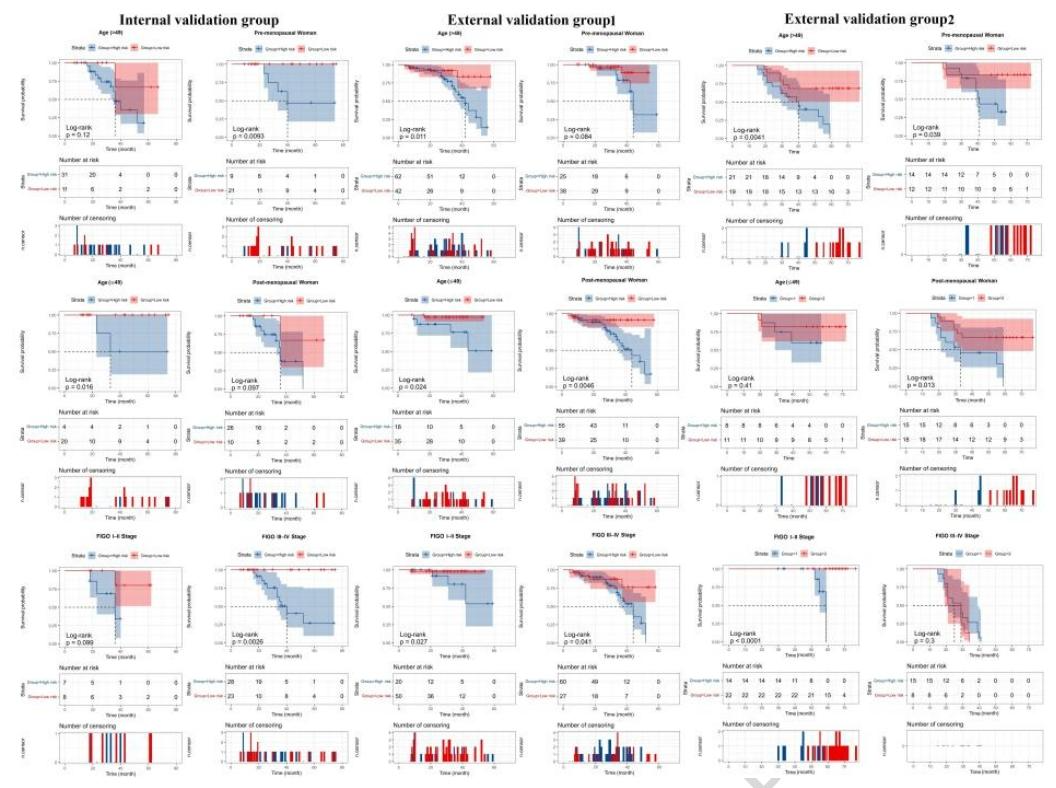

基于风险评分的高低风险组KM曲线分离显著(P<0.05),高风险组中位生存期显著低于低风险组;

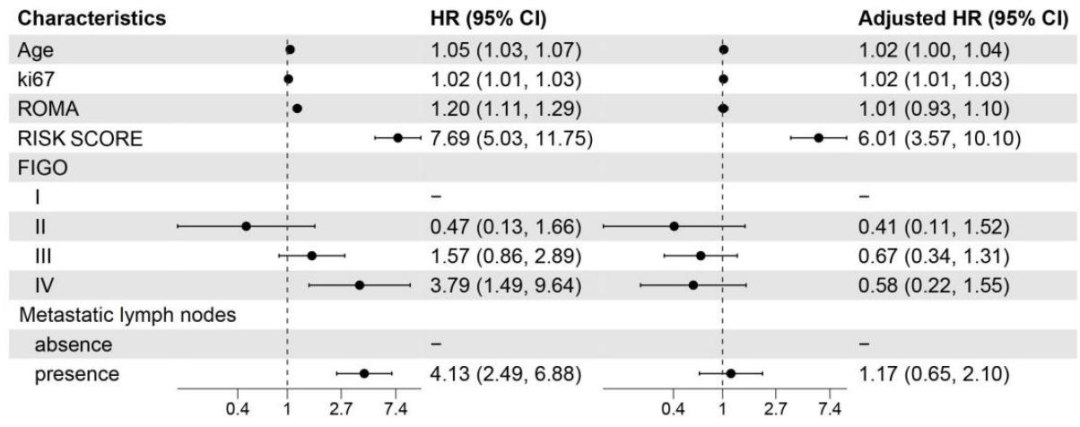

多因素Cox回归显示,风险评分为独立预后因素(HR=6.01,95% CI:3.57-10.10)。

(4)亚组分析与消融实验

亚组分析:模型在多数亚组(不同年龄、绝经状态、FIGO分期)中表现稳定,但部分亚组(如内部队列中绝经后女性、>49岁患者、早期病例)统计显著性不足(P>0.05),可能与样本量较小有关;

消融实验:移除交叉注意力模块或门控单元后,模型性能显著下降,证实融合架构的有效性。

图 1:时间依赖性ROC曲线与决策曲线分析(DCA)

a)1年、3年、5年时间依赖性受试者工作特征(ROC)曲线;b)同期生存预测模型的决策曲线分析(DCA)。

对比对象:OvcaSurvivor(多模态融合模型)与单模态模型(超声US、全切片图像WSI)、双模态模型(WSI+US)及临床基线策略。

图 2:模态贡献与跨模态对齐分析

a)模态贡献重要性雷达图;b)不同FIGO分期下模态权重分配图;c)WSI与US的交叉注意力矩阵。

图 3:高低风险组Kaplan-Meier(KM)生存曲线

图 4:多因素Cox回归森林图

展示纳入模型的关键变量(年龄、Ki67、ROMA指数、OvcaSurvivor风险评分、FIGO分期、淋巴结转移状态等)的多因素Cox回归结果,包括未调整和调整后的风险比(HR)及95%置信区间(95% CI)。

图 5:亚组Kaplan-Meier(KM)曲线分析

05

研究结论

本研究构建并验证了一种名为 OvcaSurvivor 的多模态深度学习框架 ,用于R0切除术后卵巢癌患者的生存预测与风险分层。该模型整合了全切片图像、超声影像与临床数据 ,通过注意力引导的门控融合机制,显著提升了预测性能。在内部验证中,其C-index达到0.81 ,外部验证分别为0.76与0.70 ,均优于单模态模型。研究证实WSI特征是预测最主要的贡献源 ,模型能够依据FIGO分期自适应调整不同模态的权重,早期阶段依赖临床指标,晚期则增强影像特征的重要性。此外,基于模型输出的风险评分,患者可被显著区分为高、低风险两组 ,生存曲线分离明显,且风险评分是独立的预后因素(HR=6.01)。尽管在部分亚组中因样本量限制表现受限,但整体上,OvcaSurvivor 通过多模态融合实现了更精准的个体化预后评估,为卵巢癌术后精准管理提供了有力的决策支持工具。

参考文献:Zhou Y, Duan Y, Teng M, Li S, Zhang H, He F, Gao C, Xiong Y, Wang J, Fan X, Zhang C. Survival prediction and risk stratification in R0-resected ovarian cancer: a multi-modal deep learning approach. NPJ Precis Oncol. 2026 Jan 10. doi: 10.1038/s41698-025-01263-3.