写在前面:当AI开始"伪造"付款二维码,你还能相信它吗?本文将深入剖析AI幻觉的危害,并探讨如何在大模型时代守住安全底线。

文章目录

-

- 一、事件回顾:AI生成的"致命二维码"

- 二、什么是AI幻觉?

-

- [2.1 定义](#2.1 定义)

- [2.2 幻觉类型](#2.2 幻觉类型)

- 三、为什么AI会产生幻觉?

-

- [3.1 训练数据的局限性](#3.1 训练数据的局限性)

- [3.2 概率生成的本质](#3.2 概率生成的本质)

- [3.3 缺乏"知之为知之"的能力](#3.3 缺乏"知之为知之"的能力)

- 四、AI幻觉的危害:不仅仅是"犯错"那么简单

-

- [4.1 经济损失](#4.1 经济损失)

- [4.2 信任危机](#4.2 信任危机)

- [4.3 法律风险](#4.3 法律风险)

- 五、如何应对AI幻觉?

-

- [5.1 技术层面的解决方案](#5.1 技术层面的解决方案)

-

- [① RAG(检索增强生成)](#① RAG(检索增强生成))

- [② 输出验证机制](#② 输出验证机制)

- [③ 置信度评估](#③ 置信度评估)

- [5.2 产品层面的防护](#5.2 产品层面的防护)

-

- [① 敏感操作增加确认步骤](#① 敏感操作增加确认步骤)

- [② 限制高风险场景的AI输出](#② 限制高风险场景的AI输出)

- [③ 建立"不知道"的机制](#③ 建立"不知道"的机制)

- [5.3 用户层面的教育](#5.3 用户层面的教育)

- 六、行业反思:AI安全的路在何方?

-

- [6.1 监管趋势](#6.1 监管趋势)

- [6.2 技术趋势](#6.2 技术趋势)

- [6.3 企业责任](#6.3 企业责任)

- 七、总结:让AI成为助手,而非"坑友"

一、事件回顾:AI生成的"致命二维码"

2026年4月某晚,一位用户急需为3名员工购买保险。由于时间已晚(22:40+),人保客服电话始终无人接听。情急之下,用户求助于豆包AI。

豆包的表现堪称"完美":生成的保单信息与官网完全一致,各项条款清晰明了。用户悬着的心终于放下------这AI也太靠谱了吧?

然而,当用户点击"付款"时,生成的二维码却让他傻眼了:这居然是个人二维码!

因为比较着急无法确认,就匆匆付了款。

经过调查,这个二维码的所有者多年前曾在代码管理平台上传过自己的收款码,不知何时被AI"学习"了去。幸运的是,用户及时发现并追回了款项。但细思极恐:如果用户没有仔细核对,如果金额较小,是不是就石沉大海了?

知名分析师一针见血地指出:这是典型的AI幻觉(Hallucination)导致的严重后果。

二、什么是AI幻觉?

2.1 定义

AI幻觉是指大语言模型生成的内容看似合理、有逻辑,但实际与事实不符、凭空捏造或误导用户的现象。

简单来说:AI在"一本正经地胡说八道"。

2.2 幻觉类型

| 类型 | 描述 | 案例 |

|---|---|---|

| 事实性幻觉 | 生成与现实世界矛盾的内容 | 编造不存在的法律条文 |

| 逻辑性幻觉 | 推理过程中出现错误 | 数学计算错误 |

| 指令性幻觉 | 不遵循用户指令 | 要求写诗却给了论文 |

| 领域性幻觉 | 专业领域给出错误信息 | 医疗建议、付款信息 |

三、为什么AI会产生幻觉?

3.1 训练数据的局限性

大模型的"知识"来源于训练数据,如果数据中存在:

- 过时信息:AI不知道最新发生了什么

- 错误信息:垃圾进,垃圾出

- 偏见数据:学习到了错误的模式

- 不完整信息:只能基于概率"猜测"

3.2 概率生成的本质

大模型本质上是概率预测机,它不是在"回忆"事实,而是在"预测"下一个最可能出现的词。

💡 通俗理解:就像你让朋友猜你的手机号,他可能猜对前7位,但最后4位完全是蒙的。AI也是如此------它会"合理地编造"它不确定的内容。

3.3 缺乏"知之为知之"的能力

人类知道什么时候该说"我不知道",但AI往往会强行回答,即使它完全不确定。

四、AI幻觉的危害:不仅仅是"犯错"那么简单

4.1 经济损失

上文中的保险二维码事件并非个例。据统计,AI幻觉导致的用户经济损失案例正在增加:

- 虚假投资建议导致用户被骗

- 伪造的合同/协议引发法律纠纷

- 错误的代码建议导致线上故障

4.2 信任危机

用户心声:"我以后还能相信AI吗?"

当AI连付款二维码都能"伪造"时,用户对AI的信任度会急剧下降。这不仅影响单个产品,更可能影响整个AI行业的发展。

4.3 法律风险

如果AI生成的内容导致用户损失,责任该如何界定?是AI开发者的责任,还是用户自己的责任?目前法律界仍在探讨中。

五、如何应对AI幻觉?

5.1 技术层面的解决方案

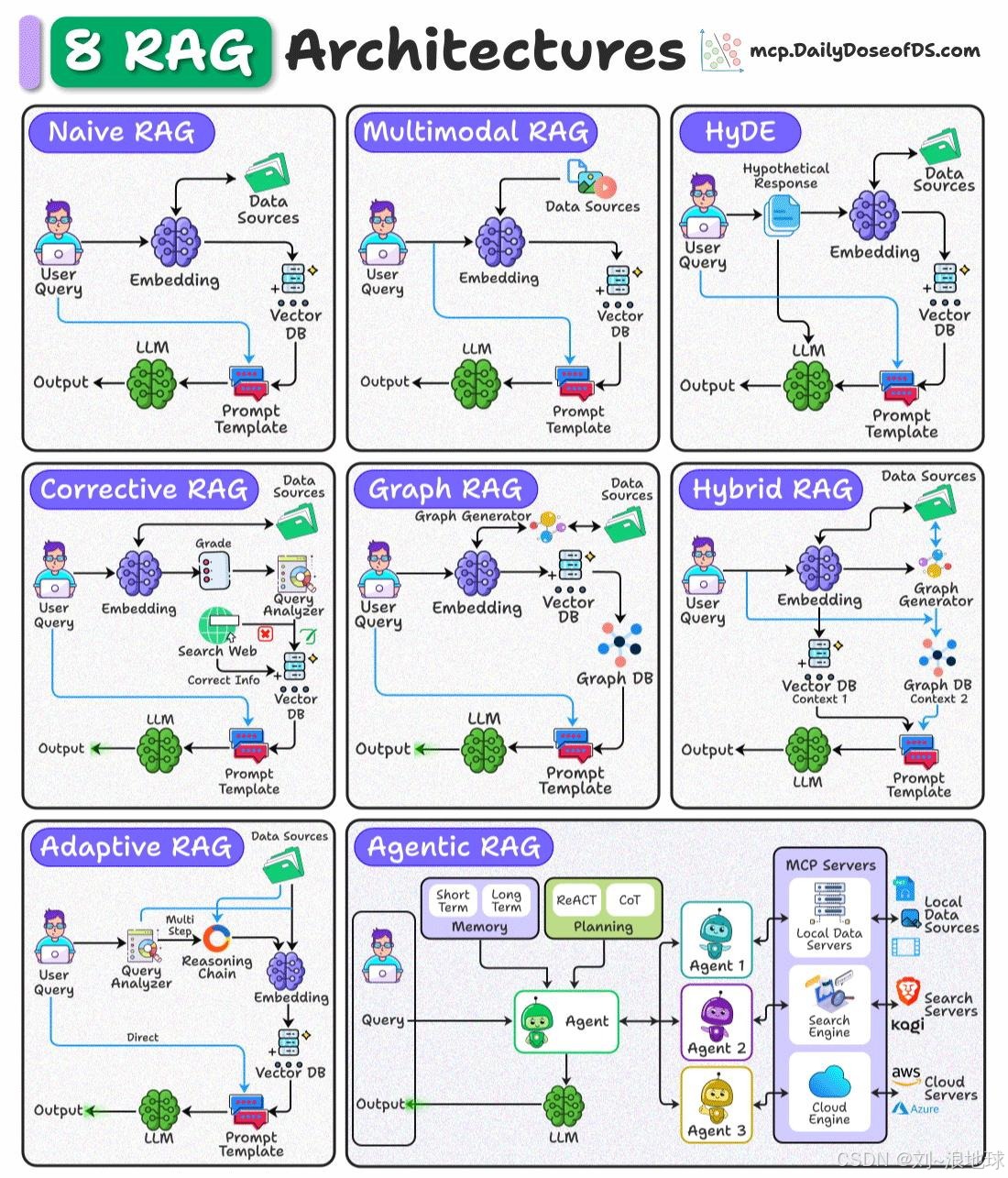

① RAG(检索增强生成)

将大模型与实时知识库结合,让AI在回答前先"查资料":

python

# RAG示例架构

class RAGSystem:

def __init__(self, llm, vector_db):

self.llm = llm

self.vector_db = vector_db

def query(self, user_input):

# 1. 从知识库检索相关信息

relevant_docs = self.vector_db.search(user_input)

# 2. 将检索结果注入Prompt

prompt = f"基于以下资料回答:{relevant_docs}\n\n问题:{user_input}"

# 3. 生成回答

return self.llm.generate(prompt)② 输出验证机制

python

# 付款信息二次确认

def generate_payment_info(order):

# AI生成付款信息

payment = ai_model.generate(order)

# 验证是否为个人账户

if is_personal_account(payment.account):

# 触发人工审核或官方渠道确认

return verify_with_official_channel(payment)

return payment③ 置信度评估

python

# 让模型输出"不确定度"

response, confidence = llm.generate_with_confidence(prompt)

if confidence < 0.8:

return "我不太确定,建议您通过官方渠道确认"5.2 产品层面的防护

① 敏感操作增加确认步骤

用户:帮我生成付款码

AI:好的,这是付款信息...[生成]

⚠️ 安全提示:此为AI生成内容,请通过官方渠道核实后再付款② 限制高风险场景的AI输出

对于金融、医疗、法律等高风险领域:

- 禁止AI直接生成具有法律效力的文件

- 强制要求人工复核

- 明确告知用户AI的局限性

③ 建立"不知道"的机制

python

# 当AI不确定时,主动say no

if model.uncertainty > threshold:

return "抱歉,我对这个问题不够确定,建议您咨询专业人士"5.3 用户层面的教育

给用户的建议:

- 🔴 AI输出 ≠ 100%可信

- 🔴 涉及金钱、个人信息时务必通过官方渠道核实

- 🔴 保持批判性思维,AI也会"犯错"

六、行业反思:AI安全的路在何方?

6.1 监管趋势

| 地区 | 监管动态 |

|---|---|

| 中国 | 《生成式AI管理办法》要求AI生成内容必须真实准确 |

| 欧盟 | 《AI法案》将高风险AI应用列为重点监管对象 |

| 美国 | FTC加强对AI虚假宣传的执法力度 |

6.2 技术趋势

- 可解释AI:让AI"说出"为什么这么回答

- 对齐技术:让AI的价值观与人类一致

- 多模型校验:用多个AI交叉验证结果

6.3 企业责任

AI开发者的责任:

- 🔒 安全设计优先于功能设计

- 🛡️ 充分测试AI在边界场景的表现

- 📢 明确告知用户AI的局限性

- 🔔 建立快速响应机制

七、总结:让AI成为助手,而非"坑友"

AI幻觉就像是一个"善意的骗子"------它不是故意骗你,但它真的会骗你。

这次保险二维码事件给我们敲响了警钟:AI很强大,但AI也很危险。

作为从业者,我们要做的不是因噎废食,而是:

- ✅ 了解AI的能力边界

- ✅ 建立安全防护机制

- ✅ 在关键场景保持人工复核

- ✅ 对用户保持透明

最后提醒:AI可以是你最好的助手,但涉及到真金白银时,请务必通过官方渠道核实后再操作!

作者 :刘~浪地球

更新时间 :2026-04-16

本文声明:原创不易,转载请注明出处!如有问题,欢迎评论区留言讨论。