这是一个系列专利,不讲 AI 概念,只讲实际落地!

前言

- 在日常的 AI 编程中,我们早已习惯了公司提供的 Claude Code、Cursor等AI编程套餐,带来的效率提升。但你可能没意识到,这些集成工具背后的模型提供商,基本是国外的,仅售卖给国外账户,收费标准也非常的贵。

- cc、gpt 等国外模型的购买,实际上对于小企业或者个人开发者,由于相关政策的限制,是有一定门槛的 ,使用起来也是极其不稳定。

那么如何解决这个问题呢?实际上,AI 大模型正在悄悄发生格局变化。

我们完全可以继续使用现在的开发工具 ,但是换成国内的大模型,这样访问起来,就非常稳定且快速。

今天这篇文章,就是要让大家在Claude code、gpt 购买和访问都困难的情况下,能够使用国内的模型进行快速的编码。

当下,智谱AI 和 miniMax 正在成为不可忽视的新力量。

接下来,我们将深入剖析这两家国内模型提供商的技术能力、定价策略、接入方式;以及它们是如何与主流 AI 编程工具协同工作的。

智谱AI:厚积薄发的国产大模型

1. 技术演进

智谱的GLM系列模型经历了多个版本的迭代,覆盖了多个场景。不仅有 coding 编程,还有图像、视觉、语言等场景的模型,基本覆盖了全场景

| 版本 | 发布时间 | 核心能力 | 编程能力 |

|---|---|---|---|

| GLM-4 | 2024年初 | 基础对话增强 | 初级编程辅助 |

| GLM-4V | 2024年中 | 多模态 | 图像理解 + 代码 |

| GLM-5 | 2025年 | Agentic能力 | 复杂任务编排 |

| GLM-5-Turbo | 2025年 | 推理优化 | 高效编程 |

2. 定价体系(按量计费)

智谱采用 输入/输出分离计费 模式:bigmodel.cn/pricing

| 模型 | Context长度 | Input (¥/M) | Output (¥/M) |

|---|---|---|---|

| GLM-5-Turbo | 0-32K | ¥5 | ¥22 |

| GLM-5-Turbo | 32K+ | ¥7 | ¥26 |

| GLM-5 | 0-32K | ¥4 | ¥18 |

| GLM-5 | 32K+ | ¥6 | ¥22 |

| GLM-4.7-FlashX | 200K | ¥0.5 | ¥3 |

| GLM-4.7-Flash | 200K | Free | Free |

计费逻辑:

- 输入计费:发送的 prompt、system prompt、history 都算 Token

Token 是指模型推理过程中文本的最小意义单位,通常指一个单词、汉语词语/短句、标点符号或数字等

- 输出计费:模型生成的内容才算 token

- context 长度超过 32K 后单价增加

- 文生图模型按请求次数计费,其它模型均按照每千 tokens 为单位计费

3. CodingPlan 编程套餐

相较于按量计费,CodingPlan 是更面向编程场景的套餐:

抢购时间: 每日 10:00

套餐特点:

- 专属编程优化模型,推出后已经涨价了 3 波

- 更低的单价(对比按量约 60%+ 节省)

- 基本上是供不应求的状态,不仅是为了控制并发,也进一步说明智谱 GLM 确实是国内顶流的大模型

4. 接入方式:兼容主流工具

智谱提供了多种接入方式,兼容 Claude Code、OpenAI、OpenCode 等主流工具:

方式一:Coding Tool Helper(推荐)

智谱官方的CLI工具管理助手,支持一键配置:

bash

# 推荐方式

npx @z_ai/coding-helper

# 全局安装

npm install -g @z_ai/coding-helper功能:

| 功能 | 说明 |

|---|---|

| 套餐集成 | 自动将 CodingPlan 加载到 IDE |

| 工具管理 | 检测/安装/配置 Claude Code 等 |

| MCP 配置 | 管理 MCP 服务 |

| 插件市场 | 用量查询、问题反馈插件 |

方式二:手动配置 Claude Code

编辑配置文件 ~/.claude/settings.json:

json

{

"env": {

"ANTHROPIC_BASE_URL": "https://open.bigmodel.cn/api/coding/paas/v4",

"ANTHROPIC_AUTH_TOKEN": "你的APIKey",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "glm-5.1",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "glm-5-turbo"

}

}方式三:手动配置 OpenCode

bash

curl -fsSL https://opencode.ai/install | bash

# 或使用 npm

npm install -g opencode-ai

# 启动后使用 /models 选择 GLM-55. 生态圈

智谱的生态在国内还算是相对成熟,生态内有不少智能体和MCP

miniMax:Token Plan 的创新模式

1. Token Plan 订阅模式

miniMax 采用了不同于传统按量计费的 Token Plan 方式:

不按 Token 收费,而是按照调用次数 ,每5小时刷新 一次。

次数用完了,就短暂休息会喝个咖啡吧~

| 套餐 | 价格/年 | 调用次数 | 速度 |

|---|---|---|---|

| Starter | ¥290 | 600次/5h | 50 TPS |

| Plus | ¥490 | 1500次/5h | 50 TPS |

| Max | ¥1,190 | 4500次/5h | 50 TPS |

| Plus-极速版 | ¥980 | 1500次/5h | 100 TPS |

| Max-极速版 | ¥1,990 | 4500次/5h | 100 TPS |

| Ultra-极速版 | ¥8,990 | 30000次/5h | 100 TPS |

2. 接入方式

2.1 Python 调用 - Anthropic SDK 兼容

这是 miniMax 最值得关注的特性!只需修改 base_url,无需更换 SDK:

ini

import anthropic

client = anthropic.Anthropic(

base_url="https://api.minimax.io/anthropic",

api_key="your Token Plan Key"

)

response = client.messages.create(

model="MiniMax-M2.7",

max_tokens=4096,

system=[{"type": "text", "text": "你是一个专业的开发者"}],

messages=[{"role": "user", "content": "写一个快速排序"}]

)

for block in response.content:

if block.type == "text":

print(block.text)2.2 Claude Code 配置

编辑 ~/.claude/settings.json:

json

{

"env": {

"ANTHROPIC_BASE_URL": "https://api.minimax.io/anthropic",

"ANTHROPIC_AUTH_TOKEN": "你的TokenPlanKey",

"API_TIMEOUT_MS": "3000000",

"ANTHROPIC_MODEL": "MiniMax-M2.7"

}

}2.3 OpenCode 配置

bash

opencode auth login

# 选择 provider: minimax

# 输入 API Key三、编程工具上如何使用这两个模型

前面我们已经购买了 AI 模型,但目前还不适用于程序员编写代码。

一个现实问题是:AI编程的GUI工具,基本都是国外开发的。

国外的工具,天然支持 openAI 和 Anthropic 的模型,所以国内的模型想要参与编程领域,就必须支持这两个协议,并且能作为代理转发。

形成这样的局面:国内的模型,要去兼容国外的编程工具。

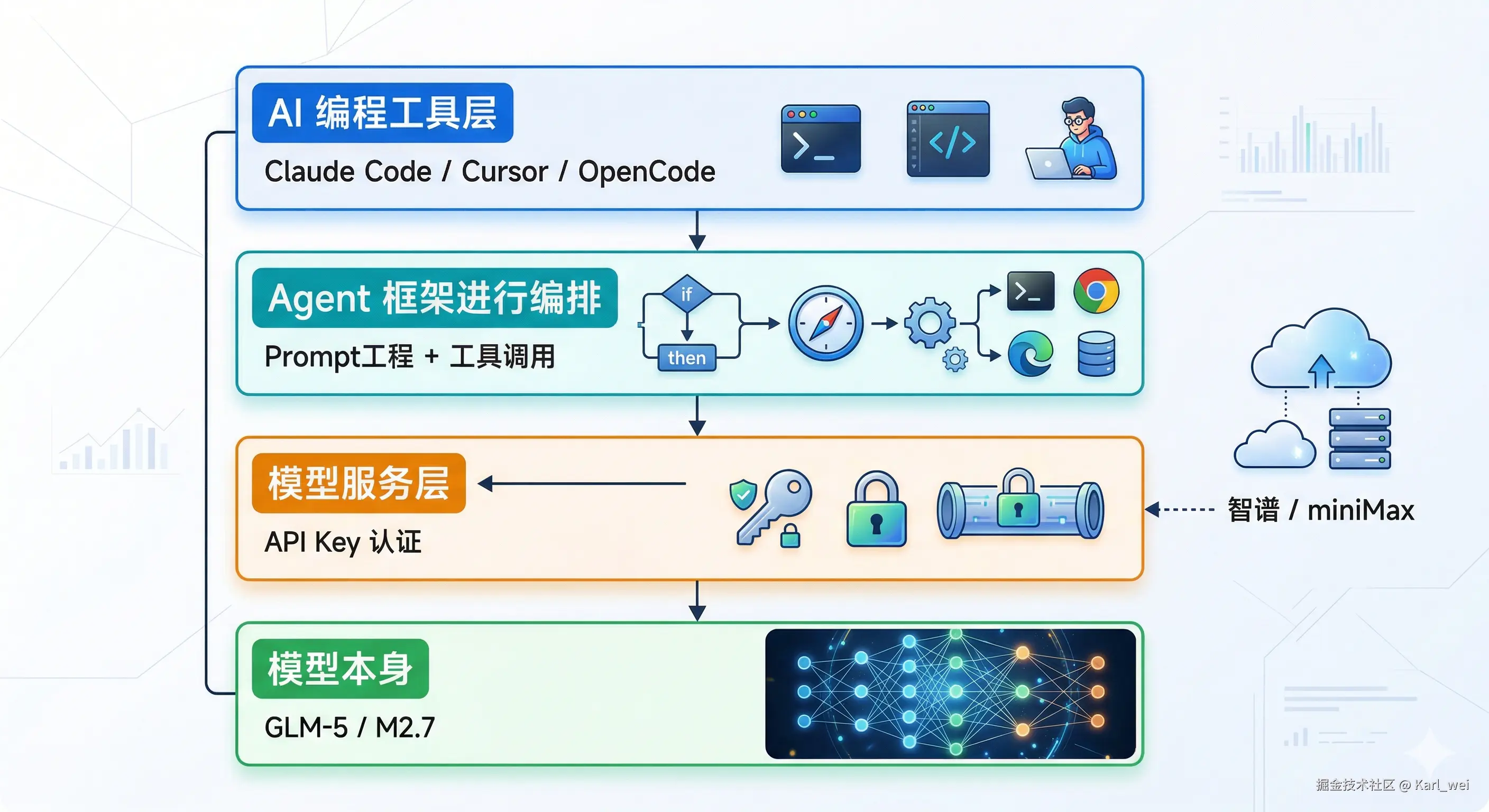

1. 分层架构

编程工具会带 Agent 框架,负责会话记忆、内存、任务编排等,然后依据协议调用大模型

模型提供商,只负责"提供答案"

这也是为什么换一个模型,你就会觉得AI更聪明了,AI 编程本质的差异在于模型的能力

2. 兼容原理

主流 AI 代理工具,最初都是为 OpenAI/Anthropic 设计,它们的代码期望大模型能提供:

- 特定的 API 端点(open.bigmodel.cn/api/coding/...

- 大模型请求的 Auth/ Key,通过这个认证信息去扣除对应账号的额度

兼容实现方式:模型厂商只需实现兼容的 API 端点,工具无需修改。

3. 操作步骤

3.1 Claude Code 命令行工具或者 IDE插件

直接修改本机的配置文件,即可替换模型

- Claude Code 的配置位置: ~/.claude/settings.json

json

{

"env": {

"ANTHROPIC_AUTH_TOKEN": "xxxxx",

"ANTHROPIC_BASE_URL": "https://open.bigmodel.cn/api/anthropic",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "glm-5",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "glm-5",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "glm-5",

"ANTHROPIC_MODEL": "glm-5"

},

"includeCoAuthoredBy": false,

"CLAUDE_CODE_DISABLE_NONESSENTIAL_TRAFFIC": 1

}- 同理,也可以通过修改openAI 的配置:auth.json, 让国产大模型去替代 gpt

json

{

"OPENAI_API_KEY": "clp_xxxx"

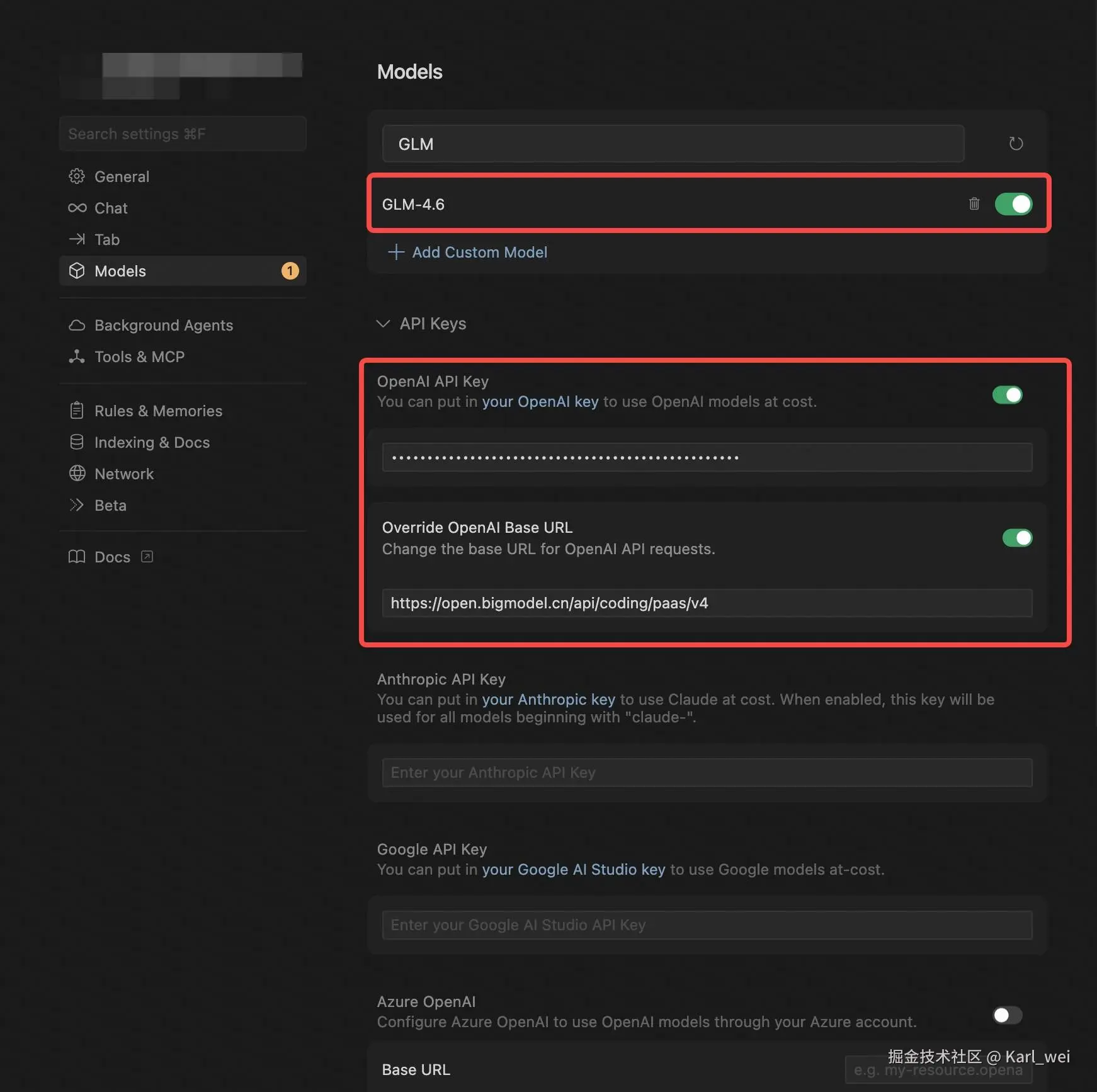

}3.2 Cursor 设置面板添加模型

- 选择 OpenAI 协议。

- 配置 OpenAI API Key(从智谱开放平台获取)。

- 在 Override OpenAI Base URL 中,将默认 URL 替换为:

https://open.bigmodel.cn/api/coding/paas/v4。 - 输入您希望使用的模型,如

GLM-5,GLM-4.7,GLM-4.6或GLM-4.5-air。 - 注意: 在 Cursor 中,需要输入模型的大写名称不能小写名称,如

GLM-4.7。

docs.bigmodel.cn/cn/coding-p...

四、选型建议

1. 选择智谱的场景

markdown

✅ 需要 **CodingPlan** 套餐(性价比高)

✅ 需要 **多模态** 能力(图像理解)

✅ 喜欢官方提供的 **Tool Helper** 一键配置

✅ 需要 **MCP 扩展**(联网搜索、网页读取)2. 选择 miniMax 的场景

markdown

✅ 想要 **Anthropic SDK 零成本迁移**

✅ 需要 **100 TPS** 极速推理

✅ 需要的工具 **已被官方支持**(Claude Code、Cursor等)

✅ 更喜欢 **订阅制**(预算更可控)3. 对比总结

| 特性 | 智谱AI | miniMax |

|---|---|---|

| 计费模式 | 按量 + CodingPlan | Token Plan 订阅 |

| SDK兼容 | OpenAI风格 | Anthropic风格 |

| 极速版 | 待确认 | 100 TPS |

| 工具支持 | 4种 | 11+种 |

五、总结

实际上,国内AI模型正在快速崛起,智谱和miniMax都展现出了不逊于国外大模型的技术能力。

作为工程师,拥抱这种多元化,不依赖单一供应商,根据场景灵活选择,这反而是一种优势。

注意:本文定价和功能信息可能会有变化,请以官网为准。