或者站内下载:https://download.csdn.net/download/s060403072/92816570

📋 概览

本项目基于上一篇【第3篇】Multi-Model多模型多模态开发指南,是企业级多模态 AI 应用示例 ,也是在Spring AI Alibaba 框架的基础上构建,展示了如何以统一的方式集成多种 AI 服务提供商(阿里云 DashScope、字节跳动 Ark、NVIDIA API)。

项目采用模块化架构设计 ,每个模块独立演示不同的 AI 能力场景,从简单的文本对话到复杂的多模态理解(图片、视频、音频),为大家提供完整的参考实现。

为什么选择 Spring AI Alibaba?

Spring AI Alibaba 是 Spring AI 框架的阿里云生态扩展,它继承了 Spring 家族一贯的**"抽象即自由"设计理念 ------正如 JdbcTemplate 统一了数据库访问层,Spring AI 试图在 AI 领域建立一套通用编程模型**,让开发者无需被特定模型、平台或 API 绑定,实现"一次编码,多模型运行"的愿景。

🏗️ 项目架构全景

用户请求

Controller层

ChatClient 统一入口

Advisor增强链

ChatModel 模型抽象

DashScope

多模态模型

Ark

企业级模型

NVIDIA API

OpenAI兼容

图片理解

视频分析

音频处理

对话记忆

日志追踪

文本生成

视觉理解

模块结构

spring-ai-alibaba-multi-model-example/

├── dashscope-multi-model/ # 阿里云 DashScope 全模态能力展示

├── ark-multi-model/ # 字节跳动 Ark 企业级 AI 服务

├── openai-dashscope-multi-model/ # NVIDIA API (OpenAI 兼容接口)

└── README.md # 项目文档🔍 核心设计原理深度解析

1. Spring AI 分层架构哲学

Spring AI 的核心架构采用分层抽象设计,将复杂的 AI 调用简化为清晰的职责分离:

🏢 提供商实现层 (Provider Implementation)

🔧 模型抽象层 (Model Abstraction)

✨ 功能增强层 (Enhancement Layer)

🚀 应用层 (Application Layer)

请求

增强

路由

路由

路由

📋 业务代码

🤖 ChatClient

高层API

🔗 流畅API链式调用

.prompt().user().call()

⚡ Advisor拦截器链

📝 日志记录

SimpleLoggerAdvisor

💬 对话记忆

MessageChatMemoryAdvisor

🔍 RAG检索增强

QuestionAnswerAdvisor

📦 ChatModel 接口

▶️ 同步调用 call

📡 流式调用 stream

🖼️ 多模态支持

🔷 DashScopeChatModel

🟢 OpenAiChatModel

Ark兼容

🟠 OpenAiChatModel

NVIDIA兼容

关键洞察 :ChatClient 是高层抽象 ,面向应用开发者,提供声明式、易用的 API;ChatModel 是底层接口 ,直接封装与 AI 模型的通信 。正如驾驶汽车:ChatModel 是引擎(直接操控动力),ChatClient 是方向盘(优雅驾驶)。

2. 多模态统一处理机制

多模态 AI 的核心挑战在于异构数据的统一表达 。Spring AI 通过 Media 类实现了优雅的抽象:

AI模型 ChatClient 用户消息 Media封装 控制器 用户 AI模型 ChatClient 用户消息 Media封装 控制器 用户 MimeType + 数据源 统一封装二进制/URL/文件 text: 文本提示 media: List<Media> 上传图片/视频/音频 创建 Media 对象 构建多模态消息 prompt(new Prompt(message)) 发送统一格式请求 返回理解结果 结构化响应

代码实现原理:

java

// 统一的多媒体封装 - 屏蔽底层差异

Media media = new Media(

MimeTypeUtils.IMAGE_PNG, // MIME 类型标识

URI.create("https://example.com/image.jpg") // 数据源(URL/文件/二进制)

);

// 统一的消息格式 - 文本+多媒体混合

UserMessage message = UserMessage.builder()

.text("分析这张图片的内容") // 文本提示词

.media(List.of(media)) // 多媒体内容列表

.build();3. 智能视频处理架构

视频理解的难点在于时序信息的提取与压缩 。项目采用帧提取 + 智能采样策略:

视频文件

FFmpeg/JavaCV

帧提取

帧序列

N帧

智能采样算法

均匀选取M帧

代表关键信息

转换为 Media 列表

构建多模态 Prompt

DashScope 视觉模型

智能采样算法原理:

- 问题:视频可能包含数千帧,全部发送会超出模型上下文限制且成本高昂

- 策略:均匀采样,从 N 帧中选取具有代表性的 M 帧(如每 30 帧取 1 帧)

- 实现 :通过

IntStream流式处理,确保时间轴上的均匀分布

🎯 各模块详细剖析

模块一:dashscope-multi-model(全模态能力)

这是最完整的多模态示例,展示了 DashScope 的原生多模态能力:

提供视频帧

依赖注入

FrameExtraHelper

-List<Path> imgList

+run(ApplicationArguments)

+getVideoPic() : void

+createMediaList(int) : List<Media>

DashScopeController

-ChatClient chatClient

+analyzeImageByUrl() : String

+analyzeVideo() : String

+analyzeAudio() : String

+analyzeImageBinary() : String

+streamAnalyzeImage() : Flux<String>

ChatClient

+prompt() : ChatClientRequestSpec

+call() : CallResponseSpec

+stream() : StreamResponseSpec

核心技术亮点

1. 视频帧提取与智能采样

java

@Component

public class FrameExtraHelper implements ApplicationRunner {

// 应用启动时自动预热:提取视频帧到本地缓存

@Override

public void run(ApplicationArguments args) {

getVideoPic(); // 异步提取所有帧,避免首次请求延迟

}

/**

* 智能采样算法:从总帧数中均匀选取指定数量的代表帧

* 原理:interval = totalFrames / numberOfImages,确保时间轴均匀分布

*/

public static List<Media> createMediaList(int numberOfImages) {

int totalFrames = imgList.size();

int interval = Math.max(totalFrames / numberOfImages, 1); // 防止除零

return IntStream.range(0, numberOfImages)

.mapToObj(i -> imgList.get(i * interval)) // 均匀采样

.map(image -> new Media(

MimeType.valueOf("image/png"),

new PathResource(image) // Spring Resource 抽象

))

.collect(Collectors.toList());

}

}2. DashScope 特有消息格式标记

DashScope 需要显式声明消息格式以优化处理路径:

java

// 通过 Metadata 传递格式信息,让 DashScope 选择最优处理管道

message.getMetadata().put(

DashScopeApiConstants.MESSAGE_FORMAT,

MessageFormat.VIDEO // 可选:IMAGE / VIDEO / AUDIO

);API 接口矩阵

| 端点 | 功能描述 | 技术特点 | 适用场景 |

|---|---|---|---|

/dashscope/multi/image |

URL 图片分析 | 远程资源加载,支持任意公开图片 URL | 网络图片分析 |

/dashscope/multi/video |

视频内容理解 | 帧提取 + 智能采样 + 时序理解 | 视频摘要、内容审核 |

/dashscope/multi/audio |

音频内容分析 | 音频文件转录与理解 | 语音指令、会议记录 |

/dashscope/multi/image/bin |

二进制图片处理 | 本地资源直接加载,减少网络开销 | 用户上传图片 |

/dashscope/multi/stream/image |

流式图片分析 | SSE 实时推送,提升交互体验 | 实时聊天应用 |

模块二:ark-multi-model(企业级特性)

字节跳动 Ark 模块展示了AI 应用的最佳实践:

企业级特性架构

功能

功能

配置

请求进入

MessageChatMemoryAdvisor

SimpleLoggerAdvisor

OpenAiChatModel

对话记忆管理

维护上下文连续性

完整调用日志

便于审计调试

topP 参数控制

输出多样性

ChatClient 高级配置解析

java

this.openAiChatClient = ChatClient.builder(chatModel)

// 1. 对话记忆:基于窗口的滑动记忆,防止上下文溢出

.defaultAdvisors(

MessageChatMemoryAdvisor.builder(

MessageWindowChatMemory.builder()

.maxMessages(10) // 保留最近10轮对话

.build()

).build()

)

// 2. 可观测性:记录请求/响应详情,支持分布式追踪

.defaultAdvisors(new SimpleLoggerAdvisor())

// 3. 模型参数:topP 控制采样多样性(0.7 = 保守,0.9 = 创造性)

.defaultOptions(

OpenAiChatOptions.builder()

.topP(0.7)

.temperature(0.8) // 随机性控制

.build()

)

.build();配置原理说明:

- MessageWindowChatMemory :使用固定窗口维护对话历史,当超过

maxMessages时自动丢弃最早的消息,既保持上下文又控制 Token 消耗 - SimpleLoggerAdvisor:基于 Spring AI 的 Advisor 链机制,在请求前后插入日志记录,实现 AOP 式的可观测性

- topP 参数:核采样(Nucleus Sampling)阈值,0.7 表示只从概率累积前 70% 的词汇中采样,输出更确定;值越高创造性越强

Ark 专属配置

yaml

spring:

ai:

openai:

api-key: ${ARK_API_KEY}

base-url: https://ark.cn-beijing.volces.com/api/

chat:

options:

model: ${ARK_MODEL_ID} # 如:ep-20250101-xxxxx

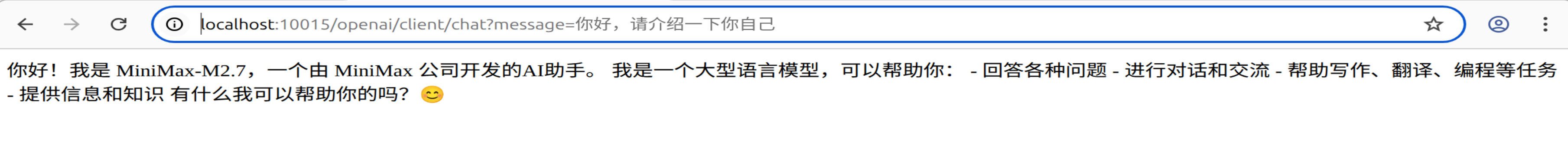

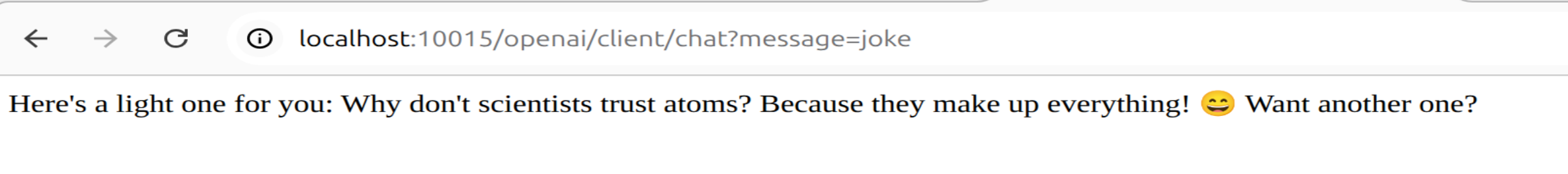

completions-path: /v3/chat/completions # Ark 特定路径模块三:openai-dashscope-multi-model(OpenAI 兼容性)

此模块展示了 OpenAI 兼容接口的通用性设计,这是多供应商策略的关键,我这次是薅了下英伟达的羊毛:

NVIDIA

字节 Ark

阿里云 DashScope

Spring AI 抽象层

base-url: dashscope.aliyuncs.com

base-url: ark.cn-beijing.volces.com

base-url: integrate.api.nvidia.com

ChatClient

OpenAiChatModel

DashScope API

Ark API

NVIDIA API

设计价值 :通过更换 base-url 和 api-key,无需修改业务代码即可切换底层模型供应商,实现真正的供应商解耦 。

文件上传处理实现

java

@PostMapping("/image/analyze/upload")

public String analyzeImageByUpload(

@RequestParam String prompt,

@RequestParam("file") MultipartFile file) {

// 1. 防御性编程:严格校验文件类型,防止恶意上传

if (!file.getContentType().startsWith("image/")) {

return "请上传图片文件";

}

// 2. 自动 MIME 类型识别:基于文件内容而非扩展名

Media media = new Media(

MimeTypeUtils.parseMimeType(file.getContentType()),

file.getResource() // Spring MultipartFile 直接转 Resource

);

// 3. 构建多模态消息:文本提示 + 视觉输入

UserMessage message = UserMessage.builder()

.text(prompt)

.media(media)

.build();

// 4. 同步调用并返回内容(生产环境建议改为异步)

return chatClient.prompt(new Prompt(message)).call().content();

}NVIDIA API 配置示例

yaml

spring:

ai:

openai:

api-key: ${AI_OPENAI_API_KEY}

base-url: https://integrate.api.nvidia.com

chat:

options:

model: minimaxai/minimax-m2.5 # NVIDIA 托管的第三方模型

temperature: 0.7 # 控制随机性:0=确定,1=随机

max-tokens: 1000 # 限制输出长度,控制成本🚀 生产环境部署指南

环境准备清单

环境准备

Java 17+

Maven 3.6+

API密钥准备

DashScope

阿里云控制台

Ark

火山引擎

NVIDIA

NGC平台

验证: java -version

验证: mvn -version

配置环境变量

附一个羊毛地址,感兴趣的可以去薅一下,就是响应相对要慢一些:https://build.nvidia.com/models

分步部署流程

步骤 1:环境变量配置(安全最佳实践)

bash

# 使用 export(Linux/Mac)或 set(Windows)

# 注意:切勿将密钥提交到代码仓库,建议使用 Vault 或 K8s Secrets

# DashScope 配置

export AI_DASHSCOPE_API_KEY=sk-xxxxxxxxxxxxxxxx

# Ark 配置(需要同时配置模型 ID)

export ARK_API_KEY=xxxxxxxx-xxxx-xxxx-xxxx-xxxxxxxxxxxx

export ARK_MODEL_ID=ep-20250101-xxxxxxxxx

# NVIDIA API 配置

export AI_OPENAI_API_KEY=nvapi-xxxxxxxxxxxxxxxx步骤 2:模块化构建策略

bash

# 方案 A:全量构建(首次部署)

mvn clean install -DskipTests

# 方案 B:增量构建(日常更新)

cd dashscope-multi-model

mvn clean package -DskipTests

# 方案 C:生产优化(跳过测试,使用生产配置)

mvn clean package -Pprod -DskipTests步骤 3:服务启动与端口管理

bash

# 模块 1:DashScope 多模态服务(端口 10013)

cd dashscope-multi-model

mvn spring-boot:run &

# 或生产模式:java -jar target/dashscope-multi-model-*.jar

# 模块 2:Ark 服务(端口 7878)

cd ark-multi-model

mvn spring-boot:run &

# 模块 3:NVIDIA API 服务(端口 10015)

cd openai-dashscope-multi-model

mvn spring-boot:run &端口冲突解决:

bash

# 查找占用端口的进程

lsof -ti:10013 | xargs kill -9

# 或修改 application.yml 中的 server.port🧪 功能验证测试

自动化测试脚本

bash

#!/bin/bash

# DashScope 多模态测试套件

BASE_URL="http://localhost:10013"

echo "=== 测试 1: URL 图片分析 ==="

curl -s "$BASE_URL/dashscope/multi/image" | jq .

echo -e "\n=== 测试 2: 视频理解(需等待帧提取)==="

curl -s "$BASE_URL/dashscope/multi/video" | jq .

echo -e "\n=== 测试 3: 流式响应测试 ==="

curl -N "$BASE_URL/dashscope/multi/stream/image"文件上传测试(multipart/form-data)

bash

# NVIDIA 模块文件上传测试

curl -X POST \

-F "file=@/path/to/local/image.jpg" \

-F "prompt=描述这张图片的内容" \

http://localhost:10015/openai/client/image/analyze/upload💡 架构设计亮点总结

-

统一多模态抽象 :通过

Media+UserMessage的组合,实现了图片、视频、音频的统一处理接口,业务代码无需关心底层媒体类型差异 -

智能视频处理:基于 FFmpeg 的帧提取 + 均匀采样算法,在保留关键信息的同时大幅降低 Token 消耗

-

企业级可观测性 :通过 Advisor 链实现日志、记忆、监控的声明式集成,不侵入业务逻辑

-

供应商零锁定:OpenAI 兼容接口设计允许在 DashScope、Ark、NVIDIA 之间无缝切换,保护技术投资

-

流式用户体验 :基于 Project Reactor 的

Flux流式响应,实现打字机效果的实时反馈,降低用户等待焦虑

🔧 故障排除与性能优化

常见问题诊断

| 问题现象 | 根因分析 | 解决方案 |

|---|---|---|

| API 调用返回 401 | 密钥未生效或已过期 | 检查环境变量是否 export,尝试 echo $AI_DASHSCOPE_API_KEY |

| 视频接口返回空 | 帧提取尚未完成 | 查看日志 "Frame extraction completed",首次启动需等待 30-60 秒 |

| 流式响应中断 | 网络超时或缓冲区满 | 配置 spring.mvc.async.request-timeout=60s |

| 依赖下载缓慢 | Maven 中央仓库网络问题 | 配置阿里云镜像:mvn clean install -Dmaven.repo.local=/path/to/repo |

生产环境优化配置

yaml

# application-prod.yml

spring:

ai:

openai:

# 连接池优化:高并发场景增大连接数

connection-pool-size: 20

# 超时配置:平衡用户体验与资源占用

timeout: 30s

# 重试策略:网络抖动时自动恢复

retry:

max-attempts: 3

backoff:

delay: 1s

multiplier: 2缓存策略建议:

- 对于重复性高的查询(如图片 OCR 结果),建议引入 Redis 缓存,Key 为图片 URL 的 MD5 + 提示词哈希,TTL 根据业务场景设置(如 1 小时),可显著降低 API 调用成本。

这个项目设计精巧,从架构分层到具体实现都体现了 Spring AI 框架"抽象即自由"的核心理念。开发者可以根据实际业务场景选择合适的模块进行扩展,或组合多个模块构建复杂的企业级 AI 应用。