首先下载一个3.12的python环境。

然后开始配置环境

下载langchain本身

pip install langchain -i https://mirrors.aliyun.com/pypi/simple/

下载openai的专用组件

pip install langchain-openai openai -i https://mirrors.aliyun.com/pypi/simple/

下载其他的一些东西

pip install python-dotenv langchain-core -i https://mirrors.aliyun.com/pypi/simple/

后面一些东西

pip install langchain_community -i https://mirrors.aliyun.com/pypi/simple/

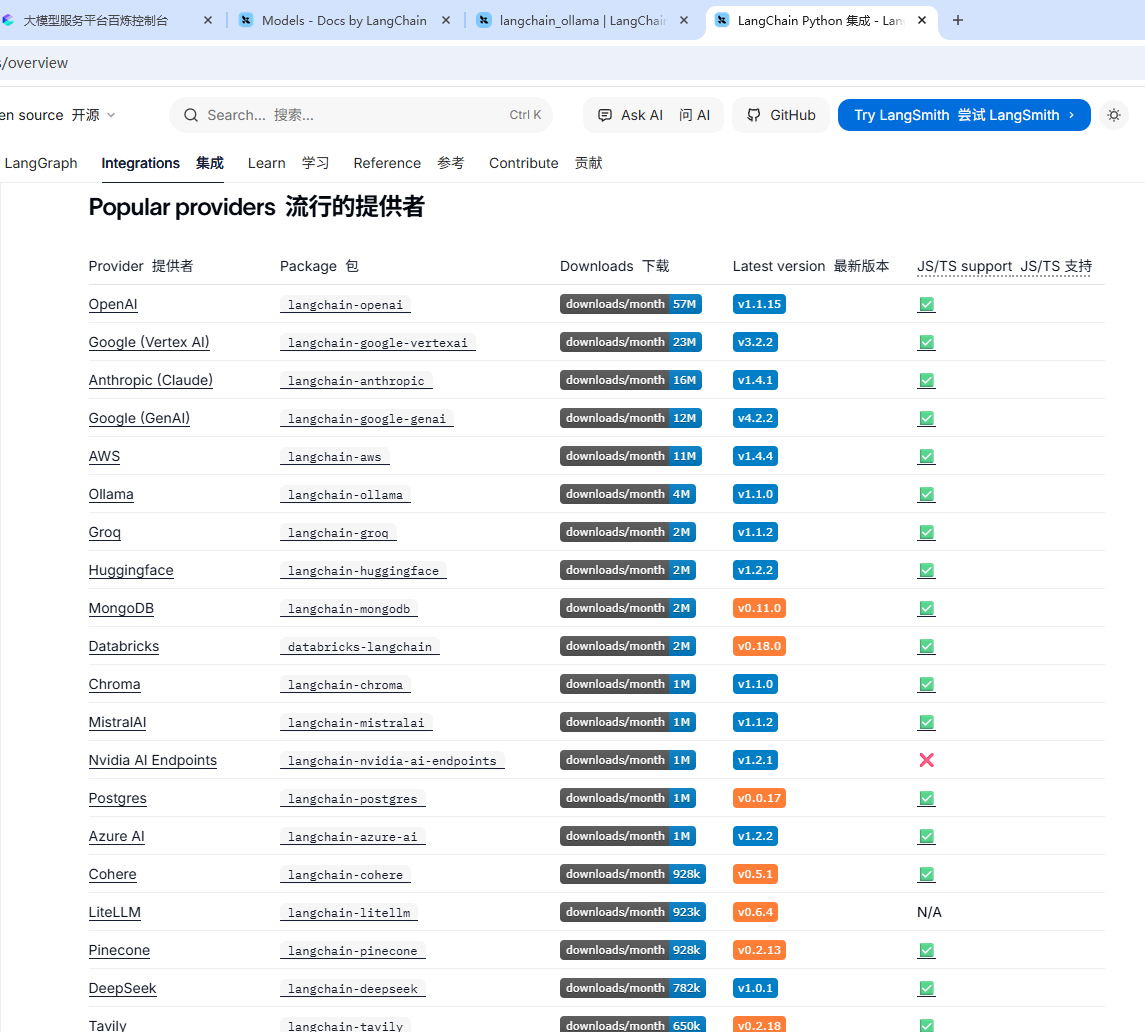

后面可以上官网去选择我们需要下载的专有模型的专有的package:

https://docs.langchain.com/oss/python/langchain/models#parameters

下面这个是初始化的本地ollama模型的代码

python

from langchain_ollama import ChatOllama

# 设置本地模型,不使用深度思考

model = ChatOllama(base_url="http://localhost:11434", model="modelscope.cn/qwen/Qwen3-0.6B-GGUF:latest", reasoning=False)

# 打印结果,

print(model.invoke("什么是LangChain,1000字回答我"))