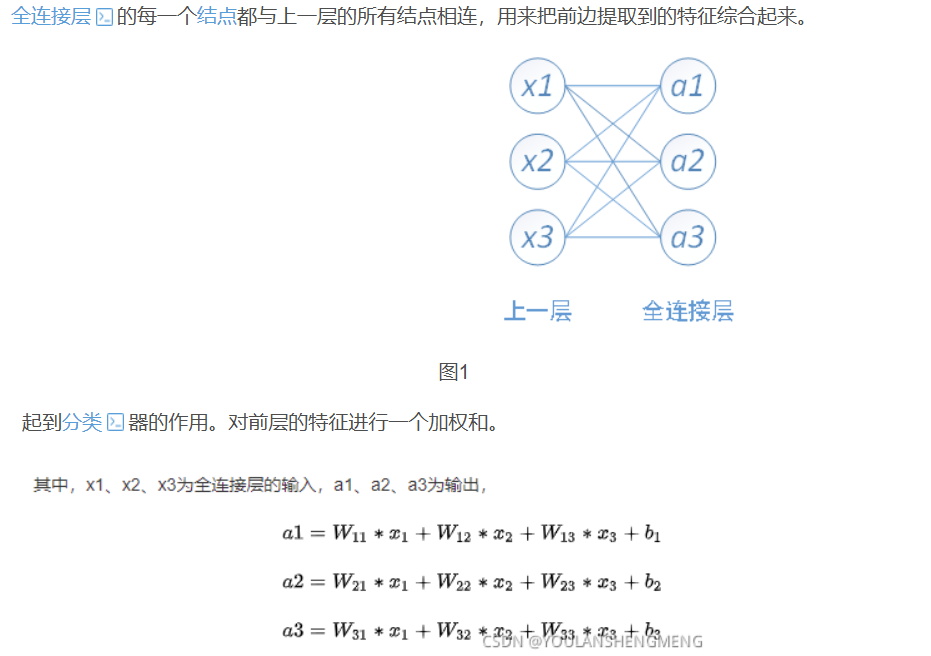

1、全连接层

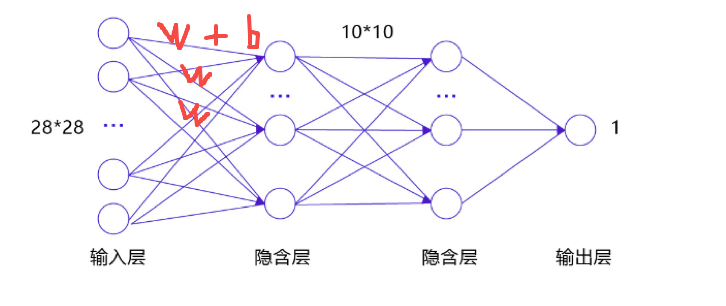

在全连接网络1中,一张图片上的所有像素点会被展开成一个1维向量输入网络,如 图1 所示,28 x 28的输入数据被展开成为784 x 1 的数据作为输入。

全连接层的问题:

1. 输入数据的空间信息被丢失。 空间上相邻的像素点往往具有相似的RGB值,RGB的各个通道之间的数据通常密切相关,但是转化成1维向量时,这些信息被丢失。

2. 模型参数过多,容易发生过拟合。 由于每个像素点都要跟所有输出的神经元相连接。当图片尺寸变大时,输入神经元的个数会按图片尺寸的平方增大,导致模型参数过多,容易发生过拟合。例如:对于一幅1000×10001000×1000 的输入图像而言,如果下一个隐含层的神经元数目为106106 个,那么将会有1000×1000×106=10121000×1000×106=1012 个权重参数,可以想象,如此大规模的参数量使得网络很难训练。为了解决上述问题,引入卷积(Convolution)来对输入的图像进行特征提取。

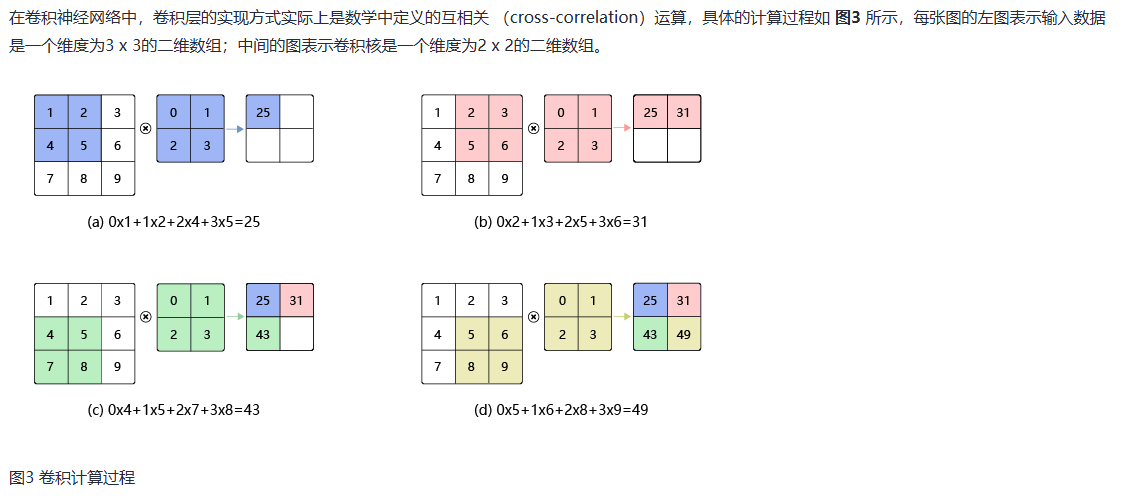

二、卷积

卷积核(kernel):也被叫做滤波器(filter),假设卷积核的高和宽分别为khkh和kwkw,则将称为kh×kwkh×kw卷积,比如3×53×5卷积,就是指卷积核的高为3, 宽为5。卷积核中数值为对图像中与卷积核同样大小的子块像素点进行卷积计算时所采用的权重。

卷积计算(convolution):图像中像素点具有很强的空间依赖性,卷积(convolution)就是针对像素点的空间依赖性来对图像进行处理的一种技术。

特征图(feature map):卷积滤波结果在卷积神经网络中被称为特征图(feature map)。