摘要:面向物流分拣与仓储盘点场景,快递包裹的自动检测与统计是实现作业数字化与降低人工成本的关键环节。本文围绕基于深度学习的快递包裹检测系统展开,采用以 YOLO 系列为核心的目标检测框架完成包裹目标的定位与类别识别,并结合数据清洗、标注规范与增强策略提升对复杂背景、遮挡堆叠、尺度变化与光照扰动的鲁棒性。系统侧重工程化落地,前端以 PySide6 构建交互界面,支持图片/视频/摄像头多源输入、置信度与 IoU 阈值可调、检测结果可视化与批量统计;后端提供结果持久化存储与导出能力,便于后续追溯分析与业务对接。实验部分对不同轻量化检测模型进行对比评估,并从精度、速度与资源占用维度分析其在实际部署条件下的适配性,为物流场景下的包裹检测系统设计与实现提供可复用的技术参考。

文章目录

- 1.前言综述

- [2. 数据集介绍](#2. 数据集介绍)

- [3. 模型设计与实现](#3. 模型设计与实现)

- [4. 训练策略与模型优化](#4. 训练策略与模型优化)

- [5. 实验与结果分析](#5. 实验与结果分析)

-

- [5.1 实验设计](#5.1 实验设计)

- [5.2 度量指标](#5.2 度量指标)

- [5.3 实验结果分析](#5.3 实验结果分析)

- 6.系统设计与实现

-

- [6.1 系统设计思路](#6.1 系统设计思路)

- [6.2 登录与账户管理 --- 流程图](#6.2 登录与账户管理 — 流程图)

- [7. 下载链接](#7. 下载链接)

- 8.参考文献

1.前言综述

在电商与即时配送驱动下,分拣、复核、装笼与盘点等环节对吞吐与准确性的要求持续上升,而"货到人"与移动机器人拣货等新型作业组织方式,也使视觉感知从"辅助"逐渐变为"关键基础设施"。以 RMFS(Robotic Mobile Fulfillment Systems)为代表的仓内自动化体系在流程效率与柔性方面具备优势,但其稳定运行往往依赖对货物/包裹状态与位置的在线感知与决策闭环,尤其在高密度、强遮挡的流水线与格口场景中更为突出1。快递包裹检测作为其中最直接的感知任务之一,需要在有限算力与严格时延约束下,对不同尺寸、形变外观、贴单反光与背景干扰条件下的包裹目标实现可靠定位与计数,从而为分拣控制、异常告警与数据追溯提供结构化输入。 (Sciengine)

从方法谱系来看,目标检测是将"看见"转化为"可操作信息"的核心技术,其研究已形成从数据预处理、标签分配、网络结构到后处理的较为完整的理论与工程框架2。在深度学习兴起之前,传统视觉通常依赖人工特征与规则化几何约束,但在快递包裹这类材质多样、遮挡频繁且背景复杂的工业场景中,特征可迁移性与鲁棒性往往不足;卷积神经网络在 ImageNet 规模数据上展示的表征能力跃迁,为检测任务提供了更强的特征学习基础3。随后的两阶段检测器以"候选区域---分类回归"的范式提升了定位精度,其中 Faster R-CNN 通过区域建议网络实现端到端训练,成为高精度检测的重要里程碑4;而一阶段检测器在速度上更具优势,RetinaNet 通过 Focal Loss 缓解前景-背景不均衡,显著缩小了一阶段与两阶段精度差距5;在实时性需求更苛刻的工程侧,YOLO 将检测重构为单网络回归问题,使实时检测成为可落地的默认选项6。 (CJIG)

近年来,检测范式进一步向端到端与全局建模演进,DETR 将检测表述为集合预测并引入二分匹配损失,减少对锚框与 NMS 等手工组件的依赖,为复杂场景中的全局关系建模提供了新路径7。与此同时,YOLO 系列围绕骨干网络、特征融合、标签分配与推理后处理等环节持续迭代,YOLOv7 通过可训练的"bag-of-freebies"与结构设计在速度-精度权衡上取得代表性进展8;Ultralytics 生态将训练、推理与多端导出流程工程化固化,使 YOLOv8 在实践中更易复现与部署,也更便于面向行业数据进行快速迭代9;其后续版本进一步引入 YOLO11 并作为默认模型发布,体现出"精度提升与参数效率并重"的工程取向10;在更激进的结构探索上,YOLOv12 提出注意力中心的实时检测框架,尝试在保持时延竞争力的前提下引入更强的全局建模能力11。 (Springer)

围绕"更高效率、更少后处理依赖"的趋势,YOLOv9 以可编程梯度信息与轻量网络设计为切入点,关注深层信息传递与参数利用率问题12;YOLOv10 则在 NeurIPS 2024 给出面向端到端部署的系统化设计,强调 NMS-free 训练与结构冗余消减以降低推理时延13。面向物流包裹这一高重复外观、尺度分布偏置明显且遮挡严重的任务,研究者也开始针对性地做轻量化与多尺度结构裁剪,例如 SFYOLOv5 结合剪枝与专门的金字塔设计以适配包裹尺度分布,并在自建数据上验证其在参数量与 FLOPs 方面的显著下降14;在更细粒度的作业场景(如机器人抓取/码垛)中,对包裹边界与姿态的精细表达需求推动了检测与分割一体化的轻量算子设计,CheapConv 将多分支高效卷积融入 YOLOv8 框架以提升密集场景下的实时分割与检测能力15。 (Springer)

尽管算法与工具链快速演进,快递包裹检测的工程落地仍面临若干共性难点:其一,堆叠遮挡与相互贴靠导致目标边界不清,易出现粘连误检与漏检;其二,贴单、胶带与覆膜引入的高反光与纹理干扰会破坏外观一致性,叠加运动模糊与滚动快门效应后,特征稳定性进一步下降;其三,流水线与仓内摄像头布设差异带来显著域偏移,单一数据源训练的模型在跨站点部署时性能衰减明显;其四,实时控制链路要求"检测---统计---反馈"在毫秒级完成闭环,对模型结构、后处理、推理框架与 UI 线程调度都提出了系统性约束。老思在做系统化实现时更关注:如何把上述不确定性显式纳入数据闭环与软件架构,使模型迭代与工程可维护性同步推进。

基于上述背景,本文(博客)的主要贡献可以概括为:围绕快递包裹检测这一真实工业任务,构建并清洗标注专用数据集,系统对比 YOLOv5--YOLOv12 等系列模型在同一数据分布下的精度与速度差异,并结合任务特点给出针对性的结构与训练改进;同时以 PySide6 设计交互友好的检测系统界面,支持图片/视频/摄像头多源输入、阈值与可视化调节、结果统计与导出,形成从数据到模型再到应用的可复现工程链路;最终整理数据集、训练脚本与部署代码,便于读者在自有分拣场景中快速复现与二次开发。

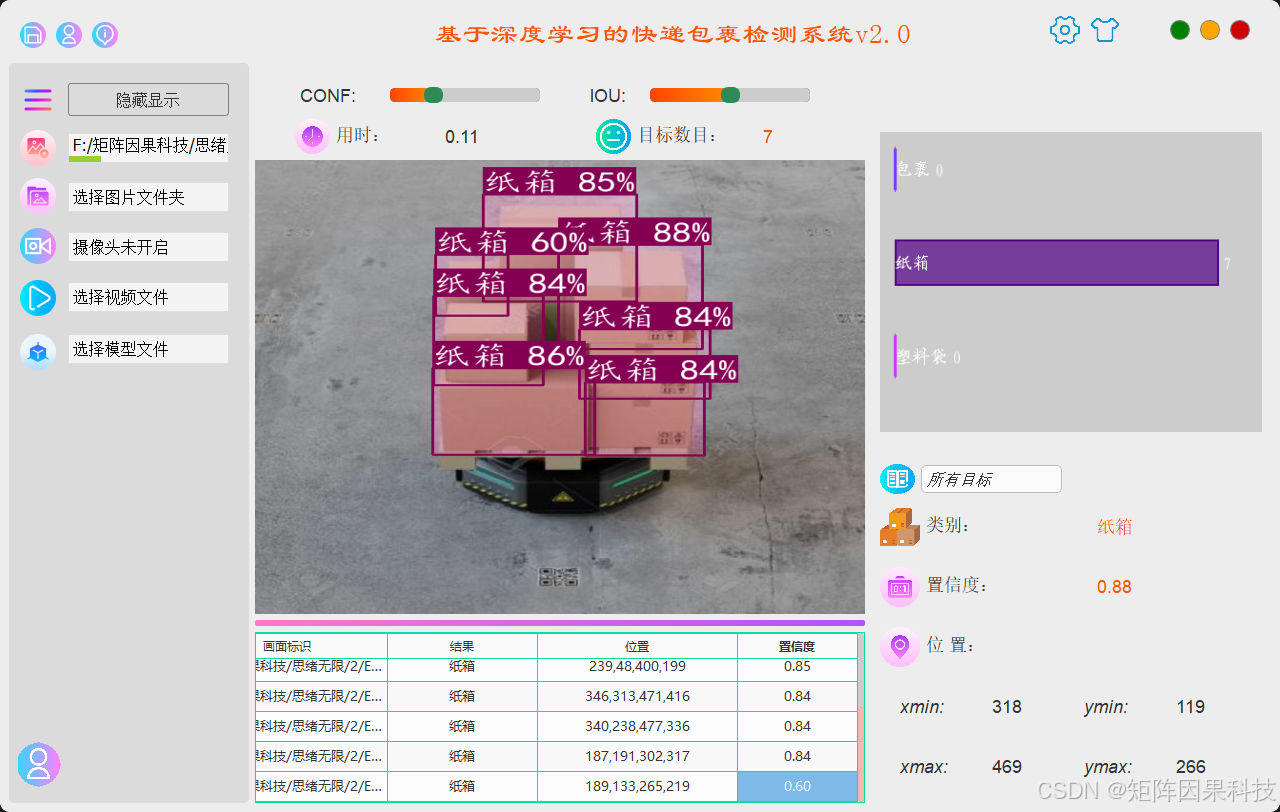

主要功能演示:

登录注册 :系统启动后首先进入登录界面,用户可在同一入口完成"登录---注册---找回/修改"的基础闭环。登录阶段由界面层收集账号与密码信息,控制层触发数据库查询校验,通过后加载该用户的个性化配置与历史检测记录,并将会话态写入内存以便后续模块调用;注册阶段则对账号唯一性与密码强度进行前置检查,随后将用户信息写入 SQLite,并支持上传头像作为界面个性化标识。为避免界面卡顿,登录校验与数据库读写均以信号槽方式与主线程解耦,界面端仅承担状态反馈与错误提示,从而保证交互流畅与可维护性。

页面布局 :进入主界面后,整体采用"控制区---显示区---信息区"的典型检测软件布局:左侧为输入源与运行控制(图片/视频/摄像头切换、开始/暂停/停止、导出与清空等),中部为检测可视化窗口(原图与结果图切换、缩放与适配显示),右侧为结构化信息面板(当前模型名称、推理耗时、FPS、置信度阈值与 IoU 阈值、类别统计表与日志输出)。底部状态栏用于持续展示推理线程状态、输入源路径与保存位置,减少弹窗打断。该布局使"看结果---调参数---再验证"的迭代路径更短,适合工程调试与现场操作。

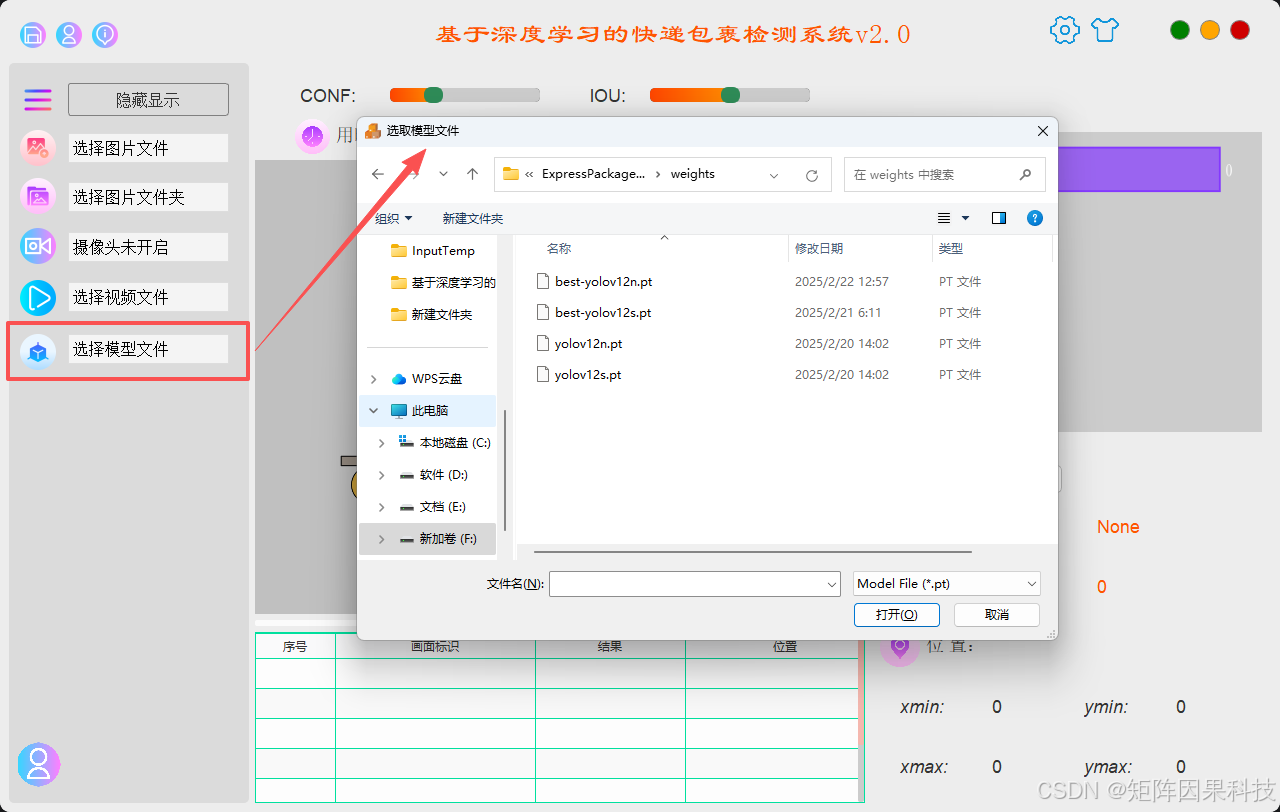

模型选择 :系统在主界面提供模型下拉框或权重管理面板,支持从预置的 YOLO 系列模型中快速切换,也允许用户导入自训练权重文件。切换时控制层先完成权重路径校验与模型结构匹配检查,再由处理层在独立推理线程中完成加载与一次前向预热,避免首次推理造成的明显时延抖动;切换完成后,界面端同步更新模型元信息(参数量、输入尺寸、推理后端等)并将选择写入用户配置,确保下次启动可恢复到上一次使用状态。该设计的核心是把"模型切换"做成稳定的状态迁移过程,减少因误操作引发的崩溃与资源泄漏风险。

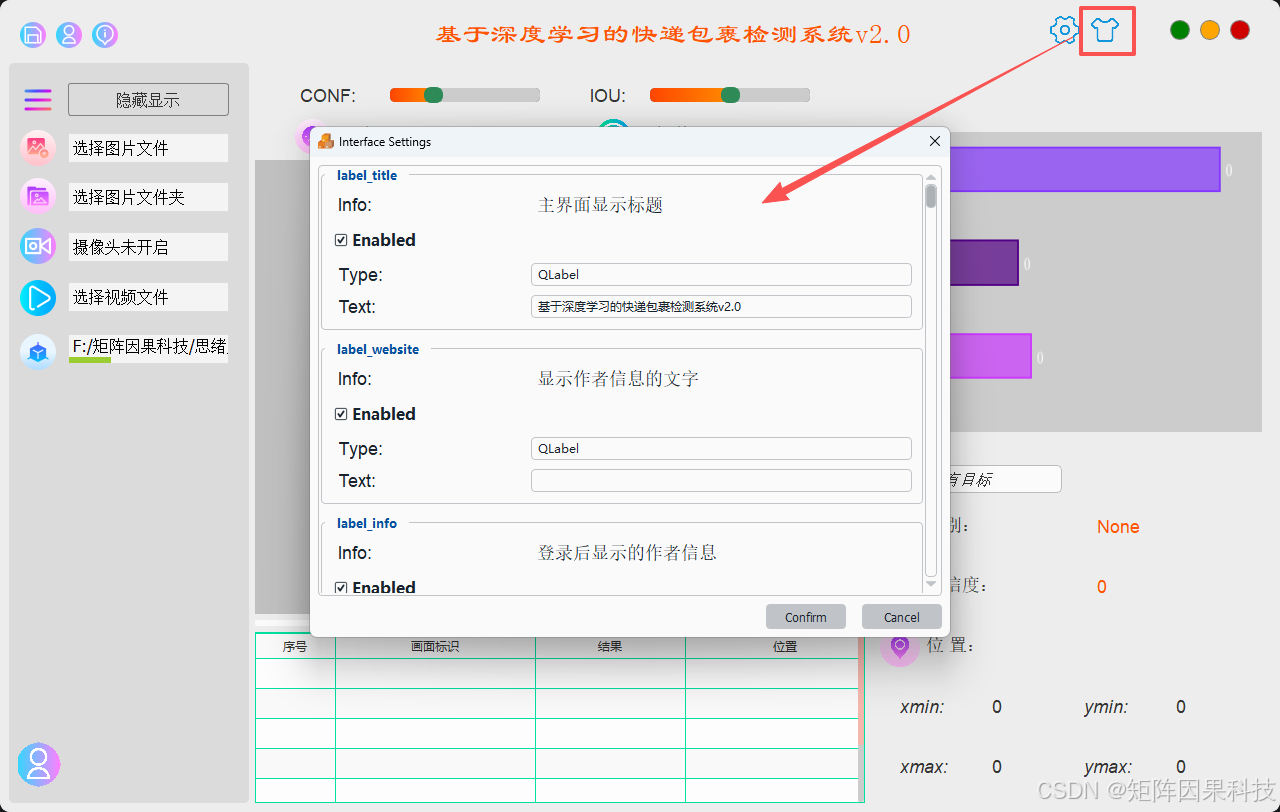

主题修改 :为提升长时间值守与不同环境光照下的可读性,系统提供主题切换能力,包括浅色/深色模式、主色调与字体大小的有限范围调整,并支持替换背景图与图标资源以适配不同单位的视觉规范。主题变更由界面层即时生效,同时将样式配置持久化到 SQLite 的用户配置表中,实现"一人一套主题"的个性化体验;在检测过程中修改主题不会影响推理线程,仅触发界面重绘与资源热更新,从而保证稳定性。通过把视觉风格与业务逻辑解耦,系统在可用性与工程可维护性之间保持了较好的平衡。

2. 数据集介绍

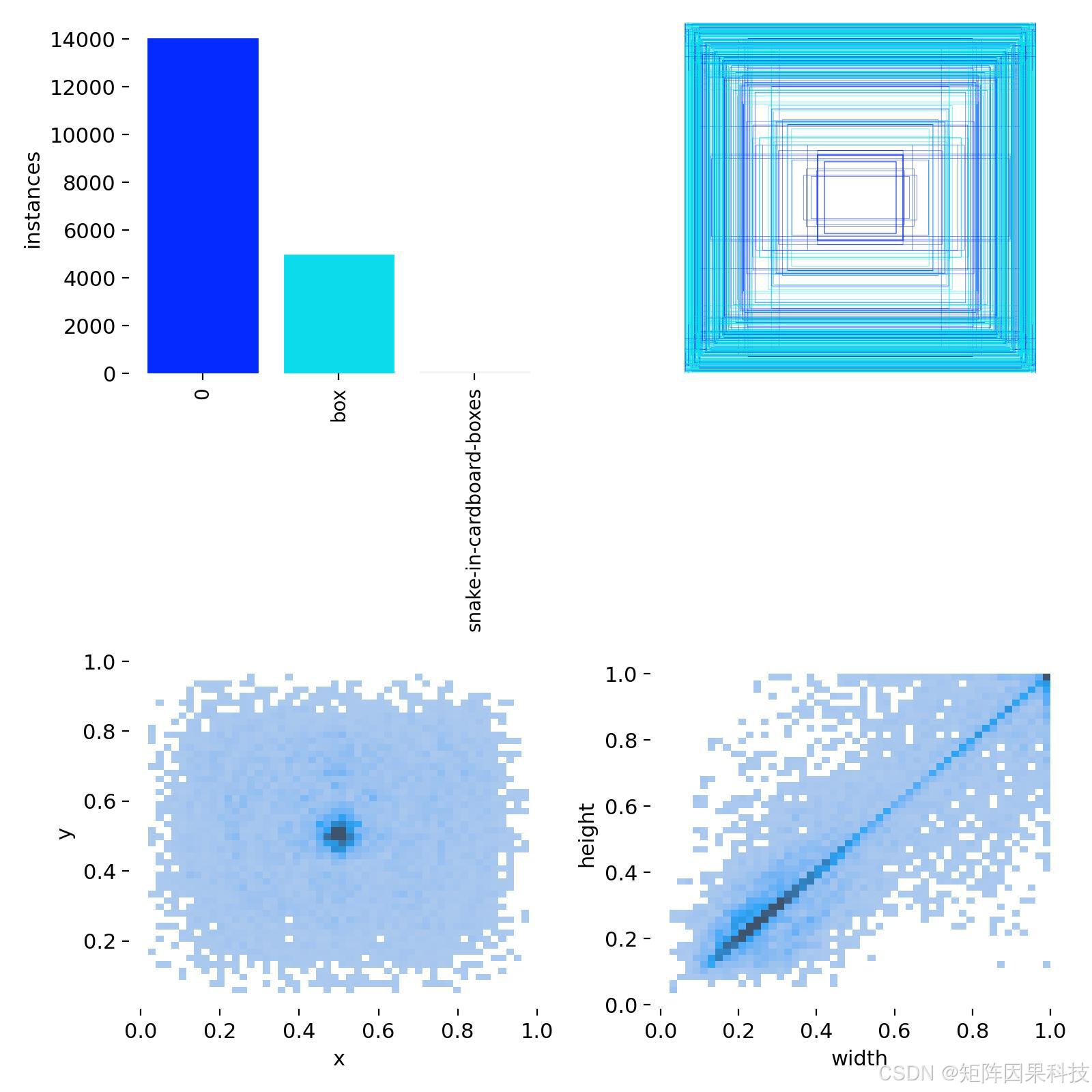

本研究面向物流分拣与仓储盘点场景,构建了一个以"快递包裹/纸箱/塑料袋"为核心目标的检测数据集。数据集中每张图像均采用矩形框进行目标级标注,标注以 YOLO 规范的归一化坐标形式保存(每行对应一个目标,包含类别编号与 ( x c , y c , w , h ) (x_c,y_c,w,h) (xc,yc,w,h) 四元组),便于直接接入 Ultralytics 等主流训练框架进行端到端训练与部署。在数据构建流程上,老思采用"样本采集---人工筛选---统一命名与清洗---标注---一致性复核---划分"的方式控制噪声:一方面尽量覆盖室内/仓库/传送带等不同背景与光照,另一方面通过引入遮挡、反光、堆叠、尺度变化等典型困难样本,使数据分布更贴近真实分拣线的视觉条件。为提升训练稳定性,图像在加载阶段按模型输入尺寸进行等比例缩放与 letterbox 填充,并在训练阶段配合 Mosaic、随机缩放/裁剪、颜色扰动与随机遮挡等增强手段,以减弱域偏移和遮挡导致的漏检风险(从训练 batch 的可视化结果中也可观察到典型的拼接与遮挡增强痕迹)。

从标签统计图可以看出,数据集的目标中心分布在图像中部具有更高密度,这与拍摄/截帧时"主体居中"的采集习惯一致;而宽高二维分布呈现明显的尺度跨度与相关性,说明同一类别在不同距离和不同摆放方式下具有显著外观尺度变化。类别实例数存在一定不均衡:以"包裹(Class 0)"与"纸箱(Class 1)"为主,"塑料袋(Class 2)"相对稀疏,这种长尾分布会在训练中放大误检与漏检的差异,因而更依赖合理的数据增强、采样策略或损失加权来维持小样本类别的召回率。工程实现中,为避免类别名中出现数字字符串带来的歧义,界面层通过 Chinese_name = {"0":"包裹","box":"纸箱","snake-in-cardboard-boxes":"塑料袋"} 将原始类别名映射为中文显示,从而保证 UI 统计与日志输出的可读性与一致性。

📊 数据集规格说明 (Dataset Specification)

| 维度 | 参数项 | 详细数据 |

|---|---|---|

| 基础信息 | 标注软件 | LabelImg |

| 标注格式 | YOLO TXT (Normalized) | |

| 数量统计 | 训练集 (Train) | 9,087 张 (87.43%) |

| 验证集 (Val) | 855 张 (8.23%) | |

| 测试集 (Test) | 451 张 (4.34%) | |

| 总计 (Total) | 10,393 张 | |

| 类别清单 | Class ID: 0 | 0(包裹) |

| Class ID: 1 | box(纸箱) |

|

| Class ID: 2 | snake-in-cardboard-boxes(塑料袋) |

|

| 图像规格 | 输入尺寸 | 640 * 640 |

| 数据来源 | 公开快递/纸箱场景图像为主,结合少量实拍补充(手动清洗) |

3. 模型设计与实现

在快递包裹检测这种"单类为主、尺度跨度大、遮挡与背景干扰强、并且需要实时响应"的任务设定下,老思更倾向于从"精度---时延---工程可维护性"三者的折中出发选择基线模型。传统的两阶段检测器(如 Faster R-CNN)在高遮挡场景下往往能给出更稳定的定位,但其候选区域生成与多阶段计算会显著抬高时延;而一阶段检测器以单次前向同时完成分类与回归,更符合分拣线在线推理与 PySide6 桌面端交互的实时要求。考虑到系统需支持摄像头/视频流的连续推理,并在中低端 GPU 上保持可用帧率,本系统默认基线选用 YOLOv12n (同时保留 YOLOv5--YOLOv12 的权重切换能力),将"轻量模型快速迭代"和"现场可部署"作为首要目标。YOLOv12 的核心思路是将注意力机制引入实时检测框架,通过 Area Attention 在较大感受野下保持计算可控,并配合 R-ELAN 改善特征聚合与优化稳定性;在 Ultralytics 实现中还支持可选的 FlashAttention 以降低显存访问开销,但默认推理路径并不强依赖该组件,便于在不同硬件条件下获得较一致的部署体验。 (Ultralytics Docs)

从网络结构上看,模型依然沿用目标检测的经典三段式组织:Backbone 负责提取多层语义特征,Neck 负责跨尺度特征融合,Head 负责在多尺度特征图上完成分类与边界框回归。对于快递包裹这一类"形状规则但纹理变化大"的目标,Backbone 的关键在于获得对遮挡与光照变化更鲁棒的中高层表征;若以 YOLOv5 作为典型参照,其 Backbone/Neck/Head 的整体拓扑如图所示,能直观体现多尺度分支与路径聚合对小目标与远距离目标的重要性。

在此基础上,YOLOv12 将注意力友好的结构与高效卷积模块进行更紧密的耦合:Area Attention 通过对特征图进行区域化处理,使注意力计算能覆盖更大范围的上下文关系;R-ELAN 则通过残差化的层聚合缓解深层堆叠带来的优化困难,从而在不显著牺牲推理速度的前提下提升特征表达能力。该思路的效果可从热力图对比中得到侧面印证:相较 YOLOv10/YOLOv11,YOLOv12 对关键目标区域的响应更集中、更清晰。

就任务建模而言,本系统将快递场景抽象为标准的多类目标检测问题,类别集合为 包裹 , 纸箱 , 塑料袋 { \text{包裹},\text{纸箱},\text{塑料袋} } 包裹,纸箱,塑料袋,模型输出每个候选框的类别置信度与边界框参数。Ultralytics 系列 YOLO 的检测头通常采用 anchor-free 的预测方式,在多尺度特征图上直接回归边界框,并以分类分支输出类别概率,从而减少锚框设计与超参数敏感性;这类设计在"包裹尺度分布随镜头位置大幅变化"的场景中更易保持稳定。 (Ultralytics Docs) 训练目标函数可写为多项损失的加权和:

L = λ box L ∗ box + λ ∗ dfl L ∗ dfl + λ ∗ cls L ∗ cls . \mathcal{L}=\lambda_{\text{box}}\mathcal{L}*{\text{box}}+\lambda*{\text{dfl}}\mathcal{L}*{\text{dfl}}+\lambda*{\text{cls}}\mathcal{L}*{\text{cls}}. L=λboxL∗box+λ∗dflL∗dfl+λ∗clsL∗cls.

其中 L ∗ box \mathcal{L}*{\text{box}} L∗box 常以 IoU 系列度量(如 CIoU)约束预测框 b ^ \hat b b^ 与真值框 b b b 的几何一致性; L ∗ dfl \mathcal{L}*{\text{dfl}} L∗dfl(Distribution Focal Loss)将边界框回归转化为离散分布学习,以提升定位的精细度与稳定性; L ∗ cls \mathcal{L}*{\text{cls}} L∗cls 则采用以二元交叉熵为核心的分类损失,并可结合质量感知的加权形式以缓解正负样本不均衡。Ultralytics 的损失实现中明确包含 DFLoss 等组件,且在 YOLOv8 的回归损失构成中可见 DFL 与 CIoU 的组合方式,这对后续将 YOLOv12 接入同一训练框架提供了实现层面的可复用性。 (Ultralytics Docs)

工程实现上,模型侧被封装为独立的 Detector 组件:初始化阶段加载 *.pt 权重并完成一次"空推理/预热",避免首次推理的显著抖动;推理阶段对输入帧执行 letterbox 尺度对齐与归一化,将张量送入 YOLO 前向计算;后处理阶段依据 UI 侧可调的 conf 与 iou 阈值进行候选框过滤与 NMS(若使用端到端无 NMS 的配置,则按模型输出协议直接解码),最终返回包含类别、置信度与像素坐标框的结构化结果,并通过类别映射表输出中文标签以便界面展示与统计。一个最小化的调用流程可概括为:

python

from ultralytics import YOLO

# 1) 加载模型(默认 YOLOv12n,也可切换 yolov5/8/11 等)

model = YOLO("yolov12n.pt")

# 2) 推理(img 可以是路径、ndarray、PIL 或视频帧)

results = model.predict(

source=img,

imgsz=640,

conf=0.25,

iou=0.45,

verbose=False

)

# 3) 解析结果(boxes.xyxy / boxes.conf / boxes.cls)

r = results[0]

boxes = r.boxes.xyxy.cpu().numpy()

scores = r.boxes.conf.cpu().numpy()

cls_id = r.boxes.cls.cpu().numpy().astype(int)在这一实现框架下,后续若需要做面向快递场景的结构微调(例如在 Neck 增加更强的多尺度分支、在浅层引入轻量注意力以增强小目标召回,或针对塑料袋类的长尾问题调整分类分支的损失权重),都可以在不破坏 UI 与业务逻辑的前提下,围绕模型配置文件与损失/后处理模块进行局部改造,从而把"科研改进"与"可交付系统"保持在同一代码基座上。

4. 训练策略与模型优化

在快递包裹检测这类工业任务中,训练策略往往比"换一个更大的模型"更能决定最终可用性:一方面需要在遮挡、反光、堆叠与尺度变化下维持召回率,另一方面又要控制推理端的时延与显存占用。老思在实现上采用 Ultralytics YOLO 训练管线作为基座,硬件侧以 RTX 4090 为主,训练侧优先启用 AMP 混合精度与 EMA(Exponential Moving Average)权重滑动平均来稳定收敛,并在数据层引入强增强以逼近分拣现场的域偏移。对于初始化权重,默认加载 COCO 预训练参数再进行迁移学习:先用较保守的学习率完成"检测头快速对齐",随后再放开骨干网络的更新,使特征从通用语义逐步迁移到"纸箱纹理、塑料袋褶皱、贴单反光"等任务特异模式。若数据集中长尾类别(如塑料袋)占比较低,则在不破坏训练稳定性的前提下适度提高该类样本的出现概率(重采样)或在分类损失中加入类别权重,以避免模型在早期被主类主导而形成"召回塌陷"。

学习率与收敛控制采用"预热 + 余弦退火"的组合:预热阶段用较小学习率逐步升至初始学习率 η 0 \eta_0 η0,缓解大 batch/强增强带来的梯度震荡;之后按余弦退火降低学习率以获得更平滑的后期优化轨迹,其典型形式为

η ( t ) = η min + 1 2 ( η max − η min ) ( 1 + cos π t T ) , \eta(t)=\eta_{\min}+\frac{1}{2}\left(\eta_{\max}-\eta_{\min}\right)\left(1+\cos\frac{\pi t}{T}\right), η(t)=ηmin+21(ηmax−ηmin)(1+cosTπt),

其中 t t t 为当前迭代或 epoch, T T T 为总训练长度。与此同时设置 Early Stopping(patience=50)抑制过拟合,并在训练后期关闭 Mosaic(close_mosaic=10)以减少拼接带来的几何扰动,使模型在"更接近真实画面分布"的样本上完成最终拟合与定位细化,这一点对边界清晰度与框回归质量尤其关键。为了保证复现实验,训练脚本固定随机种子并记录数据划分文件、增强参数与权重版本,避免因数据管线漂移导致的指标波动。

在默认配置下,本系统的关键超参数可概括如下(博主仅保留对收敛与部署影响最大的部分,便于后续复现实验与对比):

| 名称 | 作用(简述) | 数值 |

|---|---|---|

| epochs | 最多训练轮数 | 120 |

| patience | 早停耐心 | 50 |

| batch | 批大小 | 16 |

| imgsz | 输入分辨率 | 640 |

| pretrained | 预训练权重 | true |

| optimizer | 优化器 | auto |

| lr0 | 初始学习率 | 0.01 |

| lrf | 最终学习率占比 | 0.01 |

| momentum | 动量系数 | 0.937 |

| weight_decay | 权重衰减 | 0.0005 |

| warmup_epochs | 预热轮数 | 3.0 |

| mosaic | Mosaic 强度/概率 | 1.0 |

| close_mosaic | 后期关闭 Mosaic | 10 |

模型优化部分则围绕"部署友好"展开:训练完成后导出 ONNX 作为中间表示,再视目标平台选择 TensorRT 进行图融合与算子替换;推理精度允许的情况下优先使用 FP16(半精度)以显著降低显存与提升吞吐,同时对 NMS 阈值与置信度阈值做任务级标定,使"漏检成本"和"误检成本"在业务侧可控。若系统需要在更弱算力边缘设备运行,则进一步考虑结构化剪枝(优先剪 Neck/Head 的冗余通道以减少 FLOPs)与 INT8 量化:前者强调保持张量对齐与卷积通道连续性以减少实际推理碎片化开销,后者则依赖代表性校准集完成激活分布标定,尽量把精度损失限制在小类(如塑料袋)可接受范围内。通过上述训练与优化策略,模型在精度、速度与可维护性之间形成较稳定的折中,为后续在 PySide6 界面内的多模型切换与实时推理提供了可持续的工程基础。

5. 实验与结果分析

5.1 实验设计

本节在同一数据划分(Train 9,087 / Val 855 / Test 451,输入尺寸 640 × 640 640\times640 640×640)与同一训练流程(总计 120 epochs,迁移学习初始化、余弦退火与后期关闭 Mosaic 等策略保持一致)的前提下,对 YOLO 系列不同规模模型进行对比评估。对比对象分为两组:轻量 n/tiny 组(YOLOv5nu、YOLOv6n、YOLOv7-tiny、YOLOv8n、YOLOv9t、YOLOv10n、YOLOv11n、YOLOv12n)与中等规模 s 组(YOLOv5su、YOLOv6s、YOLOv7、YOLOv8s、YOLOv9s、YOLOv10s、YOLOv11s、YOLOv12s)。推理速度在同一硬件环境下统计,报告 Pre/Inf/Post 三段耗时与总时延(单位 ms),硬件为 NVIDIA GeForce RTX 3070 Laptop GPU(8192 MiB)。这一设计的目的并非单纯追求最高 mAP,而是刻画"精度---召回---时延"在快递包裹场景中的可用折中,从而为 UI 实时推理与部署选择提供依据。

5.2 度量指标

检测性能采用 Precision、Recall、F1 与 mAP 进行综合刻画。令 TP/FP/FN 分别表示真阳性、假阳性与漏检,则

Precision = T P T P + F P , Recall = T P T P + F N , \text{Precision}=\frac{TP}{TP+FP},\qquad \text{Recall}=\frac{TP}{TP+FN}, Precision=TP+FPTP,Recall=TP+FNTP,

F 1 = 2 ⋅ Precision ⋅ Recall Precision + Recall . F_1=\frac{2\cdot \text{Precision}\cdot \text{Recall}}{\text{Precision}+\text{Recall}}. F1=Precision+Recall2⋅Precision⋅Recall.

其中 Precision 更敏感于误检(背景被误判为包裹/纸箱等),Recall 更敏感于漏检(遮挡与弱纹理目标被漏掉)。mAP 指对不同置信度阈值下 PR 曲线面积(AP)的平均:mAP@0.5(文中记为 mAP50)对应 IoU=0.5 的 AP,mAP@0.5:0.95(文中记为 mAP50-95)在 0.5 , 0.55 , ... , 0.95 {0.5,0.55,\dots,0.95} 0.5,0.55,...,0.95 多阈值上求平均,更能体现定位精细度与鲁棒性差异。

5.3 实验结果分析

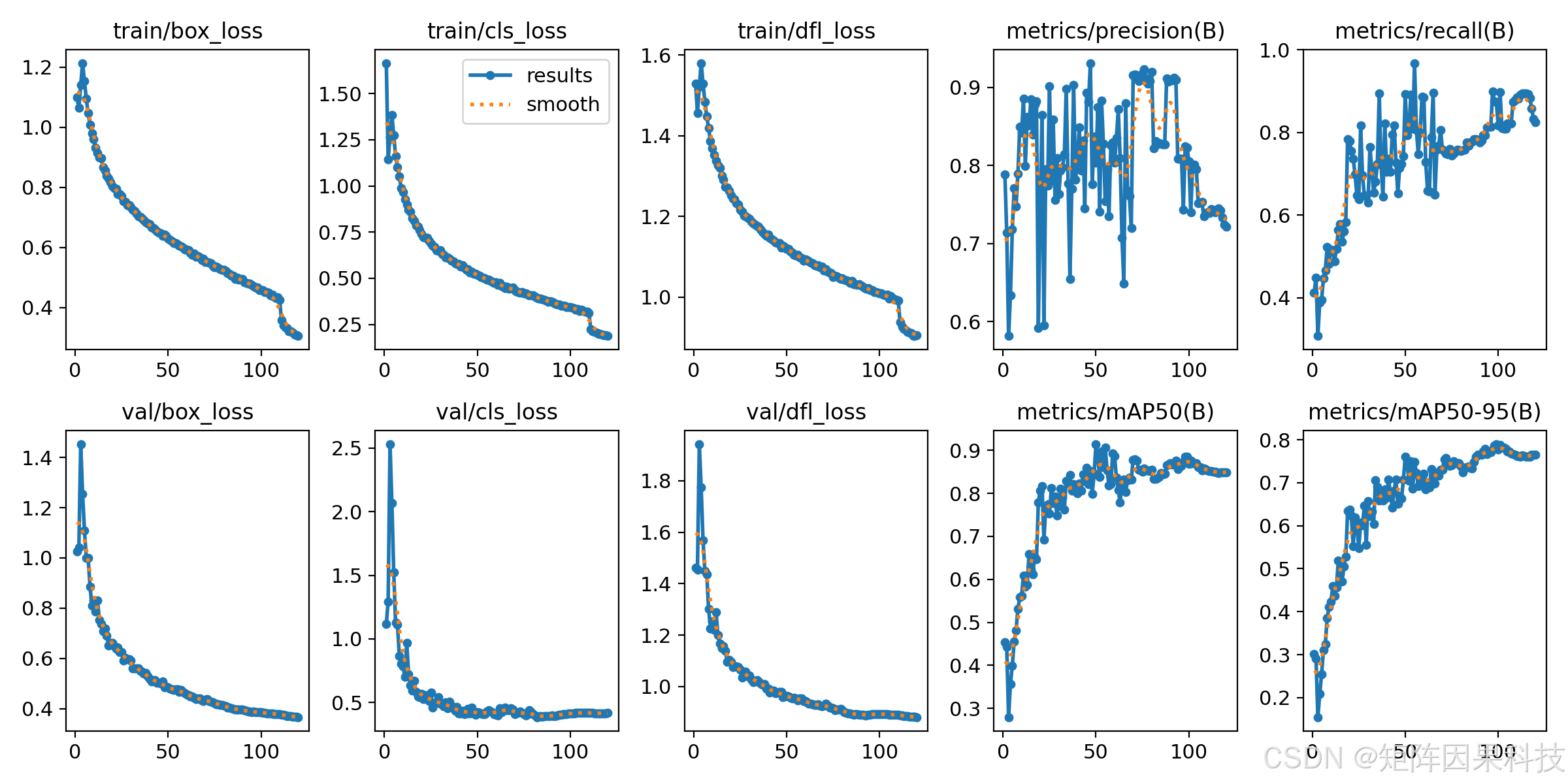

以一次代表性训练日志(mAP50 约 0.87 的收敛水平)为例,训练/验证损失与精度指标曲线如图所示,box/cls/dfl 三项损失整体呈现稳定下降,mAP50 与 mAP50-95 在前 40 个 epoch 内快速提升,随后进入平台期并在后期小幅波动,说明训练已从"特征对齐"阶段进入"边界框细化与类别判别微调"阶段;同时 precision 曲线抖动大于 recall,体现该任务在强增强、复杂背景下更容易出现间歇性误检,阈值选择对最终可用性影响明显。

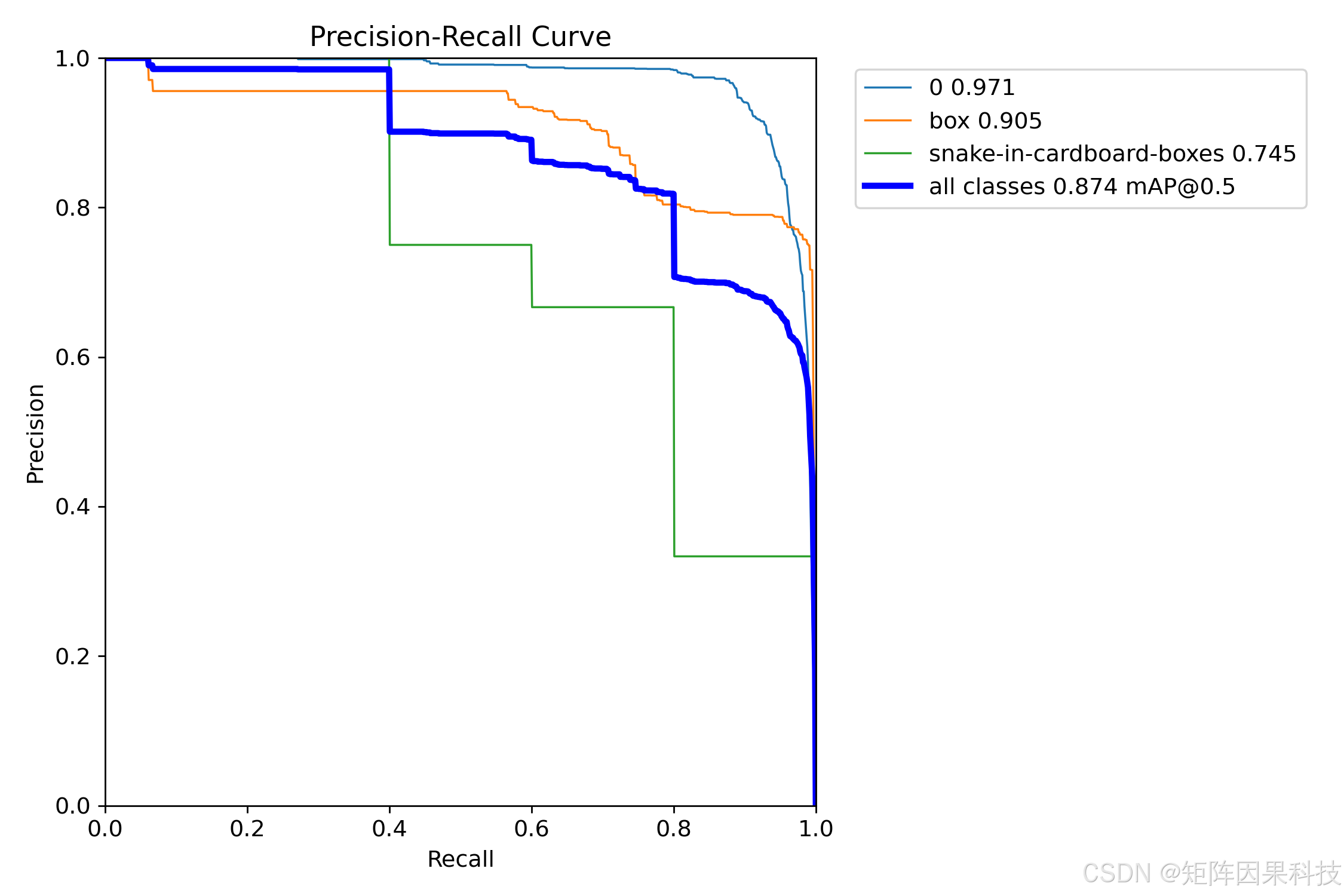

进一步从 PR 曲线观察类别差异,三类目标的 AP(IoU=0.5)分别为:包裹(Class 0)0.971 、纸箱(box)0.905 、塑料袋(snake-in-cardboard-boxes)0.745 ,全类 mAP@0.5 为 0.874 。如图所示,"塑料袋"类明显弱于"包裹/纸箱",这与其外观形变强、纹理弱、反光与褶皱导致边界不稳定有关,也与数据集中该类实例相对稀疏相吻合;相反,"包裹/纸箱"在尺度变化下仍维持较高的精度与召回,说明模型对规则几何边界与箱体纹理学习更充分。

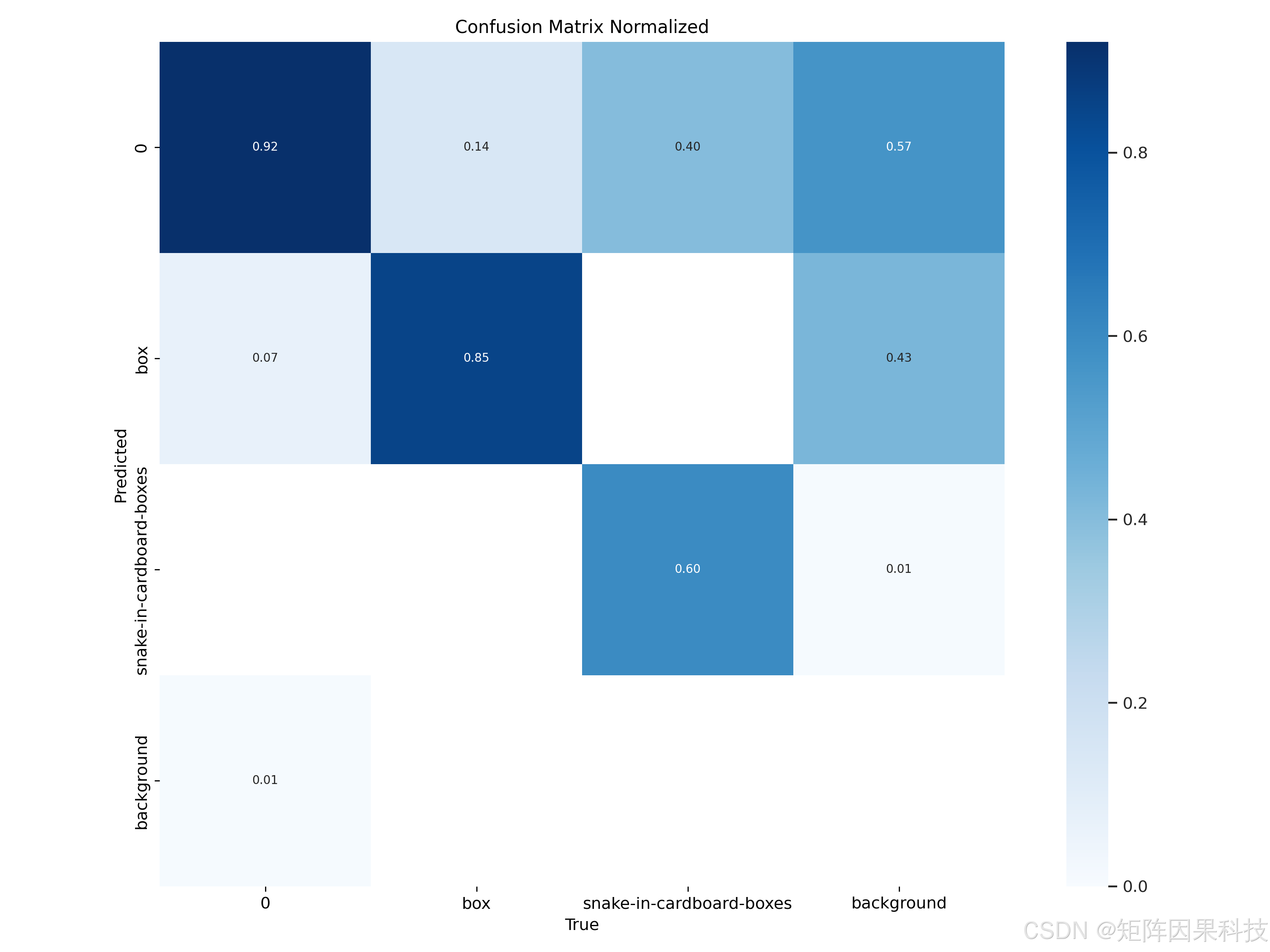

混淆矩阵(归一化)从"错分结构"侧面揭示了误差来源:对角线项显示 包裹约 0.92、纸箱约 0.85、塑料袋约 0.60 的正确识别比例,塑料袋类的对角占比最低,且更容易被分配到其他前景类或被背景吸收;同时背景列在"包裹/纸箱"行上占比较高,说明存在一定比例的 背景误检为前景 ,这类 FP 在分拣场景中会直接抬高计数误差,通常需要通过提高置信度阈值、增强负样本多样性或改进后处理策略来抑制。

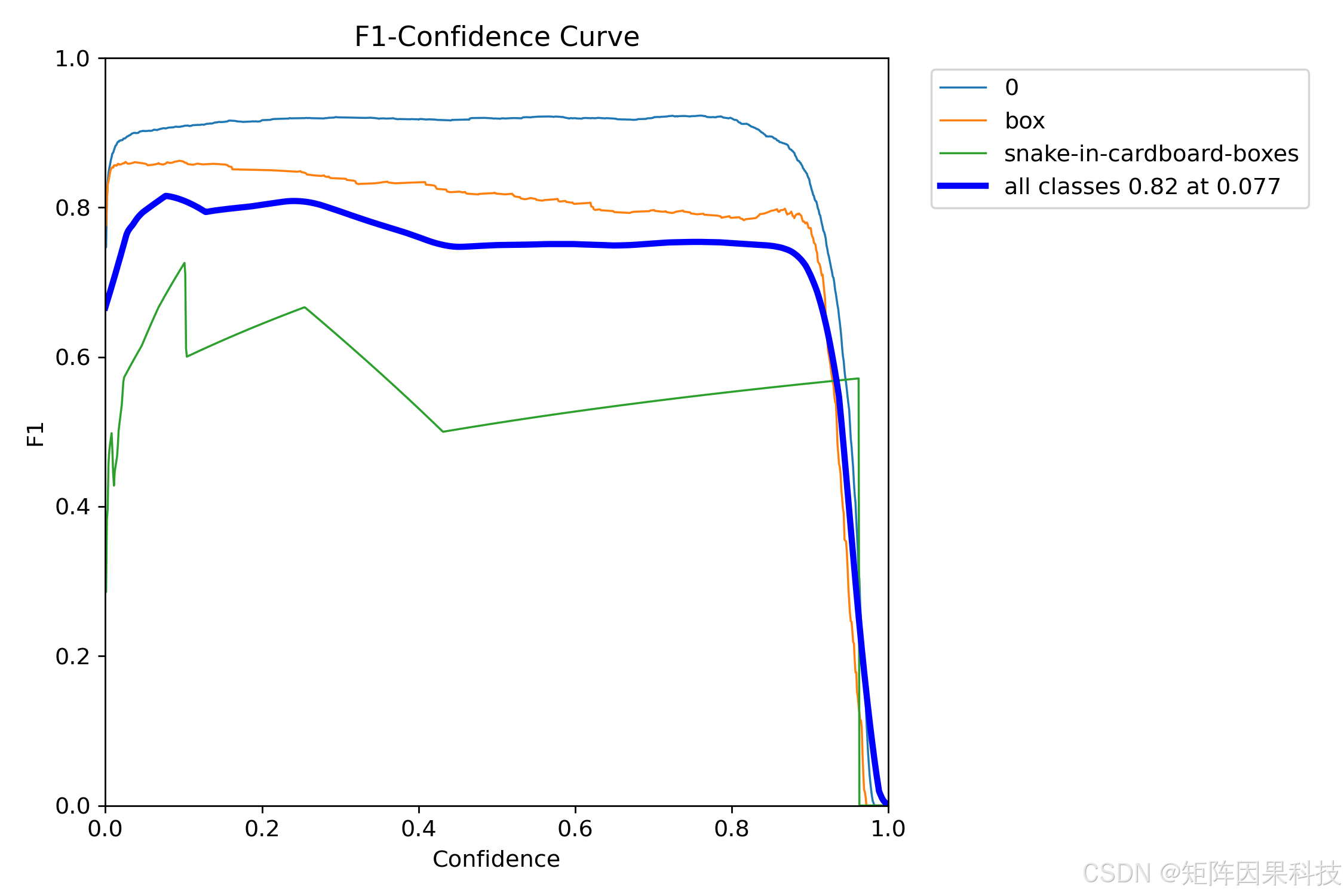

置信度阈值的选取可通过 F1-Confidence 曲线确定:图中全类最优点约出现在 conf = 0.077 ,对应 F 1 ≈ 0.82 F_1\approx0.82 F1≈0.82 。这一结果意味着在当前训练分布下,若系统更重视"尽量不漏检"(例如用于后端复核),可将 conf 设在 0.07--0.10 的区间以提高 recall;若更重视"计数稳定、少误报"(例如直接驱动分拣逻辑),应将 conf 上调并配合更严格的 IoU/NMS 策略。

在多模型对比方面,老思将表中 Total(ms)=Pre+Inf+Post 作为端到端单帧时延近似,并给出由此换算的帧率参考( F P S ≈ 1000 / Total FPS\approx1000/\text{Total} FPS≈1000/Total)。n/tiny 组结果如下:

| Model | Params(M) | FLOPs(G) | Total(ms) | FPS(1/Total) | Precision | Recall | F1 | mAP50 | mAP50-95 |

|---|---|---|---|---|---|---|---|---|---|

| YOLOv5nu | 2.6 | 7.7 | 10.94 | 91.41 | 0.760 | 0.805 | 0.782 | 0.820 | 0.665 |

| YOLOv6n | 4.3 | 11.1 | 10.34 | 96.71 | 0.841 | 0.695 | 0.761 | 0.783 | 0.701 |

| YOLOv7-tiny | 6.2 | 13.8 | 21.08 | 47.44 | 0.860 | 0.806 | 0.832 | 0.845 | 0.667 |

| YOLOv8n | 3.2 | 8.7 | 10.17 | 98.33 | 0.875 | 0.717 | 0.788 | 0.824 | 0.715 |

| YOLOv9t | 2.0 | 7.7 | 19.67 | 50.84 | 0.893 | 0.786 | 0.836 | 0.861 | 0.764 |

| YOLOv10n | 2.3 | 6.7 | 13.95 | 71.68 | 0.778 | 0.803 | 0.790 | 0.806 | 0.734 |

| YOLOv11n | 2.6 | 6.5 | 12.97 | 77.10 | 0.927 | 0.725 | 0.813 | 0.889 | 0.769 |

| YOLOv12n | 2.6 | 6.5 | 15.75 | 63.49 | 0.674 | 0.800 | 0.732 | 0.813 | 0.712 |

从精度维度看,YOLOv11n 在 mAP50(0.889)与 mAP50-95(0.769)上均为该组最佳,并且 Precision 达到 0.927,说明其对背景误检抑制能力更强;但其 Recall(0.725)并非最高,体现出更"保守"的判别倾向。若系统场景以"计数稳定、少误报"为优先(例如格口包裹统计),YOLOv11n 更贴合目标。与之相对,YOLOv9t 的 F1(0.836)最高,Recall 也较高(0.786),更适合"尽量不漏"的复核型任务,但其推理时间显著增加(Inf 16.51ms),会压缩 UI 实时帧率空间。就速度而言,YOLOv8n 与 YOLOv6n 的 Total(ms) 最低(约 10ms,对应接近 100 FPS 的理论上限),但二者分别受限于 Recall(YOLOv8n)或 mAP(YOLOv6n),更适合作为"弱算力优先、实时优先"的部署方案。图中的 n 组柱状对比与 mAP50 训练轨迹也体现了这一结论:高性能模型的收敛平台更高,而轻量模型更易在早期达到可用水平但上限受限。

s 组结果如下:

| Model | Params(M) | FLOPs(G) | Total(ms) | FPS(1/Total) | Precision | Recall | F1 | mAP50 | mAP50-95 |

|---|---|---|---|---|---|---|---|---|---|

| YOLOv5su | 9.1 | 24.0 | 12.24 | 81.70 | 0.891 | 0.792 | 0.838 | 0.816 | 0.718 |

| YOLOv6s | 17.2 | 44.2 | 12.26 | 81.57 | 0.800 | 0.805 | 0.803 | 0.866 | 0.784 |

| YOLOv7 | 36.9 | 104.7 | 29.52 | 33.88 | 0.717 | 0.453 | 0.555 | 0.469 | 0.283 |

| YOLOv8s | 11.2 | 28.6 | 11.39 | 87.80 | 0.905 | 0.777 | 0.836 | 0.851 | 0.748 |

| YOLOv9s | 7.2 | 26.7 | 22.17 | 45.11 | 0.881 | 0.773 | 0.823 | 0.902 | 0.782 |

| YOLOv10s | 7.2 | 21.6 | 14.19 | 70.47 | 0.890 | 0.841 | 0.865 | 0.890 | 0.821 |

| YOLOv11s | 9.4 | 21.5 | 13.47 | 74.24 | 0.900 | 0.887 | 0.893 | 0.945 | 0.841 |

| YOLOv12s | 9.3 | 21.4 | 16.74 | 59.74 | 0.807 | 0.817 | 0.812 | 0.874 | 0.781 |

s 组的最优者更为明确:YOLOv11s 在 Precision(0.900)、Recall(0.887)、F1(0.893)与 mAP50(0.945)上均达到该组最高,并且 mAP50-95(0.841)同样领先,说明其不仅"检得准",而且"框得更细"。更重要的是,它的 Total(ms) 约 13.47ms(理论帧率约 74 FPS),在 RTX 3070 Laptop 的桌面端场景仍具备较好实时性,因此若系统部署允许 s 级模型的显存占用与耗时,YOLOv11s 是精度优先时的首选。YOLOv10s 的 mAP50-95 同样较高(0.821),且 PostTime 仅 0.60ms,体现出后处理开销更低的优势,在"希望减少后处理成本、维持较高召回"的约束下更有吸引力;YOLOv8s 则是该组中最快的方案(Total 约 11.39ms),Precision 很高但 Recall 略低,更适合对误检敏感且追求更高帧率的在线检测。YOLOv7 在该任务上出现"慢且不准"的双重劣势,通常意味着模型规模与训练/数据分布不匹配或优化难度过高,不建议作为工程基线。

综合来看,在"快递包裹检测 + PySide6 实时界面"的系统约束下,老思更推荐将模型选择策略做成可切换的两档:若现场算力与时延预算较充足,优先采用 YOLOv11s 作为默认模型以获得更稳的 mAP 与更好的定位精度;若更强调帧率与响应速度,则可选择 YOLOv8n/YOLOv6n 作为轻量方案,并通过 F1-Confidence 曲线给出的阈值区间对 conf/iou 做任务级标定,以在误检与漏检之间取得可解释的工程折中。

6.系统设计与实现

6.1 系统设计思路

本系统以"可交付的实时检测软件"为目标,整体采用界面层、控制层与处理层的分层组织方式,以降低 PySide6 交互逻辑与深度学习推理逻辑之间的耦合度。界面层以 Ui_MainWindow 为主体,负责按钮、标签、表格与画布控件的布局与呈现;控制层由 MainWindow 统一调度,维护输入源状态(图片/视频/摄像头)、运行状态(开始/暂停/停止)、阈值参数(conf/IoU)与当前模型指针,并将用户操作转化为可复现的状态迁移;处理层封装为 Detector,负责权重加载、预处理、推理与后处理,同时对外输出结构化结果(类别、置信度、边界框、统计信息)。这种组织方式使界面侧可以更专注于交互一致性与可用性,而模型侧可以在不破坏 UI 的前提下持续替换 YOLO 系列权重或优化后处理策略。

在并发与实时性方面,老思将推理过程从主线程中剥离,通过"信号---槽"机制实现跨层通信:控制层向处理层发送"新帧/新参数/切换模型"等请求,处理层在独立推理线程内完成 GPU 前向与后处理,并将渲染所需的绘制要素(框坐标、文本、颜色索引等)以信号形式回传给主线程,最终由界面层完成绘制与表格刷新。对视频/摄像头输入,系统在采集侧引入轻量队列缓冲,避免解码抖动将延迟传播到 UI;对模型切换,采用"加载---预热---替换引用"的方式完成平滑过渡,减少首次推理抖动对交互体验的影响。结果的持久化被设计为可选旁路:既支持导出可视化图片/视频,也支持写入 SQLite 以实现按用户隔离的历史追溯与统计分析,从而保证系统在"单机演示"和"现场长期运行"两类使用方式下都具备一致的数据闭环。

图 系统流程图

图注:系统从初始化到多源输入,完成预处理、推理与界面联动,并通过交互形成闭环。

6.2 登录与账户管理 --- 流程图

登录与账户管理模块并非"附加功能",而是将检测系统从一次性演示提升为可长期运行工具的关键支撑。系统以 SQLite 作为轻量持久化载体,在登录阶段完成账号校验与会话态建立,并将该用户的主题、阈值、模型选择与历史检测记录一并加载到控制层状态中,使进入主界面后能够直接继承上次的使用习惯;在注册阶段通过合法性校验与唯一性约束避免脏数据进入库表,从而降低后续维护成本。资料修改(头像/密码)与注销/切换账号被设计为"可逆的状态迁移":更新操作仅写回用户表与配置表,不干扰推理线程;注销则清理内存会话并回到登录界面,保证不同用户之间的结果、偏好与导出目录天然隔离。对检测主流程而言,账户体系提供了稳定的"个性化空间与数据追溯入口",使同一台设备在多人轮转使用时仍能维持配置一致性与结果可追踪性,从工程角度显著降低了现场使用的管理复杂度。

7. 下载链接

若您想获得博文中涉及的实现完整全部资源文件 (包括测试图片、视频,py, UI文件,训练数据集、训练代码、界面代码等),这里见可参考博客与视频,已将所有涉及的文件同时打包到里面,点击即可运行,完整文件截图如下:

完整资源中包含数据集及训练代码,环境配置与界面中文字、图片、logo等的修改方法请见视频,项目完整文件请见项目介绍及功能演示视频处给出:➷➷➷

详细介绍文档博客 :YOLOv5至YOLOv12升级:快递包裹检测系统的设计与实现(完整代码+界面+数据集项目)

环境配置博客教程:(1)Pycharm软件安装教程;(2)Anaconda软件安装教程;(3)Python环境配置教程;

或者环境配置视频教程:(1)Pycharm软件安装教程;(2)Anaconda软件安装教程;(3)Python环境依赖配置教程

数据集标注教程(如需自行标注数据):数据标注合集

8.参考文献

1 徐翔斌, 马中强. 基于移动机器人的拣货系统研究进展J. 自动化学报, 2022, 48(1): 1-20. DOI:10.16383/j.aas.c190728. (Google Patents)

2 曹家乐, 李亚利, 孙汉卿, 谢今, 黄凯奇, 庞彦伟. 基于深度学习的视觉目标检测技术综述J. 中国图象图形学报, 2022, 27(6): 1697-1722. DOI:10.11834/jig.220069. (CJIG)

3 Krizhevsky A, Sutskever I, Hinton G E. ImageNet classification with deep convolutional neural networksC//Advances in Neural Information Processing Systems 25. 2012: 1097-1105. (BibSonomy)

4 Ren S, He K, Girshick R, Sun J. Faster R-CNN: Towards real-time object detection with region proposal networksC//Advances in Neural Information Processing Systems 28. 2015: 91-99. (dblp)

5 Lin T Y, Goyal P, Girshick R, He K, Dollár P. Focal loss for dense object detectionC//Proceedings of the IEEE International Conference on Computer Vision (ICCV). 2017. DOI:10.1109/ICCV.2017.324. (IEEE Computer Society)

6 Redmon J, Divvala S, Girshick R, Farhadi A. You only look once: Unified, real-time object detectionC//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR). 2016. (CV Foundation)

7 Carion N, Massa F, Synnaeve G, Usunier N, Kirillov A, Zagoruyko S. End-to-End object detection with transformersC//Computer Vision -- ECCV 2020. LNCS 12346. Springer, Cham, 2020: 213-229. DOI:10.1007/978-3-030-58452-8_13. (Springer)

8 Wang C Y, Bochkovskiy A, Liao H Y M. YOLOv7: Trainable bag-of-freebies sets new state-of-the-art for real-time object detectorsC//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). 2023: 7464-7475. DOI:10.1109/CVPR52729.2023.00721. (CVF Open Access)

9 Jocher G, Chaurasia A, Qiu J. Ultralytics YOLO (v8.2.0)CP/OL. Zenodo, 2024. DOI:10.5281/zenodo.10983461. (Zenodo)

10 Jocher G, Qiu J, Chaurasia A. Ultralytics YOLO (v8.3.0)CP/OL. Zenodo, 2024. DOI:10.5281/zenodo.13858602. (Zenodo)

11 Tian Y, Ye Q, Doermann D. YOLOv12: Attention-Centric Real-Time Object DetectorsEB/OL. arXiv:2502.12524, 2025. DOI:10.48550/arXiv.2502.12524. (arXiv)

12 Wang C Y, Yeh I H, Liao H Y M. YOLOv9: Learning what you want to learn using programmable gradient informationC//European Conference on Computer Vision (ECCV). Springer, 2024. DOI:10.1007/978-3-031-72751-1_1. (Springer)

13 Wang A, Chen H, Liu L, Chen K, Lin Z, Han J, Ding G. YOLOv10: Real-Time End-to-End Object DetectionC//Advances in Neural Information Processing Systems 37 (NeurIPS 2024). 2024. (NeurIPS Proceedings)

14 Zhang G, Kong Y, Li W, Tang X, Zhang W, Chen J, Wang L. Lightweight deep learning model for logistics parcel detectionJ. The Visual Computer, 2024, 40: 2751-2759. DOI:10.1007/s00371-023-02982-z. (Springer)

15 Zou B, Li W, Chen Z. Cheapconv: Efficient parcel segmentation and detection for real-time logistics automationJ. Journal of Real-Time Image Processing, 2025, 22: 209. DOI:10.1007/s11554-025-01779-8. (Springer)