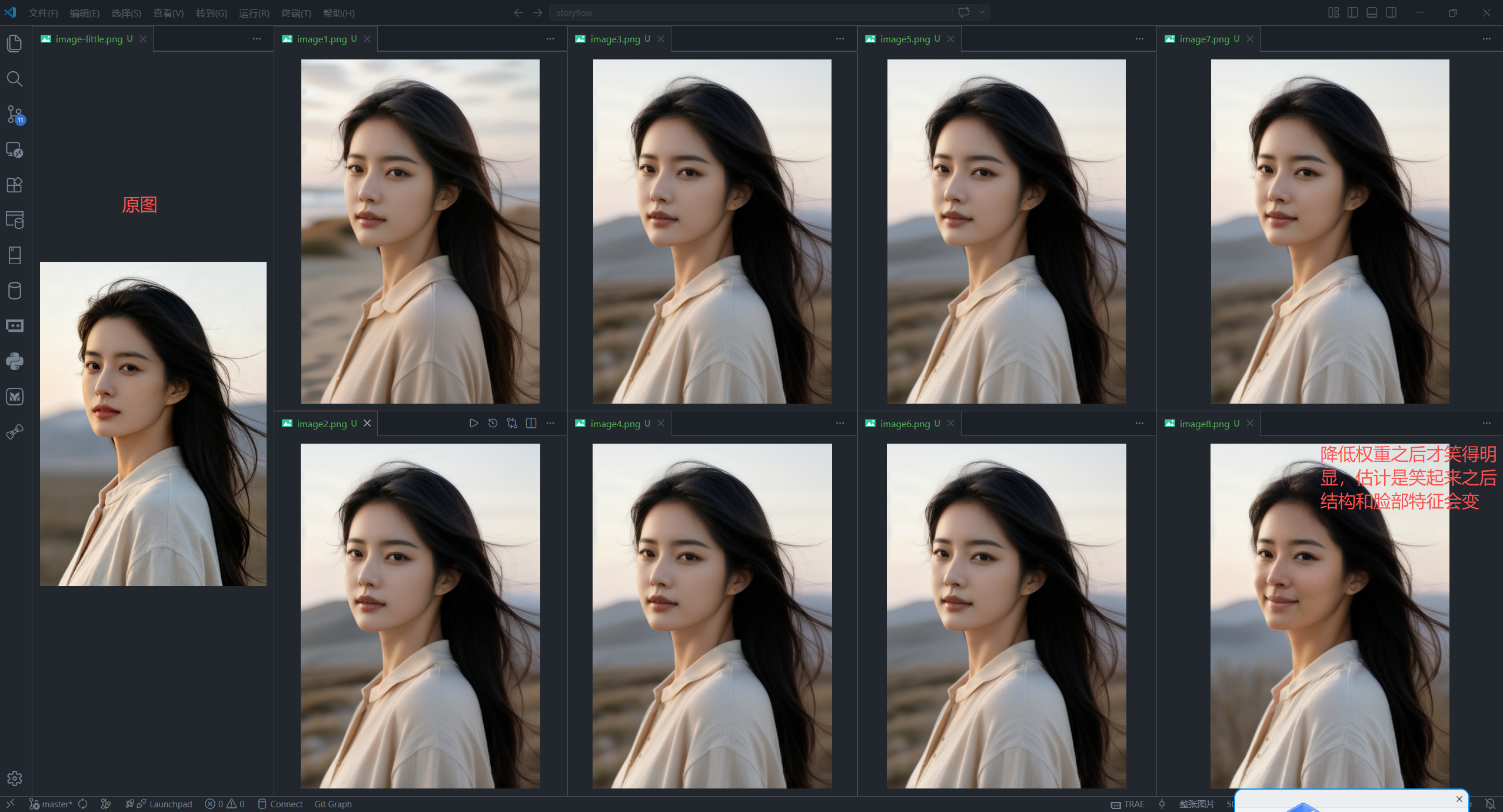

ComfyUI 实战:IP-Adapter + ControlNet 实现人物表情编辑,为什么降权重后更容易"笑出来"

摘要

在人像表情编辑任务中,仅依赖 prompt 往往难以稳定实现"让人物笑起来"的目标。为兼顾结构稳定与人物一致性,可以将 IP-Adapter 与 SoftEdge ControlNet 组合使用:前者负责增强人物特征保持,后者负责约束整体结构与边缘轮廓。本文基于一套已验证的 ComfyUI 工作流,介绍 IPAdapterUnifiedLoader + IPAdapterAdvanced + PiDiNetPreprocessor + ControlNetApplyAdvanced 的组合方式,并重点分析一个关键现象:IP-Adapter 权重过高时,人物更像原图,但笑容反而不容易生成;适当降低权重后,表情变化会更明显 。

实现效果,笑得更开心了

一、问题背景

在人物编辑任务里,"让人物笑起来"看起来像是一个简单的 prompt 问题,但实际操作中往往会遇到两个相互矛盾的目标:

-

希望人物保持原有特征

- 不能改得不像同一个人

- 发型、姿态、服装、整体结构尽量不变

-

希望表情真的发生变化

- 嘴角上扬

- 嘴型改变

- 整体表情变得更开心、更明显

这两个目标天然存在冲突:

- 如果约束过强,表情改不出来

- 如果约束过弱,人物又容易漂

因此,人物表情编辑本质上不是"生成一张笑脸",而是:

在原图基础上做受控修改,并在"身份保持"和"表情变化"之间找到平衡。

二、为什么需要同时使用 IP-Adapter 和 ControlNet

在这套工作流里,IP-Adapter 和 ControlNet 解决的是两个不同层面的问题。

1. IP-Adapter:负责人物特征保持

根据当前工作流,IP-Adapter 采用的是:

IPAdapterUnifiedLoader- 预设

PLUS FACE (portraits)

并通过 IPAdapterAdvanced 接入模型 。

这类结构的作用是:

- 让生成结果参考输入图中的人物特征

- 提高人物一致性

- 降低"改完之后不像原来那个人"的问题

2. SoftEdge ControlNet:负责结构约束

ControlNet 部分采用的是:

PiDiNetPreprocessorControlNetLoadercontrol_v11p_sd15_softedge.pthControlNetApplyAdvanced

其作用主要是:

- 保持轮廓结构

- 保持边缘关系

- 保持发丝、衣服和整体构图稳定

- 减少整图漂移

3. 两者的分工可以概括为

- IP-Adapter:尽量保证"还是这个人"

- SoftEdge ControlNet:尽量保证"还是这张图的结构"

这也是为什么人物表情编辑里,单独用其中一个模块通常不够稳,而组合使用更合理。

三、当前验证通过的工作流结构

这次验证通过的思路是:

- 输入原图

- 使用

IPAdapterUnifiedLoader加载人像预设 - 使用

IPAdapterAdvanced将参考图注入到 model 中 - 使用

PiDiNetPreprocessor从原图提取 SoftEdge - 使用

ControlNetApplyAdvanced把 SoftEdge 条件施加到采样阶段 - 最后通过

KSampler进行采样生成

从草案 JSON 可以看到,这套工作流包含以下关键节点:

IPAdapterUnifiedLoader:PLUS FACE (portraits)IPAdapterAdvancedPiDiNetPreprocessor,参数为enable, 512ControlNetLoader,加载control_v11p_sd15_softedge.pthControlNetApplyAdvancedKSamplerSaveImage

这说明工作流已经从"仅结构验证"升级为:

人物一致性 + 结构稳定性 + 表情编辑能力的组合验证。

四、为什么加入 IP-Adapter 后更稳,但笑容反而可能变弱

这是这次工作流里最值得重点说明的地方。

在实际验证中,一个很明显的现象是:

加入 IP-Adapter 之后,人物特征更稳定了,但如果 IP-Adapter 权重过高,笑容反而不容易生成。

这个现象非常合理,原因在于:

1. 表情变化本身会改变脸部局部特征

人物一旦笑起来,通常会出现以下变化:

- 嘴角抬起

- 嘴型变化

- 面部肌肉变化

- 局部阴影变化

- 整体"面部观感"发生轻微变化

而 IP-Adapter 的作用本质上是在告诉模型:

尽量贴近参考图中的人物特征。

如果参考图本身是自然表情,那么当 IP-Adapter 权重过高时,模型就会更倾向于:

- 维持原有脸部状态

- 避免对表情做过大改动

因此就会出现:

人物很像原图,但笑不出来

2. 表情编辑本质上需要"局部自由度"

人物表情变化不是整图重绘,而是需要给模型留出一定的局部编辑空间。

如果:

- IP-Adapter 权重太高

- SoftEdge ControlNet 强度太高

- Prompt 又偏保守

那么模型几乎会被锁死在原图附近。

所以在这类任务里,不是约束越强越好,而是需要平衡:

- 一致性

- 结构稳定

- 表情可编辑性

五、为什么降低 IP-Adapter 权重后,笑容更明显

这次验证结果说明了一个很典型的调参规律:

适当降低 IP-Adapter 权重后,人物的表情变化会更明显。

这背后的逻辑是:

- 权重高:更像原图,但表情被压制

- 权重低:人物一致性稍微放松,但表情更容易生成

也就是说,在人物微笑编辑任务中:

IP-Adapter 权重并不是越高越好

如果目标是"尽量像原图",可以适当提高。

但如果目标是"既要像原图,又要明显笑起来",就需要给模型保留一定空间。

这也是为什么在人物表情编辑里,通常更适合从 中等权重 开始试,而不是一上来就拉满。

六、IP-Adapter 节点参数重点说明

1. IPAdapterUnifiedLoader

当前工作流中,IPAdapterUnifiedLoader 使用的是:

preset = PLUS FACE (portraits)

这个预设更偏向人像场景,适合:

- 脸部一致性

- 人物特征保持

- 人像编辑任务

它的主要作用是加载一组适合当前任务的 IP-Adapter 配置,而不是单纯加载一个模型。

2. IPAdapterAdvanced

从已验证的工作流可以看到,IPAdapterAdvanced 包含以下关键参数:

weightweight_typecombine_embedsstart_atend_atembeds_scaling

这些参数的含义如下。

(1)weight

这是最重要的参数,表示 IP-Adapter 对模型的影响强度。

可理解为:

- 越高:越贴近参考图

- 越低:越允许模型自由变化

在人物表情编辑任务里,它直接影响:

- 人物是否还能保持原有特征

- 表情是否还有足够空间被改出来

这次验证中最关键的结论就是:

如果想让笑容更明显,通常需要适当降低这个权重。

(2)weight_type

当前工作流中使用的是:

linear

它表示权重在采样过程中的施加方式。

对于大多数常规场景,linear 是比较稳妥的选择。

(3)combine_embeds

当前工作流中使用的是:

average

它决定参考特征如何与模型条件进行组合。

在人物编辑任务中,这会影响参考特征注入方式。

(4)start_at / end_at

当前工作流中分别是:

start_at = 0end_at = 1

表示 IP-Adapter 在整个采样阶段都生效。

这意味着从开始到结束,模型都会持续参考输入图中的人物特征。

如果后续需要更细调,也可以考虑让它只在部分采样阶段生效,但对于当前阶段,整段生效更容易稳定。

(5)embeds_scaling

当前工作流中使用的是:

V only

它表示参考特征在注意力中的缩放方式。

在当前人像工作流中,这是一个比较常见的设置。

七、ControlNet 节点参数重点说明

1. PiDiNetPreprocessor

当前工作流中的 PiDiNetPreprocessor 参数为:

enable512

它的作用是把输入图像转成 SoftEdge 控制图。

可以简单理解为:

- 提取图像的"柔和边缘结构"

- 提供给 ControlNet 做结构参考

512 代表预处理分辨率。

分辨率越高,结构信息越细;越低,边缘更概括。

2. ControlNetLoader

当前加载的是:

control_v11p_sd15_softedge.pth

说明这条工作流使用的是 SD1.5 版本的 SoftEdge ControlNet,更适合当前 SD1.5 主模型链路。

3. ControlNetApplyAdvanced

这是整个结构控制的核心节点。

标准输入包括:

positivenegativecontrol_netimage

输出新的:

positivenegative

再送入 KSampler。

从已验证的草案 JSON 看,当前 ControlNetApplyAdvanced 的强度参数是:

0.2

这个参数可以理解为:

ControlNet 对结构约束的力度

- 越高:结构越稳,但越难改表情

- 越低:表情更容易变化,但结构可能变松

在人物表情编辑任务里,这个参数和 IP-Adapter 的 weight 一样,都不能一味拉高。

因为你需要的是:

结构要稳,但嘴部表情还要能动。

所以对于这类任务,通常更适合从中低强度开始调。

八、为什么这套组合比"只用 ControlNet"更适合人物编辑

如果只用 ControlNet:

- 可以保结构

- 但人物身份保持能力有限

如果只用 IP-Adapter:

- 可以保人物特征

- 但结构边缘和轮廓的稳定性不够

而两者组合之后:

- IP-Adapter 负责"像不像原来那个人"

- SoftEdge 负责"整体结构稳不稳"

因此,这种组合更适合:

- 人像表情编辑

- 轻微换表情

- 后续扩展到局部 inpaint

- 后续做视频关键帧准备

九、这套工作流还没有完全到最终版

虽然这次已经验证了:

- IP-Adapter 可正常接入

- SoftEdge ControlNet 可正常接入

- 降低 IP-Adapter 权重后,笑容会更明显

但当前这套工作流依然更接近:

整图受控表情编辑验证版

它还没有完全做到"只改嘴部、其他区域尽量不动"。

因为从草案里也可以看到,目前已经预留了后续的嘴部 mask 方案说明:

- 可把嘴部 mask 接入

attn_mask - 或接入 latent inpaint 分支

这意味着下一步最合理的升级方向是:

局部嘴部 Mask + IP-Adapter + SoftEdge

这样会比整图重采样更适合做高质量微笑编辑。

十、推荐的调试顺序

对于这类人物表情编辑工作流,更推荐按以下顺序调试:

第一步:先验证结构和一致性链路能否工作

确认:

IPAdapterUnifiedLoaderIPAdapterAdvancedPiDiNetPreprocessorControlNetApplyAdvancedKSampler

这条链已经打通 。

第二步:优先调 IP-Adapter 的 weight

这是最影响"能不能笑出来"的参数。

建议调参逻辑:

- 如果人物明显变样:适当升高

- 如果人物很像但笑不出来:适当降低

第三步:再调 ControlNet 强度

如果发现:

- 结构漂移多:略微加大

- 表情改不动:适当减小

第四步:最后再做局部嘴部 Mask

只有进入局部编辑之后,才更容易做到:

- 只改嘴角

- 只改唇形

- 其他区域几乎不动

十一、总结

从解决问题的角度来看,这次加入 IP-Adapter 之后的验证结果,有几个非常关键的结论:

1. IP-Adapter 和 ControlNet 的作用并不重复

- IP-Adapter 负责人物一致性

- SoftEdge ControlNet 负责结构稳定

2. 表情编辑不是"约束越强越好"

如果:

- IP-Adapter 权重过高

- ControlNet 强度过高

那么人物虽然更稳,但表情会更难改出来。

3. 人物笑起来本身会带来脸部局部变化

这意味着在"保持人物一致性"和"让表情发生变化"之间,必须留出一定的编辑自由度。

4. 降低 IP-Adapter 权重后,笑容更明显是合理现象

这不是工作流失效,反而说明:

模型终于有空间去改变脸部局部表情了。

5. 更适合正式落地的方案是

IP-Adapter + SoftEdge ControlNet + 局部嘴部 Mask

这套结构会比纯 prompt 或纯整图控制更适合高质量人物表情编辑。