摘要

本周学习了Life-Long Learning的相关知识,重点了解了灾难性遗忘与灾难性遗忘的出现原因以及解决方法Selective Synaptic Plasticity的基本理论与公式

Abstract

This week, I learned about concepts related to Life-Long Learning, with a focus on catastrophic forgetting, the reasons for its occurrence, and the basic theory and formulas of Selective Synaptic Plasticity, a method to address it.

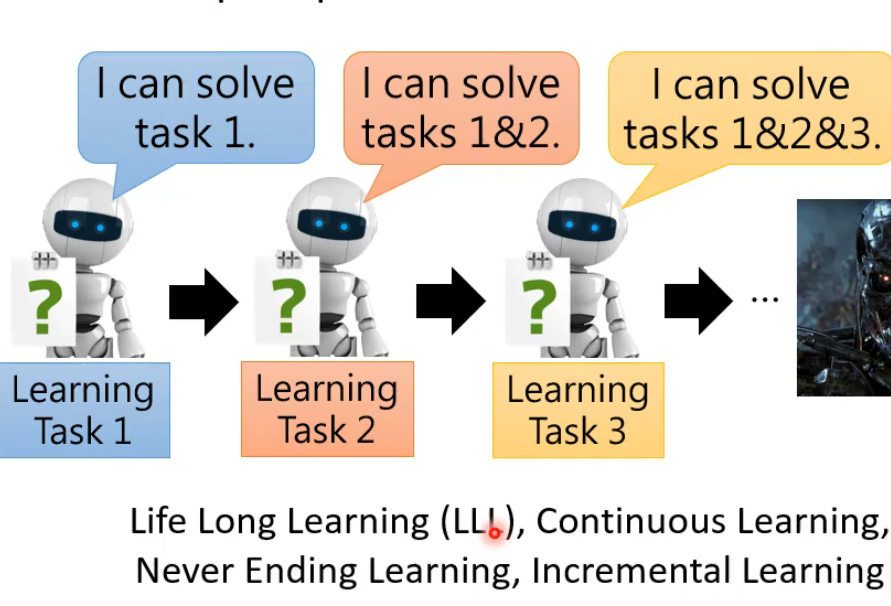

Life-Long Learning"(终身学习),就是让机器学习模型能够持续不断地学习新任务,同时不忘记已经学过的旧知识。

-

持续学习:不像传统模型训练完一个任务就固定不变,终身学习的模型会不断接收新数据、新任务。

-

知识积累:它要在学习新东西时,利用或保留过去学到的有用知识,实现正向迁移。

-

克服灾难性遗忘:这是最大的挑战。普通模型学新任务后,往往会彻底忘记旧任务(称为"灾难性遗忘")。终身学习的目标就是在学习新知识时,不严重破坏旧知识。

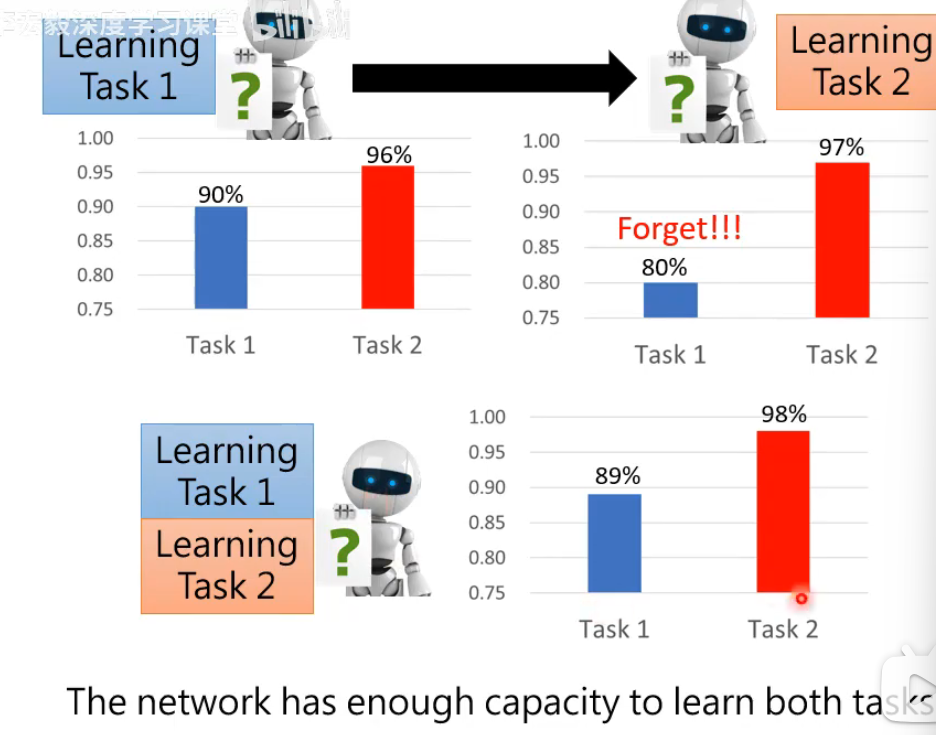

其中灾难性遗忘是指人工神经网络在连续学习多个任务时的一个关键缺陷:当模型学习新任务并调整自身参数以优化新任务的性能后,它会急剧且彻底地丧失先前学习任务的执行能力。这并非缓慢的遗忘,而是一种突发性的崩塌------原本在旧任务上表现优异的网络,其准确率可能从很高水平瞬间跌至随机猜测的程度。如下图所示,在先学习任务一再任务二的的情况下,任务一的结果表现得很差。但是同时学习任务一与任务二时,机器又能同时得到不错的结果。这证明并不是机器没有能力学习多个任务,而是存在某些原因导致灾难性遗忘的发生

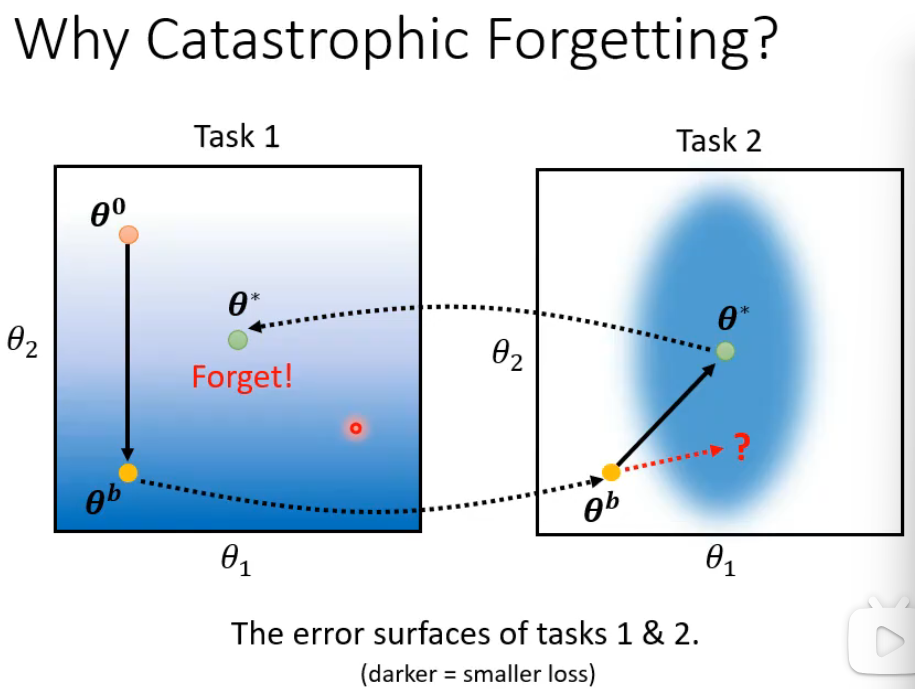

Selective Synaptic Plasticity 为解决神经网络的灾难性遗忘(Catastrophic Forgetting)问题提出的核心思路之一,其基本假设是:模型中的参数并非对所有任务同等重要,部分参数是旧任务的 "关键记忆载体",如果这些参数在学习新任务时被大幅修改,模型就会彻底遗忘旧任务;而另一部分参数对旧任务的影响微乎其微,完全可以用来适配新任务。因此,该方法的核心策略就是"选择性保护重要参数,只允许更新对旧任务不重要的参数",在学习新知识的同时尽可能保留旧知识。

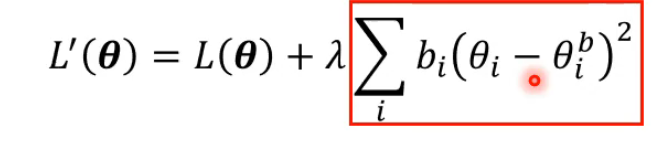

公式中也体现了两种极端情况:当 bi=0 时,该参数不受任何约束,模型可以随意修改它,如果大量关键参数的 bi 都为 0,就会直接导致灾难性遗忘;当 bi=∞ 时,该参数会被完全锁定在旧任务的状态,模型无法更新它,最终陷入无法学习新任务的 "僵化(Intransigence)" 状态。这一框架也正是 EWC(弹性权重巩固)、Synaptic Intelligence(突触智能)等经典持续学习算法的底层逻辑 ------ 它们的核心差异仅在于计算 "重要性权重 bi" 的方式不同,EWC 使用费雪信息矩阵估计参数重要性,Synaptic Intelligence 则通过跟踪参数对损失的贡献来计算重要性,但其本质都是通过选择性地约束参数更新,在持续学习中平衡记忆与可塑性。