一个自然的问题随之产生:语言模型能否在推理过程中学会整合记忆,从而只保留解决任务所必需的信息?

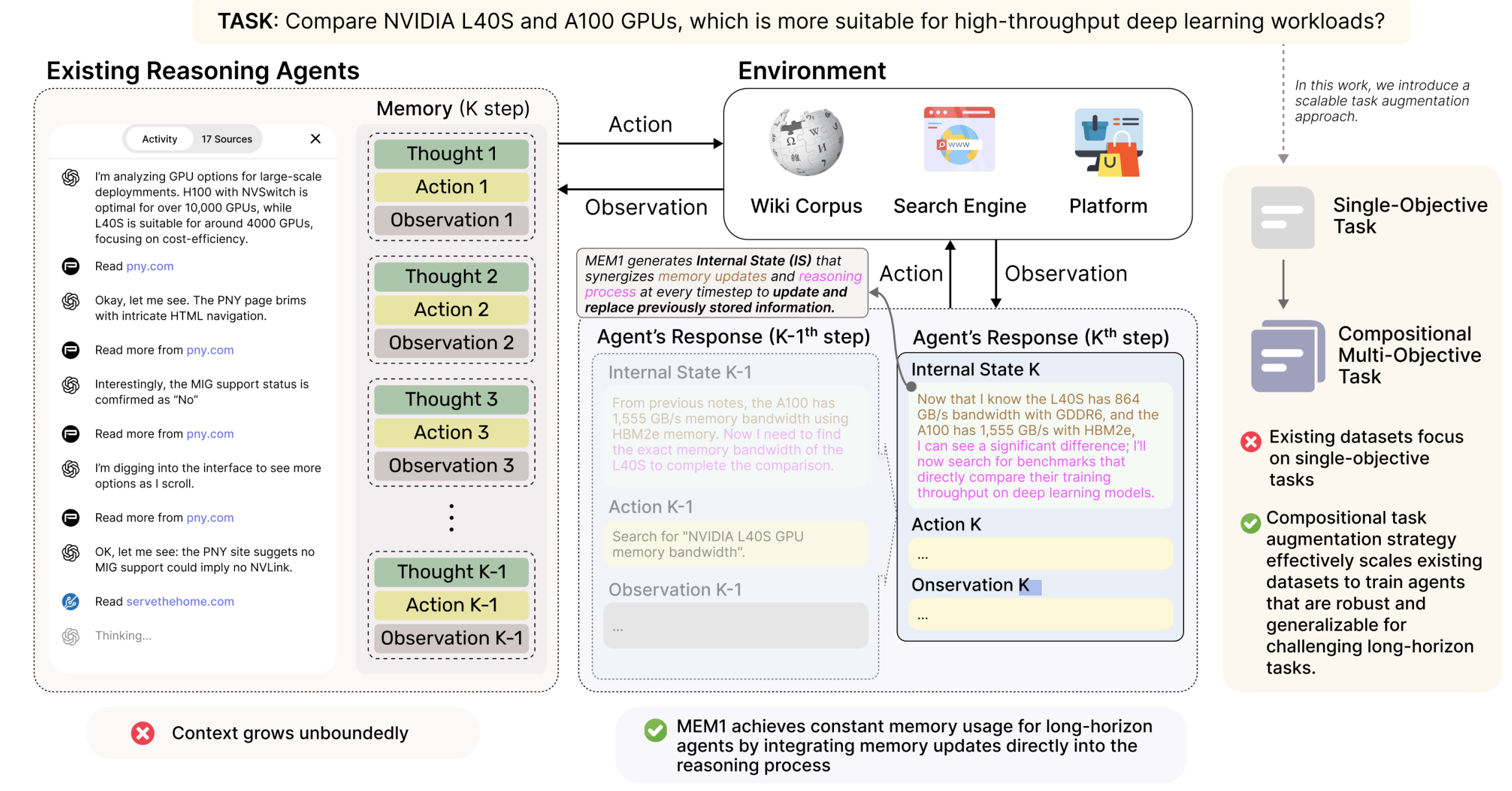

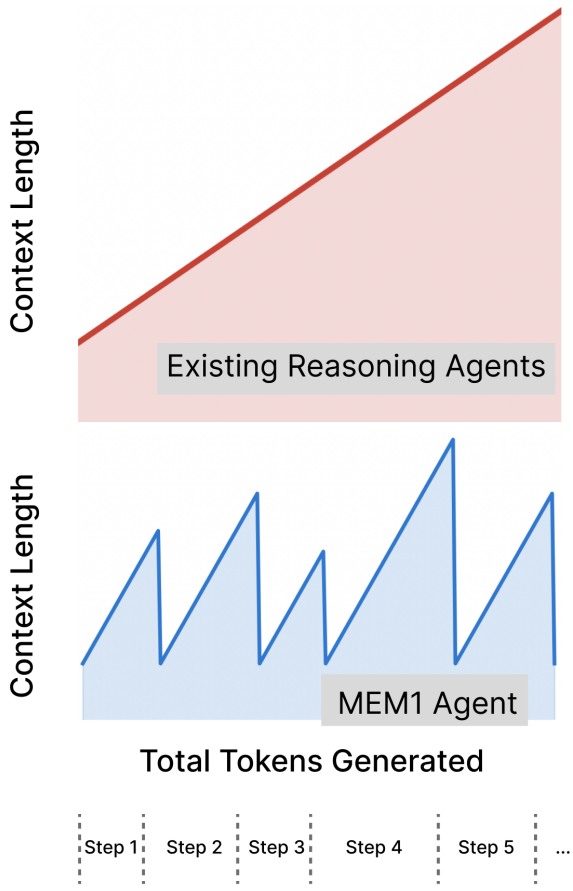

受此问题启发,我们提出了 MEM1:一种内存高效机制通过学习一步式整合推理与整合------一种训练大语言模型智能体的方法,该方法可在任意长的时间范围内保持恒定的内存使用量。如图1所示,在每一轮交互中,模型会更新一个由先前记忆和新获取信息组成的整合状态。这一整合状态成为智能体唯一保留的记忆,使得所有外部工具的输出在使用后均可被丢弃,从而从根本上避免提示词膨胀,如图2所示。

图1:MEM1 与现有推理智能体的内存管理对比。现有面向长视野任务的智能体会持续追加思考内容(通常包含在<think></think>标签内)、动作和观测信息,导致上下文不断膨胀;而我们的 MEM1 智能体则会持续更新一个融合了思考与记忆的内部状态(包含在<IS></IS>标签内),并丢弃之前步骤的内容,从而在任务执行过程中保持稳定的内存占用。此外,现有环境和数据集均聚焦于单目标任务,我们的任务增强方法则能有效扩展这些任务,支持长视野智能体的训练。

图2:MEM1智能体与现有推理智能体在处理长时程任务时上下文长度的概念对比。我们的智能体在生成新的内部状态和动作后,会立即丢弃之前的上下文(提示词和初始查询除外),从而实现近乎恒定的内存占用。

一、MEM1 核心定义与技术定位

1. 核心定义

MEM1(Memory-Efficient Mechanism via learning 1-step integrated reasoning and consolidation)是面向大语言模型长视距多轮交互智能体的端到端强化学习框架,通过单步集成推理与记忆整合学习,使智能体在任意长度的多轮任务中维持恒定内存占用,同时保障长视距推理性能,是针对大语言模型智能体记忆管理与推理协同的轻量化解决方案。

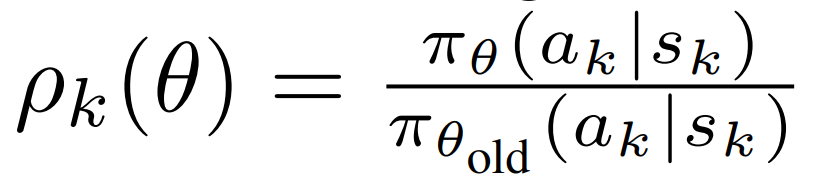

强化学习 提供了一种通过奖励信号塑造智能体行为的强大机制,奖励信号只奖励「任务最终是否成功完成」。模型不是拿到 "实物奖励",而是拿到「强化学习的梯度信号」,用来更新策略、学会记忆 - 推理协同,具体得到 3 个核心能力:

- 得到策略更新的梯度 奖励信号驱动 PPO 算法计算策略梯度 ,调整模型的 actor-critic 网络参数,让模型提高 "能完成任务的行为概率",降低 "完不成任务的行为概率"。

- 学会把记忆压缩进

<IS>内部状态 因为每轮都会裁剪历史上下文,模型只有学会把关键记忆压缩进<IS>,才能完成任务拿到奖励,被迫形成恒定内存的行为模式。 - 学会记忆 - 推理一体化 模型不再依赖完整历史上下文,而是通过

<IS>同时完成记忆存储 和推理决策,实现长视距交互不崩、泛化到 16 目标复杂任务。

2. 技术背景与研发意义

在为长周期场景设计的系统中,当前 LLM 智能体需完成多轮、多目标、依赖历史信息的交互任务,一种常见做法是在每一轮都将所有过往的观察、动作和思考附加到上下文之中,进而带来三大核心缺陷:

- 全上下文拼接机制导致上下文无界增长,推理成本和内存占用不断增加,引发O(N2)计算开销、GPU 内存占用线性上升,往往会造成计算机资源显著浪费;

- 超出训练时长范围的泛化能力局限。上下文长度超过训练数据中对应长度的持续对话,对模型而言属于分布外数据。模型难以对这类陌生的长时程输入进行有效管理和推理。

- 上下文过载且效率低下。冗余历史信息稀释注意力,推理性能显著衰减。

另有一些方法引入了外部记忆模块 (如摘要生成器或者检索器),采用记忆模块与智能体推理策略分离训练 的范式,记忆模块独立于智能体策略完成训练与部署,无法与智能体整体决策策略实现端到端联合优化 ,直接造成记忆管理与推理过程的逻辑割裂。同时,该方案需独立维护、集成两个异构模型组件,为系统带来额外工程开销与部署复杂度;

此外,现有基于强化学习训练的工具使用型智能体仍未解决记忆管理核心缺陷,依旧存在提示词长度随交互轮次无界增长的问题。

MEM1 的研发意义在于:首次将推理过程与记忆整合(Consolidation) 统一表征,实现效率与性能协同优化,为长视距智能体提供可扩展、低算力的记忆管理范式。

3. 应用场景边界

MEM1仅适用于存在可验证明确奖励的长视距交互任务,核心场景包括:

- 多目标多跳问答(内部检索 QA、开放域网页 QA);

- 多轮网页导航(WebShop 电商交互、网页信息检索);

暂不适用无明确奖励、开放式自由对话等任务。

二、MEM1 核心技术机制与工作流程

1. 整体技术机制

MEM1 以推理驱动的记忆整合为核心,结合掩码轨迹策略优化方法,通过 PPO 强化学习实现端到端训练;在多轮交互中动态更新紧凑内部状态(Internal State, IS),完成历史信息融合与冗余信息丢弃,同时保障策略梯度计算的准确性与训练稳定性。。

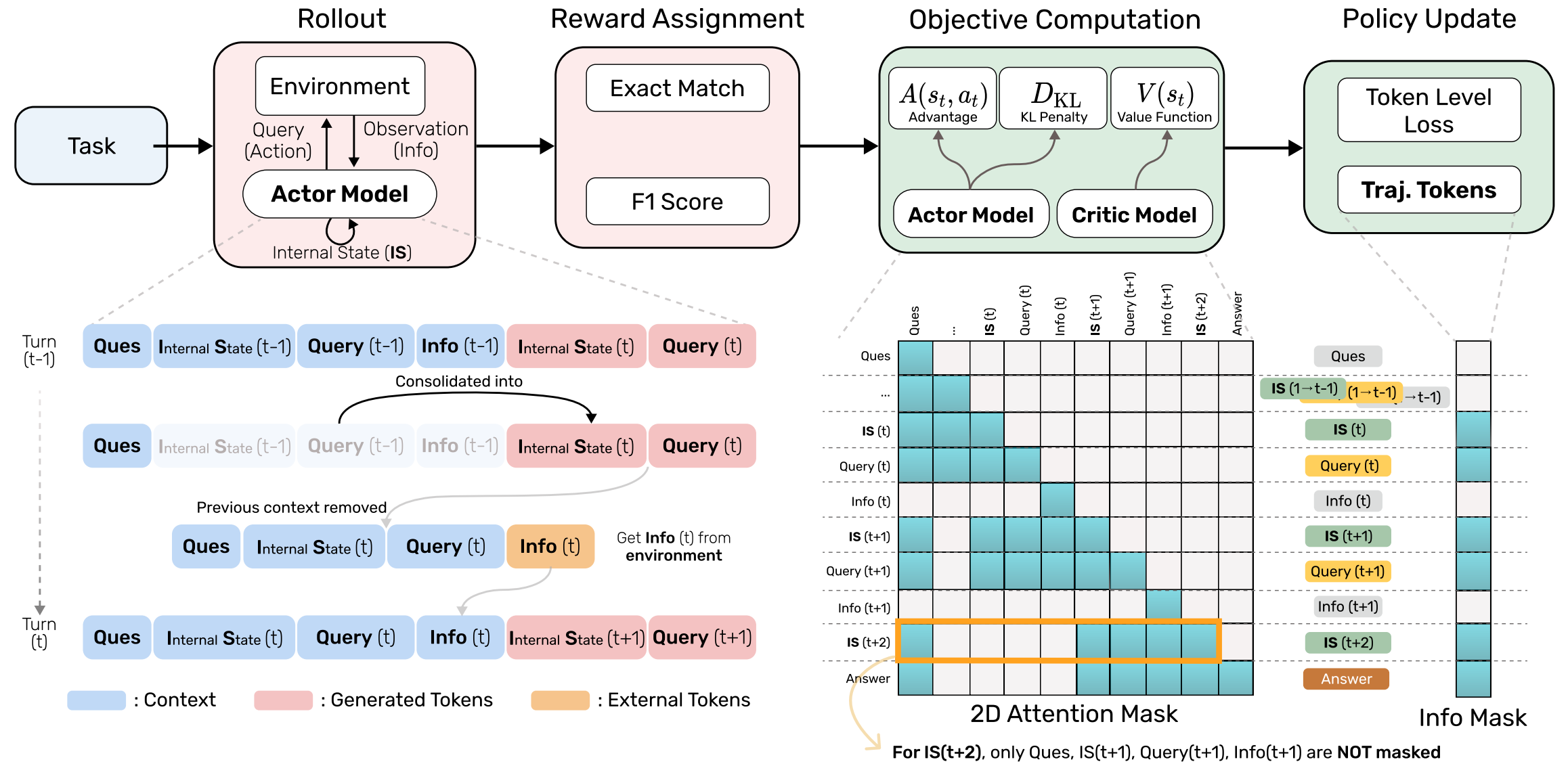

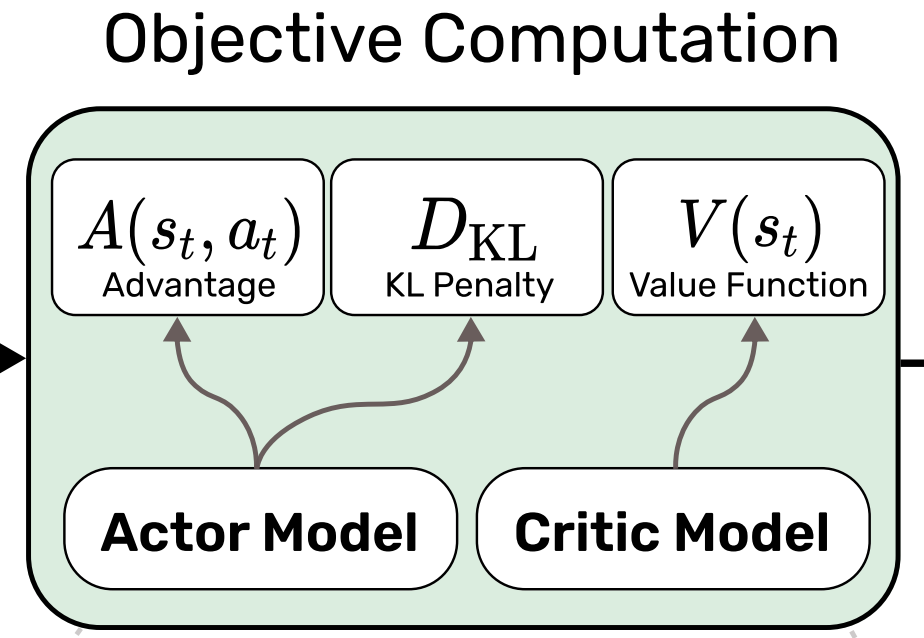

图3:(上图)用于训练MEM1的强化学习(RL)流程。(左下)MEM1中上下文的演变------当新状态进入上下文时,旧的<IS>、<查询>、<信息>会被清除。该机制用于展开过程中。(右下)目标计算阶段使用的二维注意力掩码。该掩码在前向传播过程中应用,用于为智能体模型计算动作对数概率,为评判模型计算状态价值估计。在策略更新阶段,信息掩码会应用于完整轨迹,屏蔽掉非模型自身生成的标记。

##知识点补充

图里的 Advantage(A)、KL Penalty(D_KL)、Value Function(V),和 Transformer 的 Q/K/V 没有一一对应的关系。它们分属两个完全不同的模块:

- Transformer 的

Q/K/V是模型推理时的注意力计算单元,是模型本身的 "骨架"; - 这张图是PPO 强化学习训练时的目标函数计算模块,是用来更新模型参数的 "训练逻辑",不是模型推理时会用到的组件。

先快速回顾你知道的 Transformer Q/K/V

你已经了解的部分,用最直白的话再理一遍:

- 领域:模型推理 / 前向传播环节,是自注意力机制的核心;

- 作用:解决 "序列里哪些 token 是相关的" 问题,让模型能融合上下文信息;

- 大白话拆解:

Q(Query):每个 token 的 "问题"------ 我要关注谁?K(Key):每个 token 的 "标签"------ 我是什么内容?V(Value):每个 token 的 "答案"------ 我能提供什么信息?

- 关系:Q 和 K 计算相似度(注意力分数),再用分数加权 V,得到每个 token 融合了上下文的输出。本质是序列内部的信息聚合工具。

这张图里的模块是什么?

这张图是PPO 强化学习的目标计算流程 ,MEM1 训练时用的就是这套逻辑,目的是计算梯度,让模型学会选能拿更多奖励的动作(比如学会把关键信息压缩到 <IS> 里)。

每个模块大白话拆解:

- Actor Model(策略模型) :就是你训练的大模型(比如 MEM1 里的 Qwen),负责 "选动作"------ 也就是生成

<IS>、<query>这些内容,输出的是动作的概率分布(比如下一个 token 选什么的概率)。 - Critic Model(价值模型) :和 Actor 是一对,负责 "评好坏"------ 评估当前状态(比如当前的

<IS>)未来能拿多少奖励,输出V(s_t)。 V(s_t)(Value Function):Critic 的输出,大白话:"现在这个状态,未来大概能拿多少分?" 用来判断当前状态好不好。A(s_t, a_t)(Advantage,优势函数):由 Actor 和 Critic 一起算出来的,大白话:"我刚才选的这个动作,比平均水平好多少?" 好很多就多学,差就少学,是更新 Actor 的核心依据。D_KL(KL Penalty,KL 散度惩罚):大白话:"别学歪了!新策略和旧策略别差太远,不然之前学的好东西都忘了",是 PPO 的核心约束,防止模型更新太猛崩掉。

疑问:为什么 A (sₜ,aₜ) 要 Actor+Critic 一起算,但图里 Critic 没有箭头指向 A?

核心就一句话:图里只画「模型直接输出的数据流」,不画「后台数学计算」;A 不是任何模型直接输出,是用 Actor 的结果 + Critic 的结果 算出来的,所以没有 Critic→A 的箭头!

一、先搞懂:A (sₜ,aₜ) 到底是什么?

A = Advantage 优势函数 大白话:在当前状态 sₜ下,选这个动作 aₜ,比 "平均随便选动作" 好多少?

- 正数 = 这个动作很棒,要多学

- 负数 = 这个动作很烂,要少学

它是PPO 更新 Actor 的核心依据,论文里 MEM1 训练全靠它。

二、A (sₜ,aₜ) 的计算公式(决定了必须 Actor+Critic 一起算)

MEM1 用的是标准PPO 算法 ,优势函数公式:A(sₜ,aₜ) = Q(sₜ,aₜ) − V(sₜ)

拆成两部分,你就懂为什么要两个模型:

- Q (sₜ,aₜ):动作价值 状态 sₜ下,选了动作 aₜ 之后,未来总共能拿多少奖励→ 由Actor Model算(Actor 负责输出动作、动作概率)

- V (sₜ):状态价值 状态 sₜ本身好不好,不管选什么动作 ,未来大概能拿多少奖励→ 由Critic Model直接输出(图里 Critic → V (sₜ) 的箭头就是这个)

✅ A 是【Actor 的动作价值】减【Critic 的状态价值】算出来的→ 所以必须两个模型一起参与,缺一不可

三、为什么图里没有 Critic → A 的箭头?

看论文图 3 的标注规则 :图里只画「模型直接输出的东西」,不画「后台用公式计算的东西」

- Actor Model 直接输出 → 动作概率、Q 相关(所以有箭头到 A)

- Critic Model 直接输出 → V (sₜ)(所以只有箭头到 V)

- A (sₜ,aₜ) 是计算出来的,不是模型吐出来的,所以不画 Critic→A

对应图里的模块:

- Actor Model → 提供 Q (sₜ,aₜ)

- Critic Model → 提供 V (sₜ)

- Objective Computation(目标计算模块) → 后台做减法:Q − V = A→ 图里只画了数据输入 ,没画计算过程!

两者的核心异同对比

| 对比维度 | Transformer 的 Q/K/V | 这张图里的模块(A、D_KL、V 等) |

|---|---|---|

| 所属领域 | 模型推理 / 前向传播(注意力机制) | 模型训练优化(PPO 强化学习目标计算) |

| 核心目的 | 解决序列上下文的信息融合问题 | 解决策略优化的梯度计算问题,让模型学会拿更多奖励 |

| 计算时机 | 模型每次推理时(生成每个 token 都算) | 训练时,每一轮交互之后,用来更新模型参数 |

| 数据来源 | 同一个序列里 token 的嵌入向量 | Actor/Critic 模型的输出,以及环境的奖励信号 |

| 和模型的关系 | 模型内部的特征计算单元,属于模型本身的一部分 | 训练时的辅助计算模块,用来更新模型参数,不是模型推理时的组件 |

| 和对方的关系 | 两者没有一一对应关系,是完全不同层面的东西 | 两者没有一一对应关系,是完全不同层面的东西 |

仅有的 2 个底层共性:

- 都基于模型输出的特征 / 向量做后续计算:Q/K/V 是 token 嵌入的线性变换,A、V 是 Actor/Critic 的输出;

- 都服务于模型的优化目标:Q/KV 让模型推理时能更好地理解上下文,A/V 让模型训练时能更好地更新参数。

2. 核心模块拆解(三个)

(1)推理驱动的记忆 Consolidation 模块

以<IS>标签为核心载体,将历史记忆、新观测、推理逻辑融合为紧凑内部状态,每轮仅保留最新状态,彻底裁剪历史上下文。

(2)掩码轨迹策略优化模块

针对动态的上下文更新破坏了词元生成轨迹的连续性 问题,设计二维注意力掩码, 该掩码在前向传播过程中应用,用于为智能体模型计算动作对数概率,约束 token 注意力范围,保证近端策略优化(PPO)和增强版强化学习(Reinforce++)等策略优化算法中,梯度计算的准确性;同时通过信息掩码(一维注意力掩码)锁定模型生成 token,确保梯度更新仅局限于智能体生成的token,屏蔽掉非模型自身生成的token,避免外部信息干扰梯度更新。

(怎么理解)我们在完整轨迹上应用二维注意力掩码:

一个 token 在被生成的那一刻,模型当时只保留了极少的最新记忆(旧上下文已经被剪掉了)。

这个二维掩码就是强制规定:这个 token 只能 "回看" 它被生成时、模型当时手里还留着的那些记忆 token;绝对不能看已经被删掉的旧内容,也不能看还没生成的未来内容。

(怎么理解)动作对数概率(action log-probabilities):

动作对数概率就是PPO 训练的 "数值抓手" :Actor 模型用它算新旧策略差异,把新、旧策略的差异锁在安全范围,结合优势函数A (sₜ,aₜ)计算**策略损失,**进而更新参数,再配合两个掩码保证计算符合记忆约束,最终让模型学会把历史记忆压缩进<IS>,用恒定内存完成长轮次推理。

(3)多目标任务构建模

基于现有单目标 QA 数据集 (HotpotQA、Natural Question)组合构建多目标多跳任务,搭建长视距智能体训练环境,弥补现有数据集对长交互任务支撑不足的缺陷。。

3. 记忆全生命周期工作流程

MEM1 定义**<IS>(代表内部状态,即推理过程)、<query>(代表环境查询)、<info>(代表外部观测结果或工具输出)、<answer>(智能体的响应)**四类 XML 标签。

MEM1采用学习方法实现状态的迭代更新与整合,确保在任意时刻仅将最新一组<IS>、<query>、<answer>和<info>元素保留在提示词中。该设计维持了上下文的有限性与语义相关性,助力高效且连贯的多步推理。

从而实现记忆的存储、更新、检索、调用全流程闭环:

- 记忆初始化 :智能体接收任务 Prompt,初始内部状态

<IS>为空,无历史记忆; - 记忆更新与整合 :每轮交互中,智能体基于上一轮

<IS_t>、<query_t>、<info_t>生成新<IS_{t+1},融合关键历史信息与新观测,主动丢弃冗余 / 无关内容; - 记忆调用 :以最新

<IS>为唯一记忆依据,生成环境查询<query>或最终答案 ``; - 记忆裁剪 :单轮交互结束后,彻底删除历史轮次所有标签 ,仅保留最新

<IS>、<query>、<info>,实现上下文长度恒定。

4. 训练与优化机制

- 采用PPO 近端策略优化 算法,以任务完成度为唯一奖励信号(QA 任务采用精确匹配 EM,WebShop 任务采用环境内置奖励),不设置任何中间奖励与格式约束惩罚;

- 通过掩码轨迹拼接多轮交互上下文,重构逻辑连贯的完整轨迹,解决动态上下文更新对策略梯度计算的干扰;

- 仅基于2 目标多跳任务完成训练,即可泛化至 16 目标等高复杂度长视距交互场景。

三、MEM1 与传统大模型记忆方案的对比分析

1. 传统记忆方案的技术局限

表格

| 记忆方案 | 核心原理 | 关键缺陷 |

|---|---|---|

| 全上下文拼接记忆(ReAct 等) | 逐轮将观测、动作、推理内容追加至Prompt | 上下文无界增长,O(N2)计算开销,长上下文注意力稀释,分布外泛化能力差 |

| 外部辅助记忆(A-MEM、摘要器、检索器) | 记忆模块与智能体策略分离训练、独立部署 | 无法端到端联合优化,存在额外工程开销,记忆与推理过程脱节 |

2. MEM1 核心创新与差异化优势

- 推理 - 记忆一体化表征 :将记忆整合嵌入推理过程,无需额外记忆模块,共享表征空间,无额外工程开销;

- 恒定内存占用:动态裁剪历史上下文,峰值 token 数量近乎恒定,彻底解决上下文膨胀问题;

- 端到端强化学习优化:记忆管理直接纳入策略优化,无需人工设计记忆规则,自适应学习关键信息保留逻辑;

- 掩码轨迹梯度保障:二维注意力掩码解决动态上下文的梯度计算难题,保证训练稳定性与梯度准确性;

- 强长视距泛化性:仅需短视距训练,即可泛化至多目标、长交互场景,无性能崩塌现象。

四、实验设计与性能结果分析

1. 实验设置

- 实验环境:多目标多跳 QA(Wiki RAG、开放网页 QA)、WebShop 网页导航;

- 基线模型:Qwen2.5-7B/14B-Instruct、Search-R1、DeepResearcher、AgentLM、A-MEM 等;

- 评价指标:准确率(EM、F1、环境奖励)、效率(峰值 token、依赖长度、推理时间);

- 训练配置:基于 Qwen2.5-7B 基座,4×H100/H200 训练,单卡 H200 推理,PPO 算法优化。

2. 核心性能结果

- 多目标 QA 任务 16 目标任务中,MEM1-7B 的 EM 值达 1.97,远超 Qwen2.5-14B-Instruct(0.567);峰值 token 仅为 14B 模型的 27.1%,推理时间仅占 29.3%,实现小模型性能超越大模型 + 效率大幅提升。

- WebShop 导航任务平均最终奖励 70.87,超越 AgentLM-13B(70.80);峰值 token 较 AgentLM-7B 降低 2.8 倍,推理速度提升 1.5 倍。

- 泛化与训练特性仅训练 2 目标任务,可稳定泛化至 16 目标;RL 训练效果显著优于 SFT,6 目标后 SFT 性能完全崩塌,RL 仍保持稳定。

3. 技术优势与现存不足

(1)核心技术优势

- 内存效率:长视距交互场景下峰值内存占用近乎恒定,大幅降低算力需求;

- 推理性能:多目标复杂任务中性能超越参数量翻倍的基线模型;

- 泛化能力:短视距训练即可适配超长交互场景,分布外泛化性能优异。

(2)现存技术不足(基于论文原文)

- 奖励依赖限制:仅支持具备明确可验证奖励的任务,无法适配开放式无奖励场景;

- 注意力掩码折中:位置 ID 处理未完全还原理想轨迹,训练效率存在优化空间;

- 模型规模验证有限:仅在 7B 参数规模模型完成实验,未验证更大规模模型的协同效果;

- 极端场景验证不足:超过 16 目标的超长篇交互场景未开展充分实验验证。

五、后续研究方向与学术借鉴意义

1. 后续研究与优化思路(计算机研究生科研视角)

- 稀疏 / 延迟奖励场景适配:设计弱监督 / 无监督奖励机制,将 MEM1 拓展至开放式对话、创意生成等无明确奖励任务;

- 注意力与记忆联合优化:改进二维掩码与位置 ID 编码,消除训练折中,提升记忆表征精度与训练效率;

- 多模态记忆协同 :将文本内部状态

<IS>拓展至图像、音频模态,适配多模态长视距智能体; - 模型规模缩放验证:探索 13B/70B 大模型与 MEM1 的协同效果,验证框架的缩放性;

- 边缘部署优化:结合量化、知识蒸馏,实现 MEM1 在端侧设备的轻量化部署;

- 记忆可解释性研究 :解析

<IS>内部状态的表征逻辑,提升智能体记忆的可控性与可解释性。

2. 领域学术借鉴价值

- 范式创新 :打破 "记忆 - 推理分离" 的传统思路,确立推理即记忆 Consolidation的一体化研究范式;

- 训练方案:验证了强化学习在长视距记忆管理中的有效性,为 LLM 高效推理提供端到端优化思路;

- 数据集构建:多目标任务组合方法为长视距智能体的 benchmark 构建提供可复用范式;

- 工程落地:恒定内存设计大幅降低大模型智能体的部署算力门槛,为轻量化长视距交互提供技术参考。