一、 引言:为 AI Agent 赋予可自然交互的 "身体"

从大模型到 AI Agent,智能系统已具备强大的理解与决策能力,但如何让 AI 实现拟人化、实时流畅的表达,依然是落地过程中的核心难题。

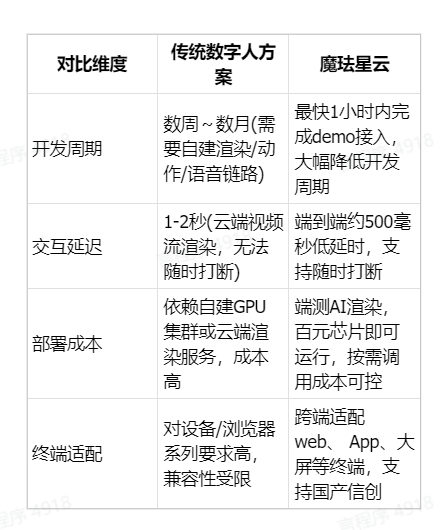

当前行业普遍面临交互体验与工程成本的双重困境:普通数字人依赖云端渲染与视频流推送,不仅响应迟缓,也不支持用户实时打断,难以满足真实对话场景;而自主搭建方案需要串联语音、渲染、动作等多套系统,开发复杂度高、延迟与成本居高不下。

魔珐星云作为 AI 屏幕操作系统与具身智能表达基础设施,能否打破这些局限,让开发者快速实现可交互、低延迟、低成本的数字人落地?本文将通过极简代码实战,完整验证这套方案的真实能力。

二、 认知破界:第一行代码,构建属于你的具身智能体

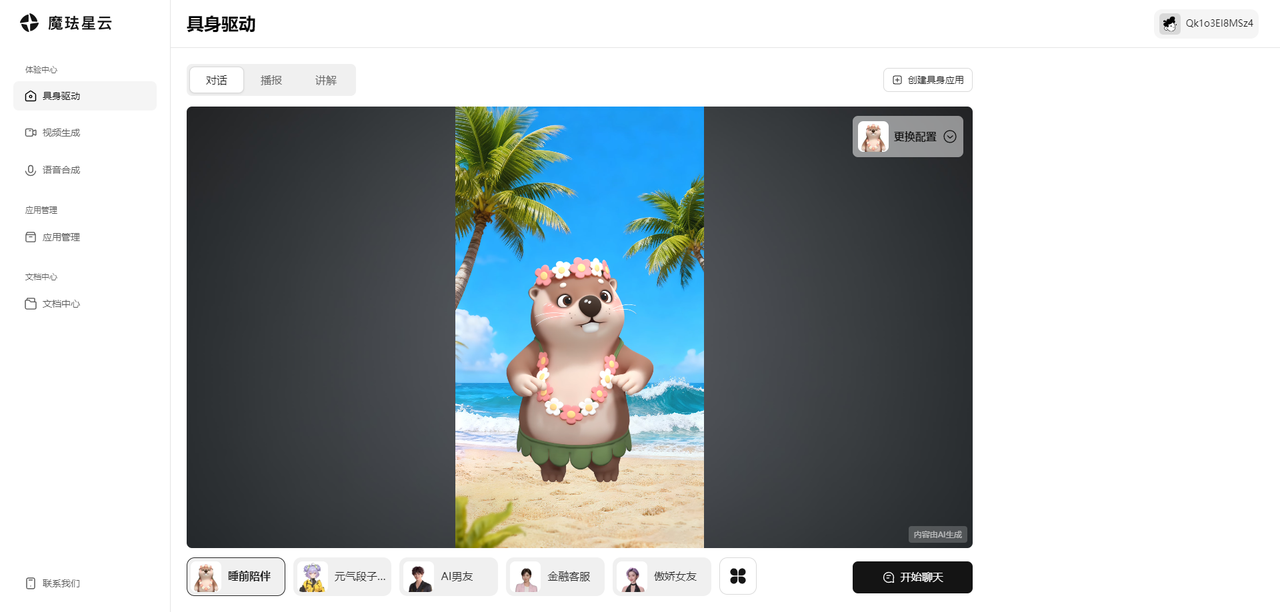

2.1 初识星云控制台:创建的是「具身驱动应用」,用于构建可实时交互的具身智能体

登录魔珐星云控制台,你会发现核心概念不是"上传模型",而是创建应用。你在这里"培植"的是一个可被API实时驱动的智能体实例,而非一段多媒体文件。

2.2 3分钟极速集成:感受"底座"的易用性

魔珐星云提供了极简的HTML集成方案。只需几行代码,即可让数字人"活"起来:

hytml

<!DOCTYPE html>

<html lang="zh-CN">

<head>

<meta charset="UTF-8">

<meta name="viewport" content="width=device-width, initial-scale=1.0">

<title>我的第一个数字人</title>

<style>

#avatar-container {

width: 800px;

height: 450px;

position: relative;

}

#sdk {

width: 100%;

height: 100%;

}

</style>

</head>

<body>

<div id="avatar-container">

<div id="sdk"></div>

</div>

<script src="https://media.xingyun3d.com/xingyun3d/general/litesdk/xmovAvatar@latest.js"></script>

<script>

const sdk = new XmovAvatar({

containerId: "#sdk",

appId: "你的AppID",

appSecret: "你的AppSecret",

gatewayServer: "",

onMessage: (message) => {

console.log("SDK message:", message);

},

});

sdk.init({

onDownloadProgress: (progress) => {

console.log("资源下载进度:", progress + "%");

},

});

</script>

</body>

</html>关键认知:魔珐星云不是传统数字人方案,而是可编程的具身驱动引擎,可直接构建端到端具身智能体。开发者只需关注业务逻辑,无需关心底层的3D渲染和语音合成。

三、 实战升级:打造AI屏幕助手 - 从0到1教学

3.1 环境准备与配置

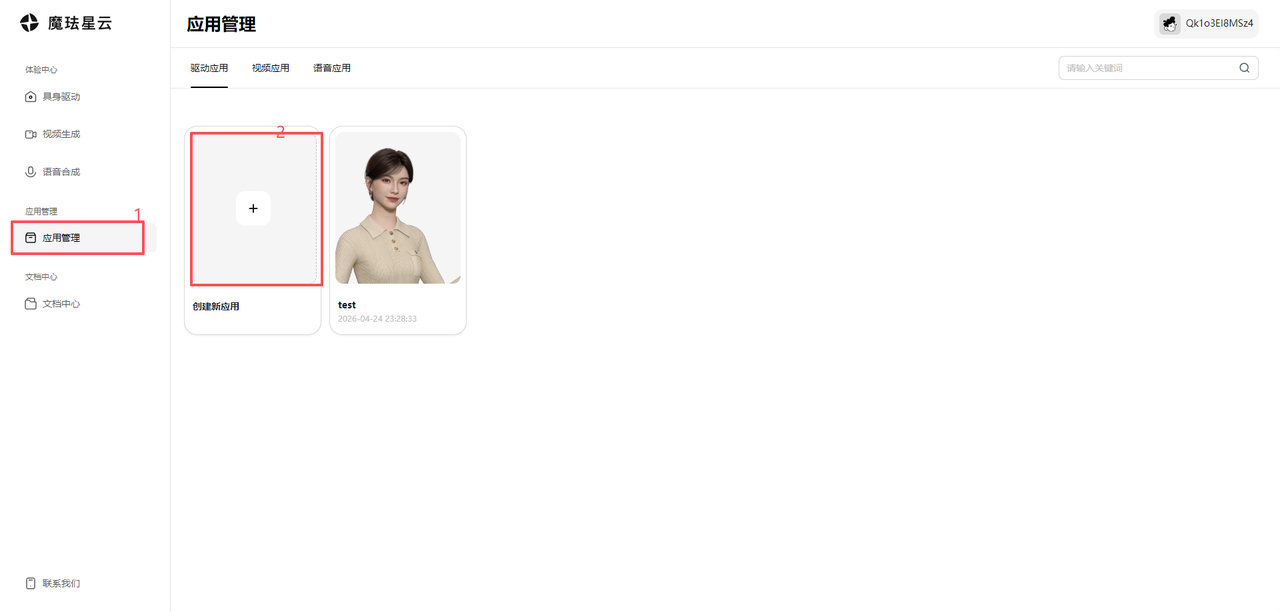

步骤1:创建应用

-

登录魔珐星云控制台(https://xingyun3d.com)

-

创建具身驱动应用,选择适合的形象和场景

-

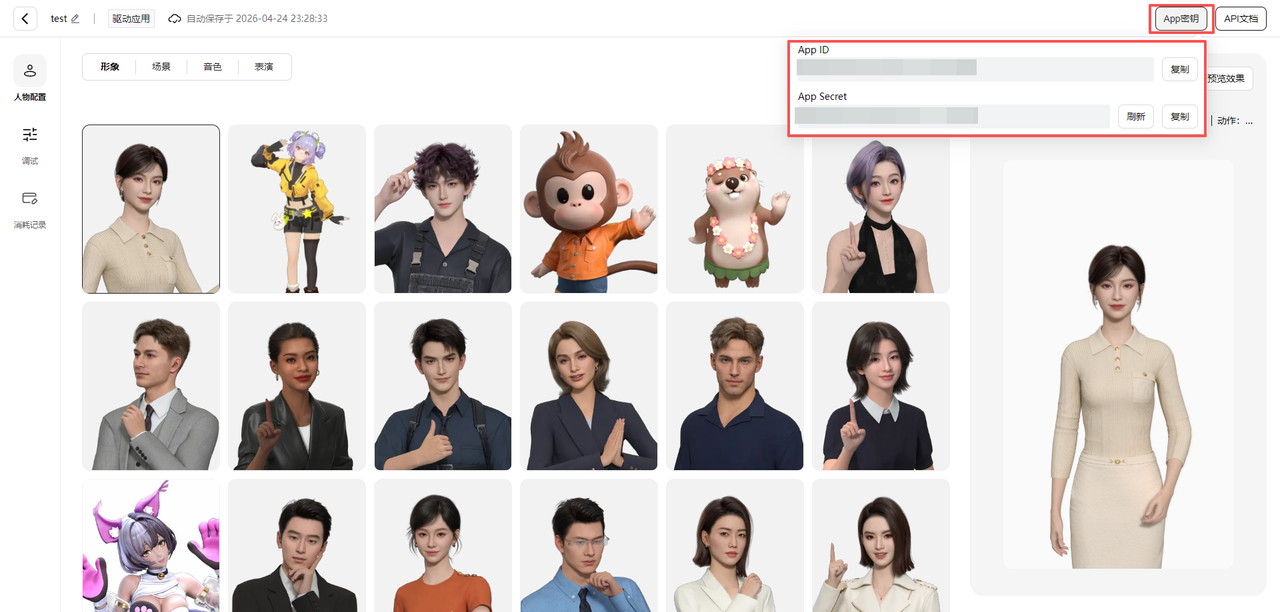

获取AppID和AppSecret

步骤2:使用官方Demo快速验证

H5部署不显示(仅作记录)

html

<!DOCTYPE html>

<html lang="zh-CN">

<head>

<script src="https://media.xingyun3d.com/xingyun3d/general/litesdk/xmovAvatar@latest.js"></script>

<meta charset="UTF-8" />

<meta name="viewport" content="width=device-width, initial-scale=1.0" />

<!-- 页面标题 -->

<title>我的第一个数字人</title>

<style>

<!-- [关键配置] 容器比例需与您在控制台选择的"应用类型"保持一致 -->

#avatar-container {

width: 800px;

height: 450px;

position: relative;

}

<!-- 定义数字人呈现的容器样式 -->

#sdk {

width: 100%;

height: 100%;

}

</style>

</head>

<body>

<!-- 定义SDK容器 -->

<div id="avatar-container">

<!-- 数字人将在此容器中显示 -->

<div id="sdk"></div>

</div>

<!-- 引入魔珐星云数字人SDK -->

<!-- 初始化SDK -->

<script>

// 创建XmovAvatar SDK实例

const sdk = new XmovAvatar({

// 指定数字人渲染的容器ID(CSS选择器格式)

containerId: "#sdk",

// 魔珐星云具身驱动应用App ID(用于身份验证)

appId: "xxxxxxxx",

// 魔珐星云具身驱动应用App Secret(用于身份验证)

appSecret: "xxxxxxxx",

// 数字人模型资源网关服务器地址

gatewayServer: "https://nebula-agent.xingyun3d.com/user/v1/ttsa/session",

// 数字人消息通知回调函数

onMessage: (message) => {

console.log("SDK message:", message);

},

});

// 初始化SDK实例并设置回调函数

sdk.init({

// 资源下载进度回调函数

onDownloadProgress: (progress) => {

console.log("资源下载进度:", progress + "%");

},

});

</script>

</body>

</html>Vue 3 + TypeScript

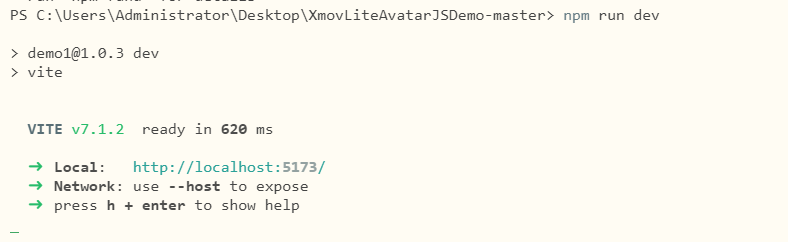

为了确保最佳兼容性,我们使用魔珐官方提供的JS Demo(基于Vue 3 + TypeScript,因为H5大多数浏览器不显示数字人):

bash

# 克隆Demo仓库

git clone https://gitee.com/xmovmaster/XmovLiteAvatarJSDemo.git

# 安装依赖

cd XmovLiteAvatarJSDemo

npm install

# 启动开发服务器

npm run dev

[图片]步骤3:配置密钥

在Demo的配置面板中填入你的AppID、AppSecret,以及腾讯云ASR配置(用于语音识别)和LLM配置(用于智能对话)。

3.2 核心代码解析:从"能说"到"会思考"

Demo的核心逻辑在src/stores/app.ts中,实现了"语音输入 → LLM处理 → 数字人播报"的完整闭环:

bash

// 发送消息给LLM并驱动数字人播报

async function sendMessage(content: string) {

// 1. 调用LLM获取回复(流式)

const replyStream = await llmService.sendMessageWithStream(content);

// 2. 智能分句处理

const sentences = splitSentence(replyStream);

// 3. 逐句推送给数字人播报

for (const sentence of sentences) {

await avatar.speak(sentence);

}

}技术亮点:

- 流式处理:LLM回复无需等待完整生成,实现"边想边说"的低延迟体验

- 智能分句:自动识别中英文标点,确保播报自然流畅

- 多模态同步:语音、表情、口型自动匹配,无需手动对齐

3.3 效果验证

运行项目后,你将看到:

- 数字人实时渲染在浏览器中

- 点击"语音输入"可进行实时对话

- 数字人会根据LLM的回复内容自动播报,表情和口型自然匹配

四、 技术解构:星云如何用"参数流"架构破解难题

4.1 传统方案为什么"重"?

传统方案需要开发者自己串联多个系统:

LLM → TTS → 3D渲染引擎 → 动作引擎 → 屏幕

每个环节都有延迟,且需要处理复杂的同步问题。

4.2 星云的"端侧渲染+参数流"架构

魔珐星云采用"云端理解-本地表达"的三层架构:

- 云端大脑:处理LLM推理和语义理解

- 参数流传输:只传输轻量的驱动参数(文本、情感、动作指令)

- 端侧渲染:在终端设备上实时合成语音和3D动画

核心优势:

- 低延迟:参数流仅几KB,传输极快

- 高并发:云端不传输视频流,支持高并发、万级以上并发

- 低成本:百元级芯片即可运行,无需昂贵GPU集群

五、 测评总结:这是"基础设施"该有的样子

经过实战验证,魔珐星云确实配得上"AI屏幕操作系统"的称号:

5.1 实际体验优势

5.2 适合谁用?

- 开发者:快速为应用添加拟人化交互界面

- 企业:将现有的信息屏、一体机升级为智能服务点

- 终端厂商:让任何屏幕都具备AI交互能力

5.3 生态展望

魔珐星云定义了"表达层"的标准,正如Android定义了移动应用的标准。它让构建"具身智能应用"变得像开发网页一样简单,这可能是具身智能规模化最快的路径。魔珐星云不是另一个数字人工具,它是让AI真正拥有"身体"的基础设施。 从"会思考"到"能表达",我们刚刚迈出了第一步。

https://xingyun3d.com?utm_campaign=daily\&utm_source=jixinghuiKoc76

原文出自:园游会永不打烊.