多年来,大家都百思不得其解,为什么苹果公司不开发自己的大型语言模型。他们有钱,也能轻易吸引到合适的人才,结果却什么也没发生。

谷歌刚刚发布了Gemma 4,这款软件惊艳了所有人。我们稍后会探讨它们之间的联系。

苹果公司将所有人工智能相关工作都外包了,对开发自己的模型几乎没有任何兴趣。当然,这并不完全正确,因为他们确实拥有大量的图像处理模型、图像检测以及许多其他较小的功能,这些都使 iPhone 成为现在的样子。

他们现在也拥有相当强大的基础(本地)模型,可以在手机上运行。对于许多基本任务,它们的表现都出乎意料地好。

我的应用所有处理都在设备本地完成。

所有长寿牌组的处理都在设备端进行,因为我希望用户数据绝对私密。虽然这需要模型的指导和详细的 .md 文件,但它确实有效。

目前没有公开的"苹果 Frontier 机型"。看来他们已经退出了这场竞争。

但真相远比这有趣得多。

泡沫现在几乎就要破裂了......

人工智能泡沫破裂前的格局

人工智能是个泡沫。我指的不是这项技术本身。你可以这样想,互联网泡沫破灭并不意味着互联网就此终结。它只是意味着那些价值不高、价格虚高的产品被淘汰了。

这次的情况有点不同,因为我们既有大型前沿模型公司(OpenAI、Google、Anthropic、Meta),也有数百万个 AI 封装器。

这个故事的合乎逻辑的结局是,随着泡沫破裂,大多数包装公司都会不复存在,就像互联网泡沫破灭一样。但我认为这一次情况会截然不同。

这一次,这场危机也将摧毁大部分前沿人工智能公司。空荡荡的战场上,最终谁能屹立不倒?

苹果。

来源:苹果

苹果颠覆了

他们此前已经颠覆了多个行业,从音乐制作、平面设计到音乐销售、内容分发等等。

人工智能领域目前仍处于早期阶段,少数几家大型企业正竭尽全力寻求任何形式的商业化。竞争异常激烈。几乎每隔一两周就会出现一个新模型,比之前的领先模型略胜一筹,提升幅度仅为0.01%。而要取得如此微小的优势,需要投入数十亿美元,以及足以供一个小国使用一个月的能源。

这里完全看不到苹果的身影......

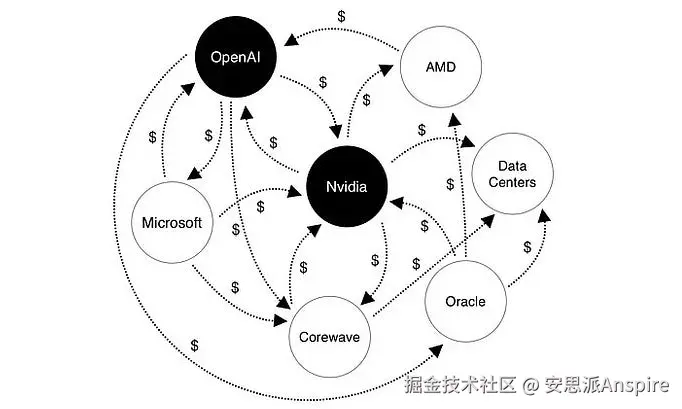

苹果公司也是极少数不在如今臭名昭著的"人工智能循环经济"图表中的公司之一。这意味着A公司支付B公司10亿美元,然后B公司再支付A公司10亿美元(返还)。尽管实际上并没有发生任何交易,但经济体系中却出现了20亿美元的流通。

这就是价值膨胀的原理。

而当它彻底崩塌时,痛苦会更加剧烈。

能源问题

前沿模型体积庞大,对硬件要求极高。

一段时间以来,订阅一直是体验人工智能的唯一途径。而人工智能公司不断制造的"害怕错过"(FOMO)情绪,让你不得不订阅,否则就会被那些臭名昭著的"使用人工智能的人"远远甩在后面。

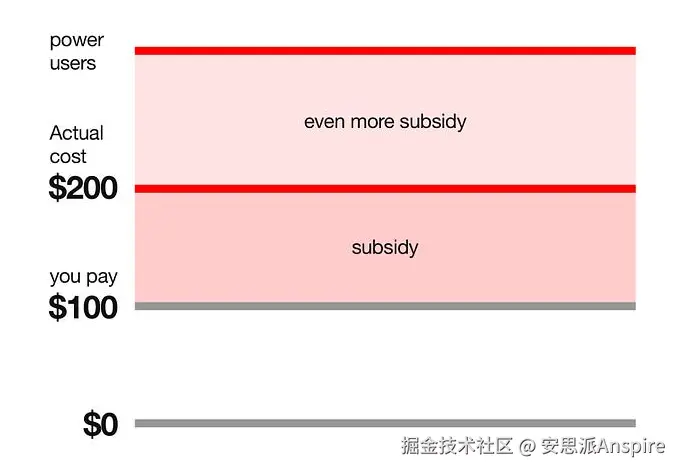

所有月度人工智能套餐均享受大量补贴。

问题在于,几乎所有前沿科技产品都享受补贴。你每月100美元的套餐,实际上要让公司损失150到200美元。他们想让你过度依赖这项技术,最终让你为了继续使用而支付更多费用,甚至可能高达1000美元。

这就像毒贩为了让你上瘾,免费给你第一次吸食毒品一样。(当然,这种事从未真正发生过)

但这些大型人工智能公司的时间不多了。他们先让你上手,然后抬高价格的计划可能很快就会适得其反。

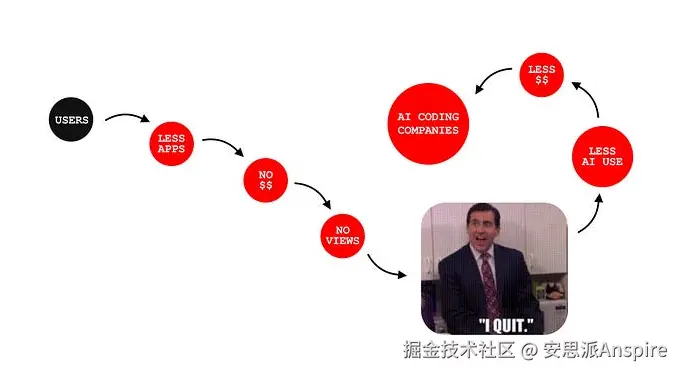

尤其现在市面上充斥着太多"氛围编码"的应用,导致人们对它们漠不关心,甚至不去下载。这不仅打击了周末开发者的积极性,也让他们对"氛围编码"这种形式本身失去了兴趣。

人们不再感兴趣,这导致人们辞职。

从某种程度上说,这也是为什么他们都试图转型为服务型公司的原因。比如"健康转型"、失败的"Sora"视频项目、Claude Cowork等等。所有这些都是为了让你获得的不仅仅是一个法学硕士学位。

采用这种模式的服务不太容易被替代。

所有这些模型和服务都运行在庞大而昂贵的数据中心上。

这就是苹果颠覆行业的方式。

当前人工智能硬件与未来人工智能硬件对比

如果能缩小数据中心的体积呢?

把那栋庞大的水冷建筑缩小到一台 Mac mini 里。在本地运行功能齐全的 LLM。数据完全由你掌控。苹果一直以来都倡导隐私保护,所以这完全合情合理。

在苹果硬件上使用人工智能作为工具,而不是使用云服务。这样更便宜、更安全、更注重隐私,风险也更低。

当然,这主要指的是早期使用者、喜欢动手实践的人、充满好奇心的人。但你知道吗?

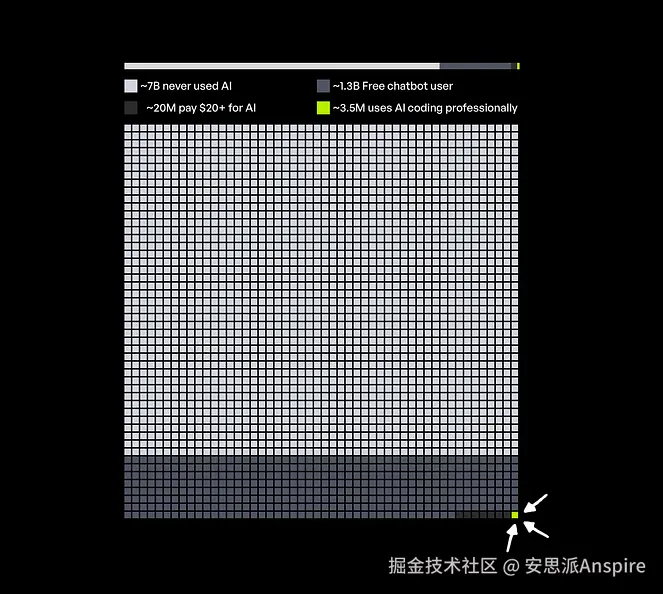

只有0.03%的人会为前沿人工智能模型支付超过20美元的费用。这意味着这些人也会最先放弃前沿人工智能模型,转而使用本地产品。

世界上大多数人根本不使用人工智能,第二大群体使用的是免费的、基于广告的模式。

你身处此地,却觉得整个世界都在与你擦肩而过。

M5、MLX,一切都从这里开始。

苹果的 MLX 框架旨在利用苹果芯片的内存处理方式,提升 AI 模型在 Mac 上的运行速度。与传统系统需要在不同处理器之间来回复制数据不同,MLX 允许 CPU 和 GPU 直接共享同一块内存,从而消除了速度瓶颈。Ollama 是一款流行的本地运行 AI 应用,其最新版本现在使用 MLX,在生成响应时速度大约提高了一倍。

最新的 M5 芯片通过内置神经网络加速器将性能提升到了新的高度。这些专用硬件专为处理人工智能任务而设计。苹果的测试表明,这些芯片可以在 10 秒内响应一个包含 140 亿个参数的模型,图像生成速度更是提升了近 4 倍。

现在,配备足够内存的现代 Mac 可以在本地运行复杂的 AI 模型,无需云订阅,没有使用限制,数据也不会离开您的计算机。

当然,它们还达不到尖端水平。但它们的价格要便宜得多。你的。私人的。

人工智能的未来不在于API

有一段时间,我们都认为人工智能的使用总是会在云端进行,或者通过我们网页封装器中的某些API来实现。

这种趋势正逐渐转向本地硬件,而本地层级管理(LLM)本身的重要性则显著降低。所有主流LLM的功能现在都大同小异。而且,本地型号通常比前沿型号落后一年。

最初那些获得巨额投资支持的人工智能是发展到今天这一步的必要步骤。但如今它们正变得越来越无关紧要,未来前景黯淡。目前,世界上绝大多数人仍然不使用人工智能模型,只有一小部分人会为人工智能付费。

而目前出资最多的群体呢?正是这个群体,一旦本地化模式可行,他们就会选择本地化。

随着苹果公司在 MLX 技术方面的最新进展,这一刻可能就在今年六月到来。

配备 128GB 内存的 Mac Mini 将彻底戳破人工智能泡沫。

M5 Mac Mini?

一款搭载 M5 处理器、配备 128GB 内存且定价极具竞争力的 Mac mini,将彻底终结人工智能公司的生存。诚然,市面上也有配备 512GB 内存的 Mac Studio,但大多数人对 128GB 的容量已经足够。而这款产品体积更小、价格更低,足以彻底粉碎人工智能泡沫。

那些嘲笑苹果的人工智能爱好者们,现在都会排队购买一台苹果电脑,然后运行 Gemma 4、Qwen 4(等它上市后)以及其他人工智能系统。

那些帮助人工智能达到如今这种输出水平的公司,要么会转向服务业,要么会慢慢耗尽资金。

最终谁将取得胜利?

苹果公司。就像他们(最近)一贯的做法一样。

押注LLM似乎从来就不是一个好主意。