2026 年 4 月 24 日,DeepSeekV4 系列模型 DeepSeekV4-Flash 和 DeepSeekV4-Pro 正式发布并开源,其以先进的 MoE 架构在参数效率与推理性能上实现了重要突破。MindSpeed LLM 目前已实现了 DeepSeekV4-Flash 模型的定长数据场景下的预训练支持,并同步开放源代码。目前提供预训练的复现部署参考,帮助用户快速上手。

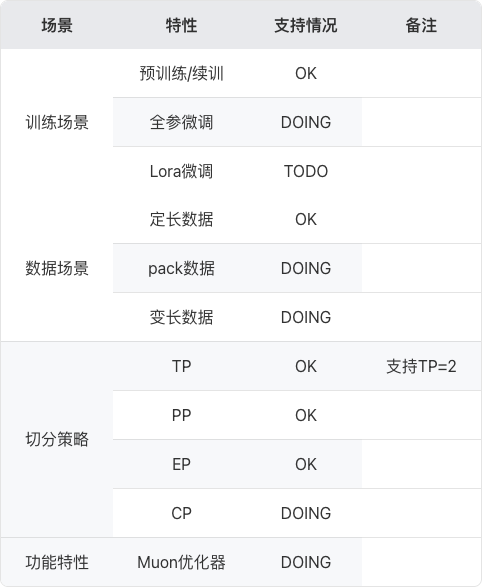

注:当前实现为 preview 版本,部分场景存在限制,后续我们将持续完善并同步跟进 DeepSeek-V4 技术报告中的演进方向:

作为昇腾大模型套件的重要组成部分,MindSpeed LLM 是昇腾 AI 生态中的核心技术支撑,专为大规模语言模型设计,具备强大的计算性能与灵活的工程化能力,可高效支撑 DeepSeekV4 等新一代大模型在训练场景下的落地应用。

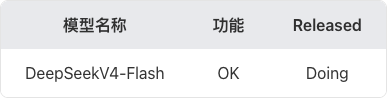

模型支持列表

MindSpeed LLM 跑通 DeepSeekV4-Flash 模型手把手教程:快速部署与应用

本教程将引导您完成从环境准备到模型训练的完整过程,确保您能够快速上手并顺利跑通 DeepSeekV4-Flash 模型。我们提供详细的步骤说明,帮助您在 MindSpeed 框架下实现 DeepSeekV4-Flash 模型的无缝运行。

环境配置

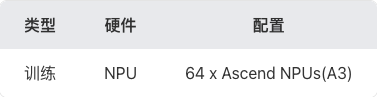

硬件要求

DeepSeekV4-Flash 的参考硬件配置如下,本文将以 A3 八机 64 卡预训练为例进行介绍:

MindSpeed LLM 仓库部署

MindSpeed LLM 的主要依赖配套如下表,安装步骤参考安装指导。

🔗 安装指导: https://atomgit.com/Ascend/MindSpeed-LLM/blob/master/docs/zh/pytorch/training/install_guide.md

仓库拉取

请参考 MindSpeed LLM 安装指导文档拉取仓库代码并配置环境:

# 如果你使用Atlas 900 A3 SuperPoD液冷超节点或Atlas 800 A3风冷超节点,我们推荐你使用如下镜像进行环境部署,可跳过CANN/Pytorch/Triton环境依赖的部署环节

# 镜像链接:https://cann-ai.obs.cn-north-4.myhuaweicloud.com/cann-quantization/deepseek_train/dsv4_train_mindspeed_v1.0.tar.gz

# 创建容器

docker run -dit --ipc=host --network host --name 'llm_test' --privileged -v /usr/local/Ascend/driver:/usr/local/Ascend/driver -v /usr/local/Ascend/firmware:/usr/local/Ascend/firmware -v /usr/local/sbin/:/usr/local/sbin/ -v /home/:/home/ -v /data/:/data 镜像名:标签 /bin/bash

# 进入容器

docker exec -it llm_test bash

# 该镜像已安装CANN与自定义融合算子包,在运行训练任务前,请使能如下环境变量以正确生效算子能力

source /usr/local/Ascend/cann/set_env.sh

source /usr/local/Ascend/cann/opp/vendors/custom_transformer/bin/set_env.bash

# 安装MindSpeed加速库

git clone https://gitcode.com/ascend/MindSpeed.git

cd MindSpeed

git checkout master # checkout commit from MindSpeed master

pip3 install -r requirements.txt

pip3 install -e .

cd ..

# 准备MindSpeed-LLM及Megatron-LM源码

git clone https://gitcode.com/ascend/MindSpeed-LLM.git

git clone https://github.com/NVIDIA/Megatron-LM.git # megatron从github下载,请确保网络能访问

cd Megatron-LM

git checkout core_v0.12.1

cp -r megatron ../MindSpeed-LLM/

cd ../MindSpeed-LLM

git checkout master

pip3 install -r requirements.txt # 安装其余依赖库权重转换

1️⃣ 权重下载

下载权重和配置文件:

https://ai.gitcode.com/hf_mirrors/deepseek-ai/DeepSeek-V4-Flash

2️⃣ 权重转换

开源 DeepSeekV4-Flash 权重为 FP8 mixed 数据格式,使用 A3 训练前需要对原始权重做反量化后获得 bf16 格式的权重,反量化方法请参考下述脚本

cd MindSpeed-LLM

bash examples/mcore/deepseek4_flash/ckpt_dequant_deepseek4_fp8_to_bf16.shMindSpeed LLM 提供脚本将已经 huggingface 开源权重转换为 mcore 权重,用于训练、推理、评估等任务。

使用方法如下,请根据实际需要的 TP/PP 等切分策略和权重路径修改权重转换脚本

cd MindSpeed-LLM

bash examples/mcore/deepseek4_flash/ckpt_convert_deepseek4_flash_hf2mcore.sh # 转换时,请指定路径到反量化后的权重数据预处理

MindSpeed LLM 提供脚本 进行数据集处理

🔗 脚本地址: https://atomgit.com/Ascend/MindSpeed-LLM/tree/master/examples/mcore/deepseek4_flash

使用方法如下,请根据实际需要修改以下参数

cd MindSpeed-LLM

bash examples/mcore/deepseek4_flash/data_convert_deepseek4_pretrain.sh

训练

MindSpeed LLM 提供脚本进行模型训练

🔗 脚本地址: https://atomgit.com/Ascend/MindSpeed-LLM/tree/master/examples/mcore/deepseek4_flash

cd MindSpeed-LLM

bash examples/mcore/deepseek4_flash/pretrain_deepseek4_flash_4k_A3_ptd.sh用户需要根据实际情况修改脚本中以下变量