flowgpt 可以看不同Agent角色的 prompt

代码练习

Agent实现搜索

{% tabs Agent实现搜索 , 1 %}

配置环境,先去搞一下 API Keys

python

import os

from dotenv import load_dotenv

load_dotenv()

GOOGLE_API_KEY = os.getenv("GOOGLE_API_KEY")

os.environ["GOOGLE_API_KEY"] = GOOGLE_API_KEYload_dotenv() 作用是去找 .env 文件夹,默认先从当前文件夹找,找不到就一直向上回溯

python

from google.adk.agents import Agent

from google.adk.models.google_llm import Gemini

from google.adk.runners import InMemoryRunner

from google.adk.tools import google_search

from google.genai import types在使用大语言模型时,可能会遇到诸如速率限制或暂时性服务不可用等瞬时错误。重试选项通过使用指数退避算法重新尝试请求,从而自动处理这些故障。

python

retry_config=types.HttpRetryOptions(

attempts=5,

exp_base=7,

initial_delay=1,

http_status_codes=[429, 500, 503, 504]

)-

名称(name)和描述(description):一个简单的名称和描述来识别我们的智能体。

-

模型(model):驱动智能体推理的具体大语言模型。我们使用 "gemini-2.5-flash-lite"。

-

指令(instruction):智能体的引导提示词。这告诉智能体其目标是什么以及如何表现。

-

工具(tools):智能体可以使用的工具列表。我们为其提供 "google_search" 工具,让它可以查找网上的最新信息。

python

root_agent = Agent(

name="yhj_dog",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config,

),

description="A simple agent that can answer general questions.",

instruction="You are a helpful assistant. Use Google Search for current info or if unsure.",

tools=[google_search],

)这里只是让定义 run 起来,但是还没使用

python

runner = InMemoryRunner(agent=root_agent)

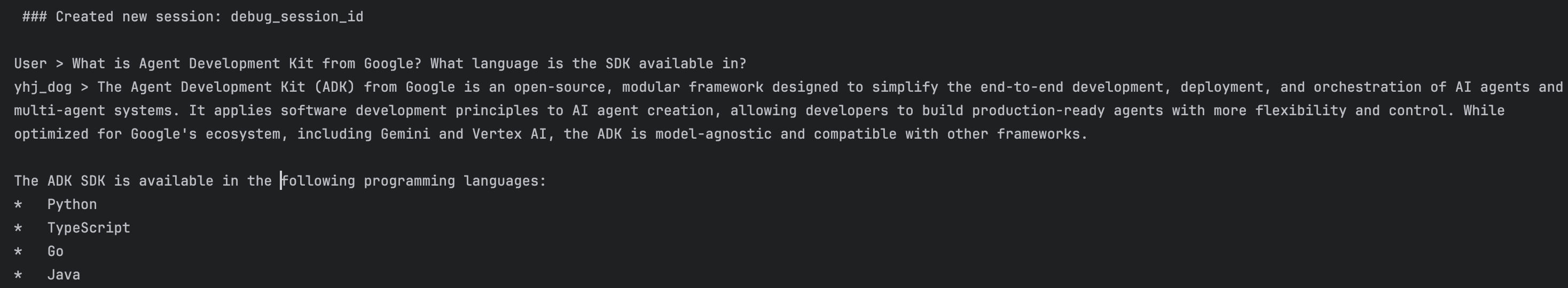

print("✅ Runner created.")提问

python

response = await runner.run_debug(

"What is Agent Development Kit from Google? What language is the SDK available in?"

)

使用互联网工具查询天气

python

response = await runner.run_debug("What's the weather in London?")

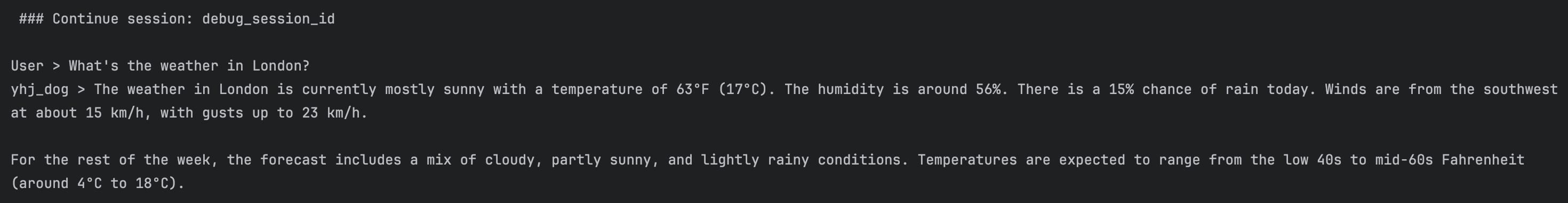

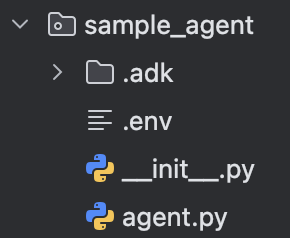

- 在命令行中导出 GOOGLE_API_KEY

bash

export GOOGLE_API_KEY=xxxx- 创建智能体

bash

adk create sample_agent --model gemini-2.5-flash-lite --api_key $GOOGLE_API_KEY

创建完智能体,它会帮我们生成一个专属的目录,以智能体名字命名,里面包含 .env(存GOOGLE_API_KEY),agent.py 用来存我们创建 agent 的代码,没什么特别的,创建完就是下面这个

python

from google.adk.agents.llm_agent import Agent

root_agent = Agent(

model='gemini-2.5-flash-lite',

name='root_agent',

description='A helpful assistant for user questions.',

instruction='Answer user questions to the best of your knowledge',

)所以,如果我们自己定义好了 agent(必须是 agent.py 文件名)以及 .env 文件夹、__init__.py,我们也可以直接使用如下命令来运行智能体。

{% note warning %}

试了一下,__init__.py 里面是否有内容,以及 __init__.py 是否存在都没影响运行。使用 adk create 创建的智能体默认带这个文件,并且默认内容是

python

from . import agent不知道什么含义

{% endnote %}

bash

adk run 文件名注意嗷,这是在命令行里面跟智能体交互,不是在 WebUI。

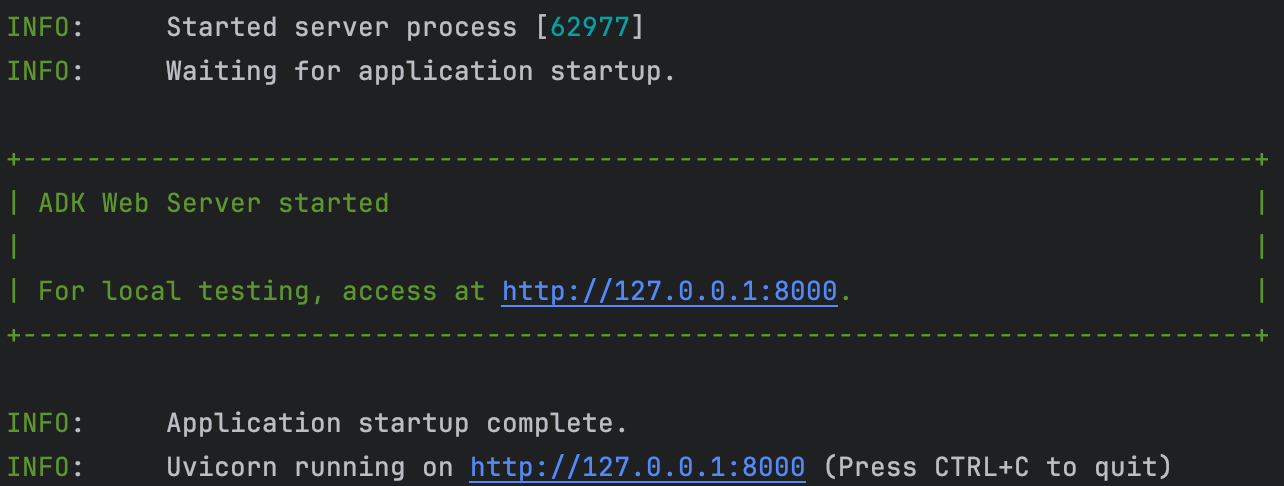

- 打开 Web UI

bash

adk web --port 8000默认在 8000 端口

界面如下

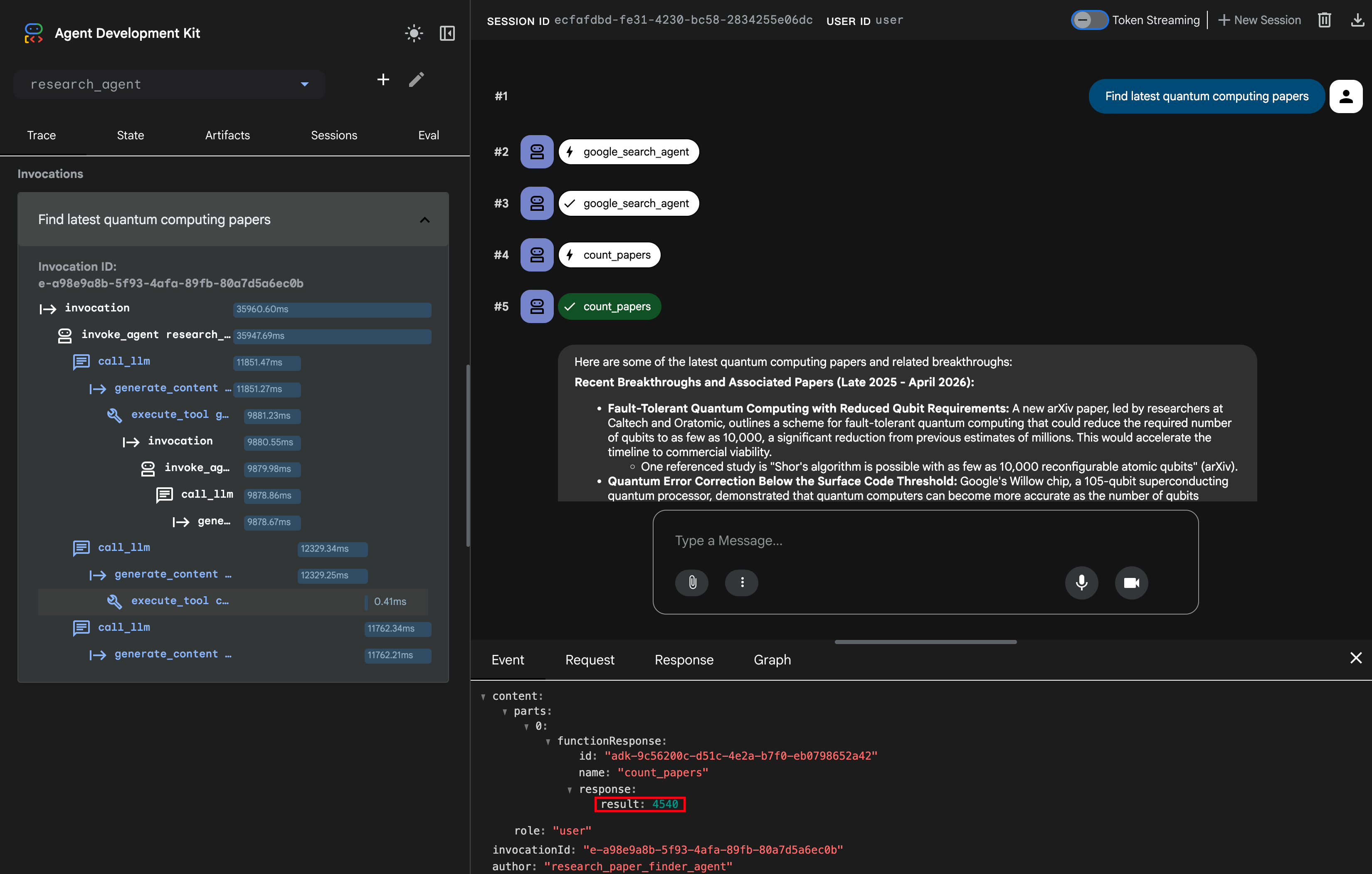

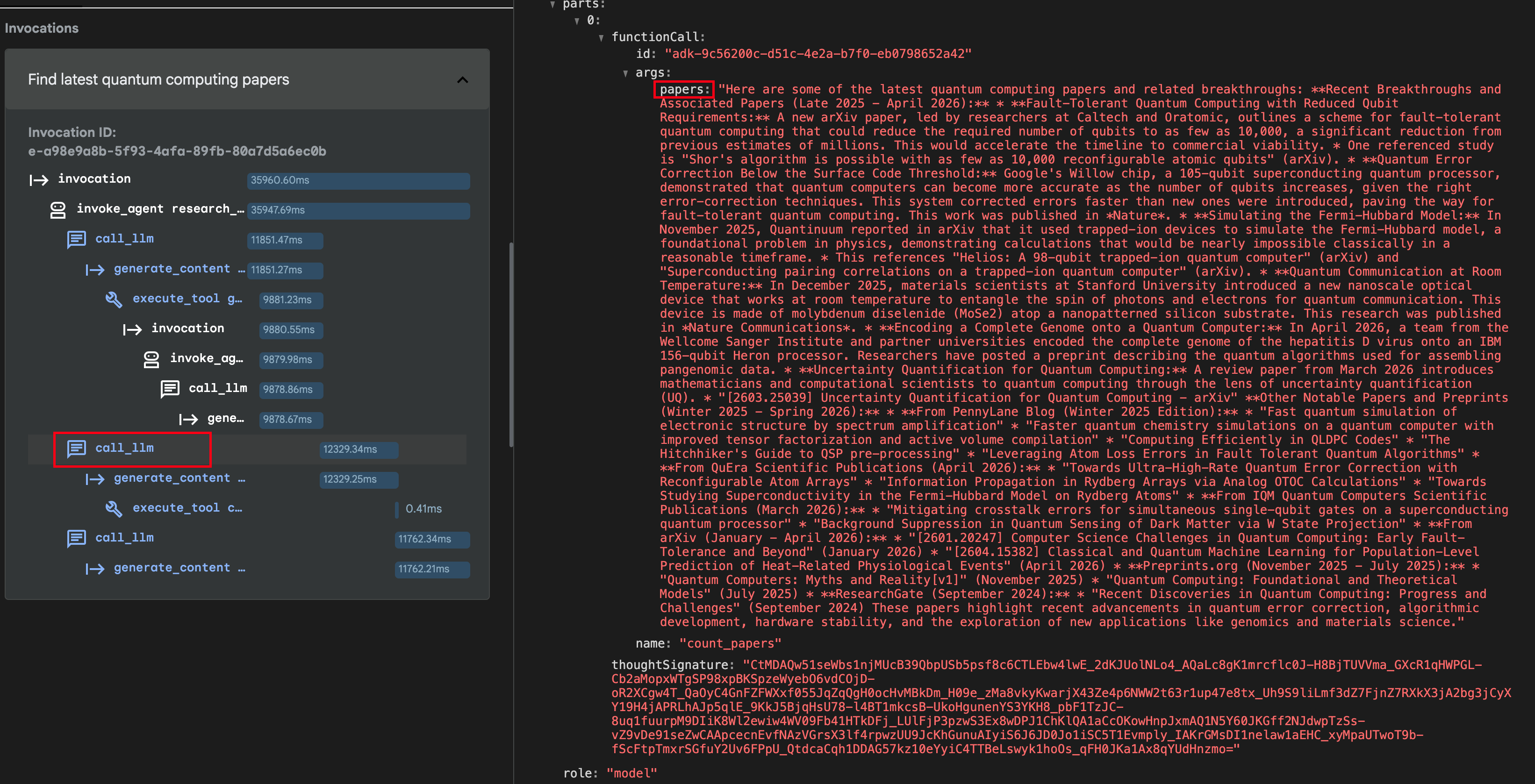

这就是在WebUI上跟智能体交互,选择了某个智能体,就相当于 run 了智能体,发送消息就代表在交互了

{% endtabs %}

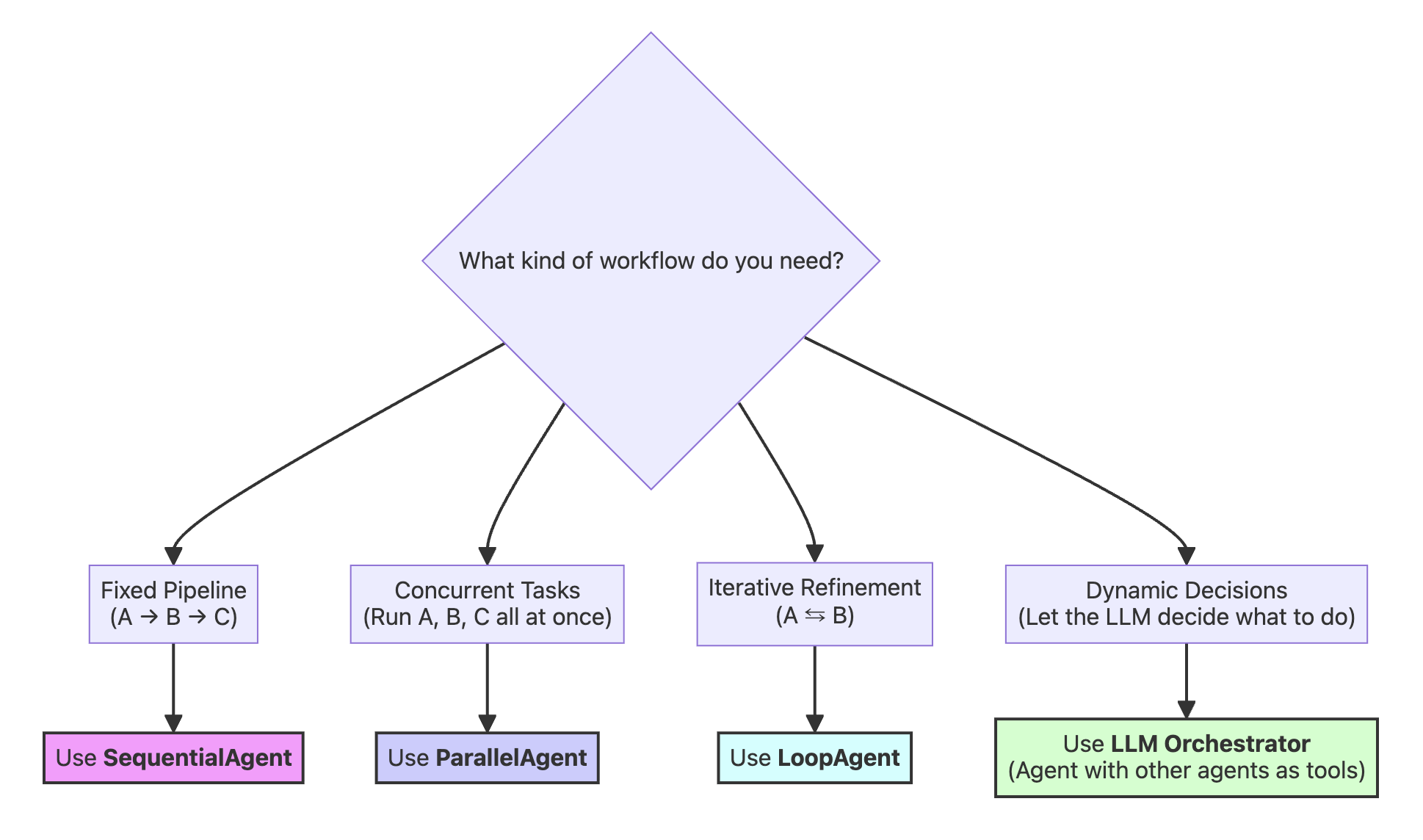

智能体架构(多智能体)

Multi-Agent System

python

import os

from dotenv import load_dotenv

load_dotenv()

GOOGLE_API_KEY = os.getenv("GOOGLE_API_KEY")

os.environ["GOOGLE_API_KEY"] = GOOGLE_API_KEY

python

from google.adk.agents import Agent, SequentialAgent, ParallelAgent, LoopAgent

from google.adk.models.google_llm import Gemini

from google.adk.runners import InMemoryRunner

from google.adk.tools import AgentTool, FunctionTool, google_search

from google.genai import types

print("✅ ADK components imported successfully.")

python

retry_config=types.HttpRetryOptions(

attempts=5, # Maximum retry attempts

exp_base=7, # Delay multiplier

initial_delay=1,

http_status_codes=[429, 500, 503, 504], # Retry on these HTTP errors

)

python

# Research Agent: Its job is to use the google_search tool and present findings.

research_agent = Agent(

name="ResearchAgent",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

instruction="""You are a specialized research agent. Your only job is to use the google_search tool

to find 2-3 pieces of relevant information on the given topic and present the findings with citations.

""",

tools=[google_search],

output_key="research_findings", # The result of this agent will be stored in the session state with this key.

)

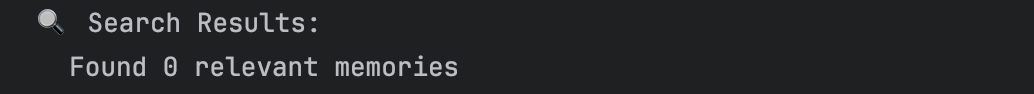

print("✅ research_agent created.")instruction 参数是塑造 LlmAgent 行为最关键的因素。它是一个字符串(或返回字符串的函数),用于告知智能体:

- 其核心任务或目标。

- 其性格或角色(例如,"你是一个得力的助手","你是一个机智的海盗")。

- 对其行为的约束(例如,"仅回答关于 X 的问题","绝不透露 Y")。

- 如何以及何时使用其工具(

tools)。应该解释每个工具的用途以及调用它们的环境背景,作为对工具自身描述的补充。 - 期望的输出格式(例如,"以 JSON 格式响应","提供一个无序列表")。

编写有效指令的技巧:

- 清晰且具体:避免含糊不清。清晰地阐述预期的行动和结果。

- 使用 Markdown:通过标题、列表等方式提高复杂指令的可读性。

- 提供示例 (Few-Shot):对于复杂的任务或特定的输出格式,直接在指令中包含示例。

- 引导工具使用:不要只是列出工具;要解释智能体应该在"何时"以及"为何"使用它们。

状态 (State):

- 指令是一个字符串模板,可以使用

{var}语法将动态数值插入到指令中。 {var}用于插入名为var的状态变量的值。{artifact.var}用于插入名为var的产出物(artifact)的文本内容。- 如果状态变量或产出物不存在,智能体将报错。如果你想忽略该错误,可以在变量名后添加一个

?,例如{var?}。

guiding agents with clear and specific instructions

python

# Summarizer Agent: Its job is to summarize the text it receives.

summarizer_agent = Agent(

name="SummarizerAgent",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

# The instruction is modified to request a bulleted list for a clear output format.

instruction="""Read the provided research findings: {research_findings}

Create a concise summary as a bulleted list with 3-5 key points.""",

output_key="final_summary",

)

print("✅ summarizer_agent created.")

python

# Root Coordinator: Orchestrates the workflow by calling the sub-agents as tools.

root_agent = Agent(

name="ResearchCoordinator",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

# This instruction tells the root agent HOW to use its tools (which are the other agents).

instruction="""You are a research coordinator. Your goal is to answer the user's query by orchestrating a workflow.

1. First, you MUST call the `ResearchAgent` tool to find relevant information on the topic provided by the user.

2. Next, after receiving the research findings, you MUST call the `SummarizerAgent` tool to create a concise summary.

3. Finally, present the final summary clearly to the user as your response.""",

# We wrap the sub-agents in `AgentTool` to make them callable tools for the root agent.

tools=[AgentTool(research_agent), AgentTool(summarizer_agent)],

)

print("✅ root_agent created.")这里用 AgentTool 来包装子智能体,让它们成为根智能体能调用的工具。

测试

python

runner = InMemoryRunner(agent=root_agent)

response = await runner.run_debug(

"What are the latest advancements in quantum computing and what do they mean for AI?"

){% note warning %}

但是仅依靠大语言模型的指令来控制顺序有时是不可预测的。接下来,介绍一种能够确保按步执行的替代模式。

{% endnote %}

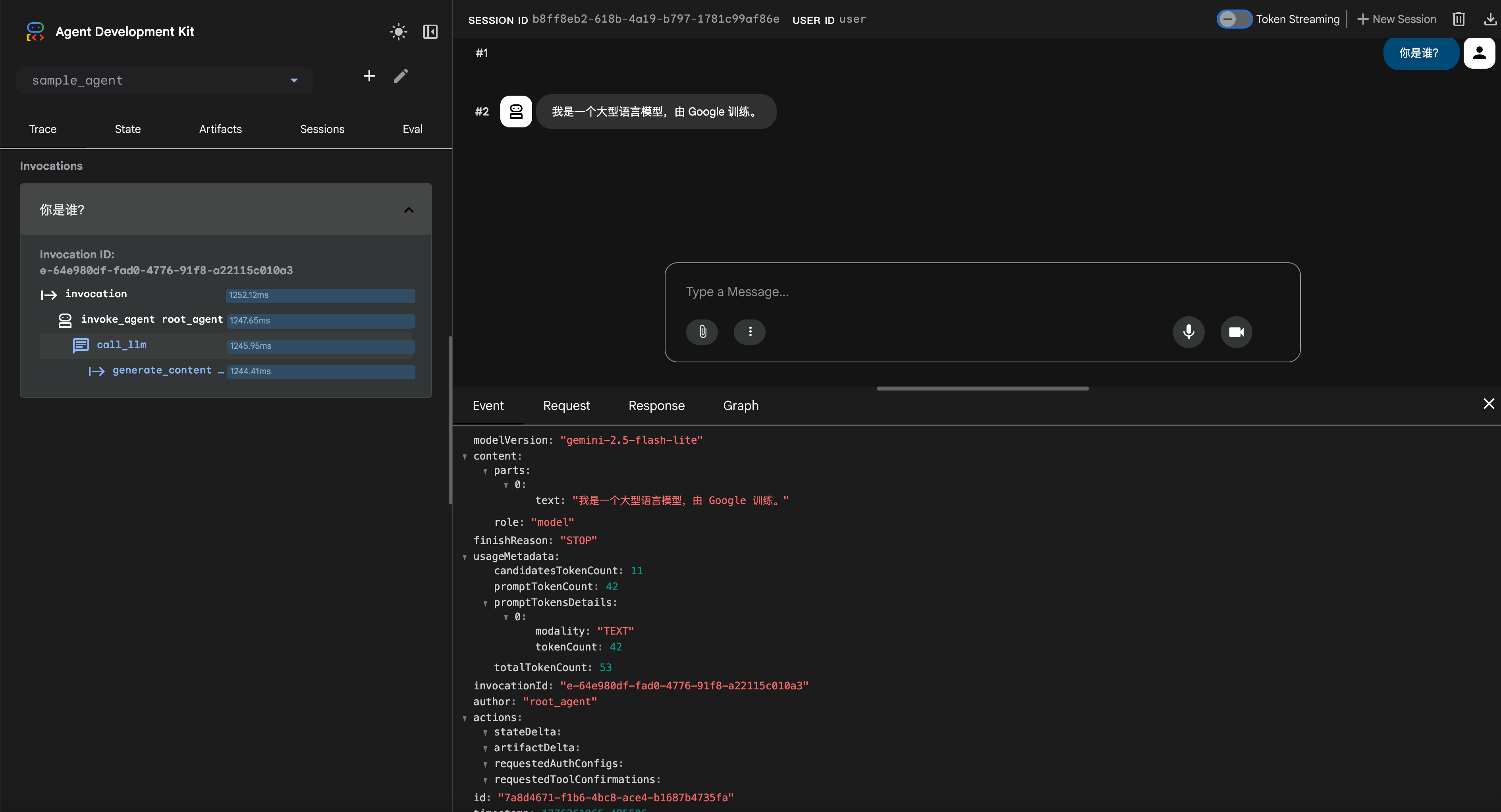

Sequential Workflows

{% note red 'fas fa-question-circle' simple %}

问题:不可预测的执行顺序

之前的多智能体系统依赖详细的指令提示词(detailed instruction prompt)来强制大语言模型按顺序执行。这种方式并不可靠,复杂的大语言模型可能会跳过步骤、乱序执行或陷入停滞,导致流程不可控。

{% endnote %}

{% note success simple %}

解决方案:固定流水线(Fixed Pipeline)

当任务需要保证特定执行顺序时,可使用 SequentialAgent。该智能体类似于流水线,按照定义的顺序运行子智能体。上一个智能体的输出会自动成为下一个智能体的输入,从而创建一个可预测且可靠的工作流。

{% endnote %}

适用场景:执行顺序至关重要。需要线性流水线。每个步骤都建立在后续步骤的基础之上。

架构示例:博客文章创建流水线

该系统由三个专业智能体组成:

- 大纲智能体 (Outline Agent):根据给定主题创建博客大纲。

- 写作智能体 (Writer Agent):撰写博客正文。

- 编辑智能体 (Editor Agent):针对清晰度和结构对博客草稿进行编辑。

python

# Outline Agent: Creates the initial blog post outline.

outline_agent = Agent(

name="OutlineAgent",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

instruction="""Create a blog outline for the given topic with:

1. A catchy headline

2. An introduction hook

3. 3-5 main sections with 2-3 bullet points for each

4. A concluding thought""",

output_key="blog_outline", # The result of this agent will be stored in the session state with this key.

)

print("✅ outline_agent created.")

# Writer Agent: Writes the full blog post based on the outline from the previous agent.

writer_agent = Agent(

name="WriterAgent",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

# The `{blog_outline}` placeholder automatically injects the state value from the previous agent's output.

instruction="""Following this outline strictly: {blog_outline}

Write a brief, 200 to 300-word blog post with an engaging and informative tone.""",

output_key="blog_draft", # The result of this agent will be stored with this key.

)

print("✅ writer_agent created.")

# Editor Agent: Edits and polishes the draft from the writer agent.

editor_agent = Agent(

name="EditorAgent",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

# This agent receives the `{blog_draft}` from the writer agent's output.

instruction="""Edit this draft: {blog_draft}

Your task is to polish the text by fixing any grammatical errors, improving the flow and sentence structure, and enhancing overall clarity.""",

output_key="final_blog", # This is the final output of the entire pipeline.

)

print("✅ editor_agent created.")在运行的时候我们放入一个列表,从前往后代表顺序

python

root_agent = SequentialAgent(

name="BlogPipeline",

sub_agents=[outline_agent, writer_agent, editor_agent],

)

print("✅ Sequential Agent created.")之后给指令运行

python

runner = InMemoryRunner(agent=root_agent)

response = await runner.run_debug(

"Write a blog post about the benefits of multi-agent systems for software developers"

){% note warning %}

但是如果任务之间是独立的,这样跑就很慢了

{% endnote %}

接下来介绍怎么在同一时间跑多个智能体

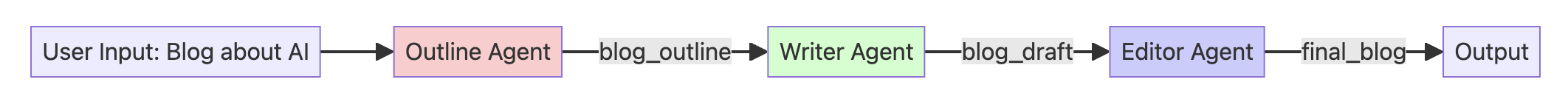

Parallel Workflows - Independent Researchers

{% note red 'fas fa-question-circle' simple %}

问题:效率瓶颈

传统的顺序执行模式(Sequential)类似于流水线,每个步骤必须等待前一步完成。当多个任务彼此互不依赖时(例如同时研究三个不同的主题),按顺序运行会导致速度缓慢且效率低下,造成不必要的等待瓶颈。

{% endnote %}

{% note success %}

解决方案:并发执行(Concurrent Execution)

处理独立任务时,可以使用 ParallelAgent 同时运行所有任务。该智能体能够并发执行其所有的子智能体,从而显著加快工作流程。当所有并行任务完成后,可以将它们的合并结果传递给最终的"聚合(aggregator)"步骤。

{% endnote %}

适用场景:任务之间相互独立。对处理速度有较高要求。可以进行并发执行。

架构示例:多主题研究系统

该系统由四个智能体组成:

- 技术研究员 (Tech Researcher):研究 AI/ML 的新闻和趋势。

- 健康研究员 (Health Researcher):研究最新的医学新闻和趋势。

- 金融研究员 (Finance Researcher):研究金融和金融科技的新闻和趋势。

- 聚合智能体 (Aggregator Agent):将所有研究发现整合为一份综合摘要。

python

# Tech Researcher: Focuses on AI and ML trends.

tech_researcher = Agent(

name="TechResearcher",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

instruction="""Research the latest AI/ML trends. Include 3 key developments,

the main companies involved, and the potential impact. Keep the report very concise (100 words).""",

tools=[google_search],

output_key="tech_research", # The result of this agent will be stored in the session state with this key.

)

print("✅ tech_researcher created.")

# Health Researcher: Focuses on medical breakthroughs.

health_researcher = Agent(

name="HealthResearcher",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

instruction="""Research recent medical breakthroughs. Include 3 significant advances,

their practical applications, and estimated timelines. Keep the report concise (100 words).""",

tools=[google_search],

output_key="health_research", # The result will be stored with this key.

)

print("✅ health_researcher created.")

# Finance Researcher: Focuses on fintech trends.

finance_researcher = Agent(

name="FinanceResearcher",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

instruction="""Research current fintech trends. Include 3 key trends,

their market implications, and the future outlook. Keep the report concise (100 words).""",

tools=[google_search],

output_key="finance_research", # The result will be stored with this key.

)

print("✅ finance_researcher created.")

# The AggregatorAgent runs *after* the parallel step to synthesize the results.

aggregator_agent = Agent(

name="AggregatorAgent",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

# It uses placeholders to inject the outputs from the parallel agents, which are now in the session state.

instruction="""Combine these three research findings into a single executive summary:

**Technology Trends:**

{tech_research}

**Health Breakthroughs:**

{health_research}

**Finance Innovations:**

{finance_research}

Your summary should highlight common themes, surprising connections, and the most important key takeaways from all three reports. The final summary should be around 200 words.""",

output_key="executive_summary", # This will be the final output of the entire system.

)

print("✅ aggregator_agent created.")先把上面这些智能体放在并行智能体中,然后并行智能体本身又嵌套在顺序智能体内部,确保研究类智能体所有研究全部完成后,将所有研究发现整合成为单一报告

python

# The ParallelAgent runs all its sub-agents simultaneously.

parallel_research_team = ParallelAgent(

name="ParallelResearchTeam",

sub_agents=[tech_researcher, health_researcher, finance_researcher],

)

# This SequentialAgent defines the high-level workflow: run the parallel team first, then run the aggregator.

root_agent = SequentialAgent(

name="ResearchSystem",

sub_agents=[parallel_research_team, aggregator_agent],

)

print("✅ Parallel and Sequential Agents created.")

runner = InMemoryRunner(agent=root_agent)

response = await runner.run_debug(

"Run the daily executive briefing on Tech, Health, and Finance"

){% note warning %}

目前的工作流均为线性(从开始到结束)。若需要多次审查和改进输出,则需要构建能够**循环(loop)并持续优化(refine)**自身工作的结果

{% endnote %}

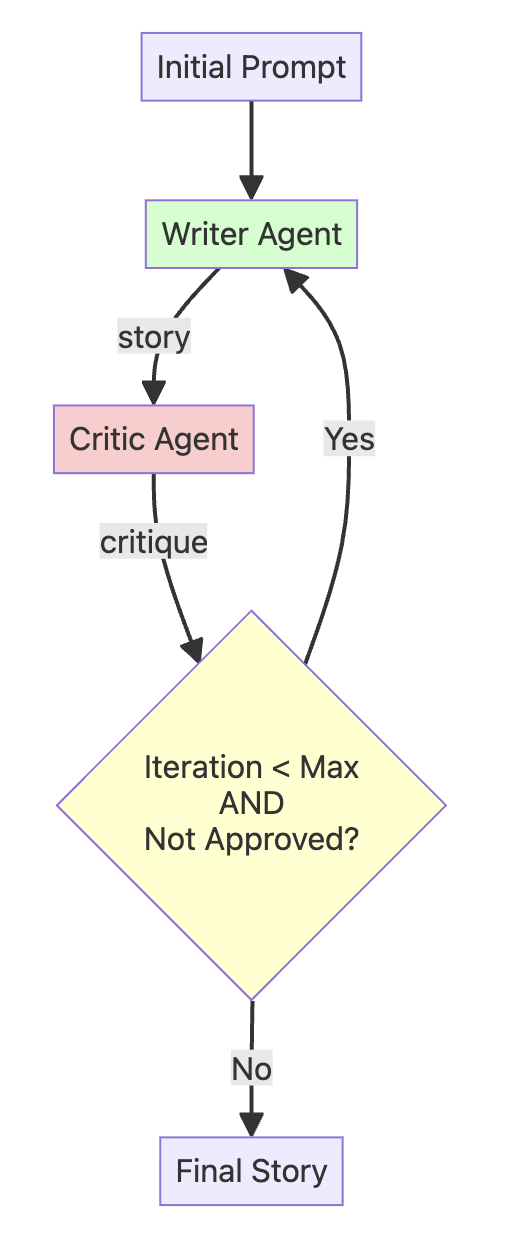

Loop Workflows - The Refinement Cycle

{% note red 'fas fa-question-circle' simple %}

问题:单次生成(One-Shot)的质量问题

目前为止看到的工作流都是从开始运行到结束即停止。SequentialAgent(顺序智能体)和 ParallelAgent(并行智能体)在生成最终输出后就会关闭。这种"单次触发"的方法不适用于需要打磨和质量控制的任务。如果初稿质量不佳,系统无法对其进行审查或要求重写。

{% endnote %}

{% note success simple %}

解决方案:迭代优化(Iterative Refinement)

当任务需要通过反馈和修订循环来改进时,可以使用 LoopAgent。LoopAgent 会重复运行一组子智能体,直到满足特定条件或达到最大迭代次数为止。这创建了一个优化循环,允许智能体系统不断改进自身的工作结果。

{% endnote %}

架构:故事创作与批评循环

python

# This agent runs ONCE at the beginning to create the first draft.

initial_writer_agent = Agent(

name="InitialWriterAgent",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

instruction="""Based on the user's prompt, write the first draft of a short story (around 100-150 words).

Output only the story text, with no introduction or explanation.""",

output_key="current_story", # Stores the first draft in the state.

)

print("✅ initial_writer_agent created.")

# This agent's only job is to provide feedback or the approval signal. It has no tools.

critic_agent = Agent(

name="CriticAgent",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

instruction="""You are a constructive story critic. Review the story provided below.

Story: {current_story}

Evaluate the story's plot, characters, and pacing.

- If the story is well-written and complete, you MUST respond with the exact phrase: "APPROVED"

- Otherwise, provide 2-3 specific, actionable suggestions for improvement.""",

output_key="critique", # Stores the feedback in the state.

)

print("✅ critic_agent created.")现在,需要一种方法让循环根据评论者的反馈实际停止。LoopAgent 本身并不会自动理解 APPROVED 意味着 "停止"。

我们需要一个代理给它一个明确的信号来终止循环。

我们分两部分来完成:

- 一个简单的

Python函数,LoopAgent将其理解为 "退出" 信号。 - 一个能在满足正确条件时调用该函数的代理。

首先,定义 exit_loop 函数:

python

# This is the function that the RefinerAgent will call to exit the loop.

def exit_loop():

"""Call this function ONLY when the critique is 'APPROVED', indicating the story is finished and no more changes are needed."""

return {"status": "approved", "message": "Story approved. Exiting refinement loop."}

print("✅ exit_loop function created.")为了让代理能够调用这个 Python 函数,我们将其封装在一个 FunctionTool 中。然后,我们创建一个拥有该工具的 RefinerAgent。

👉 请注意其指令: 该代理是循环的"大脑"。它读取来自 CriticAgent 的 {critique}(评论),并决定是 (1) 调用 exit_loop 工具,还是 (2) 重写故事。

python

# This agent refines the story based on critique OR calls the exit_loop function.

refiner_agent = Agent(

name="RefinerAgent",

model=Gemini(

model="gemini-2.5-flash-lite",

retry_options=retry_config

),

instruction="""You are a story refiner. You have a story draft and critique.

Story Draft: {current_story}

Critique: {critique}

Your task is to analyze the critique.

- IF the critique is EXACTLY "APPROVED", you MUST call the `exit_loop` function and nothing else.

- OTHERWISE, rewrite the story draft to fully incorporate the feedback from the critique.""",

output_key="current_story", # It overwrites the story with the new, refined version.

tools=[

FunctionTool(exit_loop)

], # The tool is now correctly initialized with the function reference.

)

print("✅ refiner_agent created.")然后我们将这些代理统一置于一个循环代理(Loop Agent)之下,循环代理本身又嵌套在一个顺序代理(Sequential Agent)中。

这种设计确保了系统首先生成初始故事草稿,随后精炼循环将按照指定的 max_iterations(最大迭代次数)运行:

python

# The LoopAgent contains the agents that will run repeatedly: Critic -> Refiner.

story_refinement_loop = LoopAgent(

name="StoryRefinementLoop",

sub_agents=[critic_agent, refiner_agent],

max_iterations=2, # Prevents infinite loops

)

# The root agent is a SequentialAgent that defines the overall workflow: Initial Write -> Refinement Loop.

root_agent = SequentialAgent(

name="StoryPipeline",

sub_agents=[initial_writer_agent, story_refinement_loop],

)

print("✅ Loop and Sequential Agents created.")

python

runner = InMemoryRunner(agent=root_agent)

response = await runner.run_debug(

"Write a short story about a lighthouse keeper who discovers a mysterious, glowing map"

)总结

| 模式 | 何时使用 | 示例 | 核心特性 |

|---|---|---|---|

| 基于 LLM (sub_agents) | 需要动态编排时 | 研究 + 总结 | 由 LLM 决定调用内容 |

| 顺序 (Sequential) | 顺序很重要,线性管道 | 大纲 → 写作 → 编辑 | 确定性的顺序 |

| 并行 (Parallel) | 任务相互独立,速度至关重要 | 多主题研究 | 并发执行 |

| 循环 (Loop) | 需要迭代改进时 | 作者 + 评论家精炼 | 重复循环 |

- 基于 LLM(sub_agents):比如上面的

refiner_agent

智能体工具

🤔 智能体为何需要工具?

{% note red 'fas fa-question-circle' simple %}

问题所在:若没有工具,智能体的知识便会停滞不前 ------ 无法获取当日新闻或你公司的库存信息。它与外部世界毫无联结,因此无法为你执行任何操作。

{% endnote %}

{% note success %}

解决方案:工具能将孤立的大语言模型转变为实用的智能体,切实帮你完成各类事务。

{% endnote %}

下面我们将做

- 将 Python 函数转化为智能体工具

- 构建一个智能体,并将其作为工具供另一个智能体使用

- 打造你的首个多工具智能体

- 探究智能体开发工具包(ADK)中的各类工具类型

自定义工具

{% tabs AgentTools_a , 1 %}

python

import os

from dotenv import load_dotenv

from google.genai import types

from google.adk.agents import LlmAgent

from google.adk.models.google_llm import Gemini

from google.adk.runners import InMemoryRunner

from google.adk.sessions import InMemorySessionService

from google.adk.tools import google_search, AgentTool, ToolContext

from google.adk.code_executors import BuiltInCodeExecutor

load_dotenv(override=True)

GOOGLE_API_KEY = os.getenv("GOOGLE_API_KEY")

os.environ["GOOGLE_API_KEY"] = GOOGLE_API_KEY

retry_config = types.HttpRetryOptions(

attempts=5, # Maximum retry attempts

exp_base=7, # Delay multiplier

initial_delay=1,

http_status_codes=[429, 500, 503, 504], # Retry on these HTTP errors

)辅助函数,用于输出生成的 Python 代码以及代码执行工具返回的结果:

python

def show_python_code_and_result(response):

for i in range(len(response)):

# Check if the response contains a valid function call result from the code executor

if (

(response[i].content.parts)

and (response[i].content.parts[0])

and (response[i].content.parts[0].function_response)

and (response[i].content.parts[0].function_response.response)

):

response_code = response[i].content.parts[0].function_response.response

if "result" in response_code and response_code["result"] != "```":

if "tool_code" in response_code["result"]:

print(

"Generated Python Code >> ",

response_code["result"].replace("tool_code", ""),

)

else:

print("Generated Python Response >> ", response_code["result"])

print("✅ Helper functions defined."){% note red 'fas fa-question-circle' simple %}

什么是自定义工具?

自定义工具是指利用自有代码和业务逻辑自行构建的工具。与 ADK 自带的预制内置工具不同,自定义工具能让你完全掌控功能实现。

{% endnote %}

{% note red 'fas fa-question-circle' simple %}

何时使用自定义工具?

谷歌搜索这类内置工具功能强大,但每家企业都有通用工具无法满足的独特需求。自定义工具可用于实现专属业务逻辑、对接自有系统,并解决特定领域的问题。ADK 提供多种自定义工具类型以应对这类场景。

{% endnote %}

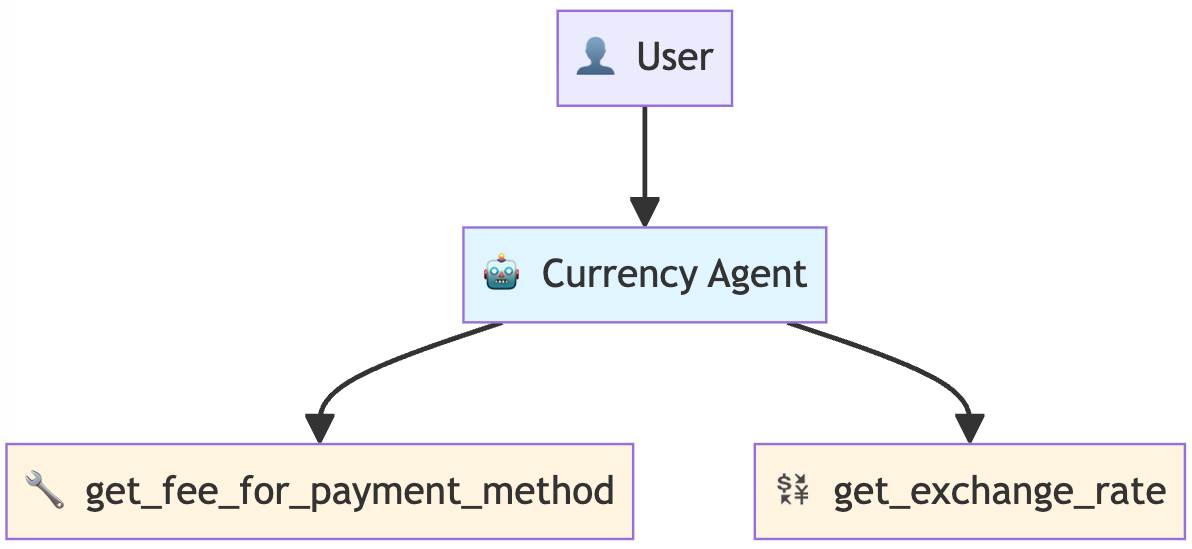

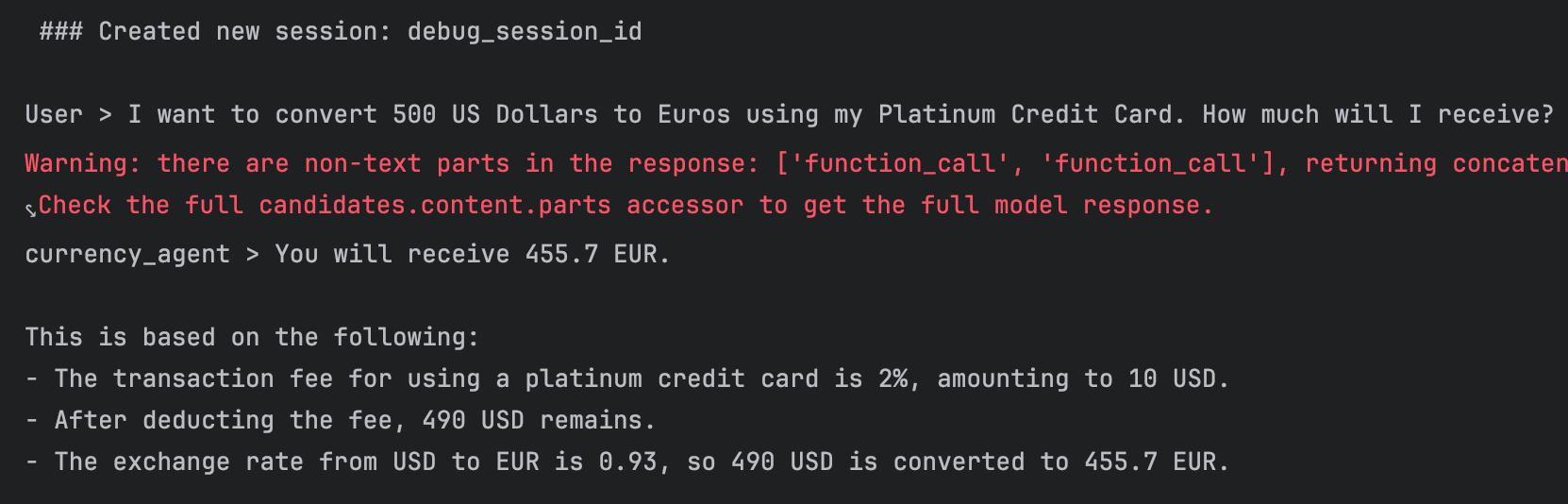

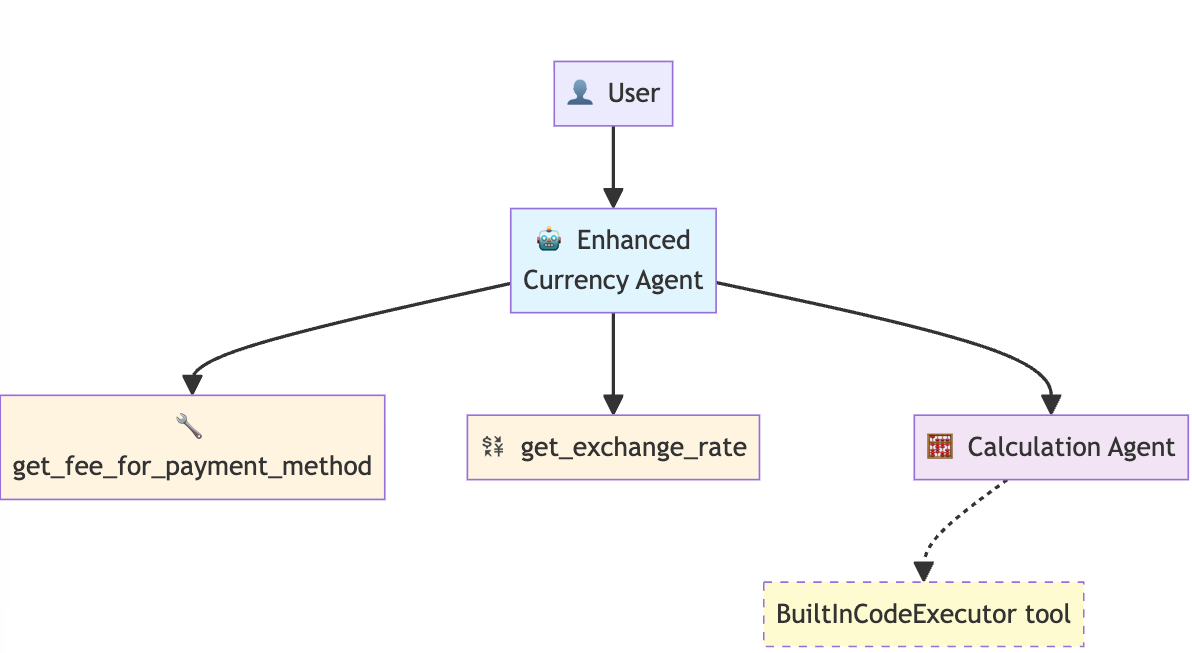

示例:构建自定义功能工具 --> 货币兑换智能体

该智能体可实现不同币种间的兑换,并计算兑换所需手续费。智能体包含两个自定义工具,执行流程如下:

- 手续费查询工具 ------ 查询兑换交易手续费(模拟数据)

- 汇率工具 ------ 获取货币兑换汇率(模拟数据)

- 计算步骤 ------ 核算包含手续费在内的总兑换成本

{% note red 'fas fa-question-circle' simple %}

如何定义一个工具?

只需遵循以下简单准则,任意 Python 函数都能成为智能体工具:

- 创建一个 Python 函数

- 遵循下方列出的最佳实践

- 将你的函数添加到智能体的 tools=\[\] 列表中,其余工作将由 ADK 自动处理。

实践中的 ADK 最佳实践

- 字典返回值:工具返回 {"status": "success", "data": ...} 或 {"status": "error", "error_message": ...}

- 清晰的文档字符串:大语言模型通过文档字符串判断何时以及如何使用工具

- 类型注解:使 ADK 能够生成规范的模式结构(字符串、字典等)

- 错误处理:结构化的错误响应有助于大语言模型妥善处理执行失败情况

这些模式能让你的工具更可靠,也便于大语言模型正确使用。

{% endnote %}

python

# Pay attention to the docstring, type hints, and return value.

def get_fee_for_payment_method(method: str) -> dict:

"""Looks up the transaction fee percentage for a given payment method.

This tool simulates looking up a company's internal fee structure based on

the name of the payment method provided by the user.

Args:

method: The name of the payment method. It should be descriptive,

e.g., "platinum credit card" or "bank transfer".

Returns:

Dictionary with status and fee information.

Success: {"status": "success", "fee_percentage": 0.02}

Error: {"status": "error", "error_message": "Payment method not found"}

"""

# This simulates looking up a company's internal fee structure.

fee_database = {

"platinum credit card": 0.02, # 2%

"gold debit card": 0.035, # 3.5%

"bank transfer": 0.01, # 1%

}

fee = fee_database.get(method.lower())

if fee is not None:

return {"status": "success", "fee_percentage": fee}

else:

return {

"status": "error",

"error_message": f"Payment method '{method}' not found",

}

print("✅ Fee lookup function created")

print(f"💳 Test: {get_fee_for_payment_method('platinum credit card')}")然后我们遵循同样的最佳实践来定义第二个工具 get_exchange_rate

python

def get_exchange_rate(base_currency: str, target_currency: str) -> dict:

"""Looks up and returns the exchange rate between two currencies.

Args:

base_currency: The ISO 4217 currency code of the currency you

are converting from (e.g., "USD").

target_currency: The ISO 4217 currency code of the currency you

are converting to (e.g., "EUR").

Returns:

Dictionary with status and rate information.

Success: {"status": "success", "rate": 0.93}

Error: {"status": "error", "error_message": "Unsupported currency pair"}

"""

# Static data simulating a live exchange rate API

# In production, this would call something like: requests.get("api.exchangerates.com")

rate_database = {

"usd": {

"eur": 0.93, # Euro

"jpy": 157.50, # Japanese Yen

"inr": 83.58, # Indian Rupee

}

}

# Input validation and processing

base = base_currency.lower()

target = target_currency.lower()

# Return structured result with status

rate = rate_database.get(base, {}).get(target)

if rate is not None:

return {"status": "success", "rate": rate}

else:

return {

"status": "error",

"error_message": f"Unsupported currency pair: {base_currency}/{target_currency}",

}

print("✅ Exchange rate function created")

print(f"💱 Test: {get_exchange_rate('USD', 'EUR')}")现在我们来创建货币代理。注意:代理的指令 instruction 是如何引用这些工具的

要点:

tools=[]列表用于告知代理可以使用哪些函数- 指令通过工具确切的函数名来引用它们(例如

get_fee_for_payment_method()) - 代理会依据这些名称来决定何时以及如何调用各个工具

python

# Currency agent with custom function tools

currency_agent = LlmAgent(

name="currency_agent",

model=Gemini(model="gemini-2.5-flash-lite", retry_options=retry_config),

instruction="""You are a smart currency conversion assistant.

For currency conversion requests:

1. Use `get_fee_for_payment_method()` to find transaction fees

2. Use `get_exchange_rate()` to get currency conversion rates

3. Check the "status" field in each tool's response for errors

4. Calculate the final amount after fees based on the output from `get_fee_for_payment_method` and `get_exchange_rate` methods and provide a clear breakdown.

5. First, state the final converted amount.

Then, explain how you got that result by showing the intermediate amounts. Your explanation must include: the fee percentage and its

value in the original currency, the amount remaining after the fee, and the exchange rate used for the final conversion.

If any tool returns status "error", explain the issue to the user clearly.

""",

tools=[get_fee_for_payment_method, get_exchange_rate],

)

print("✅ Currency agent created with custom function tools")

print("🔧 Available tools:")

print(" • get_fee_for_payment_method - Looks up company fee structure")

print(" • get_exchange_rate - Gets current exchange rates")

python

# Test the currency agent

currency_runner = InMemoryRunner(agent=currency_agent)

_ = await currency_runner.run_debug(

"I want to convert 500 US Dollars to Euros using my Platinum Credit Card. How much will I receive?"

)

{% endtabs %}

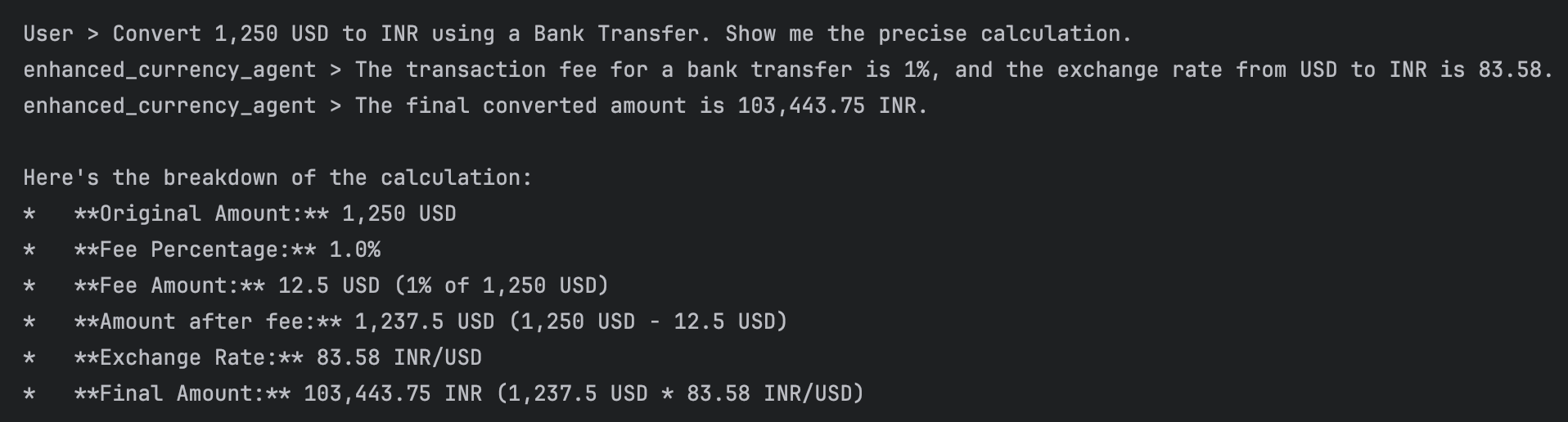

通过代码提升智能体可靠性

智能体的指令要求 "计算扣除费用后的最终金额",但大语言模型在数学计算方面并非始终可靠。它们可能出现计算错误,或是使用不一致的计算公式。

{% note success %}

解决方案:让智能体生成一段 Python 代码来完成数学运算,并运行代码得出最终结果!代码执行远比让大语言模型直接心算数学问题更加可靠!

{% endnote %}

{% tabs 通过代码提升智能体可靠性 , 1 %}

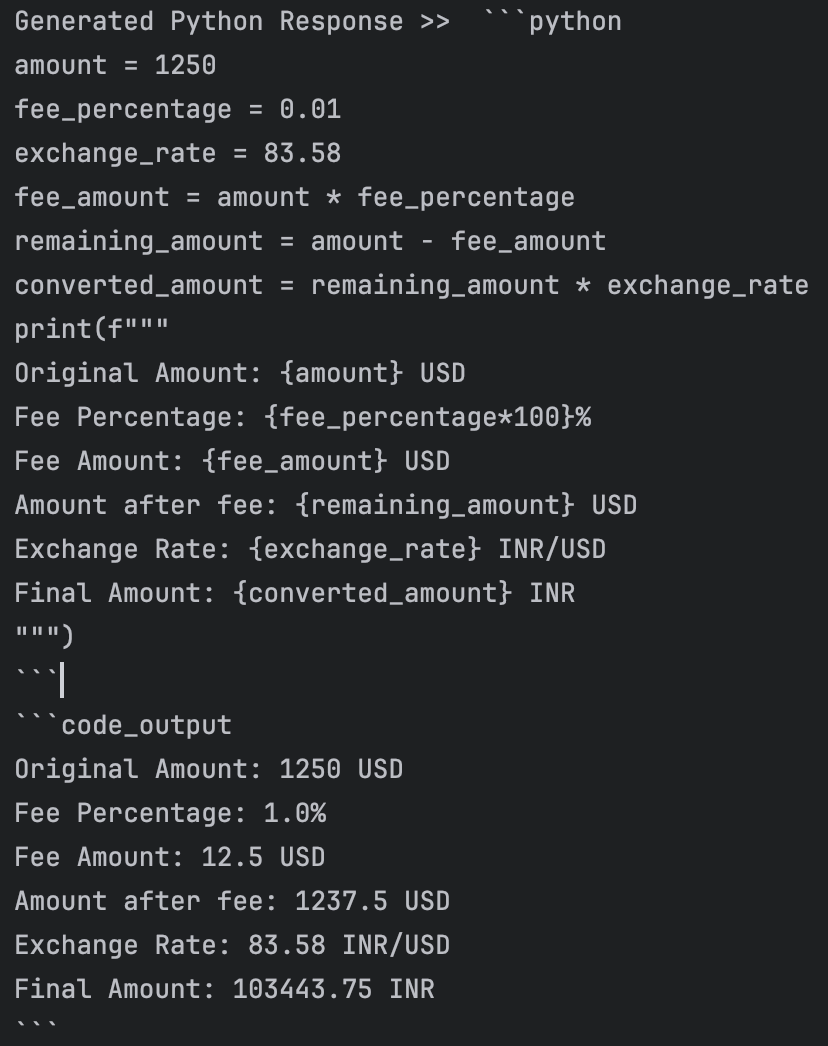

ADK 内置了一款可在沙箱环境中运行代码的代码执行器。注意:该功能依托 Gemini 的代码执行能力实现。下面我们创建一个 calculation_agent,它接收计算请求并翻译为 Python 代码,然后通过 BuiltInCodeExecutor 运行该代码。

python

calculation_agent = LlmAgent(

name="CalculationAgent",

model=Gemini(model="gemini-2.5-flash-lite", retry_options=retry_config),

instruction="""You are a specialized calculator that ONLY responds with Python code. You are forbidden from providing any text, explanations, or conversational responses.

Your task is to take a request for a calculation and translate it into a single block of Python code that calculates the answer.

**RULES:**

1. Your output MUST be ONLY a Python code block.

2. Do NOT write any text before or after the code block.

3. The Python code MUST calculate the result.

4. The Python code MUST print the final result to stdout.

5. You are PROHIBITED from performing the calculation yourself. Your only job is to generate the code that will perform the calculation.

Failure to follow these rules will result in an error.

""",

code_executor=BuiltInCodeExecutor(), # Use the built-in Code Executor Tool. This gives the agent code execution capabilities

){% note danger %}

官方文档描述有严重错误,官方描述是货币智能体来生成代码给计算智能体,但实际上是货币智能体只传入了信息,计算智能体在生成代码并执行得到结果。

{% endnote %}

执行两项关键操作:

- 更新

currency_agent的指令,使其调用工具计算金额

- 原指令:"计算扣除手续费后的最终金额"(模糊的数学计算指令)

- 优化后:调用

calculation_agent生成一段 Python 代码以计算最终金额 并运行该代码得到计算结果

- 将

calculation_agent添加至工具集

ADK 支持通过AgentTool将任意智能体作为工具使用。

- 将

AgentTool(agent=calculation_agent)添加到工具列表中 - 该专业智能体将作为可调用工具,供根智能体使用

python

enhanced_currency_agent = LlmAgent(

name="enhanced_currency_agent",

model=Gemini(model="gemini-2.5-flash-lite", retry_options=retry_config),

# Updated instruction

instruction="""You are a smart currency conversion assistant. You must strictly follow these steps and use the available tools.

For any currency conversion request:

1. Get Transaction Fee: Use the get_fee_for_payment_method() tool to determine the transaction fee.

2. Get Exchange Rate: Use the get_exchange_rate() tool to get the currency conversion rate.

3. Error Check: After each tool call, you must check the "status" field in the response. If the status is "error", you must stop and clearly explain the issue to the user.

4. Calculate Final Amount (CRITICAL): You are strictly prohibited from performing any arithmetic calculations yourself. You must use the calculation_agent tool to generate Python code that calculates the final converted amount. This

code will use the fee information from step 1 and the exchange rate from step 2.

5. Provide Detailed Breakdown: In your summary, you must:

* State the final converted amount.

* Explain how the result was calculated, including:

* The fee percentage and the fee amount in the original currency.

* The amount remaining after deducting the fee.

* The exchange rate applied.

""",

tools=[

get_fee_for_payment_method,

get_exchange_rate,

AgentTool(agent=calculation_agent), # Using another agent as a tool!

],

)

print("✅ Enhanced currency agent created")

print("🎯 New capability: Delegates calculations to specialist agent")

print("🔧 Tool types used:")

print(" • Function Tools (fees, rates)")

print(" • Agent Tool (calculation specialist)")

python

# Define a runner

enhanced_runner = InMemoryRunner(agent=enhanced_currency_agent)

# Test the enhanced agent

response = await enhanced_runner.run_debug(

"Convert 1,250 USD to INR using a Bank Transfer. Show me the precise calculation."

)

请注意所发生的情况:

- 当货币智能体调用

CalculationAgent时,它会传入信息让CalculationAgent生成计算 Python 代码 - 而

CalculationAgent继而使用BuiltInCodeExecutor运行该代码,并为我们提供了精确的计算结果,而非大语言模型的推测结果!

现在,可以使用开头附近定义的辅助函数,查看响应中生成 Python 代码或包含 Python 代码运行结果的部分。

python

show_python_code_and_result(response)

{% endtabs %}

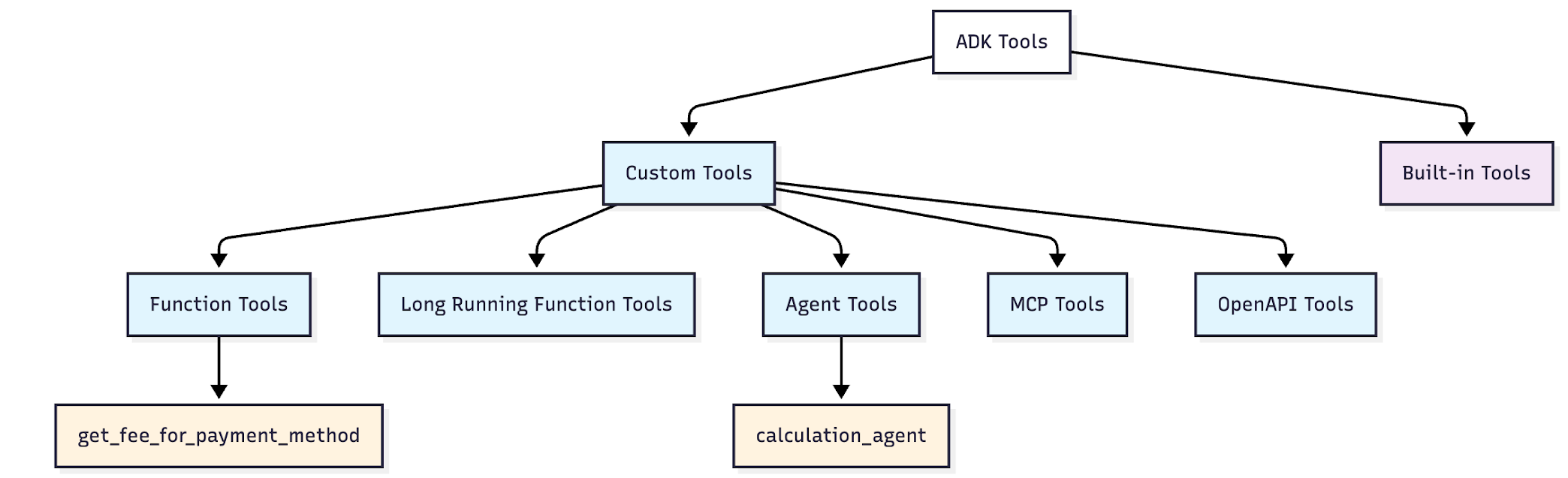

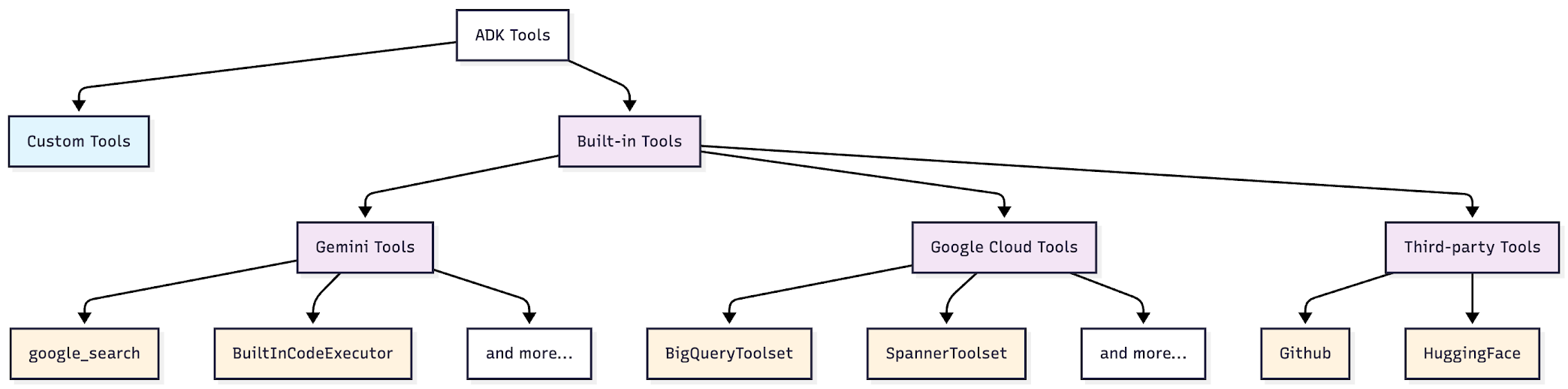

ADK 工具类型完整指南

接下来我们完整了解一下 ADK 工具包:

它大致分为两大类:自定义工具与内置工具

自定义工具

定义:为满足特定需求而自行构建的工具

优势:对功能拥有完全控制权 ------ 你可以精准打造智能体所需的工具

函数工具 ✅(已使用过)

- 定义:由 Python 函数转换而来的智能体工具

- 示例:获取支付方式手续费、获取汇率

- 优势:可将任意 Python 函数即时转化为智能体可用工具

长时间运行函数工具

- 定义:适用于耗时较长操作的函数

- 示例:人工介入审批、文件处理

- 优势:智能体可启动任务后,在等待期间继续处理其他工作

智能体工具 ✅(已使用过)

- 定义:将其他智能体作为工具使用

- 示例:AgentTool(agent=calculation_agent)

- 优势:打造专业型智能体,并可在不同系统中复用

MCP 工具

- 定义:来自模型上下文协议服务器的工具

- 示例:文件系统访问、谷歌地图、数据库

- 优势:无需自定义集成,即可连接任意兼容 MCP 的服务

OpenAPI 工具

- 定义:根据 API 规范自动生成的工具

- 示例:REST API 接口转化为可调用工具

- 优势:无需手动编码 ------ 只需提供 API 规范即可生成可用工具

内置工具

定义:ADK 提供的预制工具

优势:无需开发,零配置即可直接使用

Gemini 工具 ✅(已使用过)

- 定义:依托 Gemini 能力实现的工具

- 示例:谷歌搜索、内置代码执行器

- 优势:可靠且经过测试,开箱即用

谷歌云工具 需谷歌云访问权限

- 定义:用于谷歌云服务及企业级集成的工具

- 示例:BigQuery 工具集、Spanner 工具集、APIHub 工具集

- 优势:企业级数据库与 API 访问能力,内置安全保障

第三方工具

- 定义:现有工具生态的封装接口

- 示例:Hugging Face、Firecrawl、GitHub 工具

- 优势:复用现有工具资源,无需重新构建已有的成熟工具

智能体工具最佳实践

本章学习调用外部 MCP 服务并处理耗时较长的操作。

学习如何:

- 连接至外部 MCP 服务器

- 实现可暂停智能体执行以等待外部输入的耗时操作

- 构建可恢复工作流,在对话中断期间保持状态

- 理解何时以及如何使用这些模式

前置工作

python

import os

from dotenv import load_dotenv

import uuid

from google.genai import types

from google.adk.agents import LlmAgent

from google.adk.models.google_llm import Gemini

from google.adk.runners import Runner

from google.adk.sessions import InMemorySessionService

from google.adk.tools.mcp_tool.mcp_toolset import McpToolset

from google.adk.tools.tool_context import ToolContext

from google.adk.tools.mcp_tool.mcp_session_manager import StdioConnectionParams

from mcp import StdioServerParameters

from google.adk.apps.app import App, ResumabilityConfig

from google.adk.tools.function_tool import FunctionTool

load_dotenv(override=True)

GOOGLE_API_KEY = os.getenv("GOOGLE_API_KEY")

os.environ["GOOGLE_API_KEY"] = GOOGLE_API_KEY

retry_config = types.HttpRetryOptions(

attempts=5, # Maximum retry attempts

exp_base=7, # Delay multiplier

initial_delay=1,

http_status_codes=[429, 500, 503, 504], # Retry on these HTTP errors

)模型上下文协议(Model Context Protocol)

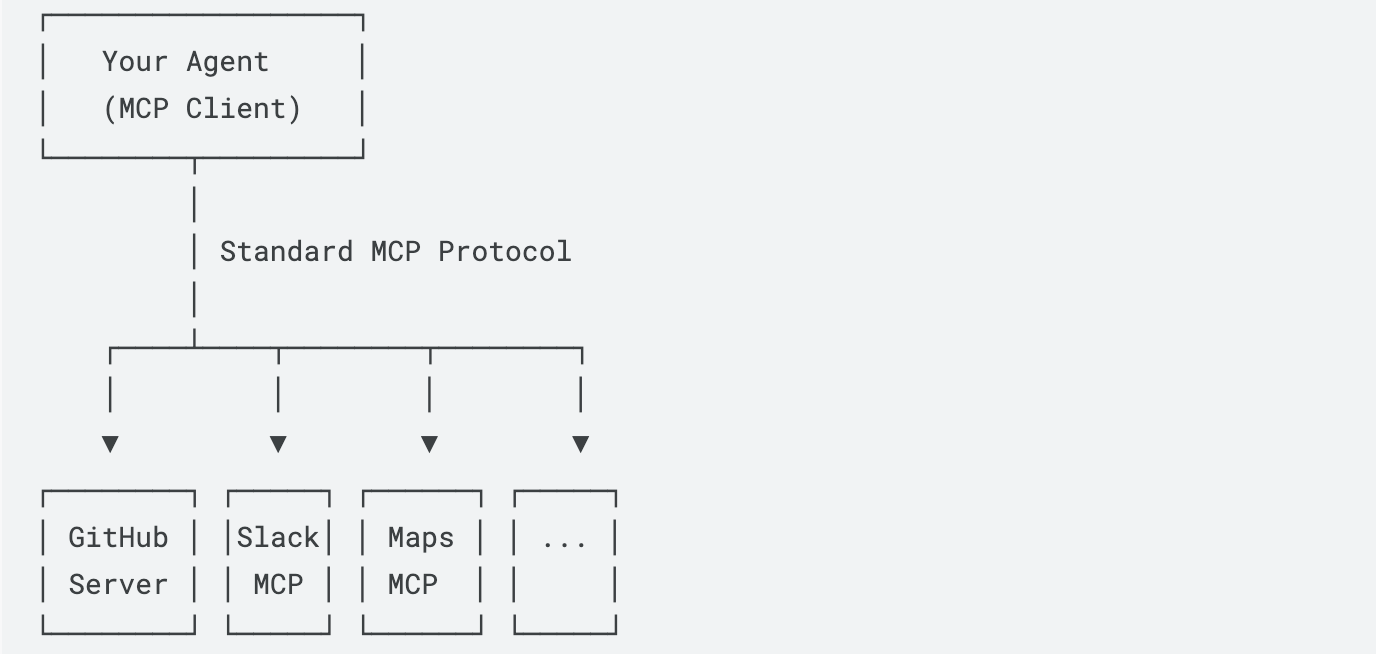

之前学的是智能体使用自定义函数。但要连接外部系统(GitHub、数据库、Slack),需要编写并维护 API 客户端。

模型上下文协议(MCP)是一项开放标准,可让智能体使用社区构建的集成组件。无需自行编写集成代码与 API 客户端,只需连接至现有的 MCP 服务器即可。

MCP 可让智能体实现以下功能:

- 无需编写自定义集成代码,即可从数据库、API 接口及各类服务中获取实时外部数据

- 借助标准化接口使用社区构建的工具

- 通过连接多个专用服务器实现能力扩展

MCP 工作原理

MCP 将你的智能体(客户端)与提供各类工具的外部 MCP 服务器相连:

- MCP 服务器:提供特定工具(如图像生成、数据库访问)

- MCP 客户端:使用这些工具的智能体

- 所有服务器均采用统一工作方式 ------ 标准化接口

使用 MCP

工作流程:

- 选择一个 MCP 服务器与工具

- 创建 MCP 工具集(配置连接)

- 将其添加到智能体

- 运行并测试该智能体

选择 MCP 服务器

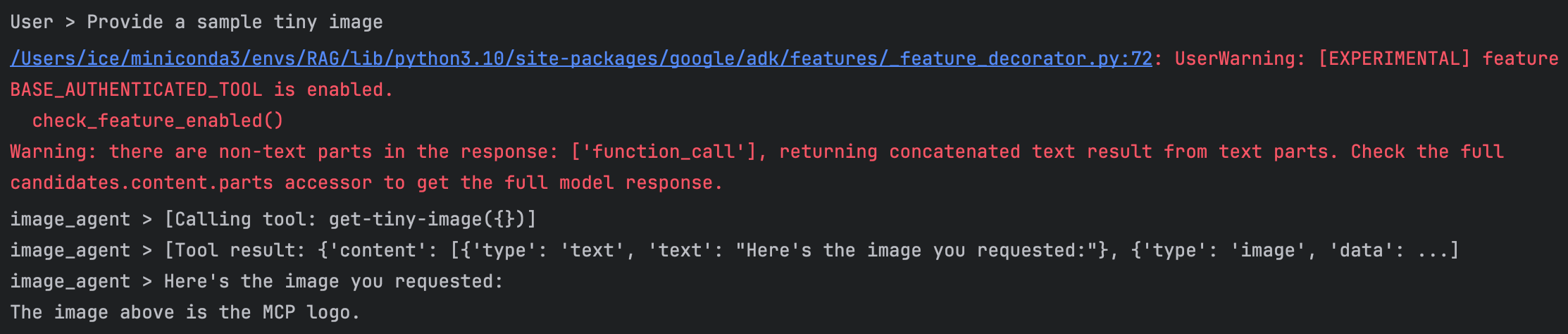

这里使用 Everything MCP 服务器 ------ 这是一款专为测试 MCP 集成而设计的 npm 软件包(@modelcontextprotocol/server-everything)。该服务器提供了一个 getTinyImage 工具,可返回一张简易测试图片(16×16 像素,采用 Base64 编码)。

更多服务器可访问:modelcontextprotocol

{% note info %}

搞清楚 MCP

MCP 是一种协议,用来把AI应用连接到外部数据源、工具和工作流。我们的 agent 就是MCP client,这个 @modelcontextprotocol/server-everything 就是一个 MCP server,用 npx 来运行。MCP Server 是一个具体跑起来的程序/服务。MPC server 把某个平台能力包装成 MCP 标准接口的适配器/服务。比如

- GitHub MCP Server:提供 GitHub 相关工具

- Slack MCP Server:提供 Slack 读写能力

- Maps MCP Server:提供地图查询能力

- server-everything:一个官方测试/演示 server

{% endnote %}

{% tabs 使用MCP , 1 %}

McpToolset 用于将 ADK 智能体与 MCP 服务器进行集成。

代码实现功能:

- 使用 npx(Node 包运行器)运行 MCP 服务器

- 连接至

@modelcontextprotocol/server-everything - 筛选并仅使用

getTinyImage工具(该服务器还包含其他工具,但本演示仅需此工具)

python

# MCP integration with Everything Server

mcp_image_server = McpToolset(

connection_params=StdioConnectionParams(

server_params=StdioServerParameters(

command="npx", # Run MCP server via npx

args=[

"-y", # Argument for npx to auto-confirm install

"@modelcontextprotocol/server-everything",

],

tool_filter=["getTinyImage"],

),

timeout=30,

)

)

print("✅ MCP Tool created")幕后原理:

- 服务器启动: ADK 运行

npx -y @modelcontextprotocol/server-everything - 握手: 建立标准输入输出(stdio)通信通道

- 工具发现: 服务器告知 ADK:"我提供

getTinyImage功能" - 集成: 工具自动出现在智能体的工具列表中

- 执行: 当智能体调用

getTinyImage()时,ADK 将其转发至 MCP 服务器 - 响应: 服务器结果无缝返回给智能体

为什么这很重要: 无需编写集成代码,即可立即获得工具访问权限!不需要和工具对接,只需要一个运行一个符合MCP协议的服务器,即插即用(像一个USB接口,MCP官网也这么形容MCP)

将 mcp_server 添加至智能体的工具数组中,并更新智能体的指令,使其能够处理生成微型图像的请求。

python

# Create image agent with MCP integration

image_agent = LlmAgent(

model=Gemini(model="gemini-2.5-flash-lite", retry_options=retry_config),

name="image_agent",

instruction="Use the MCP Tool to generate images for user queries",

tools=[mcp_image_server],

)创建运行器

python

from google.adk.runners import InMemoryRunner

runner = InMemoryRunner(agent=image_agent)让智能体生成一张图片。观察它如何使用 MCP 工具

python

response = await runner.run_debug("Provide a sample tiny image", verbose=True)

run_bebug(...)用调试模型运行 agent,除了输出最终结果,尽可能把中间过程打印出来,比如 agent 收到什么问题、调用了什么工具、工具返回了什么、最后 agent 怎么组织回答。verbose=True参数含义是把过程打印的更详细- 返回结果里面有

'type': 'image'内容

其实是看不到图片的,下面这个代码可以展示一下(这个图片数据是base64编码格式)

python

from IPython.display import display, Image as IPImage

import base64

for event in response:

if event.content and event.content.parts:

for part in event.content.parts:

if hasattr(part, "function_response") and part.function_response:

for item in part.function_response.response.get("content", []):

if item.get("type") == "image":

display(IPImage(data=base64.b64decode(item["data"])))

这个小东西就是

同样的模式适用于任意 MCP 服务器 ------ 仅需修改连接参数。

Kaggle MCP Server

python

McpToolset(

connection_params=StdioConnectionParams(

server_params=StdioServerParameters(

command='npx',

args=[

'-y',

'mcp-remote',

'https://www.kaggle.com/mcp'

],

),

timeout=30,

)

)其提供的功能包括:

- 📊 搜索并下载 Kaggle 数据集

- 📓 获取笔记本元数据

- 🏆 查询竞赛信息等

GitHub MCP Server

python

McpToolset(

connection_params=StreamableHTTPServerParams(

url="https://api.githubcopilot.com/mcp/",

headers={

"Authorization": f"Bearer {GITHUB_TOKEN}",

"X-MCP-Toolsets": "all",

"X-MCP-Readonly": "true"

},

),

)相关的 Tools 文档都可以在这个连接里面找到,都会有连接方式的示例 ADK Third-party Tools Documentation

{% endtabs %}

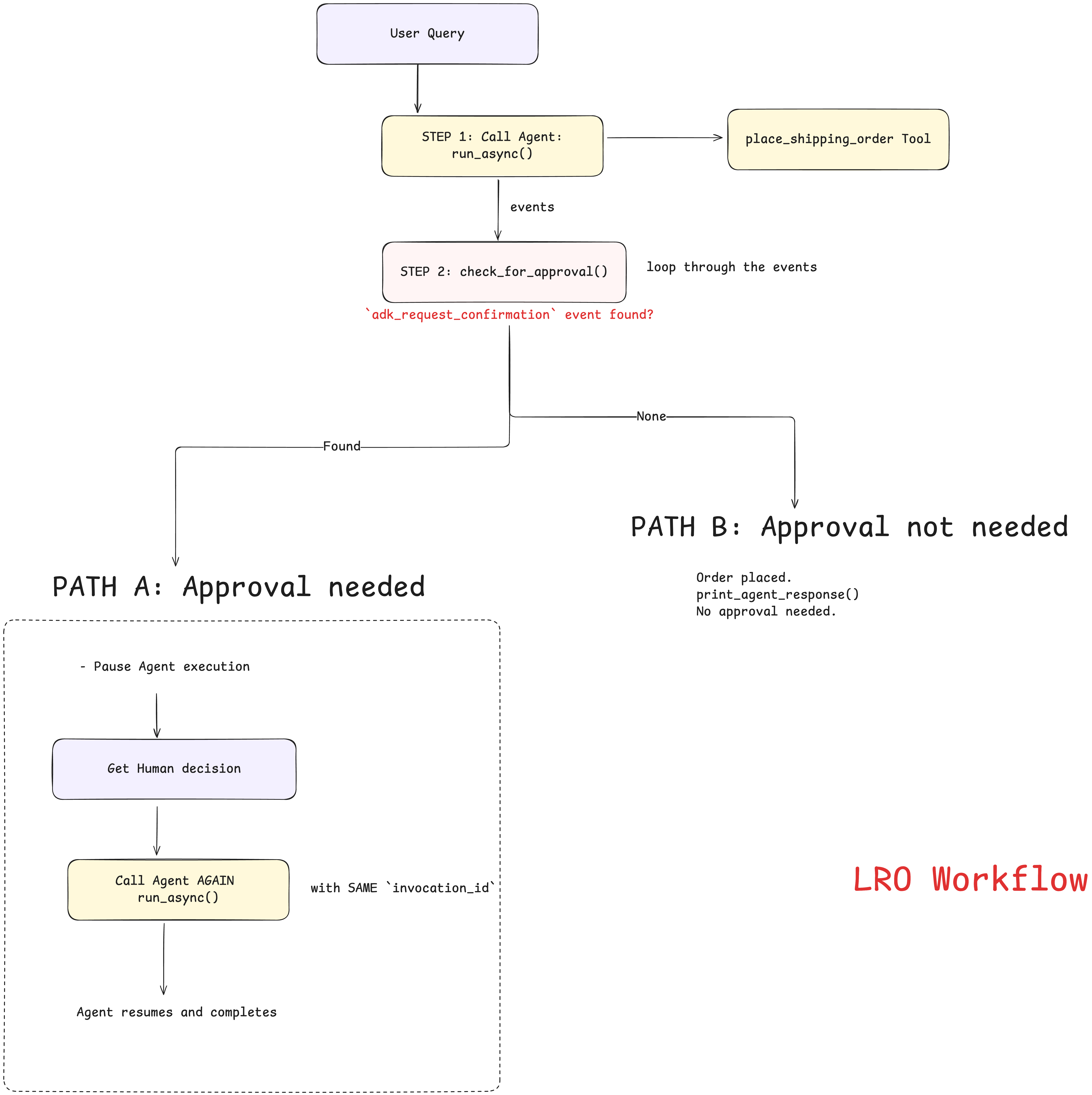

长时间运行操作(人工介入)

到目前为止,所有工具均会立即执行并返回结果:

用户提出问题 → 智能体调用工具 → 工具返回结果 → 智能体作出应答

但如果工具需要长时间运行,或者在完成某项操作前需要获得人工许可,该如何处理?利用货运智能体在下达大额订单前,应先请求审批。

用户提出问题 → 智能体调用工具 → 工具暂停并征询人工意见 → 人工审批通过 → 工具执行完毕 → 智能体作出应答

这种模式被称为长时间运行操作(LRO)------ 工具需要暂停运行,等待外部输入(人工审批),之后再恢复执行。

长时间运行操作举例:

- 💰 需要审批的金融交易(转账、采购)

- 🗑️ 批量操作(删除 1000 条记录 ------ 请先确认!)

- 📋 合规检查节点(需监管部门批准)

- 💸 高成本操作(启动 50 台服务器 ------ 您确定吗?)

- ⚠️ 不可逆操作(永久删除账户)

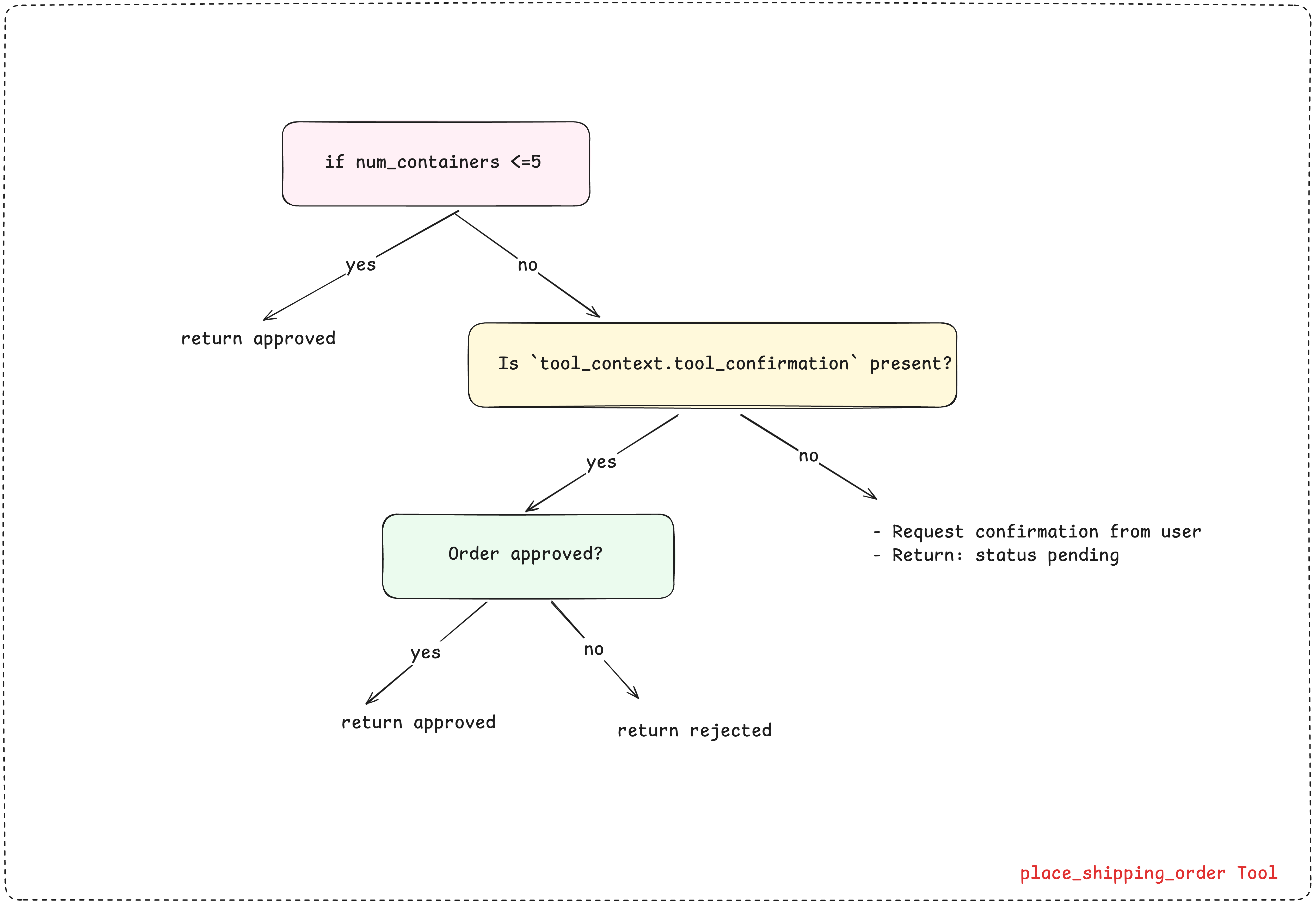

下面实现一个功能,搭建一个物流协调智能体,其配套工具具备以下功能:

- 自动审批小额订单(≤5 个集装箱)

- 对大额订单(>5 个集装箱)暂停并请求审批

- 根据审批结果完成或取消操作

这里包含了核心的长时间运行操作模式:暂停 → 等待人工输入 → 恢复执行。

{% tabs 长时间运行操作 , 1 %}

工具上下文参数

注意函数签名中包含 tool_context: ToolContext。当工具运行时,应用开发工具包(ADK)会自动提供该对象。它具备两项核心能力:

- 请求审批:调用

tool_context.request_confirmation() - 检查审批状态:读取

tool_context.tool_confirmation

python

LARGE_ORDER_THRESHOLD = 5

def place_shipping_order(

num_containers: int, destination: str, tool_context: ToolContext

) -> dict:

"""Places a shipping order. Requires approval if ordering more than 5 containers (LARGE_ORDER_THRESHOLD).

Args:

num_containers: Number of containers to ship

destination: Shipping destination

Returns:

Dictionary with order status

"""

# -----------------------------------------------------------------------------------------------

# -----------------------------------------------------------------------------------------------

# SCENARIO 1: Small orders (≤5 containers) auto-approve

if num_containers <= LARGE_ORDER_THRESHOLD:

return {

"status": "approved",

"order_id": f"ORD-{num_containers}-AUTO",

"num_containers": num_containers,

"destination": destination,

"message": f"Order auto-approved: {num_containers} containers to {destination}",

}

# -----------------------------------------------------------------------------------------------

# -----------------------------------------------------------------------------------------------

# SCENARIO 2: This is the first time this tool is called. Large orders need human approval - PAUSE here.

if not tool_context.tool_confirmation:

tool_context.request_confirmation(

hint=f"⚠️ Large order: {num_containers} containers to {destination}. Do you want to approve?",

payload={"num_containers": num_containers, "destination": destination},

)

return { # This is sent to the Agent

"status": "pending",

"message": f"Order for {num_containers} containers requires approval",

}

# -----------------------------------------------------------------------------------------------

# -----------------------------------------------------------------------------------------------

# SCENARIO 3: The tool is called AGAIN and is now resuming. Handle approval response - RESUME here.

if tool_context.tool_confirmation.confirmed:

return {

"status": "approved",

"order_id": f"ORD-{num_containers}-HUMAN",

"num_containers": num_containers,

"destination": destination,

"message": f"Order approved: {num_containers} containers to {destination}",

}

else:

return {

"status": "rejected",

"message": f"Order rejected: {num_containers} containers to {destination}",

}

print("✅ Long-running functions created!")代码解析

三种场景的运行机制

该工具通过检查 tool_context.tool_confirmation 来处理三种场景:

场景 1:小额订单(≤5 个集装箱) 立即返回自动审核通过状态。

- 不会检查

tool_context.tool_confirmation

场景 2:大额订单 ------ 首次调用

- 工具判定为首次调用:若未设置

tool_context.tool_confirmation - 调用

request_confirmation()申请人工审核 - 立即返回

{'status': 'pending', ...} - ADK 自动生成

adk_request_confirmation事件 - 智能体执行暂停,等待人工决策

⚠️:是调用了这个函数,然后ADK触发确认请求机制,事件流里面出现 adk_request_confirmation

场景 3:大额订单 ------ 恢复调用

- 工具判定为恢复执行:此时

not tool_context.tool_confirmation判定为否 - 核查人工审核结果:

tool_context.tool_confirmation.confirmed - 若为真 → 返回审核通过状态

- 若为假 → 返回审核驳回状态

核心要点:在两次调用之间,工作流代码(第 4 部分)必须检测到 adk_request_confirmation 事件,并根据审核结果恢复执行流程。

创建智能体

将工具添加到智能体中。工具会根据订单规模,在内部自行判断何时请求审批。

python

# Create shipping agent with pausable tool

shipping_agent = LlmAgent(

name="shipping_agent",

model=Gemini(model="gemini-2.5-flash-lite", retry_options=retry_config),

instruction="""You are a shipping coordinator assistant.

When users request to ship containers:

1. Use the place_shipping_order tool with the number of containers and destination

2. If the order status is 'pending', inform the user that approval is required

3. After receiving the final result, provide a clear summary including:

- Order status (approved/rejected)

- Order ID (if available)

- Number of containers and destination

4. Keep responses concise but informative

""",

tools=[FunctionTool(func=place_shipping_order)],

)

print("✅ Shipping Agent created!")封装至可恢复应用

{% note red 'fas fa-question-circle' simple %}

问题所在:常规的大语言模型智能体(LlmAgent)是无状态的 ------ 每次调用相互独立,无法记忆此前的交互记录。若工具需要审批,智能体将无法记住此前的操作进程。

{% endnote %}

LLM 是脑子,Agent 是角色,App 是系统,Runner 是让系统跑起来的执行器。

{% note success simple %}

解决方案:将你的智能体封装至启用了可恢复功能的 APP 中。该应用会新增持久化层,用于保存并恢复状态。

{% endnote %}

工具暂停时会保存以下内容:

- 截至目前的所有对话消息

- 已调用的工具(下达发货订单)

- 工具参数(10 个集装箱,鹿特丹)

- 具体暂停节点(等待审批)

恢复运行时,应用会加载已保存的状态,使智能体从暂停处精准接续执行,仿佛时间从未中断。

python

# Wrap the agent in a resumable app - THIS IS THE KEY FOR LONG-RUNNING OPERATIONS!

shipping_app = App(

name="shipping_coordinator",

root_agent=shipping_agent,

resumability_config=ResumabilityConfig(is_resumable=True), # 可以进行恢复

)

print("✅ Resumable app created!")创建会话和运行器

将 app=shipping_app 而非 agent=... 传入,这样运行器就能感知到可恢复执行的特性。

python

session_service = InMemorySessionService()

# Create runner with the resumable app

shipping_runner = Runner(

app=shipping_app, # Pass the app instead of the agent

session_service=session_service,

)

print("✅ Runner created!"){% endtabs %}

下一步:构建工作流代码,测试智能体能否检测到暂停状态并处理审批流程。

构建工作流

在工作流中处理事件

智能体不会自动处理暂停 / 恢复操作。每个长时间运行的工作流都需要完成以下步骤:

- 检测暂停状态:检查事件中是否包含

adk_request_confirmation - 获取人工决策:在生产环境中,需展示界面并等待用户点击。此处我们对该过程进行模拟。

- 恢复智能体:将决策结果与已保存的调用标识(

invocation_id)一同回传

理解核心技术概念

- 事件(events)------ 智能体执行过程中,ADK 会生成各类事件。工具调用、模型响应、函数执行结果等均会以事件形式呈现

adk_request_confirmation事件 ------ 该事件为特殊事件,用于发出 "在此处暂停" 的指令

- 当你的工具调用

request_confirmation()方法时,ADK 会自动生成该事件 - 该事件包含调用标识(invocation_id)

- 你的工作流必须检测到该事件,才能知晓智能体已进入暂停状态

- 调用标识(invocation_id)------ 每次调用

run_async()方法都会生成一个唯一的调用标识(例如 "abc123")

- 当工具暂停时,需保存该标识

- 恢复执行时,需传入相同的标识,以便 ADK 识别需要继续执行的任务进程

- 若缺少该标识,ADK 会启动一个全新的执行进程,而非恢复已暂停的任务

用于处理事件的辅助函数

这些函数会为你处理事件迭代逻辑。

check_for_approval() - 检测智能体是否暂停

- 遍历所有事件,查找特定的

adk_request_confirmation事件 - 返回

approval_id(用于标识该具体请求)和invocation_id(用于标识需恢复的执行任务) - 若未检测到暂停状态,则返回

None

python

def check_for_approval(events):

"""Check if events contain an approval request.

Returns:

dict with approval details or None

"""

for event in events:

if event.content and event.content.parts:

for part in event.content.parts:

if (

part.function_call

and part.function_call.name == "adk_request_confirmation"

):

return {

"approval_id": part.function_call.id,

"invocation_id": event.invocation_id,

}

return Noneevents:所有事件,比如用户消息、模型回复、tool call、tool resultevent.content.parts:有些事件可能没有内容,所以要先判断,有多个part的原因是一个回复可能不只是纯文本,可能还包含图片、function_call、function_response等。所以要逐个检查

print_agent_response() - 显示智能体文本,用于从事件中提取并打印文本的简易辅助函数

python

def print_agent_response(events):

"""Print agent's text responses from events."""

for event in events:

if event.content and event.content.parts:

for part in event.content.parts:

if part.text:

print(f"Agent > {part.text}")create_approval_response() - 格式化人工决策

- 接收来自人工的审批信息与布尔型决策(真 / 假)

- 创建 ADK 可识别的

FunctionResponse对象 - 将其封装至

Content对象中,以返回给智能体

python

def create_approval_response(approval_info, approved):

"""Create approval response message."""

confirmation_response = types.FunctionResponse(

id=approval_info["approval_id"],

name="adk_request_confirmation",

response={"confirmed": approved},

)

return types.Content(

role="user", parts=[types.Part(function_response=confirmation_response)]

)

print("✅ Helper functions defined")工作流函数

run_shipping_workflow() 函数统筹整个审批流程。

python

async def run_shipping_workflow(query: str, auto_approve: bool = True):

"""Runs a shipping workflow with approval handling.

Args:

query: User's shipping request

auto_approve: Whether to auto-approve large orders (simulates human decision)

"""

print(f"\n{'='*60}")

print(f"User > {query}\n")

# Generate unique session ID

session_id = f"order_{uuid.uuid4().hex[:8]}"

# Create session

await session_service.create_session(

app_name="shipping_coordinator", user_id="test_user", session_id=session_id

)

query_content = types.Content(role="user", parts=[types.Part(text=query)])

events = []

# -----------------------------------------------------------------------------------------------

# -----------------------------------------------------------------------------------------------

# STEP 1: Send initial request to the Agent. If num_containers > 5, the Agent returns the special `adk_request_confirmation` event

async for event in shipping_runner.run_async(

user_id="test_user", session_id=session_id, new_message=query_content

):

events.append(event)

# -----------------------------------------------------------------------------------------------

# -----------------------------------------------------------------------------------------------

# STEP 2: Loop through all the events generated and check if `adk_request_confirmation` is present.

approval_info = check_for_approval(events)

# -----------------------------------------------------------------------------------------------

# -----------------------------------------------------------------------------------------------

# STEP 3: If the event is present, it's a large order - HANDLE APPROVAL WORKFLOW

if approval_info:

print(f"⏸️ Pausing for approval...")

print(f"🤔 Human Decision: {'APPROVE ✅' if auto_approve else 'REJECT ❌'}\n")

# PATH A: Resume the agent by calling run_async() again with the approval decision

async for event in shipping_runner.run_async(

user_id="test_user",

session_id=session_id,

new_message=create_approval_response(

approval_info, auto_approve

), # Send human decision here

invocation_id=approval_info[

"invocation_id"

], # Critical: same invocation_id tells ADK to RESUME

):

if event.content and event.content.parts:

for part in event.content.parts:

if part.text:

print(f"Agent > {part.text}")

# -----------------------------------------------------------------------------------------------

# -----------------------------------------------------------------------------------------------

else:

# PATH B: If the `adk_request_confirmation` is not present - no approval needed - order completed immediately.

print_agent_response(events)

print(f"{'='*60}\n")

print("✅ Workflow function ready")- 我们跟GPT聊天的时候,一个会话窗口其实就是这里面的一个

session_id。让系统内部知道这是哪个对话,里面聊过什么。 APP类似于我定义好了一个有具体功能的类,比如定义了一个写作助手,代码助手,然后session就是创建实体对象session_service.create_session(app_name="shipping_coordinator", user_id="test_user", session_id=session_id)里面,user_id来标识是哪个用户- 前面有

session_service = InMemorySessionService()这个意思是创建一个会话服务,它来专门负责保存和管理session的,是保存在内存中的。session_service.create_session()是用来创建会话的 shipping_runner = Runner(...)是运行shipping_app,接收消息,调用app,在运行时去session_service里面读写会话状态的。shipping_runner.run_async(...)是把一条消息发送到这个session的,这一步是真正开始聊天的query_content = types.Content(role="user", parts=[types.Part(text=query)])这个是在构造用户消息,因为query只是一个普通字符串,这里role是用户角色,谁发的消息,types.Part(text=query)是消息的组成,因为消息可能包含图片、语音、文本啥的。

正常情况下

数量小于等于 5 的时候,在 shipping_runner.run_async(...) 处,发出 Query 之后,Agent 内部会围绕这个 Query 产生一系列的事件流,比如收消息、推理、调工具、拿结果、输出回复、结束,这也是 for 的原因。然后代码继续向下执行,判断了 approval_info 里面是空,直接打印结果

需要暂停的情况下

数量大于 5 的时候,在 shipping_runner.run_async(...) 处,发出 Query 之后,Agent 内部会产生一系列的事件流,不同的是这次执行过程中会出现一个 adk_request_confirmation 事件,需要人工去确认了,因此这轮循环会在这里暂停,代码继续向下执行,判断了 approval_info 里面不是空,进入 if,然后在里面再次 run_async(...) ,传入 invocation_id 和人工批准/拒绝消息,这样ADK就知道要恢复之前暂停的那次执行,继续把剩余流程跑完。

代码拆解

步骤 1:向智能体发送初始请求

- 调用

run_async()启动智能体执行 - 将所有事件收集到列表中以便查看

步骤 2:检测暂停状态

- 调用

check_for_approval(events)查找特定事件:adk_request_confirmation - 若存在该特殊事件,则返回包含调用 ID(invocation_id)的审批信息;若执行完成则返回空值

步骤 3:恢复执行

路径 A:

- 若存在审批信息,此时智能体会暂停运行以等待人工输入。

- 待获取人工输入后,再次调用

run_async()并传入人工输入内容。 - 关键要点:需使用相同的调用 ID(告知 ADK 执行恢复操作,而非重新启动)

- 恢复执行后展示智能体的最终响应

路径 B:

- 若不存在审批信息,则无需审批,智能体直接完成执行。

结果

python

# 订单小于 5

await run_shipping_workflow("Ship 3 containers to Singapore")

# ============================================================

# User > Ship 3 containers to Singapore

# Agent > Shipping order placed successfully.

# Order status: approved

# Order ID: ORD-3-AUTO

# Number of containers: 3

# Destination: Singapore

# ============================================================

# 订单大于 5,但是同意了

await run_shipping_workflow("Ship 10 containers to Rotterdam", auto_approve=True)

# ============================================================

# User > Ship 10 containers to Rotterdam

# ⏸️ Pausing for approval...

# 🤔 Human Decision: APPROVE ✅

# Agent > Shipping order approved. Order ID: ORD-10-HUMAN. 10 containers to Rotterdam.

# ============================================================

# 订单大于 5,但是拒绝了

await run_shipping_workflow("Ship 8 containers to Los Angeles", auto_approve=False)

# ============================================================

# User > Ship 8 containers to Los Angeles

# ⏸️ Pausing for approval...

# 🤔 Human Decision: REJECT ❌

# Agent > The order for 8 containers to Los Angeles has been rejected.

# ============================================================总结 ------ 高级工具的核心模式

| 模式 | 适用场景 | 核心 ADK 组件 |

|---|---|---|

| MCP 集成 | 需要连接外部标准化服务(如时间服务、数据库或文件系统),且无需编写自定义集成代码 | McpToolset |

| 长时间运行操作 | 需要暂停工作流以等待外部事件,最常见于人工介入审批、长时间后台任务执行,或合规性 / 安全性检查节点 | ToolContext、request_confirmation、App、ResumabilityConfig |

智能体会话(Agent Sessions)

前期准备

python

import os

from dotenv import load_dotenv

from typing import Any, Dict

from google.adk.agents import Agent, LlmAgent

from google.adk.apps.app import App, EventsCompactionConfig

from google.adk.models.google_llm import Gemini

from google.adk.sessions import DatabaseSessionService

from google.adk.sessions import InMemorySessionService

from google.adk.runners import Runner

from google.adk.tools.tool_context import ToolContext

from google.genai import types

load_dotenv(override=True)

GOOGLE_API_KEY = os.getenv("GOOGLE_API_KEY")

os.environ["GOOGLE_API_KEY"] = GOOGLE_API_KEY

retry_config = types.HttpRetryOptions(

attempts=5, # Maximum retry attempts

exp_base=7, # Delay multiplier

initial_delay=1,

http_status_codes=[429, 500, 503, 504], # Retry on these HTTP errors

)辅助函数

用于管理完整的对话会话,处理会话的创建 / 获取、查询处理以及响应流式传输。该函数既支持单次查询,也支持连续的多次查询。

举例

bash

>>> await run_session(runner, "What is the capital of France?", "geography-session")

>>> await run_session(runner, ["Hello!", "What's my name?"], "user-intro-session")

python

# Define helper functions that will be reused throughout the notebook

async def run_session(

runner_instance: Runner,

user_queries: list[str] | str = None,

session_name: str = "default",

):

print(f"\n ### Session: {session_name}")

# Get app name from the Runner

app_name = runner_instance.app_name

# Attempt to create a new session or retrieve an existing one

try:

session = await session_service.create_session(

app_name=app_name, user_id=USER_ID, session_id=session_name

)

except:

session = await session_service.get_session(

app_name=app_name, user_id=USER_ID, session_id=session_name

)

# Process queries if provided

if user_queries:

# Convert single query to list for uniform processing

if type(user_queries) == str:

user_queries = [user_queries]

# Process each query in the list sequentially

for query in user_queries:

print(f"\nUser > {query}")

# Convert the query string to the ADK Content format

query = types.Content(role="user", parts=[types.Part(text=query)])

# Stream the agent's response asynchronously

async for event in runner_instance.run_async(

user_id=USER_ID, session_id=session.id, new_message=query

):

# Check if the event contains valid content

if event.content and event.content.parts:

# Filter out empty or "None" responses before printing

if (

event.content.parts[0].text != "None"

and event.content.parts[0].text

):

print(f"{MODEL_NAME} > ", event.content.parts[0].text)

else:

print("No queries!")

print("✅ Helper functions defined.")会话管理(Session Management)

问题

从本质上来说,大语言模型本身是无状态的。它们的认知范围仅限于单次 API 调用中你所提供的信息。这意味着,若智能体缺乏合理的上下文管理机制,只会对当前提示做出响应,而不会考虑此前的对话历史。

为何这一点至关重要?试想一下,你试图与某人进行一场有意义的交谈,可对方每听完一句话就会彻底忘记你之前说过的所有内容。这正是我们使用原生大语言模型时所面临的难题!

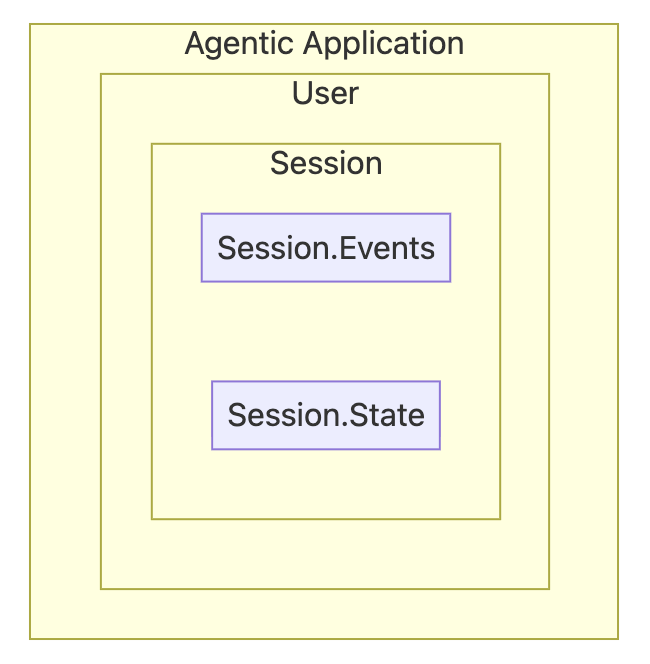

在 ADK 中,我们采用会话(Sessions) 管理短期记忆,通过记忆(Memory) 实现长期记忆。

什么是会话

会话

会话是对话的容器。它按时间顺序封装对话历史,同时记录单次连续对话中所有的工具交互与响应内容。会话与用户及智能体绑定,不会与其他用户共享;同理,某一智能体的会话历史也不会与其他智能体共享。

在 ADK 中,会话由两大核心组件构成:事件与状态。

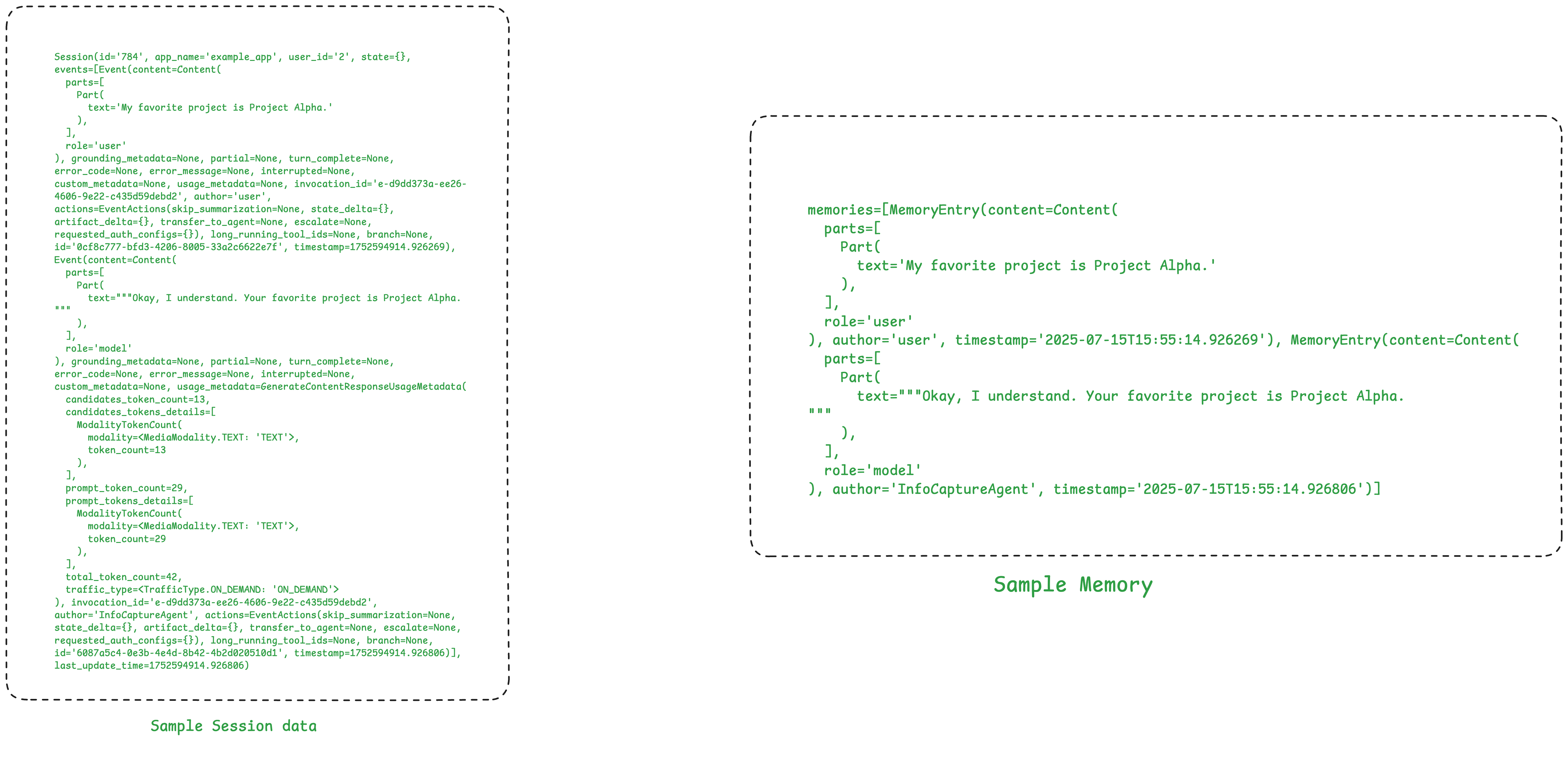

Session.Events:

如果说会话是对话的容器,那么事件就是构成对话的基本单元。

事件示例:

- 用户输入:来自用户的消息(文本、音频、图片等)

- 智能体响应:智能体对用户的回复

- 工具调用:智能体决定调用外部工具或 API

- 工具输出:工具调用返回的数据,供智能体继续推理使用

{} Session.State:

session.state 是智能体的临时存储区,用于存储和更新对话过程中所需的动态信息。可将其视作全局 {key, value} 对存储结构,所有子智能体与工具均可访问。

如何管理会话

一个智能体应用可服务多名用户,且每位用户可与该应用建立多个会话。为管理这些会话与事件,应用开发工具包(ADK)提供了会话管理器与运行器。

- 会话服务(SessionService):存储层

- 负责会话数据的创建、存储与获取

- 可根据不同需求提供多种实现方式(内存、数据库、云端)

- 运行器(Runner):编排层

- 管理用户与智能体之间的信息流转

- 自动维护对话历史

- 后台完成上下文工程处理

可以这样理解:

- 会话 = 一本笔记本 📓

- 事件 = 单页上的独立记录 📝

- 会话服务 = 存放笔记本的文件柜 🗄️

- 运行器 = 管理对话的助手 🤖

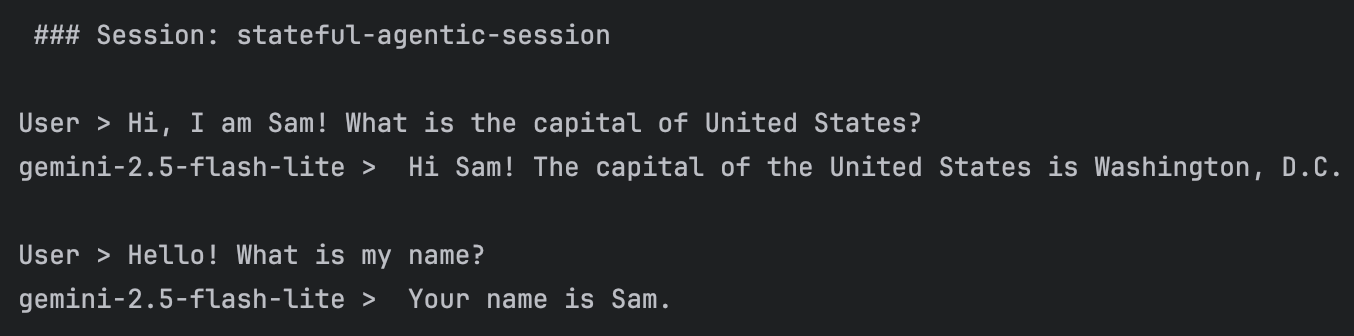

实现有状态智能体

创建第一个有状态智能体,它能够记住信息并开展有意义的对话。

ADK 提供多种适用于不同需求的会话类型。首先,我们将从一个简单的会话管理方案(InMemorySessionService)开始。

python

APP_NAME = "default" # Application

USER_ID = "default" # User

SESSION = "default" # Session

MODEL_NAME = "gemini-2.5-flash-lite"

# Step 1: Create the LLM Agent

root_agent = Agent(

model=Gemini(model="gemini-2.5-flash-lite", retry_options=retry_config),

name="text_chat_bot",

description="A text chatbot", # Description of the agent's purpose

)

# Step 2: Set up Session Management

# InMemorySessionService stores conversations in RAM (temporary)

session_service = InMemorySessionService()

# Step 3: Create the Runner

runner = Runner(agent=root_agent, app_name=APP_NAME, session_service=session_service)

print("✅ Stateful agent initialized!")

print(f" - Application: {APP_NAME}")

print(f" - User: {USER_ID}")

print(f" - Using: {session_service.__class__.__name__}")测试有状态智能体

python

# Run a conversation with two queries in the same session

# Notice: Both queries are part of the SAME session, so context is maintained

await run_session(

runner,

[

"Hi, I am Sam! What is the capital of United States?",

"Hello! What is my name?", # This time, the agent should remember!

],

"stateful-agentic-session",

)

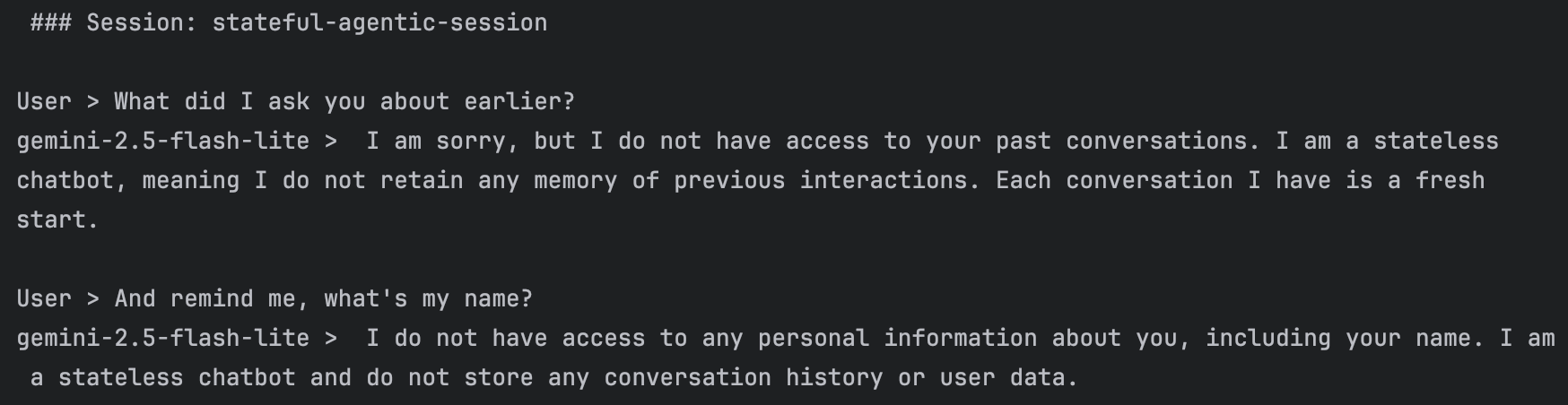

测试智能体的遗忘特性

为验证智能体会遗忘对话内容,重启IDEA。随后运行除 1.5.1.5 中 run_session 之外的所有先前代码。

现在下面代码,你会发现智能体已完全不记得此前对话中的任何内容。

python

# Run this cell after restarting the kernel. All this history will be gone...

await run_session(

runner,

["What did I ask you about earlier?", "And remind me, what's my name?"],

"stateful-agentic-session",

) # Note, we are using same session name

{% note warning no-icon simple %}

问题:会话信息无法持久保存(即有意义的对话内容会丢失)

在实际应用场景下,用户应当能够查阅过往记录并继续对话。要实现这一功能,我们必须对信息进行持久化存储。

{% endnote %}

借助数据库会话服务实现持久化会话

尽管内存会话服务(InMemorySessionService)非常适合原型开发,但实际应用场景中的对话需要在服务重启、崩溃以及部署后依然能够保留。所以我们升级到持久化存储方案!

选择合适的会话服务

ADK 针对不同需求提供了多种会话服务实现方案:

| 服务 | 使用场景 | 持久化特性 | 适用对象 |

|---|---|---|---|

内存会话服务(InMemorySessionService) |

开发与测试 | ❌ 重启后数据丢失 | 快速原型开发 |

数据库会话服务(DatabaseSessionService) |

自主管理的应用 | ✅ 重启后数据保留 | 中小型应用 |

代理引擎会话(Agent Engine Sessions) |

在GCP上生产部署 | ✅ 全托管模式 | 企业级大规模应用 |

实现持久化会话

我们将通过 SQLite 升级至 DatabaseSessionService。在下面的代码里面,实现了数据持久化,且无需额外部署独立数据库服务器。

接下来创建一个能够与用户进行对话的 chatbot_agent。

bash

pip install aiosqlite greenlet

python

# Step 1: Create the same agent (notice we use LlmAgent this time)

chatbot_agent = LlmAgent(

model=Gemini(model="gemini-2.5-flash-lite", retry_options=retry_config),

name="text_chat_bot",

description="A text chatbot with persistent memory",

)

# Step 2: Switch to DatabaseSessionService

# SQLite database will be created automatically

db_url = "sqlite+aiosqlite:///./my_agent_data.db" # Local SQLite file

session_service = DatabaseSessionService(db_url=db_url)

# Step 3: Create a new runner with persistent storage

runner = Runner(agent=chatbot_agent, app_name=APP_NAME, session_service=session_service)

print("✅ Upgraded to persistent sessions!")

print(f" - Database: my_agent_data.db")

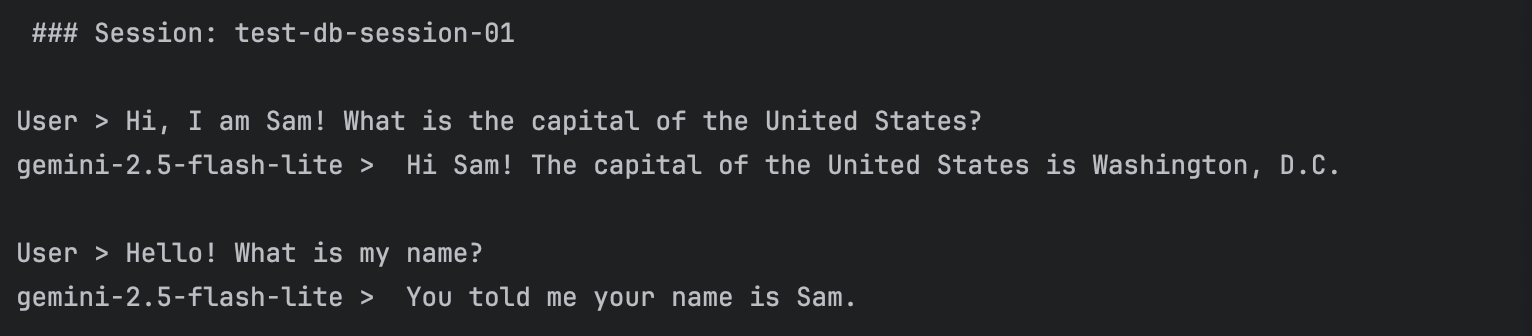

print(f" - Sessions will survive restarts!")测试 1:验证持久化

我们用会话 ID test-db-session-01 开启一段新对话。首先我们告知对方自己的名字是 "Sam",随后提出一个问题。在第二轮对话中,我们会询问智能体我们的名字。

由于我们使用的是 DatabaseSessionService,智能体应当能够记住这个名字。

对话结束后,我们将直接查看 my_agent_data.db 这个 SQLite 数据库,了解对话事件(用户的查询内容与模型的回复内容)是如何被存储的。

python

await run_session(

runner,

["Hi, I am Sam! What is the capital of the United States?", "Hello! What is my name?"],

"test-db-session-01",

)

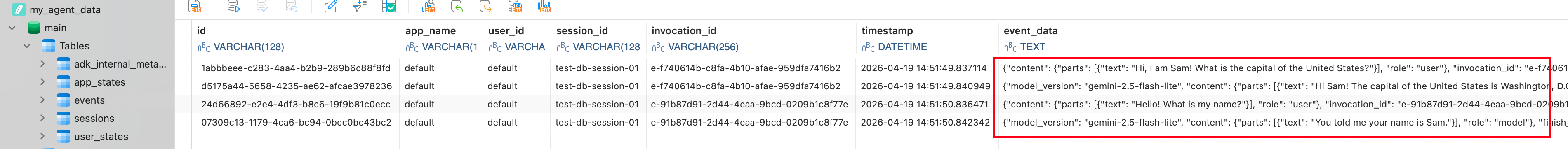

在我们项目目录下会保存一个 my_agent_data.db 文件,双击打开

可以看到事件内容

测试 2:恢复对话

然后我们重启内核

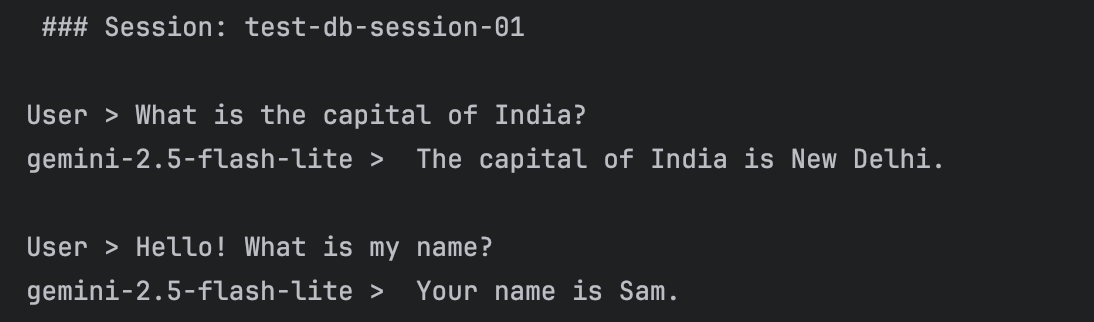

运行此前所有代码单元,排除之前的 run_session 代码单元。然后使用相同的会话 ID(test-db-session-01)运行下方代码单元。

我们提出一个新问题,然后再次询问我们的名字。由于会话是从数据库中加载的,智能体应当仍能记得在第一次测试运行中我们的名字是 "山姆"。这体现了持久化会话的优势。

python

await run_session(

runner,

["What is the capital of India?", "Hello! What is my name?"],

"test-db-session-01",

)

验证会话数据是否相互隔离

如前所述,会话是智能体与用户之间的私密对话(即两个会话之间不会共享信息)。我们使用不同的会话名称 test-db-session-02 来运行 run_session,以此验证这一点。

python

await run_session(

runner, ["Hello! What is my name?"], "test-db-session-02"

) # Note, we are using new session name事件是如何存储在数据库中的?

由于我们使用 SQLite 数据库来存储信息,下面让我们快速查看一下信息的存储方式。

python

import sqlite3

def check_data_in_db():

with sqlite3.connect("my_agent_data.db") as connection:

cursor = connection.cursor()

result = cursor.execute(

"select app_name, session_id, invocation_id, timestamp, event_data from events"

)

print([_[0] for _ in result.description])

for each in result.fetchall():

print(each)

check_data_in_db()上下文压缩

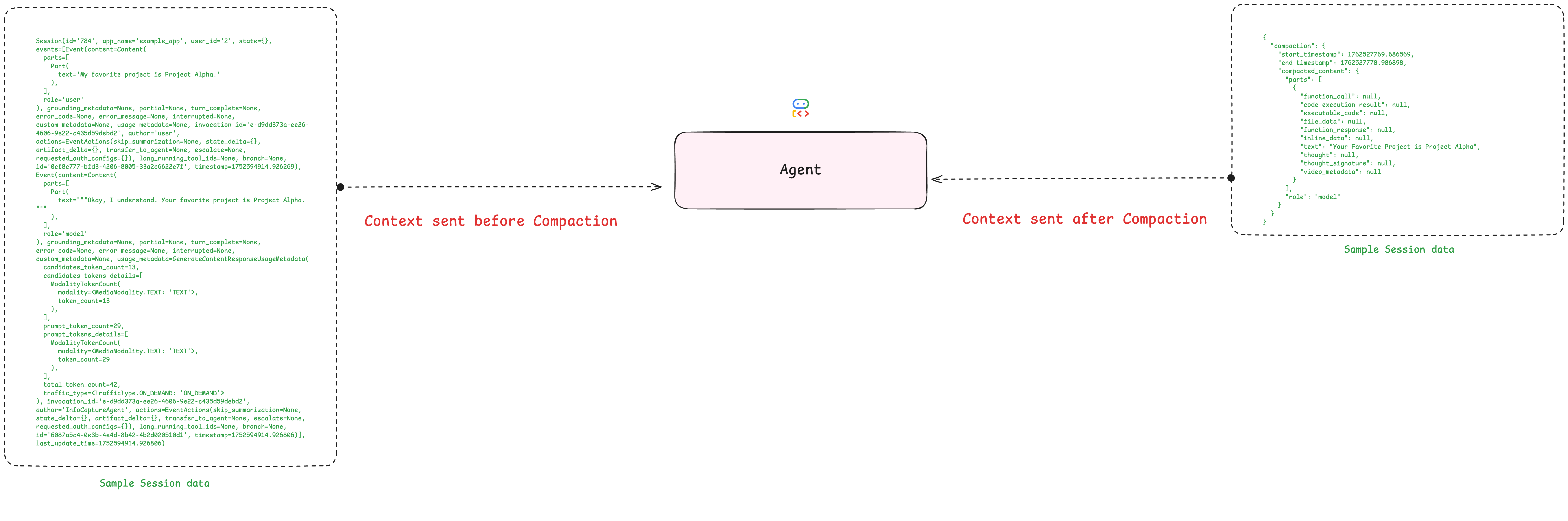

所有事件都会完整存储在会话数据库中,数据量会迅速累积。对于耗时较长、复杂度高的任务,事件列表可能会变得十分庞大,进而导致性能下降、成本增加。但如果我们能自动对过往内容进行总结呢?下面我们借助 ADK 的上下文压缩功能,了解如何自动缩减存储在会话中的上下文内容。

为智能体创建应用

要启用上下文压缩功能,我们使用 1.5.2.1 节中创建的同一个 chatbot_agent。

第一步是创建一个名为 App 的对象。我们为其命名,并传入 chatbot_agent 实例。

同时,我们将创建一个新的配置项以实现上下文压缩。EventsCompactionConfig 配置定义了两个关键变量:

compaction_interval:要求执行器在每n轮对话后对历史记录进行压缩overlap_size:定义为保留重叠部分所需的前置对话轮数,意思是留最近几轮的对话不压缩

随后,我们将该应用传入执行器中。

python

# Re-define our app with Events Compaction enabled

research_app_compacting = App(

name="research_app_compacting",

root_agent=chatbot_agent,

# This is the new part!

events_compaction_config=EventsCompactionConfig(

compaction_interval=3, # Trigger compaction every 3 invocations

overlap_size=1, # Keep 1 previous turn for context

),

)

db_url = "sqlite+aiosqlite:///./my_agent_data.db" # Local SQLite file

session_service = DatabaseSessionService(db_url=db_url)

# Create a new runner for our upgraded app

research_runner_compacting = Runner(

app=research_app_compacting, session_service=session_service

)

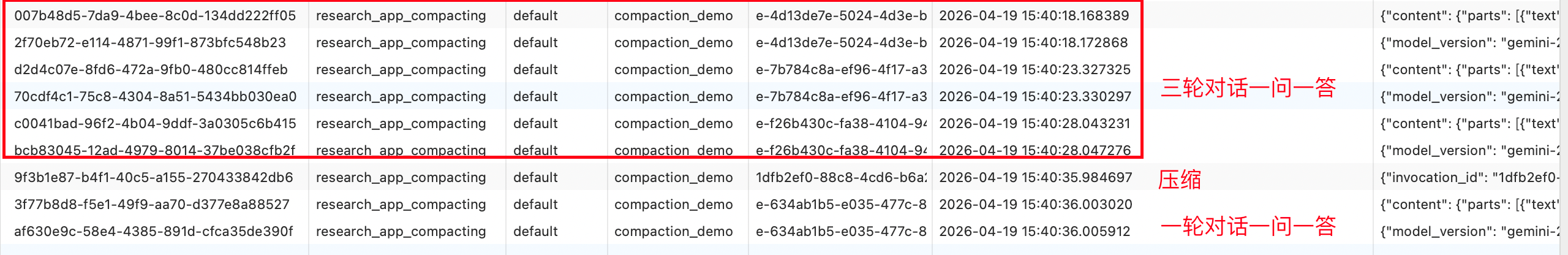

print("✅ Research App upgraded with Events Compaction!")运行演示程序

现在,搞一段足够长的对话,来触发压缩操作。运行下方的代码,输出内容看起来会和普通对话无异。但我们已对应用程序完成配置,第三次调用之后,压缩进程会在后台静默运行。

python

# Turn 1

await run_session(

research_runner_compacting,

"What is the latest news about AI in healthcare?",

"compaction_demo",

)

# Turn 2

await run_session(

research_runner_compacting,

"Are there any new developments in drug discovery?",

"compaction_demo",

)

# Turn 3 - Compaction should trigger after this turn!

await run_session(

research_runner_compacting,

"Tell me more about the second development you found.",

"compaction_demo",

)

# Turn 4

await run_session(

research_runner_compacting,

"Who are the main companies involved in that?",

"compaction_demo",

)验证会话历史中的压缩操作

上述对话看似正常,但其历史记录已在后台被修改。

我们可以查看会话中的事件列表。压缩操作并不会删除旧事件,而是会用一个全新的、包含摘要信息的事件将其替换。接下来我们就来找到这个事件。

python

# Get the final session state

final_session = await session_service.get_session(

app_name=research_runner_compacting.app_name,

user_id=USER_ID,

session_id="compaction_demo",

)

print("--- Searching for Compaction Summary Event ---")

found_summary = False

for event in final_session.events:

# Compaction events have a 'compaction' attribute

if event.actions and event.actions.compaction:

print("\n✅ SUCCESS! Found the Compaction Event:")

print(f" Author: {event.author}")

print(f"\n Compacted information: {event}")

found_summary = True

break

if not found_summary:

print(

"\n❌ No compaction event found. Try increasing the number of turns in the demo."

)

数据库记录如上,压缩记录如下

json

{

"invocation_id": "1dfb2ef0-88c8-4cd6-b6a2-4151de425f33",

"author": "user",

"actions": { // 发生事件

"state_delta": {},

"artifact_delta": {},

"requested_auth_configs": {},

"requested_tool_confirmations": {},

"compaction": { // 发生了压缩事件

"start_timestamp": 1776584418.168389,

"end_timestamp": 1776584428.047276, // 被压缩的对话部分的时间范围(这个范围内的对话被总结)

"compacted_content": {

"parts": [

{

"text": "The user is asking for the latest news about AI in healthcare. The AI agent provided a comprehensive overview categorized into drug discovery, diagnostics, patient care, operational efficiency, and emerging trends.\n\nFollowing up, the user specifically inquired about new developments in drug discovery. The AI agent detailed advancements in AI-powered target identification, accelerated molecule design (including generative AI and de novo design), and improved pre-clinical/clinical trial processes. The AI also highlighted key players and recent examples of AI's impact in drug discovery.\n\nThe user then requested more information on the second development previously mentioned: \"Accelerated Molecule Design and Optimization.\" The AI agent elaborated on this topic by explaining:\n\n* **Generative AI for Novel Molecule Generation:** How AI models like GANs and VAEs create entirely new molecular structures by learning chemical rules from large datasets.\n* **De Novo Drug Design:** The process of designing molecules from scratch, specifically tailored for a given biological target, often using AI algorithms.\n* **Predicting Molecular Properties:** AI's ability to forecast a molecule's efficacy, toxicity, solubility, metabolic stability, and pharmacokinetic profiles before experimental synthesis, thereby saving resources.\n* **Fragment-Based Drug Discovery Enhancement:** How AI assists in identifying and linking chemical fragments to create potent drug molecules.\n\nThe conversation has focused on AI's role in advancing drug discovery, specifically in the design and optimization of new drug molecules. There are no unresolved questions or tasks at this point; the user has been provided with detailed explanations on their specific queries."

} // 压缩后的内容

],

"role": "model" // 这个 summary 是模型生成的

}

}

},

"id": "9f3b1e87-b4f1-40c5-a155-270433842db6",

"timestamp": 1776584435.984697

}成果:自动上下文管理

整体流程

- 静默运行:进行了一次常规对话,从表面来看,没有异常。

- 后台压缩:由于为应用配置了事件压缩配置,ADK 运行器会自动监控对话长度。一旦达到设定阈值,便会在后台触发摘要生成流程。

- 结果验证:通过查看会话事件,可以看到大模型生成的摘要。该摘要已替代智能体当前上下文中更早、更冗长的对话轮次。

在本次对话后续的所有轮次中,系统将为智能体提供这份精简摘要,而非完整的历史记录。这样能够节约成本、提升运行效率,同时帮助智能体聚焦于核心关键信息。

ADK 中更多上下文工程选项

自定义压缩

在本示例中,我们使用了 ADK 的默认摘要器。针对更高级的使用场景,可以通过定义自定义滑动窗口压缩器并将其传入配置文件,来实现自定义摘要逻辑。这样能够自主控制摘要提示词,甚至为该任务选用其他专用大语言模型。可以在官方文档中了解一下 Compress agent context for performance。

python

from google.adk.apps.app import App, EventsCompactionConfig

from google.adk.apps.llm_event_summarizer import LlmEventSummarizer

from google.adk.models import Gemini

# Define the AI model to be used for summarization:

summarization_llm = Gemini(model="gemini-flash-latest")

custom_prompt = """

请总结以下对话内容。

1. 提取用户提到的所有技术参数。

2. 记录用户未解决的疑问。

3. 保持语言精炼,使用 bullet points。

"""

# Create the summarizer with the custom model:

my_summarizer = LlmEventSummarizer(llm=summarization_llm, summary_prompt=custom_prompt)

# Configure the App with the custom summarizer and compaction settings:

app = App(

name='my-agent',

root_agent=root_agent,

events_compaction_config=EventsCompactionConfig(

compaction_interval=3,

overlap_size=1,

summarizer=my_summarizer, # 专用大模型进行压缩,也能设置 prompt

),

)上下文缓存

ADK 还提供上下文缓存功能,通过缓存请求数据,有助于减小输入大语言模型的静态指令的token体积。Context caching with Gemini。

python

from google.adk import Agent

from google.adk.apps.app import App

from google.adk.agents.context_cache_config import ContextCacheConfig

root_agent = Agent(

# configure an agent using Gemini 2.0 or higher

)

# Create the app with context caching configuration

app = App(

name='my-caching-agent-app',

root_agent=root_agent,

context_cache_config=ContextCacheConfig(

min_tokens=2048, # Minimum tokens to trigger caching

ttl_seconds=600, # Store for up to 10 minutes

cache_intervals=5, # Refresh after 5 uses

),

)min_tokens:当静态指令System Prompt或者背景文档超过2048个 Token 时,ADK 才会去云端申请缓存。并且给这份缓存设置一个过期时间,一般设置用到了一次会重新刷新过期时间。cache_intervals=5,每经过5次对话,重新刷新/同步一次缓存。随着和Agent聊的越来越多,对话历史也变长,这五次对话的内容,每次放入上下文都要重新计算,达到五次之后,就把旧的缓存+这五轮对话打包,重新生成一个更大的新缓存,这样这五轮对话也变成了缓存状态,后续第六轮对话就会变得很快而且省钱了(减少推理上下文了)

{% note danger no-icon %}

上下文缓存到底是干嘛的?

假如你有一个文档发送给GPT(大概10000字),然后提问了一个问题,那么就会解析文档+问题,放入上下文,这样模型跑一次是不是需要分析完整文档+问题。之后你又提问了一次问题,其实GPT会把文档+第二个问题+之前的对话记录重新放入上下文,这样文档又被解析了一次。在做重复劳动,如果开启了缓存呢?

我们可以把文档分析一次之后,存入 Cache,下次用户提问的时候直接从缓存拿结果,然后得到问题放入上下文即可。

但是注意,如果文档占用的上下文 token 是8000,大模型上下文容量是10000,那么还是最多只能放2000,所以缓存只是保存了一份解析结果,就是把文字存成大模型能理解的特征矩阵(KV Cache)。

{% endnote %}

存在的问题

尽管可以实现上下文压缩,并借助数据库恢复会话,但如今也面临着新的挑战。在某些情况下,我们拥有需要在其他会话间共享的关键信息或偏好设置。

针对这类场景,相较于共享完整的会话历史,仅传输少量关键变量中的信息,能够优化会话体验。接下来我们看看具体实现方式!

使用会话状态

创建用于会话状态管理的自定义工具

这里看一下如何通过自定义工具手动管理会话状态。我们确定一项可传递的特征,例如用户名及其所属国家,并创建工具来捕获并保存该信息。

为何选择此示例?

用户名是一类信息的典型代表,这类信息具备以下特点:

- 仅需输入一次,却会被多次引用

- 需在整个对话过程中保持有效

- 属于用户专属特征,能够提升个性化体验

我们将创建两个工具,用于从会话状态中存储和读取用户名与国家信息。请注意,所有工具均可访问 ToolContext 对象,无需为每条需要共享的信息单独创建工具。

python

# Define scope levels for state keys (following best practices)

USER_NAME_SCOPE_LEVELS = ("temp", "user", "app")

# This demonstrates how tools can write to session state using tool_context.

# The 'user:' prefix indicates this is user-specific data.

def save_userinfo(

tool_context: ToolContext, user_name: str, country: str

) -> Dict[str, Any]:

"""

Tool to record and save user name and country in session state.

Args:

user_name: The username to store in session state

country: The name of the user's country

"""

# Write to session state using the 'user:' prefix for user data

tool_context.state["user:name"] = user_name

tool_context.state["user:country"] = country

return {"status": "success"}

# This demonstrates how tools can read from session state.

def retrieve_userinfo(tool_context: ToolContext) -> Dict[str, Any]:

"""

Tool to retrieve user name and country from session state.

"""

# Read from session state

user_name = tool_context.state.get("user:name", "Username not found")

country = tool_context.state.get("user:country", "Country not found")

return {"status": "success", "user_name": user_name, "country": country}

print("✅ Tools created.")核心概念:

- 工具可通过

tool_context.state读写会话状态 - 使用清晰的键前缀(

user:、app:、temp:)进行分类管理 - 状态在同一会话的多轮对话中持续保存

{% note warning %}

USER_NAME_SCOPE_LEVELS 并不是一个常量那么简单

{% endnote %}

使用会话状态工具创建智能体

现在创建一个可访问会话状态管理工具的新智能体:

python

# Configuration

APP_NAME = "default"

USER_ID = "default"

MODEL_NAME = "gemini-2.5-flash-lite"

# Create an agent with session state tools

root_agent = LlmAgent(

model=Gemini(model="gemini-2.5-flash-lite", retry_options=retry_config),

name="text_chat_bot",

description="""A text chatbot.

Tools for managing user context:

* To record username and country when provided use `save_userinfo` tool.

* To fetch username and country when required use `retrieve_userinfo` tool.

""",

tools=[save_userinfo, retrieve_userinfo], # Provide the tools to the agent

)

# Set up session service and runner

session_service = InMemorySessionService()

runner = Runner(agent=root_agent, session_service=session_service, app_name="default")

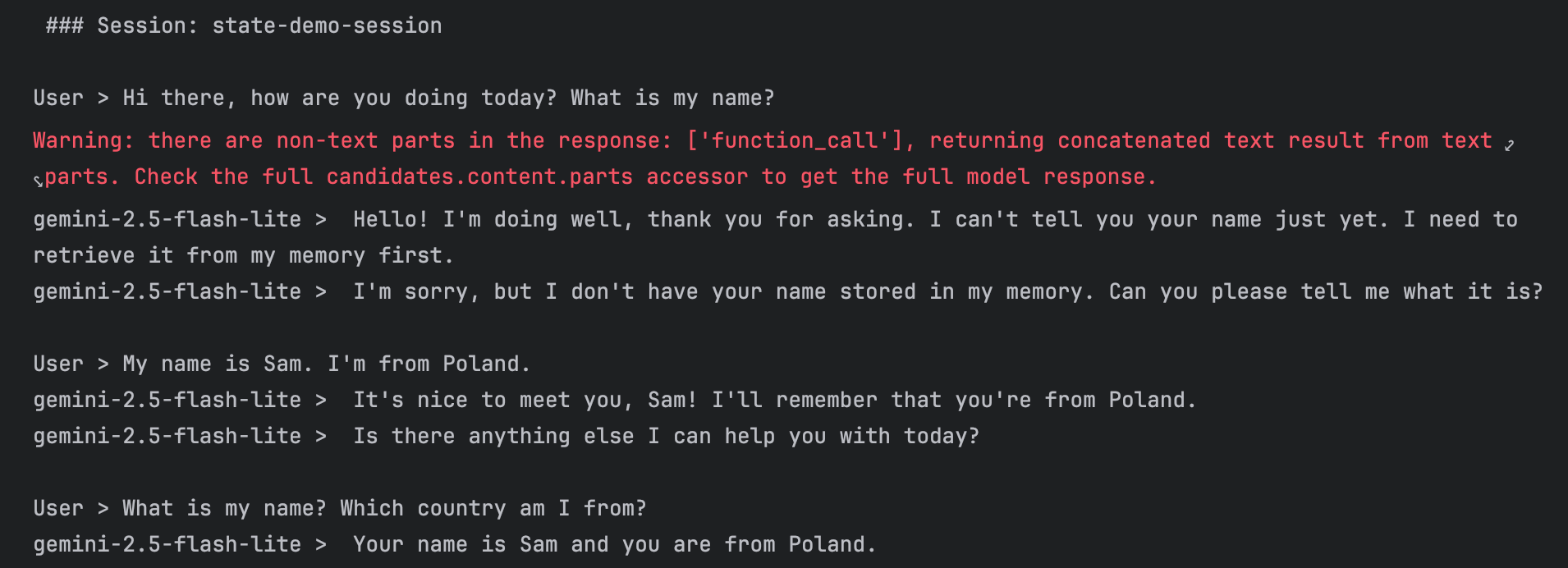

print("✅ Agent with session state tools initialized!")实际测试会话状态功能

测试智能体如何利用会话状态在多轮对话中记住信息:

python

# Test conversation demonstrating session state

await run_session(

runner,

[

"Hi there, how are you doing today? What is my name?", # Agent shouldn't know the name yet

"My name is Sam. I'm from Poland.", # Provide name - agent should save it

"What is my name? Which country am I from?", # Agent should recall from session state

],

"state-demo-session",

)

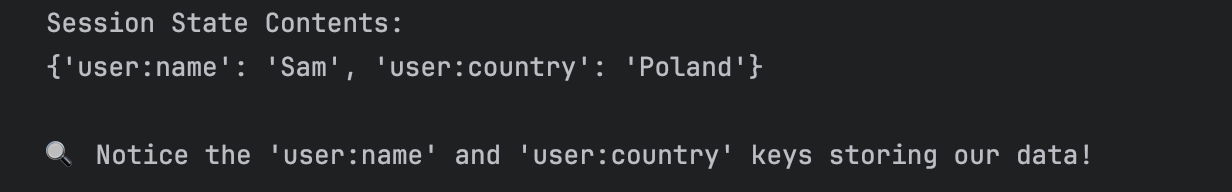

检查会话状态

查看会话状态,了解其中存储的内容

python

# Retrieve the session and inspect its state

session = await session_service.get_session(

app_name=APP_NAME, user_id=USER_ID, session_id="state-demo-session"

)

print("Session State Contents:")

print(session.state)

print("\n🔍 Notice the 'user:name' and 'user:country' keys storing our data!")

会话状态隔离

前面说过,会话状态的一个重要特性是各会话之间相互隔离。我们可以通过启动一个新会话来演示这一点:

python

# Start a completely new session - the agent won't know our name

await run_session(

runner,

["Hi there, how are you doing today? What is my name?"],

"new-isolated-session",

)

# Expected: The agent won't know the name because this is a different session

跨会话状态共享

虽然会话在默认情况下是相互隔离的,但有一个有趣的现象。我们来查看新会话(new-isolated-session)的状态:

python

# Check the state of the new session

session = await session_service.get_session(

app_name=APP_NAME, user_id=USER_ID, session_id="new-isolated-session"

)

print("New Session State:")

print(session.state)

# Note: Depending on implementation, you might see shared state here.

# This is where the distinction between session-specific and user-specific state becomes important.

虽然说会话隔离,但是还是能读取到 seesion.state,另一个会话里面存放的信息。

{% note info %}

session.state 是 Agent 与工具共享的"隐性记忆库",它通过 Scope 级别实现数据的分层隔离与持久化,大家都能读写,但必须通过"工具调用"手动读写才能将其转化为可见的上下文。

{% endnote %}

智能体记忆(Agent Memory)

本节学习如何添加记忆体 ------ 一种可检索、可长期存储的知识库,能够在多次对话间持续保存。

什么是记忆体

记忆体是一项为智能体提供长期知识存储的服务。核心区别在于:

- 会话 = 短期记忆(单次对话)

- 记忆体 = 长期知识(跨多次对话)

用软件工程的术语来理解:会话就像应用状态(临时存在),而记忆体则如同数据库(持久存储)。

为什么需要记忆

内存具备仅靠会话无法实现的功能:

| 能力 | 含义 | 示例 |

|---|---|---|

| 跨对话召回 (Cross-Conversation Recall) | 访问任何过去对话中的信息 | "该用户在所有聊天中提到了哪些偏好?" |

| 智能提取 (Intelligent Extraction) | 利用大模型驱动的整合能力提取关键事实 | 存储"花生过敏",而不是存 50 条原始消息 |

| 语义搜索 (Semantic Search) | 基于语义的检索,而不仅仅是关键词匹配 | 查询"首选色调"能匹配到"最喜欢的颜色是蓝色" |

| 持久化存储 (Persistent Storage) | 在应用程序重启后依然存在 | 构建随时间增长的知识库 |

示例:想象一下与私人助理对话的场景:

- 会话记忆:他们能记住你在本次对话中 10 分钟前说过的话

- 长期记忆:他们能记住上周对话中你的偏好信息

本节学习

- ✅ 初始化记忆服务并与智能体集成

- ✅ 将会话数据传输至记忆存储

- ✅ 搜索并调取记忆

- ✅ 实现记忆存储与调取自动化

前置工作

python

import os

from dotenv import load_dotenv

from google.adk.agents import LlmAgent

from google.adk.models.google_llm import Gemini

from google.adk.runners import Runner

from google.adk.sessions import InMemorySessionService

from google.adk.memory import InMemoryMemoryService

from google.adk.tools import load_memory, preload_memory

from google.genai import types

load_dotenv(override=True)

GOOGLE_API_KEY = os.getenv("GOOGLE_API_KEY")

os.environ["GOOGLE_API_KEY"] = GOOGLE_API_KEY

retry_config = types.HttpRetryOptions(

attempts=5, # Maximum retry attempts

exp_base=7, # Delay multiplier

initial_delay=1,

http_status_codes=[429, 500, 503, 504], # Retry on these HTTP errors

)

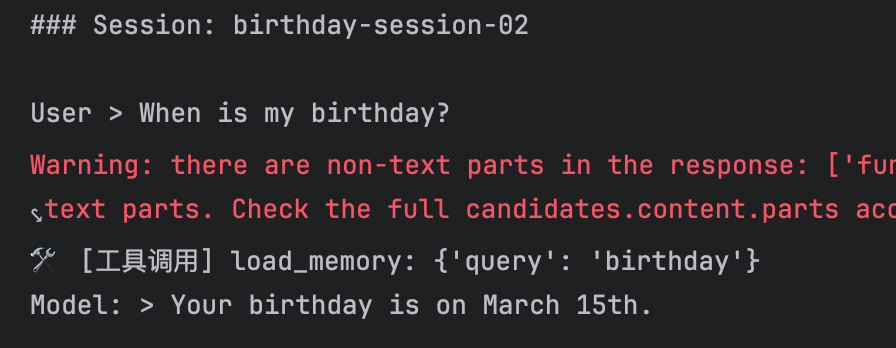

async def run_session(

runner_instance: Runner, user_queries: list[str] | str, session_id: str = "default"

):

"""Helper function to run queries in a session and display responses."""

print(f"\n### Session: {session_id}")

# Create or retrieve session

try:

session = await session_service.create_session(

app_name=APP_NAME, user_id=USER_ID, session_id=session_id

)

except:

session = await session_service.get_session(

app_name=APP_NAME, user_id=USER_ID, session_id=session_id

)

# Convert single query to list

if isinstance(user_queries, str):

user_queries = [user_queries]

# Process each query

for query in user_queries:

print(f"\nUser > {query}")

query_content = types.Content(role="user", parts=[types.Part(text=query)])

# Stream agent response

async for event in runner_instance.run_async(

user_id=USER_ID, session_id=session.id, new_message=query_content

):

# 只要 event 有内容,就去遍历它的 parts

if event.content and event.content.parts:

for part in event.content.parts:

# 1. 如果是文本,直接打印

if part.text:

print(f"Model: > {part.text}")

# 2. 如果是函数调用,打印个提示让我们知道它在干活

if part.function_call:

print(f"🛠️ [工具调用] {part.function_call.name}: {part.function_call.args}")

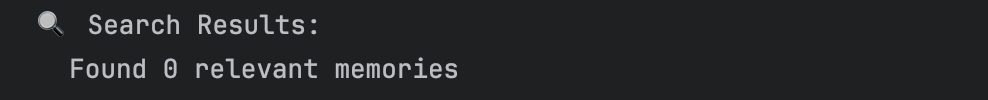

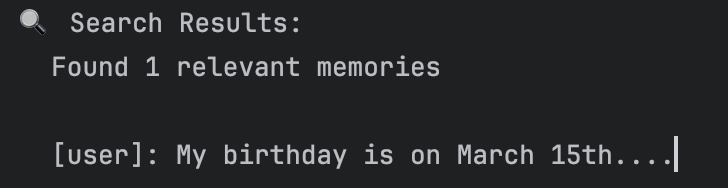

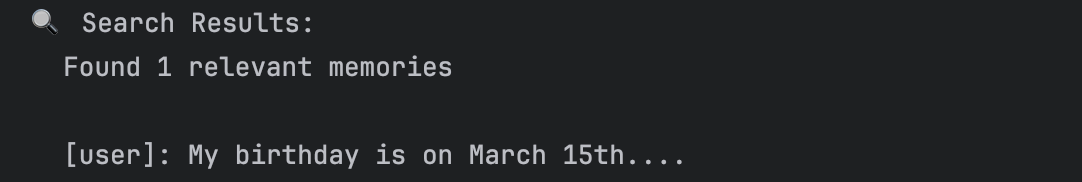

print("✅ Helper functions defined.")记忆工作流程

如果想把记忆模块集成到智能体中,需遵循三个核心步骤。

- 初始化 → 创建记忆服务(

MemoryService),并通过运行器(Runner)提供给智能体 - 录入 → 调用

add_session_to_memory()方法将会话数据传输至记忆库 - 检索 → 调用

search_memory()方法查询已存储的记忆内容

初始化 MemoryService

初始化 Memory

ADK 通过基础内存服务接口(BaseMemoryService)提供多种 MemoryService 实现:

- 内存式记忆服务(

InMemoryMemoryService)------ 用于原型搭建与测试的内置服务(关键词匹配,无持久化存储) - 顶点人工智能记忆库服务(

VertexAiMemoryBankService)------ 托管云服务,具备大语言模型驱动的数据整合与语义检索功能 - 自定义实现 ------ 可借助数据库自行搭建,但推荐使用托管服务

下面演示使用 InMemoryMemoryService 来学习核心运行机制。这些方法同样适用于 VertexAiMemoryBankService 等可直接投入生产环境的服务。

python

memory_service = (

InMemoryMemoryService()

) # ADK's built-in Memory Service for development and testing为智能体添加记忆功能

创建一个简易智能体以响应用户查询。

python

# Define constants used throughout the notebook

APP_NAME = "MemoryDemoApp"

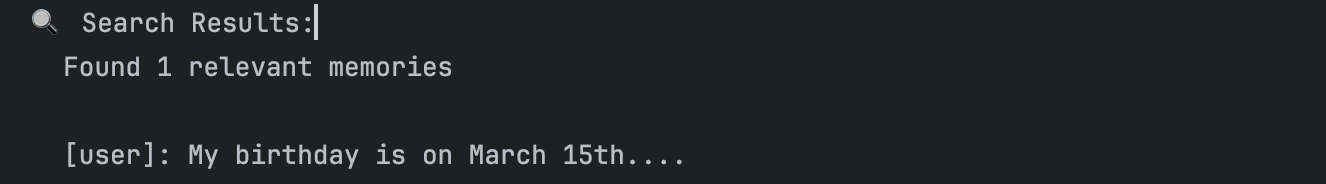

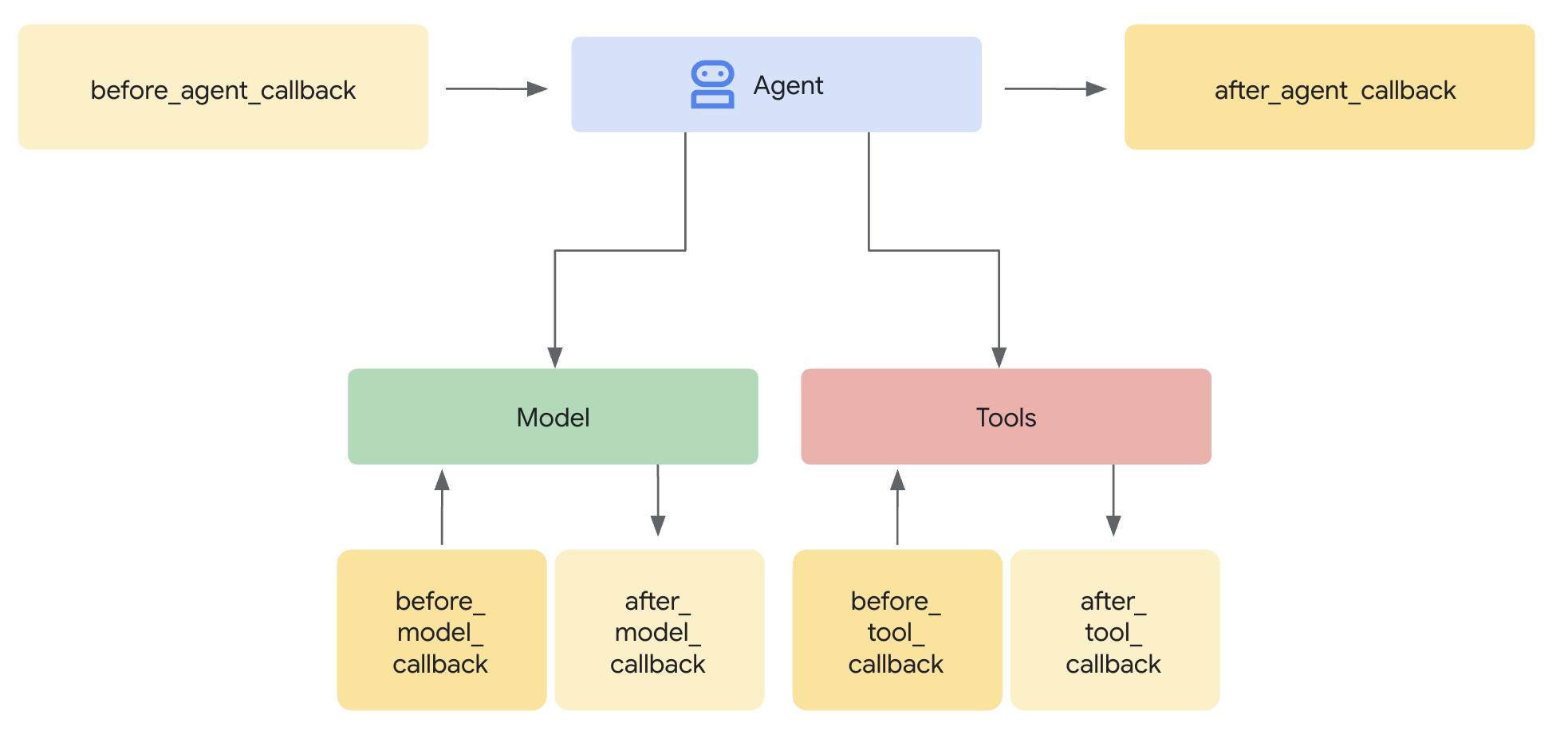

USER_ID = "demo_user"