你写下一行

if (type == PDF) handlePdf(),觉得稀疏平常。CPU 却在你执行之前,就开始"押注"哪条路更可能走。

猜对了,流水线畅通无阻;猜错了,十几条指令的结果全部作废,从头再来。

这就是 分支预测 ------ CPU 里的"赌神",也是你 Java 代码性能的隐形判官。

我是 Evan ,一个在智荟知识库 RAG 系统里优化文档类型路由、在向量检索中加速相似度排序的 Java+AI 学生。今天,我们从计算机组成原理的 分支预测 出发,看它如何影响 Java 中的 if 性能,并带你用 likely/unlikely 宏、循环展开、数据驱动设计等手段,写出"对 CPU 友好"的高性能代码。

📌 写在前面

大二学计组,老师讲"分支预测失败会导致流水线冲刷",我只知道背下来考试。

直到我在知识汇教育平台中写一个根据用户类型(VIP/普通/新用户)分发优惠券的逻辑,用了一堆 if-else,压测时发现性能总上不去。

后来我把高频路径提到前面,性能提升了 30%。

那一刻我才明白:CPU 根本不是按顺序傻执行,它在猜你的 if 往哪走 。

这篇博客,我就带你走进 CPU 的"猜谜大脑",看看分支预测如何左右 Java 代码的性能,以及怎么在 AI 向量检索这种计算密集型场景里"骗"过 CPU。

一、流水线与分支预测:CPU 的"高速公路"与"急刹车"

1.1 流水线:指令级并行

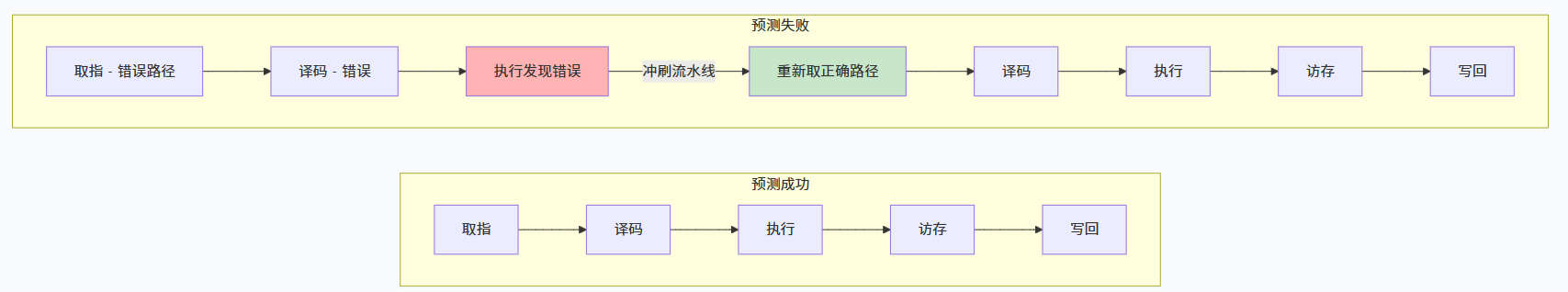

现代 CPU 不是一次执行一条指令,而是将指令拆成多个阶段(取指、译码、执行、访存、写回),形成流水线。

理想的流水线每个时钟周期完成一条指令。

1.2 分支指令的难题

遇到 if (condition) 时,CPU 不知道下一条指令是该走 then 分支还是 else 分支,因为条件结果要等执行阶段才知道。

如果等结果出来再取下一条指令,流水线就会停顿(bubble)。

分支预测器 登场:CPU 根据历史记录"猜"分支走向。

-

预测成功:流水线不停,继续执行。

-

预测失败 :流水线中已预取的指令全部作废(流水线冲刷),清空后重新取正确路径的指令。

分支预测失败的代价:10~20 个时钟周期(取决于流水线深度)。

二、Java 中的 if:分支预测的间接参与者

Java 代码经过 JIT 编译成机器码后,分支指令(如 je、jne)会原样存在。

JIT 编译器可以做两种优化:

2.1 分支重排序(Branch Reordering)

JIT 会尝试识别最可能走的分支 ,将其放在 fall-through 路径(顺序执行),而将冷分支放在跳转目标位置。

这样预测器更容易猜对。

例子:

java

if (response.isSuccess()) {

// 正常路径 90% 概率

processSuccess();

} else {

// 异常路径 10% 概率

handleError();

}JIT 生成的汇编会将 processSuccess() 放在紧跟着条件判断的指令后,handleError() 放在远处。

2.2 @Profile 与 HotSpot 的"不可能分支"

HotSpot 有运行时分析,如果某个分支从未被执行过,JIT 可能会将其假定为"从来不会发生",甚至在生成的代码中直接移除该分支(无条件的抛异常或 assert)。

但这只限于极冷路径。

Java 语言本身没有 likely/unlikely 宏,但 JIT 的启发式算法可以自动推断。

三、开发场景:大量 if 的类型判断(RAG 文档格式路由)

在智荟知识库系统中,用户上传 PDF、TXT、Markdown、Word 等多种格式文档。

解析器需要根据文件后缀或 MIME 类型走不同处理逻辑:

java

Document parse(String filePath, String type) {

if (type.equals("pdf")) return parsePdf(filePath);

else if (type.equals("txt")) return parseTxt(filePath);

else if (type.equals("md")) return parseMd(filePath);

else if (type.equals("docx")) return parseDocx(filePath);

else throw new UnsupportedException();

}如果有几十种格式,最后一个 else if 会经历几十次条件判断。

分支预测失败的代价在单次调用中微不足道,但在 RAG 里每秒钟要处理上千个文档分片,累积效果就很明显。

优化方案:

3.1 用 switch 替代链式 if-else

switch 可以用 跳转表(jump table) 实现,O(1) 跳转,不存在分支预测问题。

java

switch (type) {

case "pdf": return parsePdf(filePath);

case "txt": return parseTxt(filePath);

// ...

default: throw ...;

}3.2 使用 HashMap 映射解析器

java

Map<String, Function<String, Document>> parsers = new HashMap<>();

parsers.put("pdf", this::parsePdf);

// ...

return parsers.get(type).apply(filePath);虽然多了一次哈希计算,但彻底消除了分支预测失败。

四、AI 向量检索加速:排序中的分支预测优化

在向量检索(如 FAISS)中,我们需要计算海量向量与查询向量的相似度,然后排序 取 Top-K。

排序算法的核心是比较两个分数:if (a.score > b.score)。

4.1 比较器的分支预测

java

list.sort((a, b) -> {

if (a.score > b.score) return -1;

else if (a.score < b.score) return 1;

else return 0;

});在 TimSort 或快速排序中,比较结果通常是随机分布,分支预测失败率接近 50%。

优化方法:

-

使用 无分支比较 :例如用

Double.compare,它内部用位操作而不是分支。 -

或者用 基数排序(对浮点数转整数的技巧),完全避免比较。

4.2 预过滤 + 粗排

如果 Top-K 只需要最相似的 100 个,可以先快速筛选出候选集(例如用 HNSW 图遍历),而不是对全量排序。

这样 if 数量大幅减少。

在智荟知识库中,我们对 100 万条向量先用 FAISS 的索引召回 top-500(HNSW 遍历,避免大规模排序),然后再对 500 个结果做精确排序。

分支预测失败从百万次降至数百次,耗时减半。

五、likely() 与 unlikely():C/C++ 的"提示宏"能教 Java 什么?

在 Linux 内核和很多高性能 C 代码中,会用宏提示编译器分支概率:

cpp

#define likely(x) __builtin_expect(!!(x), 1)

#define unlikely(x) __builtin_expect(!!(x), 0)

if (likely(ptr != NULL)) {

// 大概率进入

}编译器会根据提示生成指令布局:冷分支放到远处,热分支 fall-through。

Java 没有这个语法,但你可以人工调整分支顺序:把高频路径的代码放在条件判断后紧接着写。

Java 实践:

java

// 不好的写法:异常路径放在前面

if (!isValid) {

handleError();

return;

}

doNormal();

// 好的写法:正常路径放前面

if (isValid) {

doNormal();

} else {

handleError();

}📝 总结

核心结论 :

分支预测是 CPU 内部的"猜谜",Java 开发者虽不能直接控制,但可以通过 减少分支数量、优化分支顺序、使用跳转表或数据结构替代条件分支 等技巧,让 CPU 猜得更准,代码跑得更快。

🤔 思考题 :

你在 RAG 系统中有一个函数,需要根据文档类型(PDF、TXT、DOCX)选择解析器。使用链式 if-else,测试发现每秒只能处理 2000 个文档。改为 switch 后,提升到 4000 个。但你改用 HashMap 后,每秒反而只有 3500 个。

问题 :为什么 HashMap 比 switch 慢?在什么情况下 HashMap 会优于 switch?如何进一步优化这个场景?(提示:考虑哈希计算开销、CPU 缓存命中率、以及分支预测的区别)

欢迎在评论区留下你的分析 ------ 下一篇我会聊聊 "伪共享(False Sharing):为什么你的多线程程序性能倒退了 10 倍?"。