🎬 渡水无言 :个人主页渡水无言

❄专栏传送门 : 《linux专栏》《嵌入式linux驱动开发》《linux系统移植专栏》

❄专栏传送门 : 《freertos专栏》 《STM32 HAL库专栏》《linux裸机开发专栏》

⭐️流水不争先,争的是滔滔不绝

📚博主简介:第二十届中国研究生电子设计竞赛全国二等奖 |国家奖学金 | 省级三好学生

| 省级优秀毕业生获得者 | csdn新星杯TOP18 | 半导纵横专栏博主 | 211在读研究生

在这里主要分享自己学习的linux嵌入式领域知识;有分享错误或者不足的地方欢迎大佬指导,也欢迎各位大佬互相三连

目录

[1. 安装 WSL2(Windows 用户必备)](#1. 安装 WSL2(Windows 用户必备))

[编辑2. 安装 Docker Desktop](#编辑2. 安装 Docker Desktop)

[三、第一步:安装并配置 Ollama(本地大模型环境)](#三、第一步:安装并配置 Ollama(本地大模型环境))

[1. 下载安装 Ollama](#1. 下载安装 Ollama)

[2. 关键环境变量配置](#2. 关键环境变量配置)

[3、下载并启动对话模型(以 Qwen3:8B 为例)](#3、下载并启动对话模型(以 Qwen3:8B 为例))

[四、RAGFlow 的安装和部署](#四、RAGFlow 的安装和部署)

前言

最近在做项目时,遇到需要构建个人知识库的需要,所以本期从零搭建一套完全本地、无依赖、可离线使用的个人知识库系统。

一、方案介绍

1. Ollama:本地大模型的 "万能管家"

Ollama 是一款轻量工具,一键就能在本地部署和管理各类大语言模型(LLM),不用复杂的环境配置,新手也能快速上手。我们用它来部署对话模型和嵌入模型,所有数据全程在本地运行,隐私性拉满。

2. RAGFlow:开箱即用的知识库框架

RAGFlow 是一款基于检索增强生成(RAG)的开源知识库工具,支持多种文件格式解析、智能分块和向量检索,搭配 Ollama 就能实现 "上传文档→智能问答" 的完整流程,完全不用自己从零写代码。

二、前置环境准备

1. 安装 WSL2(Windows 用户必备)

Windows 版 Docker Desktop 依赖 WSL2 作为后端运行环境,需先安装 WSL2:

以管理员身份打开 PowerShell,执行安装命令:

cpp

wsl --install安装完成后重启电脑,设置 Ubuntu 账号密码。

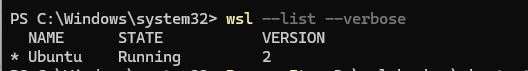

验证安装:

cpp

wsl --list --verbose输出显示 Ubuntu 版本为 2 即安装成功。

💡 节省 C 盘空间:可将 WSL2 虚拟磁盘迁移至 D 盘,避免占用系统盘空间。步骤如下:

关闭所有 WSL 实例:

cpp

wsl --shutdown作用:停止所有运行中的 WSL 环境,确保虚拟磁盘文件没有被占用。

导出 Ubuntu 为备份文件(存到 D 盘)

cpp

mkdir D:\wsl-backup

wsl --export Ubuntu D:\wsl-backup\ubuntu.tar作用:把 C 盘里的 Ubuntu 系统完整备份成一个 tar 包,存到 D 盘,方便后续导入。

注销当前 Ubuntu 发行版。

cpp

wsl --unregister Ubuntu⚠️ 注意:这一步会删除 C 盘里的 Ubuntu 系统文件,但不会删除刚才导出的备份文件。

在 D 盘创建新的 WSL 目录

cpp

mkdir D:\wsl作用:创建新的安装目录,用来存放迁移后的 Ubuntu 系统。

把备份的 Ubuntu 导入到 D 盘

cpp

wsl --import Ubuntu D:\wsl\Ubuntu D:\wsl-backup\ubuntu.tar --version 2恢复默认登录用户

cpp

ubuntu config --default-user administrator验证迁移是否成功

cpp

wsl --list --verbose如果输出里的Ubuntu状态为Running,版本为2,说明迁移成功,如下图所示:

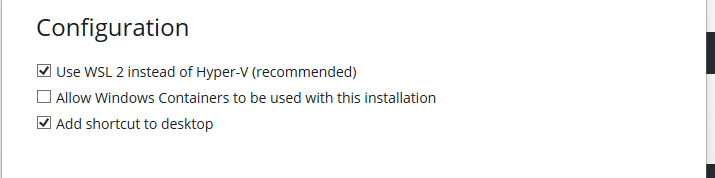

- 安装 Docker Desktop

访问 Docker 官网下载安装包,安装时勾选如下图所示:

启动 Docker Desktop,等待右下角图标变绿(服务运行中)。

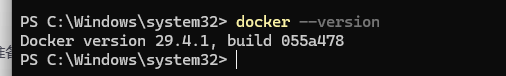

验证安装:

新开 PowerShell 窗口执行:

cpp

docker --version输出版本号即成功,如下图所示:

三、第一步:安装并配置 Ollama(本地大模型环境)

1. 下载安装 Ollama

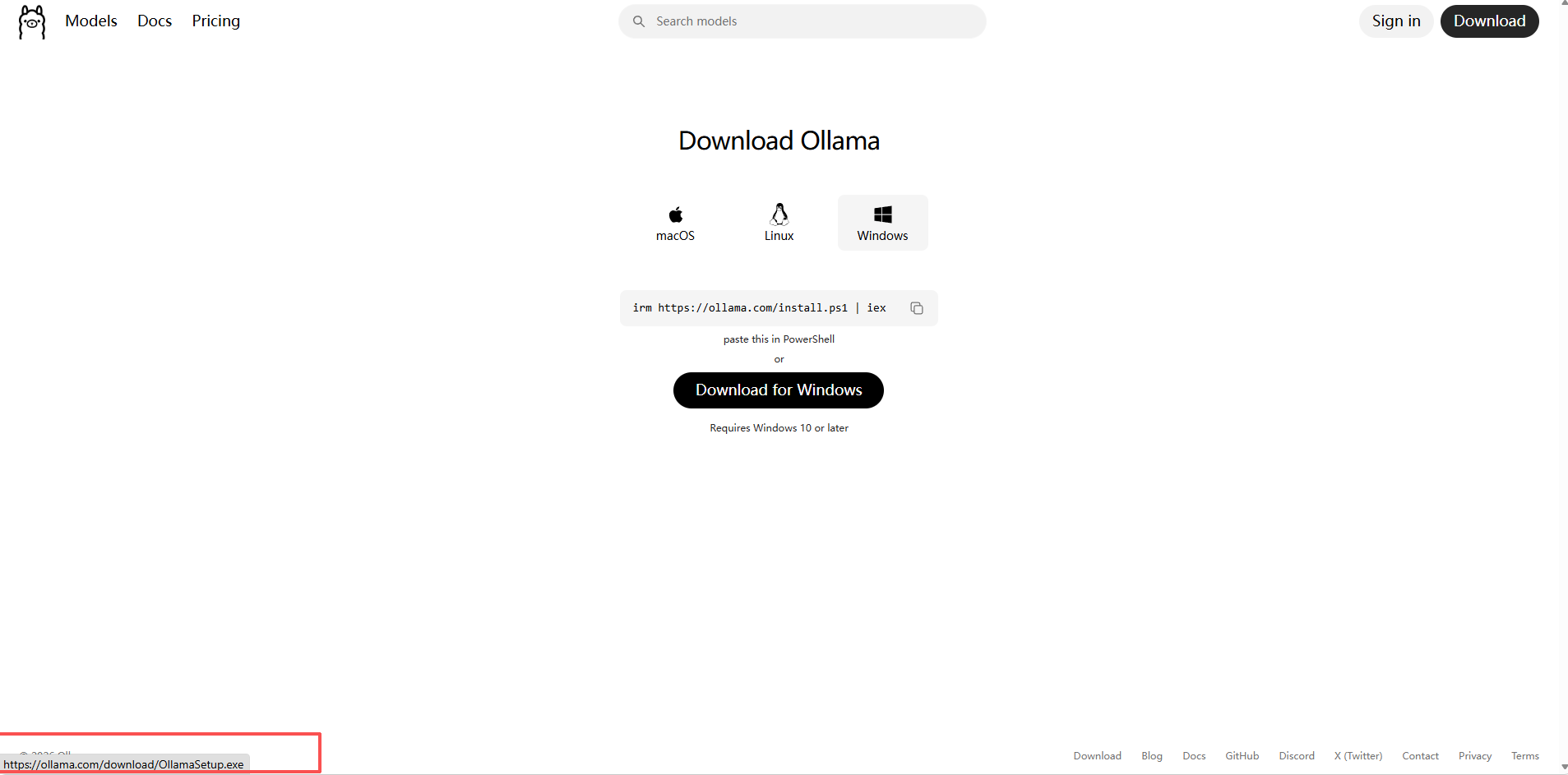

访问 Ollama 官网,根据你的系统(Windows/macOS/Linux)下载对应版本安装包,默认路径安装即可。如下图所示:

很多人会苦恼 ollama 软件下载很慢,解决思路如下(个人亲测好用方法):

使用某雷软件加速下载(推荐)

鼠标悬停,会在左下角显示下载链接。点击右键,选择复制下载链接。如下图所示:

然后复制完直接到迅雷去下载即可。

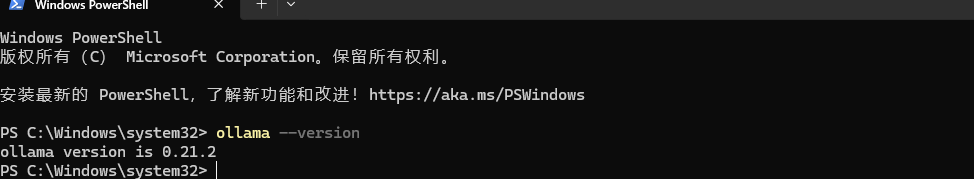

安装完成后,打开 PowerShell 输入以下命令验证是否安装成功:

cpp

ollama --version如下图所示:

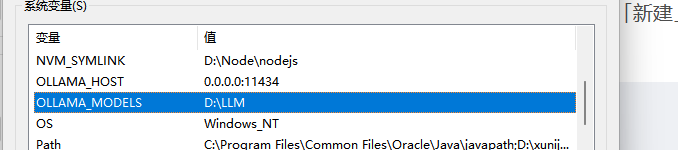

2. 关键环境变量配置

安装后一定要配置两个核心环境变量,否则后续会出现模型路径乱存、跨服务访问失败等问题:

右键「此电脑」→「属性」→「高级系统设置」→「环境变量」,在系统变量中点击「新建」

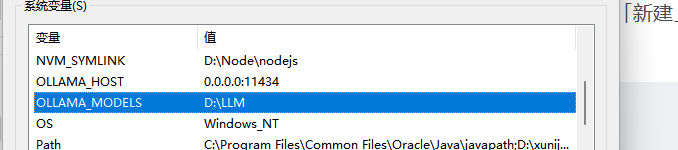

配置第一个变量:让其他服务(如 RAGFlow)能访问本地 Ollama

变量名:OLLAMA_HOST

变量值:0.0.0.0:11434

如下图所示:

配置第二个变量:修改模型默认存储路径,避免占满 C 盘

变量名:OLLAMA_MODELS。

变量值:D:\LLM(可自定义为你想存模型的路径,建议 D 盘)。

配置完成后,必须重启电脑,否则变量不生效!如下图所示:

3、下载并启动对话模型(以 Qwen3:8B 为例)

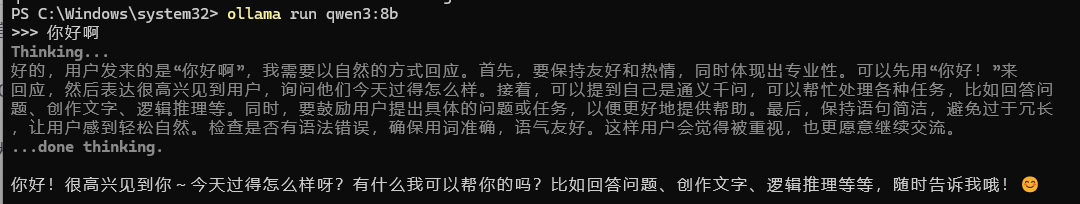

打开 PowerShell,输入以下命令下载并启动模型:

cpp

ollama run qwen3:8b下载完成后,会自动进入对话交互界面,输入问题即可测试模型是否正常运行。如下图所示:

四、RAGFlow 的安装和部署

通过cd /mnt/d/ragflow/docker进入项目目录。

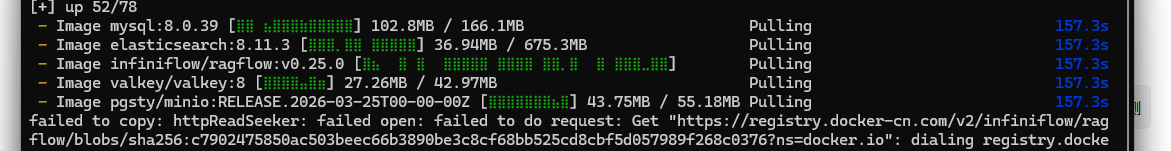

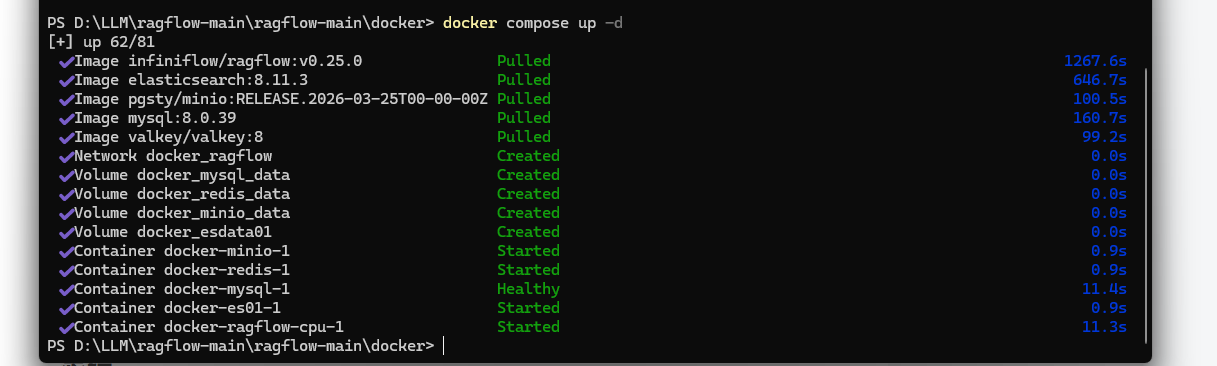

再拉取镜像,指令如下:

cpp

docker compose up -d注意如果直接拉取大概率是不成功的。可能会出现如下失败情况:

原因一般是镜像下载过程中,网络不稳定导致文件损坏。

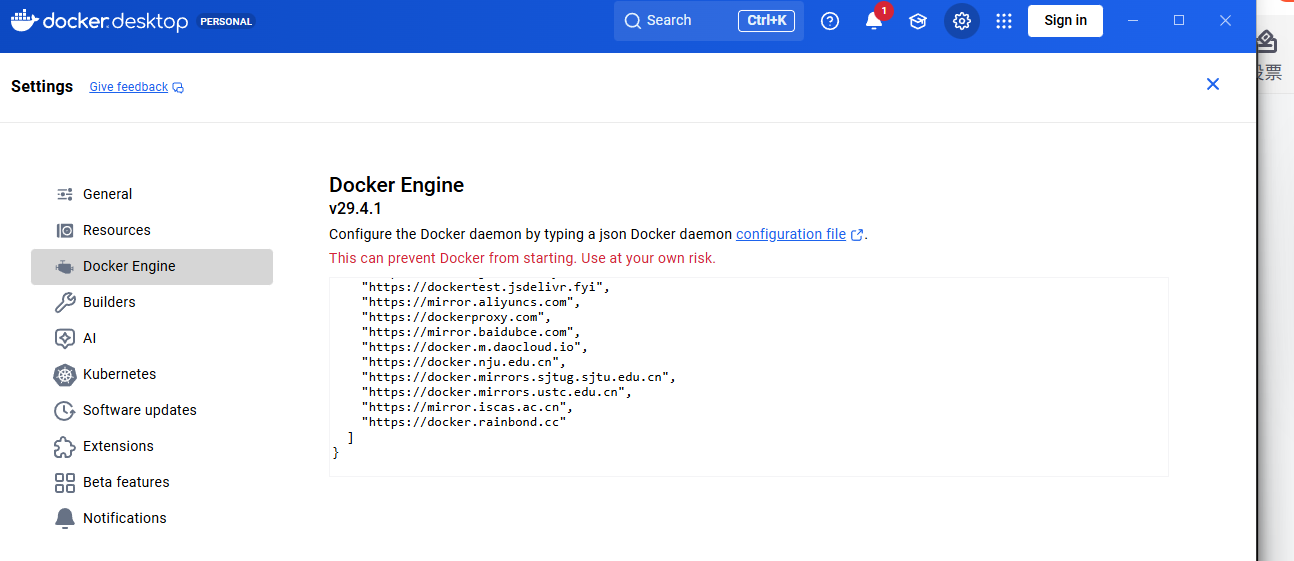

此时需要换国内镜像源,进入如下图界面所示:

换成国内源如下(亲测好用):

cpp

{

"registry-mirrors": [

"https://docker.registry.cyou",

"https://docker-cf.registry.cyou",

"https://dockercf.jsdelivr.fyi",

"https://docker.jsdelivr.fyi",

"https://dockertest.jsdelivr.fyi",

"https://mirror.aliyuncs.com",

"https://dockerproxy.com",

"https://mirror.baidubce.com",

"https://docker.m.daocloud.io",

"https://docker.nju.edu.cn",

"https://docker.mirrors.sjtug.sjtu.edu.cn",

"https://docker.mirrors.ustc.edu.cn",

"https://mirror.iscas.ac.cn",

"https://docker.rainbond.cc"

]

}拉取成功如下图所示:

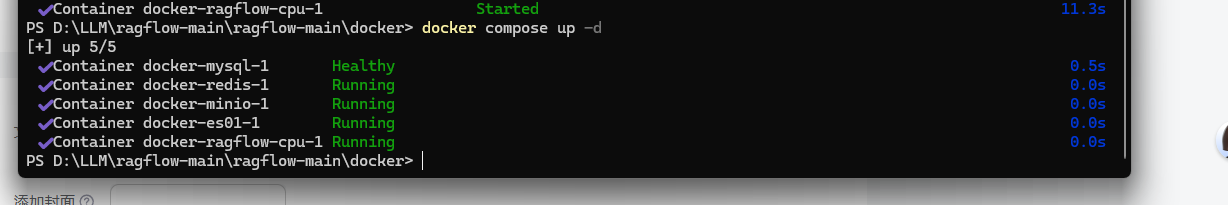

拉取成功之后,再开启docker服务,命令为,如下图所示:

cpp

docker compose up -d

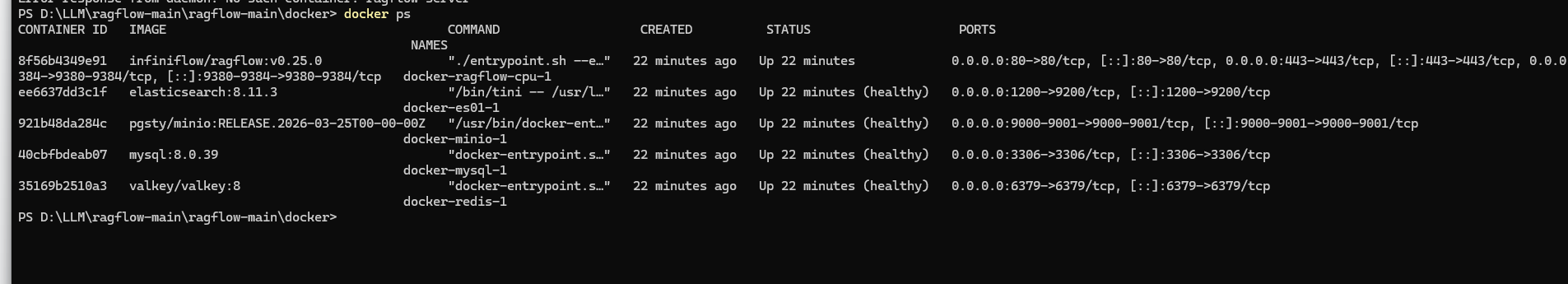

然后我们可以用如下命令来确认所有正在运行的容器名称:

cpp

docker ps如下图所示:

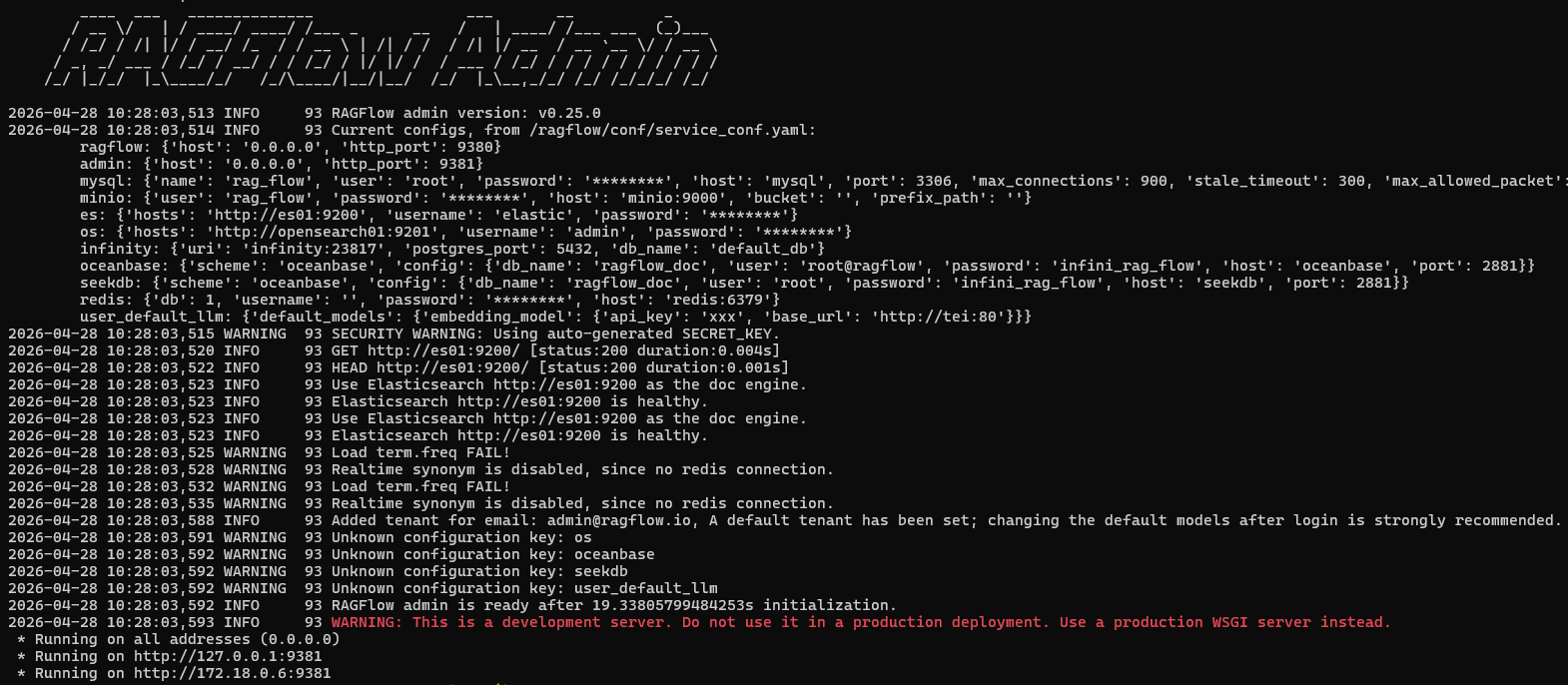

服务器启动成功后再次确认服务器状态:

cpp

docker logs -f docker-ragflow-cpu-1如下图所示:

这里注意,安装完成后并不是要进入 下面两个地址:

cpp

http://127.0.0.1:9381

http://172.18.0.6:9381而是要进入:

cpp

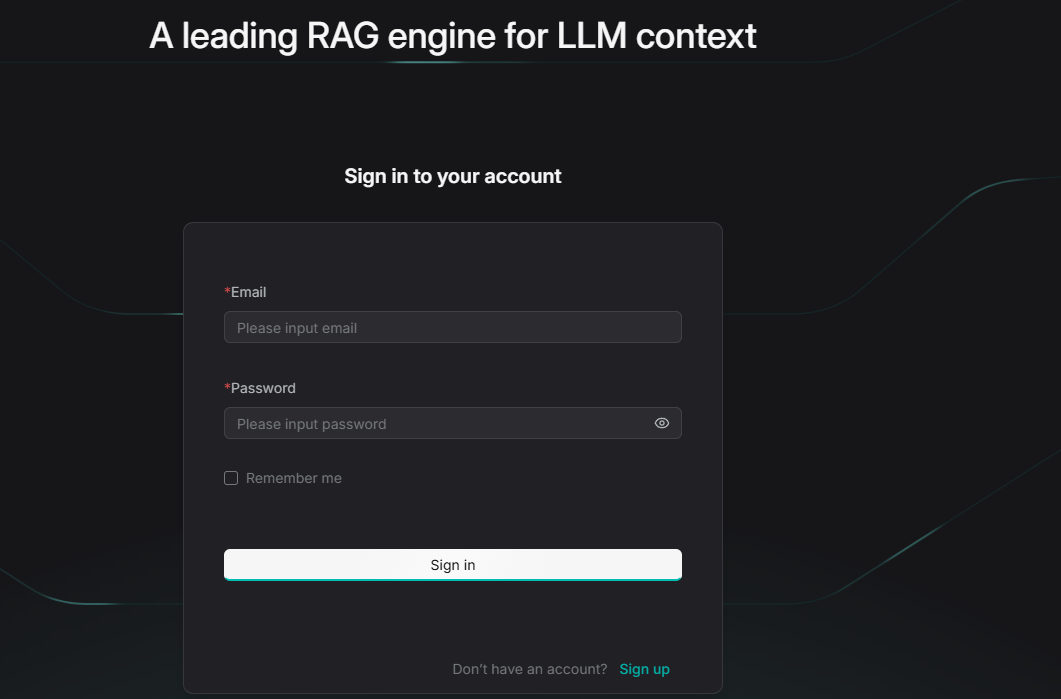

http://localhost:80先注册账号,是下面这个页面:

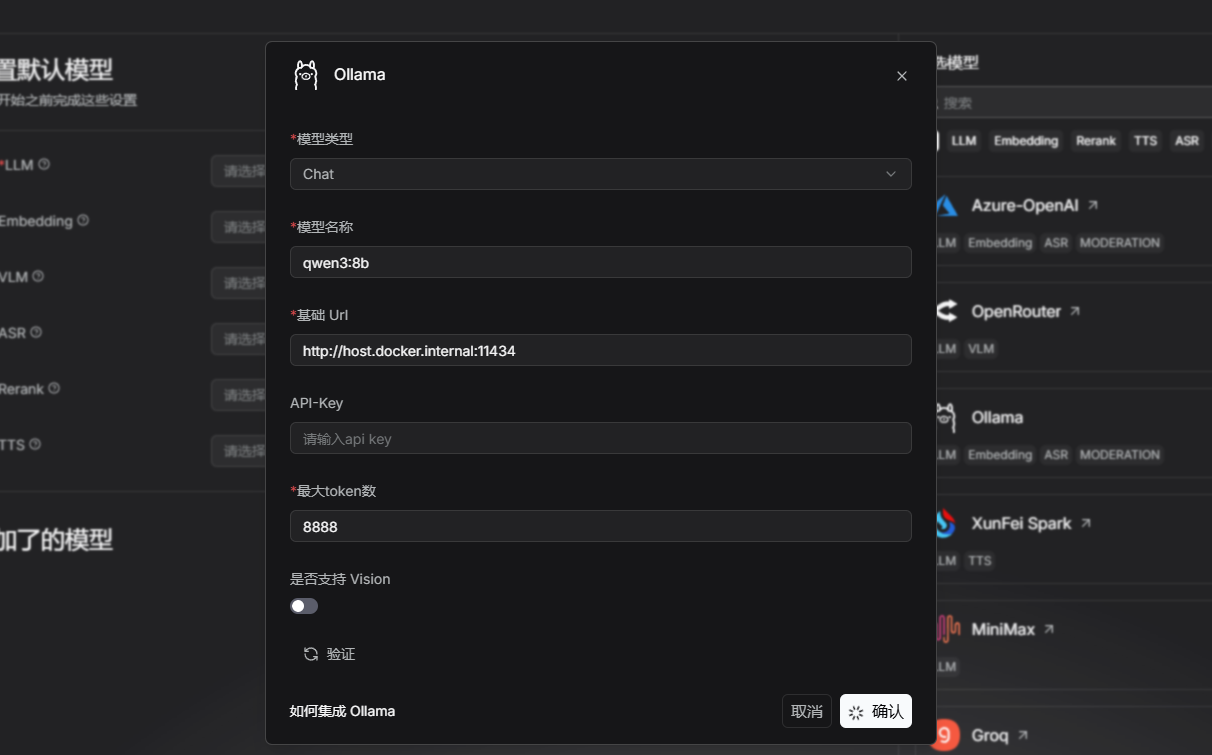

注册完成之后进入这个页面

五、添加模型

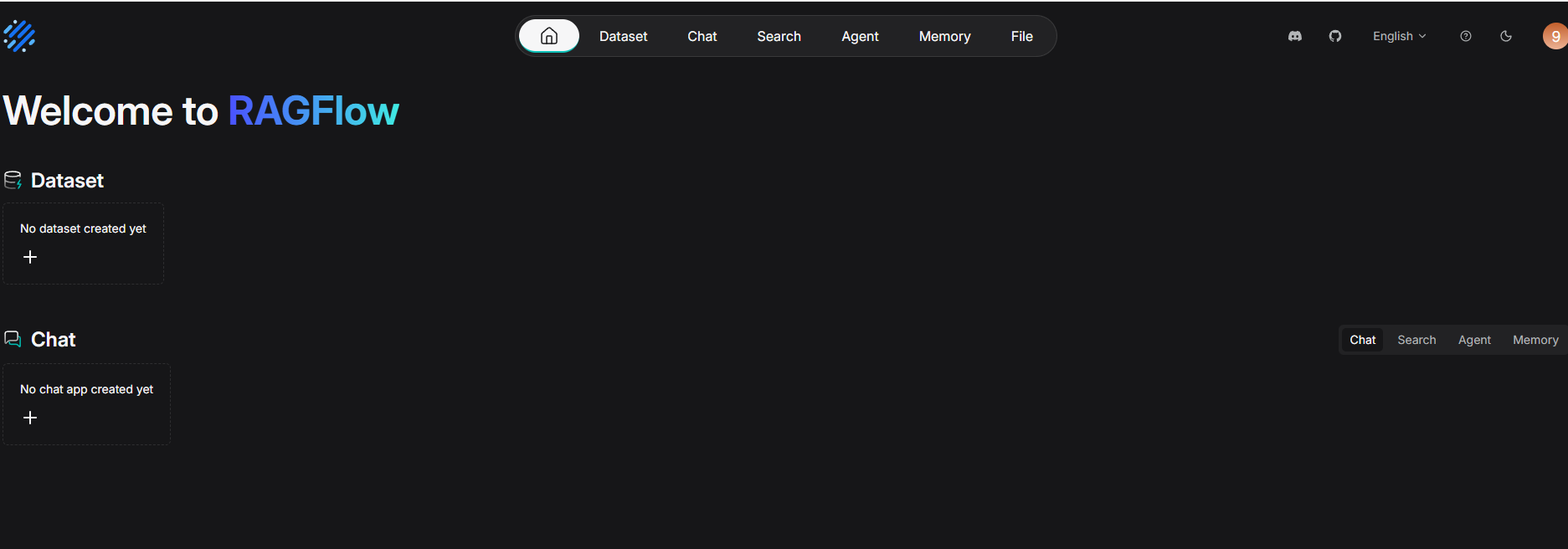

我们先可以选中文简体,再如下图我们先配置模型,点击右上角头像,再点击模型提供商

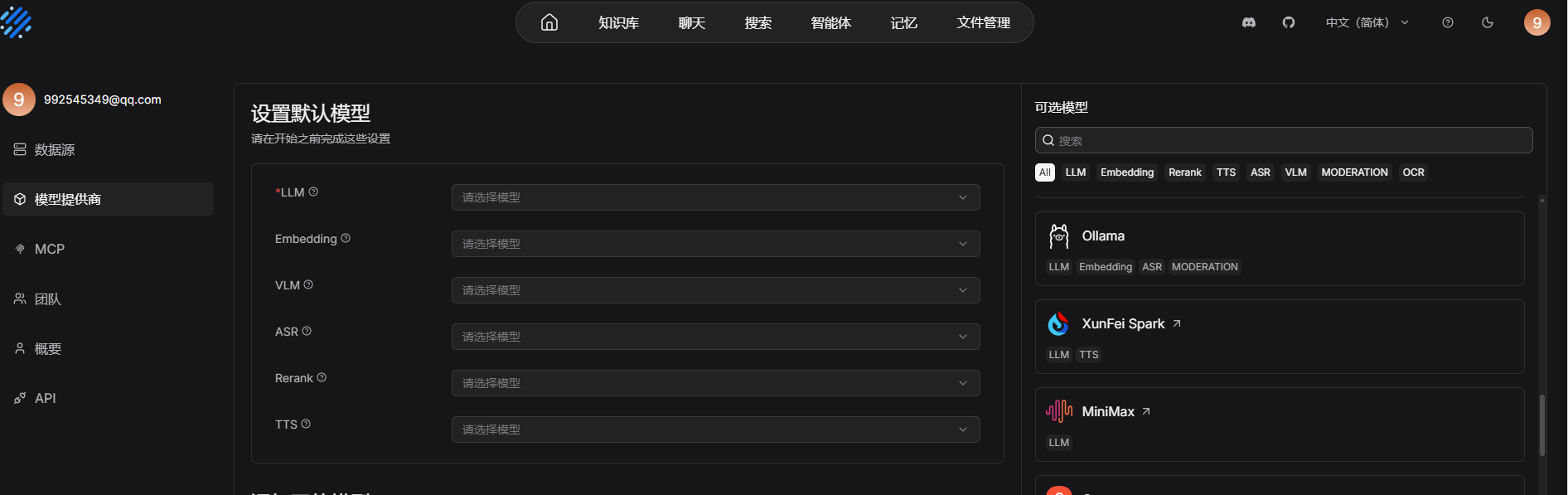

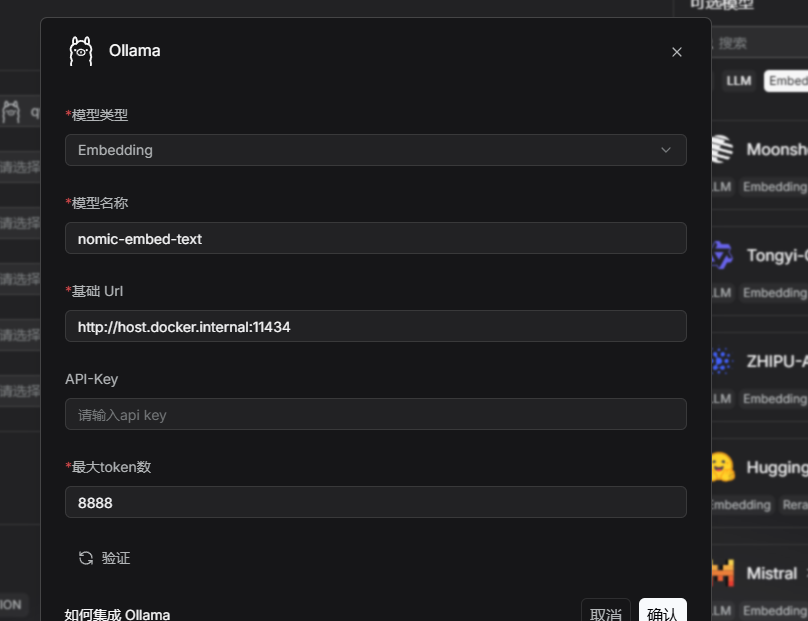

点击Ollama添加模型,填写模型信息。

如果ollama是在本机的话docker访问宿主机url为:

cpp

http://host.docker.internal:11434

再下一个Embedding 模型

这里我们下载nomic-embed-text,使用指令如下:

cpp

ollama pull nomic-embed-text还是和之前一样的步骤,如下图所示:

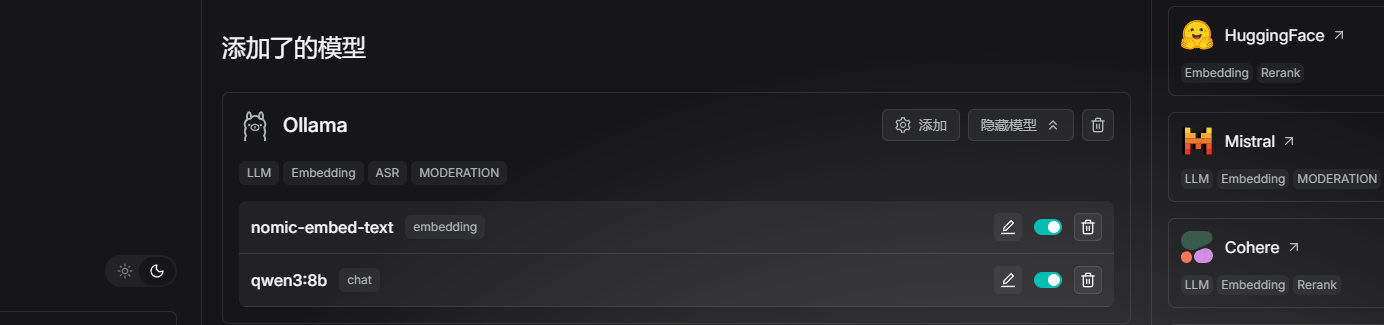

添加了之后是这样

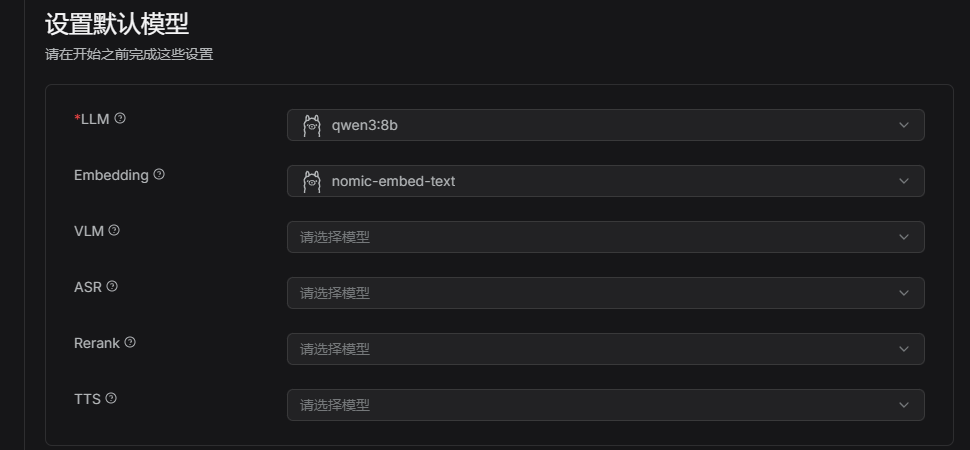

然后再设置默认模型,如下图所示:

六、知识库使用

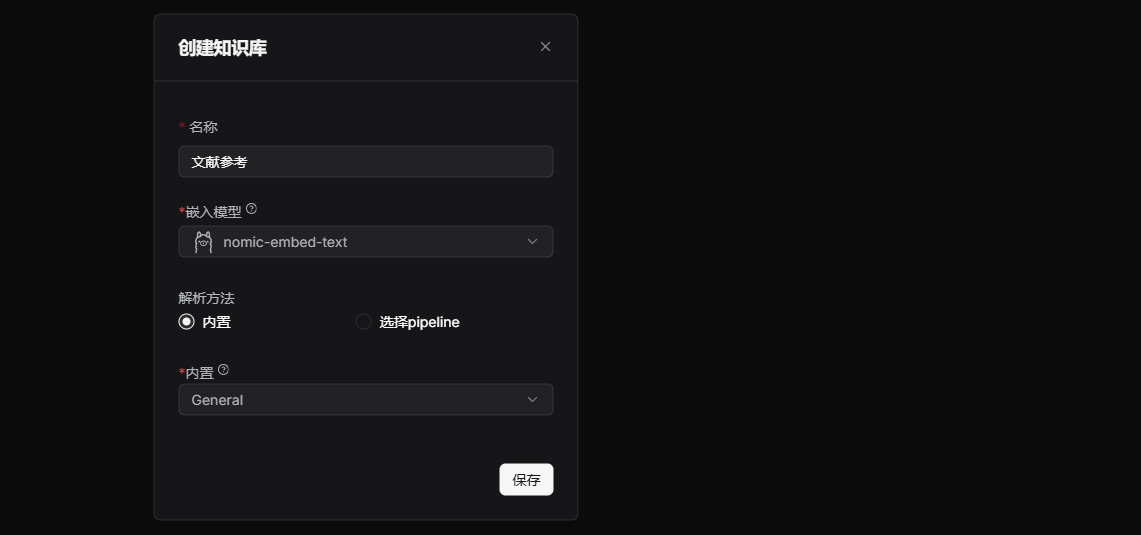

1.创建知识库

2.上传文件解析

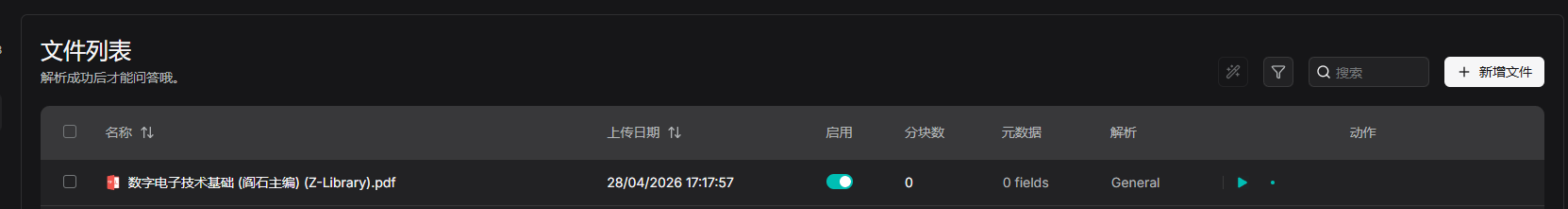

在数据集中,点击新增文件,选择文件后选择上传。如下图所示:

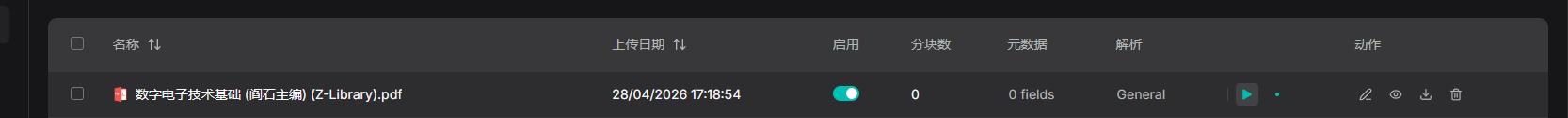

点击开始按钮进行解析,解析就是相当于向量化以及分块,如下图所示:

解析完之后如下图所示:

七、聊天助手

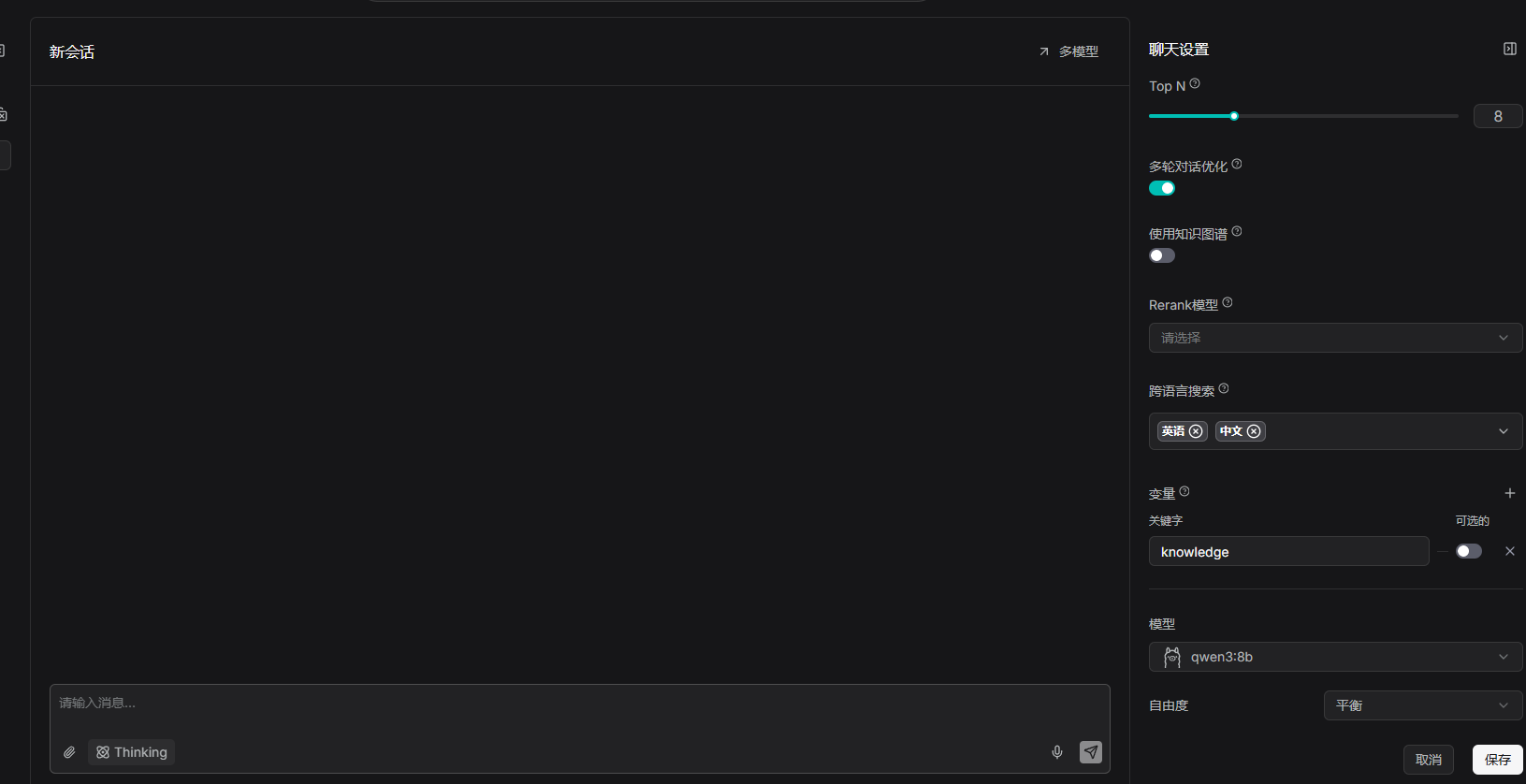

在聊天模块中点击新建助理,填写信息,选择知识库。在模型设置中配置模型信息。

可以在聊天设置里设置相关配置

总结

本教程完整实现了Windows 环境下纯本地、无外网依赖、可永久离线使用的个人智能知识库系统,全程基于 Ollama 管理本地大模型、RAGFlow 实现文档检索问答,无需调用第三方云服务,所有数据、模型、文档均存储在本地电脑,兼顾隐私安全、使用成本与操作便捷性。

通过 WSL2+Docker 完成环境部署,优化了磁盘占用问题,搭配 Qwen3:8B 对话模型与 nomic-embed-text 嵌入模型,实现了文档上传→智能解析分块→向量检索→精准问答的完整 RAG 流程;同时支持 API 调用,可轻松对接前端、小程序、自有项目,把本地知识库变成可复用的智能问答接口。