说出来你可能不信------我在做了3年量化策略,后来转型去做技术链创业,写代码这件事贯穿了我整个职业生涯。我自认为是个「高级玩家」,工具链用得比大多数人溜。

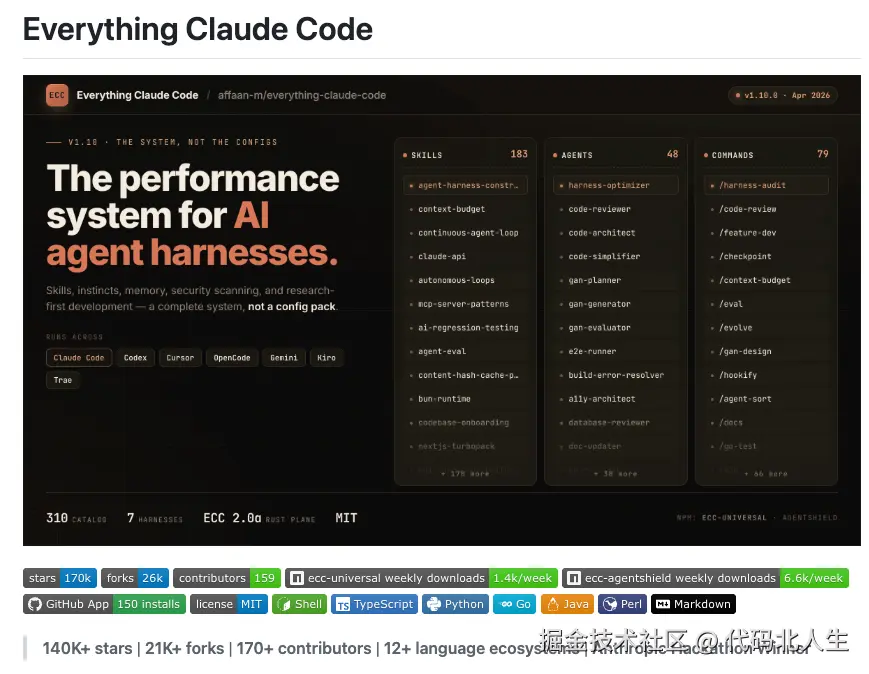

直到 2026 年初,朋友丢给我一个 GitHub 链接:[everything-claude-code]

我点开一看,167,000 个 Star、25,900 个 Fork、170+ 位贡献者。

我沉默了大概五秒钟。

然后我低头看了看自己光秃秃的 Claude Code 配置,感觉就像一个自以为会做菜的人,突然走进了米其林三星厨房的后厨。

Claude订阅对国内用户确实不太友好。有想尝试的可以去这个代订阅站:claudemax.shop

这个项目到底是什么?先别被名字骗了

很多人看到「Everything Claude Code」,以为是个 prompt 合集或者什么教程 repo,然后点进去被文件树搞懵,默默关掉。

我第一次也是这样。

但它其实是一套完整的 AI Agent 性能优化系统------用项目自己的话说,叫「agent harness performance optimization system」。

翻译成人话就是:它不只给你 prompt,它给你一套让 AI 帮你干活的完整工作流架构。

包含什么?我来数数:

- 48 个专业化 Subagent(代码审查、安全扫描、架构规划、TDD 向导......应有尽有)

- 183 个 Skill 定义(工作流程的最小执行单元)

- 79 个 Legacy Command Shims(向后兼容的斜杠命令入口)

- Hook 系统(自动触发,比如编辑 TS 文件时自动检查 console.log)

- 跨平台支持:Claude Code、Cursor、OpenCode、Codex、Gemini CLI 通通搞定

而且这不是某个大厂的官方项目------这是 Anthropic 黑客松冠军 Affaan Mustafa 和社区一起打磨了 10+ 个月的产物。

我怎么发现我之前在裸奔的

来,让我说个让我至今尴尬的故事。

我做量化策略的背景,让我在写回测代码时极其注重「验证」------每个假设都要有测试覆盖,每个数据处理步骤都要有 checkpoint。这个习惯我以为已经带进了 AI 辅助编程。

然后我打开了这个 repo 里的 skills/verification-loop/ 和 skills/eval-harness/。

好家伙。

我之前所谓的「验证」,跟这套系统比起来,就像用算盘对比 Bloomberg Terminal。

它的 Verification Loop 是这样运作的:

- 先定义评估标准(grader types)

- checkpoint 验证 vs 持续验证分开跑

- pass@k 指标追踪

- 自动提取 session 里的 patterns 变成可复用的 instinct

我当时的感受:原来 AI 辅助开发可以做到这种程度?

核心功能测评:说优点,也说缺点,不装

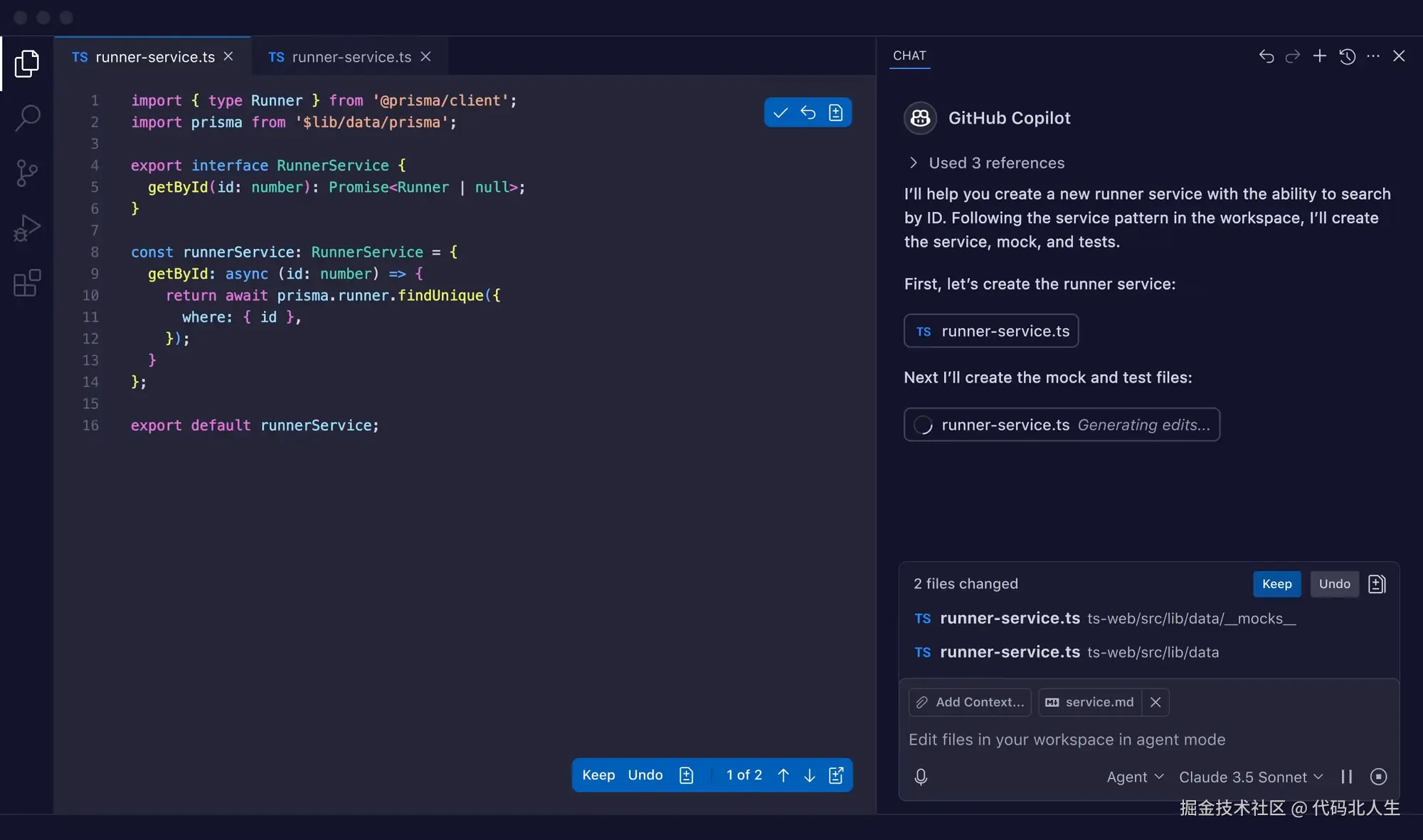

✅ 亮点一:Skills + Agents 的分层设计

这是整个项目最精妙的地方。

很多人用 Claude Code 就是一股脑地把需求往里扔,然后祈祷 AI 理解你的意图。这套系统把任务分层了:

- Skills:最小的工作流单元,告诉 AI「在这类场景下,你应该怎么做事」

- Agents:带有特定 tools 权限和系统 prompt 的专家 subagent

- Commands :入口 shim,让你用

/tdd、/plan这样的简短指令触发整套流程

举个金融场景的例子:我现在做一个 Python 的量化因子回测系统。

以前:跟 Claude 聊一大堆,然后开始写,然后发现测试不够,返工。

现在:

bash

/ecc:plan "实现 Fama-French 三因子模型回测框架"

→ planner agent 生成完整实施蓝图

/tdd

→ tdd-guide 强制我先写测试,再写实现

/code-review

→ code-reviewer 从质量、安全、可维护性三个维度扒皮效果:我最近一个项目的 bug 数量下降了大概 40%,复盘阶段发现的「设计问题」几乎没了。

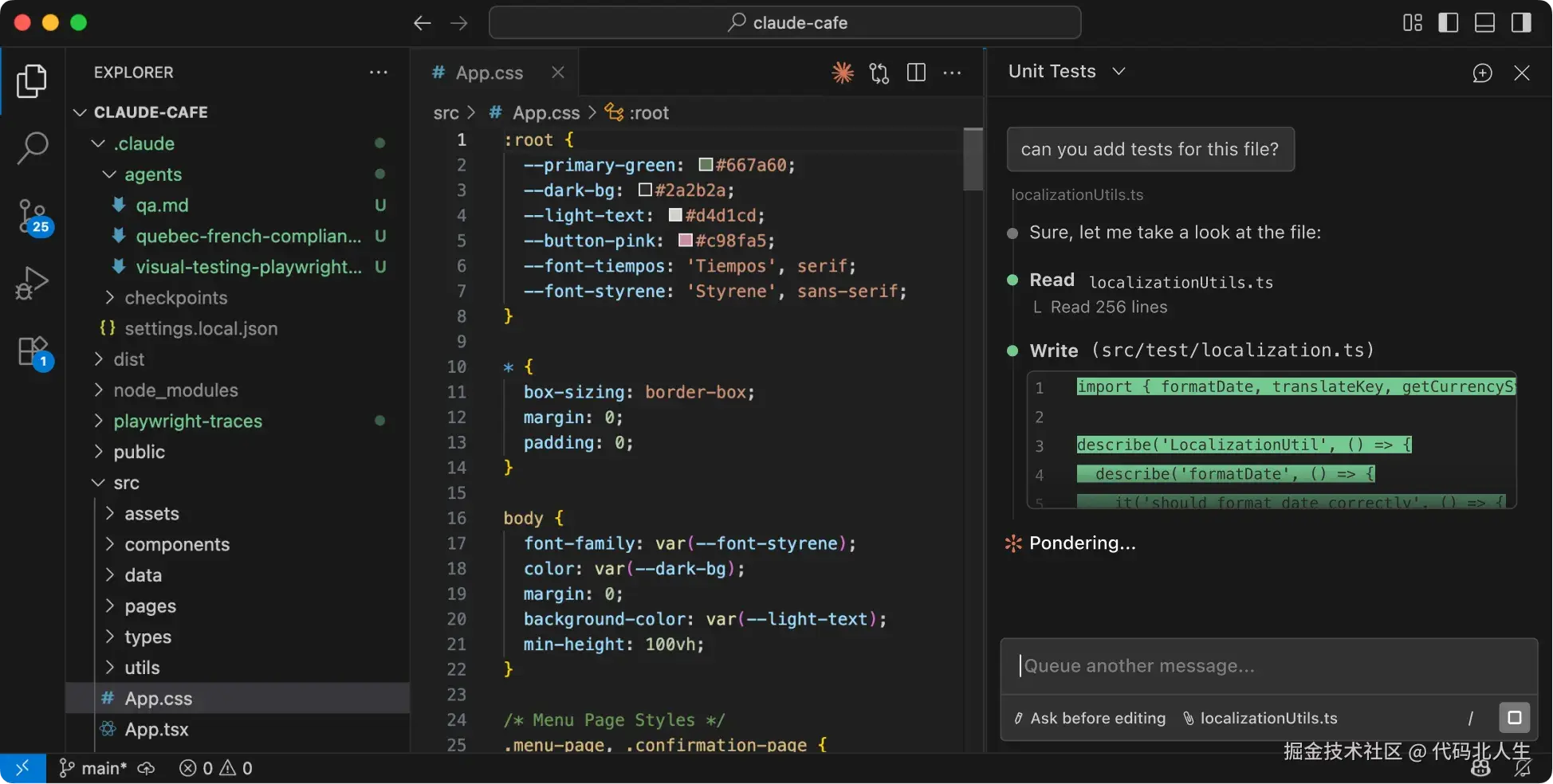

✅ 亮点二:Continuous Learning v2(这个真的牛)

这是我最意外的功能。

普通的 AI 助手每次对话都是「失忆」的------你今天教会它的东西,明天它又不记得了。

这个系统的「Instinct-based Learning」机制是这样的:

bash

/instinct-status # 看已经学到的 instincts,附带置信度分数

/evolve # 把相关的 instincts 聚类成可复用 skills

/instinct-export # 把你学到的 pattern 分享给团队我现在的 Claude Code 已经「记住」了我们公司的代码规范、常见的数据处理 pattern、以及我个人偏好的 API 设计风格。

这才叫真正的「AI 助手」,而不是「AI 工具」。

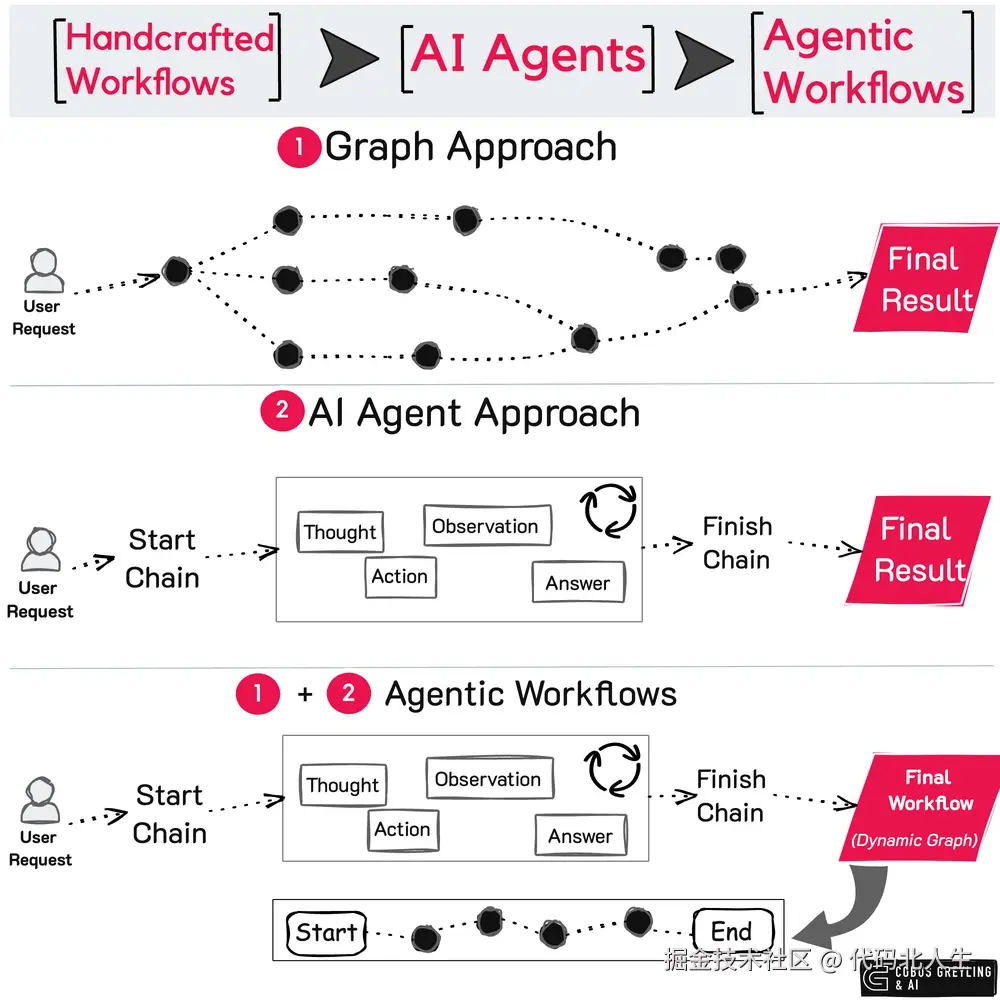

这就是 everything-claude-code 的 Agent 协作模式------多个专家 Agent 并行处理不同子任务

这就是 everything-claude-code 的 Agent 协作模式------多个专家 Agent 并行处理不同子任务

✅ 亮点三:AgentShield 安全审计(黑客松作品,但是很硬核)

金融行业的人对安全都有职业性的敏感。

这个项目内置了 AgentShield------一个专门扫描你 Claude Code 配置的安全审计工具,1282 个测试用例,102 条静态分析规则,98% 测试覆盖率,是 2026 年 2 月 Anthropic x Cerebral Valley 黑客松的获奖作品。

bash

npx ecc-agentshield scan # 快速扫描

npx ecc-agentshield scan --opus # 三个 Opus 4.6 agent 组成红队/蓝队/审计员--opus 模式真的很有意思:攻击者 agent 找漏洞链,防御者 agent 评估防护,审计员 agent 综合出优先级最高的风险清单。

对于在合规敏感行业工作的人来说,这个功能不是可选项,是刚需。

⚠️ 缺点一:上手曲线陡,文档有点散

老实说,这个项目的文档量是够的,但入门路径设计得不太友好。

README 很长,信息密度极高。你得先读完「The Shorthand Guide」和「The Longform Guide」才能真正理解这套系统的设计哲学,否则你就是在 copy 命令而不是在用这套系统。

我的建议 :先只装 rules/common/ + 你的主力语言规则(比如 rules/python/),感受一下 hook 系统,再慢慢扩展。

⚠️ 缺点二:Token 消耗需要主动管理

系统给了明确的 token 优化建议,但这也侧面说明:如果你不管,费用可能飙得很快。

每个 MCP server 的工具描述都会占用 context window,超过 10 个 MCP 开着,200k 的上下文可能缩水到 70k。

好在项目提供了解决方案:

json

// ~/.claude/settings.json

{

"model": "sonnet",

"env": {

"MAX_THINKING_TOKENS": "10000",

"CLAUDE_AUTOCOMPACT_PCT_OVERRIDE": "50"

}

}把默认模型从 opus 换成 sonnet 处理日常任务,费用大概能降 60%。复杂的架构设计再 /model opus 临时切换。

⚠️ 缺点三:Windows 支持相对滞后

Mac/Linux 用户可以无缝上手,Windows 用户需要用 PowerShell installer,部分 hook 行为有细微差异。

如果你是 Windows 开发者,建议先用 WSL2 跑,体验会好很多。

作为量化/金融从业者的特别视角

金融行业有一个特点:对「可重复性」和「可审计性」的要求极高。

你的 AI 帮你写了什么代码、改了什么逻辑、测试覆盖率是多少------这些在合规审查时都可能被问到。

这套系统的 session 管理、verification loop、以及自动提取 instinct 的机制,天然地给了你一层「操作日志」。不是说它能直接满足金融监管要求,但它的思路是对的。

另外,skills/cost-aware-llm-pipeline/ 这个 skill 值得单独拿出来说------专门讲 LLM 成本优化、模型路由和预算追踪。做 FinTech 产品的朋友,强烈建议读一读,里面的设计思路在产品层面也完全适用。

一些没想到的彩蛋

SOUL.md:项目居然有一个描述「灵魂」的文档,讲的是这个系统的设计哲学。我没想到一个技术项目会有这种东西,读完之后觉得作者是个有意思的人。- ECC 2.0 Alpha :正在用 Rust 重写控制平面,

ecc2/目录里已经有可以本地构建的原型。这说明项目不是玩票性质,是在认真做工程化。 - Dashboard GUI :

python3 ./ecc_dashboard.py启动一个桌面 GUI,可以可视化浏览所有 agents、skills、commands。对于不喜欢翻文件的人来说是个福音。

最后说几句大实话

我做量化的时候有个原则:一个策略的好坏,不能只看它在牛市里的表现,要看它在压力测试下能不能活下来。

everything-claude-code 这个项目,在「实际使用」这个压力测试下,表现超出了我的预期。

它的问题是:上手成本确实不低,你需要投入时间去理解这套系统,而不是无脑抄命令。

它的价值是:一旦你理解了,你会发现你的 AI 辅助开发工作流从「聊天」升级成了「协作」------AI 不再只是一个会说话的补全工具,而是一个知道你工作方式、能主动执行、能自我改进的 pair programmer。

167k stars 不是营销出来的。是真实的开发者用了觉得好,才给出去的。

我现在的日常:每个新项目必装,安装第一件事是 rules/common/ + rules/python/,然后根据项目需要慢慢加 skill。

如果你也在认真用 Claude Code,这个项目值得你花一个下午认真研究。

评分(基于 2026-04-30 最新版本 v1.10.0):

| 维度 | 评分 | 备注 |

|---|---|---|

| 功能完整度 | ⭐⭐⭐⭐⭐ | 几乎覆盖所有 AI 编程场景 |

| 上手友好度 | ⭐⭐⭐ | 文档全但入门曲线陡 |

| 工程质量 | ⭐⭐⭐⭐⭐ | 997 内部测试,CI 全绿 |

| 社区活跃度 | ⭐⭐⭐⭐⭐ | 170+ 贡献者,7 种语言文档 |

| 性价比 | ⭐⭐⭐⭐⭐ | 开源免费,值回一百倍时间成本 |

总体推荐:强烈推荐,尤其适合重度 Claude Code 用户、团队技术负责人、以及任何想把 AI 辅助开发从「感觉不错」升级到「系统化运作」的人。