详解RocketMQ:高可靠消息中间件的核心特性与生产实践

作者 :Weisian

发布时间:2026年4月

直击痛点:

"RocketMQ是阿里开源的金融级消息队列 ,以高可靠、低延迟、事务消息 著称,但90%的开发者只懂基础收发,忽略其事务、事务消息、顺序消息、死信队列、延迟消息等核心特性;线上生产环境,消息丢失、重复消费、乱序、积压频发,不懂RocketMQ特性就上线,等于裸奔。"

RocketMQ作为阿里巴巴开源的高性能分布式消息中间件,历经双十一等万亿级流量考验,凭借其高吞吐、低延迟、强可靠等特性,成为金融级消息系统的首选。但在高并发生产环境中,消息丢失、重复消费、顺序错乱、消息积压等问题依然是架构师需要直面的挑战。

本文将从核心特性 切入,结合底层原理 、代码实战 、生产级方案 ,彻底讲透RocketMQ的可靠性设计和问题治理:

✅ RocketMQ四大核心特性:高吞吐、强可靠、顺序消息、事务消息;

✅ 消息丢失三端防护:生产者同步发送、Broker同步刷盘、消费者手动ACK;

✅ 消息重复与幂等:消息ID去重、业务唯一键、数据库唯一约束;

✅ 顺序消息保障:MessageQueueSelector、MessageListenerOrderly、分区顺序;

✅ 消息积压处理:Consumer扩容、批量消费、非核心业务降级;

✅ 生产级配置清单与避坑指南;

✅ 高频面试题标准答案(直接背)。

📌 核心一句话 :

RocketMQ的核心是分布式队列+事务消息+死信队列 ,保证金融级可靠;生产级可靠性保障:生产者Confirm+事务+幂等 、Broker持久化+多副本+同步刷盘 、消费手动ACK+幂等 ;顺序性靠同Key同队列+单线程消费 实现,消息积压靠扩容消费者+批量消费+死信队列解决,四大问题全覆盖。

📌 面试金句先记牢:

- RocketMQ核心:NameServer→Broker→Topic→Queue,NameServer无状态,Broker多副本;

- 事务消息:半消息+本地事务+Commit/Rollback,实现端到端一致性;

- 生产者防丢:Confirm监听+事务+重试 ,

sendMessageWithTx;- 消费防丢:手动ACK,业务成功再确认;

- 防重复:幂等生产者+消费端唯一ID去重;

- 保顺序:相同Key路由同一Queue +单线程消费;

- 延迟消息:固定延迟级别,实现定时任务;

- 死信队列:失败消息自动进入,避免阻塞正常消息;

- 顺序消息:全局有序/局部有序,满足不同场景。

一、RocketMQ核心特性

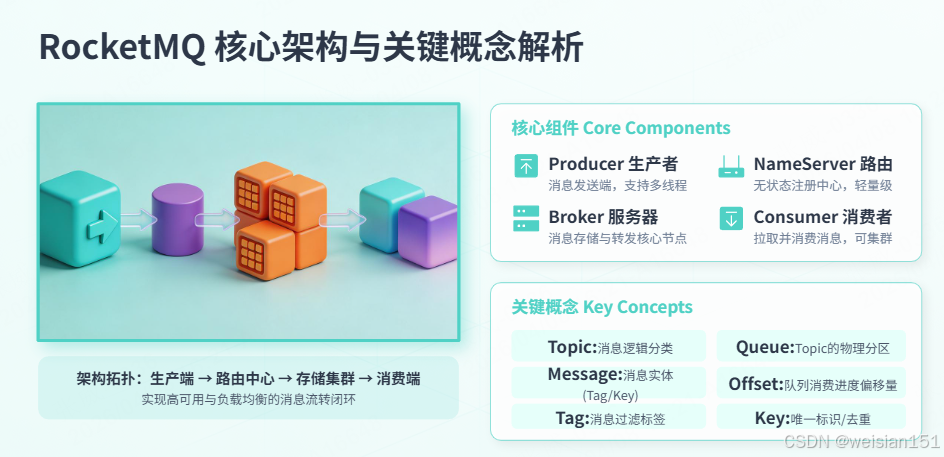

1.1 整体架构

┌─────────────────────────────────────────────────────────────────────────┐

│ RocketMQ 整体架构图 │

├─────────────────────────────────────────────────────────────────────────┤

│ │

│ ┌──────────┐ ┌──────────┐ ┌──────────┐ │

│ │ Producer │ │ Producer │ │ Producer │ (消息生产者) │

│ └────┬─────┘ └────┬─────┘ └────┬─────┘ │

│ │ │ │ │

│ └───────────────┼───────────────┘ │

│ ▼ │

│ ┌─────────────────────────────────────────────────────────────────┐ │

│ │ NameServer Cluster │ │

│ │ (服务发现、路由注册、负载均衡,AP架构) │ │

│ └─────────────────────────────────────────────────────────────────┘ │

│ │ │

│ ┌───────────────┼───────────────┐ │

│ ▼ ▼ ▼ │

│ ┌─────────────┐ ┌─────────────┐ ┌─────────────┐ │

│ │ Broker A │ │ Broker B │ │ Broker C │ │

│ │ ┌─────────┐ │ │ ┌─────────┐ │ │ ┌─────────┐ │ │

│ │ │ Master │ │ │ │ Master │ │ │ │ Master │ │ │

│ │ │┌───────┐│ │ │ │┌───────┐│ │ │ │┌───────┐│ │ │

│ │ ││TopicP0││ │ │ ││TopicP1││ │ │ ││TopicP2││ │ │

│ │ │└───────┘│ │ │ │└───────┘│ │ │ │└───────┘│ │ │

│ │ └─────────┘ │ │ └─────────┘ │ │ └─────────┘ │ │

│ │ ┌─────────┐ │ │ ┌─────────┐ │ │ ┌─────────┐ │ │

│ │ │ Slave │ │ │ │ Slave │ │ │ │ Slave │ │ │

│ │ └─────────┘ │ │ └─────────┘ │ │ └─────────┘ │ │

│ └─────────────┘ └─────────────┘ └─────────────┘ │

│ │

│ ┌───────────────┼───────────────┐ │

│ ▼ ▼ ▼ │

│ ┌──────────┐ ┌──────────┐ ┌──────────┐ │

│ │Consumer │ │Consumer │ │Consumer │ (消费者组) │

│ │ Group1 │ │ Group2 │ │ Group3 │ │

│ └──────────┘ └──────────┘ └──────────┘ │

│ │

└─────────────────────────────────────────────────────────────────────────┘1.1.1 核心概念详解(面试必背)

- NameServer :无状态路由中心,负责Broker注册、Topic路由、集群管理,轻量级高可用;

- Broker:RocketMQ服务器节点,负责存储消息、处理请求、副本同步;

- Topic:消息的逻辑分类,生产者发送到Topic,消费者从Topic消费;

- Queue :Topic的物理队列,一个Topic包含多个Queue,并行处理提升吞吐;

- Message :消息实体,包含Topic、Queue、Key、Body、Tag等;

- Producer Group :生产者组,组内多个生产者,共同发送消息,提升发送速度;

- Consumer Group :消费者组,组内多个消费者,共同消费一个Topic,提升消费速度;

- Offset :消息在队列内的唯一编号,单调递增,消费者通过Offset定位消息;

- Tag :消息标签,用于消息过滤,消费者可只消费指定Tag消息;

- Key :消息唯一标识,用于去重+顺序;

- 事务消息 :支持半消息+事务确认,实现分布式事务;

- 死信队列(DLQ):消费失败超过最大次数,自动进入死信队列,避免阻塞正常消息。

核心流转:

Producer → NameServer(路由发现) → Broker集群(多Queue+多副本) → Consumer

生活类比:秒懂RocketMQ架构

我们用大型连锁超市配送中心类比RocketMQ,瞬间理解所有核心概念:

- NameServer:超市总调度中心(记录所有门店位置、库存);

- Broker:区域配送中心(存储所有商品,负责配送);

- Topic:商品分类(如生鲜、日用品);

- Queue:配送队列(一个分类有多个队列,并行配送);

- Producer:供应商(向配送中心发货);

- Consumer:超市门店(从配送中心收货);

- Message:商品(每个商品有唯一编号);

- 事务消息:预售商品(先锁定,确认后再发货);

- 死信队列:问题商品区(损坏/过期商品,单独处理)。

1.2 特性一:高吞吐

RocketMQ的高吞吐能力源自三大核心设计:

1.2.1 顺序写CommitLog

与Kafka为每个Topic创建独立文件不同,RocketMQ将所有Topic的消息都写入同一个CommitLog文件:

java

// RocketMQ存储架构

// CommitLog:所有消息的顺序写入文件(单一文件,顺序追加)

// ConsumeQueue:每个MessageQueue对应的索引文件(逻辑队列)

// IndexFile:消息索引文件(支持按Key查询)

// 优势:最大化顺序IO,单机可支撑万级Topic

// 劣势:消费时需通过ConsumeQueue索引定位CommitLog位置性能对比:

| 存储方式 | 随机写IOPS | 顺序写IOPS | 适用场景 |

|---|---|---|---|

| 多文件(Kafka) | 低 | 中 | Topic数量少 |

| 单文件(RocketMQ) | - | 极高 | Topic数量多(万级) |

1.2.2 零拷贝与PageCache

java

// RocketMQ使用mmap(内存映射)实现零拷贝

// 写入:消息先写入PageCache,异步刷盘

// 读取:优先从PageCache读取,未命中才读磁盘

// 关键配置

flushDiskType = SYNC_FLUSH // 同步刷盘(高可靠性)

flushDiskType = ASYNC_FLUSH // 异步刷盘(高性能)1.3 特性二:消息可靠性

RocketMQ通过多层次设计保证消息不丢失:

┌─────────────────────────────────────────────────────────────────┐

│ RocketMQ 可靠性保障体系 │

├─────────────────────────────────────────────────────────────────┤

│ │

│ 生产者端: │

│ ├── 同步发送(等待Broker确认) │

│ ├── 重试机制(网络抖动自动重试) │

│ └── 事务消息(半消息+本地事务+回查) │

│ │

│ Broker端: │

│ ├── 同步刷盘(消息写入物理文件后才返回) │

│ ├── 同步复制(主从都写入成功后才返回) │

│ └── 高可用集群(主从切换,自动故障转移) │

│ │

│ 消费者端: │

│ ├── 手动ACK(业务处理成功后才确认) │

│ ├── 重试队列(消费失败自动重试) │

│ └── 死信队列(超过重试次数进入DLQ) │

│ │

└─────────────────────────────────────────────────────────────────┘

1.4 特性三:顺序消息

RocketMQ通过MessageQueueSelector保证分区内消息有序:

java

// 核心原理:相同业务Key的消息路由到同一队列

// 生产者:通过ShardingKey选择队列

// 消费者:单线程处理每个队列

// 注意:顺序消息的吞吐量低于普通消息

// 适用场景:订单状态流转、数据库binlog同步、金融交易

1.5 特性四:事务消息

RocketMQ的事务消息是解决分布式事务的核心方案:

┌─────────────────────────────────────────────────────────────────┐

│ RocketMQ 事务消息流程 │

├─────────────────────────────────────────────────────────────────┤

│ │

│ 1. 生产者发送半消息(Half Message)到Broker │

│ ↓ │

│ 2. Broker存储半消息(消费者不可见) │

│ ↓ │

│ 3. 生产者执行本地事务(如更新订单状态) │

│ ↓ │

│ 4. 生产者发送commit/rollback到Broker │

│ ↓ │

│ 5. Broker根据指令提交或回滚消息 │

│ ↓ │

│ 6. 若生产者未发送二次确认,Broker定时回查本地事务状态 │

│ │

└─────────────────────────────────────────────────────────────────┘二、RocketMQ全特性深度拆解(从基础到高级)

2.1 生产者(Producer)核心特性

2.1.1 消息发送模式

- 同步发送:发送后阻塞,等待Broker返回结果(可靠,性能低);

- 异步发送 :发送后不阻塞,通过Confirm回调处理结果(高性能,生产首选);

- 单向发送:发送后不等待结果(最不可靠,仅用于日志);

- 批量发送:积攒多条消息一起发送,减少网络IO(提升吞吐)。

2.1.2 Confirm 确认机制(防丢失核心)

生产者发送消息后,等待Broker返回ACK确认:

- 同步Confirm:阻塞等待;

- 异步Confirm:回调处理(生产首选);

- 事务Confirm:事务消息专用,保证消息可靠投递。

2.1.3 幂等生产者(防重复核心)

开启enableIdempotence=true,RocketMQ自动为每条消息生成唯一ID ,Broker端去重,保证消息不重复投递。

2.1.4 事务消息(分布式事务核心)

RocketMQ最核心特性,支持端到端事务,解决分布式系统数据不一致问题。

2.1.5 延迟消息(定时任务核心)

发送消息时指定延迟级别,消息延迟指定时间后才投递,实现定时任务。

2.1.6 消息过滤

- Tag过滤:消费者订阅指定Tag消息,简单高效;

- SQL过滤:支持SQL语法过滤,灵活强大。

2.2 Broker 核心特性

2.2.1 多副本机制(高可用核心)

- 主从架构:一个队列一个主Broker(Master),多个从Broker(Slave);

- 数据同步:Slave从Master拉取数据,保持一致;

- 故障转移:Master宕机,Slave自动升级为Master,保证服务不中断。

2.2.2 持久化机制(防丢失核心)

- 磁盘存储 :消息持久化到CommitLog,而非内存,宕机不丢;

- 顺序写:RocketMQ采用磁盘顺序写,性能接近内存;

- 同步刷盘 :

flushDiskType=SYNC_FLUSH,消息写入磁盘成功,再返回ACK(生产必选)。

2.2.3 死信队列(DLQ)(异常处理核心)

- 触发条件 :消费失败超过

maxReconsumeTimes(默认16次); - 自动转移:失败消息自动进入死信队列,不阻塞正常消息;

- 手动处理:运维人员定期处理死信消息,避免丢失。

2.2.4 延迟消息级别

RocketMQ支持18个固定延迟级别(1s/5s/10s/30s/1m/.../2h),满足不同定时场景。

2.2.5 消息重试机制

- 生产者重试:发送失败自动重试;

- 消费者重试:消费失败,Broker重新投递,超过最大次数进入死信队列。

2.3 消费者(Consumer)核心特性

2.3.1 消费模式

- 推模式(Push):Broker主动推送消息到消费者(RocketMQ默认);

- 拉模式(Pull):消费者主动拉取消息(灵活,可控制速度)。

2.3.2 ACK 确认机制(防丢失核心)

- 自动ACK:消费者拿到消息后,自动确认(可能丢消息,生产禁用);

- 手动ACK:业务执行成功后,手动确认(生产必选)。

2.3.3 消费者组(高吞吐核心)

- 组内负载均衡:一个Topic的多个Queue,分配给组内不同消费者;

- 并行消费:消费者数≤队列数,提升消费速度;

- 重平衡:消费者加入/退出,重新分配队列,保证高可用。

2.3.4 顺序消费

- 局部顺序:同Key同队列+单线程消费(生产首选);

- 全局顺序:一个Topic只有一个队列,单线程消费(性能低,仅用于核心场景)。

2.3.5 死信队列处理

消费失败进入死信队列,定期处理,避免消息丢失。

2.4 高级特性(生产必备)

- 事务消息(Transaction):端到端事务,保证生产者-消费者数据一致;

- 顺序消息(Orderly):全局/局部顺序,满足不同场景;

- 延迟消息(Delay):定时投递,实现定时任务;

- 死信队列(DLQ):异常消息处理,避免阻塞;

- 消息轨迹(Trace):记录消息全链路轨迹,方便排查问题;

- ACL权限控制:细粒度权限控制,保证数据安全;

- 监控告警:Prometheus/Grafana监控,实时监控集群状态;

- 高可用部署:多Broker+多副本,保证服务不中断。

三、消息丢失:三端防护体系

3.1 消息丢失的三大环节

生产端丢失:异步发送未确认、网络超时、重试次数耗尽

Broker端丢失:宕机消息未持久化、副本未同步、主从切换、PageCache未刷盘

消费端丢失:自动ACK后业务失败生活类比:生产端是"寄快递",Broker是"快递中转站",消费端是"收件人"。

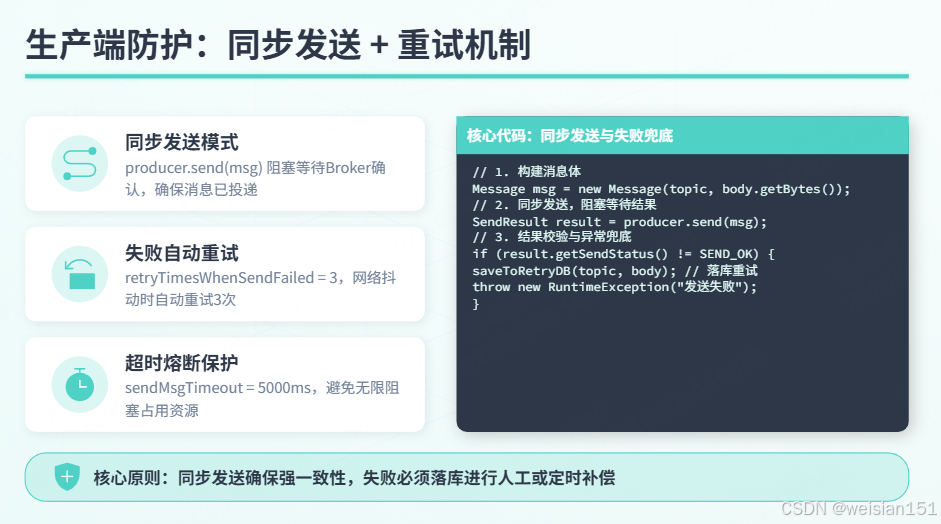

3.2 生产端防护(Confirm 机制 + 事务 + 幂等)

java

/**

* RocketMQ生产者可靠性配置

*/

@Component

public class RocketMQProducerConfig {

@Bean

public DefaultMQProducer defaultMQProducer() throws MQClientException {

DefaultMQProducer producer = new DefaultMQProducer("order_producer_group");

// 【关键1】NameServer地址

producer.setNamesrvAddr("localhost:9876");

// 【关键2】同步发送:阻塞等待Broker确认(最可靠)

// 使用方式:producer.send(msg) 同步等待结果

// 【关键3】发送超时时间(毫秒)

producer.setSendMsgTimeout(5000);

// 【关键4】失败重试次数

producer.setRetryTimesWhenSendFailed(3);

// 【关键5】异步发送失败重试次数

producer.setRetryTimesWhenSendAsyncFailed(3);

producer.start();

return producer;

}

/**

* 同步发送(最可靠,核心业务必须使用)

*/

public SendResult sendSync(DefaultMQProducer producer, String topic, String message) {

try {

Message msg = new Message(topic, message.getBytes(StandardCharsets.UTF_8));

SendResult result = producer.send(msg);

if (result.getSendStatus() != SendStatus.SEND_OK) {

// 发送失败,记录到本地数据库,定时重试

saveToRetryDB(topic, message);

throw new RuntimeException("消息发送失败,status=" + result.getSendStatus());

}

return result;

} catch (Exception e) {

log.error("消息发送异常", e);

saveToRetryDB(topic, message);

throw new RuntimeException("消息发送异常", e);

}

}

/**

* 异步发送(高性能,需回调确认)

*/

public void sendAsync(DefaultMQProducer producer, String topic, String message,

SendCallback callback) {

try {

Message msg = new Message(topic, message.getBytes(StandardCharsets.UTF_8));

producer.send(msg, new SendCallback() {

@Override

public void onSuccess(SendResult sendResult) {

callback.onSuccess(sendResult);

}

@Override

public void onException(Throwable e) {

// 异步发送失败,记录到重试表

saveToRetryDB(topic, message);

callback.onException(e);

}

});

} catch (Exception e) {

saveToRetryDB(topic, message);

log.error("异步发送失败", e);

}

}

}3.3 Broker端防护(同步刷盘 + 多副本 + 持久化)

properties

# broker.conf - Broker可靠性配置

# 【关键1】同步刷盘:消息写入物理文件后才返回(最强可靠性)

flushDiskType = SYNC_FLUSH

# 异步刷盘:消息写入PageCache就返回(高性能)

# flushDiskType = ASYNC_FLUSH

# 【关键2】同步复制:主从都写入成功后才返回

brokerRole = SYNC_MASTER

# 异步复制:主节点写入成功即返回

# brokerRole = ASYNC_MASTER

# 【关键3】自动创建Topic

autoCreateTopicEnable = false

# 【关键4】消息存储路径

storePathRootDir = /data/rocketmq/store刷盘策略对比:

| 策略 | 可靠性 | 性能 | 适用场景 |

|---|---|---|---|

| 同步刷盘 | 最高(不丢失) | 低 | 订单、支付 |

| 异步刷盘 | 较高(可能丢) | 高 | 日志、埋点 |

主从复制对比:

| 策略 | 可靠性 | 性能 | 适用场景 |

|---|---|---|---|

| 同步复制 | 最高(不丢失) | 低 | 核心业务 |

| 异步复制 | 较高(可能丢) | 高 | 非核心业务 |

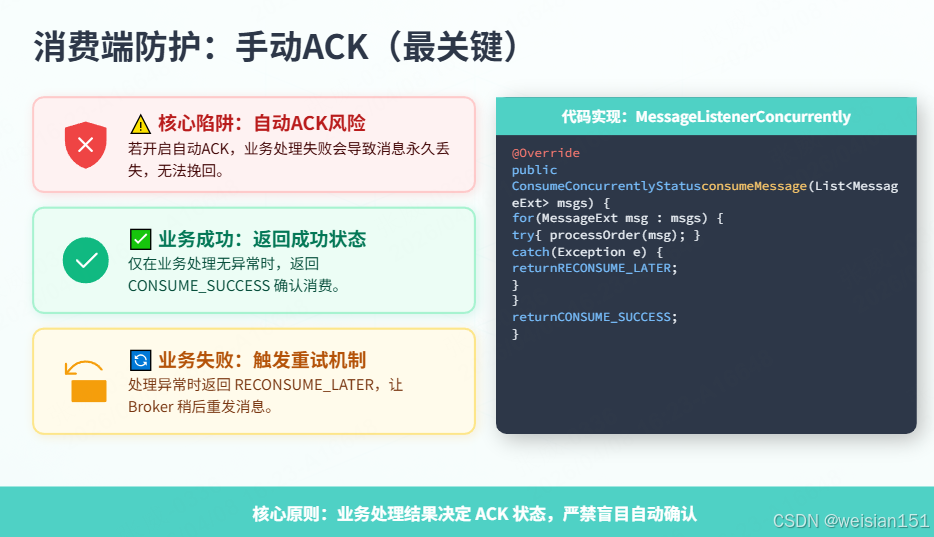

3.4 消费端防护:手动 ACK(最关键)

核心陷阱

自动ACK:消费者一拿到消息,就自动确认,业务失败,消息永久丢失。

java

/**

* RocketMQ消费者可靠性配置

*/

@Component

public class RocketMQConsumer {

@Autowired

private RedisTemplate<String, String> redisTemplate;

/**

* 配置消费者(手动ACK)

*/

@Bean

public DefaultMQPushConsumer defaultMQPushConsumer() throws MQClientException {

DefaultMQPushConsumer consumer = new DefaultMQPushConsumer("order_consumer_group");

consumer.setNamesrvAddr("localhost:9876");

// 【关键1】订阅Topic

consumer.subscribe("order_topic", "*");

// 【关键2】从最新位置开始消费(避免重复消费历史消息)

consumer.setConsumeFromWhere(ConsumeFromWhere.CONSUME_FROM_LAST_OFFSET);

// 【关键3】手动ACK(业务处理成功后才确认)

consumer.registerMessageListener(new MessageListenerConcurrently() {

@Override

public ConsumeConcurrentlyStatus consumeMessage(List<MessageExt> msgs,

ConsumeConcurrentlyContext context) {

for (MessageExt msg : msgs) {

String msgId = msg.getMsgId();

String body = new String(msg.getBody());

try {

// 幂等校验

if (isProcessed(msgId)) {

log.warn("消息已处理过,跳过,msgId={}", msgId);

continue;

}

// 业务处理

processOrder(body);

// 标记已处理

markProcessed(msgId);

} catch (Exception e) {

log.error("消费失败,msgId={}", msgId, e);

// 返回RECONSUME_LATER,触发重试

return ConsumeConcurrentlyStatus.RECONSUME_LATER;

}

}

// 全部处理成功,确认消费

return ConsumeConcurrentlyStatus.CONSUME_SUCCESS;

}

});

consumer.start();

return consumer;

}

private boolean isProcessed(String msgId) {

return Boolean.TRUE.equals(redisTemplate.hasKey("consumed:" + msgId));

}

private void markProcessed(String msgId) {

redisTemplate.opsForValue().set("consumed:" + msgId, "1", Duration.ofDays(7));

}

}3.5 防丢失总结(面试必背)

生产丢:Confirm回调 + 事务 + 幂等

Broker丢:同步刷盘 + 多副本 + 持久化

消费丢:手动ACK,先业务再确认

三位一体,缺一不可四、消息重复:幂等设计

4.1 重复消息产生原因

RocketMQ保证**至少一次(At Least Once)**投递语义,因此重复消费是可能发生的:

场景1:网络超时重试

生产者发送消息 → 网络超时 → 生产者重试 → Broker收到两次

场景2:消费者Rebalance

消费者A处理消息 → 触发Rebalance → 分区分配给消费者B

→ 消费者B从上次offset开始消费 → 消息重复

场景3:消费超时

消费者处理消息耗时过长 → 未及时提交offset → 重新消费

4.2 方案一:消息ID去重(不推荐)

java

/**

* 方案1:基于Message ID去重(不推荐)

* 问题:不同消息可能MsgId重复,且无法处理业务层面的重复

*/

@Component

public class MsgIdDeduplication {

@Autowired

private RedisTemplate<String, String> redisTemplate;

public boolean consume(String msgId, Runnable business) {

// SET NX:不存在则设置,返回true;存在则返回false

Boolean success = redisTemplate.opsForValue()

.setIfAbsent("msg:" + msgId, "1", Duration.ofMinutes(5));

if (Boolean.FALSE.equals(success)) {

log.info("重复消息(MsgId),跳过,msgId={}", msgId);

return false;

}

business.run();

return true;

}

}4.3 方案二:业务唯一键去重(推荐)

java

/**

* 方案2:基于业务唯一键去重(推荐)

* 示例:订单支付场景,使用订单ID作为唯一键

*/

@Component

public class BusinessKeyDeduplication {

@Autowired

private RedisTemplate<String, String> redisTemplate;

/**

* 消费支付消息

* @param orderId 订单ID(业务唯一键)

*/

public void consumePayment(String orderId, BigDecimal amount) {

String lockKey = "payment:" + orderId;

// Redis分布式锁,确保同一订单只处理一次

Boolean locked = redisTemplate.opsForValue()

.setIfAbsent(lockKey, "1", Duration.ofMinutes(5));

if (Boolean.FALSE.equals(locked)) {

log.info("重复支付消息,已拦截,orderId={}", orderId);

return;

}

try {

// 更新订单状态为已支付

orderService.updateOrderStatus(orderId, "PAID", amount);

} catch (DuplicateKeyException e) {

// 数据库唯一键兜底

log.warn("订单已支付,幂等处理,orderId={}", orderId);

}

}

}4.4 方案三:数据库唯一约束(最强)

sql

-- 方案3:数据库唯一约束 + 幂等插入

CREATE TABLE `payment_record` (

`id` BIGINT AUTO_INCREMENT PRIMARY KEY,

`order_id` VARCHAR(64) NOT NULL COMMENT '订单ID(业务唯一键)',

`amount` DECIMAL(10,2) NOT NULL,

`status` VARCHAR(20) DEFAULT 'SUCCESS',

`create_time` DATETIME DEFAULT CURRENT_TIMESTAMP,

UNIQUE KEY `uk_order_id` (`order_id`) -- 唯一约束保证幂等

) ENGINE=InnoDB DEFAULT CHARSET=utf8;

java

/**

* 数据库唯一键幂等

*/

@Repository

public class PaymentRecordMapper {

@Autowired

private JdbcTemplate jdbcTemplate;

public boolean insertPayment(String orderId, BigDecimal amount) {

String sql = "INSERT INTO payment_record(order_id, amount) VALUES(?, ?)";

try {

jdbcTemplate.update(sql, orderId, amount);

return true;

} catch (DuplicateKeyException e) {

// 唯一键冲突,说明已处理过

log.info("支付记录已存在,幂等处理,orderId={}", orderId);

return false;

}

}

}4.5 避坑指南

- 幂等判断必须原子性(Redis/数据库锁);

- 去重数据必须持久化,避免重启丢失;

- 核心业务(支付/退款)必须强幂等,绝不允许重复执行。

五、顺序消息:下单→支付→发货

5.1 RocketMQ顺序性原理

RocketMQ通过MessageQueueSelector保证分区内消息有序:

Topic: order_topic (3个MessageQueue)

├── Queue 0: 订单A(创建) → 订单A(支付) → 订单A(发货) ✓ 有序

├── Queue 1: 订单B(创建) → 订单B(支付) → 订单B(发货) ✓ 有序

└── Queue 2: 订单C(创建) → 订单C(支付) → 订单C(发货) ✓ 有序

关键:相同订单ID的消息必须路由到同一队列5.2 顺序消息实现原理(面试必考)

RocketMQ保序核心:同Key同队列 + 单线程消费

- 相同Key路由到同一队列 :

用订单号Hash取模,保证同一个订单的所有消息进入同一个Queue; - 单线程消费 :

一个队列只被一个消费者线程消费,FIFO执行,绝对有序。

注意:我们保证的是局部有序(同一个订单有序),而非全局有序,性能最优。

5.3 生产者:MessageQueueSelector

java

/**

* 顺序消息生产者

*/

@Component

public class OrderedProducer {

@Autowired

private DefaultMQProducer producer;

/**

* 发送顺序消息

* @param orderId 订单ID(作为ShardingKey)

* @param eventType 事件类型(create/pay/ship)

*/

public void sendOrderEvent(String orderId, String eventType, Object data) {

String topic = "order_topic";

String message = JSON.toJSONString(Map.of(

"orderId", orderId,

"eventType", eventType,

"data", data,

"timestamp", System.currentTimeMillis()

));

try {

Message msg = new Message(topic, message.getBytes(StandardCharsets.UTF_8));

// 【关键】使用MessageQueueSelector,将相同订单ID的消息路由到同一队列

SendResult result = producer.send(msg, new MessageQueueSelector() {

@Override

public MessageQueue select(List<MessageQueue> mqs, Message msg, Object arg) {

// arg = orderId

Integer orderId = (Integer) arg;

// 取模运算,相同orderId进入同一队列

int index = orderId % mqs.size();

return mqs.get(index);

}

}, Integer.parseInt(orderId));

log.info("顺序消息发送成功,orderId={}, event={}, queueId={}",

orderId, eventType, result.getMessageQueue().getQueueId());

} catch (Exception e) {

log.error("顺序消息发送失败", e);

throw new RuntimeException("发送失败", e);

}

}

}5.4 消费者:MessageListenerOrderly

java

/**

* 顺序消息消费者

* 关键:使用MessageListenerOrderly,保证单线程处理每个队列

*/

@Component

public class OrderedConsumer {

@Autowired

private OrderStateMachine stateMachine;

@Bean

public DefaultMQPushConsumer orderedConsumer() throws MQClientException {

DefaultMQPushConsumer consumer = new DefaultMQPushConsumer("order_consumer_group");

consumer.setNamesrvAddr("localhost:9876");

consumer.subscribe("order_topic", "*");

// 【关键】从队列头部开始消费(顺序消费必须)

consumer.setConsumeFromWhere(ConsumeFromWhere.CONSUME_FROM_FIRST_OFFSET);

// 【关键】使用MessageListenerOrderly(顺序消费)

consumer.registerMessageListener(new MessageListenerOrderly() {

@Override

public ConsumeOrderlyStatus consumeMessage(List<MessageExt> msgs,

ConsumeOrderlyContext context) {

// 自动提交offset(顺序消费建议自动提交)

context.setAutoCommit(true);

for (MessageExt msg : msgs) {

String orderId = msg.getKeys(); // 从消息属性获取

String body = new String(msg.getBody());

Map<String, Object> event = JSON.parseObject(body);

String eventType = (String) event.get("eventType");

log.info("顺序消费,orderId={}, event={}, queueId={}, msgId={}",

orderId, eventType, msg.getQueueId(), msg.getMsgId());

// 状态机处理(只有正确顺序的状态才能流转)

boolean success = stateMachine.processEvent(orderId, eventType);

if (!success) {

// 顺序错误,暂停当前队列消费

log.error("顺序消费失败,orderId={}, event={}", orderId, eventType);

return ConsumeOrderlyStatus.SUSPEND_CURRENT_QUEUE_A_MOMENT;

}

}

return ConsumeOrderlyStatus.SUCCESS;

}

});

consumer.start();

return consumer;

}

}5.5 订单状态机

java

/**

* 订单状态机:保证状态流转顺序

*/

@Component

public class OrderStateMachine {

enum Status {

CREATED, // 已创建

PAID, // 已支付

SHIPPED, // 已发货

COMPLETED // 已完成

}

// 合法状态转换

private static final Map<Status, Set<Status>> TRANSITIONS = Map.of(

Status.CREATED, Set.of(Status.PAID),

Status.PAID, Set.of(Status.SHIPPED),

Status.SHIPPED, Set.of(Status.COMPLETED)

);

@Autowired

private RedisTemplate<String, String> redisTemplate;

public boolean processEvent(String orderId, String eventType) {

Status target = mapEvent(eventType);

String currentStr = redisTemplate.opsForValue().get("order:" + orderId);

Status current = currentStr == null ? Status.CREATED : Status.valueOf(currentStr);

if (TRANSITIONS.getOrDefault(current, Set.of()).contains(target)) {

redisTemplate.opsForValue().set("order:" + orderId, target.name());

log.info("状态流转成功,orderId={}, {}→{}", orderId, current, target);

return true;

} else {

log.warn("非法状态转换,orderId={}, {}→{}", orderId, current, target);

return false;

}

}

private Status mapEvent(String eventType) {

switch (eventType) {

case "create": return Status.CREATED;

case "pay": return Status.PAID;

case "ship": return Status.SHIPPED;

default: return Status.COMPLETED;

}

}

}5.6 顺序性总结

保序核心:同Key同队列 + 单线程消费

生产端:按业务ID Hash路由

消费端:禁止并发,单线程执行

适合场景:订单流程、状态机、数据流处理六、消息积压:紧急处理

6.1 积压原因分析

RocketMQ消息积压的核心本质是生产速率 > 消费速率:

┌─────────────────────────────────────────────────────────────────┐

│ 消息积压原因分布 │

├─────────────────────────────────────────────────────────────────┤

│ │

│ 生产侧问题(约10%): │

│ ├── 业务高峰(秒杀、大促) │

│ ├── 补偿机制重发 │

│ └── 生产端线程池失控 │

│ │

│ Broker侧问题(约10%): │

│ ├── 磁盘IO瓶颈(PageCache刷盘慢) │

│ ├── 主从同步延迟 │

│ └── 网络分区 │

│ │

│ 消费侧问题(约80%):【重点关注】 │

│ ├── 消费者实例不足(未随流量动态扩容) │

│ ├── 业务逻辑复杂(慢SQL、外部API调用) │

│ ├── 消费者假死(Full GC、死循环) │

│ └── 配置缺陷(消费线程数不足) │

│ │

└─────────────────────────────────────────────────────────────────┘

6.2 第一步:定位积压原因

- 查看消费组堆积量(

mqadmin consumerProgress); - 查看消费者日志,排查业务慢接口;

- 检查是否有死循环/异常导致消费停滞;

- 检查重平衡是否频繁;

- 检查死信队列是否有大量消息。

6.3 第二步:紧急止血(临时扩容)

java

/**

* 消息积压紧急处理

* 核心原则:先恢复消费,再分析原因

*/

@Component

public class BacklogEmergencyHandler {

/**

* 第一招:临时扩容Consumer实例

* 注意:Consumer数量不能超过MessageQueue数量

*

* 例如:Topic有100个队列,当前10个Consumer

* 最多可扩容到100个Consumer(每个Consumer消费1个队列)

*/

public void increaseConsumer() {

// 1. 查看当前队列数

int queueCount = getQueueCount("order_topic");

// 2. 计算最优Consumer数 = 队列数

int optimalConsumerCount = queueCount;

log.info("当前队列数={},建议Consumer数={}", queueCount, optimalConsumerCount);

// 3. 扩容操作(K8s或手动启动新实例)

// kubectl scale deployment rocketmq-consumer --replicas=20

}

/**

* 第二招:开启批量消费

* 每次拉取多条消息,减少网络交互

*/

@Bean

public DefaultMQPushConsumer batchConsumer() throws MQClientException {

DefaultMQPushConsumer consumer = new DefaultMQPushConsumer("batch_consumer_group");

consumer.setNamesrvAddr("localhost:9876");

// 【关键】设置批量消费大小(每次拉取32条)

consumer.setConsumeMessageBatchMaxSize(32);

// 设置消费线程数

consumer.setConsumeThreadMin(20);

consumer.setConsumeThreadMax(64);

consumer.registerMessageListener(new MessageListenerConcurrently() {

@Override

public ConsumeConcurrentlyStatus consumeMessage(List<MessageExt> msgs,

ConsumeConcurrentlyContext context) {

// 批量处理消息

for (MessageExt msg : msgs) {

processMessage(msg);

}

return ConsumeConcurrentlyStatus.CONSUME_SUCCESS;

}

});

return consumer;

}

/**

* 第三招:弃卒保帅 - 非核心业务降级

*/

public void downgrade() {

// 暂停非关键业务消费者

// 降低非关键业务消费者线程数

// 优先保证核心业务(订单、支付)的消费

}

}6.4 第三步:并行爆破(重武器)

java

/**

* 消息转储 + 消费者更大规模扩容

* 适用于千万级以上积压

*/

@Component

public class MassiveBacklogHandler {

/**

* 方案:创建临时Topic,N倍消费者并行处理

*

* 原Topic(10队列)→ 转发程序 → 临时Topic(100队列)→ 100个消费者

*/

public void emergencyExpand(String sourceTopic, int expandFactor) {

String tempTopic = sourceTopic + "_temp_" + System.currentTimeMillis();

int newPartitions = getQueueCount(sourceTopic) * expandFactor;

// 1. 创建临时Topic(队列数 = 原队列数 × 扩容倍数)

createTopic(tempTopic, newPartitions);

// 2. 启动转发消费者(消费原Topic,转发到临时Topic)

startForwardConsumer(sourceTopic, tempTopic);

// 3. 启动处理消费者(消费临时Topic,执行业务逻辑)

for (int i = 0; i < newPartitions; i++) {

startProcessConsumer(tempTopic);

}

log.info("紧急扩容完成,原队列={},临时队列={}",

getQueueCount(sourceTopic), newPartitions);

}

/**

* 消息转发:从原Topic拉取,批量发送到临时Topic

*/

private void startForwardConsumer(String sourceTopic, String tempTopic) {

// 实现消息转发逻辑

// 从sourceTopic拉取消息,批量发送到tempTopic

}

/**

* 业务处理:消费临时Topic

*/

private void startProcessConsumer(String tempTopic) {

// 启动消费者处理业务逻辑

}

}6.5 消息积压处理流程图

┌─────────────────────────────────────────────────────────────────────────┐

│ 消息积压紧急处理流程 │

├─────────────────────────────────────────────────────────────────────────┤

│ │

│ 第1步:定位原因(80%是消费侧问题) │

│ │ │

│ ▼ │

│ 第2步:紧急止血 │

│ ┌─────────────────────────────────────────────────────────────────┐ │

│ │ • 临时扩容Consumer(不超过队列数) │ │

│ │ • 开启批量消费(consumeMessageBatchMaxSize=32) │ │

│ │ • 增加消费线程数(consumeThreadMin/Max) │ │

│ └─────────────────────────────────────────────────────────────────┘ │

│ │ │

│ ▼ │

│ 第3步:弃卒保帅 │

│ ┌─────────────────────────────────────────────────────────────────┐ │

│ │ • 暂停非核心业务消费者 │ │

│ │ • 降低非关键业务线程数 │ │

│ │ • 优先保证核心业务 │ │

│ └─────────────────────────────────────────────────────────────────┘ │

│ │ │

│ ▼ │

│ 第4步:并行爆破(千万级以上积压) │

│ ┌─────────────────────────────────────────────────────────────────┐ │

│ │ • 创建N倍队列的临时Topic │ │

│ │ • 启动N倍消费者并行消费 │ │

│ │ • 处理完成后恢复原Topic │ │

│ └─────────────────────────────────────────────────────────────────┘ │

│ │ │

│ ▼ │

│ 第5步:架构治根 │

│ ┌─────────────────────────────────────────────────────────────────┐ │

│ │ • 监控告警优化(提前预警) │ │

│ │ • 高吞吐架构升级 │ │

│ │ • 应急预案演练 │ │

│ └─────────────────────────────────────────────────────────────────┘ │

│ │

└─────────────────────────────────────────────────────────────────────────┘6.6 积压避坑

- 禁止无限重试:失败消息进入死信队列,避免阻塞正常消息;

- 消费线程数不超过队列数:多了没用,浪费资源;

- 核心业务限流生产:从源头控制流量,避免再次积压;

- 重平衡优化:调整

consumerTimeoutMinutesWhenIdle和pullInterval,减少重平衡。

七、RocketMQ生产级高级特性:事务消息与分布式事务

7.1 事务消息(金融级核心)

核心原理

解决分布式系统数据不一致 问题,保证生产者发送消息+本地事务原子性:

- 生产者发送半消息到Broker(暂不投递);

- 执行本地事务(如扣减库存);

- 本地事务成功→发送Commit,Broker投递消息;

- 本地事务失败→发送Rollback,Broker删除消息。

代码实战:事务消息

java

import org.apache.rocketmq.client.producer.*;

import org.apache.rocketmq.common.message.Message;

import org.apache.rocketmq.remoting.common.RemotingHelper;

/**

* RocketMQ事务消息:保证多条消息原子性发送

*/

public class RocketMQTransactionProducerDemo {

public static void main(String[] args) throws Exception {

// 1. 配置事务生产者

TransactionMQProducer producer = new TransactionMQProducer("Transaction_Producer_Group");

producer.setNamesrvAddr("127.0.0.1:9876");

producer.setEnableIdempotence(true);

// 设置事务监听器

producer.setTransactionListener(new TransactionListenerImpl());

producer.start();

// 2. 发送事务消息

Message msg = new Message(

"Transaction_Topic",

"ORDER_1001",

"订单创建+支付,事务消息"

);

// 发送事务消息

SendResult sendResult = producer.sendMessageInTransaction(msg, null);

System.out.println("✅ 事务消息发送成功,状态:" + sendResult.getSendStatus());

producer.shutdown();

}

// 事务监听器(核心)

static class TransactionListenerImpl implements TransactionListener {

@Override

public LocalTransactionState executeLocalTransaction(Message msg, Object arg) {

// 执行本地事务(如扣减库存)

System.out.println("🔧 执行本地事务:扣减库存");

// 本地事务成功,返回COMMIT

return LocalTransactionState.COMMIT_MESSAGE;

// 本地事务失败,返回ROLLBACK

// return LocalTransactionState.ROLLBACK_MESSAGE;

}

@Override

public LocalTransactionState checkLocalTransaction(MessageExt msg) {

// 检查本地事务状态

System.out.println("🔍 检查本地事务状态");

return LocalTransactionState.COMMIT_MESSAGE;

}

}

}八、生产级配置清单

8.1 生产者配置

properties

# producer配置(可靠性优先)

# 同步发送(核心业务必须)

# 异步发送(日志、埋点等非核心业务)

# 重试配置

retryTimesWhenSendFailed = 3 # 同步发送重试次数

retryTimesWhenSendAsyncFailed = 3 # 异步发送重试次数

sendMsgTimeout = 5000 # 发送超时(毫秒)

# 批量优化

compressMsgBodyOverHowmuch = 4096 # 超过4KB启用压缩

maxMessageSize = 4194304 # 最大消息4MB8.2 Broker配置

properties

# broker.conf - 生产级配置

# === 可靠性配置 ===

flushDiskType = SYNC_FLUSH # 同步刷盘

brokerRole = SYNC_MASTER # 同步复制

waitTimeMillsInSyncQueue = 50000 # 等待同步超时

# === 存储配置 ===

storePathRootDir = /data/rocketmq/store

mapedFileSizeCommitLog = 1073741824 # 1GB

deleteWhen = 04 # 凌晨4点删除过期文件

fileReservedTime = 72 # 保留72小时

# === 性能配置 ===

sendMessageThreadPoolNums = 16 # 发送线程池

pullMessageThreadPoolNums = 16 # 拉取线程池

useReentrantLockWhenPutMessage = true # 使用重入锁8.3 消费者配置

properties

# consumer配置

# 消费模式

consumeFromWhere = CONSUME_FROM_LAST_OFFSET # 从最新开始

consumeMessageBatchMaxSize = 32 # 批量消费大小

# 线程配置

consumeThreadMin = 20 # 最小消费线程

consumeThreadMax = 64 # 最大消费线程

# 超时配置

consumeTimeout = 15 # 消费超时(分钟)

maxReconsumeTimes = 16 # 最大重试次数

# Rebalance优化

rebalanceLockInterval = 30000 # 30秒8.4 配置清单汇总

| 配置项 | 推荐值 | 作用 |

|---|---|---|

| 生产端 | ||

| 发送方式 | 同步发送 | 等待Broker确认 |

| retryTimesWhenSendFailed | 3 | 网络抖动重试 |

| sendMsgTimeout | 5000ms | 发送超时 |

| Broker端 | ||

| flushDiskType | SYNC_FLUSH | 同步刷盘 |

| brokerRole | SYNC_MASTER | 同步复制 |

| default.replication.factor | 3 | 3副本 |

| 消费端 | ||

| consumeFromWhere | CONSUME_FROM_LAST_OFFSET | 从最新开始 |

| 消费确认 | 手动ACK | 业务成功才确认 |

| maxReconsumeTimes | 16 | 最大重试次数 |

九、RocketMQ生产问题全方位对比总结

| 生产问题 | 核心原因 | 解决方案 | 核心关键词 |

|---|---|---|---|

| 消息丢失 | 生产未确认、Broker未持久化、消费自动ACK | 生产Confirm+事务+Broker多副本+消费手动ACK | 全链路防丢 |

| 消息重复 | 网络重传、重试、重平衡 | 消费端幂等性(唯一ID+去重) | 幂等兜底 |

| 消息乱序 | 并发消费、多队列路由 | 同Key同队列+单线程消费 | 局部有序 |

| 消息积压 | 消费速度不足 | 扩容消费者、批量消费、死信队列、临时分流 | 提速扩容 |

| 分布式事务 | 跨服务数据不一致 | 事务消息+本地消息表 | 最终一致 |

十、面试高频真题

Q1:RocketMQ为什么吞吐量高?

答案:三大核心设计

- 顺序写CommitLog:所有Topic共享一个日志文件,顺序追加写入,最大化利用磁盘IO;

- 零拷贝:使用mmap内存映射,数据从PageCache直接到网卡,减少拷贝;

- PageCache:读写都在操作系统页缓存中进行,不经过JVM堆内存,减少GC。

Q2:如何保证RocketMQ消息不丢失?

答案:三端配合

- 生产端:同步发送 + 重试机制 + 事务消息;

- Broker端:同步刷盘(SYNC_FLUSH)+ 同步复制(SYNC_MASTER);

- 消费端:手动ACK,业务处理成功后才确认。

Q3:RocketMQ如何保证顺序消息?

答案:分区有序

- 生产者:使用MessageQueueSelector将相同业务Key的消息路由到同一队列;

- Broker:单队列内消息天然有序;

- 消费者:使用MessageListenerOrderly单线程处理每个队列。

Q4:RocketMQ消息重复消费的原因是什么?

答案:At Least Once语义

- 网络超时重试:生产者发送超时,触发重试,Broker可能已收到;

- 消费者Rebalance:分区重新分配时,offset未及时提交;

- 消费超时:处理耗时过长,未提交offset,重新消费;

- 解决方案:业务幂等设计(数据库唯一键、Redis分布式锁)。

Q5:RocketMQ事务消息的原理是什么?

答案:两阶段提交

- 半消息:生产者发送半消息到Broker(消费者不可见);

- 本地事务:生产者执行本地业务(如更新订单状态);

- 提交/回滚:本地事务成功则commit,失败则rollback;

- 回查机制:Broker定时回查本地事务状态,防止消息未决。

Q6:消息积压了怎么办?

答案:四步紧急处理

- 定位原因:80%是消费侧问题(消费者不足、逻辑慢、假死);

- 临时扩容:增加Consumer实例(不超过队列数),开启批量消费;

- 降级处理:暂停非核心业务消费者,优先保证核心业务;

- 临时Topic:创建N倍队列的临时Topic,N倍消费者并行处理。

Q7:RocketMQ和Kafka有什么区别?

答案:核心差异

| 维度 | RocketMQ | Kafka |

|---|---|---|

| 存储模型 | 单CommitLog(万级Topic) | 每Topic独立文件(千级Topic) |

| 顺序消息 | 支持(MessageQueueSelector) | 支持(分区有序) |

| 事务消息 | 支持 | 不支持 |

| 延迟消息 | 支持18个级别 | 不支持 |

| 消息过滤 | Tag/SQL92过滤 | 无 |

| 适用场景 | 金融、订单、复杂业务 | 日志、大数据流处理 |

Q8:RocketMQ事务消息如何实现分布式事务?

答案:原子性+最终一致性

- 发送半消息到Broker,暂不投递;

- 执行本地事务,成功则Commit,失败则Rollback;

- 消费端幂等,保证不重复执行;

- 最终所有节点数据一致。

总结

1. 核心知识点速记口诀

RocketMQ特性全掌握,队列副本加事务

生产防丢Confirm全,幂等事务保安全

Broker持久多副本,同步刷盘不丢数

消费手动ACK确认,业务成功再签收

消息重复不可免,幂等机制来兜底

唯一ID加去重,重复执行无影响

消息乱序要避免,同Key同队单线程

生产路由算好模,消费顺序不打乱

消息积压不用急,扩容批量加分流

死信队列处理异常,百万积压快速清

分布式事最难搞,事务消息来保障

金融级可靠是目标,数据安全无差错2. 核心要点回顾

- RocketMQ核心:NameServer→Broker→Topic→Queue,NameServer无状态,Broker多副本;

- 消息丢失:生产Confirm、Broker多副本、消费手动ACK,三位一体;

- 消息重复:无解,只能幂等性兜底,唯一ID+去重存储;

- 消息顺序:同Key路由同队列+单线程消费,保证局部有序;

- 消息积压:扩容消费者+批量消费+死信队列+临时分流,快速消化;

- 分布式事务:事务消息+本地消息表,实现最终一致性;

- 金融级可靠:事务+幂等+手动ACK+顺序消费,四大特性全覆盖。

3. 生产环境配置速查

| 业务类型 | 生产端 | Broker | 消费端 |

|---|---|---|---|

| 订单/支付 | 同步发送 | 同步刷盘+同步复制 | 手动ACK+幂等 |

| 积分/通知 | 同步发送 | 异步刷盘+异步复制 | 手动ACK |

| 日志/埋点 | 异步发送 | 异步刷盘+异步复制 | 自动ACK |

4. 生产环境配置最佳实践

- 核心支付/订单系统:Confirm+事务+幂等+手动ACK+顺序消费+死信队列;

- 高吞吐日志系统:可适当降低可靠性,追求高性能;

- 线上应急:优先扩容消费者,其次处理死信,最后优化业务;

- 集群部署 :至少3个Broker,副本数≥2,

flushDiskType=SYNC_FLUSH; - 监控告警:实时监控堆积量、延迟、死信队列,异常及时告警;

- 延迟消息:使用固定延迟级别,实现定时任务。

写在最后

RocketMQ作为历经双十一考验的金融级消息中间件,其可靠性设计值得每个架构师深入学习。但"会用"和"用好"之间隔着无数生产事故------消息丢失、重复、乱序、积压,这些问题几乎都能在配置和设计层面找到解决方案。

很多开发者遇到问题第一反应是"RocketMQ有bug",但99%的问题其实是配置不当或使用方式有误。深入理解RocketMQ的核心原理和可靠性机制,才能在关键时刻快速定位问题,保障系统稳定运行。

记住:RocketMQ的高性能是设计出来的,可靠性是配置出来的,而稳定性是监控出来的。

如果觉得有帮助,欢迎点赞、收藏、转发!