1. 为什么需要内存模型?------从一个"诡异"的 Bug 说起

我们先看一段看起来"完全没问题"的代码:

cpp

// 线程间通信:一个线程准备数据,另一个线程读取

// ❌ 这段代码存在严重的并发问题!

#include <thread>

#include <iostream>

int data = 0; // 共享数据------普通变量,没有任何同步保护

bool ready = false; // 标志位:数据是否准备好------同样是普通变量

void producer() {

data = 42; // Step 1: 写入数据

ready = true; // Step 2: 设置标志位

}

void consumer() {

while (!ready) { // Step 3: 等待标志位

// 忙等------注意:编译器可能将 ready 缓存到寄存器中,

// 导致这个循环永远不会退出!(见下面的编译器优化分析)

}

std::cout << data << std::endl; // Step 4: 读取数据

// 你期望输出 42,但可能输出 0!

}

int main() {

std::thread t1(producer);

std::thread t2(consumer);

t1.join(); // 等待 t1 执行完毕

t2.join(); // 等待 t2 执行完毕

return 0;

}这段代码的意图 非常清晰:生产者先写 data = 42,再设 ready = true;消费者等到 ready == true 后读取 data。逻辑上,输出应该永远是 42。

但实际上,这段代码有三个致命问题:

问题一:编译器重排序(Compiler Reordering)

编译器为了优化性能,可能会调换 data = 42 和 ready = true 的执行顺序。因为从单线程的视角看,这两条语句之间没有依赖关系,交换顺序不影响单线程的正确性。但对于多线程,顺序至关重要。

cpp

// 编译器可能将 producer() 优化为:

void producer() {

ready = true; // ← 被提前了!

data = 42; // ← 被延后了!

}

// 这样 consumer 可能在 data 还没写入时就看到 ready == true** 编译器为什么要重排序?**

指令流水线 :最朴素的 CPU 执行方式是:一条指令彻底完成,再开始下一条。但一条指令内部其实由多个步骤组成,每个步骤使用的硬件部件不同。经典的五级流水线把每条指令拆成:

| 阶段 | 缩写 | 做什么 | 用到的硬件 |

|---|---|---|---|

| 取指 | IF | 从内存取出指令 | 程序计数器、指令缓存 |

| 译码 | ID | 解析指令含义,读寄存器 | 译码器、寄存器文件 |

| 执行 | EX | 算术/逻辑运算 | ALU |

| 访存 | MEM | 读写内存(load/store) | 数据缓存 |

| 写回 | WB | 结果写回寄存器 | 寄存器文件 |

当指令 1 在做"译码"时,"取指"部件是空闲的,完全可以让指令 2 去用。这就像工厂流水线------工人 A 在给产品上螺丝时,工人 B 可以同时给下一个产品喷漆,各干各的。所以 CPU 让多条指令像这样重叠执行:

时钟周期: 1 2 3 4 5 6 7

指令1: IF ID EX MEM WB

指令2: IF ID EX MEM WB

指令3: IF ID EX MEM WB理想情况下,虽然每条指令仍需 5 个周期完成,但每个周期都能"吐出"一条指令的结果,吞吐量提升到了 5 倍。

为什么编译器敢重排?

编译器做优化时遵循的是 as-if 规则 :只要单线程的可观察行为 不变,怎么改都行。

编译器重排序的目的是优化指令流水线的利用率 。

如上面所说,现代 CPU 的指令流水线有多个阶段(取指、译码、执行、访存、写回),如果连续两条指令访问同一个内存地址 ,可能产生流水线停顿(pipeline stall) 。编译器通过重排指令来避免这种停顿,提高指令级并行度(ILP, Instruction-Level Parallelism,在一段代码中,有多少指令可以同时执行)。在单线程环境下这是完全安全的(因为编译器保证重排不改变单线程的可观察行为),但在多线程环境下就可能破坏程序员的预期。

为什么连续两条指令访问同一内存地址会导致流水线停顿?

数据冒险(Data Hazard)

cpp

// 考虑这两条连续指令:

str x1, [addr] // 指令A:把 x1 的值写入内存地址 addr

ldr x2, [addr] // 指令B:从同一个地址 addr 读值到 x2

// 在流水线里它们是重叠的:

时钟周期: 1 2 3 4 5 6

指令A(store): IF ID EX MEM WB

指令B(load): IF ID EX MEM WB

// 问题在于:指令 B 在第 5 周期的 MEM 阶段去读 addr,但指令 A 要到第 4 周期的 MEM 阶段才把数据写进去。 如果 B 的 MEM 阶段和 A 的 MEM 阶段时序卡得太紧,B 可能读到的是旧值,或者必须等 A 写完。

// 更直观的例子是寄存器级别的:

add x1, x2, x3 // 指令A:x1 = x2 + x3,结果在 EX 阶段才算出来

sub x4, x1, x5 // 指令B:需要用 x1,但在 ID 阶段就要读 x1

// 在流水线中:

时钟周期: 1 2 3 4 5

指令A: IF ID EX MEM WB ← 第5周期才写回 x1

指令B: IF ID ... ← 第3周期就要读 x1!

↑

x1 还没准备好!

// 指令 B 在第 3 周期需要 x1 的值,但指令 A 到第 5 周期才写回。这就是 Read-After-Write (RAW) 冒险。停顿(Stall / Bubble)

CPU 的解决办法之一就是插入气泡------让 B 原地等几个周期:

cpp

时钟周期: 1 2 3 4 5 6 7

指令A: IF ID EX MEM WB

[bubble] [bubble]

指令B: IF ---- ---- ID EX MEM WB

// 这些空等的周期就是流水线停顿(pipeline stall),流水线里出现了"气泡",吞吐量下降了。

// 虽然现代 CPU 用数据转发/旁路(forwarding/bypassing)技术能缓解很多情况(比如把 A 的 EX 结果直接转发给 B,不等写回),但涉及到内存访问(load/store)时,延迟更大、转发更困难,停顿更容易发生。编译器优化

编译器知道这些硬件特性,所以它会分析指令间的依赖图,尽量让没有依赖关系的指令同时进入不同的执行单元,在两条有依赖的指令之间插入不相关的指令来填充气泡,这就是编译器重排指令,进而提高进而提高指令级并行度:

cpp

// 原始顺序(会停顿):

str x1, [addr] // A:写 addr

ldr x2, [addr] // B:读 addr(依赖A,要等)

// 编译器重排后:

str x1, [addr] // A:写 addr

add x5, x6, x7 // C:完全无关的运算,填在中间

ldr x2, [addr] // B:读 addr(A已经完成了,不用等)

// 指令 C 本来在代码的其他位置,编译器把它"搬"过来填坑。这就是为什么编译器要重排指令------不是闲着没事干,而是在帮 CPU 避免停顿,进而提高指令级并行度。问题二:CPU 指令重排序(CPU Reordering)

即使编译器没有重排序,现代 CPU 的乱序执行(Out-of-Order Execution)也可能让 ready = true 的效果在 data = 42 之前对其他 CPU 核心可见。

CPU 为什么要乱序执行?

乱序执行是 CPU 微架构层面的优化。CPU 内部有一个保留站(Reservation Station)/ 重排序缓冲区(ROB, Reorder Buffer) ,它将指令按数据依赖关系而非程序顺序来调度执行 。例如,如果指令 A 需要等待内存读取(可能耗时 100+ 个周期),CPU 不会空等,而是先执行后面不依赖 A 结果的指令 B 和 C。这在单核 看来结果是一致的(CPU 保证单核的退休顺序与程序顺序一致 ),但对其他核心观察到的写入顺序可能不同 。

举个例子:

cpp

// 假设 CPU 按顺序执行这三条指令:

ldr x1, [addr1] // A:从内存读数据到 x1(cache miss,要等 100+ 周期)

add x2, x1, x3 // B:x2 = x1 + x3(依赖 A 的结果)

add x5, x6, x7 // C:x5 = x6 + x7(和 A、B 完全无关)

// 如果严格按顺序执行,CPU的状态是:

周期 1: A 发出内存请求

周期 2~100: 等......等......等......(x1 还没回来)

B 不能执行(依赖 x1)

C 也不能执行(被 B 挡住了)

周期 101: A 完成,x1 就绪

周期 102: B 执行

周期 103: C 执行

// CPU 白白空转了将近 100 个周期。C 明明和 A、B 没有任何关系,却被堵在后面,这太浪费了。

// 乱序执行的思路就是:既然 C 不依赖 A 和 B,为什么不先执行 C?

周期 1: A 发出内存请求

周期 2: C 执行!(不用等 A)

周期 3~100: 还可以继续执行后面其他不依赖 A 的指令

周期 101: A 完成,x1 就绪

周期 102: B 执行

// 白白浪费的 100 个周期被利用起来了。这就是乱序执行的核心价值。如何实现CPU乱序执行?

1. 保留站(Reservation Station):保留站是指令的"候车室"。每条指令被译码后,不是直接执行,而是先进入保留站等待。保留站会记录:

- 这条指令要做什么运算

- 它需要哪些操作数

- 这些操作数是否已经就绪

一旦某条指令的所有操作数都就绪了,它就可以被**发射(issue)**到执行单元去执行------不管它前面的指令有没有完成。

cpp

// 例如上面的例子:

保留站状态(周期 2):

┌─────────┬──────────┬────────────┐

│ 指令 │ 操作数 │ 状态 │

├─────────┼──────────┼────────────┤

│ A (ldr) │ addr1 │ 等待内存 │

│ B (add) │ x1, x3 │ x1 未就绪 │ ← 等 A

│ C (add) │ x6, x7 │ 全部就绪! │ ← 可以发射!

└─────────┴──────────┴────────────┘

// C 的操作数 x6 和 x7 都已经在寄存器里了,所以 C 直接被发射执行,跳过了还在等待的 A 和 B。2. 重排序缓冲区(ROB, Reorder Buffer) :乱序执行带来一个问题,指令的完成顺序和程序顺序不一致了 。如果中间发生异常(比如指令 A 触发了缺页中断),已经执行完的 C 的结果应该算数吗?按照程序语义,A 都没完成,C 不该被执行。

ROB 就是用来解决这个问题的。它是一个按程序顺序排列的队列,每条指令进入流水线时按顺序分配一个 ROB 条目:

cpp

ROB(周期 2):

┌────────┬────────┬──────────┐

│ 槽位 │ 指令 │ 状态 │

├────────┼────────┼──────────┤

│ #1 │ A │ 执行中 │

│ #2 │ B │ 等待 │

│ #3 │ C │ 已完成 ✓ │ ← 虽然先算完了,但不能先提交

└────────┴────────┴──────────┘

// C 虽然先算完了,但它的结果暂时存在 ROB 里,不会立即写入寄存器文件/内存。只有当队列头部的指令完成了,才按顺序提交(commit/retire):

周期 101: A 完成 → 提交 A(ROB #1 退出)

周期 102: B 完成 → 提交 B(ROB #2 退出)

周期 102: C 早就完成了 → 提交 C(ROB #3 退出)

// 这就是上面说的"CPU 保证单核的退休顺序与程序顺序一致",从本核心的视角看,结果和顺序执行完全一样。问题三:内存可见性(Memory Visibility)

CPU 核心各有自己的缓存 (L1/L2 Cache)。一个核心对变量的修改不一定会立刻对其他核心可见。没有适当的同步手段,消费者可能看到 ready == true 但 data 仍然是旧值 0。

举个例子:

// 现代多核 CPU 的内存层次大致是这样的:

核心0 核心1

┌──────────┐ ┌──────────┐

│ 寄存器 │ │ 寄存器 │

│ L1 Cache │ │ L1 Cache │ ← 每个核心私有

│ L2 Cache │ │ L2 Cache │ ← 通常也私有

└────┬─────┘ └────┬─────┘

└──────────┬────────────┘

L3 Cache ← 所有核心共享

│

主内存L1/L2 是每个核心私有 的。当核心 0 写一个变量时,新值首先写入核心 0 自己的 L1 Cache,并不会立刻出现在核心 1 的 L1 Cache 里。

问题四:编译器优化导致的无限循环

还有一个容易被忽视的问题:编译器在优化 consumer() 时,可能发现 ready 在循环体内没有被修改 ,于是将 ready 的值缓存到寄存器中 ,导致循环永远不会退出。这并不是重排序问题 ,而是编译器不知道其他线程可能修改这个变量 的问题。C++ 标准规定,对非原子、非 volatile(volatile用于声明禁止编译器优化) 变量的并发读写是未定义行为(Undefined Behavior, UB),编译器可以做出任意假设。

cpp

// 编译器可能将 consumer() 优化为:

void consumer() {

bool cached_ready = ready; // 将 ready 读入寄存器(只读一次!)

while (!cached_ready) { // 永远循环下去...

// 因为 cached_ready 永远不会改变

}

std::cout << data << std::endl;

}问题汇总:

所以会有一个矛盾:现代硬件和编译器都是为单线程优化的,但程序员写的是多线程代码。这就导致对于多线程代码有三层因为优化而产生的问题,每层都独立地可能破坏多线程程序的正确性:

- 第一层:编译器重排序。 编译器为了提高指令级并行度、避免流水线停顿,会调换没有数据依赖的语句顺序。

data = 42和ready = true在单线程视角下互不依赖,编译器可能把ready = true提前,导致 consumer 看到信号时数据还没写入。 - 第二层:CPU 乱序执行 + Store Buffer。 即使编译器没重排,CPU 的乱序执行引擎会按数据依赖关系而非程序顺序来调度指令。而且执行结果会先进入 Store Buffer,不同变量的写入从 Store Buffer 刷出到缓存的时序不确定,其他核心可能先看到后写的变量。

- 第三层:缓存可见性延迟。 每个核心有私有的 L1/L2 Cache,一个核心的写入需要通过缓存一致性协议(MESI)传播到其他核心,这个传播有时间窗口,不同变量的传播速度可能不同。

- 额外还有一个编译器层面的问题: 编译器发现

ready在循环体内没被修改,就把它缓存到寄存器里只读一次,导致循环永远看不到其他线程的更新,变成死循环。这不是重排,而是编译器利用 UB 做的激进优化。

这四个问题的共同根源 是:C++ 标准规定对非原子变量的并发读写是未定义行为,编译器和 CPU 都有权假设不存在多线程竞争,从而自由优化。

这就是为什么我们需要内存模型 ------它是一套规则,定义了在多线程环境下,一个线程对内存的修改何时、以何种顺序对其他线程可见。

2. 硬件层:CPU 缓存、缓存一致性与内存屏障

在理解 C++ 内存模型之前,必须先理解硬件层面发生了什么。

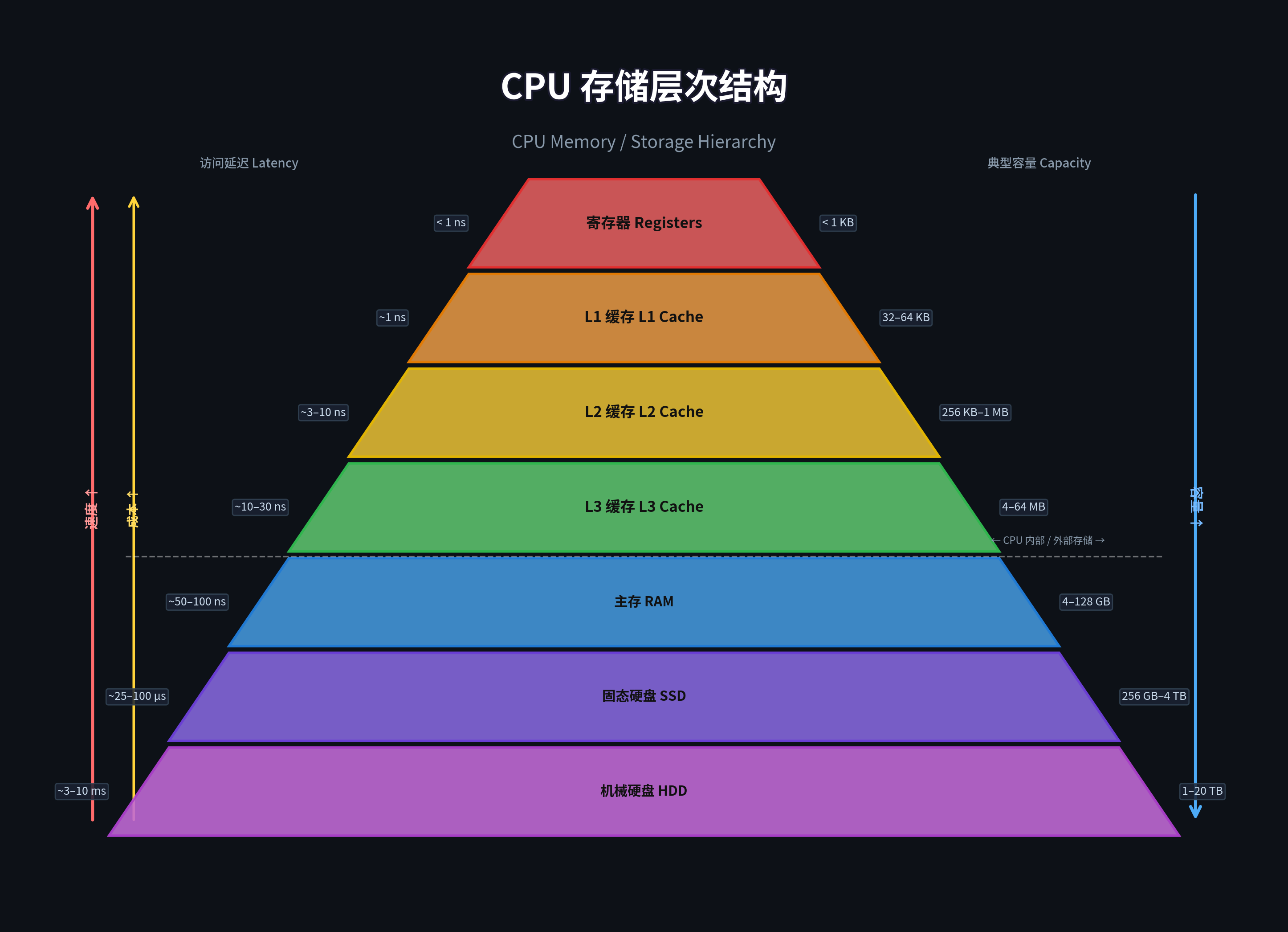

2.1 现代 CPU 的存储层次

关键事实:

-

L1/L2 Cache 是每个 CPU 核心私有的。Core 0 写入一个变量,修改首先只存在于 Core 0 的 L1 Cache 中。

-

从 L1 到主内存,延迟差距可达 50-100 倍。

-

L1 分为 I-Cache(指令缓存)和 D-Cache(数据缓存),现代 CPU 通常各 32KB 或 48KB。

-

Cache Line(缓存行)是缓存操作的最小单位(CPU 缓存与内存之间交换数据的最小单位 ),通常为 64 字节 。 L1 Cache、L2 Cache、L3 Cache这三层------它们内部都是以缓存行为单位 来存储和管理数据的。即使你只修改了一个

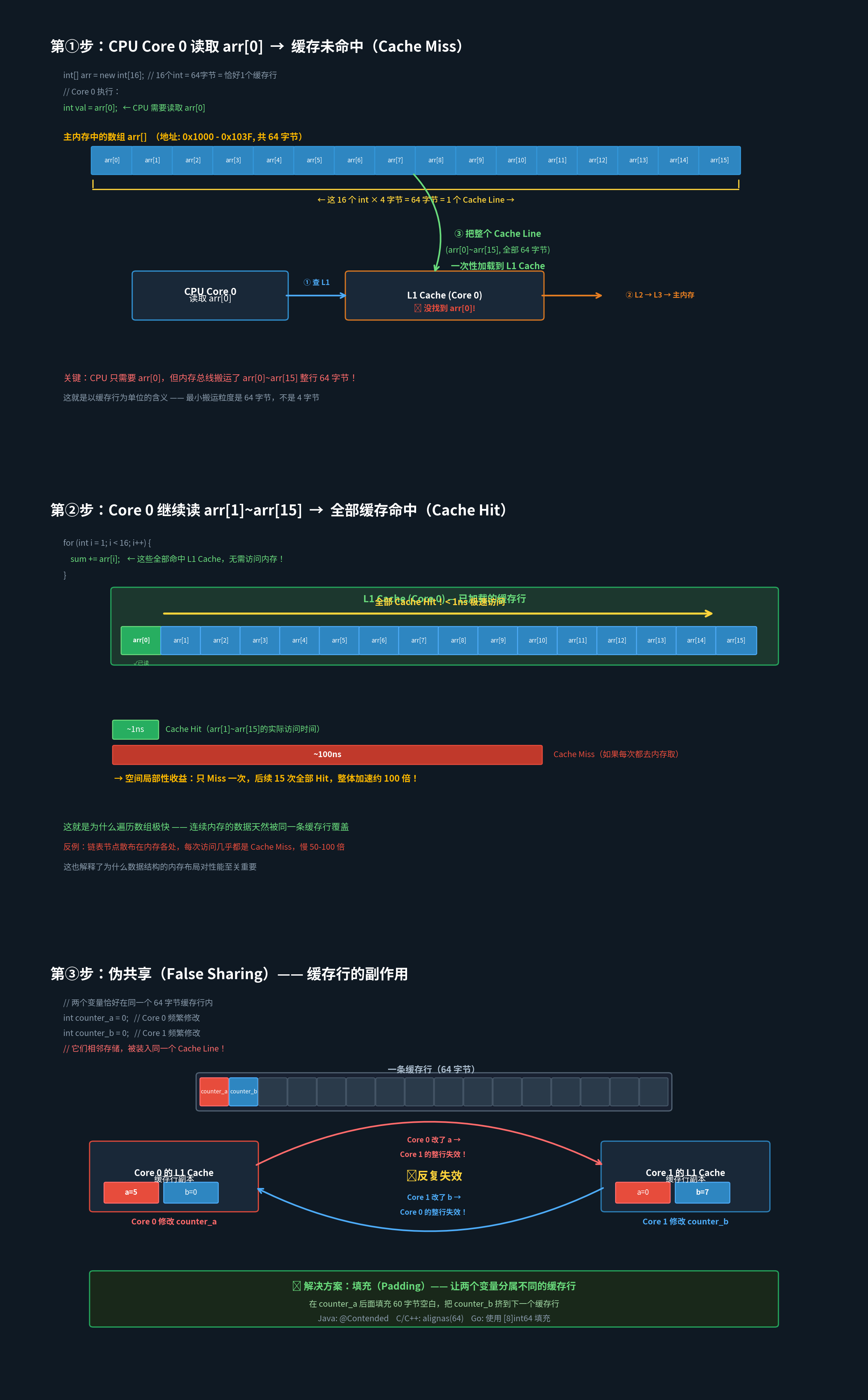

int(4 字节),CPU 并不会只搬运这 4 字节,而是会把这个变量所在的整整 64 字节(一个缓存行)一起从内存加载到 L1 Cache 中。写回时也是整行操作。举个多核数组访问场景的例子:

第①步 Cache Miss :Core 0 只想读arr[0](4 字节),但 CPU 按缓存行为单位搬运,直接把arr[0]~arr[15]整整 64 字节从内存拉进 L1 Cache。

第②步 Cache Hit :接下来遍历arr[1]~arr[15]时,数据全在 L1 里了,每次访问 1ns,比去内存(100ns)快约 100 倍。这就是连续数组比链表快的根本原因。

第③步 伪共享 :两个核心各改各的变量,但因为它们挤在同一条缓存行里,每次修改都会让对方的整行副本失效、重新加载,反复拉扯导致严重性能下降。解决办法是用填充(Padding)把它们隔开到不同的缓存行。

-

补充一个查找过程和策略:

** 缓存的关联性(Associativity)**

缓存内部是怎么决定"一条数据该放在哪个位置"的?有一下几种策略:

缓存不是简单的"大数组",它通常采用 N 路组相联(N-way Set Associative)结构 。例如 8 路组相联意味着,对于某个特定的内存地址,它只能存储在缓存中 8 个特定位置之一 (也就是说即便有其他空位,但也只能存在这8个特定位置之一,其他空位无法使用)。这意味着即使缓存没有完全用满,也可能因为"冲突未命中"(Conflict Miss)而淘汰有用的数据。这在性能调优中很重要------如果你的数据结构中经常访问的字段恰好映射到缓存的同一个组(set),就会产生严重的性能问题。补充说明8路组相关联:

8路组相联缓存是指每个缓存组中包含8条缓存行,通过组索引 和标签 匹配实现高效缓存访问。

基本概念:在8路组相联缓存中,Cache被划分为若干组(Set),每组包含8条缓存行(line)。每条缓存行存储主存中的一块连续数据(通常称为Cache Line),并配有一个标签(Tag)用于标识该缓存行对应的主存地址。

地址映射与访问流程:

- 组索引(Set Index):CPU访问某个内存地址时,先取地址的中间几位作为组索引,确定该地址映射到哪一组。例如,对于32KB、每行64字节、8路组相联的Cache,总共有64组,地址的第6到11位用于选择组。

- 标签匹配(Tag Match):确定组后,需要在组内的8条缓存行中查找标签是否匹配。如果某条缓存行的标签与地址匹配且有效,则发生缓存命中(Cache Hit);否则为缓存未命中(Cache Miss)。

- 并行比较:组内的8条缓存行的标签通常同时进行比较,以加快查找速度。

2.2 缓存一致性协议(MESI)

既然每个核心都有自己的缓存 ,那如何保证数据一致 ?答案是缓存一致性协议 ,最经典的是 MESI 协议。

MESI 定义了每条缓存行的四种状态:

| 状态 | 全称 | 含义 |

|---|---|---|

| M (Modified) | 已修改 | 本核心修改了这行数据,与主内存不一致,其他核心没有这行的有效拷贝 |

| E (Exclusive) | 独占 | 本核心独占这行数据,与主内存一致,其他核心没有这行的有效拷贝 |

| S (Shared) | 共享 | 多个核心都有这行数据的拷贝,与主内存一致 |

| I (Invalid) | 无效 | 本核心的这行数据已失效(被其他核心修改了) |

** MESI 的扩展协议**

实际硬件中使用的协议通常是 MESI 的扩展版本:

- MOESI (AMD 使用):增加了 O (Owned) 状态,允许一个核心在持有 Modified 数据时与其他核心共享,而不必先写回主内存。这减少了内存总线的流量。

- MESIF (Intel 使用):增加了 F (Forward) 状态,在多个核心持有 Shared 状态的缓存行时,只有 F 状态的核心负责响应其他核心的读请求,避免所有 S 状态核心同时响应。

MESI 的核心流程举例:

初始状态:变量 x = 0 在主内存中

1. Core 0 读取 x:

- Cache Miss! 从主内存加载到 Core 0 的 L1 Cache

- 状态标记为 E (Exclusive)

- (因为没有其他核心缓存了这行数据)

2. Core 1 也读取 x:

- Cache Miss! 通过总线嗅探(Bus Snooping)发现 Core 0 有这行数据

- Core 0 的状态从 E 变为 S (Shared)

- Core 1 也得到一份拷贝,状态为 S (Shared)

- (现在两个核心都有一致的拷贝)

3. Core 0 写入 x = 42:

- Core 0 需要独占这行数据才能修改

- Core 0 发出 "Invalidate" 消息到总线

- Core 1 收到消息,将本地缓存行状态变为 I (Invalid)

- Core 1 回复 Invalidate ACK

- Core 0 收到 ACK 后,状态变为 M (Modified)

- Core 0 在自己的 Cache 中修改 x = 42

4. Core 1 再次读取 x:

- 发现自己的缓存行是 I (Invalid)

- 发出读请求到总线

- Core 0 通过总线嗅探发现读请求命中自己的 M 状态缓存行

- Core 0 将修改后的数据(x=42)发给 Core 1

- Core 0 同时将数据写回主内存(Write-Back)

- Core 0 和 Core 1 的状态都变为 S (Shared)关键点 :MESI 保证了最终所有核心能看到一致的数据 ,但是时机是不确定的。原因在于下面的 Store Buffer 和 Invalidate Queue。

2.3 Store Buffer 与 Invalidate Queue

为了提高性能,现代 CPU 在缓存一致性协议之上又加了两个缓冲结构:

Store Buffer(写缓冲区):

Core 0 写入 x = 42 时,如果要严格遵循 MESI:

1. 发送 Invalidate 消息

2. 等待所有其他核心回复 ACK(可能要等几十个时钟周期!)

3. 收到所有 ACK 后,才修改缓存行

4. 继续执行下一条指令

这太慢了!所以现代 CPU 引入了 Store Buffer:

1. 将 "x = 42" 暂存到 Store Buffer(几乎瞬间完成)

2. 同时发送 Invalidate 消息(异步)

3. CPU 立即继续执行后续指令(不等待 ACK)

4. 等 ACK 全部收到后,Store Buffer 中的值再异步刷入 L1 Cache

结果:Core 0 自己能立即看到 x = 42(CPU 会先检查 Store Buffer 再查 Cache,叫做 "Store Forwarding" / "Store Buffer Forwarding")但 Core 1 可能暂时还看不到这个修改!Invalidate Queue(失效队列):

Core 1 收到 "x 已失效" 的 Invalidate 消息时,如果严格处理:

1. 立即将对应缓存行标记为 Invalid

2. 回复 ACK

但标记 Invalid 需要查找缓存(有时还需要等待 Cache 可用),所以:

1. 将 Invalidate 消息放入 Invalidate Queue(瞬间完成)

2. 立即回复 ACK(让 Core 0 不用等)

3. 稍后再真正处理队列中的 Invalidate 消息,将缓存行标记为 Invalid

结果:Core 1 可能在一小段时间内还能读到 x 的旧值!因为 Invalidate 还在队列里排队,还没真正执行。这就是为什么仅有缓存一致性协议是不够的 ------Store Buffer 和 Invalidate Queue 让修改的可见性变得不确定。它们让 CPU 快了很多,但也让多线程编程变得困难。

2.4 内存屏障(Memory Barrier / Memory Fence)

在提出解决办法之前,我们先捋一下问题(即屏障到底在"挡"谁):

存在两道关卡会改变程序的指令执行顺序:

- 关卡 1:编译器。 它在编译阶段就可能把你的指令换位置。原因是 as-if 规则------只要单线程行为不变,编译器怎么排都行。你写的是

data=42; ready=true;,它可能生成的 机器码顺序是ready=true; data=42;。这一步发生在你的代码变成二进制的时候,CPU 还没上场。 - 关卡 2:CPU 硬件。 即使编译器没重排,CPU 的乱序执行引擎 、Store Buffer、Invalidate Queue 也会让其他核心观察到的写入顺序 跟你程序中的顺序不一样。这一步发生在指令实际运行的时候。

所以"内存屏障"其实是一个统称,对应这两道关卡,有两种不同层次的屏障:

| 编译器屏障 | 硬件内存屏障 | |

|---|---|---|

| 挡谁 | 只挡编译器 | 挡编译器 + 挡 CPU |

| 生成 CPU 指令吗 | 不生成,零开销 | 生成(如 MFENCE、DMB) |

| C++ 写法 | asm volatile("" ::: "memory") 或 atomic_signal_fence |

atomic_thread_fence 或 atomic 操作本身自带 |

硬件屏障是编译器屏障的超集。 你用了硬件屏障,编译器重排也同时被禁止了。所以日常写代码时,你真正要打交道的是硬件屏障这一层(通过 std::atomic 来间接使用)。

硬件层面到底发送了什么?-- 屏障的物理根源

要理解屏障为什么"长这样",必须先理解 Store Buffer 和 Invalidate Queue。它们才是制造麻烦的元凶。

- Store Buffer 制造了"写-写"和"写-读"乱序:当 Core 0 执行

data = 42时,如果严格走 MESI 协议,它要先发 Invalidate 消息给所有核心、等所有 ACK 回来、才能写入缓存。这个等待可能 几十到上百个时钟周期 。

CPU 设计者说:太慢了。于是引入 Store Buffer------把写操作先"暂存"起来,CPU 立即执行下一条指令,不等 ACK。 等 ACK 慢慢收齐后,Store Buffer 里的值再异步刷入 L1 Cache。

这带来一个问题:Core 0 先写data、后写ready,但这两个写可能按不同的速度从 Store Buffer 刷出到缓存。Core 1 完全有可能先看到ready=true,后看到data=42。 - Invalidate Queue 制造了"读"的乱序:类似地,当 Core 1 收到"某个缓存行失效了"的消息时,如果立刻去缓存里做 Invalid 标记,需要查找缓存、等缓存可用,也有延迟。所以 CPU 把这个消息先放进 Invalidate Queue,立刻回复 ACK,稍后再真正把缓存行标记为 Invalid 。

这就意味着:Core 1 在一小段时间窗口内,可能还在用旧的缓存数据,因为 Invalidate 消息还在队列里排队没处理。

屏障就是强迫 CPU "停下来清理":理解了上面两个队列,三种屏障的含义就自然了:

- Store Fence(写屏障) :在执行后续的 store 之前,先把 Store Buffer 里所有挂起的写操作全部刷出去写入缓存 。效果是------"我之前的所有写,必须先对外可见,然后才能做新的写。" 这挡住了写-写重排。

- Load Fence(读屏障) :在执行后续的 load 之前,先把 Invalidate Queue 里所有挂起的失效消息全部处理掉 。效果是------"我要确保自己的缓存是最新的,然后才做新的读。" 这挡住了读-读重排。

- Full Fence(全屏障):两件事都做。Store Buffer 清干净,Invalidate Queue 也清干净。这是最重的屏障。

用一个比喻来说:Store Buffer 和 Invalidate Queue 就像两个待办箱。正常情况下 CPU 会攒着慢慢处理。内存屏障就是领导突然来说"你现在把待办箱清空了再做下一件事"。

为了让程序员能控制内存操作的可见顺序 ,CPU 提供了内存屏障指令:

| 屏障类型 | 作用 | x86 指令 | ARM 指令 |

|---|---|---|---|

| Store Fence | 刷出 Store Buffer:确保屏障之前的所有写操作都写入缓存后,屏障之后的写操作才能执行 | SFENCE |

DSB ST |

| Load Fence | 清空 Invalidate Queue:确保屏障之前的所有读操作完成后,屏障之后的读操作才能执行 | LFENCE |

DSB LD |

| Full Fence | 同时刷出 Store Buffer 并清空 Invalidate Queue,约束读和写 | MFENCE |

DSB SY |

屏障的精确语义

更精确地说,内存屏障并不是"让缓存写入主内存",而是:

- Store Fence:确保在该指令之前的所有 store 操作的效果,在该指令之后的所有 store 操作的效果之前,对所有其他核心可见。

- Load Fence:确保在该指令之前的所有 load 操作都完成了(即读到了最新值),再执行该指令之后的 load 操作。

- Full Fence:以上两者的组合。

内存屏障的作用范围是屏障前后操作之间的排序关系,而非某个具体的"刷新"动作。

x86 的特殊性:x86 架构提供了较强的内存模型(TSO, Total Store Order),天然保证:

- Store-Store 不重排:写操作之间保持程序顺序

- Load-Load 不重排:读操作之间保持程序顺序

- Load-Store 不重排:读操作不会被重排到后续的写操作之后

x86 唯一允许的重排 是:Store-Load 重排(写操作可能被重排到后续读操作之后)。

x86 TSO 允许的重排示例:

CPU 的程序顺序: 其他核心可能观察到的顺序:

STORE x = 1 ──┐ LOAD y ← 被提前了

LOAD y ─┘ STORE x = 1

原因:STORE 在 Store Buffer 中排队,

而 LOAD 直接从 Cache 读取,LOAD 可能先完成。但 ARM 和 RISC-V 等架构的内存模型要弱得多,几乎所有类型的重排都可能发生:

各架构允许的重排类型对比:

| 重排类型 | x86-64 | ARM | RISC-V (RVWMO) | Power |

|----------------|--------|--------|----------------|--------|

| Load-Load | ✗ 禁止 | ✓ 允许 | ✓ 允许 | ✓ 允许 |

| Load-Store | ✗ 禁止 | ✓ 允许 | ✓ 允许 | ✓ 允许 |

| Store-Load | ✓ 允许 | ✓ 允许 | ✓ 允许 | ✓ 允许 |

| Store-Store | ✗ 禁止 | ✓ 允许 | ✓ 允许 | ✓ 允许 |

| 数据依赖保序 | ✓ 保证 | ✓ 保证 | ✓ 保证 | ✓ 保证 |这就是为什么不能依赖平台特性,而要使用 C++ 标准提供的内存模型来编写可移植的并发代码。在 x86 上看起来正确的代码,移植到 ARM(如 Apple M 系列芯片、Android 手机)上可能就会出 Bug。

3. 编译器屏障 vs 硬件屏障:容易混淆的两个层次

很多人混淆编译器屏障和硬件内存屏障,这是两个完全不同层面的东西。

3.1 编译器屏障(Compiler Barrier)

编译器屏障阻止编译器对指令进行重排序,但不会生成任何 CPU 指令,对 CPU 的行为没有影响。

cpp

#include <atomic>

// GCC/Clang 的编译器屏障

void compiler_barrier_demo() {

int a = 1;

// asm volatile 是 GCC/Clang 的内联汇编语法

// "" 表示空指令(不生成任何 CPU 指令)

// "memory" 告诉编译器:这条伪指令可能读写了任意内存

// 效果:编译器不会将这条语句前后的内存操作互相重排

asm volatile("" ::: "memory");

int b = 2;

// 编译器保证 a = 1 在 b = 2 之前执行

// 但 CPU 仍然可能重排它们的执行顺序!

}

// MSVC 的编译器屏障

// _ReadWriteBarrier(); // (已弃用,不推荐)

// C++11 标准的编译器屏障(推荐方式)

void standard_compiler_barrier() {

int a = 1;

// std::atomic_signal_fence 只阻止编译器重排,不生成硬件屏障

// 它主要用于同一线程中信号处理函数(signal handler)与主代码之间的同步

std::atomic_signal_fence(std::memory_order_acq_rel);

int b = 2;

}但只有编译器屏障是远远不够的,编译器屏障只是阻止编译器重排,但CPU仍然会发生重排。

举个例子:按照下列代码的逻辑,存在v1、v2、r1、r2

如果没有发生指令重排的话,会有如下三种情况:

- r1 = 1,r2 = 1:即线程1和线程2都先完成了对v1 = 1和 v2 = 1的操作,然后再分别对r1 = v2,r2 = v1。

- r1 = 0,r2 = 1:即线程1进行r1 = v2操作之前,线程2还没有进行v2 = 1的操作,导致了 r1 = v2 = 0。(发生这种情况的原因有两种,第一就是线程的执行顺序导致的(线程1比线程2快执行),第二就是可能发生了指令重排(线程1比线程2快执行的同时,线程1的v1 = 1和r1 = v2顺序交换了,但是暂时无法观测到这个重排现象,所以是理论上存在,所以这里就认定为没有发生指令重排))

- r1 = 1,r2 = 0:即线程2进行r2 = v1操作之前,线程1还没有进行v1 = 1的操作,导致了 r2 = v2 = 0。(发生这种情况的原因有两种,第一就是线程的执行顺序导致的(线程2比线程1快执行),第二就是可能发生了指令重排(线程2比线程1快执行的同时,线程2的v2 = 1和r2 = v1顺序交换了,但是暂时无法观测到这个重排现象,所以是理论上存在,所以这里就认定为没有发生指令重排))

如果发生了指令重排,会有这个情况:

- r1 = 0,r2 = 0:即为线程1 和 线程2对 r1 = v2、r2 = v1的操作都重排到v1 = 1、v2 = 1之前了,这就导致了 r1 = v2 = 0、r2 = v1 = 0;所以可以把这个r1 = 0 && r2 = 0 作为条件来观测是否指令发生了重排。

cpp

#include <iostream>

#include <semaphore.h>

#include <thread>

int v1, v2, r1, r2;

sem_t start1, start2, complete;

void thread1()

{

while(true)

{

// 每次在这里等待,直到主线程发出信号

sem_wait(&start1);

v1 = 1;

r1 = v2;

sem_post(&complete);

}

}

void thread2()

{

while(true)

{

// 每次在这里等待,直到主线程发出信号

sem_wait(&start2);

v2 = 1;

r2 = v1;

sem_post(&complete);

}

}

int main()

{

// 初始化信号量

sem_init(&start1, 0, 0);

sem_init(&start2, 0, 0);

sem_init(&complete, 0, 0);

// 启动两个线程

std::thread t1(thread1);

std::thread t2(thread2);

// 1000000 次测试

for(int i = 0; i < 1000000; i++)

{

v1 = v2 = 0;

// 通知两个线程一次测试开始

sem_post(&start1);

sem_post(&start2);

// 等待两个线程一次测试完成

sem_wait(&complete);

sem_wait(&complete);

// 如果发生重排,这里就会打印

if((r1 == 0) && (r2 == 0))

{

std::cout << "reorder detected @ " << i << std::endl;

}

}

t1.detach();

t2.detach();

return 0;

}多次运行结果:

bash

$ ./test

reorder detected @ 103274

reorder detected @ 165413

reorder detected @ 260100

reorder detected @ 419154

reorder detected @ 508480

reorder detected @ 509414

reorder detected @ 535796

reorder detected @ 554339

reorder detected @ 602725

reorder detected @ 626495

reorder detected @ 756016

reorder detected @ 848165

reorder detected @ 864235

$ ./test

reorder detected @ 145744

reorder detected @ 292547

reorder detected @ 319411

reorder detected @ 325013

reorder detected @ 360162

reorder detected @ 368819

reorder detected @ 373382

reorder detected @ 397535

reorder detected @ 401965

reorder detected @ 449255

reorder detected @ 472074

reorder detected @ 570637

reorder detected @ 570802

reorder detected @ 574712

reorder detected @ 587480

reorder detected @ 616706

reorder detected @ 617032

reorder detected @ 643429

reorder detected @ 679384

reorder detected @ 691302

reorder detected @ 741847

reorder detected @ 765935

reorder detected @ 802661

reorder detected @ 831310

reorder detected @ 879595

reorder detected @ 886543

reorder detected @ 886786

reorder detected @ 893694

reorder detected @ 898316

reorder detected @ 919692

reorder detected @ 924013

reorder detected @ 966790

$ ./test

reorder detected @ 300

reorder detected @ 122448

reorder detected @ 176583

reorder detected @ 190003

reorder detected @ 230573

reorder detected @ 245686

reorder detected @ 281640

reorder detected @ 390802

reorder detected @ 416831

reorder detected @ 451071

reorder detected @ 470245

reorder detected @ 531855

reorder detected @ 560102

reorder detected @ 562926

reorder detected @ 655202

reorder detected @ 657929

reorder detected @ 668500

reorder detected @ 695968

reorder detected @ 710164

reorder detected @ 726194

reorder detected @ 777659

reorder detected @ 780944

reorder detected @ 781010

reorder detected @ 795391

reorder detected @ 876963

reorder detected @ 880055

reorder detected @ 890770

$ ./test

reorder detected @ 62922

reorder detected @ 176667

reorder detected @ 203593

reorder detected @ 224320

reorder detected @ 345974

reorder detected @ 392123

reorder detected @ 393105

reorder detected @ 459240

reorder detected @ 486975

reorder detected @ 508644

reorder detected @ 656035

reorder detected @ 669090

reorder detected @ 703426

reorder detected @ 706660

reorder detected @ 920639从结果得到,是存在指令重排导致乱序执行的,即便采用了编译器屏障,也只是阻止了编译器重排并没有生成任何 CPU 指令,对 CPU 的行为没有影响,CPU仍然可能重排它们的执行顺序,所以需要硬件内存屏障。

3.2 硬件内存屏障

生成CPU 指令 ,强制 CPU 按照程序顺序执行内存读写,解决多核 CPU 缓存不一致、乱序执行问题。硬件屏障既阻止编译器重排,也阻止 CPU 重排。

cpp

#include <atomic>

void hardware_barrier_demo() {

int a = 1;

// 多种使用硬件内存屏障的方式:

// 1、GCC/Clang 硬件屏障(直接嵌入汇编)

// 1.1 全能屏障:asm volatile("mfence" ::: "memory"); 读写都屏障(x86)

// 1.2 读屏障:asm volatile("lfence" ::: "memory"); 仅读屏障

// 1.3 写屏障:asm volatile("sfence" ::: "memory"); 仅写屏障

// 2、Linux内核封装

// mb(); // 全屏障

// rmb(); // 读屏障

// wmb(); // 写屏障

//

// smp_mb(); // 多核 SMP 全屏障

// smp_rmb(); // 多核读屏障

// smp_wmb(); // 多核写屏障

// 3、C/C++ 标准跨平台硬件屏障(C++11):std::atomic_thread_fence 同时生成编译器屏障 + 硬件屏障

// 在 x86 上,seq_cst fence 会生成 MFENCE 指令

// 在 ARM 上,会生成 DMB 或 DSB 指令

std::atomic_thread_fence(std::memory_order_seq_cst);

// 硬件屏障(带CPU指令,多核线程间同步)

// atomic_thread_fence(memory_order_acquire); // 读屏障

// atomic_thread_fence(memory_order_release); // 写屏障

// atomic_thread_fence(memory_order_acq_rel); // 读写屏障

// atomic_thread_fence(memory_order_seq_cst); // 最强全屏障

int b = 2;

// 编译器和 CPU 都保证 a = 1 在 b = 2 之前完成

}在3.1 举的例子加入硬件内存屏障就不会乱序执行了:

cpp

#include <iostream>

#include <semaphore.h>

#include <thread>

int v1, v2, r1, r2;

sem_t start1, start2, complete;

void thread1()

{

while(true)

{

// 每次在这里等待,直到主线程发出信号

sem_wait(&start1);

v1 = 1;

// std::atomic_signal_fence(std::memory_order_acq_rel);// 编译器屏障

std::atomic_thread_fence(std::memory_order_seq_cst);// 硬件屏障

r1 = v2;

sem_post(&complete);

}

}

void thread2()

{

while(true)

{

// 每次在这里等待,直到主线程发出信号

sem_wait(&start2);

v2 = 1;

// std::atomic_signal_fence(std::memory_order_acq_rel);// 编译器屏障

std::atomic_thread_fence(std::memory_order_seq_cst);// 硬件屏障

r2 = v1;

sem_post(&complete);

}

}

int main()

{

// 初始化信号量

sem_init(&start1, 0, 0);

sem_init(&start2, 0, 0);

sem_init(&complete, 0, 0);

// 启动两个线程

std::thread t1(thread1);

std::thread t2(thread2);

// 1000000 次测试

for(int i = 0; i < 1000000; i++)

{

v1 = v2 = 0;

// 通知两个线程一次测试开始

sem_post(&start1);

sem_post(&start2);

// 等待两个线程一次测试完成

sem_wait(&complete);

sem_wait(&complete);

// 如果发生重排,这里就会打印

if((r1 == 0) && (r2 == 0))

{

std::cout << "reorder detected @ " << i << std::endl;

}

}

t1.detach();

t2.detach();

return 0;

}3.3 两者的关系

┌─────────────────────────────────────────────────────┐

│ 编译器屏障 │

│ 阻止编译器重排,不生成 CPU 指令 │

│ 示例:asm volatile("" ::: "memory") │

│ std::atomic_signal_fence(...) │

│ │

│ ┌───────────────────────────────────────────────┐ │

│ │ 硬件内存屏障 │ │

│ │ 阻止编译器重排 + 阻止 CPU 重排 │ │

│ │ 示例:MFENCE / DMB / DSB │ │

│ │ std::atomic_thread_fence(...) │ │

│ │ std::atomic 操作(非 relaxed) │ │

│ └───────────────────────────────────────────────┘ │

└──────────────────────────────────────────────────────┘

注意:硬件屏障是编译器屏障的超集。

使用 std::atomic_thread_fence 时,编译器会自动插入编译器屏障。实践建议 :绝大多数情况下,你不需要直接使用编译器屏障或硬件屏障。使用

std::atomic配合合适的memory_order是最佳实践------编译器会自动帮你生成正确的屏障指令。只有在极端性能优化或与硬件 I/O 交互时,才需要使用更底层的屏障。

3.4 从硬件屏障到 C++ 的 Memory Order------抽象层的映射

直接写 MFENCE/DMB 这样的汇编指令既不可移植、也容易出错。C++11 做的事情是:把"屏障"的概念抽象成了 memory_order,绑定在每一个原子操作上。

你不需要自己插入屏障指令,你只需要在 atomic.store() 或 atomic.load() 时告诉编译器 :"这个操作要有什么级别的排序保证",编译器就会自动帮你在对应平台上生成正确的屏障指令。

这是一个从"具体"到"抽象"的映射关系:

你想要的效果 C++ 的写法 x86 实际生成的 ARM 实际生成的

───────────── ────────── ────────── ──────────

什么保证都不要 memory_order_relaxed 普通 MOV 普通 LDR/STR

写之前的东西不许往后跑 memory_order_release (store) 普通 MOV (x86天然保证) STLR

读之后的东西不许往前跑 memory_order_acquire (load) 普通 MOV (x86天然保证) LDAR

以上两者都要 memory_order_acq_rel (RMW) LOCK 前缀 LDAXR + STLXR

全局一致的全序 memory_order_seq_cst LOCK XCHG 或 MFENCE DMB + LDAR/STLR注意看 x86 那一列:acquire 和 release 在 x86 上竟然都是普通 MOV,不生成任何额外指令。这是因为 x86 的 TSO(Total Store Order)内存模型天然就禁止了除 Store-Load 以外的所有重排。这也是为什么很多 bug 在 x86 上跑不出来,一移植到 ARM 手机或 Apple M 芯片就崩了。

3.5 Acquire-Release 配对------理解屏障最核心的心智模型

三种屏障(读屏障、写屏障、全屏障)在 C++ 中最常用的形态就是 acquire + release 配对。把这个配对吃透,内存屏障就算真正理解了。

1、release = "单向下推屏障"

store(value, memory_order_release) 的语义是:在这个 store 之前的所有读写操作,不允许被重排到这个 store 之后。

你可以把它想象成一道只阻止向下穿越的单向闸门:

data = 42; ← 这些操作被"关"在上面

extra = 100; ← 不允许掉到 release store 下面

─── release store(ready = true) ─── ← 闸门

... 后续操作 ... ← 上面的操作不能跑到这里来

但后续操作可以往上跑(是单向的)从硬件角度看,release store 做的事情就是:确保在这个 store 被写入 Store Buffer 之前,前面所有挂起的写操作都已经从 Store Buffer 刷出到缓存了。 这样当其他核心看到 ready=true 时,data=42 和 extra=100 一定已经在缓存中可见了。

2、 acquire = "单向上推屏障"

load(memory_order_acquire) 的语义是:在这个 load 之后的所有读写操作,不允许被重排到这个 load 之前。

... 前面的操作 ... ← 后面的操作不能跑到这里来

但前面的操作可以往下跑(是单向的)

─── acquire load(ready) ─── ← 闸门

use(data); ← 这些操作被"关"在下面

use(extra); ← 不允许浮到 acquire load 上面从硬件角度看,acquire load 做的事情是:在执行后续的 load/store 之前,先把 Invalidate Queue 中的所有消息处理掉,确保自己看到的是最新的缓存状态。

3、 配对的效果 = "同步点"

单独的 release 或单独的 acquire 都没什么用。它们必须配对使用,并且配对的条件是:acquire-load 读到了 release-store 写入的那个值。

一旦配对成功,效果就像在两个线程之间建立了一条因果链:

cpp

Thread A Thread B

──────── ────────

(1) data = 42;

(2) extra = 100;

(3) ready.store(true, RELEASE); ──── "synchronizes-with" ────

(4) while(!ready.load(ACQUIRE));

(5) assert(data == 42); // ✅ 保证成立

(6) assert(extra == 100); // ✅ 保证成立为什么 (5)(6) 一定能看到正确的值?因为:

- release 保证了 (1)(2) 在 (3) 之前完成(硬件上:Store Buffer 已刷出)

- acquire 保证了 (5)(6) 在 (4) 之后执行(硬件上:Invalidate Queue 已清空)

- (4) 读到了 (3) 写入的

true→ 建立了 synchronizes-with 关系 - 所以 (1)(2) happens-before (5)(6)

这就是整个 C++ 内存模型中最核心的推理链条。

3.6、atomic_thread_fence ------独立屏障 vs 附着在操作上的屏障

上面我们说的都是"把 memory order 写在 atomic 操作上",比如 flag.store(true, release)。但 C++ 还提供了另一种写法:独立的屏障函数 std::atomic_thread_fence。

两者的区别在于作用范围:

- 附着式 (memory order 写在 atomic 操作上):只约束这一个原子操作与其前/后操作之间的顺序。

- 独立式 (atomic_thread_fence):约束 fence 前后所有内存操作之间的顺序。它是一道"批量屏障"。

什么时候独立式更好?当你有多个原子变量都需要同样的排序保证时:

cpp

// 方式一:每个操作都标 release(三条 release store)

x = 1; y = 2; z = 3; // 非原子写

a.store(1, memory_order_release);// 保证 x,y,z 在 a 之前完成

b.store(1, memory_order_release);// 保证 x,y,z 在 b 之前完成

c.store(1, memory_order_release);// 保证 x,y,z 在 c 之前完成

// 这能工作,但每个 store 都单独带了一个 release。在 ARM 上,每条 release store 都会生成一条 STLR 指令(带屏障效果的 store),你写了三条,就生成了三条 STLR。

// 方式二:一个 release fence + 三条 relaxed store(只用一个屏障)

x = 1; y = 2; z = 3; // 非原子写

std::atomic_thread_fence(memory_order_release); // 一道屏障管住上面所有写

a.store(1, memory_order_relaxed);

b.store(1, memory_order_relaxed);

c.store(1, memory_order_relaxed);

// fence 的语义是:fence 之前的所有操作,不许重排到 fence 之后的任何 store 之后。

// 注意这里说的是"所有"和"任何"------它不绑定某一个特定的 atomic 操作,而是一刀切,把前后所有操作的顺序关系都管了。

// 所以 x=1, y=2, z=3 这三个写操作,全部被这一道 fence 挡住了,不可能跑到 a.store、b.store、c.store 的后面。效果和方式一完全一样,但在 ARM 上只生成一条 DMB 屏障指令 + 三条普通 STR。方式二的好处是:一道屏障保护了上面所有的写操作,而不需要在每个 store 上都加 release。在某些架构上,这可以减少生成的屏障指令数量。

3.7、seq_cst------最强的全屏障,以及你什么时候真正需要它

memory_order_seq_cst 是最严格的选项。它在 acquire-release 的基础上,额外保证了一件事:所有线程观察到的所有 seq_cst 操作,存在一个全局一致的全序。

这个"全序"有什么用?看一个经典的例子:

cpp

// 两个线程分别写两个不同的变量,另外两个线程分别观察

Thread 1: x.store(1, seq_cst); // 写x

Thread 2: y.store(1, seq_cst); // 写y

Thread 3: if (x.load(seq_cst)==1 && y.load(seq_cst)==0) { saw_x_first = true; } // 观察者A

Thread 4: if (y.load(seq_cst)==1 && x.load(seq_cst)==0) { saw_y_first = true; } // 观察者B

// Thread 1 和 Thread 2 分别写不同的变量,Thread 3 和 Thread 4 是两个"旁观者",各自按不同顺序观察这两个写入。

// 核心问题是:Thread 3 和 Thread 4 对"x 和 y 谁先被写入"的看法,能不能不一致?

// 用 acquire/release 时:两个观察者可能"各说各话"

Thread 1 (Core 0): x.store(1, release);

Thread 2 (Core 1): y.store(1, release);

// 从硬件角度想。Core 0 写 x=1,这个值先进 Core 0 的 Store Buffer,然后通过 Invalidate 传播到各个核心。Core 1 写 y=1,同理。

// 关键在于:x 的 Invalidate 和 y 的 Invalidate 到达不同核心的时间可能不同。

Core 0 写了 x=1 Core 1 写了 y=1

发出 x 的 Invalidate 发出 y 的 Invalidate

│ │

▼ ▼

Core 2 (Thread 3): 先收到 x 的 Invalidate,后收到 y 的 Invalidate

→ 先看到 x=1,此时 y 还是 0

→ saw_x_first = true ✓

Core 3 (Thread 4): 先收到 y 的 Invalidate,后收到 x 的 Invalidate

→ 先看到 y=1,此时 x 还是 0

→ saw_y_first = true ✓

// 两个观察者同时为 true! 因为 Invalidate 消息在总线上传播到不同核心的时间是不确定的。Core 2 可能离 Core 0 更近(或者 Core 2 的 Invalidate Queue 先处理了 x 的消息),Core 3 可能离 Core 1 更近。每个核心看到的"写入顺序"可以是不同的。

// acquire/release 不管这个问题。它只保证配对的两个线程之间的同步------"我写的东西你能看到"。但它不保证第三方观察者看到的顺序跟另一个第三方观察者一致。用 seq_cst 时:所有人必须达成共识:seq_cst 额外加了一条规则:所有 seq_cst 操作,在所有线程眼中,必须存在同一个全局顺序。

这意味着 x.store(1) 和 y.store(1) 这两个操作,全世界所有核心必须就"谁先谁后"达成一致。要么全局顺序是"先 x 后 y",要么是"先 y 后 x",不允许有分歧。

cpp

假设全局顺序是 "先 x=1,后 y=1":

Thread 3: 读 x==1 && 读 y==0 → saw_x_first = true ✓(符合全局顺序)

Thread 4: 读 y==1 && 读 x==0 → 不可能!

因为全局顺序是先 x 后 y,

当 y==1 已经成立时,x==1 一定更早就成立了,

所以 Thread 4 读到 y==1 时,x 不可能还是 0

假设全局顺序是 "先 y=1,后 x=1":

Thread 3: 读 x==1 && 读 y==0 → 不可能!(同理)

Thread 4: 读 y==1 && 读 x==0 → saw_y_first = true ✓

// 无论全局顺序是哪种,最多只有一个观察者为 true。 这就是"全序"的威力。硬件上 seq_cst 是怎么做到的?

在 x86 上,seq_cst store 会生成 MFENCE 或 LOCK XCHG。这条指令做的事情是:

Core 0 执行 x.store(1, seq_cst):

(1) 把 x=1 写入 Store Buffer

(2) MFENCE:强制等待 Store Buffer 完全刷空

(3) 直到 x=1 已经进入 L1 Cache 并且所有核心都处理了 Invalidate

(4) 才继续执行下一条指令MFENCE 禁止了 Store-Load 重排。 没有 MFENCE 时,CPU 可以在 Store Buffer 还没刷完的情况下就去做下一个 load(这就是 Store-Load 重排,也是 x86 唯一允许的重排)。MFENCE 堵住了这个口子。

而 acquire/release 在 x86 上就是普通 MOV,不生成 MFENCE,所以 Store-Load 重排仍然可能发生。

在 ARM 上更明显:seq_cst 会生成 DMB(Data Memory Barrier)全屏障,相当于同时刷 Store Buffer 和清 Invalidate Queue,并且确保所有核心对操作顺序达成一致。

为什么 90% 场景不需要 seq_cst?

因为绝大多数并发模式都是两方通信 :一个生产者写数据,一个消费者读数据。这种场景只需要"我写的东西你能看到",acquire/release 就够了。

只有当你有多个写者写不同变量 + 多个观察者需要对这些写入的顺序达成一致时,才需要 seq_cst。这种场景在实际代码中很少见。而 seq_cst 的代价是每次 store 都要强制刷 Store Buffer(等几十个时钟周期),在高频操作中这个开销很显著。

4. C++ 内存模型基础:std::atomic 与原子操作

4.1 什么是原子操作?

原子操作 是不可分割的操作:它要么完全执行,要么完全不执行,不存在"执行到一半"被其他线程看到中间状态的情况。

先看一个非原子操作的问题:

cpp

// ❌ 非原子操作:两个线程同时执行 counter++ 会出问题

int counter = 0; // 普通 int,没有原子性保证

// 线程 A 和线程 B 同时执行:

counter++;

// counter++ 在 CPU 层面实际上是三步操作(Read-Modify-Write, RMW),有三条指令(单条指令执行是原子的):

// 1. 从内存读取 counter 到寄存器(LOAD)

// 2. 寄存器中的值 +1 (ADD)

// 3. 将结果写回内存 (STORE)

//

// 可能的执行序列(两个线程各执行一次 counter++,期望结果是 2):

//

// 时间线 Thread A Thread B

// ───── ──────── ────────

// t0 LOAD counter (=0)

// t1 LOAD counter (=0) ← B 也读到 0!

// t2 ADD (0+1=1)

// t3 STORE (counter=1)

// t4 ADD (0+1=1)

// t5 STORE (counter=1) ← 覆盖了 A 的结果!

//

// 最终结果:counter = 1(而不是期望的 2)

// 这就是典型的 "数据竞争"(Data Race)** C++ 标准中数据竞争的定义**

C++11 标准(§1.10)对数据竞争的定义非常精确:如果两个表达式求值分别来自不同线程,访问同一个内存位置,其中至少有一个是修改(写入),且两者之间没有 happens-before 关系,则构成数据竞争(Data Race)。

数据竞争是未定义行为(Undefined Behavior)。这意味着编译器可以假设程序不存在数据竞争,并基于此假设进行激进优化。一旦程序存在数据竞争,所有行为都是未定义的------不仅仅是那个特定的变量,整个程序的行为都不可预测。

4.2 std::atomic 基础用法

std::atomic<T> 是 C++11 引入的类模板,定义在 <atomic> 头文件中,用于提供原子类型------可以在多线程环境下安全访问的数据类型,无需使用互斥锁就能避免数据竞争。

普通变量在多线程下并发读写会触发未定义行为 (数据竞争)。而 std::atomic<T> 保证:

- 原子性:一个线程对原子对象的读/写操作不会被其他线程"看到一半"。

- 线程间同步 :通过

std::memory_order参数,原子操作还能为周围的非原子内存访问建立 happens-before 关系,这是无锁编程的基础。

类型限制:std::atomic 既不可复制也不可移动。原因很简单:复制一个原子对象需要同时读源和写目标,这两步本身就不是原子的。

cpp

#include <atomic> // 原子操作头文件

#include <thread> // 线程支持

#include <iostream>

#include <vector>

// ✅ 使用 std::atomic 保证原子性

// atomic<int> 保证对 counter 的所有操作都是原子的,不会被其他线程"撕裂"

std::atomic<int> counter{0}; // 花括号初始化(推荐)

void increment(int times) {

for (int i = 0; i < times; ++i) {

// fetch_add 是原子的 Read-Modify-Write 操作:

// 将 counter 加 1,并返回加之前的旧值

// memory_order_relaxed 表示只保证原子性,不保证与其他变量的顺序关系

// 对于独立的计数器,relaxed 就足够了(性能最好)

counter.fetch_add(1, std::memory_order_relaxed);

// 或者使用 operator++ 重载(默认使用 seq_cst 语序,更安全但性能稍差):

// counter++;

}

}

int main() {

const int num_threads = 8; // 使用 8 个线程

const int per_thread = 100000; // 每个线程递增 10 万次

std::vector<std::thread> threads; // 线程容器

for (int i = 0; i < num_threads; ++i) {

// emplace_back 原地构造线程对象,比 push_back 更高效

threads.emplace_back(increment, per_thread);

}

for (auto& t : threads) {

t.join(); // 等待所有线程完成

}

// 结果一定是 800000,不会有数据竞争

// load() 原子地读取 counter 的当前值

std::cout << "Counter = " << counter.load() << std::endl;

return 0;

}4.3 std::atomic 支持的类型(atomic模板与特化)

1、主模板 std::atomic<T>

可用于任何满足以下条件的用户自定义类型T:

- TriviallyCopyable(可平凡复制)

- 可拷贝/移动构造,可拷贝/移动赋值

- 不能是 cv 限定的(LWG 4069 修复)

cpp

struct Counters { int a; int b; }; // 平凡可复制

std::atomic<Counters> cnt; // OK注意: 用户自定义类型的原子操作通常不是无锁的 ------实现一般会内部加一把锁,只为你提供原子性的语义假象。可以用 is_lock_free() 或 is_always_lock_free 查询。

std::atomic<bool> 也走主模板,但保证是标准布局并具有平凡析构函数。

2、指针特化 std::atomic<U*>

除了基本操作外,额外支持指针算术:fetch_add、fetch_sub、++、-- 等(按元素步长偏移,类似裸指针运算)。

**3、std::shared_ptr / std::weak_ptr **特化(C++20)

定义在 <memory> 中,让原子地替换共享指针成为可能,取代了 C++20 之前的自由函数 std::atomic_load(shared_ptr*) 等(已弃用)。

4、整数类型特化

对所有标准整数类型(char、short、int、long、long long、对应无符号版本、char8_t/char16_t/char32_t/wchar_t,以及 <cstdint> 中的定宽类型),除基本操作外还提供:

fetch_add/fetch_sub------ 原子加减fetch_and/fetch_or/fetch_xor------ 原子位运算fetch_max/fetch_min(C++26) ------ 原子取大/取小- 复合赋值

+=、-=、&=、|=、^=、++、--

特别注意:有符号整数算术明确定义为二进制补码,没有未定义行为 ------不像普通有符号 int 溢出是 UB。

5、浮点类型特化(C++20)

对 float、double、long double 提供 fetch_add/fetch_sub。即使结果不可表示也不会 UB,但浮点环境可能与调用线程不同。

cpp

// ==================== 基本整数类型 ====================

std::atomic<bool> flag; // 原子布尔

std::atomic<int> counter; // 原子 int (32 位)

std::atomic<long> big_counter; // 原子 long

std::atomic<unsigned int> unsigned_counter; // 原子无符号 int

std::atomic<int64_t> precise_counter; // 原子 64 位整数

// ==================== 指针类型 ====================

// 原子指针支持 fetch_add/fetch_sub(指针算术),但不支持 fetch_and 等位操作

std::atomic<int*> ptr;

std::atomic<Node*> head;

// ==================== C++20 引入浮点数支持 ====================

std::atomic<float> value; // C++20 支持 fetch_add, fetch_sub

std::atomic<double> result; // C++20 支持 fetch_add, fetch_sub

// 注意:浮点原子操作不支持 fetch_and / fetch_or 等位操作

// 注意:浮点原子操作的 RMW 使用 CAS 循环实现(因为硬件不直接支持原子浮点加法)

// ==================== 自定义类型 ====================

// 必须满足 TriviallyCopyable 条件:

// 1. 没有虚函数(no virtual functions)

// 2. 没有虚基类(no virtual base classes)

// 3. 可以用 memcpy 安全复制(trivial copy/move constructor/assignment)

// 4. 有 trivial 析构函数

struct Point {

int x, y;

};

std::atomic<Point> pos; // OK,Point 是 trivially copyable 的

// 判断某个类型是否满足 TriviallyCopyable

static_assert(std::is_trivially_copyable_v<Point>,

"Point must be trivially copyable for std::atomic");

// ❌ 以下类型不能用 std::atomic

// std::atomic<std::string> s; // 错误!string 有动态内存,不是 trivially copyable

// std::atomic<std::vector<int>> v; // 错误!vector 有动态内存

// std::atomic<std::shared_ptr<int>> sp; // 错误!(但 C++20 提供了 std::atomic<std::shared_ptr<T>>)

// ==================== C++20 特殊支持 ====================

// C++20 为 std::shared_ptr 和 std::weak_ptr 提供了原子特化:

// std::atomic<std::shared_ptr<int>> atomic_sp; // C++20 OK

// 这在无锁数据结构中非常有用,但内部实现通常使用锁(不是 lock-free 的)4.4 std::atomic 的核心操作

成员函数速览:

| 函数 | 作用 |

|---|---|

store(v, order) |

原子写入 |

load(order) |

原子读取 |

operator T / operator= |

load/store 的语法糖 |

exchange(v) |

原子地写入新值并返回旧值 |

compare_exchange_weak/strong |

CAS: 若当前值等于期望值则写入新值,否则把当前值读到期望值中 |

is_lock_free() |

运行时查询是否无锁 |

is_always_lock_free |

编译期常量(C++17),所有平台都无锁时为 true |

wait(old) / notify_one() / notify_all() |

C++20 引入的原子等待/通知,类似条件变量 |

cpp

#include <atomic>

std::atomic<int> x{0}; // 初始化为 0

// ==================== 基本读写操作 ====================

// store: 原子写入(仅写操作)

// 将值原子地写入 x,保证其他线程不会看到"写了一半"的值

x.store(42); // 默认 memory_order_seq_cst

x.store(42, std::memory_order_release); // 指定 release 语序(更高效)

x = 42; // store的语法糖,等价于x.store(42);

// load: 原子读取(仅读操作)

// 原子地读取 x 的值,保证读到的是一个完整的值

int val = x.load(); // 默认 memory_order_seq_cst

int val2 = x.load(std::memory_order_acquire); // 指定 acquire 语序

int val3 = x; // load的语法糖,等价于int val3 = x.load();

// exchange: 原子"交换"操作(Read-Modify-Write 操作)

// 将 x 设为 100,并返回 x 交换前的旧值

// 整个"读旧值+写新值"是一个不可分割的原子操作

int old = x.exchange(100); // x 变为 100,old 是交换前的值

// ==================== 算术操作(仅整数和指针类型)====================

// 这些都是 Read-Modify-Write (RMW) 操作,天然支持 acq_rel 语义

x.fetch_add(5); // 原子加:x += 5,返回旧值(即加之前的值)

x.fetch_sub(3); // 原子减:x -= 3,返回旧值

x.fetch_and(0xFF); // 原子按位与:x &= 0xFF,返回旧值

x.fetch_or(0x01); // 原子按位或:x |= 0x01,返回旧值

x.fetch_xor(0x10); // 原子按位异或:x ^= 0x10,返回旧值

// 操作符重载(默认使用 seq_cst,方便但性能稍差)

x++; // 等效于 x.fetch_add(1, memory_order_seq_cst),返回旧值

++x; // 等效于 x.fetch_add(1, memory_order_seq_cst) + 1,返回新值

x--; // 等效于 x.fetch_sub(1, memory_order_seq_cst),返回旧值

x += 5; // 等效于 x.fetch_add(5, memory_order_seq_cst) + 5,返回新值

// 注意:x++ 和 ++x 的语义差异!x++ 返回旧值,++x 返回新值

// ==================== CAS 操作(最重要!)====================

int expected = 42; // 期望值(会被 CAS 修改!)

// compare_exchange_strong: 强 CAS

// 语义:if (x == expected) { x = 100; return true; }

// else { expected = x; return false; }

// 整个操作是原子的

// "strong" 表示只在 x != expected 时才返回 false

bool success = x.compare_exchange_strong(expected, 100);

// compare_exchange_weak: 弱 CAS

// 和 strong 的区别:即使 x == expected,也可能返回 false("伪失败")

// 但在循环中使用时,weak 的性能通常更好(在 ARM 上尤其明显)

bool success2 = x.compare_exchange_weak(expected, 100);

// CAS 可以为成功和失败指定不同的 memory order

int exp = 0;

bool ok = x.compare_exchange_weak(

exp, // 期望值(引用,失败时被更新)

42, // 期望成功时写入的值

std::memory_order_release, // 成功时的内存序

std::memory_order_relaxed // 失败时的内存序(不能强于成功时的语序)

);

// ==================== 查询 ====================

// 检查是否是真正的原子操作(而非用锁模拟的)

bool lock_free = x.is_lock_free();

// 编译期常量版本(C++17),用于编译时断言

constexpr bool always_lock_free = std::atomic<int>::is_always_lock_free;

// 用法:static_assert(std::atomic<int>::is_always_lock_free,

// "需要硬件级原子支持");4.5 is_lock_free 的含义

并非所有 std::atomic<T> 都是真正的无锁操作 。如果类型 T 的大小超过了平台原子指令能处理的范围 ,编译器会退化为用内部锁 (通常是一个全局的自旋锁数组,叫做 "lock table")来实现:

cpp

#include <atomic>

#include <iostream>

struct Small { int a; }; // 4 bytes

struct Medium { long a, b; }; // 16 bytes

struct Large { long a, b, c, d, e; }; // 40 bytes

int main() {

std::atomic<Small> s;

std::atomic<Medium> m;

std::atomic<Large> l;

// 在 x86_64 上的典型输出:

std::cout << "Small is_lock_free: " << s.is_lock_free() << std::endl;

// 输出 1 (true):4 字节,CMPXCHG 指令直接支持

std::cout << "Medium is_lock_free: " << m.is_lock_free() << std::endl;

// 输出 1 (true):16 字节,通过 CMPXCHG16B 指令支持(需要 -mcx16 编译选项)

std::cout << "Large is_lock_free: " << l.is_lock_free() << std::endl;

// 输出 0 (false):40 字节,超过了硬件原子指令的能力

// 编译器内部会使用一个自旋锁来保护对这个 atomic 的访问

// 性能会大幅下降!

return 0;

}lock table 的实现细节

当

is_lock_free()返回 false 时,编译器使用一个全局的锁哈希表来保护原子操作。GCC/libstdc++ 的实现大致如下:

cpp// 简化的内部实现(概念性代码,非真实代码) static std::mutex lock_table[16]; // 全局锁数组 template<typename T> void atomic_store_fallback(T* addr, T value) { // 根据地址哈希选择锁,减少不同原子变量之间的争用 size_t index = (reinterpret_cast<uintptr_t>(addr) >> 4) % 16; std::lock_guard<std::mutex> guard(lock_table[index]); *addr = value; }问题:不同的

atomic<Large>变量可能映射到同一把锁,产生"虚假争用"。

经验法则 :在 x86_64 上,8 字节及以下的类型通常是 lock-free 的;16 字节在支持cmpxchg16b的平台上也是 lock-free 的。超过 16 字节的自定义类型不建议使用std::atomic。

5. volatile vs std::atomic:一个经典的误区

很多从 C 或 Java 转过来的程序员会用 volatile 来做线程间同步,这在 C++ 中是完全错误的。

5.1 volatile 的真实含义

**volatile 是 C++ 中的类型限定符(与 const 同级),核心作用是告诉编译器:该变量的值可能在程序控制之外被意外修改,**因此禁止对其进行任何优化,确保每次读写都直接访问内存(告诉编译器不要优化对该变量的访问 ------每次读必须从内存读取,每次写必须写入内存)。

volatile 只影响编译阶段,不改变运行时的 CPU 指令或内存模型:

- 正常情况:编译器会将高频变量存入寄存器(速度远快于内存),减少内存访问。

volatile:强制每次读取都从内存重新加载,每次写入都立即同步到内存。

cpp

// volatile 的正确用途 1:硬件 I/O 映射寄存器

volatile uint32_t* const GPIO_PORT = (volatile uint32_t*)0x40000000;

// 每次读写 *GPIO_PORT 都会真正访问硬件寄存器

// 如果不加 volatile,编译器可能缓存上次读取的值,导致读不到硬件变化

// volatile 的正确用途 2:信号处理

volatile sig_atomic_t signal_received = 0;

void signal_handler(int sig) {

signal_received = 1; // 信号处理函数中设置标志

}

void main_loop() {

while (!signal_received) { // 主循环中检查标志

// volatile 防止编译器将 signal_received 缓存到寄存器

}

}5.2 volatile 不能做什么

cpp

volatile int counter = 0; // ❌ 用 volatile 做线程间同步是错误的!

// 问题一:volatile 不保证原子性

// volatile int 的 counter++ 仍然是 LOAD-ADD-STORE 三步

// 两个线程同时 counter++ 仍然会丢失计数

// 问题二:volatile 不阻止 CPU 重排序

// volatile 只阻止编译器对该变量的优化,但 CPU 仍然可以乱序执行

// 在 ARM 上,volatile 写入后跟的 volatile 读取可能被重排

// 问题三:volatile 没有 happens-before 语义

// C++ 标准不保证 volatile 操作在不同线程间建立任何排序关系

// 对 volatile 变量的并发读写仍然是未定义行为5.3 对比总结

cpp

// ┌─────────────────────────────┬─────────────┬──────────────┐

// │ 特性 │ volatile │ std::atomic │

// ├─────────────────────────────┼─────────────┼──────────────┤

// │ 阻止编译器优化访问 │ ✓ │ ✓ │

// │ 保证操作的原子性 │ ✗ │ ✓ │

// │ 阻止编译器重排序 │ 部分(*) │ ✓ │

// │ 阻止 CPU 重排序 │ ✗ │ ✓ │

// │ 建立 happens-before 关系 │ ✗ │ ✓ │

// │ 适用于线程间同步 │ ✗ │ ✓ │

// │ 适用于硬件 I/O │ ✓ │ ✗ │

// │ 适用于信号处理 │ ✓ │ ✓(C++11后) │

// └─────────────────────────────┴─────────────┴──────────────┘

// (*) volatile 只阻止编译器对该特定变量的重排,不阻止与其他变量之间的重排

// ✅ 正确做法:线程间同步用 std::atomic

std::atomic<bool> ready{false};

// ❌ 错误做法:不要用 volatile 做线程间同步

// volatile bool ready = false;

// ⚠️ Java 的 volatile 不等于 C++ 的 volatile!

// Java 的 volatile 具有 acquire/release 语义,可以用于线程同步

// C++ 的 volatile 没有任何多线程语义6. std::atomic_flag:唯一保证 lock-free 的原子类型 与 自旋锁实现

6.1 为什么需要 atomic_flag?

std::atomic_flag 是 C++11 引入的一个布尔型原子标志 ,定义在 <atomic> 中。它的特殊地位在于:

它是 C++ 标准中唯一保证在所有平台上都是 lock-free 的原子类型。

这句话很关键。你可能会问:std::atomic<bool> 难道不是无锁的吗?答案是------通常是,但标准不保证(不保证在所有平台上都是 lock-free 的(取决于类型大小和平台支持)) 。标准只保证 atomic_flag。之所以能做这种保证,是因为 atomic_flag 的接口被刻意设计得极其贫瘠,贫瘠到任何一个有点现代味道的 CPU 都能用一条指令实现它。

atomic_flag 只有两种状态:set(已设置) 和 clear(已清除)。C++20 之前,它只提供两个操作:

| 操作 | 语义 |

|---|---|

test_and_set() |

原子地把 flag 设为 set,返回之前的值 |

clear() |

原子地把 flag 设为 clear |

它没有 load(),也没有 store(true)------你不能单纯地"读取"它的当前状态而不修改它(C++20 之前)。这是为了让它能直接映射到硬件的 test-and-set 指令,比如:

- x86:

xchg或lock bts - ARM:

ldxr/stxr对 - RISC-V:

amoswap

C++20 之后补充了几个方法:

| 新操作(C++20) | 语义 |

|---|---|

test() |

只读地查询当前状态,不修改 |

wait(old) |

若当前值等于 old 则阻塞,直到被通知 |

notify_one() / notify_all() |

唤醒因 wait 阻塞的线程 |

6.2 std::atomic_flag 的使用

C++20 之前,atomic_flag 必须 用宏 ATOMIC_FLAG_INIT 初始化:

cpp

std::atomic_flag f = ATOMIC_FLAG_INIT; // 初始为 clearC++20 之后,默认构造函数就保证初始状态为 clear,也可以用 {}:

cpp

std::atomic_flag f; // C++20:保证 clear

std::atomic_flag f{}; // 同上这是因为 C++20 之前,标准并不要求 atomic_flag 的默认构造函数把它初始化为 clear------这看起来很怪,但同样是为了迁就某些硬件。C++20 修正了这一点。

6.3 使用std::atomic_flag 实现自旋锁

自旋锁:自旋锁(spinlock)是一种忙等待 的锁,当锁不可用时,线程不睡眠 ,而是在一个紧凑的循环里反复检查锁状态,直到拿到为止。

与互斥锁(std::mutex)对比:

| 互斥锁 | 自旋锁 | |

|---|---|---|

| 获取失败时的行为 | 线程被挂起,让出 CPU | 线程占着 CPU 反复尝试 |

| 上下文切换开销 | 有(进入内核态) | 无 |

| 等待时的 CPU 占用 | 0 | 100% |

| 适合的临界区 | 较长 | 极短(几十条指令以内) |

| 适合的场景 | 通用 | 多核 + 短临界区 + 低竞争 |

std::mutex(互斥锁)在锁争用时会产生高额的上下文切换开销(微秒级、千~万 CPU 周期);自旋锁(Spinlock)完全无上下文切换,但会持续消耗 CPU 资源进行忙等。 两者的本质差异在于等待策略 :互斥锁是 "让出 CPU、休眠等待 ",自旋锁是"占用 CPU、循环检查"。

核心权衡 :自旋锁避免了上下文切换的开销 ,但代价是等待期间把 CPU 烧掉 。如果临界区很短(比如就是几条赋值),自旋几次就能拿到锁 ,这比让操作系统调度划算得多;但如果临界区很长或者竞争激烈,自旋锁会疯狂浪费 CPU,还不如乖乖用 std::mutex。

cpp

// 朴素版实现自旋锁

#include <atomic>

#include <thread>

#include <iostream>

// atomic_flag 只有两个操作:test_and_set() 和 clear()

// 它是最底层的原子类型,适合实现自旋锁等同步原语

// ==================== 用 atomic_flag 实现自旋锁 ====================

class SpinlockFlag {

// ATOMIC_FLAG_INIT 将 flag 初始化为 "清除" 状态

// C++20 中可以直接用 {} 初始化

std::atomic_flag flag_ = ATOMIC_FLAG_INIT;

public:

void lock() {

// test_and_set:原子地将 flag 设为 "已设置",返回旧值

// 如果旧值是 false(未锁定),说明我们成功获取了锁

// 如果旧值是 true(已锁定),说明锁被其他线程持有,继续自旋

// memory_order_acquire: 保证锁内的操作不被提前到 lock 之前

while (flag_.test_and_set(std::memory_order_acquire)) {

// 自旋等待

// 优化一:

// C++20 提供了 test() 方法(只读,不修改 flag)

// 先用 test() 检查可以减少对缓存行的写入争用

// while (flag_.test(std::memory_order_relaxed)) {

// // 纯读操作,不修改缓存行,减少总线流量

// }

// 优化二:

#if defined(__x86_64__)

__builtin_ia32_pause(); // PAUSE 指令:降低自旋时的功耗和总线争用

#elif defined(__aarch64__)

asm volatile("yield"); // ARM 的等效指令

#endif

}

}

void unlock() {

// clear:原子地将 flag 设为 "清除" 状态

// memory_order_release: 保证锁内的操作不被延迟到 unlock 之后

flag_.clear(std::memory_order_release);

}

// 尝试获取锁:如果锁空闲则获取并返回 true,否则立即返回 false(不阻塞)

bool try_lock() {

return !flag_.test_and_set(std::memory_order_acquire);

}

};

// ==================== 使用示例 ====================

SpinlockFlag spin;

int shared_counter = 0;

void worker(int id, int iterations) {

for (int i = 0; i < iterations; ++i) {

spin.lock();

// ------ 临界区开始 ------

shared_counter++; // 安全的:同一时间只有一个线程在这里

// ------ 临界区结束 ------

spin.unlock();

}

}

// 或者搭配 std::lock_guard 使用

// void worker(int id, int iterations)

// {

// for (int i = 0; i < iterations; ++i)

// {

// // 上面自旋锁的实现满足 C++ 的 Lockable 具名要求,可以直接配合 std::lock_guard 使用

// std::lock_guard<SpinlockFlag> lock(spin); // RAII 锁

// shared_counter++;

// }

// }

// 优化一:降低总线争用(test-and-test-and-set)

// 朴素版本有个性能问题:在 x86 上,test_and_set 对应的 xchg 指令是一个带锁的读改写------它会获取缓存行的独占权,广播到所有核。如果 10 个线程同时在 test_and_set 自旋,就有 10 个核在不停地抢同一个缓存行,总线/互连被刷屏,连真正持有锁的线程做 unlock 都会变慢。

// TTAS(test and test-and-set):先用纯读操作检查 flag 是否空闲,只有看起来空闲了才尝试真正的 test_and_set。

// test() 是 C++20 新增的只读操作,在 x86 上就是普通的 mov 指令。纯读不会让缓存行进入"独占"状态,各个核可以共享这个缓存行的副本,不会互相争抢。只有当持有者 unlock 时,缓存一致性协议才会把其他核的副本标记为无效,等待者这时才会看到 flag 变 clear,然后跳出内层循环,再去试一次真正的 test_and_set。

// 这个优化一在竞争激烈的场景下能带来数倍的性能提升。

// 优化二:pause / yield 指令

#if defined(__x86_64__)

__builtin_ia32_pause(); // 对应 x86 的 PAUSE 指令

#elif defined(__aarch64__)

asm volatile("yield"); // 对应 ARM 的 YIELD 指令

#endif

// 这些指令的作用是告诉 CPU:"我现在在忙等待,别太积极"。具体做了几件事:

// 1、降低功耗:CPU 进入一种轻度节能状态,不全速执行循环。

// 2、让出流水线资源给超线程兄弟:在 Intel 超线程(SMT)架构上,两个逻辑核心共享物理执行单元。如果一个核心在自旋,pause 会把执行资源让给同核的另一个线程------而那个线程可能恰好就是锁的持有者!没有 pause 的话,自旋线程可能"饿死"持有者,反而延长了等待。

// 3、避免内存序推测惩罚:x86 会猜测后续的 load 操作不会看到乱序写入,一旦猜错要回滚。紧凑的自旋循环经常触发这种误判,pause 能缓解。

// 4、防止过快重试:减少对缓存行的轮询频率,缓解总线压力。

// 没有 pause 的自旋锁在高竞争下可能比有 pause 的慢几倍------这不是微优化,这是正确性级别的必要。让我们逐行剖析:

lock() 的逻辑 :test_and_set 原子地做两件事------把 flag 设为 set,并返回旧值。

- 如果旧值是

false(clear,表示之前没人持有),说明我们刚刚 成功把它从 clear 翻成了 set,即我们获得了锁,while条件为假,跳出循环。 - 如果旧值是

true(set,表示别人持有),说明我们这次"设置"是多余的(它本来就是 set),我们没拿到锁,继续自旋。

即使我们自旋期间反复把一个已经是 set 的 flag 设为 set,也不会破坏锁的持有者 ------因为持有者不关心 flag 具体被谁重复设置,只关心自己 unlock() 时把它清掉。

unlock() 的逻辑 :直接 clear(),让下一个自旋的线程看到 false,从而能够拿到锁。

try_lock() 的逻辑 :只尝试一次。test_and_set 返回 false 说明之前没人持有,我们成功拿到锁,返回 true。否则立即返回 false,不阻塞。

内存序:为什么必须是 acquire / release :

这是整段代码最精妙、也最容易被忽略的地方。考虑临界区的典型用法:

cpp

spin.lock();

// 临界区开始

shared_data = 42; // (A)

another_var = 100; // (B)

// 临界区结束

spin.unlock();我们期望的语义是:当另一个线程之后拿到锁时,它能看到 (A) 和 (B) 的写入。但是:

- 编译器 可能把 (A) 重排到

lock()之前,或把 (B) 重排到unlock()之后。 - CPU 也会乱序执行------特别是 ARM、POWER 这类弱内存模型架构。

如果不加约束,(A) 和 (B) 可能"溢出"临界区,破坏互斥语义。内存序参数就是用来设置这道围栏的:

memory_order_acquire(用于lock) :保证临界区内的任何读写都不能被重排到lock之前 。它像一扇只能进不能出的门------后面的操作不能跑到前面。memory_order_release(用于unlock) :保证临界区内的任何读写都不能被重排到unlock之后 。它像一扇只能出不能进的门------前面的操作不能跑到后面。

两者配对后,形成一个"盒子":临界区内的所有操作被严格限制在 lock 和 unlock 之间。而且,当线程 B 的 lock(acquire) 看到线程 A 的 unlock(release) 写入的值时,A 在临界区内的所有写入都对 B 可见 ------这就是 release-acquire 同步,也是无锁编程的基石。

如果用默认的 memory_order_seq_cst,代码也能正确工作,但会略慢(特别是 ARM 上),因为顺序一致序要求更强的硬件栅栏。acquire/release 是自旋锁刚刚好够用的最低限度。

✅ 适合用自旋锁

- 临界区极短:比如几条指令的原子累加、更新少量成员变量。

- 多核系统:单核用自旋锁基本没意义------持有者没有 CPU 就不能释放锁,等待者一直占着 CPU 等,死锁式地浪费时间,不如直接睡。

- 竞争不激烈:大部分时候锁能瞬间拿到。

- 不能睡眠的上下文:比如中断处理程序、某些内核路径。

- 对延迟极度敏感:上下文切换通常需要微秒级别,而自旋拿到锁可能只要几十纳秒。

❌ 不适合用自旋锁

- 临界区较长或可能阻塞(比如涉及 I/O、系统调用、内存分配)。

- 持有者可能被抢占 :用户态自旋锁有个致命问题------持有者的线程随时可能被 OS 调度走,这段时间里所有等待者全都在白烧 CPU。这叫"lock holder preemption",Linux 上极端情况可以烧几十毫秒。内核态没这问题(持锁时禁止抢占)。

- 高竞争:等待者越多,总线争用越严重,甚至可能整体吞吐量倒退。

- 公平性要求高 :朴素自旋锁不保证 FIFO,可能出现某个线程饥饿。如果需要公平,可以换成票锁(ticket lock) 或 MCS 锁。

实践建议:

-

对于绝大多数应用代码,优先用

std::mutex。它在低竞争时也很快(Linux 的 futex 实现让无竞争路径完全在用户态完成),在高竞争时还能自动退化到睡眠,不会烧 CPU。自旋锁是一把锋利但容易割到自己的刀------只有当你测量过、确认自旋锁能带来实实在在的性能提升时才用它。 -

补充:现代

std::mutex并不是一拿不到锁就立刻切换,Linux 上的std::mutex底层是 futex (Fast Userspace Mutex)。它的聪明之处在于:1、无竞争时完全在用户态完成 :

lock()就是一个原子 CAS,成功就返回,不进内核,代价跟一次原子操作差不多(~10 ns)。2、有竞争时才调用

futex_wait系统调用 进入内核睡眠。3、更进一步,glibc 的

pthread_mutex(C++std::mutex在 Linux 上的底层)默认会在进入内核前先自旋一小段时间 ------这种"混合策略"叫 adaptive mutex 。思路是:如果锁的持有者很快就会释放,自旋几次拿到就够了;如果自旋几次仍然拿不到,再睡。这样在两种情况下都接近最优。4、

std::mutex已经免费得到了自旋锁的快速路径,又有睡眠机制兜底。自己手写自旋锁要跑赢它,必须对工作负载有非常精准的把握。 -

另外,C++ 标准库没有 提供自旋锁类型。这不是疏忽------标准委员会讨论过但决定不加,部分原因就是:用户写的自旋锁几乎总是比不过平台优化过的

std::mutex,除非你真的知道自己在做什么。 -

不要在自旋锁保护下调用可能阻塞的代码,例如:

cppSpinlock spin; void bad() { std::lock_guard<Spinlock> g(spin); std::cout << "hello\n"; // ❌ iostream 内部可能有互斥锁、系统调用 some_syscall(); // ❌ 可能阻塞数毫秒 } // 这会把所有等待者变成长时间的 CPU 烧烤机。自旋锁的临界区要短、短、再短------理想情况下不超过几十条指令,且不包含任何可能触发调度的操作。

6.2 atomic_flag vs atomic<bool>

| 特性 | std::atomic_flag |

std::atomic<bool> |

|---|---|---|

| 保证 lock-free | ✅ 标准保证 | ⚠️ 通常是,但不保证 |

load() |

❌(C++20 前) / ✅(C++20 test()) |

✅ |

store() |

只有 clear(),即 store(false) |

✅ |

test_and_set() |

✅ 原生支持 | ❌,但可用 exchange(true) 替代 |

compare_exchange |

❌ | ✅ |

wait/notify |

✅(C++20) | ✅(C++20) |

| 适合实现自旋锁 | ✅ 最佳选择 | ✅(也可以) |

| 可复制/移动 | ❌ | ❌ |

什么时候选 atomic_flag? 当你需要一个纯粹的二元标志 ,且希望在任何平台上都保证无锁------典型场景就是自旋锁 、一次性初始化标志、以及内核/嵌入式中的低层同步原语。

什么时候选 atomic<bool>? 当你需要读取当前值、或者需要 CAS 语义、或者只是写普通应用代码 ------atomic<bool> 接口更全,在主流平台上也都是无锁的。

7. 六种 Memory Order 深度剖析

这是整个内存模型中最核心、也最难理解的部分。C++11 定义了六种内存序(Memory Order),它们控制原子操作前后的非原子操作的可见顺序。

7.1 总览

严格程度(性能开销)

▲

│

seq_cst │ ████████████████████████ ← 最严格,最安全,性能最差

│ x86: MFENCE / LOCK XCHG

│ ARM: DMB + LDAR/STLR

│

acq_rel │ ██████████████████ ← acquire + release 的组合

│ 用于 RMW 操作

│

release │ ████████████████ ← "发布"语义,保证之前的写对其他线程可见

│ x86: 普通 MOV(天然保证!)

│ ARM: STLR(Store-Release)

│

acquire │ ████████████████ ← "获取"语义,保证能看到其他线程 release 的写

│ x86: 普通 MOV(天然保证!)

│ ARM: LDAR(Load-Acquire)

│

consume │ ██████████████ ← 弱化版 acquire(不要使用!)

│ 所有编译器都当 acquire 实现

│

relaxed │ ████████ ← 最宽松,只保证原子性,不保证顺序

│ 所有平台: 普通 MOV

└──────────────────────────────►7.2 memory_order_relaxed ------ 只保证原子性

memory_order_relaxed 是最宽松的内存序。它只保证当前原子操作本身是原子的 ,但不保证任何同步和内存顺序 ------前后的操作可以被任意重排。不同线程看到的操作顺序可能不一致,但对同一变量的修改顺序(modification order)仍是全局一致的。

cpp

#include <atomic>

#include <thread>

#include <cassert>

std::atomic<int> x{0};

std::atomic<int> y{0};

void thread_a() {

// relaxed 语序:这两条原子操作之间没有顺序保证

x.store(1, std::memory_order_relaxed); // (1) 原子写 x = 1

y.store(1, std::memory_order_relaxed); // (2) 原子写 y = 1

// 注意:(1) 和 (2) 可能被重排!

// 其他线程可能先看到 y==1 但还没看到 x==1

// 在 ARM 上这种重排非常容易发生

}

void thread_b() {

// 即使看到 y==1,也不能保证 x==1

while (y.load(std::memory_order_relaxed) != 1) {} // 等待 y 变为 1

// 以下断言在 ARM 上可能失败!在 x86 上可能"碰巧"通过(因为 TSO)

// assert(x.load(std::memory_order_relaxed) == 1); // ❌ 不安全

}适用场景 :只关心操作本身的原子性,不需要跨线程的顺序保证。最经典的场景是独立的计数器:

cpp

// ✅ relaxed 的典型正确用法:全局统计计数器

class Statistics {

// 这三个计数器互相独立,不存在"先写 A 才能写 B"的依赖关系

std::atomic<uint64_t> packets_received_{0};

std::atomic<uint64_t> packets_dropped_{0};

std::atomic<uint64_t> bytes_transferred_{0};

public:

// 多个线程同时递增不同的计数器

// 我们只关心每个计数器自身的准确性,不关心它们之间的时序

void on_packet_received(size_t bytes) {

// relaxed:只需要原子性,不需要排序保证

// 在 x86 上,这编译为一条 LOCK XADD 指令(无额外屏障)

packets_received_.fetch_add(1, std::memory_order_relaxed);

bytes_transferred_.fetch_add(bytes, std::memory_order_relaxed);

}

void on_packet_dropped() {

packets_dropped_.fetch_add(1, std::memory_order_relaxed);

}

// 读取时也用 relaxed ------ 统计数据不需要严格一致性

// 可能出现的情况:packets_received 已经更新了但 bytes_transferred 还是旧值

// 这在统计场景下是完全可以接受的

void print_stats() {

std::cout << "Received: " << packets_received_.load(std::memory_order_relaxed)

<< " Dropped: " << packets_dropped_.load(std::memory_order_relaxed)

<< " Bytes: " << bytes_transferred_.load(std::memory_order_relaxed)

<< std::endl;

}

};relaxed 的一个常见误区

relaxed 虽然不保证跨线程的顺序,但它仍然保证了单变量的一致性(也叫 coherence)。具体来说:

- 对同一个原子变量的所有修改,在所有线程中以相同的顺序出现(modification order)

- 一旦某个线程读到了某个值,后续读取只会看到相同或更新的值(不会看到更旧的值)

所以 relaxed 不是"完全无序"的------它只是不保证不同变量之间的顺序。

7.3 memory_order_acquire 和 memory_order_release ------ 最核心的配对

这是实际编程中最常用、最重要的内存序组合。理解它们就理解了 C++ 内存模型的核心。

memory_order_acquire --- 获取序:用于读操作 (load)。保证在此 load 之后的所有读写操作,不会被重排到此 load 之前。它与某个 release 操作配对,用于"接收"另一线程发布的数据。

memory_order_release --- 释放序:用于写操作 (store)。保证在此 store 之前的所有读写操作,不会被重排到此 store 之后。它把此前完成的所有修改"发布"给后续 acquire 同一变量的线程。

配对使用时的效果 :当线程 B 的 acquire-load 读到了线程 A 的 release-store 写入的值时,线程 A 在 release-store 之前 的所有写操作,对线程 B 在 acquire-load 之后都可见。

线程 A (producer) 线程 B (consumer)

───────────────── ──────────────────

data = 42; ─┐

extra = 100; │ 这些写入

msg = "hello"; │ 都在 release 之前 ───────────────┐

│ │

ready.store(true, ─┘ │

memory_order_release); ─── "release 发布" ───► │

│

while (!ready.load( │

memory_order_acquire)) │

; ← "acquire 获取" │

│

┌──── 到这里,能保证看到 ─────┘

│ data == 42 ✓

│ extra == 100 ✓

│ msg == "hello" ✓

└──现在我们来修复开头那个 Bug:

cpp

// ✅ 正确的线程间通信:使用 acquire-release 语义

#include <atomic>

#include <thread>

#include <iostream>

int data = 0; // 普通变量(非原子)------但在同步保护下可以安全使用

std::atomic<bool> ready{false}; // 原子标志变量------用于同步

void producer() {

data = 42; // (1) 普通写入

ready.store(true, std::memory_order_release); // (2) release 发布

// release 保证:(1) 一定在 (2) 之前完成

// 即:data=42 的写入效果一定在 ready=true 之前对其他核心可见

// 注意:即使 data 不是原子变量,只要在 release 之前写入,也能被 acquire 端安全读取

}

void consumer() {

while (!ready.load(std::memory_order_acquire)) { // (3) acquire 获取

// 忙等------但因为使用了 atomic,编译器不会将循环优化掉

}

// 当 (3) 读到 true 时(意味着它"看到了" producer 的 release store),

// acquire 保证:producer 在 release 之前的所有写入(包括 data=42)对这里可见

std::cout << data << std::endl; // (4) 一定输出 42 ✓

}

int main() {

std::thread t1(producer);

std::thread t2(consumer);

t1.join();

t2.join();

return 0;

}更实际的例子:自旋锁(Spinlock)

cpp

#include <atomic>

class Spinlock {

std::atomic<bool> locked_{false}; // false = 未锁定,true = 已锁定

public:

void lock() {

// 不断尝试将 locked_ 从 false 设为 true

// exchange 是原子的 RMW 操作:读旧值 + 写新值

// acquire 语义:如果成功获取锁(exchange 返回 false),

// 保证锁内的操作不会被重排到 lock() 之前

while (locked_.exchange(true, std::memory_order_acquire)) {

// exchange 返回旧值:

// 如果旧值是 false → 锁原来是空闲的,我们成功获取了锁,退出循环

// 如果旧值是 true → 锁被其他线程持有,继续自旋

// ===== 性能优化:Test-And-Test-And-Set (TTAS) =====

// 直接用 exchange 自旋会不断执行写操作(即使锁被持有),

// 导致缓存行在 Modified 和 Invalid 之间频繁切换(cache bouncing)

// 改为先用 relaxed load 检查,只在锁可能空闲时才执行 exchange

while (locked_.load(std::memory_order_relaxed)) {

// 纯读操作:缓存行保持 Shared 状态,不产生总线流量

// 直到其他线程 unlock(写入 false),才会收到 Invalidate

#if defined(__x86_64__)

__builtin_ia32_pause();

// PAUSE 指令的三个作用:

// 1. 告诉 CPU 这是自旋等待,降低功耗

// 2. 避免因投机执行导致的流水线清空(memory order violation)

// 3. 在超线程环境下,让出资源给另一个硬件线程

#elif defined(__aarch64__)

asm volatile("yield"); // ARM 等效指令

#endif

}

// locked_ 变为 false 了(可能),回到外层循环的 exchange 再试一次

}

}

void unlock() {

locked_.store(false, std::memory_order_release);

// release 语义:保证锁内的所有操作在 unlock 之前完成

// 即:下一个获取锁的线程能看到我们在临界区内做的所有修改

}

};

// 使用示例

Spinlock spin;

int shared_data = 0;

void worker() {

spin.lock();

// ---- 临界区开始 ----

// 所有在 acquire 之后、release 之前的读写

// 都不会被重排到临界区外部

shared_data++; // 安全的

// ---- 临界区结束 ----

spin.unlock();

}7.4 memory_order_acq_rel --- 获取-释放

用于读-改-写 (read-modify-write)操作,如 fetch_add、compare_exchange、exchange。同时具有 acquire 和 release 语义:读取部分是 acquire,写入部分是 release。

cpp

#include <atomic>

#include <thread>

#include <iostream>

std::atomic<int> sync_point{0};

int payload_a = 0;

int payload_b = 0;

void thread_a() {

payload_a = 42; // 准备数据 A(普通写入)

// fetch_add 是 RMW 操作,同时具有 acquire 和 release 语义:

// release 效果:payload_a = 42 不会被重排到 fetch_add 之后

// → 保证其他线程通过此操作能看到 payload_a

// acquire 效果:如果 thread_b 的 fetch_add 先执行,

// 此操作之后能看到 thread_b release 之前的所有写入

int prev = sync_point.fetch_add(1, std::memory_order_acq_rel);

if (prev == 1) {

// prev == 1 说明 thread_b 已经执行了 fetch_add

// 由于我们的 acquire 语义,此处能安全读取 payload_b

std::cout << "A sees B's data: " << payload_b << std::endl; // 一定是 100

}

}

void thread_b() {

payload_b = 100; // 准备数据 B(普通写入)

int prev = sync_point.fetch_add(1, std::memory_order_acq_rel);

if (prev == 1) {

// prev == 1 说明 thread_a 已经执行了 fetch_add

std::cout << "B sees A's data: " << payload_a << std::endl; // 一定是 42

}

}

// 注意:prev == 0 的那个线程不能安全读取另一个线程的 payload

// 因为另一个线程可能还没执行到 fetch_add

// 只有 prev == 1 的线程才建立了与另一个线程的 happens-before 关系7.5 memory_order_seq_cst ------ 全局一致顺序

seq_cst(Sequential Consistency,顺序一致性)是最严格的 内存序,也是所有 std::atomic 操作的默认内存序 。

它在 acquire/release 的基础上,额外保证了:所有线程看到的所有 seq_cst 操作的顺序是一致的(存在一个全局一致的全序关系 "S")。

例如下面代码这个例子:

四个线程并发运行:

- 线程1:写

x = true - 线程2:写

y = true - 线程3:先等

x变 true,再看y是不是 true,是就z++ - 线程4:先等

y变 true,再看x是不是 true,是就z++

问题:最终 z 会不会是 0?也就是说,是否可能线程3 看到 x=true, y=false,同时 线程4 看到 y=true, x=false?

直觉上这不可能------既然线程3 已经看到 x 是 true,线程4 又看到 y 是 true,那两个写都已经发生了,怎么可能后续的读又都看不到对方?但在 acquire/release 下,这居然是可能的。

为什么acquire/release 下会有这个问题?

write_x 和 write_y 是两个独立的 store,它们之间没有任何 happens-before 关系 (分别在两个不相关的线程里,happens-before具体是什么后面有详细说)。acquire/release 建立的同步是"点对点"的:

- 线程3 的

x.load(acquire)读到 true,与线程1 的x.store(release)同步 → 线程3 能看到线程1 此前的所有写入 - 线程4 的

y.load(acquire)读到 true,与线程2 的y.store(release)同步 → 线程4 能看到线程2 此前的所有写入

但线程1 的写和线程2 的写之间没有任何约束。于是允许这样一种"观察不一致":

- 从线程3 的视角:

x先变 true,y后变 true(当它读 y 时 y 还没传播过来) - 从线程4 的视角:

y先变 true,x后变 true(当它读 x 时 x 还没传播过来) - 这两种视角各自都自洽 ,但合在一起矛盾 ------没有一个全局顺序能同时满足"x 先于 y"和"y 先于 x"。acquire/release 允许这种矛盾存在,因此

z == 0是可能的。 - 这种现象在真实硬件上(尤其是 POWER、ARM)是会实际发生的,不是纯理论。原因是每个 CPU 核心有自己的 store buffer,一个核心的写何时对其他核心可见是独立的,不同观察者看到的传播顺序可能不同。

seq_cst 额外要求:所有 seq_cst 操作存在一个全局单一顺序 S,所有线程看到的都是这同一个 S 。

在这个全局顺序里,write_x 和 write_y 必有一个先一个后。假设 S 中 write_x 在 write_y 之前:

- 线程4 看到

y == true,说明write_y已在 S 中发生,那么write_x(在它之前)也必然已发生,所以线程4 读x一定得到 true →z++ - 线程3 可能看到

y是 true 或 false,不确定,但至少线程4 必然z++

反过来假设 write_y 在 write_x 之前,则线程3 必然 z++。

无论哪种情况,至少有一个线程会递增 z,所以 z 不可能为 0。

cpp

#include <atomic>

#include <thread>

#include <cassert>

std::atomic<bool> x{false};

std::atomic<bool> y{false};

std::atomic<int> z{0};

void thread_a()

{

x.store(true, std::memory_order_seq_cst); // (1) seq_cst 写 x

}

void thread_b()

{

y.store(true, std::memory_order_seq_cst); // (2) seq_cst 写 y

}

void thread_c()

{

while (!x.load(std::memory_order_seq_cst)); // (3) 等 x 变为 true

if (y.load(std::memory_order_seq_cst)) { // (4) 检查 y

z.fetch_add(1, std::memory_order_relaxed); // y 也为 true,z++

std::cout << "thread_c" << std::endl;

}

}

void thread_d()

{

while (!y.load(std::memory_order_seq_cst)); // (5) 等 y 变为 true

if (x.load(std::memory_order_seq_cst)) { // (6) 检查 x

z.fetch_add(1, std::memory_order_relaxed); // x 也为 true,z++

std::cout << "thread_d" << std::endl;

}

}

int main()

{

std::thread a(thread_a), b(thread_b), c(thread_c), d(thread_d);

a.join(); b.join(); c.join(); d.join();

// 如果使用 seq_cst,z 不可能为 0

// 因为所有线程对 x, y 的 seq_cst 操作观察顺序是一致的:

// 要么全局顺序是 x=true 先于 y=true:

// → thread_d 看到 y=true 后一定也看到 x=true → z 至少为 1(是否为2这个无法确定,因为x先于y发生,此时thread_c读取y时,y可能为false)

// 要么全局顺序是 y=true 先于 x=true:

// → thread_c 看到 x=true 后一定也看到 y=true → z 至少为 1(是否为2这个无法确定,因为y先于x发生,此时thread_d读取x时,x可能为false)

assert(z.load() != 0); // ✅ 在 seq_cst 下一定成立

std::cout << z.load() << std::endl;

// 但如果改成 acquire/release,z == 0 是可能发生的!

// 因为 acquire/release 没有全局一致顺序的保证

// thread_c 可能看到 x=true, y=false(x先变)

// thread_d 可能看到 y=true, x=false(y先变)

// 两个线程对 x 和 y 的修改顺序的"观察"可以不一致!

}seq_cst 的代价 :在 x86 上,seq_cst store 需要插入 MFENCE 指令或使用 LOCK XCHG 指令(比普通 MOV 慢得多)。在 ARM 上,需要额外的 DMB 指令。

不同 memory order 在 x86 上的指令生成:

release store: MOV [addr], val ← 普通指令,零额外开销!

seq_cst store: MOV [addr], val; MFENCE ← 多了一条 MFENCE(或用 XCHG)

或 LOCK XCHG [addr], val

acquire load: MOV val, [addr] ← 普通指令,零额外开销!

seq_cst load: MOV val, [addr] ← x86 上和 acquire load 一样!

结论:x86 上 acquire/release 几乎免费,seq_cst store 有显著开销

ARM 上所有非 relaxed 操作都有开销7.6 memory_order_consume ------ 几乎不要用

consume 是 acquire 的弱化版本,它只保证有数据依赖关系 的后续操作不被重排。理论上比 acquire 开销更小,但:

- 几乎所有编译器都把

consume当作acquire来实现(因为正确追踪数据依赖关系太困难了) - C++17 标准明确建议不要使用

consume - C++ 标准委员会正在考虑重新设计

consume(可能在未来标准中修改语义) - 实际编程中,请始终使用

acquire代替consume

** consume 的理论价值**

consume 的设计初衷是利用 CPU 的"数据依赖序"(data dependency ordering)。几乎所有 CPU 都天然保证:如果指令 B 的输入依赖于指令 A 的输出,则 B 不会在 A 之前执行。consume 希望利用这个特性来避免生成不必要的屏障指令(尤其在弱序架构如 ARM 上)。

例如:

T* p = atomic_ptr.load(consume); use(p->data);这里p->data依赖于p,CPU 天然会先加载p再加载p->data,不需要屏障。但问题是编译器在优化时可能打破数据依赖(例如通过常量传播),导致 consume 语义被破坏。所以编译器选择保守地将 consume 升级为 acquire。

7.7 六种内存序的总结对比

cpp

// ┌─────────────────────┬───────────────────────────────────────────────┐

// │ 场景 │ 推荐 Memory Order │

// ├─────────────────────┼───────────────────────────────────────────────┤

// │ 独立的计数器 │ relaxed │

// │ (不与其他数据联动) │ │

// ├─────────────────────┼───────────────────────────────────────────────┤

// │ 生产者-消费者模式 │ 生产者用 release store │

// │ (发送/接收数据) │ 消费者用 acquire load │

// ├─────────────────────┼───────────────────────────────────────────────┤

// │ 自旋锁 │ lock: acquire (exchange/CAS) │

// │ │ unlock: release (store) │

// ├─────────────────────┼───────────────────────────────────────────────┤

// │ 读-改-写操作需要 │ acq_rel (fetch_add, CAS 等) │

// │ 同时读写 │ │

// ├─────────────────────┼───────────────────────────────────────────────┤

// │ 需要全局一致顺序 │ seq_cst │

// │ 或者不确定该用什么 │ (最安全,但性能最差) │

// ├─────────────────────┼───────────────────────────────────────────────┤

// │ 不知道该用什么 │ 先用 seq_cst,性能分析后再降级 │

// └─────────────────────┴───────────────────────────────────────────────┘8. Happens-Before 关系的形式化定义

C++ 内存模型的核心是 happens-before 关系。理解它需要先理解几个更基本的概念。

8.1 基本概念链

Sequenced-Before (同一线程内的程序顺序)

↓

Synchronizes-With (一个 release 操作与读到其值的 acquire 操作之间建立的跨线程同步关系,由原子操作建立)

↓

Happens-Before = sequenced-before 与 synchronizes-with 的传递闭包

↓

Visible Side Effect (可见的副作用)

// 如果操作 A happens-before 操作 B,那么 A 的效果对 B 可见。这是无锁编程推理正确性的核心工具。补充:什么是闭包?sequenced-before 和 synchronizes-with具体是什么?为什么Happens-before 是 sequenced-before 与 synchronizes-with 的传递闭包?

1、sequenced-before 与 synchronizes-with :

- Sequenced-before(顺序前) :同一个线程内,代码按书写顺序执行的先后关系。比如线程里

a = 1; b = 2;,a=1sequenced-beforeb=2。 - Synchronizes-with(同步于) :跨线程的同步关系,比如一个线程对原子变量的

release操作,和另一个线程对同一个变量的acquire操作,就建立了 synchronizes-with 关系。

2、传递性(是一种属性):

如果关系 R 是传递的,就意味着:

若

A R B且B R C,则一定有A R C。

比如「大于」是传递关系:A > B 且 B > C → A > C;

而「朋友」不是传递关系 :A是B的朋友、B是C的朋友,不代表A是C的朋友。

3、传递闭包:

对于一个关系

R,它的传递闭包是「包含R的、最小的传递关系」。

通俗来说:

- 原关系

R可能本身不满足传递性; - 我们给它补全所有能通过传递性推出来的新关系,得到的完整关系集合,就是它的传递闭包。

举个简单例子:

假设我们有 3 个操作 A, B, C,原关系只有:A R B,B R C

原关系 R 不满足传递性(没有 A R C),我们补全 A R C 后,得到的完整关系 {A R B, B R C, A R C},就是 R 的传递闭包。

4、Happens-Before:

Happens-before 是 sequenced-before 与 synchronizes-with 的传递闭包 ,意思是:

a、基础规则(原关系):

- 规则 1(线程内顺序):如果操作

Xsequenced-beforeY,那么X happens-before Y; - 规则 2(跨线程同步):如果操作

Xsynchronizes-withY,那么X happens-before Y。

b、传递性补全(闭包的核心)

- 规则 3(传递性):如果

X happens-before Y,且Y happens-before Z,那么X happens-before Z。

c、完整的 Happens-Before 关系:

就是把所有满足规则 1、规则 2 的基础关系,再通过规则 3 补全所有能传递推导出来的关系,最终得到的完整关系集合,就是「sequenced-before 与 synchronizes-with 的传递闭包」。

5、例子:

cpp

// 线程A

int a = 1; // 操作A

flag.store(true, std::memory_order_release); // 操作B (release)

// 线程B

while (!flag.load(std::memory_order_acquire)); // 操作C (acquire,读到B的true)

int b = a; // 操作D推导 Happens-Before 关系:

- 线程内顺序 :

A sequenced-before B→A happens-before B;C sequenced-before D→C happens-before D; - 跨线程同步 :

B synchronizes-with C→B happens-before C; - 传递闭包补全 :

A happens-before B+B happens-before C+C happens-before D→A happens-before D。

最终结论:A(a=1)的效果对 D(b=a)可见,所以 b 一定等于 1,不会出现读到旧值的问题。

这就是 Happens-Before 作为**「传递闭包」**的实际作用:把线程内顺序和跨线程同步串起来,保证跨线程的内存可见性。

8.2 详细定义与示例

cpp

#include <atomic>

#include <thread>

std::atomic<int> flag{0};

int data = 0; // 非原子变量

int result = 0; // 非原子变量

void writer() {

data = 42; // (A)

flag.store(1, std::memory_order_release); // (B)

}

void reader() {

while (flag.load(std::memory_order_acquire) != 1) {} // (C)

result = data; // (D)

}

// ==================== Happens-Before 分析 ====================

//

// 1. Sequenced-Before(线程内的程序顺序):

// (A) sequenced-before (B) ------ 因为 (A) 在同一线程中先于 (B) 执行

// (C) sequenced-before (D) ------ 因为 (C) 在同一线程中先于 (D) 执行

//

// 2. Synchronizes-With(跨线程同步):

// 当 (C) 的 acquire load 读到了 (B) 的 release store 写入的值 1 时:

// (B) synchronizes-with (C) ------ release store 与 acquire load 构成同步

//

// 3. Happens-Before(传递闭包):

// (A) happens-before (B) ------ 来自 sequenced-before

// (B) happens-before (C) ------ 来自 synchronizes-with

// (C) happens-before (D) ------ 来自 sequenced-before

//

// 通过传递性:

// (A) happens-before (D) ------ A → B → C → D

//

// 4. 结论:

// 因为 (A) happens-before (D),

// 所以 (D) 读取 data 时一定能看到 (A) 写入的 42。

// result 一定等于 42。✅8.3 Modification Order(修改序)

每个原子变量 都有一个修改序 ------所有线程对该变量的修改构成一个全序关系(total order)。所有线程都同意这个顺序。

cpp

#include <atomic>

#include <thread>

#include <cassert>

std::atomic<int> x{0};

// 假设 3 个线程分别写入 x:

// Thread 1: x.store(1, relaxed);

// Thread 2: x.store(2, relaxed);

// Thread 3: x.store(3, relaxed);

// 修改序可能是以下任意一种(但一旦确定,所有线程都看到相同的顺序):

// 0 → 1 → 2 → 3

// 0 → 1 → 3 → 2

// 0 → 2 → 1 → 3

// 0 → 2 → 3 → 1

// 0 → 3 → 1 → 2

// 0 → 3 → 2 → 1

// 关键保证:如果 Thread A 先看到 x=1 再看到 x=2,

// 那么 Thread B 不可能先看到 x=2 再看到 x=1

// (对同一个原子变量,所有线程的观察顺序一致)

// 这就是 "coherence" 保证,即使使用 relaxed 也有此保证8.4 Release Sequence(释放序列)

release sequence 是一个重要但常被忽略的概念。它允许 acquire load 与 release store 之间存在其他 RMW 操作,仍然能建立 synchronizes-with 关系。

回到标准的acquire/release配对:

cpp

shared_data = 42;

count.store(1, release); // (A)

// ...

while (count.load(acquire) < 1) {} // (C)

assert(shared_data == 42); // OK

// 这里 (C) 直接读到了 (A) 写入的值 1,所以 (A) synchronizes-with (C),happens-before 关系建立,shared_data 可见。

// 但如果中间有人改了 count 呢?(C) 可能读到的根本就不是 (A) 写的那个 1,而是别人后来写的 2。按字面定义,(C) 没有"读到 (A) 的值",同步关系似乎就断了。

// 这就是 release sequence 要解决的问题。Release Sequence 的定义:

一个 release 操作 (A) 后面,在同一个原子变量上,后续满足以下条件的写操作组成一个序列,叫做 (A) 的 release sequence:

- 同一线程 的任意写操作,或

- 任意线程 的读-改-写 (RMW)操作(如

fetch_add、exchange、compare_exchange)

关键规则 :只要 acquire load © 读到的值是这个 release sequence 中任何一个 操作写入的,(A) 就 synchronizes-with ©。

注意这条线很"脆":一旦中间夹了一个别的线程的普通 store (非 RMW),release sequence 就断了,后面再读到的值就不再与 (A) 同步。

回到例子:

cpp

// 线程1 (producer)

shared_data = 42;

count.store(1, release); // (A)

// 线程2 (relay)

count.fetch_add(1, relaxed); // (B) RMW,即使是 relaxed!

// 线程3 (consumer)

while (count.load(acquire) < 2) {} // (C) 最终读到 2

assert(shared_data == 42); // 成立执行顺序大致是:

- (A) 把

count写成 1,并把shared_data = 42"发布"出去 - (B) 是 RMW,把 1 改成 2。因为它是 RMW,它加入了 (A) 的 release sequence

- © 读到 2,这个 2 是 release sequence 中的成员((B))写入的

- 因此 (A) synchronizes-with ©,(A) 之前的

shared_data = 42对 © 可见

有意思的点 :(B) 自己用的是 relaxed,看起来什么同步都不提供。但因为它是 RMW,它"接力"延续了 (A) 建立的发布关系。consumer 即使没读到 (A) 直接写的 1,而是读到 (B) 写的 2,依然能看到 shared_data = 42。

如果(B)不是RMW会怎么样?

cpp

// 线程2 改成普通 store

count.store(2, relaxed); // (B') 不是 RMW这时 (B') 是另一个线程的普通 store,会切断 release sequence。consumer 读到 2 时,这个 2 来自 (B'),而 (B') 不在 (A) 的 release sequence 里,所以 (A) 不 synchronizes-with ©,shared_data == 42 就不再保证 。

consumer 可能读到 count == 2,却看到 shared_data 还是 0。

为什么这条规则存在?

最常见的实战场景是引用计数 和多消费者通知。比如:

cpp

#include <atomic>

#include <iostream>

struct Resource {

int data = 0;

};

Resource* ptr = new Resource();

std::atomic<int> ref_count{3}; // 假设3个线程共享

// ============ 线程A ============

void thread_a() {

ptr->data = 42; // 修改资源

// release 封印:ptr->data = 42 不会跑到 fetch_sub 后面

ref_count.fetch_sub(1, std::memory_order_acq_rel);

}

// ============ 线程B ============

void thread_b() {

ptr->data = 100; // 修改资源

// release 封印:ptr->data = 100 不会跑到 fetch_sub 后面

ref_count.fetch_sub(1, std::memory_order_acq_rel);

}

// ============ 线程C(最后一个)============

void thread_c() {

if (ref_count.fetch_sub(1, std::memory_order_acq_rel) == 1) {

// acquire 封印:通过 release sequence

// 线程A 和 线程B 的 ptr->data 写入,此处均可见

std::cout << ptr->data; // ✅ 安全

delete ptr;

}

}

// 为什么这里用 acq_rel 而不是 relaxed?

// fetch_sub----relaxedrelease sequence ✅ 但最后一次 fetch_sub 看不到之前所有线程的写入(也就是说delete ptr可能会重排到refcount.fetch_sub(1, acq_rel) == 1前面)

// fetch_sub acq_relrelease sequence ✅ 且 最后一次操作 acquire 到所有之前的修改

// 如果改成relaxed会发生什么?

// ============ 线程A ============

void thread_a() {

ptr->data = 42;

ref_count.fetch_sub(1, std::memory_order_relaxed); // ← 无 release

// ptr->data = 42 这个写入,没有被"封印"在 fetch_sub 之前

// 对其他线程而言,这个写入何时可见,没有任何保证

}

// ============ 线程C(最后一个)============

void thread_c() {

if (ref_count.fetch_sub(1, std::memory_order_relaxed) == 1) {

// ← 无 acquire,没有桥接到线程A/B 的 release

// ref_count 减到0了,但线程A/B 对 ptr->data 的修改

// 有没有同步过来?完全不知道

std::cout << ptr->data; // ❌ 可能读到旧值甚至撕裂的值

delete ptr;

}

}每个 fetch_sub 都是 RMW,它们形成一条 release sequence 链。最后那个把计数减到 0 的线程,通过 release sequence 能看到此前所有线程对对象的修改------即使中间的 fetch_sub 用了较弱的内存序。这正是 std::shared_ptr 析构能正确工作的理论基础之一。

另一个场景:信号量 / 计数型门闩 。多个生产者各自 fetch_add 一个计数,消费者等待计数达到某个阈值。生产者们的修改通过 release sequence 串起来,消费者一次 acquire 就能看到所有生产者的工作。

总结:Release sequence 让 RMW 操作变成"接力棒",可以在不破坏同步关系的前提下,让多个线程依次修改同一个原子变量;但普通的非-RMW store 会"打断接力",同步关系就此终止。

记住RMW 续链,普通 store 断链 。以后看 shared_ptr、无锁队列、计数门闩这类代码里为什么大量用 fetch_add/fetch_sub 而不是 store,就会更有体感了。

cpp

#include <atomic>

#include <thread>

#include <vector>

std::atomic<int> count{0};

int shared_data = 0;

void producer() {

shared_data = 42;

count.store(1, std::memory_order_release); // (A) release store

}

void relay() {

// fetch_add 是 RMW 操作,它读取了 count 的值

// 即使使用 relaxed,它仍然是 (A) 的 release sequence 的一部分

int c = count.fetch_add(1, std::memory_order_relaxed); // (B)

// 因为 (B) 原子地读取-修改了 count,

// 它延续了 (A) 建立的 release sequence

}

void consumer() {

while (count.load(std::memory_order_acquire) < 2) {} // (C)

// (C) 读到的值(>= 2)是 release sequence {(A), (B)} 产生的

// 所以 (A) synchronizes-with (C)

// 因此 shared_data = 42 对这里可见!

assert(shared_data == 42); // ✅ 即使 (B) 用了 relaxed

}

// 如果 (B) 不是 RMW 而是单独的 store,就打破了 release sequence,

// consumer 就不能保证看到 shared_data = 429.std::atomic_thread_fence:独立内存屏障

除了在 std::atomic 的 load/store 操作上指定 memory order 之外,C++ 还提供了独立的内存屏障 函数 std::atomic_thread_fence。它不绑定在任何具体的原子变量的 load/store 上 ,而是在代码中单独设立一道"栅栏" 。用来约束其前后内存操作的重排序和可见性。

在 std::atomic 的 load/store 上直接指定 memory_order(例如 store(x, memory_order_release)),屏障是绑在那一个原子操作上的。但有时你希望:

- 用 relaxed 的原子操作(性能更好),同时只在某个关键点插一道屏障

- 让一道屏障同时保护多个原子变量的写入或读取

- 与非原子变量的读写配合使用

这时就需要 atomic_thread_fence。

9.1 基本用法

cpp

#include <atomic>

#include <thread>

int data = 0;

std::atomic<bool> flag{false};

void producer() {

data = 42;

// 方式一:在 store 操作上指定 release

// flag.store(true, std::memory_order_release);

// 方式二:使用独立的 release fence + relaxed store

// 效果与方式一等价,但更灵活

std::atomic_thread_fence(std::memory_order_release); // release 屏障

flag.store(true, std::memory_order_relaxed); // relaxed store

// release fence 保证:fence 之前的所有读写操作

// 都在 fence 之后的任何原子 store 之前完成

}

void consumer() {

// 方式一:在 load 操作上指定 acquire

// while (!flag.load(std::memory_order_acquire)) {}

// 方式二:使用 relaxed load + 独立的 acquire fence

while (!flag.load(std::memory_order_relaxed)) {}

std::atomic_thread_fence(std::memory_order_acquire); // acquire 屏障

// acquire fence 保证:fence 之前的任何原子 load(读到了非初始值)

// 之后的所有读写操作都能看到对方 release 之前的写入

assert(data == 42); // ✅ 安全

}1、release fence 的语义是------fence 之前的所有读写操作 ,不能被重排到 fence 之后的任何 store (无论那些 store 是 relaxed 还是什么)之后。

所以:

data = 42和其他的写入 都被"按住"在 fence 之前- 之后的

flag.store还有其他的store即便是 relaxed,但它们一旦被其它线程观察到 true/1,那么 fence 之前的所有写入对那个线程就都可见了

2、acquire fence 的语义是------fence 之后的所有读写 ,不能被重排到 fence 之前的任何 load 之前。

配对规则:只要当前线程在 acquire fence 之前用 relaxed 读到了另一个线程在 release fence 之后写入的某个值,那么另一个线程在 release fence 之前的所有写入,都对当前线程在 acquire fence 之后的代码可见。

9.2 fence 的独特优势

fence 与 atomic 操作上的 memory order 有一个关键区别:fence 是"批量"屏障,它影响 fence 前后的所有内存操作;而 atomic 操作上的 memory order 只约束该特定操作。

cpp

#include <atomic>

std::atomic<int> a{0}, b{0}, c{0};

int x = 0, y = 0, z = 0;

void writer() {

x = 1;

y = 2;

z = 3;

// 一个 release fence 可以保护上面所有三个写入

// 比在每个原子操作上单独指定 release 更简洁

std::atomic_thread_fence(std::memory_order_release);

a.store(1, std::memory_order_relaxed);

b.store(1, std::memory_order_relaxed);

c.store(1, std::memory_order_relaxed);

// fence 保证 x, y, z 的写入在 a, b, c 的 store 之前完成

// 读者只要 acquire-读到 a/b/c 中任意一个为 1,就能安全读取 x, y, z

}

void reader() {

// 只要读到 a, b, c 中任意一个为 1

if (a.load(std::memory_order_relaxed) == 1 ||

b.load(std::memory_order_relaxed) == 1 ||

c.load(std::memory_order_relaxed) == 1) {