论文网址:Scalable Diffusion Models with Transformers

项目网址:Scalable Diffusion Models with Transformers

目录

[1. 心得](#1. 心得)

[2. 论文逐段精读](#2. 论文逐段精读)

[2.1. Abstract](#2.1. Abstract)

[2.2. Introduction](#2.2. Introduction)

[2.3. Related Work](#2.3. Related Work)

[2.4. Diffusion Transformers](#2.4. Diffusion Transformers)

[2.4.1. Preliminaries](#2.4.1. Preliminaries)

[2.4.2. Diffusion Transformer Design Space](#2.4.2. Diffusion Transformer Design Space)

[2.5. Experimental Setup](#2.5. Experimental Setup)

[2.6. Experiments](#2.6. Experiments)

[2.6.1. State-of-the-Art Diffusion Models](#2.6.1. State-of-the-Art Diffusion Models)

[2.6.2. Scaling Model vs. Sampling Compute](#2.6.2. Scaling Model vs. Sampling Compute)

[2.7. Conclusion](#2.7. Conclusion)

1. 心得

(1)可以很快速读完

2. 论文逐段精读

2.1. Abstract

①作者把扩散模型的主干从U Net替换为了Transformer

②随着Transformer层变深变宽,效果会变得更好

2.2. Introduction

①替换成Transformer之后还能缩放

subsume vt.将...归入(或纳入) demystify vt.使明白易懂;深入浅出地解释

poise n.沉着自信;自若;仪态;稳重;优雅的举止 v.保持(某种姿势);使稳定;抓紧

2.3. Related Work

①说了一些其他的基础扩散方法,也说要考虑到计算复杂度

2.4. Diffusion Transformers

2.4.1. Preliminaries

①前向高斯加噪扩散:

简化版:

其中

②去噪:

③变分下界损失,用于优化方差:

噪声误差,用于预测噪声:

④贝叶斯定理,对数似然损失项:

梯度项:

⑤Classifier-free guidance:其中把基于条件预测

的概率梯度替换为了噪声差值

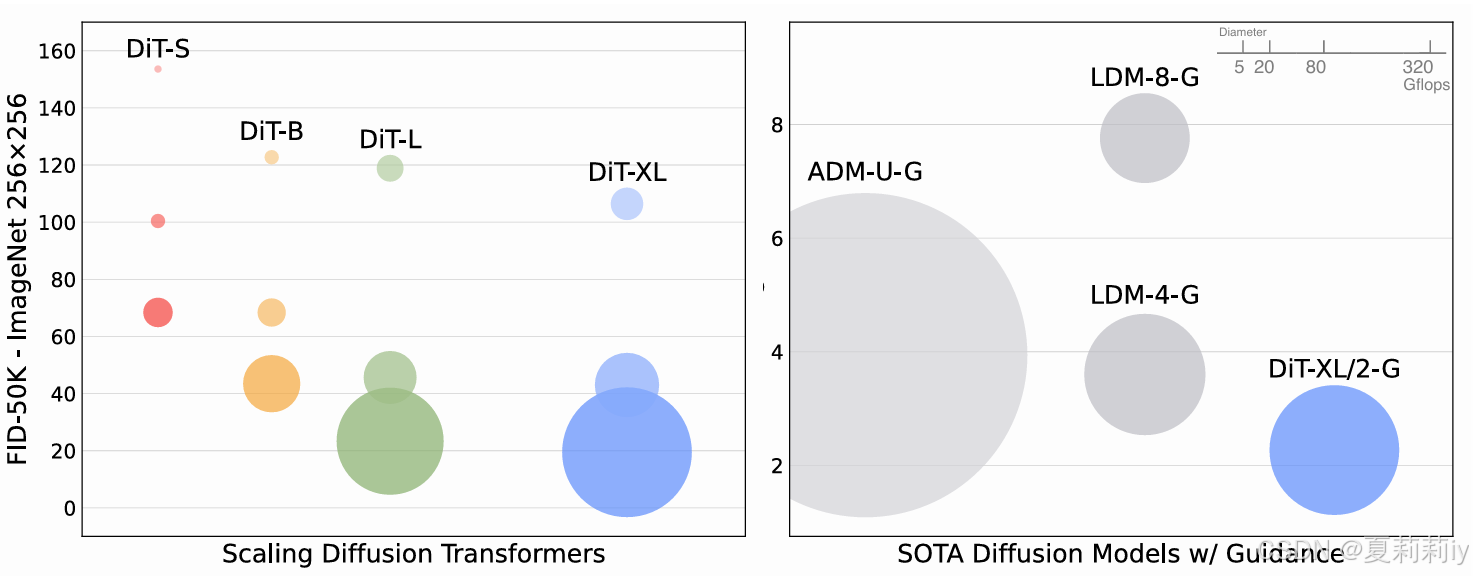

⑥规模和模型对比:

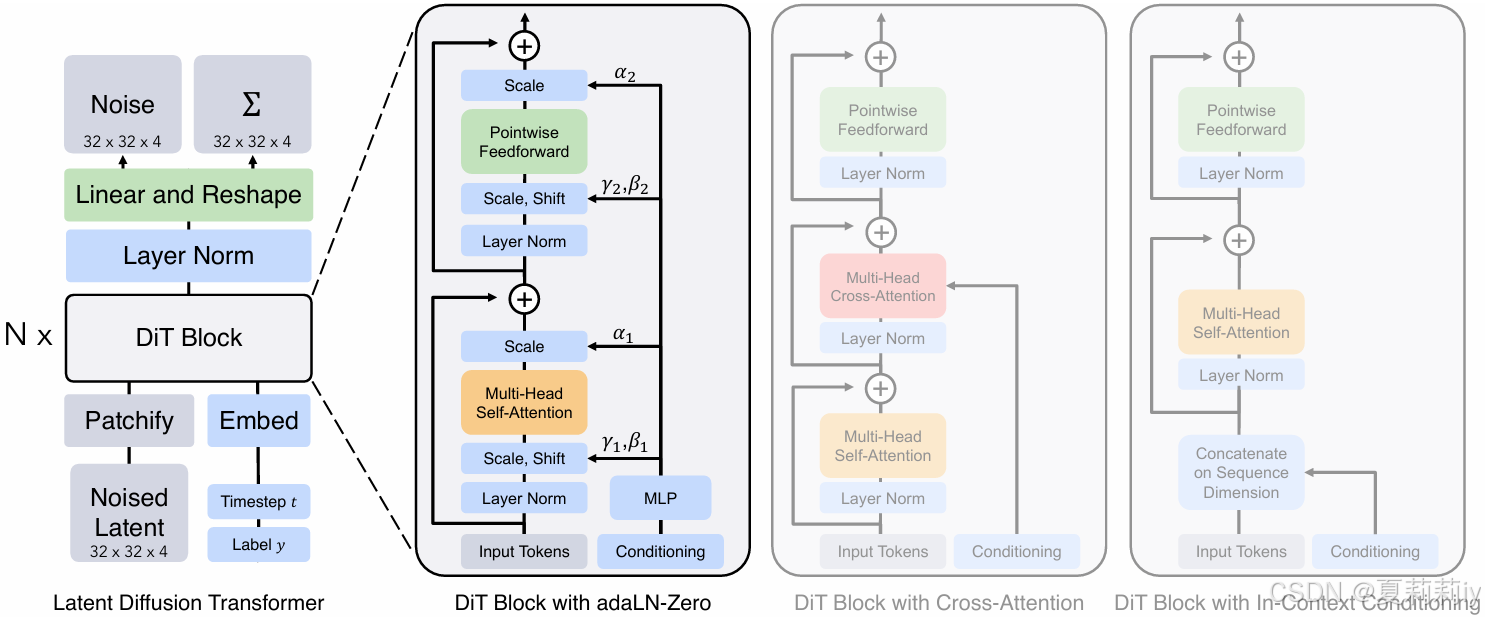

2.4.2. Diffusion Transformer Design Space

①DiT架构图:

其中输入图片像素由256×256×3被VAE变成32×32×4的作为DiT的输入

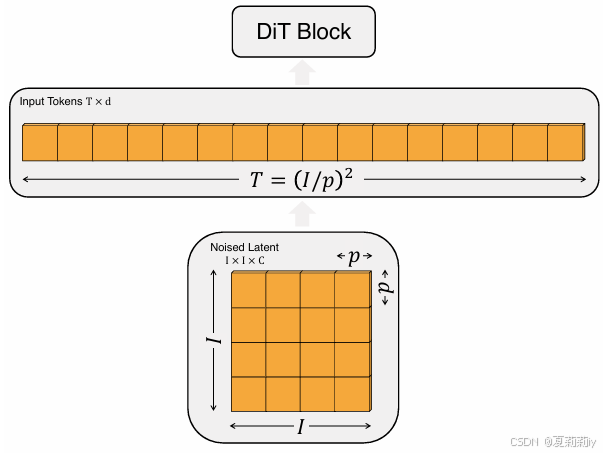

②图像切块:

2.5. Experimental Setup

①把DiT在ImageNet上256×256和512×512的图片上训练

②学习率:1e-4,不权重衰减。使用指数移动平均(exponential moving average, EMA)

③批量大小:256

④负责特征压缩的VAE单独训练

2.6. Experiments

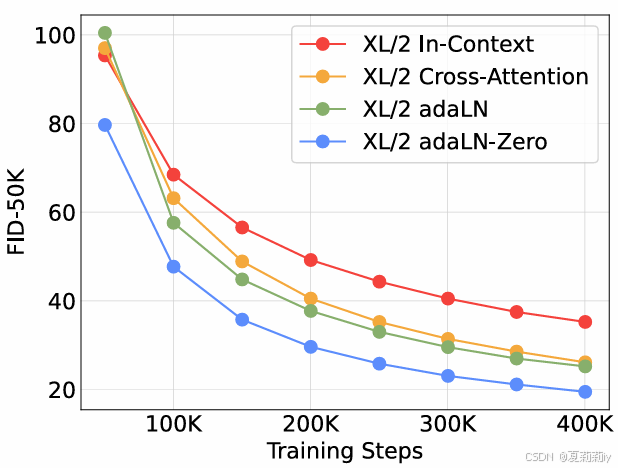

①不同设计的对比实验:

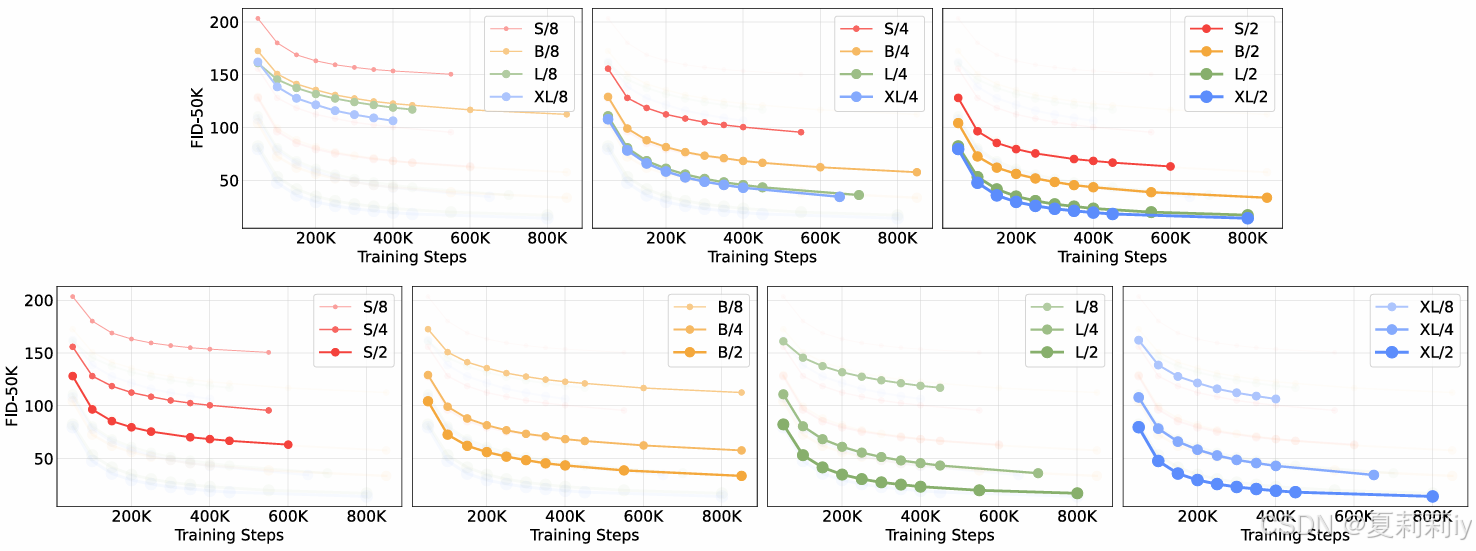

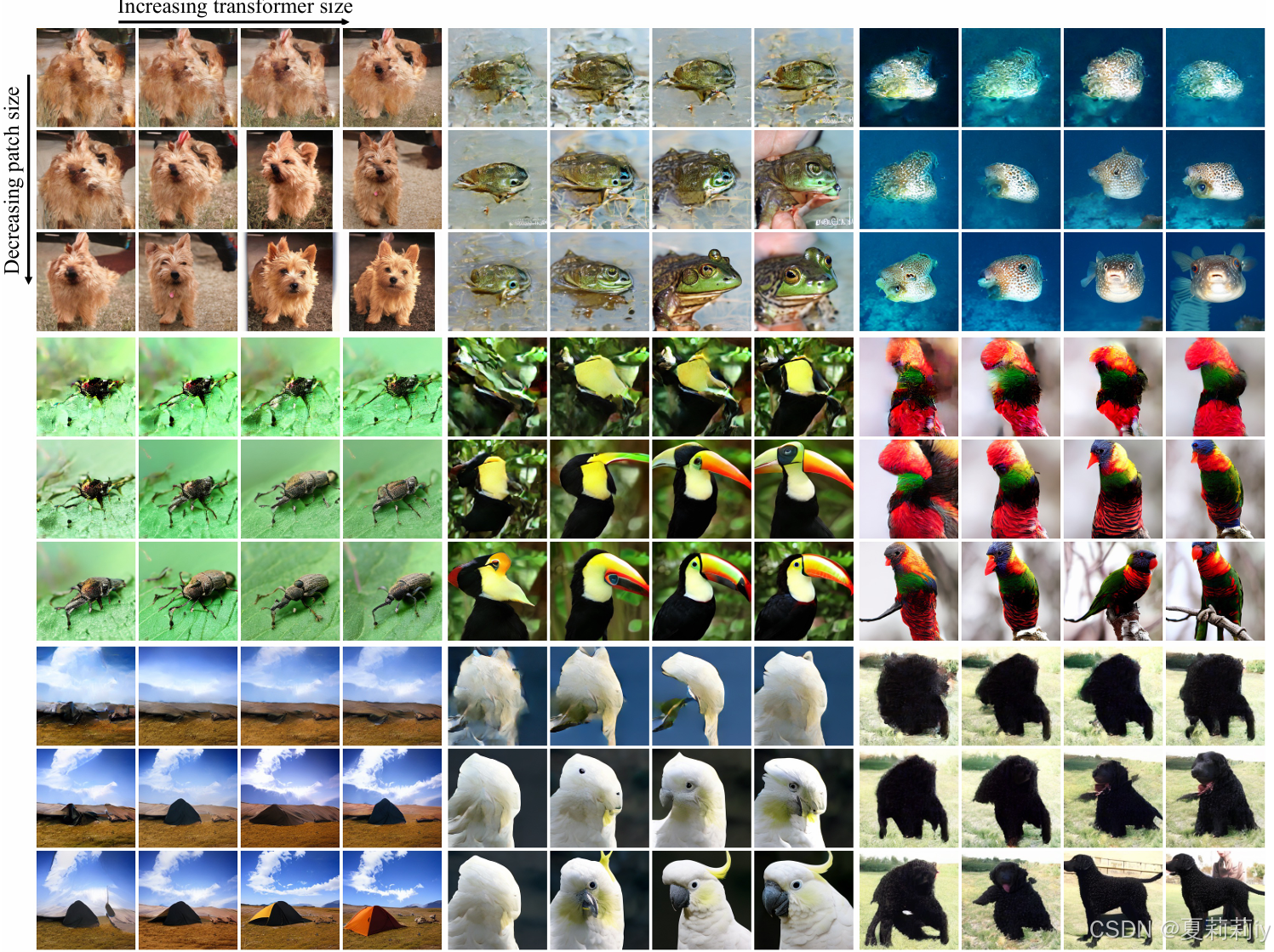

②不同模型大小和不同patch大小的对比:

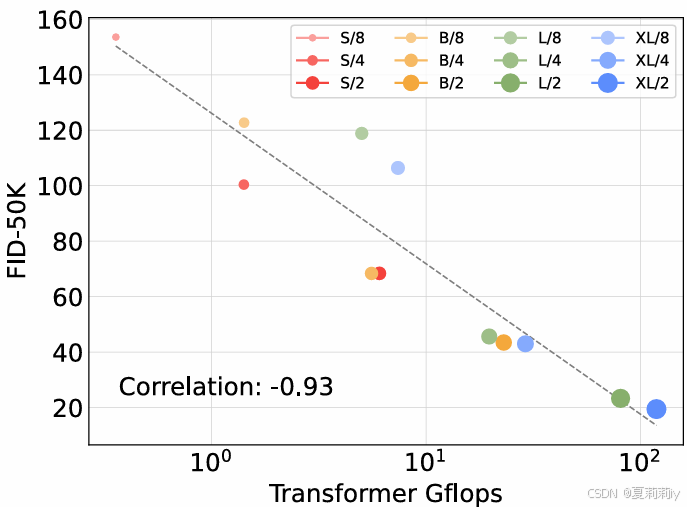

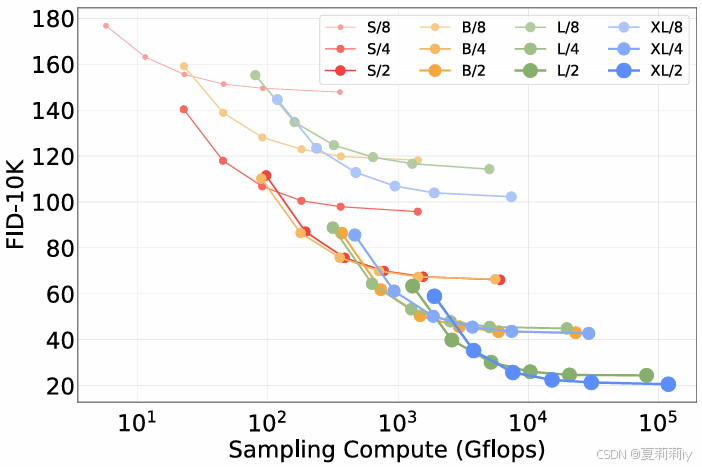

③不同模型设置的Gflops和精度比较:

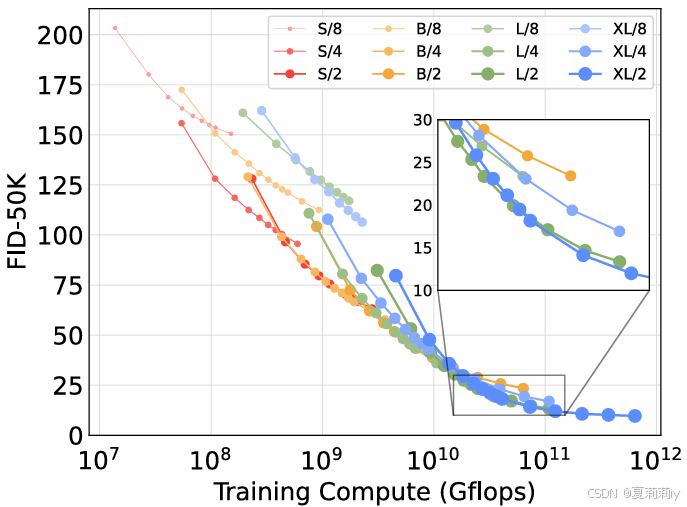

④比起上一个图,这个图记录了更多时间节点,可以看到斜率:

⑤缩放的影响:

2.6.1. State-of-the-Art Diffusion Models

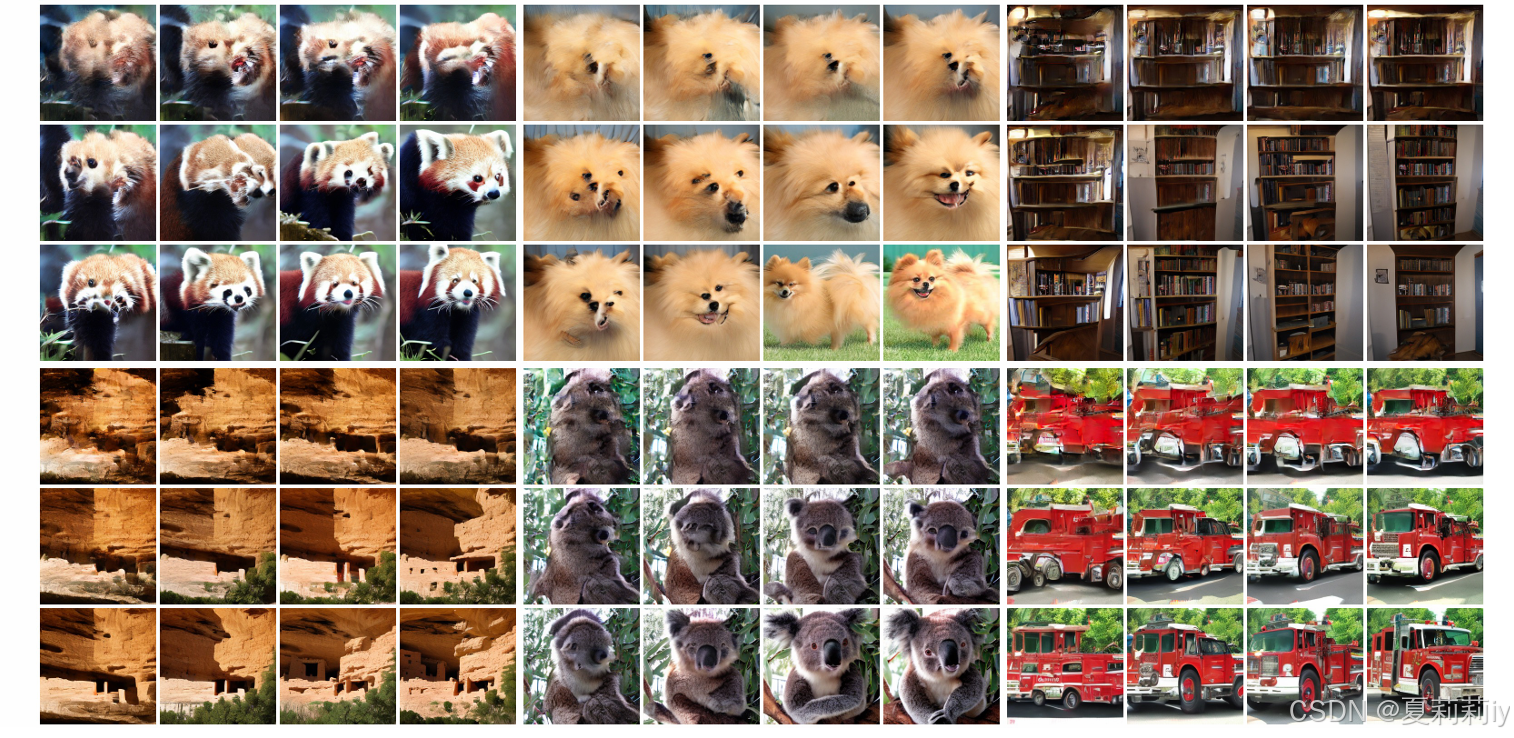

①模型效果示例:

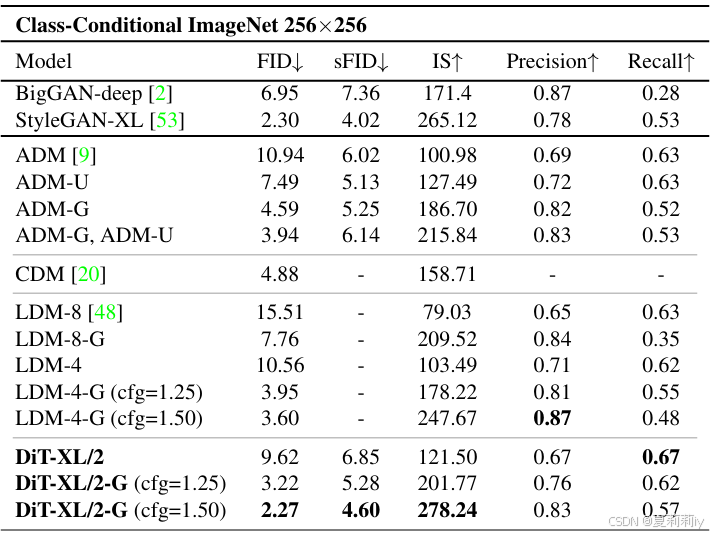

②在256×256图片上训练模型的对比表格:

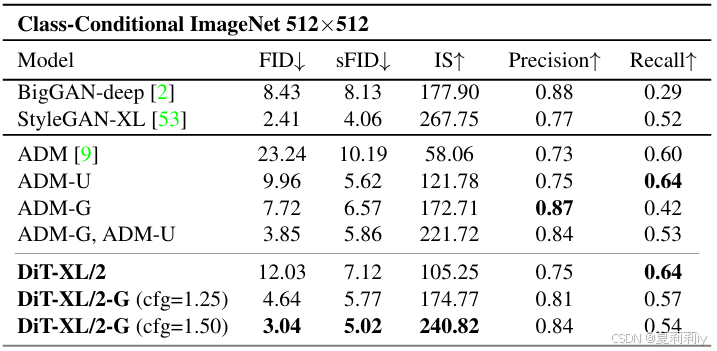

③在512×512图片上训练模型的对比表格:

2.6.2. Scaling Model vs. Sampling Compute

①不同规模模型的推理和结果:

2.7. Conclusion

~