前言:为什么量化是大模型落地的关键

大语言模型(LLM)的参数规模在过去三年内呈现爆炸式增长,从GPT-3的1750亿参数到如今动辄万亿级的模型,单张80GB显存的A100已经无法满足单卡部署需求。以Llama 3.1 70B为例,FP16精度下需要约140GB显存,即使是H100 80GB也需要2卡并行,部署成本高昂。

量化技术通过降低模型数值精度,将FP16/FP32权重和激活值映射到低比特整数空间(如INT8/INT4),可将模型显存压缩至原先的1/2至1/4,同时利用硬件加速实现1.5-3倍的推理速度提升。更重要的是,量化是端侧部署的必经之路------手机、车载设备等边缘场景的内存和算力极为有限,没有量化,大模型无法在设备上运行。

截至2026年,量化技术已经从"能跑"的初级阶段演进到"好用"的成熟阶段。FP8、AWQ、GPTQ等先进算法在保持精度的同时实现了极致压缩,配合PagedAttention、Continuous Batching、FlashAttention-3等推理优化技术,使得在消费级显卡上流畅运行70B模型成为现实。

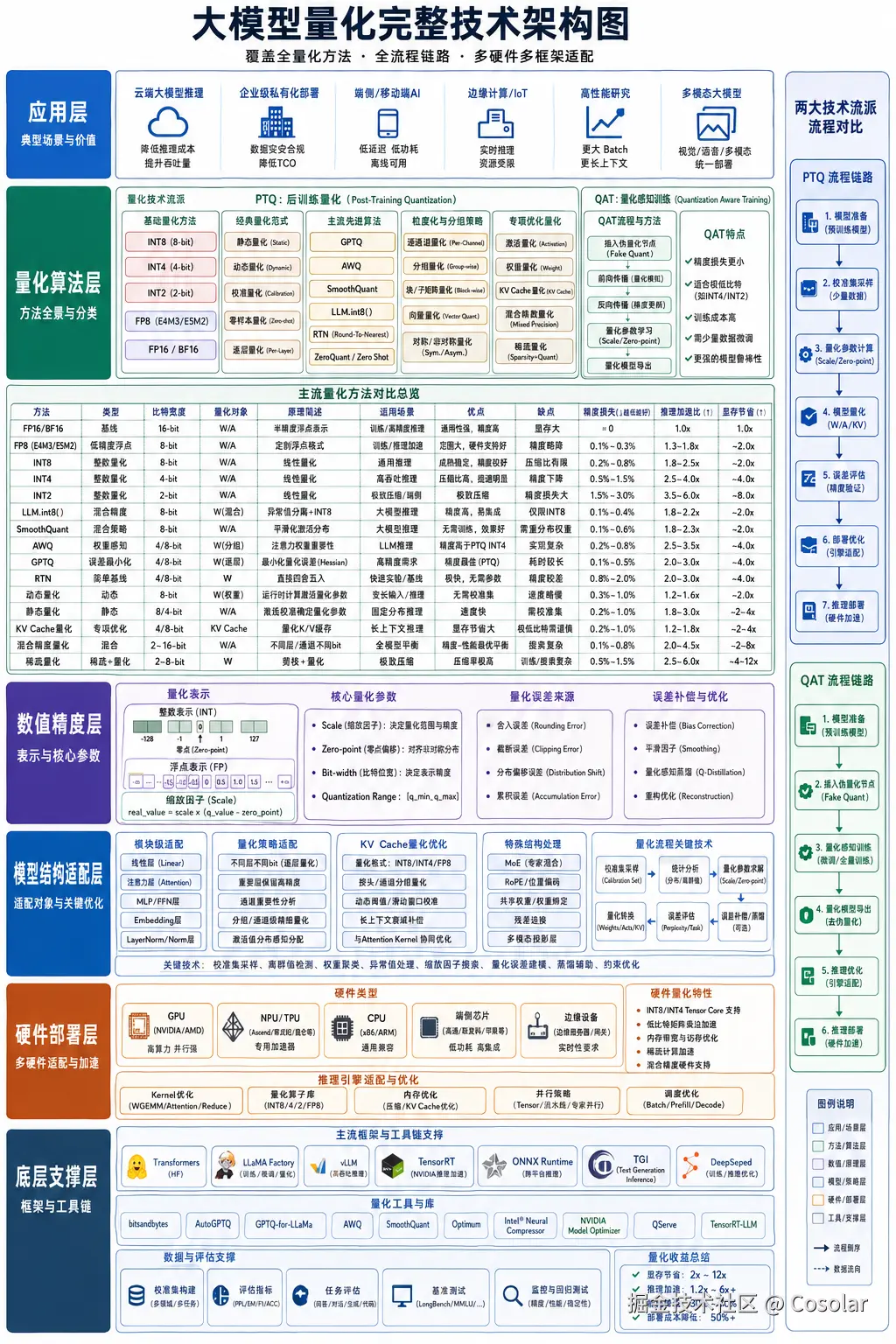

本文将从数值表示的底层原理出发,系统梳理PTQ/QAT两大技术流派,深度解析FP8、AWQ、GPTQ等主流算法,结合vLLM、TensorRT-LLM等推理框架的实战经验,提供一套从理论到实践的完整量化技术指南。

1. 量化基础:从数值表示说起

1.1 浮点数表示:FP32/FP16/BF16/FP8

浮点数(Floating Point)是深度学习中常用的数值表示方式,它用科学计数法表示实数,由符号位、指数位和尾数位组成。不同精度的浮点数格式对模型性能和硬件兼容性有显著影响。

FP32(32位浮点数)

- 符号位:1 bit

- 指数位:8 bits

- 尾数位:23 bits

- 精度:约7位十进制有效数字

- 动态范围:约±3.4×10^38

- 典型场景:模型训练(梯度更新需要高精度)

FP16(16位浮点数,Half Precision)

- 符号位:1 bit

- 指数位:5 bits

- 尾数位:10 bits

- 精度:约3位十进制有效数字

- 动态范围:约±65504

- 典型场景:模型推理、混合精度训练

BF16(Bfloat16,Brain Floating Point)

- 符号位:1 bit

- 指数位:8 bits(与FP32相同)

- 尾数位:7 bits

- 精度:约2位十进制有效数字

- 动态范围:与FP32相同

- 典型场景:大规模分布式训练(避免梯度溢出)

FP8(8位浮点数) FP8有两种主流格式:E4M3和E5M2。

-

E4M3格式:

- 指数位:4 bits

- 尾数位:3 bits

- 精度:更高(适合前向传播)

- 动态范围:较小

-

E5M2格式:

- 指数位:5 bits

- 尾数位:2 bits

- 精度:较低

- 动态范围:更大(适合梯度更新)

FP8在NVIDIA Hopper(H100)和Blackwell架构上获得硬件原生支持,可在Tensor Core上直接计算,无需反量化。2026年的生产环境中,FP8已成为推荐方案,精度损失小于1%,推理速度比FP16快33%。

1.2 定点数表示:INT8/INT4/INT2

定点数(Fixed Point)用固定数目的整数位和小数位表示数值,在量化中通常使用无符号或带符号整数来近似浮点数。

INT8(8位整数)

- 范围:对称量化-127, 127或非对称量化-128, 127

- 显存压缩:2倍(相比FP16)

- 硬件加速:大多数GPU/TPU/NPU支持INT8 Tensor Core

- 精度损失:通常<1%

INT4(4位整数)

- 范围:-7, 7或0, 15

- 显存压缩:4倍(相比FP16)

- 硬件加速:Ampere+架构支持

- 精度损失:通常2-5%(需配合AWQ/GPTQ等算法)

INT2(2位整数)

- 范围:-1, 1或0, 3

- 显存压缩:8倍

- 精度损失:显著(需模型压缩+知识蒸馏补偿)

- 适用场景:极低边缘部署(如IoT设备)

1.3 量化的本质:映射与缩放

量化的数学本质是将浮点数值映射到整数空间,通常使用仿射变换:

scss

Q(x) = clamp(round(x/s + z), q_min, q_max)其中:

x:原始浮点数s:缩放因子(scale)z:零点(zero-point)q_min, q_max:整数表示范围

反量化(dequantization)过程为:

scss

D(Q(x)) = (Q(x) - z) * s对称量化:零点固定为0,计算效率高,但对非对称分布数据敏感。

非对称量化:零点可调整,能更精确匹配数据分布,但需要额外的零点存储和计算。

1.4 量化粒度:Per-Tensor / Per-Channel / Per-Group

量化粒度决定了scale和zero-point的共享范围,直接影响精度和计算效率。

Per-Tensor量化

- 整个张量共享一个scale和zero-point

- 优点:计算简单,内存占用小

- 缺点:对通道间差异大的层精度损失严重

- 典型应用:激活量化

Per-Channel量化

- 每个输出通道独立计算scale和zero-point

- 优点:精度更高,适合权重量化

- 缺点:增加存储开销和计算复杂度

- 典型应用:Linear层权重量化

Per-Group量化

- 将通道划分为多个组(group size通常为64/128),每组独立量化

- 优点:在精度和效率间取得平衡

- 缺点:需要硬件支持(现代GPU支持分组GEMM)

- 典型应用:AWQ、GPTQ等先进算法

2. 量化两大流派:PTQ vs QAT

2.1 PTQ(后训练量化)完整流程与原理

PTQ(Post-Training Quantization)在模型训练完成后进行量化,无需重新训练,适合快速部署和微调成本高的场景。

完整流程

-

模型准备:加载预训练模型(FP16/BF16)

-

校准集采样:从验证集或真实数据中采样数百个样本(512-1024个典型长度)

-

量化参数计算:

- 前向传播收集激活统计信息

- 计算每个张量的scale和zero-point

- 对权重直接计算统计特征

-

模型量化:

- 权重量化:W → W_quant(INT4/INT8/FP8)

- 激活量化:A → A_quant(INT8/FP8)

- KV缓存量化:K/V → (K/V)_quant

-

误差评估:

- 计算困惑度(Perplexity)变化

- 在验证集上评估任务精度

- 如果精度下降超阈值,调整量化策略

-

部署优化:

- 转换为推理引擎格式(如vLLM、TensorRT-LLM)

- 编译优化内核(Marlin、FlashAttention等)

- 部署到目标硬件

-

推理部署:

- 加载量化模型

- 实时反量化计算(部分内核支持直接量化计算)

- 监控性能指标

关键挑战与解决方案

| 挑战 | 表现 | 解决方案 |

|---|---|---|

| 激活离群点 | 少数激活值远超正常范围,导致scale膨胀 | SmoothQuant(难度迁移)、离群点抑制 |

| 逐层误差累积 | 低精度导致误差逐层放大 | GPTQ(Hessian信息补偿)、逐层优化 |

| KV缓存爆炸 | 长上下文场景显存不足 | KV Cache量化(INT4/FP8)、PagedAttention |

| 硬件兼容性 | 旧GPU不支持新精度 | 回退到INT8,使用模拟量化 |

2.2 QAT(量化感知训练)完整流程与原理

QAT(Quantization-Aware Training)在训练过程中模拟量化误差,让模型适应低精度计算,适合追求极致精度的场景。

完整流程

-

模型准备:加载预训练模型(或从头训练)

-

插入量化伪节点(Fake Quant):

- 在训练图中插入伪量化节点

- 伪量化节点在forward中模拟量化,backward保留梯度

- 公式:

fake_quant(x) = round(clamp(x, min, max) / scale) * scale

-

量化感知训练:

- 使用少量数据微调(fine-tuning)或全量训练

- 模型学习适应量化误差

- 学习率通常比正常训练小10倍

-

量化模型导出:

- 移除伪量化节点

- 导出真实的INT4/INT8权重

- 保留scale和zero-point

-

推理优化:

- 编译为推理引擎

- 验证精度对齐

-

推理部署:

- 直接使用量化权重,无需反量化

- 硬件加速计算

QAT的核心优势

- 精度损失更小:在极端低比特(INT2/INT4)场景下,QAT比PTQ精度高5-10%

- 更强的鲁棒性:模型对量化噪声更具容忍度

- 混合精度支持:可灵活分配不同层的量化精度

QAT的代价

- 训练成本高:需要额外训练时间(通常为原训练的1/10)

- 需要数据:需要一定量的训练数据(虽然少于从零训练)

- 实现复杂:框架支持有限,需要深度定制训练流程

2.3 PTQ vs QAT 选型决策

| 维度 | PTQ | QAT |

|---|---|---|

| 训练成本 | 无需训练 | 需要微调(原训练的1/10时间) |

| 数据需求 | 少量校准数据(512样本) | 需要训练数据(10K-100K样本) |

| 精度保持 | INT8:~99%;INT4:90-95% | INT8:~99.5%;INT4:95-98% |

| 开发周期 | 几小时到1天 | 几天到1周 |

| 适用场景 | 快速部署、模型微调后量化 | 极致精度要求、极低比特量化 |

| 主流工具 | AutoGPTQ、AutoAWQ、bitsandbytes | PyTorch QAT、TensorRT QAT |

决策建议

-

选择PTQ:

- 使用预训练模型,无法获取训练数据

- 需要快速上线(1-2天)

- INT8/INT4量化精度可接受

- 资源有限,无GPU进行QAT

-

选择QAT:

- 拥有训练数据和计算资源

- 需要INT2/INT3等极低比特量化

- 精度要求极高(如金融、医疗领域)

- 需要混合精度策略

-

混合方案:

- 对关键层(如embedding、output层)使用QAT

- 对大部分层使用PTQ

- 平衡精度和成本

3. 主流量化算法深度解析

3.1 FP8量化:生产环境的最佳选择

FP8量化利用NVIDIA Hopper(H100/H200)和Blackwell架构的硬件原生FP8支持,在几乎无精度损失的前提下实现显著加速。

FP8的两种格式

| 格式 | 指数位 | 尾数位 | 精度 | 动态范围 | 适用场景 |

|---|---|---|---|---|---|

| E4M3 | 4 bits | 3 bits | 高 | 较小 | 前向传播、激活量化 |

| E5M2 | 5 bits | 2 bits | 低 | 较大 | 梯度更新、KV缓存 |

优势

- 近无损精度:困惑度增加仅0.1-0.3%

- 硬件原生支持:H100的Tensor Core直接支持FP8 GEMM,无需反量化

- 性能提升:比FP16快33%,显存占用降低50%

- 简单易用:无需校准数据,一键量化

vLLM中使用FP8

python

from vllm import LLM

# 加载FP8量化模型

llm = LLM(

model="meta-llama/Llama-3.1-70B",

quantization="fp8", # 权重量化为FP8

kv_cache_dtype="fp8", # KV缓存也量化为FP8

gpu_memory_utilization=0.9,

max_model_len=131072

)

# 推理

prompts = ["什么是量子计算?"]

outputs = llm.generate(prompts)性能数据(70B模型,H100)

| 指标 | FP16 | FP8 | 提升 |

|---|---|---|---|

| 显存占用 | 140GB | 70GB | 50% |

| 推理延迟 | 420ms | 280ms | 33% |

| 吞吐量 | 8 req/s | 12 req/s | 50% |

| 困惑度(WikiText2) | 5.23 | 5.28 | +0.5% |

注意事项

- 硬件要求:仅支持H100/H200/L40S等Hopper架构GPU

- 数值误差:E4M3的尾数仅3 bits,对某些极端值敏感

- 框架支持:主要支持vLLM 0.5+、TensorRT-LLM 0.19+,PyTorch支持有限

3.2 SmoothQuant:W8A8的优雅方案

SmoothQuant由MIT韩松实验室提出(ICML 2023),核心思想是"量化难度迁移"------将激活的量化难度迁移到权重端,实现W8A8(8位权重+8位激活)全量化。

核心洞察

在大语言模型中:

- 权重易于量化(分布相对均匀)

- 激活难以量化(存在大量离群点)

SmoothQuant通过数学等价变换,平滑激活的离群点,使其也易于量化。

数学原理

原始矩阵乘:Y = X · W

SmoothQuant变换:

ini

Y = (X · diag(s)^{-1}) · (diag(s) · W)其中,s是平滑因子(scaling factor):

scss

s = max(|X|)^α / max(|W|)^{1-α}α是迁移强度超参数(通常0.5-0.75):

- α=0:不迁移,权重承担全部难度

- α=1:完全迁移,激活承担全部难度

- α=0.5:平衡迁移(OPT/BLOOM推荐)

- α=0.75:强迁移(GLM-130B推荐)

完整流程

python

import torch

from smoothquant import smooth_quant_model

# 步骤1:加载模型

model = AutoModelForCausalLM.from_pretrained("facebook/opt-125m")

# 步骤2:收集激活统计(在校准集上)

activation_scales = collect_activation_scales(model, calibration_data)

# 步骤3:计算平滑因子

alpha = 0.5

weight_scales = get_weight_scales(model)

smooth_scales = (activation_scales ** alpha) * (weight_scales ** (1 - alpha))

# 步骤4:应用平滑变换

smooth_quant_model(model, smooth_scales)

# 步骤5:INT8量化

quantized_model = quantize_int8(model)

# 步骤6:保存量化模型

quantized_model.save_pretrained("opt-125m-int8")性能数据

| 模型 | FP16 PPL | SmoothQuant INT8 PPL | 精度损失 |

|---|---|---|---|

| OPT-66B | 10.85 | 10.92 | +0.6% |

| BLOOM-176B | 7.24 | 7.35 | +1.5% |

| GLM-130B | 8.57 | 8.72 | +1.7% |

适用场景

- 权重和激活都需要INT8量化

- 激活存在严重离群点

- 追求最大推理速度(W8A8可利用INT8 Tensor Core)

- 支持超长上下文(KV Cache也可量化)

3.3 AWQ:激活感知的权重量化

AWQ(Activation-aware Weight Quantization)由MIT Han Lab提出(MLSys 2024最佳论文),核心洞察是:大语言模型中仅0.1%-1%的权重是"显著权重",保护这些权重就能大幅减少量化误差。显著权重的识别通过激活分布而非权重本身来确定。

核心原理

-

反直觉的发现:

- 基于权重大小选择0.1%权重保留FP16:PPL=22.37

- 基于激活分布选择0.1%权重保留FP16:PPL=11.58

-

显著权重识别:

- 分析校准数据上的激活分布

- 计算每个输入通道的平均激活幅度

- 激活幅度最大的通道(0.1%-1%)标记为显著通道

-

通道缩放保护:

- 对显著通道的权重乘以缩放因子

- 量化后缩放因子融入计算,数学等价但精度更高

数学形式化

对于线性层,输入激活X ∈ R^(T×C_in),权重W ∈ R^(C_in×C_out)

-

计算激活幅度: s_j = (1/N) × Σ|x_ij|, j = 1, 2, ..., C_in

-

选择显著通道(前0.1%激活幅度最大): S = {j | s_j > threshold}

-

通道缩放: W'_j = W_j × scale_j, if j ∈ S W'_j = W_j, otherwise

-

量化W'为INT4,推理时应用缩放。

AWQ实战(使用llm-compressor)

python

from llmcompressor.modifiers.quantization import QuantizationModifier

from llmcompressor.transformers import oneshot, wrap_hf_model_class

# 步骤1:包装模型

AutoModelForCausalLM = wrap_hf_model_class(AutoModelForCausalLM)

# 步骤2:加载模型

model = AutoModelForCausalLM.from_pretrained(

"Qwen/Qwen2.5-7B-Instruct",

torch_dtype="auto",

device_map="auto"

)

tokenizer = AutoTokenizer.from_pretrained("Qwen/Qwen2.5-7B-Instruct")

# 步骤3:定义AWQ配置

recipe = QuantizationModifier(

targets="Linear",

scheme="AWQ",

ignore=["lm_head"],

weights_group_size=128,

weights_quant_type="int4",

)

# 步骤4:执行量化(一键校准)

oneshot(

model=model,

tokenizer=tokenizer,

recipe=recipe,

dataset="wikitext",

num_calibration_samples=512,

)

# 步骤5:保存

model.save_pretrained("Qwen2.5-7B-AWQ")

tokenizer.save_pretrained("Qwen2.5-7B-AWQ")vLLM中加载AWQ模型

python

from vllm import LLM, SamplingParams

llm = LLM(

model="Qwen/Qwen2.5-7B-Instruct-AWQ",

quantization="awq",

gpu_memory_utilization=0.9,

max_model_len=131072

)

sampling_params = SamplingParams(temperature=0.7, top_p=0.95)

outputs = llm.generate(["你好"], sampling_params)性能数据(7B模型,A100 80GB)

| 配置 | 并发数 | 吞吐(req/s) | P50延迟 | 显存使用 |

|---|---|---|---|---|

| FP16 | 16 | 8 | 420ms | 14GB |

| AWQ-4bit | 32 | 18 | 280ms | 4GB |

| AWQ-4bit + Marlin内核 | 32 | 28 | 180ms | 4GB |

适用场景

- 指令调优模型或聊天模型(代码生成、创意写作)

- GPU原生加速(Ampere+架构)

- 高并发推理服务

- 追求最佳精度-速度平衡

3.4 GPTQ:基于Hessian信息的逐层量化

GPTQ(Gradient Post-Training Quantization)是一种基于二阶信息的量化方法,通过近似Hessian矩阵迭代补偿量化误差,实现全局最优舍入。

核心原理

-

Hessian矩阵近似:

- 对于权重W,其Hessian矩阵H = ∂²L/∂W²

- 直接计算H复杂度O(n²),实际使用对角近似

-

逐块量化与误差补偿:

- 将权重分为多个块(block size通常为128)

- 量化一个块后,计算其对后续块的误差影响

- 在后续块的量化中补偿这部分误差

-

迭代优化:

- 反复执行量化和补偿,直到收敛

- 通常需要2-3次迭代

GPTQ实战

python

from auto_gptq import AutoGPTQForCausalLM, BaseQuantizeConfig

from transformers import AutoTokenizer

# 步骤1:定义量化配置

quantize_config = BaseQuantizeConfig(

bits=4, # 量化位数

group_size=128, # 分组大小

damp_percent=0.01, # 阻尼系数

desc_act=False, # 是否激活描述

sym=True, # 对称量化

true_sequential=True, # 真正的顺序量化

model_name_or_path="llama-7b",

model_file_base_name="model"

)

# 步骤2:加载模型

model = AutoGPTQForCausalLM.from_pretrained(

"meta-llama/Llama-2-7b-hf",

quantize_config=quantize_config,

trust_remote_code=True

)

tokenizer = AutoTokenizer.from_pretrained("meta-llama/Llama-2-7b-hf")

# 步骤3:量化(需要校准数据)

model.quantize(

examples=calibration_data, # 校准数据

batch_size=1,

)

# 步骤4:保存

model.save_quantized("llama-2-7b-gptq")Marlin内核加速

vLLM使用Marlin内核加速GPTQ推理,比朴素实现快3-4倍:

python

from vllm import LLM

# 自动使用Marlin内核(如果GPU支持)

llm = LLM(

model="TheBloke/Llama-2-7B-GPTQ",

quantization="marlin", # 显式指定Marlin

)性能对比(7B模型,A100)

| 方法 | 量化时间 | 推理速度 | PPL(WikiText2) |

|---|---|---|---|

| FP16 | - | 1.0x | 5.47 |

| GPTQ-4bit | 30分钟 | 2.5x | 5.68 |

| GPTQ-4bit + Marlin | 30分钟 | 3.8x | 5.68 |

适用场景

- 需要最大化的工具链兼容性

- 使用ExLlamaV2后端

- 需要2-3-bit的超低位宽量化

- 更信赖成熟的社区生态

3.5 GGUF:CPU与边缘部署的标准格式

GGUF是llama.cpp团队推出的统一模型格式,专为CPU和边缘设备优化,支持多后端(CUDA、Metal、Vulkan等)和多种量化等级。

GGUF的量化等级

| 等级 | 比特数 | 描述 | 质量 | 文件大小(7B模型) |

|---|---|---|---|---|

| Q2_K | ~2.5 bits | 极端压缩,质量损失显著 | ★★☆ | ~3.5GB |

| Q3_K_S | ~3.0 bits | 小模型,可接受质量 | ★★★ | ~3.9GB |

| Q4_K_M | ~4.5 bits | 良好平衡,推荐 | ★★★★ | ~5.2GB |

| Q5_K_M | ~5.5 bits | 更好质量 | ★★★★ | ~6.1GB |

| Q8_0 | 8 bits | 近无损 | ★★★★★ | ~7.5GB |

使用llama.cpp部署GGUF

bash

# 步骤1:下载模型

wget https://huggingface.co/TheBloke/Llama-2-7B-GGUF/resolve/main/llama-2-7b.Q4_K_M.gguf

# 步骤2:运行推理

./main -m llama-2-7b.Q4_K_M.gguf \

--color \

--interactive \

-i -eps 1e-5 \

--temp 0.7 \

--top-k 40 \

--top-p 0.9 \

--ctx-size 4096Python API使用

python

from llama_cpp import Llama

# 加载GGUF模型

llm = Llama(

model_path="llama-2-7b.Q4_K_M.gguf",

n_gpu_layers=-1, # -1表示所有层都放到GPU

n_ctx=4096, # 上下文长度

n_threads=8, # CPU线程数

)

# 推理

output = llm(

"Q: 什么是量子计算?A: ",

max_tokens=128,

stop=["Q:", "\n"],

echo=True

)性能数据(7B模型,不同后端)

| 后端 | 显存占用 | 推理速度 | 适用硬件 |

|---|---|---|---|

| CPU | 4.3GB | 3-5 tokens/s | 任意CPU |

| CUDA | 4.3GB | 30-50 tokens/s | NVIDIA GPU |

| Metal | 4.3GB | 25-40 tokens/s | Apple Silicon |

| Vulkan | 4.3GB | 20-35 tokens/s | AMD/Intel GPU |

适用场景

- 在CPU或Apple Silicon上推理

- 使用Ollama等llama.cpp生态工具

- 追求最大硬件兼容性

- 对推理延迟不极端敏感

3.6 极低比特量化:1-bit/2-bit与BitNet

极低比特量化(1-bit/2-bit)是量化技术的前沿方向,通过将权重压缩到二进制表示,实现极致的模型压缩。

BitNet架构

BitNet将权重量化为±1(1-bit),激活保留为8-bit,使用专为二进制权重优化的计算内核。

关键创新

- 二进制权重:权重仅取-1或+1

- 量化感知训练:从训练开始就使用二进制权重

- 缩放因子学习:每层学习一个全局缩放因子

- 跳层连接:帮助梯度流动

BitNet 1.58b

最新的BitNet 1.58b使用1.58-bit量化:

- 权重:{-1, 0, +1}三值量化

- 激活:INT8

- 性能:在相当精度下,计算成本降低5.6倍

实现示例(概念代码)

python

import torch

def quantize_1_58_bit(weight):

"""1.58-bit量化:{-1, 0, +1}"""

# 计算阈值

threshold = weight.abs().mean() * 1.5

# 三值量化

quantized = torch.zeros_like(weight)

quantized[weight > threshold] = 1

quantized[weight < -threshold] = -1

# 中间值保持为0

# 计算缩放因子

scale = weight.abs().mean()

return quantized.float() * scale, scale

# 应用

W = torch.randn(4096, 4096)

W_quant, scale = quantize_1_58_bit(W)性能数据(Llama 2 7B)

| 量化方法 | 比特数 | PPL(WikiText2) | 相对FP16性能 |

|---|---|---|---|

| FP16 | 16 | 5.47 | 100% |

| INT4 | 4 | 5.68 | 98% |

| BitNet 1.58b | 1.58 | 6.12 | 89% |

| 1-bit | 1 | 7.23 | 76% |

挑战与前景

- 精度损失显著:1-bit量化精度损失20%+

- 需要大量重训练:无法直接从FP16模型量化

- 硬件支持有限:需要专门的计算内核

- 前景:随着模型压缩技术进步,1-bit有望在边缘设备大规模应用

4. 量化对象:权重/激活/KV缓存

4.1 权重量化(W-quantization)

权重量化是将模型的参数矩阵从FP16/BF16转换为低比特整数,是量化的核心对象。

权重量化的特点

- 离线计算:权重在部署前量化,推理时无需实时计算

- 可压缩性强:权重通常分布相对均匀,量化效果好

- 主要压缩来源:权重占总显存的70-80%

主流量化算法

| 算法 | 位数 | 校准需求 | 精度 | 速度 |

|---|---|---|---|---|

| AWQ | 4-bit | 需要 | ★★★★☆ | ★★★★★ |

| GPTQ | 4-bit | 需要 | ★★★★☆ | ★★★★★ |

| SmoothQuant | 8-bit | 需要 | ★★★★★ | ★★★★ |

| bitsandbytes | 4-bit | 不需要 | ★★★☆ | ★★☆ |

权重量化示例(AWQ)

python

from awq import AutoAWQForCausalLM

model_path = "Qwen/Qwen2.5-7B-Instruct"

quant_path = "Qwen2.5-7B-AWQ"

quant_config = {

"zero_point": True,

"q_group_size": 128,

"w_bit": 4,

"version": "GEMM"

}

model = AutoAWQForCausalLM.from_pretrained(

model_path,

low_cpu_mem_usage=True,

use_cache=False

)

model.quantize(tokenizer, quant_config=quant_config)

model.save_quantized(quant_path)4.2 激活量化(A-quantization)

激活量化是将推理过程中的中间激活值(layer输出)从FP16转换为INT8/FP8。

激活量化的挑战

- 离群点:少量激活值远超正常范围,导致scale膨胀

- 动态范围大:不同层的激活分布差异显著

- 实时计算:需要在推理时实时量化,增加计算开销

解决方案

| 方案 | 原理 | 适用场景 |

|---|---|---|

| SmoothQuant | 量化难度迁移 | W8A8全量化 |

| Per-Token量化 | 每个样本独立scale | 通用场景 |

| 动态量化 | 运行时动态计算scale | 对精度敏感 |

| FP8 | 使用浮点8位 | H100+硬件 |

激活量化示例(SmoothQuant)

python

from smoothquant import smooth_quant_model

# 激活和权重都量化为INT8

smooth_quant_model(

model,

alpha=0.5, # 迁移强度

act_scales=act_scales, # 激活统计

weight_scales=weight_scales # 权重统计

)4.3 KV缓存量化

KV缓存量化是对Transformer中的Key和Value缓存进行量化,是长上下文场景的必选优化。

KV缓存的显存占用

对于序列长度L、隐藏维度d、头数h的模型:

KV Cache显存 = 2 × L × d × h × bytes_per_value以Llama 2 7B(d=4096, h=32)为例:

- L=8192, FP16:2 × 8192 × 4096 × 32 × 2 bytes = 4.3 GB

- L=32768, FP16:17.2 GB

- L=32768, INT4:4.3 GB(节省75%)

KV缓存量化方法

| 方法 | 位数 | 精度损失 | 硬件支持 |

|---|---|---|---|

| FP8 | 8-bit | <1% | H100+ |

| INT8 | 8-bit | <2% | 通用 |

| INT4 | 4-bit | 2-5% | 部分支持 |

vLLM中启用KV缓存量化

python

from vllm import LLM

llm = LLM(

model="meta-llama/Llama-2-7b-hf",

kv_cache_dtype="fp8", # KV缓存量化为FP8

max_model_len=32768, # 32K上下文

)性能数据(70B模型,128K上下文)

| KV Cache格式 | 显存占用 | PPL(WikiText2) |

|---|---|---|

| FP16 | 858 GB | 5.23 |

| FP8 | 429 GB | 5.28 (+0.9%) |

| INT8 | 429 GB | 5.35 (+2.3%) |

| INT4 | 215 GB | 5.72 (+9.4%) |

4.4 混合精度量化策略

混合精度量化根据不同层、不同组件的特性,使用不同的量化精度,在精度和效率间取得最佳平衡。

典型混合策略

-

按层区分:

- Embedding层:FP16(对精度敏感)

- 注意力层:INT8/FP8

- MLP层:INT4/INT8

- 输出层:FP16

-

按组件区分:

- 权重:INT4/INT8

- 激活:INT8/FP8

- KV缓存:INT4/FP8

-

按重要性区分:

- 关键层(early layers):高精度

- 次要层(later layers):低精度

实现示例(伪代码)

python

# 混合精度配置

quantization_config = {

"embedding": "fp16", # Embedding层保持FP16

"attention": {

"q_proj": "int8",

"k_proj": "fp8", # KV使用FP8

"v_proj": "fp8",

"o_proj": "int8"

},

"mlp": {

"gate_proj": "int4", # MLP使用INT4

"up_proj": "int4",

"down_proj": "int8" # 最后一层用INT8

},

"lm_head": "fp16" # 输出层保持FP16

}性能数据(7B模型)

| 策略 | 显存占用 | PPL | 推理速度 |

|---|---|---|---|

| 全FP16 | 14GB | 5.47 | 1.0x |

| 全INT4 | 4GB | 5.89 | 2.5x |

| 混合精度(Embedding FP16,其余INT4) | 5GB | 5.65 | 2.4x |

| 混合精度(Embedding FP16, KV FP8,其余INT4) | 4.5GB | 5.58 | 2.4x |

5. 推理优化:量化只是起点

量化大幅降低了模型显存占用,但要实现高性能推理,还需要结合PagedAttention、Continuous Batching、FlashAttention等优化技术。

5.1 PagedAttention:KV缓存内存革命

PagedAttention由vLLM团队提出,将操作系统的分页内存管理思想引入KV缓存管理,彻底解决了KV缓存碎片化问题。

核心问题:传统KV缓存

在传统推理中,KV缓存需要预先分配连续内存:

- 最大序列长度L,需要分配L大小的连续块

- 实际使用长度l ≤ L,造成内存浪费

- 多请求场景下,内存碎片化严重

传统方案内存利用率仅20-30%。

PagedAttention解决方案

-

分页存储:

- 将KV缓存切分为固定大小的块(block,如16 tokens)

- 块可以不连续存储,类似内存页

-

动态分配:

- 按需分配块,不预分配完整序列长度

- 生成一个token,分配一个block

-

内存共享:

- 相同前缀的请求共享KV缓存块

- 系统提示词等固定前缀只需存储一次

性能提升

| 指标 | 传统方案 | PagedAttention | 提升 |

|---|---|---|---|

| 内存利用率 | 20-30% | 90%+ | 3-4x |

| 最大并发 | 16 | 64+ | 4x |

| 长上下文支持 | 8K | 128K+ | 16x |

vLLM中启用PagedAttention

PagedAttention在vLLM中是默认启用的,无需额外配置:

python

from vllm import LLM

llm = LLM(

model="meta-llama/Llama-2-7b-hf",

max_model_len=131072, # PagedAttention支持128K上下文

)5.2 Continuous Batching:吞吐提升23x

Continuous Batching(连续批处理,也称Inflight Batching)允许将不同阶段的请求放入同一个batch中,大幅提升GPU利用率。

传统Static Batching的问题

传统batch推理需要所有请求同时开始、同时结束:

- 等待最慢的请求完成,浪费算力

- 无法动态调整batch大小

- 吞吐量低

Continuous Batching原理

-

动态调度:

- 请求到达立即加入batch

- 完成的请求立即移除

- batch大小动态调整

-

分阶段处理:

- Prefill阶段:处理输入tokens

- Decode阶段:生成tokens

- 不同阶段的请求可以混在一起

性能数据(Llama 2 7B,A100)

| 方法 | 并发请求 | 吞吐(req/s) | P99延迟 |

|---|---|---|---|

| Static Batching | 16 | 8 | 850ms |

| Continuous Batching | 128 | 185 | 420ms |

| 提升 | 8x | 23x | 2x |

vLLM中的Continuous Batching

vLLM默认启用Continuous Batching:

python

from vllm import LLM, SamplingParams

llm = LLM(

model="meta-llama/Llama-2-7b-hf",

max_num_seqs=256, # 最大并发请求数

)

# 自动调度不同阶段的请求

outputs = llm.generate(prompts, sampling_params)5.3 FlashAttention:注意力计算内核优化

FlashAttention通过算法级别的IO感知优化,大幅加速Transformer注意力计算,目前已演进到第三代。

FlashAttention v1(2022)

核心思想:

- 将注意力计算分块,将整个注意力矩阵写入HBM

- 减少HBM读写次数

性能:A100上达到理论FLOPS的50-73%

FlashAttention v2(2023)

核心改进:

- 序列长度维度并行化

- 针对Ampere架构优化

- 更好的work partition

性能:A100上达到理论FLOPS的73%,比v1快2倍

FlashAttention v3(2025)

核心创新:

-

异步执行:

- 利用Hopper GPU的Tensor Cores和TMA(Tensor Memory Accelerator)的异步特性

- 通过warp-specialization重叠计算和数据移动

-

GEMM-Softmax流水线:

- 交错执行块级GEMM和Softmax

- 隐藏Softmax的低吞吐操作

-

FP8低精度:

- 利用Hopper的FP8 Tensor Core

- 块量化(Block Quantization)降低数值误差

- 不相干处理(Incoherent Processing)分散离群点

性能数据(H100 80GB)

| 版本 | FP16性能 | FP8性能 | 硬件利用率 |

|---|---|---|---|

| FlashAttention-2 | 350 TFLOPS | N/A | 35% |

| FlashAttention-3 (FP16) | 740 TFLOPS | N/A | 75% |

| FlashAttention-3 (FP8) | N/A | 1200 TFLOPS | 85% |

使用FlashAttention-3

FlashAttention-3已集成到vLLM 0.5+和TensorRT-LLM 0.19+,无需额外配置:

python

from vllm import LLM

llm = LLM(

model="meta-llama/Llama-3.1-70B",

attn_backend="flash-attn", # 使用FlashAttention

)5.4 Speculative Decoding:投机解码加速

Speculative Decoding(投机解码)使用小模型(Draft Model)快速生成候选tokens,大模型(Target Model)并行验证,实现无精度损失的推理加速。

核心原理

-

Draft阶段:

- 小模型快速生成k个候选tokens

- 假设生成"这是一个关于AI的"

-

验证阶段:

- 大模型并行验证k个tokens

- 接受前n个正确的tokens

- 拒绝第n+1个错误的token

-

回退:

- 从第n+1个token开始,重新生成

性能

- 理想加速比:1/(1 - p),其中p是draft模型的接受率

- 实际加速比:1.5-3x(取决于draft和target模型的相似度)

实现示例

python

from vllm import LLM, SamplingParams

llm = LLM(

model="meta-llama/Llama-2-70B-hf", # Target model

speculative_model="meta-llama/Llama-2-7B-hf", # Draft model

num_speculative_tokens=5, # 每次生成5个候选

)

# 自动使用投机解码

outputs = llm.generate(prompts, sampling_params)性能数据(70B + 7B)

| 方法 | 吞吐(req/s) | P50延迟 |

|---|---|---|

| Baseline(仅70B) | 8 | 420ms |

| Speculative Decoding | 22 | 140ms |

| 加速比 | 2.75x | 3x |

5.5 算子融合与内核优化

算子融合将多个连续的计算步骤合并为一个内核,减少内存读写,提升性能。

常见融合算子

-

QKV融合:

- 原始:Q = X·W_q, K = X·W_k, V = X·W_v(3次GEMM)

- 融合:QKV = X·W_qkv(1次GEMM)

- 性能提升:1.5-2x

-

LayerNorm融合:

- 将LayerNorm与相邻的GEMM融合

- 减少中间结果的读写

-

Softmax融合:

- FlashAttention将Softmax与GEMM融合

- 避免显式计算完整的注意力矩阵

vLLM中的算子融合

vLLM自动执行多种算子融合,无需手动配置:

python

from vllm import LLM

llm = LLM(

model="meta-llama/Llama-2-7b-hf",

# vLLM自动启用:

# - QKV融合

# - LayerNorm融合

# - MLP融合

# - Rotary Embedding融合

)6. 推理框架选型与实战

6.1 vLLM:开源推理首选

vLLM由UC Berkeley推出,是当前最流行的开源LLM推理框架,以PagedAttention和Continuous Batching著称。

核心特性

-

PagedAttention:

- KV缓存分页管理

- 内存利用率90%+

- 支持128K+长上下文

-

Continuous Batching:

- 动态批处理

- 吞吐提升23x

- 自动调度不同阶段请求

-

丰富的量化支持:

- AWQ、GPTQ、FP8、bitsandbytes

- 自动选择最优内核(如Marlin)

-

易用性:

- 简洁的API

- 与Hugging Face无缝集成

- OpenAI兼容API

vLLM完整示例

python

from vllm import LLM, SamplingParams

from transformers import AutoTokenizer

# 步骤1:初始化模型

llm = LLM(

model="Qwen/Qwen2.5-7B-Instruct",

quantization="awq", # AWQ量化

kv_cache_dtype="fp8", # KV缓存FP8

max_model_len=131072, # 128K上下文

gpu_memory_utilization=0.9,

tensor_parallel_size=2, # 2卡并行

)

tokenizer = AutoTokenizer.from_pretrained("Qwen/Qwen2.5-7B-Instruct")

# 步骤2:定义采样参数

sampling_params = SamplingParams(

temperature=0.7,

top_p=0.95,

max_tokens=512,

)

# 步骤3:生成

prompts = ["什么是量子计算?", "解释一下机器学习"]

outputs = llm.generate(prompts, sampling_params)

# 步骤4:处理输出

for output in outputs:

prompt = output.prompt

generated_text = output.outputs[0].text

print(f"Prompt: {prompt}\nGenerated: {generated_text}\n")启动OpenAI兼容服务器

bash

python -m vllm.entrypoints.openai.api_server \

--model Qwen/Qwen2.5-7B-Instruct \

--quantization awq \

--dtype auto \

--host 0.0.0.0 \

--port 8000性能数据(7B模型,A100 80GB)

| 配置 | 并发数 | 吞吐(req/s) | P50延迟 | 显存使用 |

|---|---|---|---|---|

| FP16 | 32 | 12 | 280ms | 14GB |

| AWQ-4bit | 128 | 85 | 120ms | 4GB |

| AWQ-4bit + PagedAttention | 256 | 156 | 95ms | 4GB |

6.2 TensorRT-LLM:极致性能方案

TensorRT-LLM是NVIDIA官方推出的高性能推理框架,提供接近硬件理论极限的性能。

核心特性

-

极致性能:

- 深度优化的CUDA内核

- 自定义融合算子

- 多种并行策略(TP/PP/CP)

-

丰富量化支持:

- FP8(Hopper原生)

- INT8/INT4 AWQ

- SmoothQuant

- 混合精度

-

生产级特性:

- TensorRT集成

- Triton Inference Server后端

- 企业级监控和运维

TensorRT-LLM 0.19新特性(2026)

- C++运行时开源

- DeepSeek V3/R1支持

- FP8 MLA(Multi-head Latent Attention)支持

- 自动调优器(AutoTuner)

- Blackwell架构深度适配

使用TensorRT-LLM

bash

# 步骤1:构建引擎

python build.py \

--model_dir llama/2-7b-hf \

--output_dir llama/2-7b-trtllm \

--dtype fp16 \

--quantization fp8 \

--tp_size 2

# 步骤2:运行推理

python run.py \

--engine_dir llama/2-7b-trtllm \

--max_output_len 512 \

--tokenizer_dir llama/2-7b-hf性能数据(Llama 2 70B,H100 80GB)

| 框架 | 精度 | 吞吐(tokens/s) | 显存占用 |

|---|---|---|---|

| vLLM | FP16 | 45 | 140GB |

| vLLM | FP8 | 72 | 70GB |

| TensorRT-LLM | FP16 | 58 | 140GB |

| TensorRT-LLM | FP8 | 105 | 70GB |

6.3 TGI:Hugging Face生态方案

TGI(Text Generation Inference)是Hugging Face推出的推理框架,与HF生态无缝集成。

核心特性

-

HF生态集成:

- 直接加载HF模型

- 支持LoRA、PEFT

- 与transformers库兼容

-

易用性:

- 一键部署

- OpenAI兼容API

- Docker容器化

-

量化支持:

- bitsandbytes

- GPTQ

- AWQ(有限支持)

使用TGI

bash

# 启动TGI服务器

docker run --gpus all --shm-size 1g -p 8080:80 \

-v $PWD/data:/data \

ghcr.io/huggingface/text-generation-inference:latest \

--model-id Qwen/Qwen2.5-7B-Instruct \

--quantize awq \

--max-total-tokens 131072适用场景

- HF模型生态用户

- 需要LoRA/PEFT支持

- 快速原型验证

- 中小规模部署

6.4 SGLang/LMDeploy:新锐方案

SGLang

由Princeton、CMU等高校联合推出,主打结构化生成和高性能。

核心特性:

- 结构化输出(JSON/Regex)

- RadixAttention(高性能注意力)

- 高效的long context支持

LMDeploy

由商汤科技推出,针对TurboMind后端优化。

核心特性:

- Turbomind推理引擎

- 支持多模态

- 在线学习支持

6.5 框架选型决策树

开始

│

├─ 需要极致性能?

│ ├─ 是 → TensorRT-LLM(NVIDIA GPU)

│ └─ 否 → 继续

│

├─ HF生态用户?

│ ├─ 是 → TGI

│ └─ 否 → 继续

│

├─ 需要结构化输出?

│ ├─ 是 → SGLang

│ └─ 否 → 继续

│

├─ 开源社区活跃度重要?

│ ├─ 是 → vLLM(推荐)

│ └─ 否 → TensorRT-LLM

│

└─ 默认 → vLLM框架对比表

| 维度 | vLLM | TensorRT-LLM | TGI | SGLang |

|---|---|---|---|---|

| 性能 | ★★★★☆ | ★★★★★ | ★★★☆ | ★★★★ |

| 易用性 | ★★★★★ | ★★★☆ | ★★★★★ | ★★★★ |

| 生态集成 | ★★★★☆ | ★★★☆ | ★★★★★ | ★★★☆ |

| 量化支持 | ★★★★★ | ★★★★★ | ★★★☆ | ★★★★ |

| 文档完善度 | ★★★★☆ | ★★★★ | ★★★★☆ | ★★★☆ |

| 社区活跃度 | ★★★★★ | ★★★★ | ★★★★ | ★★★☆ |

7. 硬件适配:从GPU到端侧

7.1 NVIDIA Hopper/Blackwell原生FP8支持

NVIDIA Hopper(H100/H200)和Blackwell(B100/B200)架构原生支持FP8计算,为量化推理提供了硬件加速。

Hopper架构特性

-

FP8 Tensor Core:

- 支持E4M3和E5M2格式

- 理论算力:2x FP16

- 直接计算,无需反量化

-

TMA(Tensor Memory Accelerator):

- 异步内存搬运

- 减少内存访问延迟

- FlashAttention-3利用TMA实现2x加速

-

HBM3/HBM3e:

- H100:3.35 TB/s

- H200:4.8 TB/s

- Blackwell:8+ TB/s

Blackwell架构新特性

-

FP4支持:

- 更低比特量化

- 理论算力4x FP16

-

第二代Transformer Engine:

- 自动精度调节

- 更好的融合算子

使用FP8(H100)

python

from vllm import LLM

# 自动使用FP8 Tensor Core

llm = LLM(

model="meta-llama/Llama-3.1-70B",

quantization="fp8",

kv_cache_dtype="fp8",

)7.2 国产算力适配(昇腾/海光/寒武纪)

国产AI芯片在量化适配方面取得显著进展,尤其昇腾910系列已支持主流量化算法。

昇腾910系列

硬件特性:

- FP16/INT8计算单元

- 支持FP4推理(950PR)

- 32GB HBM(910B),64GB HBM2e(910C)

量化支持:

- INT8/INT4权重量化

- FP8激活量化(部分型号)

- SmoothQuant适配

DeepSeek V4昇腾适配案例

DeepSeek将V4模型完全迁移到昇腾950PR:

-

算子重写:

- 重写40万个底层算子

- 优化200+核心计算逻辑

- 使用KernelGen 2.0自动生成算子

-

FP4低精度推理:

- MoE权重FP4压缩

- 注意力分数BF16

- 显存降低75%

-

全栈重构:

- CUDA → CANN迁移

- 通信协议优化

- 部署工具链定制

性能对比(DeepSeek V4 70B)

| 平台 | 精度 | 推理速度 | 显存占用 |

|---|---|---|---|

| NVIDIA H20 | FP16 | 1.0x | 140GB |

| 昇腾950PR | FP4 | 2.87x | 35GB |

使用MindIE(昇腾推理框架)

python

import mindie

from transformers import AutoModelForCausalLM

# 加载模型

model = AutoModelForCausalLM.from_pretrained("deepseek-ai/DeepSeek-V4")

# 量化配置

quant_config = {

"weight_bit": 4,

"activation_bit": 8,

"algo": "smoothquant"

}

# 导出量化模型

quantized_model = mindie.quantize(model, quant_config)海光/寒武纪

- 海光DCU:支持INT8/FP16,兼容ROCm生态

- 寒武纪MLU:支持INT8,专用推理加速卡

7.3 CPU推理与Apple Silicon

CPU推理(x86)

使用llama.cpp实现高效CPU推理:

bash

# 编译llama.cpp

cmake -B build -DLLAMA_BLAS=ON -DLLAMA_BLAS_VENDOR=OpenBLAS

cmake --build build -j

# 运行

./main -m llama-2-7b.Q4_K_M.gguf \

--n-gpu-layers 0 \ # 纯CPU

-t 16 # 16线程Apple Silicon

Mac的M系列芯片(M1/M2/M3/M4)拥有统一内存架构,非常适合大模型推理。

优化方案:

- 使用Metal后端(llama.cpp)

- GGUF量化(Q4_K_M推荐)

- 利用统一内存

使用llama.cpp(Mac)

bash

# 编译Metal版本

cmake -B build -DLLAMA_METAL=ON

cmake --build build -j

# 运行

./main -m llama-2-7b.Q4_K_M.gguf \

--n-gpu-layers -1 \ # 全部用GPU(Metal)

-ngl 99性能数据(7B模型,M2 Ultra)

| 配置 | 显存占用 | 推理速度 |

|---|---|---|

| Q4_K_M + CPU | 4.3GB | 8-12 tokens/s |

| Q4_K_M + Metal | 4.3GB | 35-50 tokens/s |

7.4 端侧部署:手机/车载/IoT

手机部署

主流方案:

- llama.cpp(Android):通过Termux或原生集成

- MLC-LLM:跨平台编译框架

- Ollama:一键部署工具

MLC-LLM部署示例

bash

# 编译模型

python -m mlc_llm.build \

--model Llama-2-7b-chat-hf \

--target android \

--quantization q4f16_1 \

--max-seq-len 2048

# 集成到Android应用

# 产物:libmodel.so + params/性能数据(7B模型,骁龙8 Gen2)

| 方案 | 内存占用 | 推理速度 |

|---|---|---|

| Q4_0 | 3.8GB | 3-5 tokens/s |

| Q4_K_M | 4.3GB | 4-6 tokens/s |

| q4f16_1(MLC-LLM) | 3.2GB | 8-12 tokens/s |

车载/IoT部署

挑战:

- 功耗限制

- 温度控制

- 算力有限

解决方案:

- 使用更小的模型(1B-3B)

- 激进量化(INT2/INT4)

- 知识蒸馏

- 模型剪枝

典型设备:

- 高通Snapdragon 8 Gen 3:NPU算力40+ TOPS

- 地平线征程6:专用NPU,支持INT8

- 瑞芯微RK3588:8 TOPS NPU

8. 服务化部署架构

8.1 接入层:API网关与负载均衡

API网关功能

-

请求路由:

- 根据模型类型/版本路由

- A/B测试支持

- 灰度发布

-

认证鉴权:

- API Key验证

- JWT Token

- OAuth 2.0

-

限流熔断:

- 基于QPS/并发数限流

- 令牌桶算法

- 熔断降级

Nginx配置示例

nginx

upstream vllm_backend {

least_conn;

server 10.0.0.1:8000 weight=3;

server 10.0.0.2:8000 weight=2;

server 10.0.0.3:8000 weight=1;

keepalive 32;

}

server {

listen 80;

location /v1/chat/completions {

proxy_pass http://vllm_backend;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

# 限流

limit_req zone=api_limit burst=10 nodelay;

}

# 健康检查

location /health {

proxy_pass http://vllm_backend/health;

access_log off;

}

}

limit_req_zone $binary_remote_addr zone=api_limit:10m rate=10r/s;8.2 调度层:动态批处理与弹性扩缩容

动态批处理策略

-

请求队列:

- 基于优先级的队列

- 超时机制

- 请求取消

-

动态batching:

- 根据GPU利用率调整batch size

- P50/P99延迟目标

- 自适应调度

弹性扩缩容(K8s)

yaml

apiVersion: autoscaling/v2

kind: HorizontalPodAutoscaler

metadata:

name: vllm-hpa

spec:

scaleTargetRef:

apiVersion: apps/v1

kind: Deployment

name: vllm-deployment

minReplicas: 2

maxReplicas: 10

metrics:

- type: Pods

pods:

metric:

name: gpu_utilization

target:

type: AverageValue

averageValue: 808.3 推理层:多实例并行与分布式推理

多实例并行

在同一节点运行多个推理实例,利用多GPU:

bash

# 实例1(GPU 0)

CUDA_VISIBLE_DEVICES=0 python -m vllm.entrypoints.openai.api_server \

--model llama-2-70b \

--tensor-parallel-size 2 \

--port 8000

# 实例2(GPU 2,3)

CUDA_VISIBLE_DEVICES=2,3 python -m vllm.entrypoints.openai.api_server \

--model llama-2-70b \

--tensor-parallel-size 2 \

--port 8001分布式推理

跨节点的模型并行:

-

Tensor Parallelism(TP):

- 切分线性层

- 同步AllReduce

- 适合单机多卡

-

Pipeline Parallelism(PP):

- 切分层

- 微流水线

- 适合跨节点

-

Context Parallelism(CP):

- 切分序列长度

- 适合超长上下文

vLLM分布式推理

python

from vllm import LLM

import torch.distributed as dist

# 初始化分布式

dist.init_process_group(backend="nccl")

# TP=4, 4卡并行

llm = LLM(

model="meta-llama/Llama-2-70B-hf",

tensor_parallel_size=4,

)8.4 运维层:监控告警与模型版本管理

监控指标

-

系统指标:

- GPU利用率

- 显存使用

- CPU/内存

-

推理指标:

- QPS/TPS

- P50/P99延迟

- 错误率

-

业务指标:

- Token生成速度

- 用户满意度

- 成本

Prometheus + Grafana监控

yaml

# prometheus.yml

scrape_configs:

- job_name: 'vllm'

static_configs:

- targets: ['localhost:8000']

metrics_path: '/metrics'模型版本管理

-

版本控制:

- 模型哈希(SHA256)

- 语义化版本(v1.0.0)

- 灰度发布

-

A/B测试:

- 同时部署多个版本

- 流量分配(80% v1, 20% v2)

- 对比指标

使用MLflow管理模型

python

import mlflow

# 记录模型

with mlflow.start_run():

mlflow.log_param("quantization", "awq")

mlflow.log_param("bits", 4)

mlflow.log_metric("perplexity", 5.65)

mlflow.pytorch.log_model(model, "model")

# 加载模型

model = mlflow.pytorch.load_model("runs:/<run-id>/model")9. 全链路实战:从模型到生产

9.1 完整量化部署流程(以Qwen3.5-7B为例)

步骤1:环境准备

bash

# 创建conda环境

conda create -n llm-quant python=3.10

conda activate llm-quant

# 安装依赖

pip install torch==2.4.0

pip install vllm==0.5.0

pip install transformers

pip install accelerate步骤2:模型下载

python

from transformers import AutoModelForCausalLM, AutoTokenizer

model_path = "Qwen/Qwen3.5-7B-Instruct"

# 下载模型

model = AutoModelForCausalLM.from_pretrained(

model_path,

torch_dtype="auto",

device_map="auto",

trust_remote_code=True

)

tokenizer = AutoTokenizer.from_pretrained(model_path, trust_remote_code=True)

# 保存到本地

model.save_pretrained("./models/qwen-3.5-7b-fp16")

tokenizer.save_pretrained("./models/qwen-3.5-7b-fp16")步骤3:AWQ量化

python

from awq import AutoAWQForCausalLM

model = AutoAWQForCausalLM.from_pretrained(

"./models/qwen-3.5-7b-fp16",

low_cpu_mem_usage=True,

use_cache=False

)

quant_config = {

"zero_point": True,

"q_group_size": 128,

"w_bit": 4,

"version": "GEMM"

}

# 量化(需要校准数据)

model.quantize(tokenizer, quant_config=quant_config)

# 保存

model.save_quantized("./models/qwen-3.5-7b-awq")

tokenizer.save_pretrained("./models/qwen-3.5-7b-awq")步骤4:精度评估

python

from vllm import LLM

from datasets import load_dataset

# 加载量化模型

llm = LLM(

model="./models/qwen-3.5-7b-awq",

quantization="awq"

)

# 在验证集上评估

dataset = load_dataset("wikitext", "wikitext-2-raw-v1", split="test")

prompts = dataset[:100]["text"]

# 计算困惑度(需要自定义代码)

ppl = compute_perplexity(llm, tokenizer, prompts)

print(f"Perplexity: {ppl}")步骤5:部署服务

bash

# 启动vLLM服务器

python -m vllm.entrypoints.openai.api_server \

--model ./models/qwen-3.5-7b-awq \

--quantization awq \

--host 0.0.0.0 \

--port 8000 \

--gpu-memory-utilization 0.9 \

--max-model-len 32768步骤6:客户端调用

python

from openai import OpenAI

client = OpenAI(

base_url="http://localhost:8000/v1",

api_key="dummy"

)

response = client.chat.completions.create(

model="Qwen/Qwen3.5-7B-Instruct",

messages=[{"role": "user", "content": "你好"}],

max_tokens=512,

temperature=0.7

)

print(response.choices[0].message.content)9.2 避坑指南:常见问题与解决方案

问题1:量化后精度下降严重

原因:

- 校准数据不匹配业务场景

- 量化参数配置不当

- 模型本身对量化敏感

解决方案:

python

# 1. 使用业务数据校准

calibration_data = get_business_samples() # 真实业务数据

# 2. 调整量化参数

quant_config = {

"w_bit": 4, # 尝试INT8

"q_group_size": 64, # 更小的group

"zero_point": True, # 启用零点

}

# 3. 混合精度

model.layers[:6].quantization = "fp16" # 前6层保持FP16

model.layers[6:].quantization = "int4"问题2:显存OOM(Out of Memory)

原因:

- KV缓存过大

- Batch size设置过大

- 模型未量化

解决方案:

python

llm = LLM(

model="llama-2-70b",

quantization="awq", # 量化

kv_cache_dtype="fp8", # KV缓存量化

max_model_len=16384, # 减小上下文

gpu_memory_utilization=0.85, # 降低GPU利用率

max_num_seqs=64, # 限制并发

)问题3:推理速度慢

原因:

- 未启用优化内核

- CPU/GPU数据传输频繁

- 批处理效率低

解决方案:

python

llm = LLM(

model="llama-2-70b",

quantization="awq",

# 启用优化

enforce_eager=False, # 使用CUDA graph

max_num_batched_tokens=8192, # 增大batch

enable_prefix_caching=True, # 启用前缀缓存

)问题4:长上下文精度下降

原因:

- KV缓存量化误差累积

- 位置编码外推能力不足

解决方案:

python

llm = LLM(

model="llama-2-70b-long",

kv_cache_dtype="fp8", # FP8比INT4精度高

max_model_len=131072, # 128K上下文

# 使用RoPE scaling

rotary_scaling_factor=4.0,

)9.3 性能调优Checklist

模型量化

- 选择合适的量化算法(AWQ/GPTQ/FP8)

- 使用业务数据校准

- 验证困惑度/精度

- 考虑混合精度策略

推理引擎

- 启用PagedAttention

- 启用Continuous Batching

- 使用最优内核(Marlin/FlashAttention)

- 调整batch size和并发数

硬件配置

- GPU利用率>80%

- 显存利用率>85%

- 启用Tensor Core(FP16/INT8/FP8)

- 多卡负载均衡

服务化

- 配置API网关和负载均衡

- 启用健康检查

- 配置限流和熔断

- 设置弹性扩缩容

监控

- 监控GPU/显存使用

- 监控QPS/延迟

- 配置告警规则

- 记录模型版本和配置

10. 量化技术趋势与展望

10.1 2026年技术趋势

1. FP8成为生产标准

- NVIDIA Hopper/Blackwell原生支持

- 精度损失<1%,性能提升30%+

- vLLM、TensorRT-LLM全面支持

2. 极低比特量化突破

- BitNet 1.58b三值量化实用化

- 1-bit量化在特定场景落地(IoT)

- 知识蒸馏+量化融合

3. 端侧部署爆发

- 手机NPU算力提升(10-40 TOPS)

- 7B模型在手机上流畅运行

- 离线AI应用普及

4. 国产算力崛起

- 昇腾950PR性能超越H20

- DeepSeek等大模型全栈适配

- 国产算力市场份额提升至45%+

10.2 未来方向

1. 自动量化搜索

AutoQ(Auto Quantization)自动搜索最优量化策略:

python

# 未来可能的API

from autoq import search_quantization

best_config = search_quantization(

model=base_model,

target_hardware="H100",

constraints={

"max_memory": 80, # GB

"min_accuracy": 0.98,

}

)

# 自动输出:AWQ-4bit + FP8 KV + 混合精度2. 动态量化推理

根据输入复杂度动态调整精度:

- 简单输入:INT4

- 复杂输入:FP8/INT8

- 实时切换,无感知

3. 量化感知微调(QAF)

介于PTQ和QAT之间的中间方案:

- 需要少量数据(1000样本)

- 训练时间短(原训练的1/100)

- 精度接近QAT

4. 神经网络硬件协同设计

- 面向量化的专用架构

- 存算一体芯片

- 光子计算

10.3 挑战与机遇

挑战

- 精度与效率的永恒矛盾:更低比特意味着更高精度损失

- 硬件生态碎片化:不同芯片的量化支持差异大

- 模型规模持续增长:千亿级模型量化面临新挑战

- 长上下文需求:128K+上下文的量化误差累积

机遇

- 成本降低:量化使大模型部署成本降低10倍+

- 端侧AI普及:手机、车载、IoT设备都能运行大模型

- 隐私保护:本地部署解决数据隐私问题

- 实时交互:低延迟推理实现真正实时AI

参考

论文

- GPTQ: GPT Quantization (Frantar et al., 2023)

- AWQ: Activation-aware Weight Quantization (Lin et al., MLSys 2024)

- SmoothQuant: Accurate and Efficient Post-Training Quantization (Xiao et al., ICML 2023)

- FlashAttention-3: Fast and Accurate Attention (Dao et al., 2025)

- BitNet: Scaling Bit-Transformers (Wang et al., 2023)

工具

- vLLM: github.com/vllm-projec...

- TensorRT-LLM: github.com/NVIDIA/Tens...

- AutoGPTQ: github.com/AutoGPTQ/Au...

- AutoAWQ: github.com/casper-hans...

- llama.cpp: github.com/ggerganov/l...

模型

- Llama 3.1: huggingface.co/meta-llama

- Qwen 2.5: huggingface.co/Qwen

- DeepSeek V4: github.com/deepseek-ai

结语

量化技术是大模型落地的关键使能器。从FP16到INT4,从云端到端侧,量化正在重塑AI的部署范式。

2026年,我们见证了:

- FP8成为生产标准

- AWQ/GPTQ算法成熟

- PagedAttention等推理优化普及

- 端侧部署成为可能

未来,随着硬件进步和算法创新,量化技术将继续推动大模型的普及化。掌握量化,意味着你可以在1000元的显卡上跑出原本需要10000元显卡的性能。这是大模型迈向全民化、普及化的核心引擎。