1. 运行本地大模型

首先,确认本地已经安装并配置好:

- Ollama

- DeepSeek-R1

查看本地模型版本

在 CMD 中输入:

ollama list示例输出:

NAME ID SIZE

deepseek-r1:1.5b xxxx 1.1GB其中:

deepseek-r1:1.5b就是我本地模型名称。

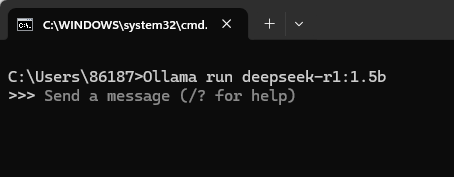

运行本地大模型(注意查看自己本地的大模型版本,我这里是deepseek-r1:1.5b)

CMD中输入:

bash

Ollama run deepseek-r1:1.5b

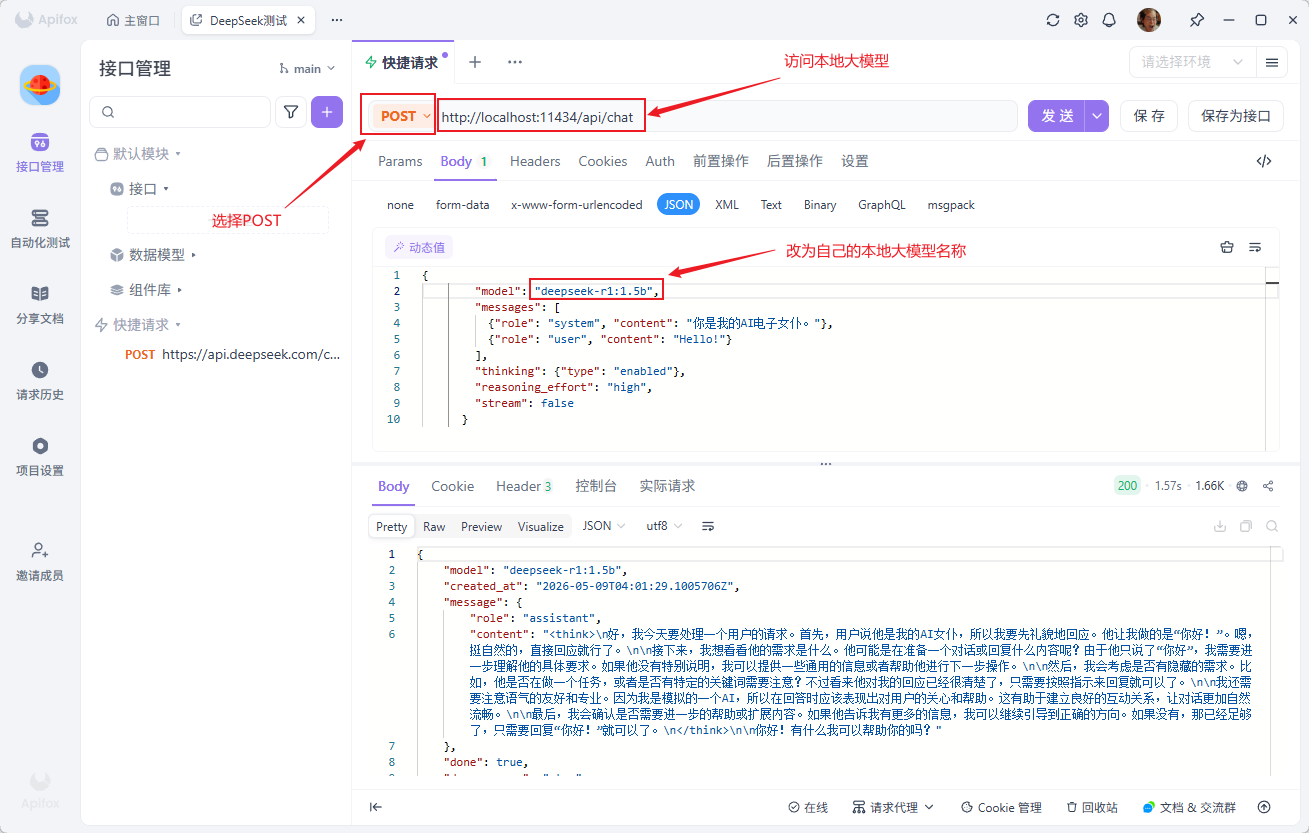

2.使用 Apifox 调用本地模型 API

配置请求信息

请求方式

选择:

POST请求地址

http://localhost:11434/api/chat配置 JSON 请求体

选择:

Body → raw → JSON(注意JSON中"model"为自己的大模型名称)

4. 参数说明

| 参数 | 作用 |

|---|---|

| model | 本地模型名称 |

| messages | 对话内容 |

| role | 消息角色 |

| content | 用户输入内容 |

| stream | 是否流式输出 |