黑白名单机制

在HDFS中可以通过黑名单、白名单机制进行节点管理,决定数据可以复制/不可以复制到哪些节点。

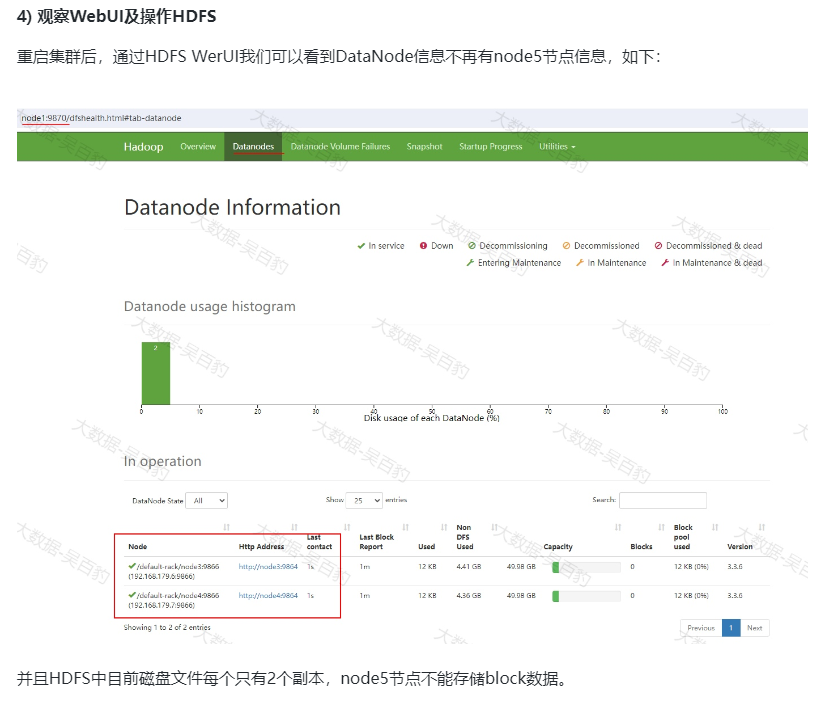

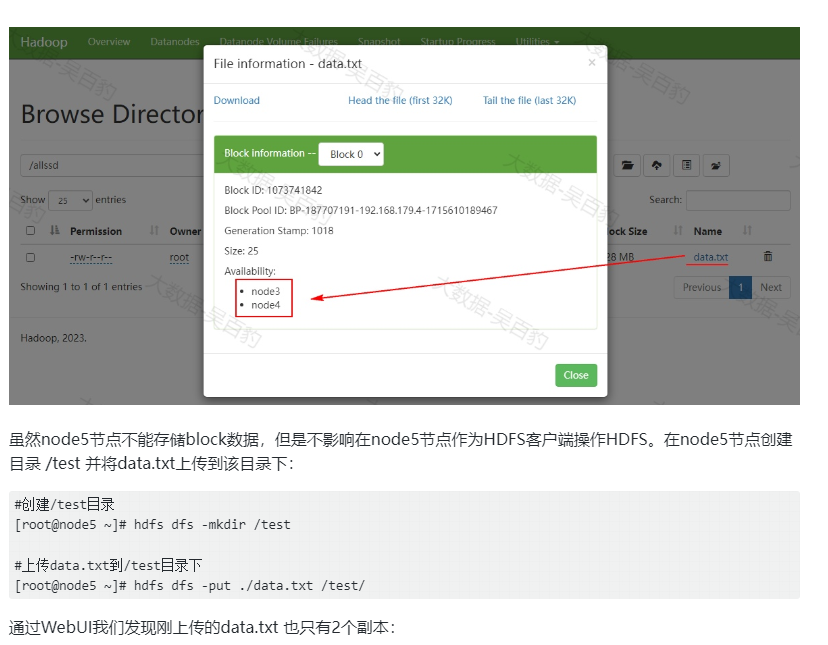

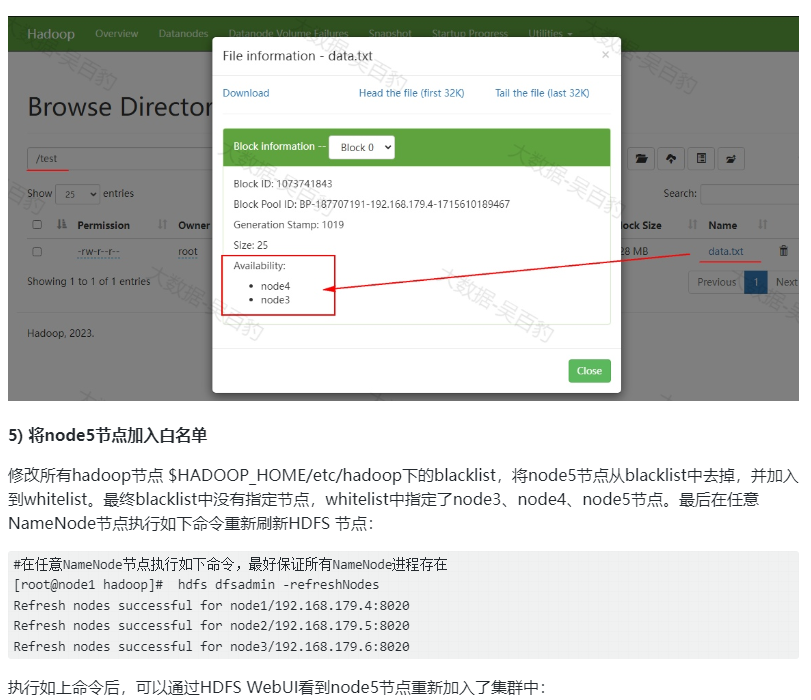

黑名单通常是指在HDFS中被标记为不可用或不可访问的节点列表,这些节点可能由于硬件故障、网络问题或其他原因而暂时或永久性地无法使用。当一个节点被加入黑名单时,HDFS会避免将新的数据块复制到该节点上,同时也会尝试移动现有的数据块副本到其他可用节点上,以确保数据的可靠性和可用性。

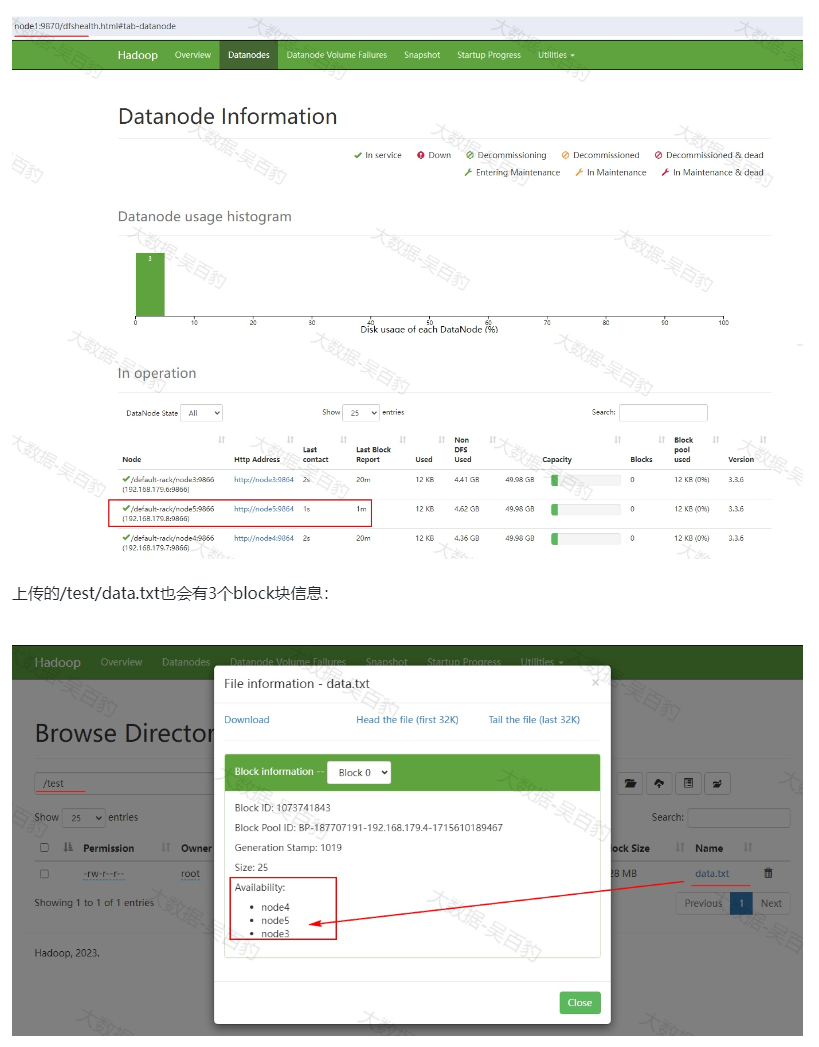

白名单通常是指HDFS中被标记为首选节点的列表。这些节点通常是性能较好、可靠性高、网络连接优良的节点,HDFS会尽可能地将数据块复制到这些节点上。白名单中的节点可能会被优先用于数据复制和块的放置,以提高系统的性能和可用性。

综上,黑名单用于标记HDFS不可用的节点,而白名单用于标记HDFS首选的节点。可以按照如下步骤配置HDFS中的黑白名单。

- 创建黑白名单

在node1节点$HADOOP_HOME/etc/hadoop目录下创建blacklist和whitelist黑白名单文件,两个文件中分别配置黑名单和白名单如下:

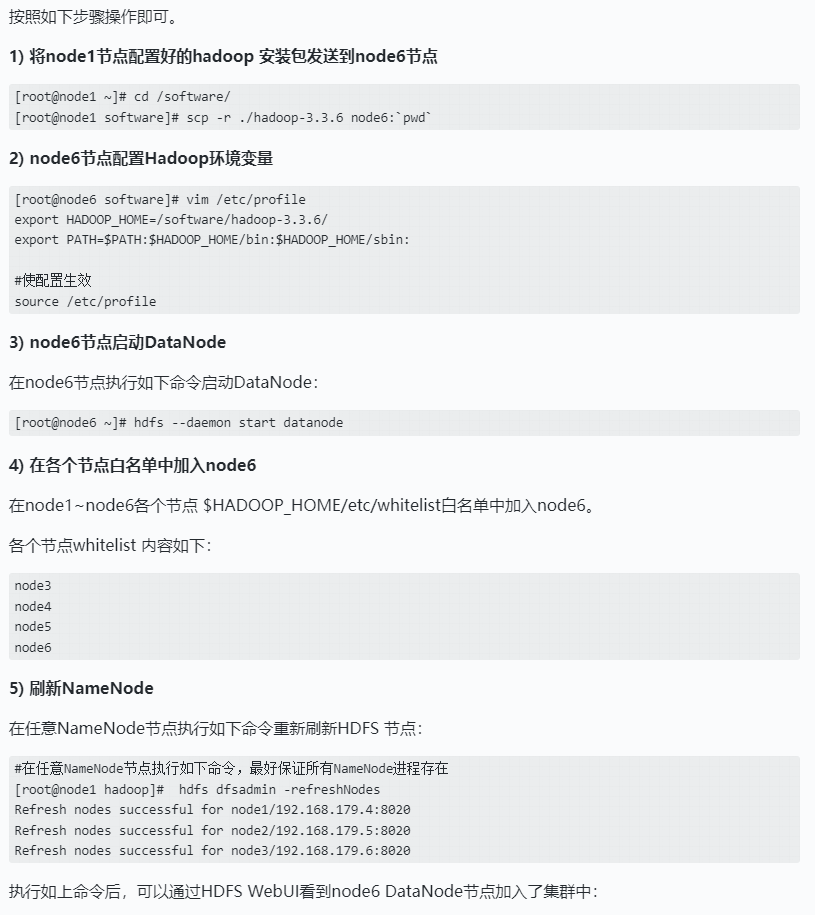

HDFS动态扩容

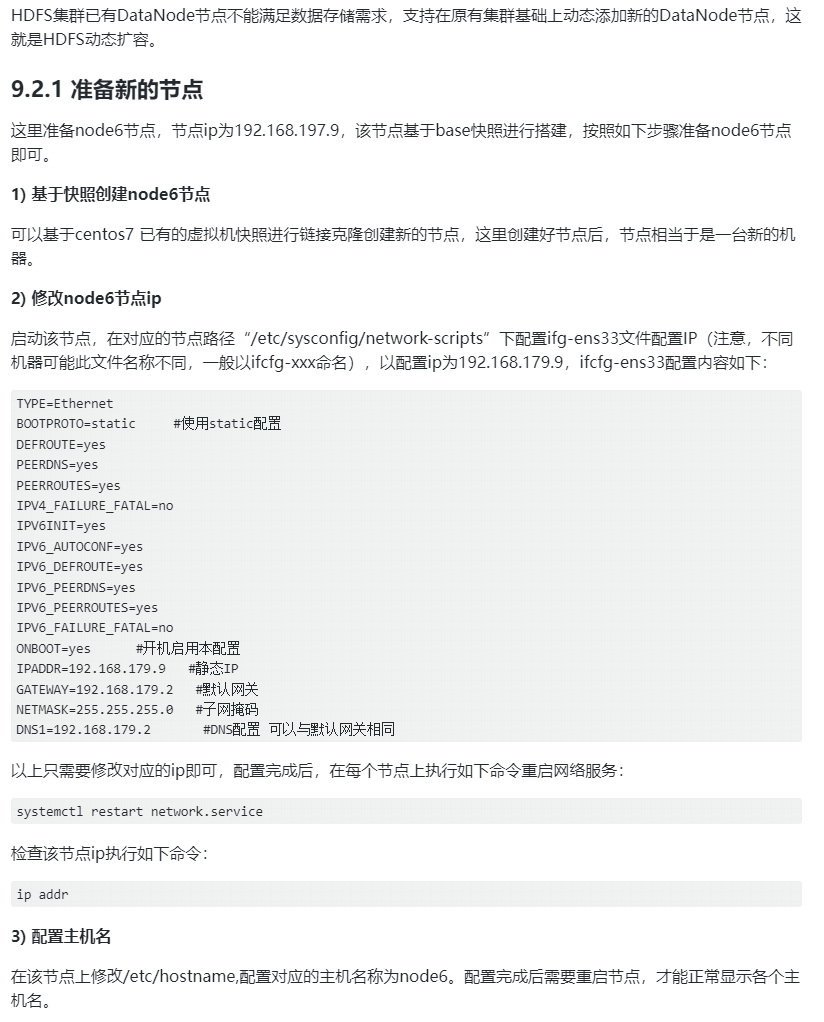

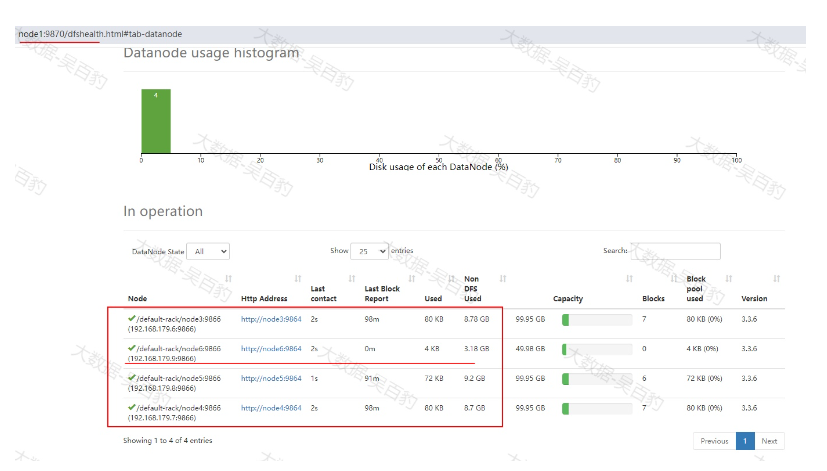

HDFS集群已有DataNode节点不能满足数据存储需求,支持在原有集群基础上动态添加新的DataNode节点,这就是HDFS动态扩容。

准备新的节点

动态扩容DataNode

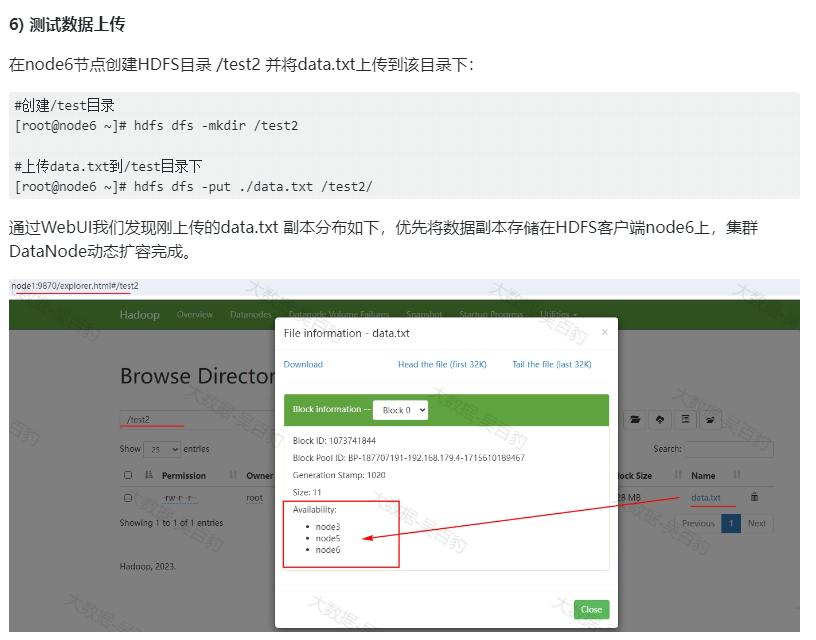

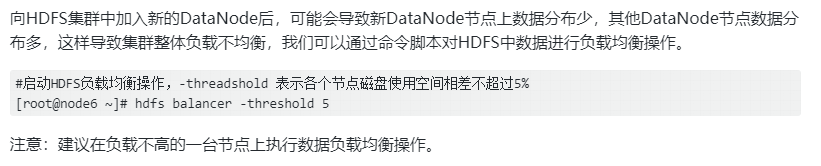

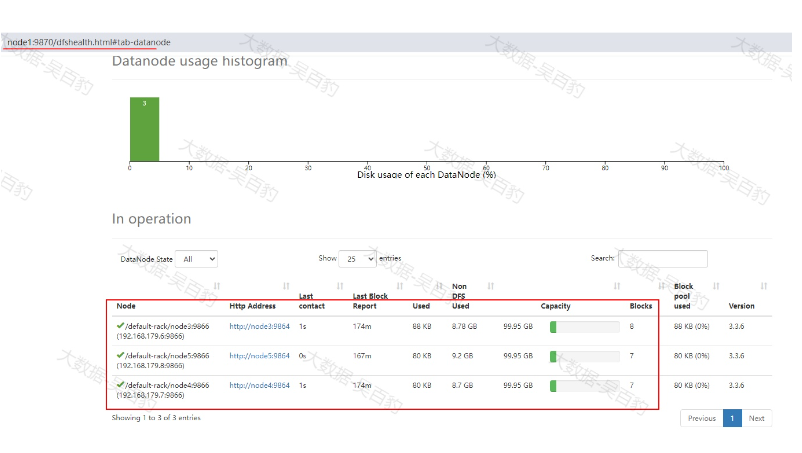

DataNode负载均衡

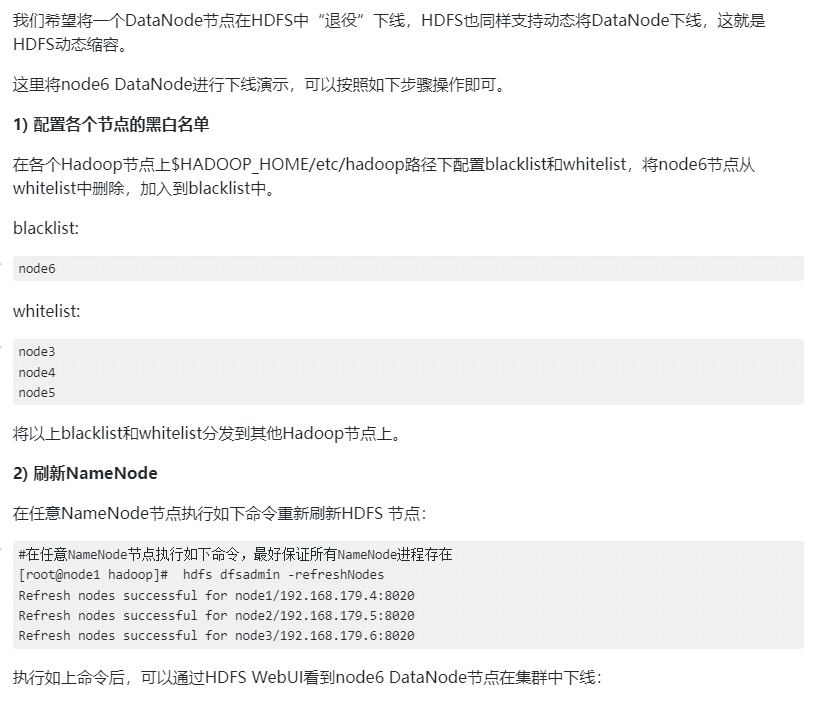

HDFS动态缩容

HDFS数据迁移

HDFS数据迁移

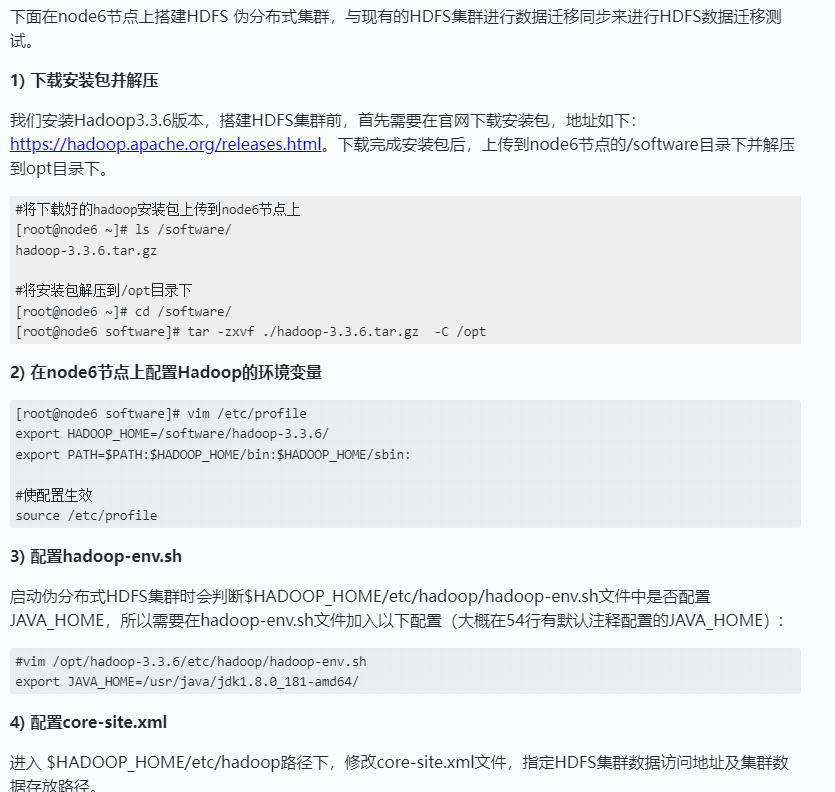

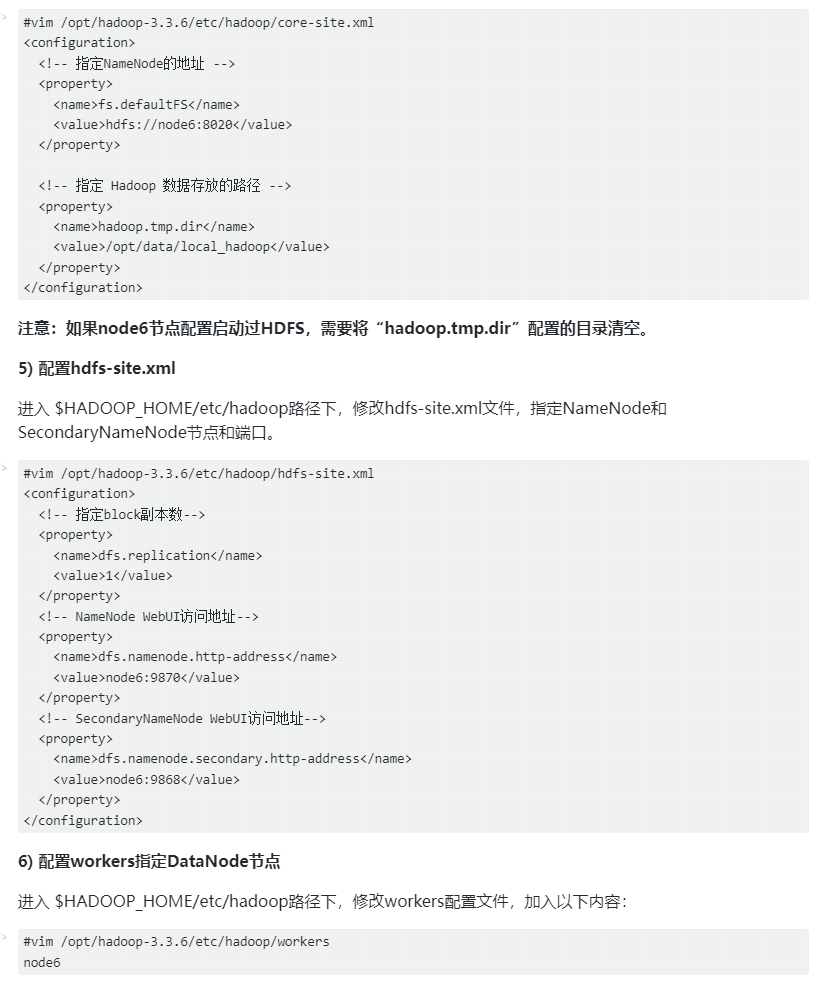

搭建HDFS伪分布式集群

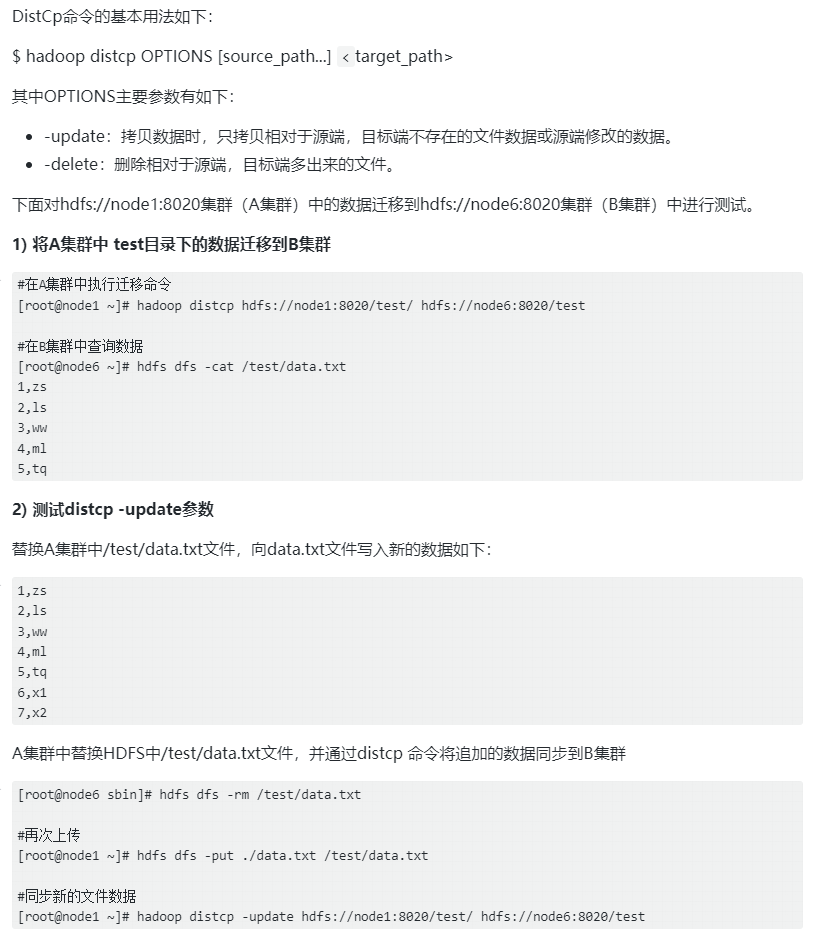

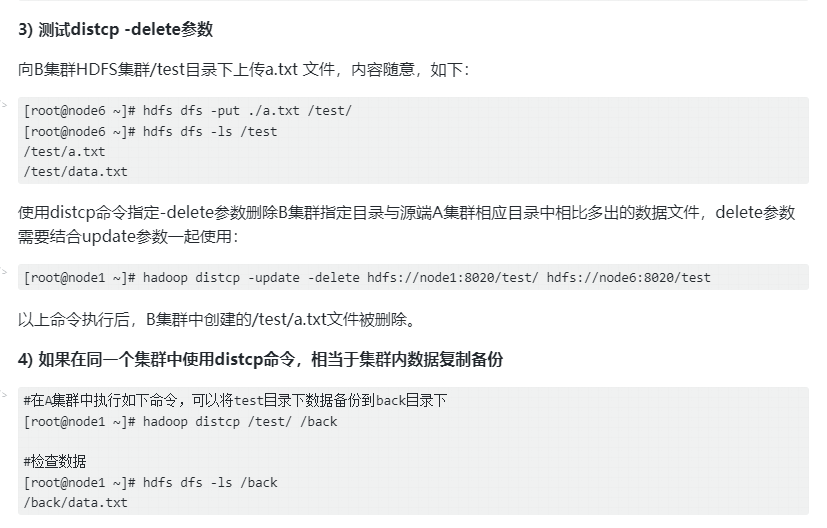

DistCp集群间数据迁移