1. 剧本开头:Redis之父从马桶上站起来,给AI修了一条专属高速

要说这年头谁还能一边蹲坑一边改变世界?那必须是 antirez------真名 Salvatore Sanfilippo,Redis 他亲爹,GitHub 上七万四千颗星的"内存数据库教父"。

别人上厕所刷短视频,他上厕所写代码。

不是开玩笑,是他老婆亲口认证:"Redis 前几年的大部分代码,都是他坐在马桶上,用一台 11 寸 MacBook Air 敲出来的。"

这画面感太强了:西西里岛的阳光照不进意大利老房的卫生间,但 MacBook 的背光映在他专注的脸上,手指在键盘上噼里啪啦,仿佛在给未来敲出一条数据高速公路。

更绝的是,他事后还坦然承认:"我真希望能说她错了......但她正好说得完全对。" 这哪是程序员?这是行为艺术家,只不过他的画布是 C 语言,颜料是 core dump。

既是编程大师也是小説家

antirez 向来信奉"小而美":Kilo 编辑器不到 1000 行 C;linenoise 是 readline 的极简替身;连科幻小说都自己写,2022 年出版《WOHPE》,讲 AI、气候危机和码农的终极浪漫。

他主页第一句话就透着一股子"老子不伺候"的清高:"我把大部分专业时间花在写代码和写小说上。" 没有"赋能",没有"闭环",只有纯粹的创造欲。

2020 年他离开 Redis 时说:"代码是一件制品,而不只是有用的工具。" 宁可被记住为"糟糕的艺术家",也不当"好程序员"------这话听着傲,但人家真做到了。

十五年过去,从 Redis 到 ds4.c,他还是那个偏执狂:讨厌抽象层堆叠,厌恶"粘合式编程",觉得现代软件"又复杂又无趣,失去了美感"。

从不缺席"先进"-永远在造极的男人

如今,这位马桶上的极客站起来了------不是从坑位上站起来,是从通用框架的泥潭里抽身,专门为 DeepSeek V4 Flash 在 Mac 上修了一条"专属高速"。

还是那股味儿:极简、精准、自成一体。连 README 都带着幽默毒舌:"软件都很烂......CPU 推理会崩内核,重启太麻烦,一点都不好玩。"

现在,他给 AI 修路,依然是坐在思想的马桶上,只不过这次,手里换成了 M3 Max。

2. ds4.c是个啥?------专为DeepSeek V4 Flash量身定制的Mac本地推理引擎

ds4.c 不是那种"啥模型都能塞进去跑一跑"的万能锅,它是一条只给 DeepSeek V4 Flash 开的 VIP 专属车道------没有收费站,没有匝道,连路标都刻着"V4 Flash Only"。

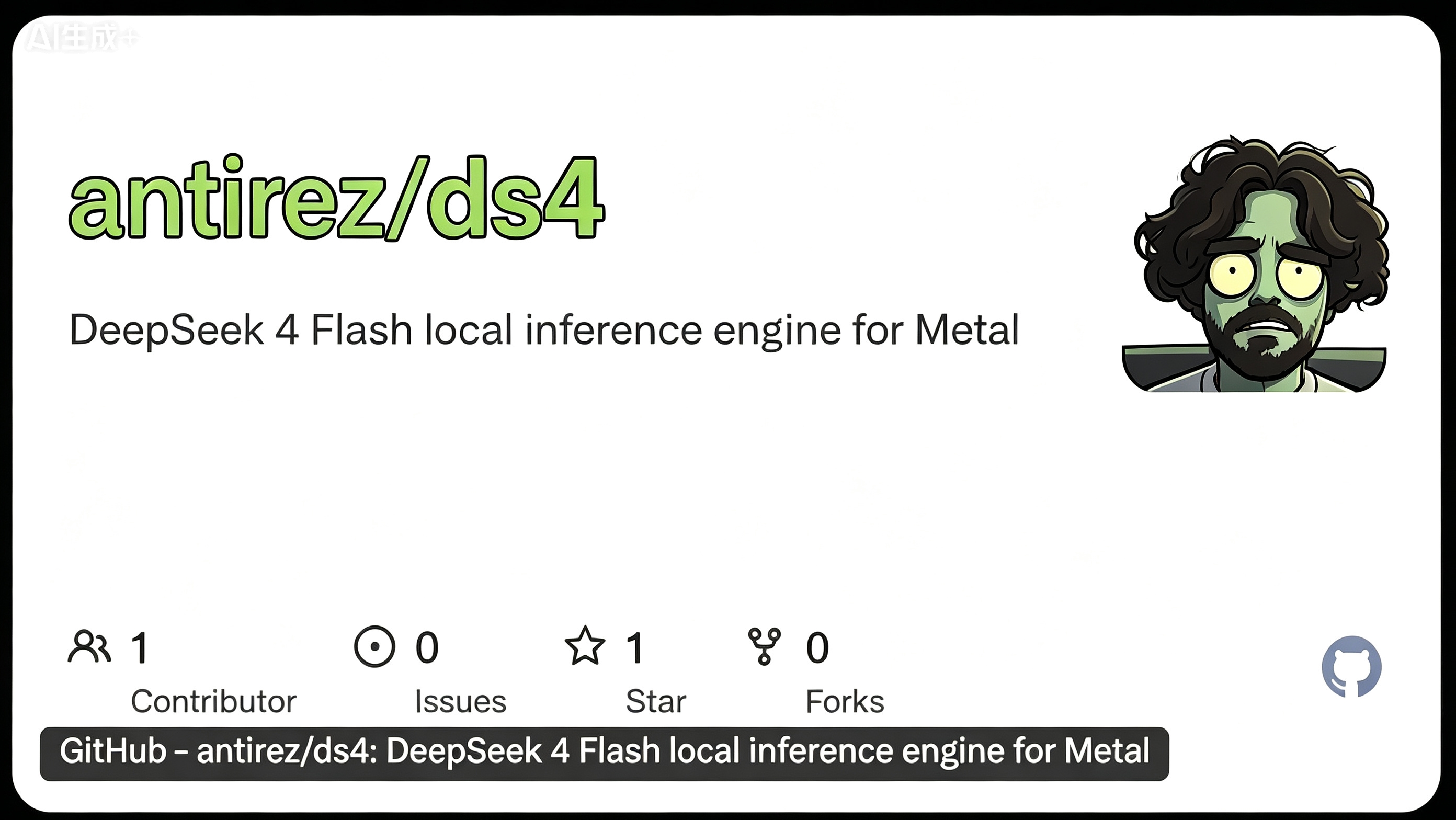

ds4.c简介

它不是 llama.cpp 的马甲,也不是 GGUF 加载器的缝合怪,压根不打算兼容 Llama、Qwen 或 Claude。它的世界里只有一个主角:DeepSeek V4 Flash。

整个项目用 C + Objective-C + Metal 纯手工打造,代码库干净得像刚擦过的 Mac 屏幕------C 占 55.4%,Objective-C 30.2%,Metal Shading Language 13.8%,连个 Python 脚本都不屑混进来。

无运行时、无框架依赖、无抽象层,更别说 Docker 或 npm 那套花里胡哨的依赖树了。你 clone 下来,make 一下,就能喂 prompt 给它吃。

专用定制框架-褒贬不一

它只认 Apple Silicon,因为全靠 Metal ------ 苹果自家的 GPU 编程接口,相当于 CUDA 在苹果生态里的亲儿子。NVIDIA 显卡?对不起,这条路没给你留出口。

目标极其明确:让一个 284B 参数的 MoE 模型,在 MacBook Pro 或 Mac Studio 上不只是"能跑",而是"丝滑到能写代码"。预填充干到 468 token/s,生成稳在 27 token/s,这速度在本地堪称离谱。

通用推理引擎为啥慢?因为要照顾一百种模型的脾气,加了一堆 if-else 和抽象接口,结果每条路都堵成早高峰。而 ds4 直接拆掉所有护栏,只为一辆车铺沥青------赌的就是 DeepSeek V4 Flash 这张牌。

它甚至自带 HTTP API,兼容 OpenAI 和 Anthropic 两套协议,tool calling 也焊死了,开箱就能接 coding agent。这不是组件拼装,是把整个本地推理链路当成一个完整产品来雕。

antirez 的哲学再次应验:少即是多,窄即是快。与其修一条通向全世界的烂路,不如为一个人挖一条穿山隧道------哪怕明天模型换代,今天也要跑出极限。

这种"单模型专用"策略,本质上是对本地推理体验的一次极致押注。antirez 深知,在 Apple Silicon 上榨干每一分算力的关键,不是通用性,而是对模型结构、量化方式与硬件特性的深度耦合。ds4.c 的每一个 Metal kernel 都只为 V4 Flash 的 MoE 架构调优,每一次内存访问都避开 macOS 的坑洼,连 KV 缓存落盘的哈希策略,都是为 coding agent 的长上下文场景量身定制。这条路注定狭窄,却也因此笔直如箭------没有兼容包袱,没有抽象损耗,只有从代码到硅片的最短路径。

3. 怎么做到这么快?三大黑科技揭秘

3.1 非对称量化:给MoE专家层装"ETC通道",其他车道保留高速限速

ds4.c没搞一刀切的2-bit暴力压缩,而是精准"瘦身"------只把MoE架构里最占地方的专家层(up/gate用IQ2_XXS,down用Q2_K)压到2-bit,相当于给高速公路上最堵的货车道装了ETC,秒过不排队。而共享专家、投影层、路由这些关键部件,统统保留Q8精度,稳如老狗。antirez直言:这可不是瞎压,coding agent实测能稳稳调工具,说明"省油不熄火"。

3.2 KV缓存落盘:服务区建"记忆仓库",长上下文秒级复活

普通推理引擎每次对话都从零开始跑prefill,好比每次进服务区都得重新办ETC卡。ds4.c反手就把KV缓存写进硬盘,key值用token序列的SHA1哈希一锁,下次来车只要前缀匹配,直接从"记忆仓库"调取状态,prefill环节当场跳过。这对动辄甩25K token初始prompt的Claude Code之类agent简直是神技------第一次跑完,后续会话秒进高速,连油门都不用踩。

3.3 双API兼容层:一个收费站,同时收OpenAI和Anthropic的币

别家本地引擎还得套中间件转协议,ds4.c直接在收费站顶上挂俩牌子:左边走/v1/chat/completions收OpenAI币,右边走/v1/messages收Anthropic币,tool calling逻辑也焊死适配。开Pi、opencode还是Claude Code?配置文件改两行就行,不用折腾代理、不用写胶水代码,堪称"API无感切换"。这不是兼容,这是把两个生态的入口焊进了同一个岗亭。

三招合璧,专车专用

非对称量化砍掉冗余算力开销,KV落盘消灭重复计算,双API打通主流agent生态------三条黑科技不是孤立功能,而是一套闭环体验。它们共同构成了一条只为DeepSeek V4 Flash服务的"智能高速":车(模型)是特制的,路(Metal kernel)是专属的,连服务区(缓存)和收费站(API)都按司机习惯定制。没有抽象层拖后腿,没有通用框架打补丁,每一纳秒都花在刀刃上。难怪M3 Ultra跑11709 token预填充能飙到468 token/s------这哪是本地推理,分明是Mac Silicon上的F1赛道。

4. 一个模型一个推理框架?本地推理的新范式正在诞生

"一模型一引擎":不是卷,是精准打击

ds4.c像一把手术刀,专切V4 Flash这块肉。Hacker News上热评炸锅:如果连GPU型号+模型结构都锁死,推理速度还能再榨30%?有人算账,去掉通用抽象层后,Metal kernel直接贴着MoE专家调参,省下的不仅是算力,还有工程师debug时掉的头发。

高回报背后是高风险押注

模型一迭代,专属引擎瞬间变电子墓碑

antirez自己都认:"ds4赌的是V4 Flash,但它可能明天就过时"

可128GB Mac用户不在乎------他们要的是现在就能在本地跑coding agent,不是等半年后的"通用方案"

全栈本地推理:新三位一体

antirez甩出新范式:

- 专属HTTP推理引擎(ds4.c)

- 针对该引擎定制的GGUF量化(非通用格式)

- 与Pi/Claude Code等agent深度联调的验证套件

三者缺一不可,拼成开箱即用的"本地AI体验包",不再是七拼八凑的乐高玩具。

每辆车配专属赛道,修路师傅还得会写小说

这波操作把"本地推理"从工具升级成产品。未来或许真会出现:DeepSeek V5发布当天,社区立刻冒出ds5.c;Llama 4登场,llama4-metal紧随其后。赛道越修越窄,但车速越来越疯------只要你不介意,下一辆车可能没路可跑。

5. One More Thing:这代码是AI写的,但灵魂是人的

ds4.c 的 README 里藏着一句大实话:"本项目在 GPT-5.5 的强力辅助下开发。"

不是 AI 写的代码,是 antirez 自己写的;但写得更快、试得更狠------AI 当键盘侠,人类当主理人。

他明确划线:如果你排斥 AI 辅助编程,这软件不适合你。不道德绑架,不装清高,坦荡得像西西里海风。

这和他"马桶上写 Redis"的哲学一脉相承:工具只是工具,MacBook Air 是,GPT-5.5 也是。真正决定代码灵魂的,是坐在那儿的人。

CPU 推理会崩内核?他不骂苹果,只说"软件都很烂",然后笑嘻嘻甩锅给 macOS,顺手召唤勇士来修------这股痞气,AI 可学不会。

在抽象层叠满、胶水代码泛滥的今天,他偏要亲手抠 Metal kernel,用 C 语言一行行喂出推理速度。

AI 能生成 for 循环,但写不出"宁可被记住为糟糕艺术家"的执念。

所以别慌,AI 没抢走极客的马桶座。它只是递了卷更软的卫生纸------真正的灵感,还得靠人蹲出来。