Tokio 是 Rust 异步生态的基石,它是一个事件驱动、非阻塞I/O平台,为 Rust 提供了构建高性能、高可靠异步应用所需的几乎所有组件。

架构

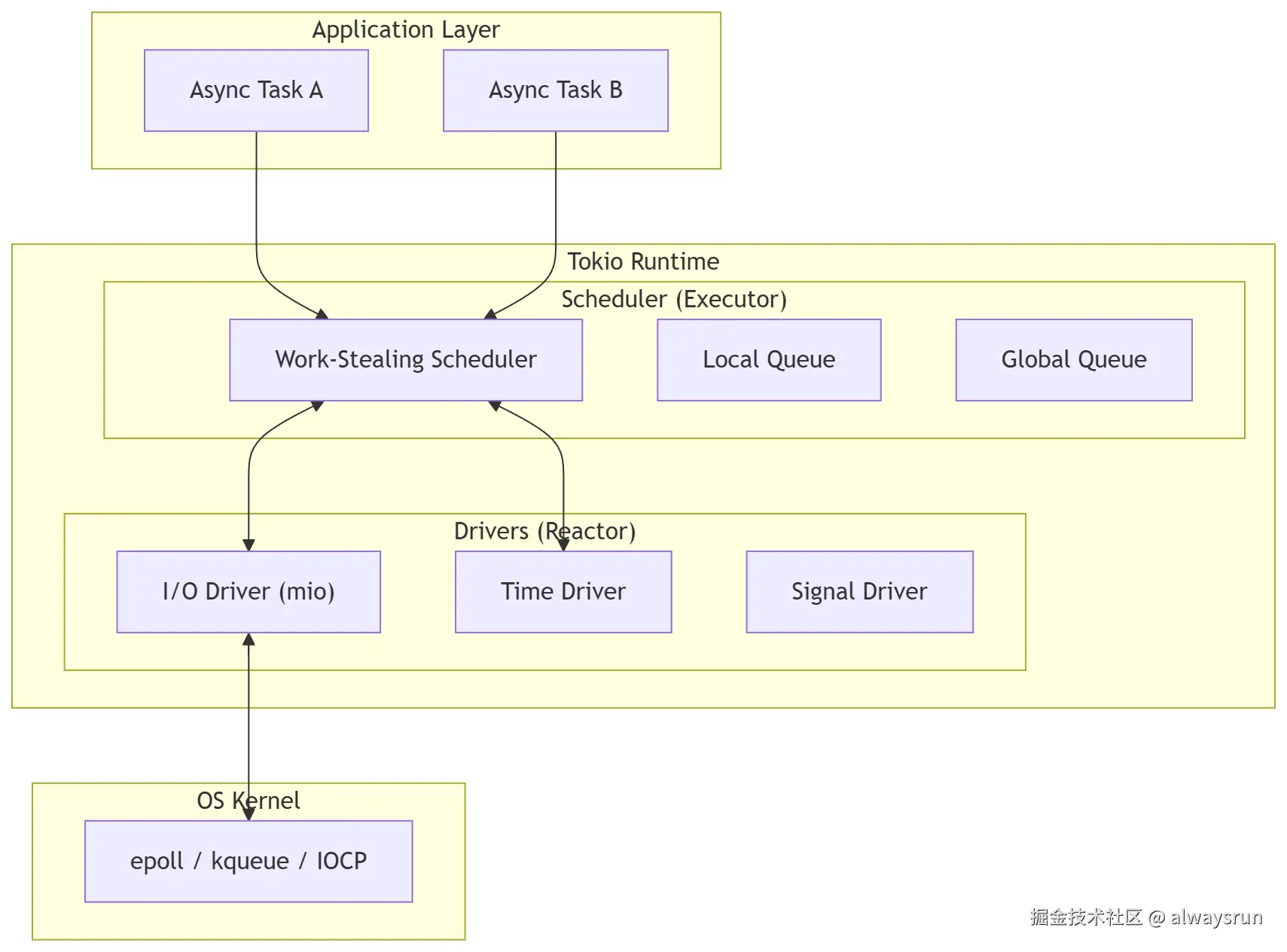

Tokio 采用三层架构,从上到下依次为应用层、中间层、核心层,各层职责明确、旨在解耦。

核心层(Runtime)

-

调度器(Scheduler):默认多线程工作窃取调度器(Work-Stealing)

- 线程数默认等于 CPU 核心数

- 每个线程有独立无锁本地队列

- 空闲线程会 "窃取" 繁忙线程队列任务

-

I/O 驱动(I/O Driver):封装操作系统事件队列(Linux

epoll、macOSkqueue、WindowsIOCP),统一管理异步 I/O 事件,实现非阻塞 I/O。 -

任务系统(Task System):管理

Task(异步任务,轻量级协程),负责任务创建、销毁、状态流转; -

定时器(Timer):高性能时间管理,支持

sleep、timeout、interval,基于时间轮算法,低开销高并发。

中间层(异步 API)

提供开箱即用的异步能力,覆盖网络、文件、同步原语等:

tokio::net:异步 TCP/UDP/Unix 套接字tokio::fs:异步文件系统(读 / 写 / 目录操作)tokio::sync:异步同步原语(Mutex/RwLock/mpsc通道)tokio::time:时间相关(sleep/timeout/interval)tokio::signal:系统信号处理(如SIGINT)

应用层(开发工具)

简化异步代码编写,降低使用门槛:

#[tokio::main]:异步主函数宏,自动初始化 Runtime#[tokio::test]:异步测试宏tokio::spawn:创建异步任务并提交调度

底层原理

Rust 异步是Pull(拉)模型:Future被创建后需主动poll才会执行,Tokio 核心是驱动Future状态流转。

Future:异步任务的 "状态机"

Future是 Rust 异步核心trait,定义在std::future::Future,表示 "未来完成的计算":

rust

pub trait Future {

type Output; // 任务完成返回值

// 核心方法:poll(拨动状态机)

// Pin:防止Future内存地址变更;Context:传递Waker

fn poll(self: Pin<&mut Self>, cx: &mut Context<'_>) -> Poll<Self::Output>;

}

// Poll枚举:任务状态

pub enum Poll<T> {

Ready(T), // 任务完成,返回结果

Pending, // 任务未完成,等待唤醒

}- 无执行权:

Future是 "惰性" 的,不调用poll则不执行 - 状态机本质:每次

poll推进状态,直到Ready - 零成本抽象:编译后无额外运行时开销

Task:Future 的 "执行载体"

Tokio 中的 task 是对Future的封装,是轻量级、非阻塞的可调度的独立执行单元;无需操作系统线程的上下文切换开销,其调度是基于协作式模型(主动让出控制权)。

轻量级与非阻塞

- 无栈设计:Task 的"栈"由编译器生成的

Future状态机实现,局部变量在.await时持久化到堆内存,避免传统线程的 MB 级栈空间开销。 - 协作式调度:Task 必须主动通过

.await让出控制权,否则会独占线程导致其他任务饥饿。 - 非阻塞要求:Task 内部禁止阻塞操作(如

std::fs::read),否则会阻塞整个工作线程。 - 携带

Waker:任务Pending时注册到 I/O 驱动 / 定时器,事件就绪后Waker唤醒Task,触发重新poll

生命周期约束

-

'static生命周期:通过tokio::spawn创建的 Task 不能持有外部非'static引用(因运行时无法确定其存活时间)。 -

Send约束:Task 必须实现Sendtrait,允许运行时在线程间迁移。若 Task 在.await后需使用非Send类型(如Rc),需确保该类型在.await前已释放。 -

状态终止:任务返回

Poll::Ready后,调度器将其标记为已完成,结果写入JoinHandle的输出槽位。 -

资源清理:

- RAII机制:任务的

Future状态机被drop时,内部资源(如文件句柄、锁)按正确顺序释放。 - 取消处理:若任务被

abort()取消,会跳过剩余逻辑,直接触发资源清理。

- RAII机制:任务的

Runtime:任务的 "调度引擎"

Runtime 是 Tokio 的核心,负责线程管理、任务调度、I/O 事件分发,采用高效的M:N线程模型。

| 组件 | 核心职责修正 | 关键细节 |

|---|---|---|

| Driver | 监听 I/O 与 Timer 事件 | 任务被挂起后的"外部唤醒源"。 |

| Scheduler | 维护 LIFO Slot、Local Queue 与 Global Queue | 实现 1/61 公平性检查(定期检查全局队列)。 |

| Worker | 运行就绪任务的事件循环 | 负责从各种队列中"寻找"任务并调用 poll。 |

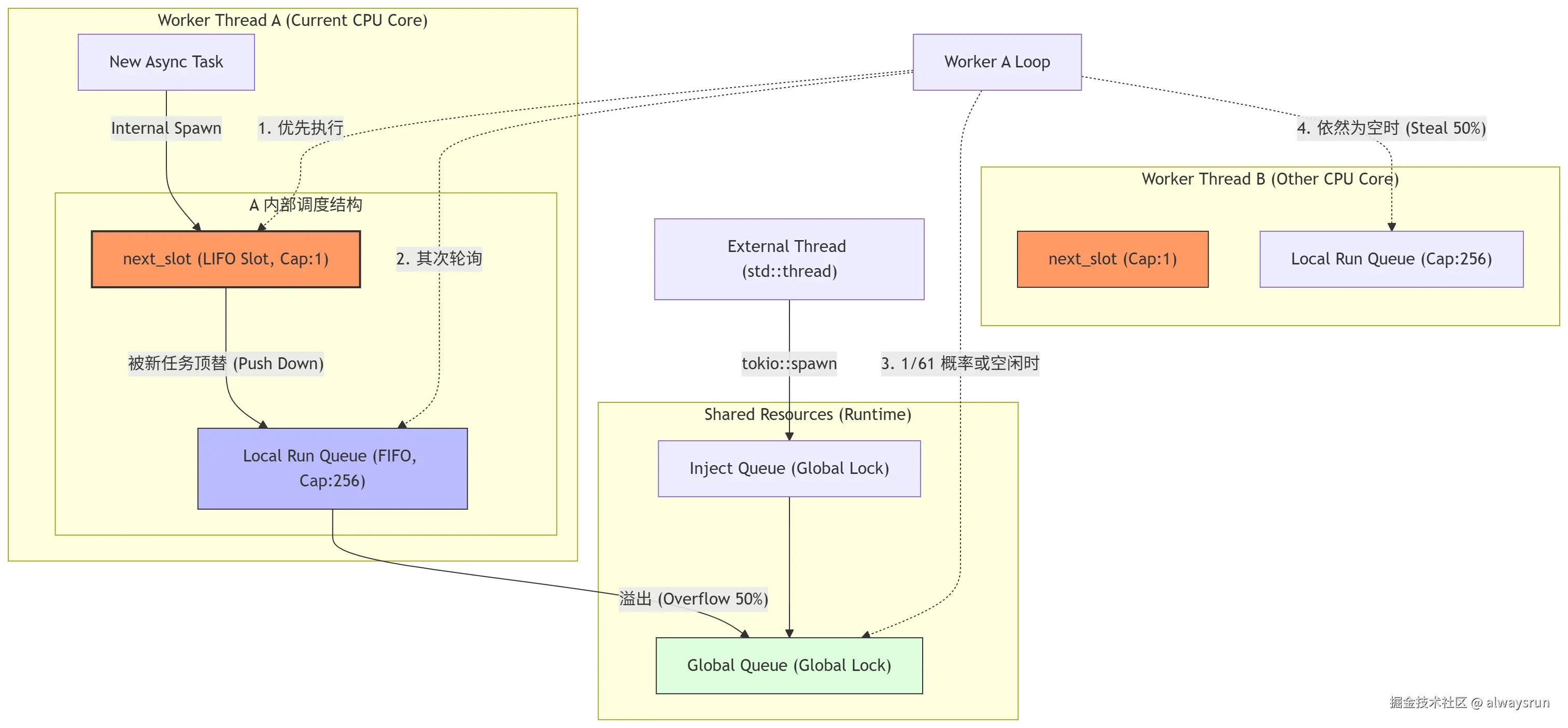

队列

队列全景图

| 队列名称 | 并发控制 | 访问速度 | 主要目的 |

|---|---|---|---|

| LIFO Slot | 线程私有(无锁) | 极快 | 压榨 CPU L1 缓存,降低延迟 |

| Local Queue | 线程私有(无锁) | 快 | 减少多核锁竞争 |

| Global Queue | Mutex 锁保护 | 慢 | 容纳溢出任务,处理外部注入 |

| Blocking Queue | 独立池锁 | 一般 | 隔离同步阻塞操作,保护异步核心 |

LIFO Slot (最后一进先出插槽)

- 容量:1 个任务。

- 设计逻辑:如果任务 A 唤醒了任务 B(例如通过 Channel 发消息),任务 B 会被直接放入当前 Worker 线程的 LIFO Slot。

- 优点:极高的缓存命中率。因为任务 A 刚修改的数据很可能就在 CPU L1/L2 缓存中,任务 B 立即执行能获得最佳性能。

本地运行队列 (Local Run Queue)

- 容量:固定大小(默认 256)。

- 作用:每个 Worker 线程私有的任务列表。

- 设计逻辑:采用无锁队列(Lock-free Buffer) 实现。

- 优点:绝大多数任务的入队和出队都不需要竞争全局锁,极大地提升了多核并发性能。

全局队列 (Global Run Queue)

-

容量:无界(Unbounded)。

-

作用:作为缓冲池和任务中转站。

-

触发场景:

- 溢出处理:当本地队列(256)满时,Worker 会将本地队列中一半的任务转移到全局队列。

- 外部注入:从非 Tokio 管理的线程(如普通的

std::thread)调用spawn时。

-

缺点:受锁保护,访问开销比本地队列高。

阻塞线程池队列 (Blocking Queue)

- 作用:专门给

spawn_blocking准备的。 - 设计逻辑:一个完全独立的线程池;存放耗时的同步阻塞操作。

- 特点:通常会根据需求动态增加线程数量(默认最高 512)。

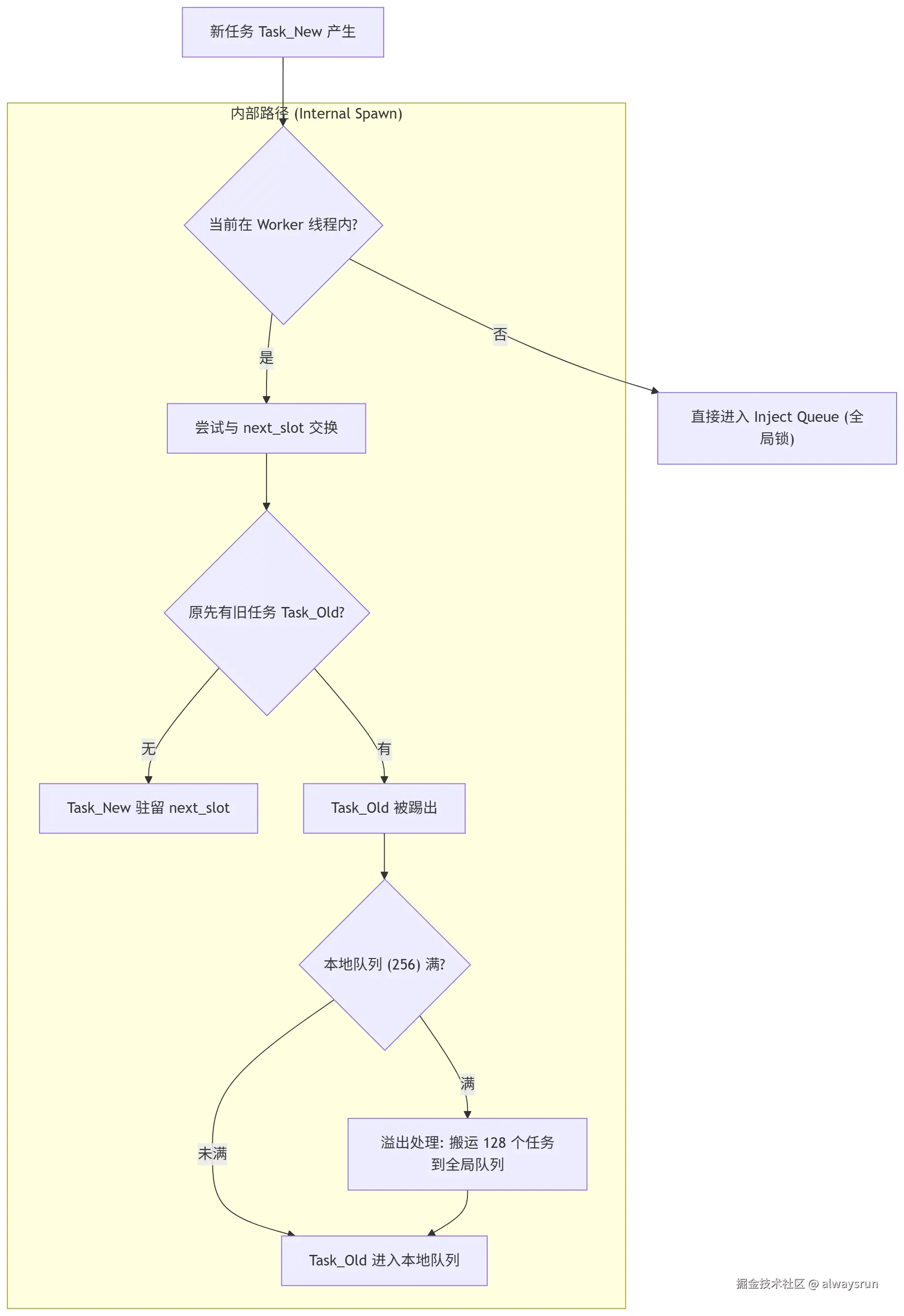

入队操作

- 出生:如果在异步函数内

spawn,直接去 Slot 抢位子;如果在外部,去 Inject Queue 排队。 - 排队:如果 Slot 被后来者抢了,就被踢进 Local Queue;

- 被执行:Worker 线程会先看一眼 Slot,再看一眼本地队列,偶尔瞄一眼全局队列。

执行与窃取

第一优先级:next_slot (最新产生的任务)

- 位置:容量为 1 的特殊插槽。

- 性质:LIFO(后进先出)。

- 逻辑:只要这个插槽里有任务,

poll时 总是先执行它(为压榨 CPU 的热缓存)。

第二优先级:本地队列的头部 (Head)

- 位置:本地 256 槽位的环形缓冲区。

- 性质:FIFO(先进先出)。

- 逻辑:当

next_slot为空时,Worker 从本地队列的 Head 弹出任务执行。 - 设计意图:保证当前 Worker 内部,任务是按顺序公平处理的。

第三优先级:全局队列 (Global Queue)

- 如果 Worker 只从本地队列取任务,那全局队列里的任务可能会永远得不到执行。

- 策略:1/61 公平性检查 (The 61st Tick),每执行 61 个任务,强制去检查一次全局队列。

- 数值由来:61 是一个质数,可以有效避免与各种周期性任务产生共振或同步,从而保证随机性的公平。

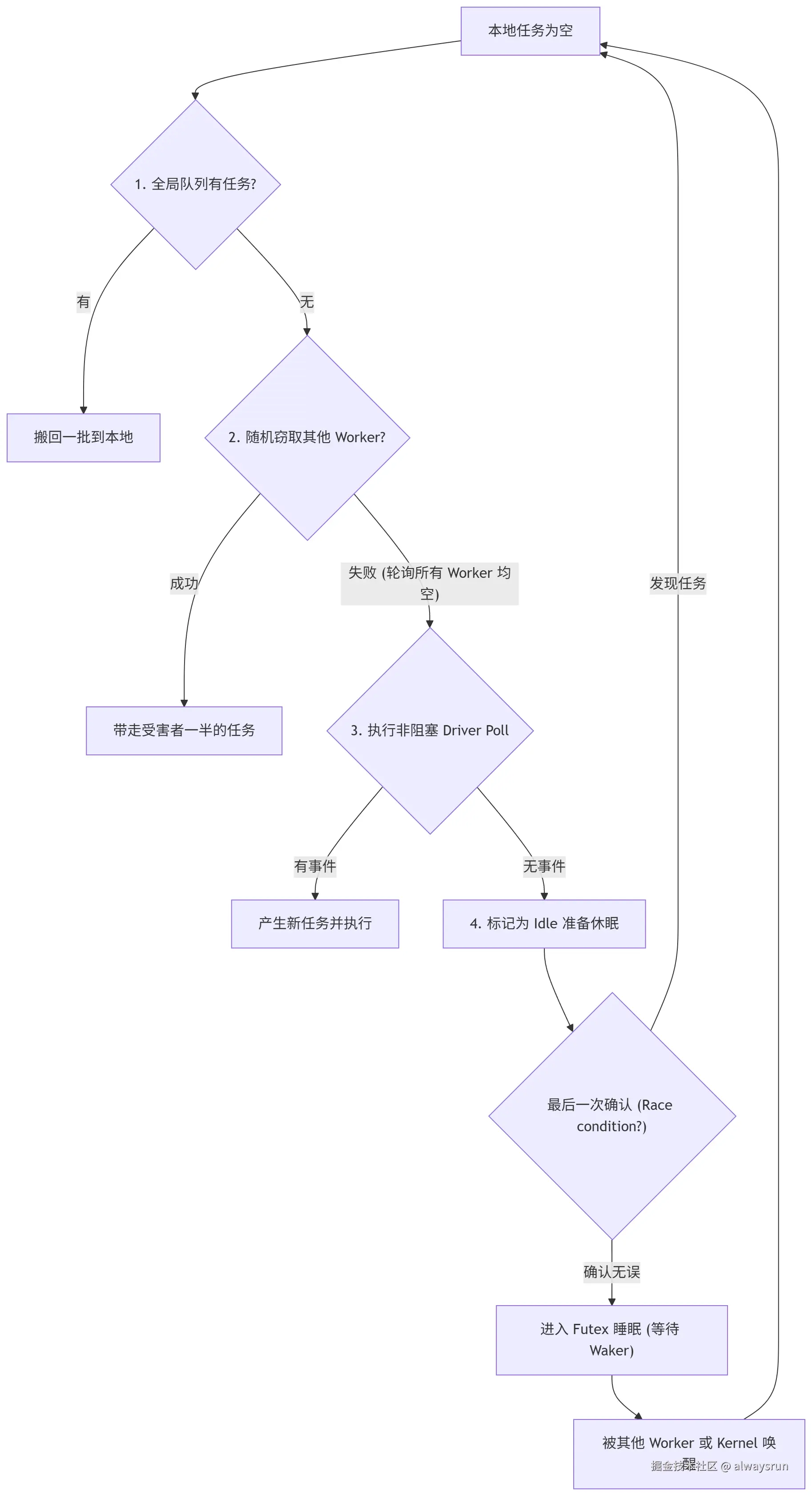

任务搜索:当 Worker 空闲时,会按照以下顺序启动搜索:

第一步:检查全局队列 (Global Queue)

- 逻辑:如果全局队列有任务,会一次性搬回一批任务(通常是

min(全局任务数/Worker总数, 128))。 - 权衡:由于涉及全局锁,比本地操作慢,但比跨核偷取更稳定。

第二步:工作窃取 (Work Stealing)

-

目标选择:随机选择另一个 Worker 线程(避免多个空闲 Worker 同时盯上同一个忙碌 Worker)。

-

窃取操作:尝试从目标 worker 的

Local Queue头部(Head,最老的)切走一半的任务。 -

重试机制:如果随机选中的 Worker 也没任务,它会尝试轮询其他所有的 Worker,直到发现有活可干或确认全员皆空。

- 搜索配额:通常只有一小部分(往往是总数的一半左右)空闲 Worker 被允许同时处于"Searching"状态。

- 行为:如果当前的"搜索者"已经够多了,多出来的空闲 Worker 连重试的机会都没有,会直接被强制送去休眠。

第三步:检查 I/O 和 定时器 (Driver Poll)

如果全网都没有就绪任务,Worker 会检查底层的 Reactor(即 I/O 驱动和时间驱动)。

- 动作:执行一次非阻塞的

poll(例如epoll_wait超时时间设为 0)。 - 逻辑:看看是否有新的网络包到达或定时器到期。如果有,产生的任务会填入本地并立即执行。

Waker:唤醒机制

Waker注册:

- 任务挂起前,必须通过

Context提取Waker并注册到事件源(如I/O驱动、定时器),确保事件就绪时能被唤醒。

当一个任务被唤醒时,其去向取决于谁唤醒了它以及它是如何被唤醒的。

-

内部唤醒 (Internal Wakeup) ------ 优先进入 Slot:如果 Worker-1 正在运行任务 A,任务 A 通过

mpsc发送了一条消息,从而唤醒了任务 B。- 逻辑:任务 B 会尝试执行

Swap操作进入 Worker-1 的next_slot。 - 意图:这被视为"协同处理":任务 A 产生了数据,任务 B 消费数据,让 B 进 Slot 可以最大限度利用 CPU L1/L2 缓存中的数据。

- 逻辑:任务 B 会尝试执行

-

外部唤醒 (External/Driver Wakeup) ------ 通常进入 Local Queue:如果任务 B 是由 I/O 驱动(Reactor)或时间驱动(Timer)唤醒的。

- 逻辑:通常进入该任务上次运行所属 Worker 的 Local Queue 的末尾。

- 意图:避免外部频繁的 I/O 中断直接打断当前正在进行的"热"任务流。

-

自唤醒 (Self-Wakeup,如yield_now().await) 公平性保:绝对不允许进入

next_slot。- 绕过 Slot:自唤醒的任务会被强制放回本地队列(Local Queue)的 末尾(Tail)

- 必须等待当前本地队列中所有的任务(FIFO)都跑完一遍。

| 唤醒类型 | 典型场景 | 入队位置 | 架构意图 |

|---|---|---|---|

| 内部协同唤醒 | mpsc发消息 |

next_slot | 极致响应,利用热缓存 |

| 外部事件唤醒 | 网络 I/O, Timer | Local Queue 尾部 | 亲和性,保证公平性 |

| 主动让出 | yield_now() |

Local Queue 尾部 | 强制公平,防止垄断 |

常用接口

运行时与任务管理 (Runtime & Tasks)

这是驱动异步代码运行的核心,决定了任务如何被调度和执行。

| 接口 / 宏 | 核心功能 | 生产建议与关键权衡 |

|---|---|---|

#[tokio::main] |

应用程序异步入口宏 | 默认开启多线程(Worker 数量等于 CPU 核心数);库作者应避免在 Lib 中使用 |

tokio::spawn |

产生一个并发 Task | 任务需满足 Send + 'static;产生的 Task 会被立即加入调度队列。 |

tokio::task::spawn_blocking |

执行阻塞式任务 | 用于处理 CPU 密集型计算 或 同步 I/O。它在专门的线程池运行,防止阻塞 Event Loop。 |

tokio::task::yield_now |

主动让出 CPU 执行权 | 在长循环、高负载计算中使用,防止当前 Worker 线程下的其他 Task 产生饥饿。 |

tokio::task::JoinHandle |

任务句柄 | spawn 的返回值,可用于 .await获取任务结果或通过 .abort()取消任务。 |

基础创建方式

#[tokio::main]:异步主函数

自动创建多线程 Runtime,执行异步main函数:

csharp

// 自动生成Runtime并block_on执行异步main

#[tokio::main]

async fn main() {

println!("Hello Tokio");

}-

tokio::spawn:提交异步任务到运行时,返回

JoinHandle用于等待结果或取消任务。关键行为:

- 任务立即提交到调度队列,但执行时机由运行时决定。

- 若父任务结束而子任务未完成,子任务仍会继续执行(除非显式取消)。

ini

let handle = tokio::spawn(async { "hello" });

let result = handle.await?; // 等待结果阻塞操作的正确处理

spawn_blocking:

将阻塞任务提交到专用阻塞线程池,避免占用异步工作线程。适用于文件 I/O、CPU 密集型计算等。

rust

let result = tokio::task::spawn_blocking(|| std::fs::read_to_string("file.txt")).await?;block_in_place:

在当前工作线程临时转换为阻塞模式,迁移本地队列任务到其他线程后再执行阻塞操作,减少上下文切换开销。

rust

let result = tokio::task::block_in_place(|| std::fs::read_to_string("file.txt"));任务取消与控制

JoinHandle::abort:

标记任务为取消状态,任务会在下一个.await点退出(非立即终止)。yield_now:

主动让出当前任务的执行权,触发调度器切换到其他任务,避免长循环导致的任务饥饿。

rust

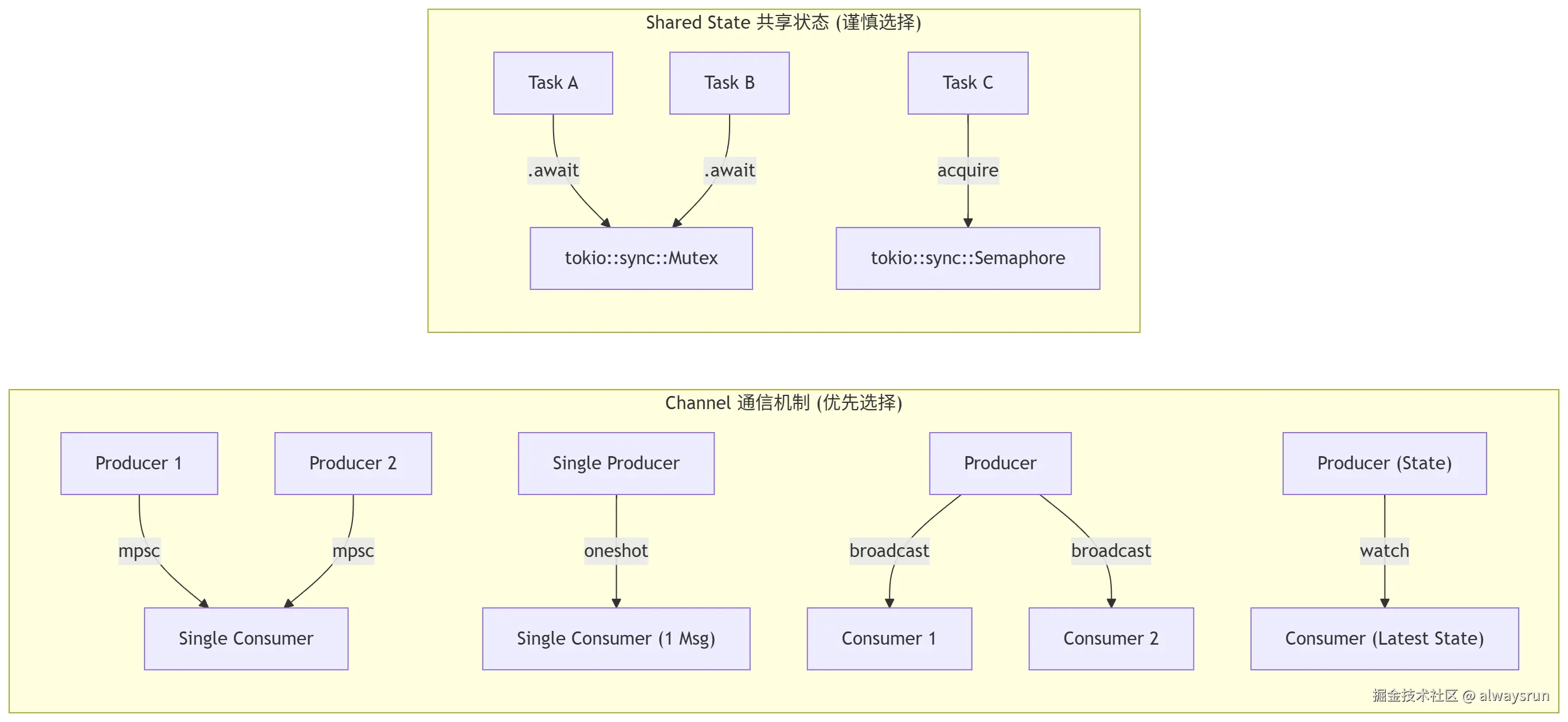

tokio::task::yield_now().await;异步同步原语 (Synchronization)

在异步环境中,严禁使用 std::sync 中的阻塞锁(如 Mutex/RwLock)跨越 .await 点。

| 模块 / 类型 | 通讯/同步模式 | 最佳实践场景 |

|---|---|---|

tokio::sync::mpsc |

多生产者单消费者 (Channel) | 最常用。具有背压(Backpressure)机制,适合任务分发与解耦。 |

tokio::sync::oneshot |

一次性信号 (Channel) | 适用于等待单个异步计算结果,如 RPC 请求的响应回调。 |

tokio::sync::watch |

状态观察 (Channel) | 仅保留最新值。非常适合配置更新广播或系统状态同步。 |

tokio::sync::broadcast |

多生产者多消费者广播 | 典型的订阅/发布模型。例如将一条网络消息广播给所有在线连接。 |

tokio::sync::Mutex |

异步互斥锁 | 仅在需要跨 .await 持有锁时使用。否则应优先使用 std::sync::Mutex以获得更高性能。 |

tokio::sync::Semaphore |

异步信号量 | 常用于流量控制。例如限制整个系统的最大并发数据库连接数或 API 并发请求数。 |

同步原语全景图

1. mpsc (Multi-Producer, Single-Consumer)

-

架构定位:系统的"主骨架"。用于任务聚合、工作队列分发。

-

特性:支持背压(Backpressure)。必须指定容量(Capacity),当队列满时,生产者调用

.send().await会被挂起,直到有空间。 -

注意事项:

- 绝对禁止使用

mpsc::unbounded_channel,除非你能 100% 保证消费速度永远大于生产速度,否则会导致内存泄漏(OOM)。 - 当所有的

Sender释放,或者Receiver释放时,通道关闭。

- 绝对禁止使用

2. oneshot (单发单收)

- 架构定位:RPC 调用、Actor 模式的回调机制。

- 特性:只能发送一次数据。

- 注意事项:通常与

mpsc结合使用。将oneshot::Sender打包在消息中通过mpsc发送给工作节点,工作节点处理完后通过oneshot::Sender返回结果。

3. watch (状态广播)

- 架构定位:配置热加载、系统健康状态分发。

- 特性:单生产者,多消费者。只保留最新值。如果生产者更新太快,消费者可能会漏掉中间状态(但保证能拿到最终状态)。

- 注意事项:初始化时必须提供一个初始值。

4. broadcast (事件广播)

- 架构定位:发布/订阅(Pub/Sub)总线,如聊天室消息分发。

- 特性:多生产者,多消费者。每个消费者都能收到所有消息。

- 注意事项:如果某个消费者处理过慢(导致滞后超过通道容量),它会收到

RecvError::Lagged错误。应用层必须处理这种"掉线"情况。

5. Mutex / RwLock (异步互斥锁)

- 架构定位:保护跨越

.await点的共享可变状态。 - 注意事项:这是最容易被滥用的原语。如果临界区内没有

.await操作,请使用std::sync::Mutex,它性能远高于tokio::sync::Mutex。只有当锁必须在.await期间保持时,才使用 Tokio 的锁。

6. Semaphore (信号量)

- 架构定位:并发度控制(Rate Limiting / Concurrency Control)。

- 特性:限制同时访问某资源的 Task 数量,例如限制最大并发数据库连接数。

网络与 I/O 操作 (Networking & I/O)

这些接口封装了操作系统的非阻塞 I/O,是高性能服务器的基石。

| 接口 / Trait | 功能描述 | 核心要点 |

|---|---|---|

tokio::net::TcpListener |

TCP 监听器 | accept().await 返回 TcpStream。支持通过 poll_accept 进行精细控制。 |

tokio::net::UdpSocket |

UDP 套接字 | 支持 send_to / recv_from以及连接模式。 |

tokio::io::AsyncReadExt |

异步读取扩展 | 提供 read_exact, read_to_end, read_buf 等便捷方法。 |

tokio::io::AsyncWriteExt |

异步写入扩展 | 提供 write_all, flush, shutdown。务必在关闭前调用 flush。 |

tokio::io::split |

读写分离 | 将一个 TcpStream 拆分为 ReadHalf 和 WriteHalf,以便在两个不同的 Task 中并发读写。 |

tokio::io::copy |

零拷贝转发 | 高效地将一个 Reader 的数据流直接传输到 Writer。 |

TCP 客户端

rust

// TCP服务器

use tokio::net::{TcpListener, TcpStream};

use tokio::io::{AsyncReadExt, AsyncWriteExt};

#[tokio::main]

async fn main() {

// 监听8080端口

let listener = TcpListener::bind("127.0.0.1:8080").await.unwrap();

println!("Server listening on 8080");

loop {

// 接受客户端连接

let (mut stream, addr) = listener.accept().await.unwrap();

println!("New connection: {}", addr);

// 异步处理连接(不阻塞主线程)

tokio::spawn(async move {

let mut buf = [0; 1024];

// 读取客户端数据

let n = stream.read(&mut buf).await.unwrap();

// 回写数据

stream.write_all(&buf[..n]).await.unwrap();

});

}

}时间驱动与流控制 (Time & Flow Control)

| 接口 / 宏 | 功能描述 | 注意事项 |

|---|---|---|

tokio::time::sleep |

异步休眠 | 不会阻塞线程,仅挂起当前 Task。 |

tokio::time::timeout |

超时包装器 | 生产环境中的防御性编程必备。防止下游服务无响应导致 Task 永久挂起。 |

tokio::time::interval |

周期性定时器 | 能够自动补偿(Missed Ticks),适合心跳检测和定时清理任务。 |

tokio::select! |

异步多路复用 | 同时等待多个分支。关键点:分支是公平竞争的,且未选中的分支会被自动 Drop(具有取消语义)。 |

tokio::join! |

并行等待 | 同时启动多个 Future 并等待它们全部完成。 |

tokio::select! 允许同时等待多个异步分支,并执行最先完成的那个分支。其余未完成的分支会被立即销毁。

- 随机性(Fairness):为了防止某个总是就绪的分支(如高速 Channel)导致其他分支饥饿,

tokio::select!默认会随机选择开始轮询的分支顺序。 - 优先级(Biased):如果你需要特定顺序(例如优先处理"退出信号"),可以使用

biased标记。

显式使用 biased; 标记时,select! 将严格按照自上而下顺序进行轮询。

scss

tokio::select! {

biased; // 开启顺序轮询

// 分支 1:高优先级

_ = shutdown_rx.recv() => {

// 即使其他分支就绪,只要收到停机信号,优先退出

}

// 分支 2:中优先级

Some(msg) = high_priority_rx.recv() => {

handle_vip_msg(msg).await;

}

// 分支 3:普通优先级

Some(msg) = normal_rx.recv() => {

handle_msg(msg).await;

}

}本文使用 markdown.com.cn 排版