从零实现 Transformer:第 0 部分 - 基础( Foundations)view 重塑形状 和 transpose 交换维度顺序

flyfish

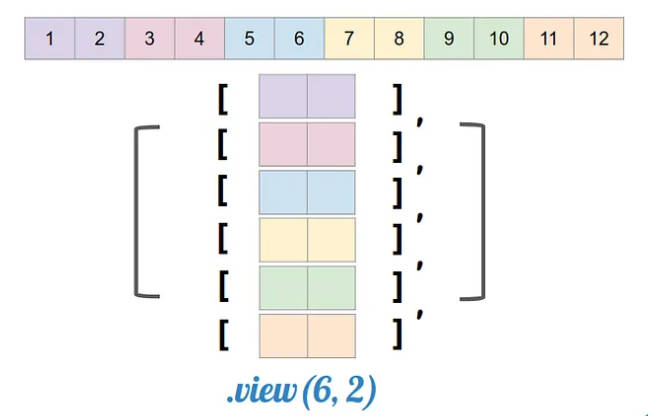

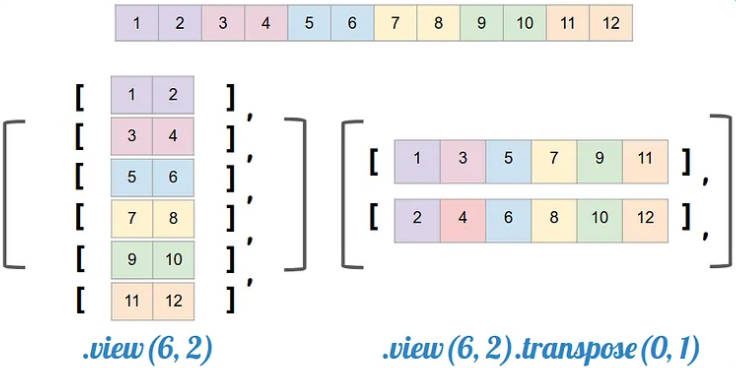

view 复用原张量同一块底层内存数据,只是换了一种维度解读方式,不会在内存中创建物理副本。

cpp

import torch

x = torch.arange(1,13).view(6,2)

print(x)

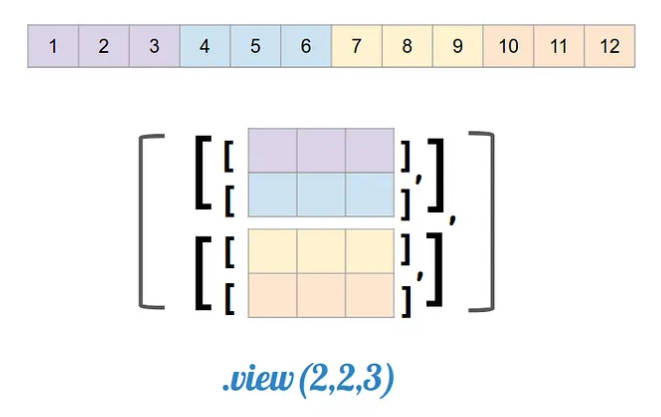

y = torch.arange(0,12).view(2,2,3)

print(y)

cpp

tensor([[ 1, 2],

[ 3, 4],

[ 5, 6],

[ 7, 8],

[ 9, 10],

[11, 12]])

cpp

tensor([[[ 0, 1, 2],

[ 3, 4, 5]],

[[ 6, 7, 8],

[ 9, 10, 11]]])

cpp

import torch

# ===================== 1. 原始张量(对应图顶部的一维数据) =====================

print("===== 原始一维张量 =====")

x = torch.arange(1, 13) # 生成 [1,2,...,12]

print(x)

# ===================== 2. view(6,2) 连续张量(对应图左侧) =====================

print("===== view(6,2) → 连续张量 =====")

x_contiguous = x.view(6, 2)

print(x_contiguous)

print(f"是否连续: {x_contiguous.is_contiguous()}")

print("-"*50)

# ===================== 3. transpose(0,1) 非连续张量(对应图右侧) =====================

print("===== transpose(0,1) → 非连续张量 =====")

x_non_contiguous = x_contiguous.transpose(0, 1)

print(x_non_contiguous)

print(f"是否连续: {x_non_contiguous.is_contiguous()}")输出

cpp

tensor([[ 1, 2],

[ 3, 4],

[ 5, 6],

[ 7, 8],

[ 9, 10],

[11, 12]])

是否连续: True

--------------------------------------------------

===== transpose(0,1) → 非连续张量 =====

tensor([[ 1, 3, 5, 7, 9, 11],

[ 2, 4, 6, 8, 10, 12]])

是否连续: Falsetranspose

transpose(dim0, dim1):仅交换两个指定维度,不复制数据- 二维 :

transpose(0,1)= 矩阵转置,等价于.t() - 视图特性:和原张量共享内存,修改任意一个都会同步变化

- 连续性 :

transpose会把连续张量变成非连续张量

示例

cpp

import torch

# ===================== 示例1:二维张量转置(最常用,矩阵转置) =====================

print("===== 1. 二维张量 transpose =====")

x = torch.arange(1, 7).view(2, 3) # 2行3列

print("原始张量:\n", x)

# 交换维度0和维度1(行和列)

y = torch.transpose(x, 0, 1)

print("转置后(3行2列):\n", y)

# 简写:x.t() 等价于 x.transpose(0,1)

print("简写x.t():\n", x.t())

print("-"*50)

# ===================== 示例2:三维张量交换维度 =====================

print("===== 2. 三维张量 transpose =====")

x = torch.randn(2, 3, 4) # 形状 [2,3,4]

print("原始形状:", x.shape)

# 交换维度1和维度2

y = x.transpose(1, 2)

print("交换dim1和dim2后形状:", y.shape) # [2,4,3]

# 交换维度0和维度1

z = x.transpose(0, 1)

print("交换dim0和dim1后形状:", z.shape) # [3,2,4]

print("-"*50)

# ===================== 示例3:验证transpose是视图(共享内存) =====================

print("===== 3. transpose 共享内存(修改一个,全变) =====")

x = torch.tensor([[1,2],[3,4]])

y = x.transpose(0, 1)

print("原x:\n", x)

print("转置y:\n", y)

# 修改转置后的张量

y[0, 1] = 999

print("\n修改y后,x自动变化:\n", x)

print("修改y后,y:\n", y)

print("-"*50)

# ===================== 示例4:transpose 生成非连续张量 =====================

print("===== 4. transpose 与连续性 =====")

x = torch.arange(1, 13).view(2, 6)

print("是否连续:", x.is_contiguous()) # True

y = x.transpose(0, 1)

print("转置后是否连续:", y.is_contiguous()) # False

print("转置步幅:", y.stride())

# 非连续张量转连续

z = y.contiguous()

print("contiguous()后是否连续:", z.is_contiguous()) # True输出

cpp

===== 1. 二维张量 transpose =====

原始张量:

tensor([[1, 2, 3],

[4, 5, 6]])

转置后(3行2列):

tensor([[1, 4],

[2, 5],

[3, 6]])

简写x.t():

tensor([[1, 4],

[2, 5],

[3, 6]])

--------------------------------------------------

===== 2. 三维张量 transpose =====

原始形状: torch.Size([2, 3, 4])

交换dim1和dim2后形状: torch.Size([2, 4, 3])

交换dim0和dim1后形状: torch.Size([3, 2, 4])

--------------------------------------------------

===== 3. transpose 共享内存(修改一个,全变) =====

原x:

tensor([[1, 2],

[3, 4]])

转置y:

tensor([[1, 3],

[2, 4]])

修改y后,x自动变化:

tensor([[ 1, 2],

[999, 4]])

修改y后,y:

tensor([[ 1, 999],

[ 2, 4]])

--------------------------------------------------

===== 4. transpose 与连续性 =====

是否连续: True

转置后是否连续: False

转置步幅: (1, 6)

contiguous()后是否连续: True