当前各家具身智能公司的机器人在传感器选型与布局上都不太一样------每一种组合背后,都是对场景、成本、算力与外观的不同权衡。本文介绍几家知名厂商当前的传感器选型与布局方案,再结合行业自身的发展脉络,对未来人形机器人"眼睛"的大方向做一些推测。

1. 问题澄清:传感器选型和布局到底在优化什么?

把人形机器人的感知栈拆开,行业里的主流矛盾其实很集中:

- 几何覆盖 :典型布局是 头周多路 + 胸/腹/背补盲 +(可选)底盘环视。工程上既要人一样的抬头视角,也要在货架、桌面、脚下形成互补视锥,减少单点遮挡。

- 深度从哪来 :路径包括 双目立体、RGB-D(结构光、ToF 等)、激光雷达、多源融合。取舍大致是:立体依赖纹理;RGB-D 近距精细但受阳光、材质影响;2D/3D LiDAR 对导航与避障友好,但成本高、外形难藏。

- 操作近场 :常见是 腕部或掌心小眼睛、手部触觉。柜内抓取、双臂交叉作业时,主视角常被手臂或柜体挡住,需要近距离冗余。

- 时间与带宽 :要 高帧率、低延迟的相机链路。端到端越主流,越像自动驾驶。

- 人机共存 :头壳隐藏式传感器、软包覆、指示灯/音频阵列 等。

2. 五花八门的视觉布局

2.1 Tesla Optimus Gen2

纯视觉路线:1 组双目;左右额角+后脑勺各1路RGB;头部遮罩。

从公开材料上看Tesla前视相机使用的FOV应是大畸变鱼眼相机(因图像中稍有暗角,推测FOV在150-180°)

并且头部相机完成了360°视野覆盖。下图中右下角机器人的四周局部感知均处于动态更新状态

总结:Optimus的感知叙事强绑定特斯拉视觉基因,但公开资料上并不支持Optimus完全复用了车载相机方案,笔者最大的困惑点是tesla是如何做到近乎0近距盲区的,是靠硬件的传感器还是通过融合算法或神经网络估计获得(作者倾向于相机完成了360°视野覆盖,神经网络融合解决近距离盲区问题)。

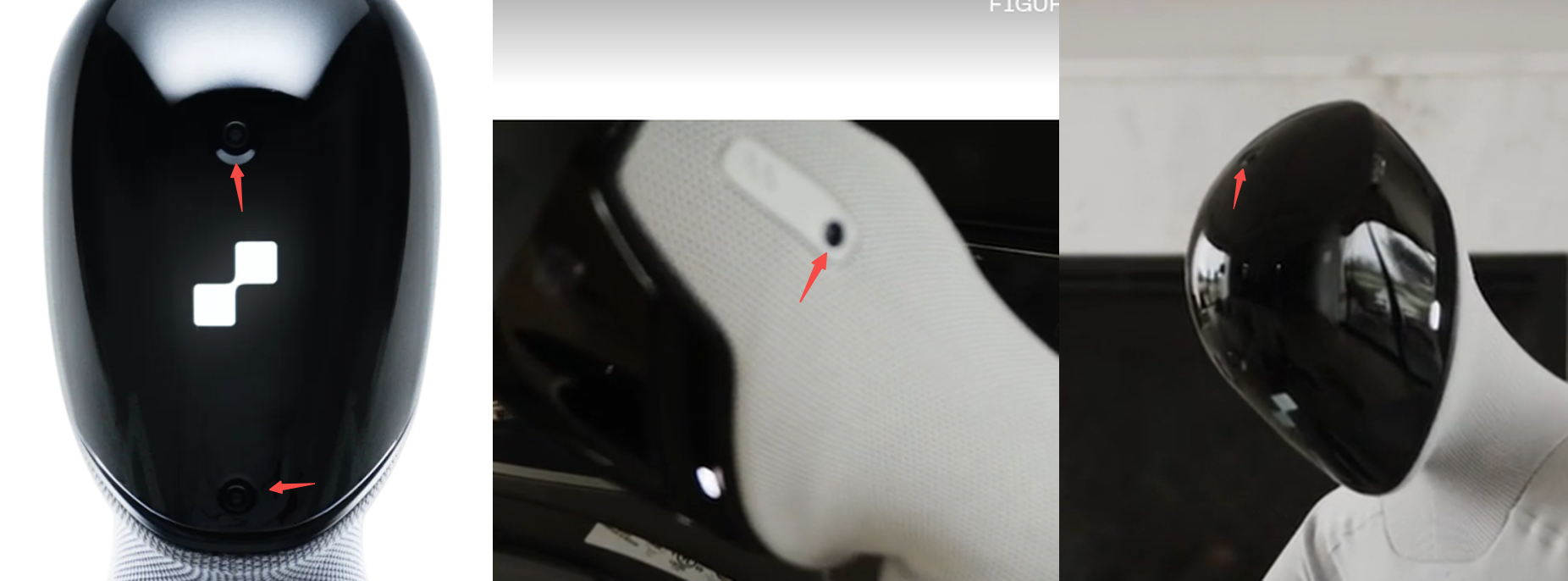

2.2 Figure 03

纯视觉路线 :下巴,额头,头顶和后脑勺各一个RGB相机。

Figure 03公开的机器人第一视角非常少且应该经过了裁切因此比较难直接推断FOV,但是官网对于Figure 03的介绍我们大致看出趋势:

- 系统级相机指标 :新一代视觉架构强调2× 帧率、1/4 延迟、单相机 FOV 提升约 60%(相对上一代)、景深扩大、体积更紧凑------这是相对量,不是绝对角度数值。这里虽然强调了FOV提升但未强调广角。

- 手部近场 :每只手集成掌心嵌入式相机,强调广角、低延迟;用途写得很直白:主相机被遮挡时(伸进柜子、狭窄空间)仍要保持视觉闭环。

- 触觉:自研指尖触觉,给出3克量级的力分辨能力。

总结:Figure 03头部应有4颗RGB相机,每个掌心各1颗广角RGB。FOV提升,帧率提升,延迟降低总体上也是往全局视野、端到端动作生成方向发展。

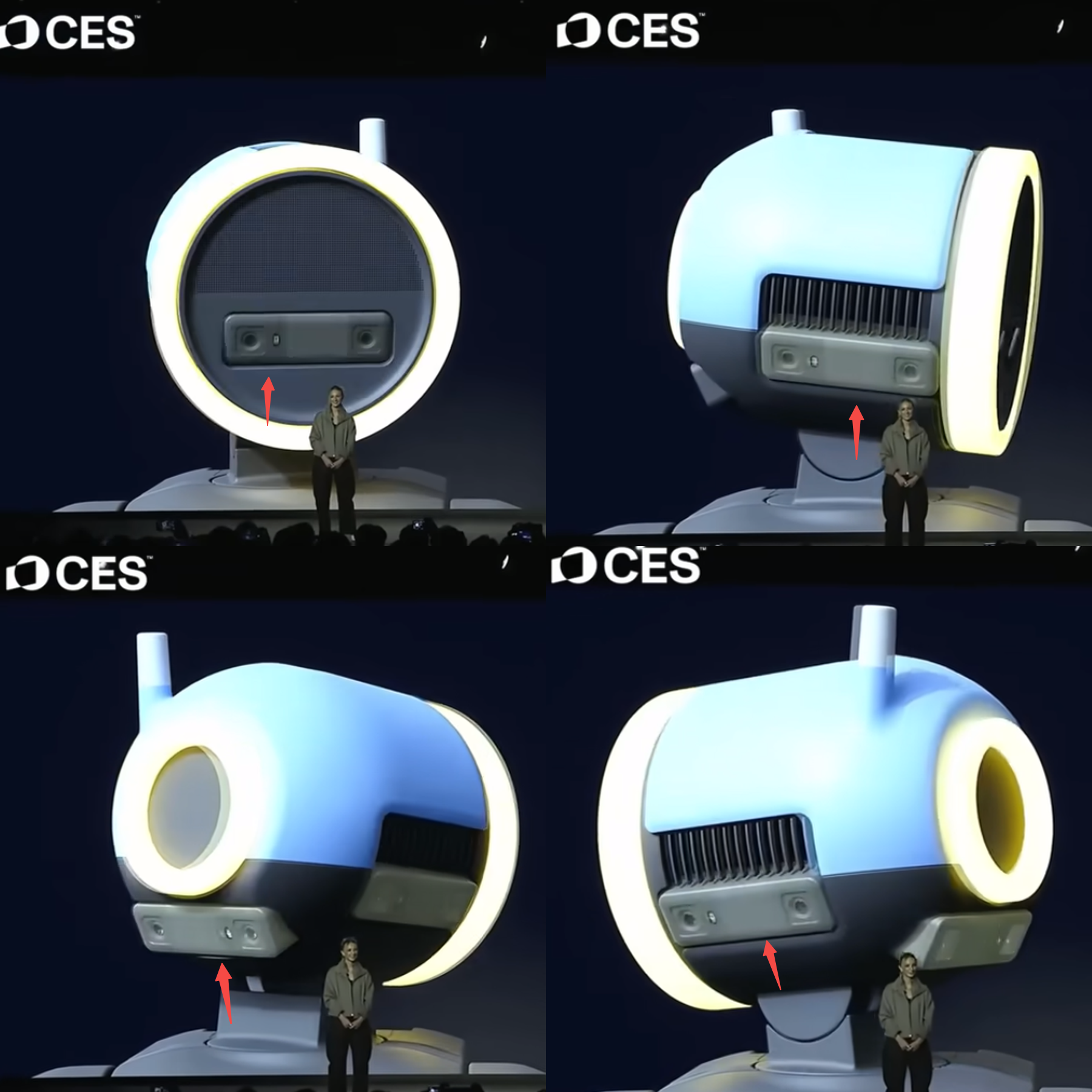

2.3 Boston Dynamics Atlas(电动版)

纯视觉路线:2025版本前视一个双目一个RGB,侧面有的版本有一个RGB,有的没有。这个机器更多的应该是一个原型机。公开视频上看相机水平FOV在120°~150°,虽有较大畸变,但无明显暗角

2026版本头部四周布局了4个双目模组,侧视双目安装角度略微下倾(大约10°),后视双目下倾更多(约30°)。官方明确360°视野,因此双目相机的FOV必然在100°以上。

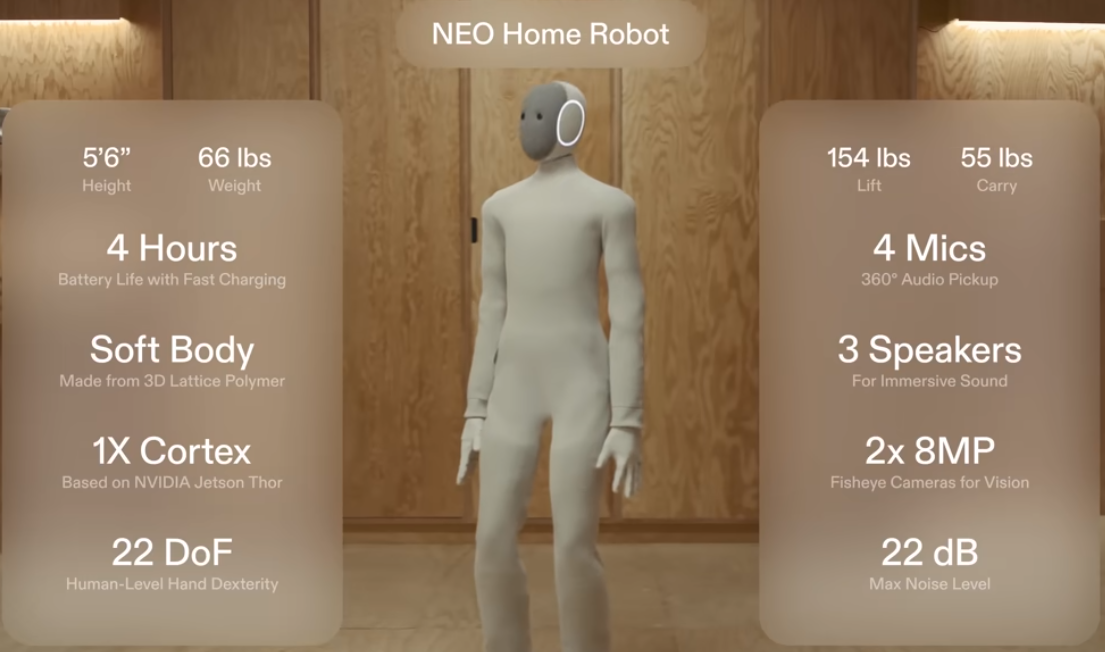

2.4 1X Technologies NEO

纯视觉路线: 800万像素、90 Hz双目鱼眼相机

布局含义 :把导航及大范围空间理解尽量收敛到头部立体鱼眼,是典型家用/近家用路线的低复杂度策略

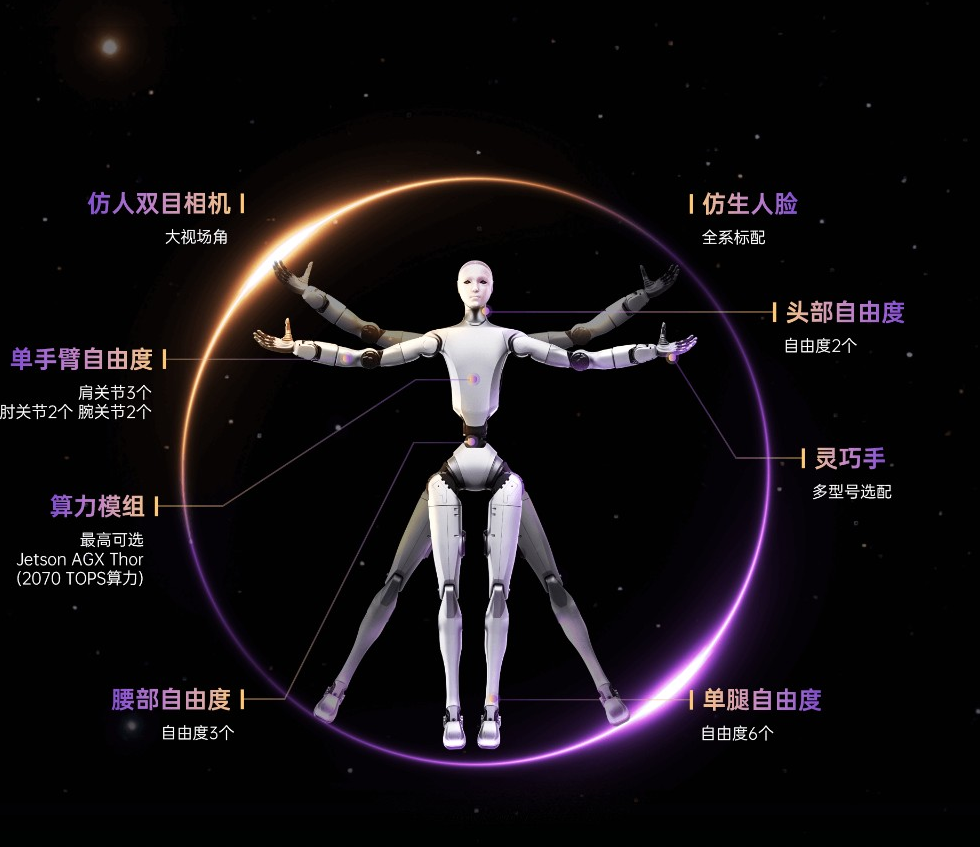

2.5 宇树家族

-

宇树G1(2024) :1 台头腔 LiDAR(Livox mid 360) + 1 路额头 RGB-D

-

宇树H2/R1 :仿人双目相机,官方介绍中H2为大视场角仿人双目相机,推测视场角应在120°以上

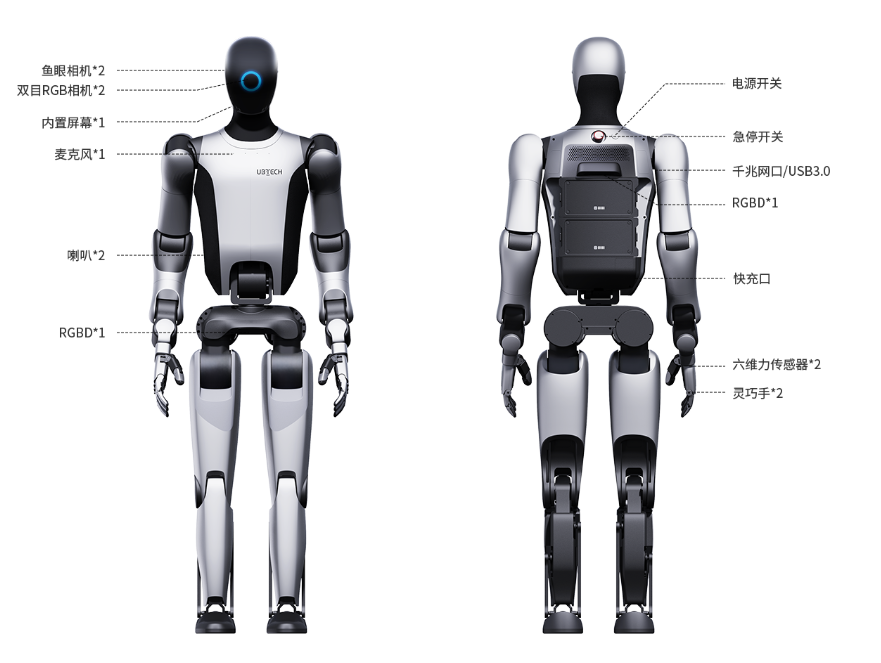

2.6 优必选

- Walker S2 :头部1组前视双目 + 2路左右鱼眼,下腹+后背2路RGB-D做躯干近场操作

2.7 智元

- 精灵G2 :2台3D底盘LiDAR + 1 路头部 RGB-D + 1路下巴双目相机 + 头部左右后 3 路鱼眼 RGB

5. 趋势判断

5.1 全向视野

人形机器人要仿人但更应该是超人。试想你一个人走夜路频繁回头看是不是很不方便?机器人可以通过头部周边部署多个相机实现360°无死角的视野覆盖。

整体上头部我比较青睐前视双RGB(FOV120-150°),左右后三颗鱼眼(FOV 180°)。整体分辨率保持在200万-500万像素,同时为了弥补导航和近距操作不同需求以及尽可能减少相机数量,前视可变焦距可能成为趋势。

5.2 高帧率 / 低延迟 / 同步

传感器的时间同步性是行业共识,这种共识在未来仍将持续。同时为了让机器人对环境变化反应更快,视觉传感器帧率,延迟要求将变高。

不排除业内会逐渐引入FPGA类似的硬件来实现传感器数据的集中采集和时间对齐,并打通与Nvidia计算核心的数据传输壁垒,实现从FPGA到Nvidia计算核心再到终端数据消费节点的零拷贝数据传输。

5.3 不看好腕部相机

虽然目前很多家机器人厂商都加了腕部/掌心相机。但从直觉上我依然觉得这不是好的方案,理由如下:

- 掌心或腕部相机一样会存在大量遮挡:掌心相机在拿到物体后会被完全遮挡,导致物体放置过程中依然只能依靠头部视觉。

- 腕部相机大大限制了机器人的操作空间,很多动作会因为腕部相机的干涉而无法完成

- 遮挡问题在自动驾驶中也出现了并尝试通过模型的方式来解决,世界模型应该具备预测遮挡物体全貌的能力

5.4 力觉进入数据管线

这里先说一下力觉的范畴:

- 末端触觉传感器

- 腕部六维力传感器

- 手臂关节力传感器

触觉传感器几乎是行业共识,为了完成对操作物体接触力的感知以及更加轻柔的操作,末端触觉传感器是唯一可行的选择。

六维力传感器依然是必要的,主要作用是在机器人操作物体过程中能够实时估计目前正在操作多大的负载。除非是未来进化出覆盖全部手掌的触觉传感器,这样可以通过触觉阵列估计负载。负载估计的主要用途是关节的动力学前馈,为了保证手臂始终处于柔性状态,避免刚性碰撞带来的机器人或环境损坏。

手臂的关节力传感器一是比较娇贵,二是会降低手臂刚度,三是电流结合动力学估计关节力矩也可以达到百分之七八十的准确度,因此我不太看好在关节端增加扭矩传感器。

5.5 底盘与上肢的传感器交融

目前底盘和双臂拟人上肢依然处于两张皮的状态,随着行业的发展,两者使用的传感器会出现交融。底盘上的激光雷达和深度相机可能会被头部的传感器组合直接取代,底盘将变得更加纯粹,可能只会保留超声波,IMU等少数传感器。