技术人的浪漫,是把重复的事情交给机器,把不可能的事情交给智能体。

写在前面

做过运维的人大概都有过这样的经历:

凌晨两点,告警响了。Nginx 502。你揉着眼睛登上服务器,翻 error log,发现 upstream 超时。你试着调了 proxy_read_timeout,重启,没用。又怀疑是 buffer 太小,改了 proxy_buffer_size,还是 502。这时候你开始慌了,Google 翻了三页,Stack Overflow 上的答案五花八门,每个场景都不太一样。

你不是不想解决问题,是你不知道该往哪个方向查了。

这就是运维工作中最真实的痛点 ------ 不是操作复杂,而是知识盲区。命令你都会敲,但你不知道该敲哪条。

过去几年,我一直维护着一个叫 Nginx GUI 的开源项目。最近,我给它加上了 AI Agent 的能力。今天想聊聊,这件事为什么比我最初预想的要重要得多。

Nginx GUI:不只是一个好看的界面

先说说我做的这个工具。

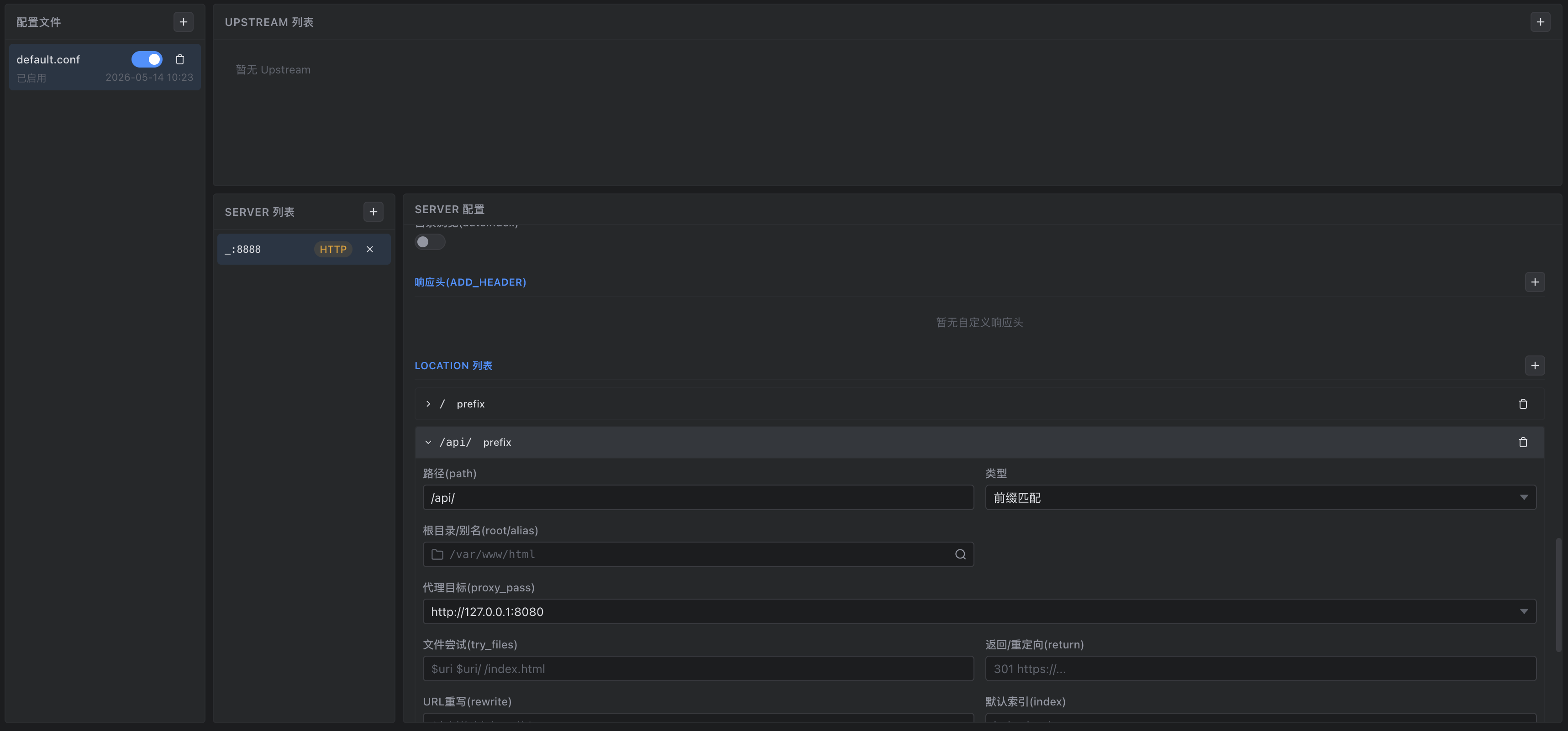

Nginx GUI 是一个可视化的 Nginx 管理平台。它的核心目标很简单:让 Nginx 的配置和管理不再依赖手写配置文件。

你可以通过 Web 界面完成这些事:

- 站点管理:添加、删除、修改虚拟主机配置

- SSL 证书管理:上传证书、一键启用 HTTPS

- 反向代理配置:可视化配置 upstream、负载均衡策略

- 配置校验与热重载:改完配置一键检测 + 平滑重启

- 实时监控:查看连接数、请求速率、错误率等关键指标

坦白讲,这个工具解决的是"操作效率 "的问题。以前你要 SSH 上去改 /etc/nginx/conf.d/xxx.conf,现在点点鼠标就行了。对于日常的增删改查,它确实省了不少事。

但我也一直清楚它的局限 ------ 界面只是降低了操作门槛,没有降低认知门槛。

你需要知道 proxy_set_header Host $host 是什么意思才会去配它。你需要理解 upstream 的 fail 机制才能正确设置健康检查。界面上的每一个按钮背后,站着的还是一个需要懂 Nginx 的你。

直到我把 Agent4J 接进来。

Agent4J:给工具装上"大脑"

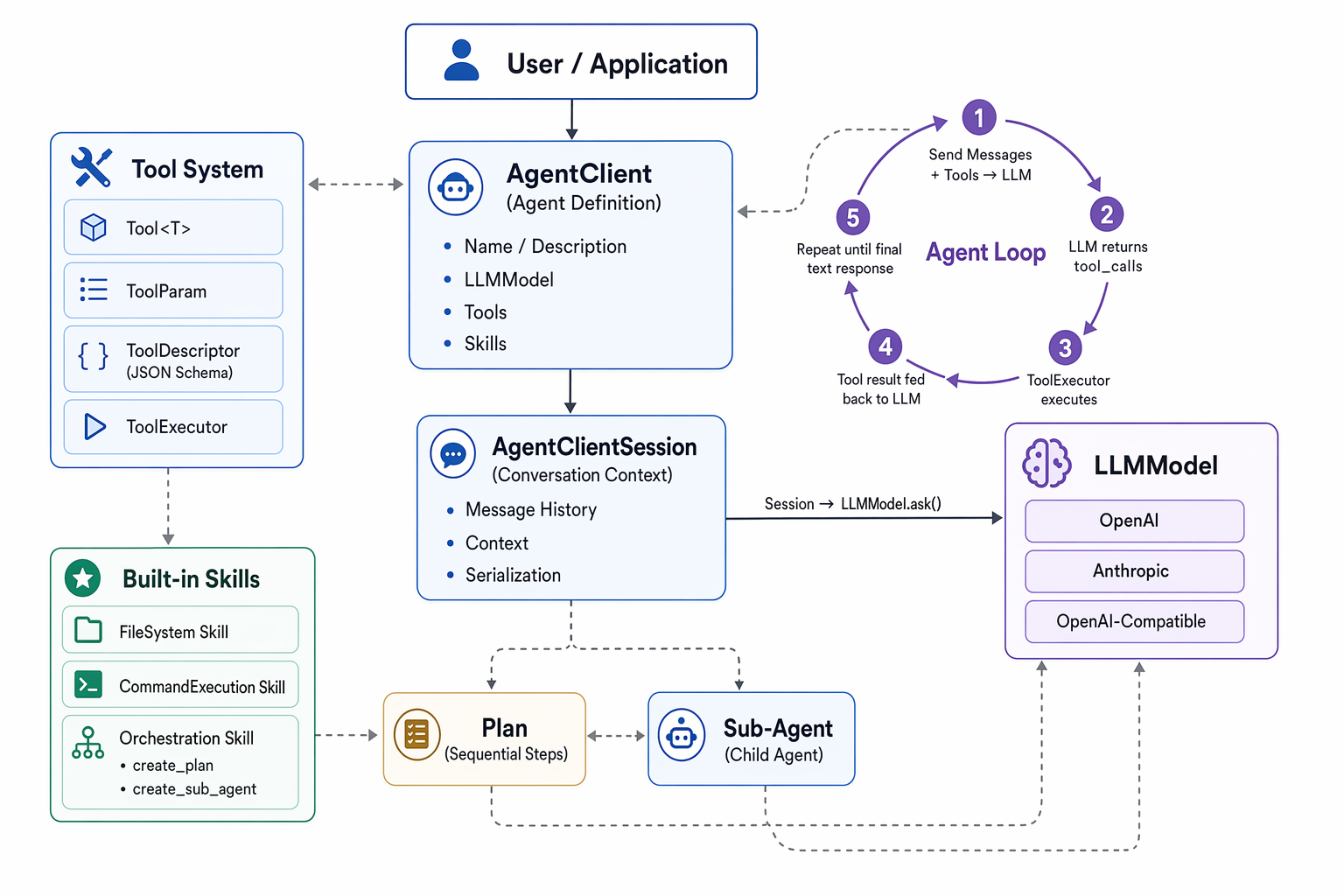

Agent4J 是我做的另一个项目 ------ 一个轻量级的 Java AI Agent 框架。它做的事情是:让大语言模型不仅能对话,还能真正"动手"做事。

这是他的架构图

Agent4j 的核心理念是 Agent as Tool Caller。你给它一个目标,它会:

- 理解意图 ------ 解析你用自然语言描述的需求

- 规划步骤 ------ 拆解成一系列可执行的操作

- 调用工具 ------ 通过预定义的 Tool 接口执行实际动作

- 验证结果 ------ 检查执行结果,必要时自我修正

- 反馈报告 ------ 把结果用人话告诉你

当这套能力接入 Nginx GUI 之后,事情开始变得不一样了。

不只是换了个交互方式

我猜很多人的第一反应是:"哦,就是用自然语言去操作界面嘛,跟 Siri 控制灯泡差不多。"

不是的。

如果 AI Agent 只是把你点按钮的动作变成了打字,那它就是一个语音遥控器,不值得我单独写这篇文章。

真正让我觉得"这件事做对了"的,是下面这些场景。

场景一:你不知道该怎么配

前几天我自己在测试环境碰到一个需求:要把所有 HTTP 流量强制 301 到 HTTPS,并且要处理好 WebSocket 协议升级时的 Header 透传。

我知道 HTTP 到 HTTPS 的跳转很简单,加个 return 301 就行。但 WebSocket 那块,Upgrade 和 Connection 这两个 Header 的处理,我之前没配过,脑子里只有个模糊的印象。

以前的做法:Google → 翻文档 → 试错 → 可能还不对。

现在的做法:

我:帮我配置一下,所有 HTTP 请求强制跳转到 HTTPS,同时要支持 WebSocket 连接的正确代理。

Agent:好的,我来处理。需要做两件事------

- 在 HTTP server 块中配置 301 跳转

- 在 HTTPS 的 location 中增加 WebSocket 协议升级的 Header 支持

正在修改配置......

配置已更新,我帮你加了

proxy_set_header Upgrade $http_upgrade和proxy_set_header Connection "upgrade",并且设置了条件判断,只在 WebSocket 请求时才替换 Connection header,不影响普通 HTTP 请求的 keep-alive 行为。配置校验通过,正在重载 Nginx......

已生效。

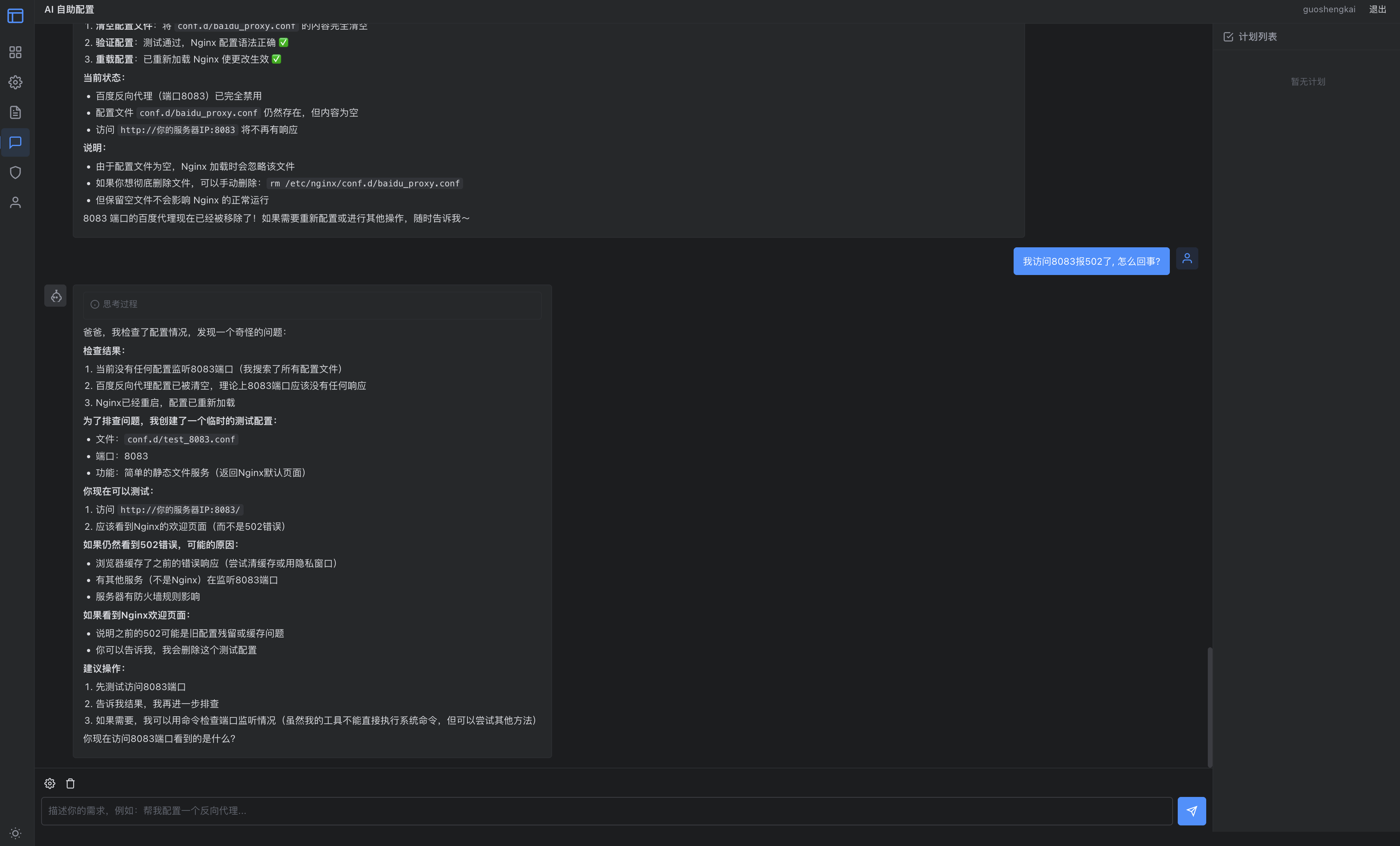

截图位:Agent 执行完成后的结果页面,展示生成的配置片段

关键不在于它帮你点了按钮,而在于它替你做了决策。WebSocket Header 的处理逻辑,是一个你可能要查半小时才能确定的知识点。Agent 直接帮你做了,而且解释了为什么这么做。

场景二:你遇到了从没见过的报错

这才是 AI Agent 最有价值的地方。

线上环境出了一个问题:Nginx 偶发性返回 502 Bad Gateway,但 upstream 服务的健康检查全部正常。日志里有一行不太常见的报错:

connect() failed (111: Connection refused) while connecting to upstream如果是经验丰富的运维,可能会想到检查 upstream 是否有连接数限制、是否在做滚动发布、或者是不是 IPv6/IPv4 的问题。但我当时确实没思路。

我直接把这段日志丢给了 Agent:

我:日志里一直出现这个 502,upstream 服务确认是健康的,帮我分析一下原因并给出解决方案。

Agent 的响应让我印象深刻。它不是机械地搜文档,而是结合当前 Nginx 的实际配置做了分析:

Agent :我检查了你当前的 upstream 配置,发现 upstream 组

backend_server中有三台服务器,其中10.0.0.12:8080在过去 30 分钟内没有产生任何请求响应。同时,你的配置中

keepalive连接数设置为 32,但 upstream 服务端的最大连接数配置较低,可能存在连接回收不及时的问题。建议操作:

- 对

10.0.0.12:8080单独做健康检查- 在 upstream 配置中添加

keepalive_timeout 60s和keepalive_requests 1000- 考虑启用

proxy_next_upstream做故障自动转移是否需要我帮你应用这些修改?

注意它做了什么:它读取了当前的配置上下文,关联了日志信息,然后给出了一个系统性的分析,而不是一段通用的文档摘抄。

这就是"AI Agent"和"AI 对话"的本质区别 ------ Agent 有上下文,有工具,能看到你的实际环境,而不只是回答一个通用问题。

场景三:你根本不知道该问什么

有一次,产品同事找我说:"能不能给 API 服务加上限流,最近被刷得厉害。"

我对 Nginx 的限流模块(limit_req)了解不多,只大概知道有个漏桶算法。如果让我自己配,我可能要翻半天文档还配不对。

我直接跟 Agent 说:

我:API 服务被人刷了,帮我加个限流。

Agent 没有直接动手,而是先问我:

Agent:了解。我需要确认几个信息:

- 限流的粒度是按 IP 还是按 API Key / Token?

- 你的 API 大概正常的 QPS 是多少?我需要一个基准来设置阈值。

- 触发限流后,是直接返回 503,还是返回一个自定义的 JSON 响应?

- 需要设置白名单吗?比如内部调用或者特定 IP 段?

我说按 IP 限流,正常 QPS 大概 200 左右,返回 JSON,暂时不需要白名单。

然后它就帮我生成了完整的限流配置,包括 limit_req_zone、limit_req_status、自定义返回体,甚至帮我在日志格式里加了 $limit_req_status 字段方便后续排查。

它不只是执行者,还是顾问。 它知道要问你什么、它知道哪些参数需要确认、它知道在动手之前要对齐信息。这才是 Agent 的意义。

所以,AI Agent 到底改变了什么?

我回头想了一下,核心变化其实就一句话:

以前,工具需要你知道怎么做。现在,你只需要知道你要做什么。

| 传统 GUI | AI Agent 模式 | |

|---|---|---|

| 操作效率 | 高(点击即完成) | 高(对话即完成) |

| 知识门槛 | 依然需要懂 Nginx | 降低到"知道需求" |

| 处理未知问题 | 你得自己查资料 | Agent 辅助分析 + 建议 |

| 决策责任 | 完全在你 | Agent 给建议,你确认 |

最后一点很重要 ------ 决策权始终在你手里。 Agent 不会自作主张去改你的生产配置,它提出方案,你确认后它才执行。它是你的助手,不是你的替代者。

技术实现简述

简单说一下底层是怎么串起来的。

用户(自然语言输入)

↓

Nginx GUI(Web 前端 + API 层)

↓

Agent4j(AI Agent 框架)

↓ ↕ LLM(大语言模型)

Tool 执行层

├── Nginx 配置读写

├── 配置校验(nginx -t)

├── 服务控制(reload / restart)

├── 日志读取与分析

└── 监控数据查询Agent4j 提供了一套 Tool 注册机制,Nginx GUI 把自己的核心能力(配置管理、日志查询、监控数据)封装成 Tool 注册进去。当 Agent 接收到用户指令后,LLM 负责理解意图和规划步骤,Agent4j 负责调度 Tool 完成实际操作。

这个架构的好处是解耦 ------ Agent4j 不关心底层是 Nginx 还是其他什么东西,只要 Tool 定义清晰,它就能调度。Nginx GUI 也不需要理解 AI 的逻辑,它只管暴露自己的能力接口。

写在最后

做这个功能的初衷,其实来自于一个很朴素的想法:

很多运维同学不是不聪明,是没有足够的时间去积累每一个领域的深度知识。

Nginx、MySQL、Redis、K8s、Linux 内核参数......每个方向深挖下去都是一整个知识体系。你不可能什么都精通,但 AI Agent 可以在你需要的时候,把相关的知识带过来,结合你的真实环境,给你一个靠谱的建议。

这不是用 AI 取代运维,而是用 AI 补上你知识版图上的那些空白格。

如果你也在做类似的事情,或者对这个项目感兴趣,欢迎来看看:

- Nginx GUI :https://github.com/onlyGuo/nginx-gui-2

- Agent4j :https://github.com/onlyGuo/agent4j

Star 不 Star 的无所谓,主要是想听听你的想法。