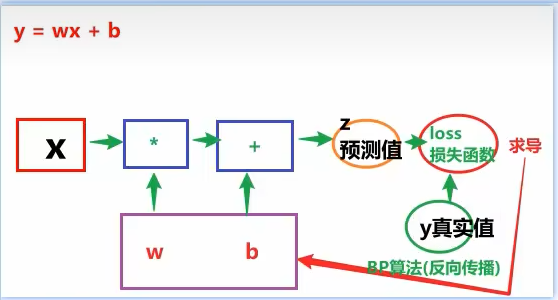

多元线性回归是 y=wx+b,x一般充当特征、z充当预测值(相当于上面公式里的y),z如何来的?:x * w + b,得到的是预测值 z,预测值下面会有一个与之对应的 y真实值,想要描述预测值 z和真实值y 之间的关系用 loss损失函数,为了让损失最小,需要求导:之前做求导需要手动计算,现在可以通过自动微分 帮忙求导,算出导数,再反向把值传到下框中,用来更新 w和 b;

为什么叫反向传播 ?:因为从 x - -> w 乘 、b加 - -> 拿到预测值z、结合真实值y - -> 得到损失函数;(绿色标注的、从左往右一直到计算出损失函数的过程叫正向传播),拿到损失函数进行求导,求导的目的是为了让损失最小,所以会将求导结果带入到下框 更新 w和b,更新完 w和b后,再次进行下一轮的正向传播,又可以得到新的预测值,再结合真实值再次计算损失,这个损失值肯定是会一次次降低的,算完后拿着导数(梯度)再次更新 w和b参数,更新完后第二轮传播结束;

第三轮拿着更新后的 w和b,与x一起再次计算预测值,预测值与真实值一起再计算损失求导,拿到导数再次更新 w和b...

所以从前往后叫正向,求导后拿着导数反向更新 w和b的值的动作叫做 BP算法**(Back Propagation 反向传播)**;