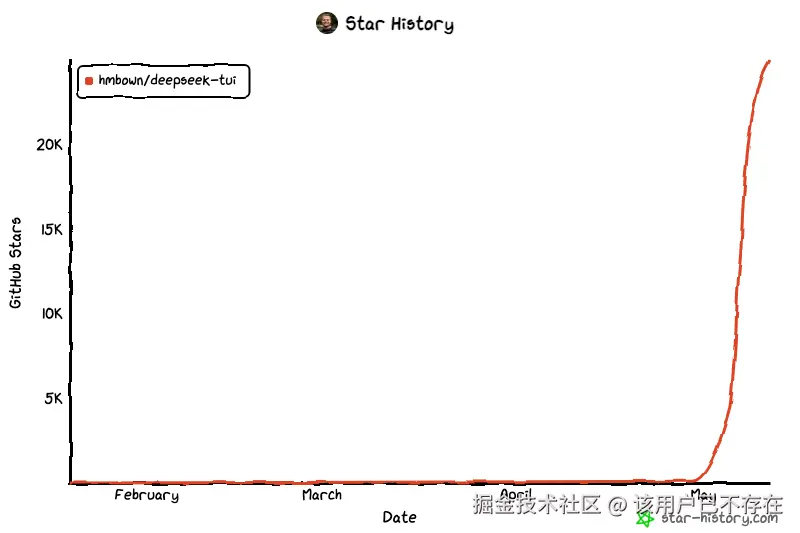

最近,一个基于 Rust 编写的开源项目 DeepSeek-TUI 在 GitHub 上的热度持续飙升,短短时间内狂揽超过两万三千颗星。这不是 DeepSeek 官方出品的工具,而是由美国独立开发者 Hunter Bown 打造的第三方项目。

这位美国佬还挺懂社区文化,不仅积极听取反馈,还用户群体称为鲸鱼兄弟。由于体验极佳,社区里的开发者普遍将其视为 DeepSeek版 Claude Code。

(最新消息,这哥们儿搞了个微信账号,在微信群里活跃得不像个真人。)

过去一年里,大模型本身的迭代固然吸引眼球,但真正改变研发工作流的,往往是贴合开发者习惯的周边工具。DeepSeek V4 发布后,凭借 100 万 token 上下文和极高的性价比震撼了整个圈子。开发者如果在网页版进行对话,不仅要频繁复制粘贴代码,还无法让 AI 直接操作本地文件,整体效率大打折扣。

早前不少人习惯使用 Codex 来辅助编程,但前阵子 Codex 的一次 API 升级彻底切断了对 V4 模型的支持。开发者迫切需要一个 国产 Codex CLI 的替代方案。DeepSeek-TUI 恰好填补了这一生态位,它被设计为一个 DeepSeek 原生终端 Coding Agent,彻底打通了模型与本地开发环境的壁垒。

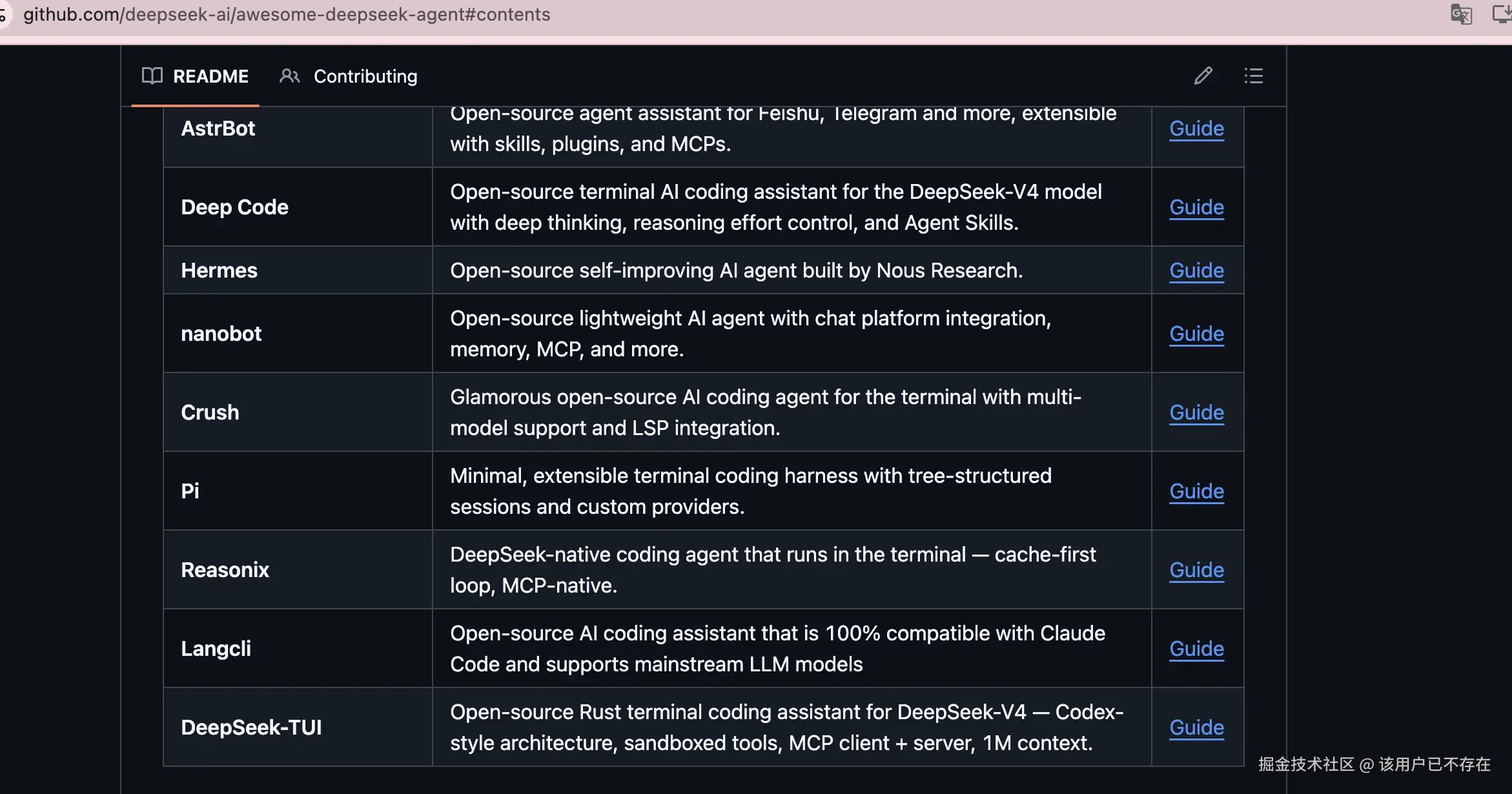

而且DeepSeek-TUI 也被官方翻牌,成了 DeepSeek 的推荐 Agent 之一。

吃满 100 万 Token 与透明的思维链路

DeepSeek V4 最突出的优势就是长上下文处理能力。100 万 token 的容量足以容纳一个中型项目的全部源代码。使用传统工具时,开发者往往需要手动挑选特定文件喂给 AI,容易导致模型丢失全局视野。现在,代码库的目录结构、模块依赖以及配置文件可以一次性被模型读取。修改底层接口时,模型能精准判断出牵一发而动全身的关联代码,避免盲目猜测。

长对话容易导致模型失忆是很多同类工具的通病。由于拥有极大的上下文窗口,开发者可以在同一个会话中完成从需求梳理、架构设计到代码编写的全流程,模型的判断逻辑自始至终保持一致。

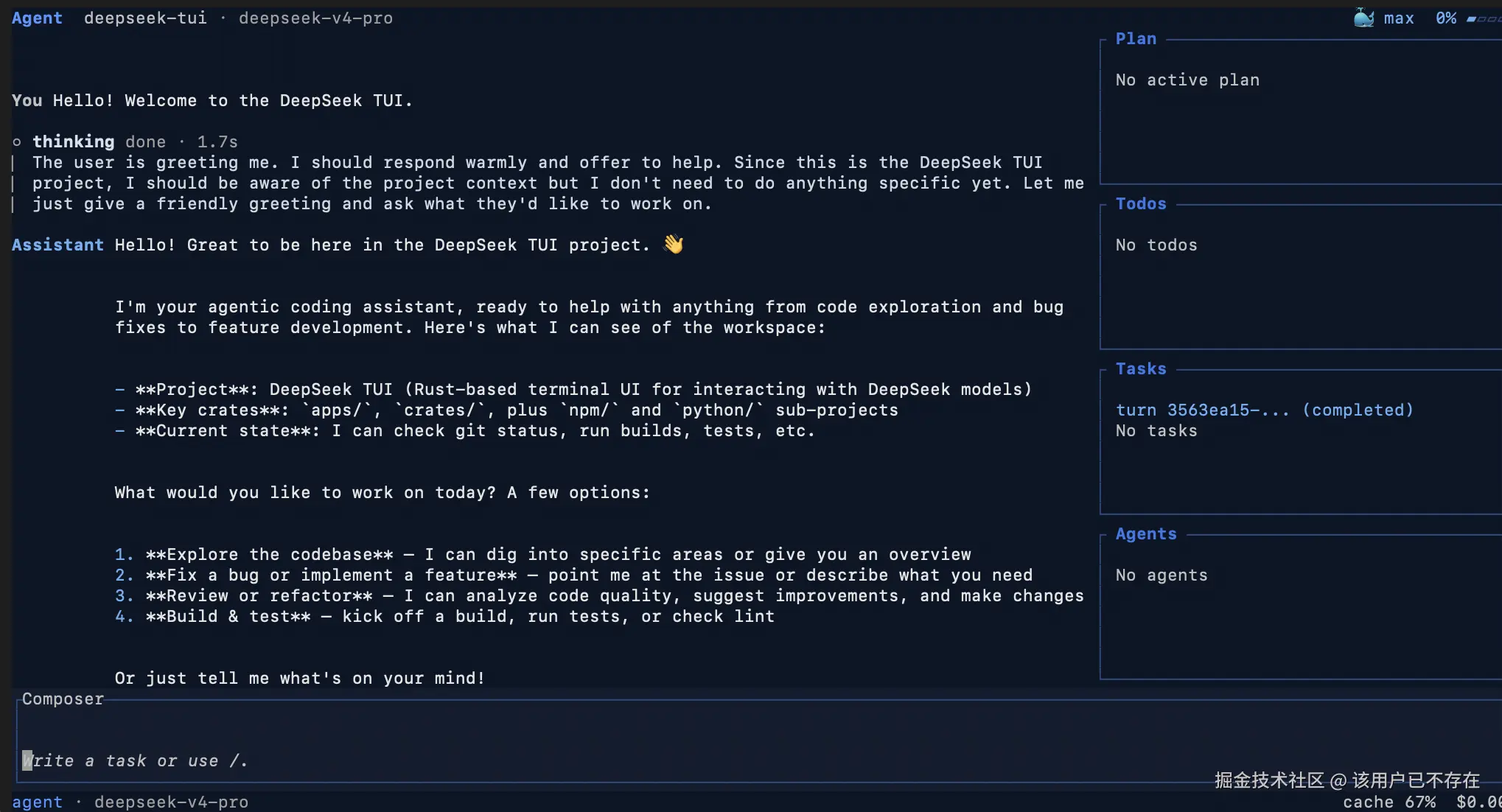

该工具原生支持了 V4 模型的思考模式。终端屏幕上会实时流式输出模型的推理过程。开发者能清晰看到 AI 决定修改某行代码的具体缘由,整个除错与构建逻辑一目了然,不再是一个只会输出最终结果的黑盒。

灵活的三种工作模式与智能调度

为了适应不同场景,项目提供了 Plan、Agent 和 YOLO 三种截然不同的运行模式。

Plan 属于观察模式。AI 会先全局扫描项目代码,梳理出执行计划并列出待办事项,期间不会对本地文件做任何实质性修改。非常适合在动手前评估方案可行性。

Agent 属于交互模式。AI 会主动调用各种工具读取文件或执行 Shell 命令,但遇到关键的修改步骤会停下来等待人工审批。这种模式兼顾了效率与代码安全。

YOLO 则属于全自动放权模式。AI 拿到需求后自主推进全流程任务,无需任何人工确认。

为了平衡效率与开销,开发者还设计了 Auto Mode 智能调度功能。系统会根据当前任务的复杂程度,自动在成本更低的 V4-Flash 和推理更强的 V4-Pro 之间切换。搭配扇出机制,系统甚至能在一次任务中并行调用多达 16 个子智能体同时处理琐碎工作,大幅缩短了整体耗时。

实战检验与极具优势的开发成本

讨论工具好坏离不开具体场景,很多人好奇 如何在终端用 DeepSeek 自动修 Bug。在针对某款 Android 开源自动化项目的实测中,下达指令后,工具会自动克隆 Git 仓库,深入阅读 Kotlin 源码并理清函数调用链路。发现潜在问题后,它会自主生成补丁文件,运行差异比对,并验证修复结果。从阅读代码到修复完成,整个过程形成了一个完整的自动化闭环,耗时十多分钟。

这种工作流彻底颠覆了网页端的聊天式编程。AI 不再单纯提供修改建议,而是亲自下场干活。

成本方面同样令人惊喜。DeepSeek V4 Flash 的定价极具攻击性,输入百万 token 仅需 0.14 美元,输出百万 token 为 0.28 美元。对比市面上主流的海外闭源大模型,费用差额高达数十倍。一次包含复杂排错和小型应用开发的长会话,总花费通常不到十元人民币,普通开发者完全能够毫无负担地将其作为日常生产力工具。

极简的安装与多平台支持

尽管底层基于 Rust 的双二进制架构开发,多平台的部署过程却非常省心。对于习惯 Node 生态的开发者,直接运行 npm 全局安装命令就能搞定。

bash

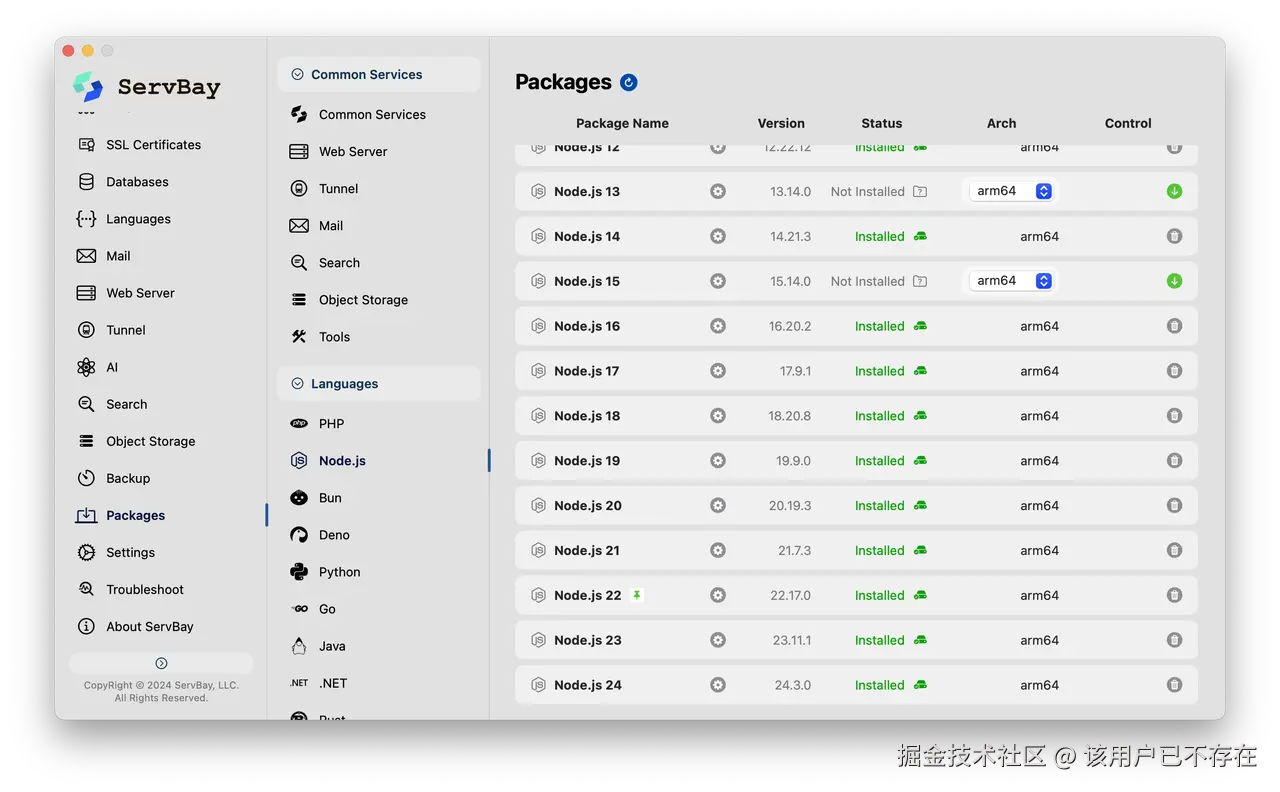

npm install -g deepseek-tui要是本地没有现成的环境,使用 ServBay 一键部署 Node 环境就是一个不错的选择。特别是 macOS 用户,借助 ServBay 完全不用再去折腾容易出依赖报错的 Homebrew,整个安装流程同样顺畅无阻。

偏好原生构建的 Rust 开发者则能利用 Cargo 包管理器直接编译。

bash

cargo install deepseek-tui-cli --locked # `deepseek` 入口

cargo install deepseek-tui --locked # `deepseek-tui` TUI 二进制初次启动并按指引填入 API 密钥后,本地终端瞬间变成智能编程工作站。后续若要接入其他自动化流水线,还可以利用原生支持的 MCP 协议或内置的 API 服务模式做深度定制。

随着底层模型的飞速进化,比拼参数大小的时代正在过去,围绕模型构建的工程化能力正成为新的主战场。DeepSeek-TUI 的爆火证明了优秀的模型配上量身定制的工程外壳,能够爆发出惊人的生产力。整个生态圈也正期待着未来能涌现出更多这样接地气的优秀开源实践。