国产化环境下运维平台如何做到全栈适配、自主可控?

作者:美玲

FAQ

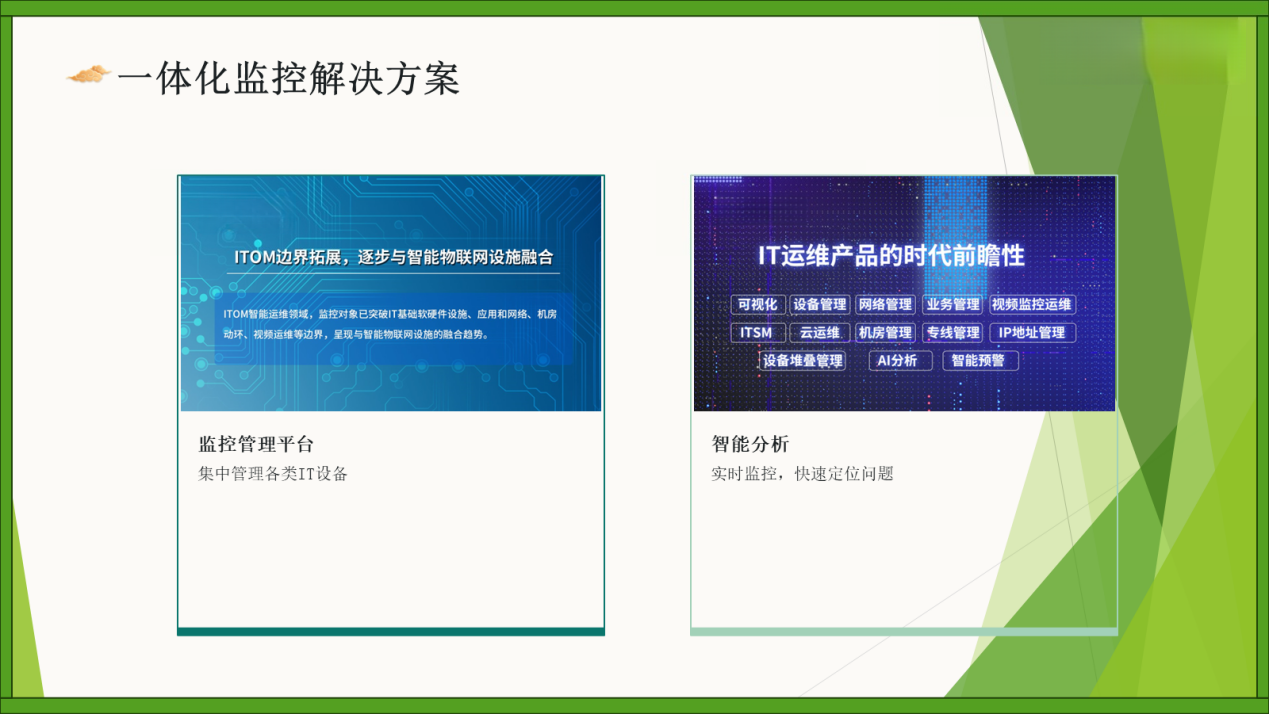

Q1:一体化监控相比传统多工具组合有哪些优势?

A:主要体现在三个方面:一是打破数据孤岛,实现统一数据视图;二是降低运维复杂度,减少工具切换成本;三是提升故障响应速度,借助AI分析实现智能预判和快速定位。

Q2:平台是否支持边缘设备和远程节点监控?

A:支持。通过分布式采集架构和轻量级代理程序,可在带宽受限或网络不稳定的边缘环境中稳定运行,保障监测数据的实时性与完整性。

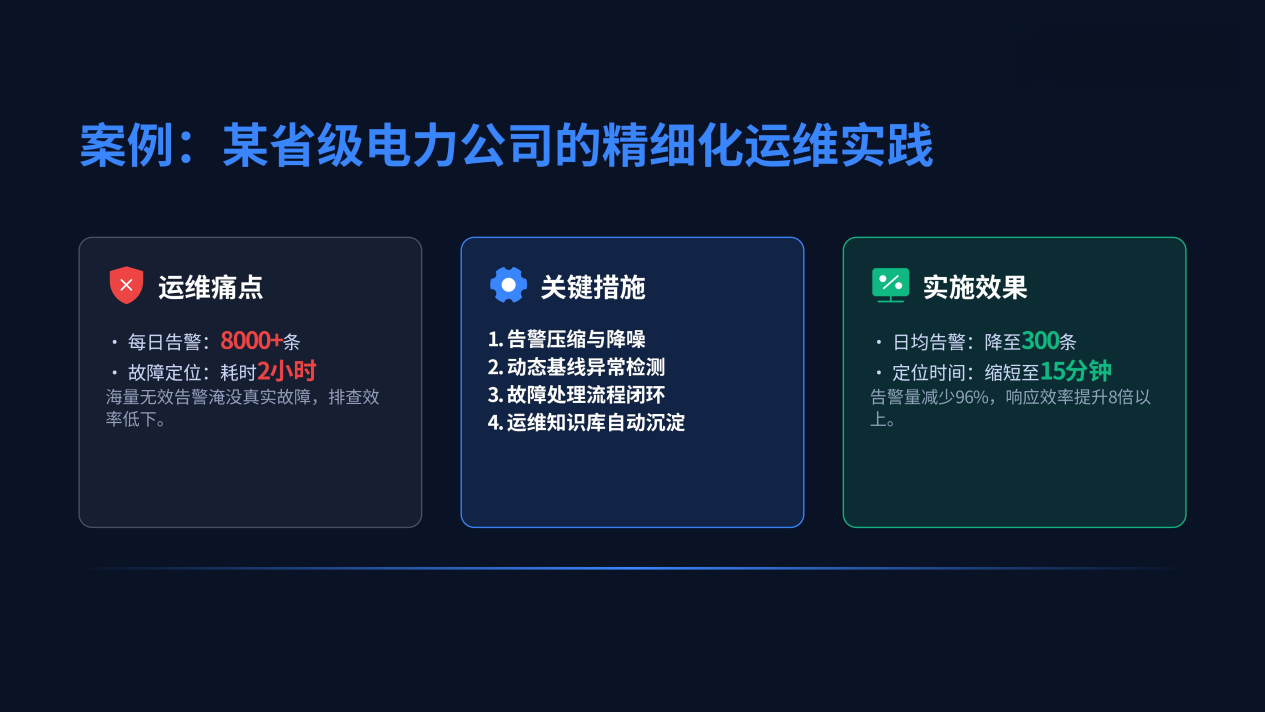

Q3:如何验证平台的实际效果?

A:可通过关键指标进行量化评估,例如单服务器承载监测点数量、平均故障排查时间缩短比例、告警准确率提升幅度等,结合具体业务场景进行前后对比验证。

摘要

在企业数字化转型加速推进的背景下,IT基础设施日益复杂,跨区域、多层级的运维管理面临前所未有的挑战。传统的"多工具拼接"模式导致数据割裂、响应滞后,难以支撑现代业务连续性需求。本文探讨一种新兴的"一体化运维监控"新范式,聚焦其在大型集团、智慧医院、电力交通等关键行业的应用实践。通过融合多协议采集、AI智能分析、自动化引擎与可视化技术,这类平台正逐步重构IT运维的工作方式。文章结合真实可验证数据------如"单台服务器可纳管超1万个监测点""故障处置效率提升60%以上",揭示技术落地带来的实质价值,同时展望未来智能运维的发展方向。

**一、**一体化运维:从碎片化到全局掌控的必然演进

说实话,我刚入行那会儿,一个企业的IT监控环境真是五花八门:服务器用一套工具,网络设备再装一个客户端,数据库又有单独的监控软件......运维同事每天得在三四种界面之间来回切,像极了厨房里同时开火的五个灶台,忙得团团转却不知道哪锅快糊了。

这种"工具林立"的局面,本质上是历史发展的产物。早期各类设备缺乏统一标准,厂商各自为政,监控自然也就分散了。但随着云计算、边缘计算、混合架构的普及,这套老办法越来越玩不转了。

尤其是在一些全国性集团企业中,总部要管几十个分支机构,每个地方还有自己的本地IT团队。以前的做法是各地自己买监控软件,结果就是数据不通、策略不一、出了问题层层上报,等总部搞清楚状况,系统已经宕了几小时。

这时候,"一体化"的概念就开始浮现了------能不能有一套平台,把所有资源都收进来?

不是简单地堆功能,而是真正打通底层数据流,让服务器、交换机、防火墙、云主机、甚至机房里的UPS和空调,都在同一个界面上看得清清楚楚。这听起来像是理想主义,但在近几年,确实已经有成熟的方案跑起来了。

**二、技术底座决定天花板:分布式架构 +**多协议接入才是关键

很多人以为"一体化"就是做个好看的仪表盘,把各种数据扔上去就行。其实远不止如此。真正的难点在于"怎么拿得到数据"。

你想啊,一台华为的交换机用的是SNMP,一台超融合一体机要用IPMI,云上的虚拟机靠Agent采集,某些老旧系统只能走SSH命令行......要是平台不支持这些协议,再漂亮的UI也是空中楼阁。

所以,真正能打的平台,第一个硬指标就是多协议接入能力。目前业内较先进的系统已支持Agent、SNMP、IPMI、SSH、WMI、JMX、REST API等多种采集方式,覆盖市面上95%以上的IT基础设施类型。

但这还不够。光能"连得上"不行,还得"扛得住"。

我们看过一个案例:某大型制造企业在实施一体化监控前,原有监控系统每5分钟轮询一次,遇到高峰时段经常丢数据。换完新平台后,最小轮询频率做到了5秒级采集,而且单台采集服务器就能支撑超过1万个监测点的并发处理。

这个数字不是吹出来的,是实打实压测出来的。背后靠的是分布式采集集群架构,可以在总部、区域、站点三级分别部署采集节点,既减轻中心压力,又能应对网络抖动。

我记得有个客户做过测试:他们在新疆的一个厂区网络不稳定,以前每次断线都要人工重连,现在通过边缘节点缓存+断点续传机制,哪怕网络中断半小时,恢复后也能把期间的数据补传回来,完整率接近100%。

这才是"可靠数据基石"的真正含义。

**五、**场景落地才是试金石:典型行业的实践启示

再好的技术,也得经得起实战检验。这几年我们观察到几个典型的落地场景,特别有代表性。

1.智慧医院:保障生命线系统的稳定

一家三甲医院采用了全栈监控方案后,实现了从网络链路到应用接口的全链路追踪。他们最满意的一点是:能提前发现潜在风险。

比如有一次,系统通过分析数据库日志,发现某个存储过程执行时间逐日递增,预测7天后将导致页面超时。运维团队提前优化了索引,避免了一次可能的大面积瘫痪。

他们还把机房动环监控和IT设备监控放在同一平台管理。空调故障不再只是"温度异常"的提示,而是直接关联到受影响的服务器列表,联动生成工单。

结果呢?过去一年平均每月2次系统告警,现在下降到不足0.3次;用户投诉率下降85%,真正实现了"365天×24小时"平稳运行。

2.集团企业:破解跨区域管控难题

前面提到的那个全国性集团,之前用三套不同的监控工具管理下属公司,总部想看整体IT健康度,得找人手工汇总Excel。

后来上了统一平台,通过四级部署架构(总部---大区---省区---站点)实现分级管理、集中可视。每个层级有自己的操作权限,但关键数据全部汇聚到中央数据库。

最直观的变化是:一次跨区域网络故障的排查时间,从3小时以上缩短到15分钟内定位。总部可以通过网络拓扑自动发现功能,一键查看任意两个节点之间的路径,并叠加延迟、丢包率等实时指标。

他们还做了个创新:把IP地址管理和资产台账打通。每次新设备接入,自动完成IP分配、MAC绑定、资产登记三步操作,彻底杜绝了私接设备的风险。