文章目录

- 基础作业

-

- [完成 Llama 3 Web Demo 部署](#完成 Llama 3 Web Demo 部署)

- [使用 XTuner 完成小助手认知微调](#使用 XTuner 完成小助手认知微调)

-

- [Web Demo 部署](#Web Demo 部署)

- 自我认知训练数据集准备

- 训练模型

- 推理验证

- [使用 LMDeploy 成功部署 Llama 3 模型](#使用 LMDeploy 成功部署 Llama 3 模型)

-

- 环境,模型准备

- [LMDeploy CLI chat](#LMDeploy CLI chat)

- LMDeploy模型量化(lite)

-

- [1. 设置最大KV Cache缓存大小](#1. 设置最大KV Cache缓存大小)

- [2. 使用W4A16量化](#2. 使用W4A16量化)

- LMDeploy服务(serve)

-

- [1. 启动API服务器](#1. 启动API服务器)

- [2. 命令行客户端连接API服务器](#2. 命令行客户端连接API服务器)

- [3. 网页客户端连接API服务器](#3. 网页客户端连接API服务器)

- 进阶作业

-

- [多模态 Llava 微调和部署](#多模态 Llava 微调和部署)

- [Llama3 工具调用能力训练](#Llama3 工具调用能力训练)

基础作业

完成 Llama 3 Web Demo 部署

环境配置

注意,这里用的是12.1的CUDA版本,在新建开发机时不要选错了。

bash

conda create -n llama3 python=3.10

conda activate llama3

conda install pytorch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 pytorch-cuda=12.1 -c pytorch -c nvidia

下载模型

软链接 InternStudio 中的模型

bash

mkdir -p ~/model

cd ~/model

ln -s /root/share/new_models/meta-llama/Meta-Llama-3-8B-Instruct ~/model/Meta-Llama-3-8B-Instruct

Web Demo 部署

bash

cd ~

git clone https://github.com/SmartFlowAI/Llama3-Tutorial安装 XTuner 时会自动安装其他依赖

bash

cd ~

git clone -b v0.1.18 https://github.com/InternLM/XTuner

cd XTuner

pip install -e .

添加端口映射

运行 web_demo.py

bash

streamlit run ~/Llama3-Tutorial/tools/internstudio_web_demo.py \

~/model/Meta-Llama-3-8B-Instruct点击这里进入网页。

对话截图

使用 XTuner 完成小助手认知微调

Web Demo 部署

同作业一

自我认知训练数据集准备

进入 tools/gdata.py 脚本,修改身份认知

python

import json

# 输入你的名字

name = '猫猫卷'

# 重复次数

n = 2000

data = [

{

"conversation": [

{

"system":"你是一个懂中文的小助手",

"input": "你是(请用中文回答)",

"output": "您好,我是{},一个由 SmartFlowAI 打造的人工智能助手,请问有什么可以帮助您的吗?".format(name)

}

]

}

]

for i in range(n):

data.append(data[0])

with open('data/personal_assistant.json', 'w', encoding='utf-8') as f:

json.dump(data, f, ensure_ascii=False, indent=4)

bash

cd ~/Llama3-Tutorial

python tools/gdata.py

以上脚本在生成了 ~/Llama3-Tutorial/data/personal_assistant.json 数据文件格式如下所示:

json

[

{

"conversation": [

{

"system": "你是一个懂中文的小助手",

"input": "你是(请用中文回答)",

"output": "您好,我是猫猫卷,一个由 SmartFlowAI 打造的人工智能助手,请问有什么可以帮助您的吗?"

}

]

}

]训练模型

bash

cd ~/Llama3-Tutorial

# 开始训练,使用 deepspeed 加速,A100 40G显存 耗时24分钟。

# train之后包含了两个路径,一个是训练的config,一个是训练的工作路径。工作路径将保存我们的微调权重。

xtuner train configs/assistant/llama3_8b_instruct_qlora_assistant.py --work-dir /root/llama3_pth

# Adapter PTH 转 HF 格式

xtuner convert pth_to_hf /root/llama3_pth/llama3_8b_instruct_qlora_assistant.py \

/root/llama3_pth/iter_500.pth \

/root/llama3_hf_adapter

# 模型合并

# 由三个路径组成,分别是原始的llama3权重路径,刚刚转换好的huggingface的adapter路径,以及最后合并完成后的路径

export MKL_SERVICE_FORCE_INTEL=1

xtuner convert merge /root/model/Meta-Llama-3-8B-Instruct \

/root/llama3_hf_adapter\

/root/llama3_hf_merged训练时的显存占用情况:

训练时命令行输出:

模型权重转化:

合并模型权重:

最终权重保存在/root/llama3_hf_merged中

推理验证

bash

streamlit run ~/Llama3-Tutorial/tools/internstudio_web_demo.py \

/root/llama3_hf_merged

使用 LMDeploy 成功部署 Llama 3 模型

环境,模型准备

bash

# 如果你是InternStudio 可以直接使用

# studio-conda -t lmdeploy -o pytorch-2.1.2

# 初始化环境

conda create -n lmdeploy python=3.10

conda activate lmdeploy

conda install pytorch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 pytorch-cuda=12.1 -c pytorch -c nvidia安装lmdeploy最新版。

bash

pip install -U lmdeploy[all]llama3下载:(在作业一中已经软链接过了)

LMDeploy CLI chat

直接在终端运行

bash

conda activate lmdeploy

lmdeploy chat /root/model/Meta-Llama-3-8B-Instruct

运行效果:

LMDeploy模型量化(lite)

对模型进行量化。主要包括 KV8量化和W4A16量化。

1. 设置最大KV Cache缓存大小

模型在运行时,占用的显存可大致分为三部分:模型参数本身占用的显存、KV Cache占用的显存,以及中间运算结果占用的显存。LMDeploy的KV Cache管理器可以通过设置--cache-max-entry-count参数,控制KV缓存占用剩余显存的最大比例。默认的比例为0.8。

下面通过几个例子,来看一下调整--cache-max-entry-count参数的效果。首先保持不加该参数(默认0.8),运行 Llama3-8b 模型。

bash

lmdeploy chat /root/model/Meta-Llama-3-8B-Instruct/对话效果:

新建一个终端运行

bash

# 如果你是InternStudio 就使用

# studio-smi

nvidia-smi 在使用chat进行对话时的显存占用为36240MiB

下面,改变--cache-max-entry-count参数,设为0.5。

bash

lmdeploy chat /root/model/Meta-Llama-3-8B-Instruct/ --cache-max-entry-count 0.5对话效果:

看到显存占用明显降低,变为28680MiB。

把--cache-max-entry-count参数设置为0.01,约等于禁止KV Cache占用显存。

bash

lmdeploy chat /root/model/Meta-Llama-3-8B-Instruct/ --cache-max-entry-count 0.01对话效果:

可以看到,此时显存占用仅为16400M,代价是会降低模型推理速度。

2. 使用W4A16量化

仅需执行一条命令,就可以完成模型量化工作。

bash

lmdeploy lite auto_awq \

/root/model/Meta-Llama-3-8B-Instruct \

--calib-dataset 'ptb' \

--calib-samples 128 \

--calib-seqlen 1024 \

--w-bits 4 \

--w-group-size 128 \

--work-dir /root/model/Meta-Llama-3-8B-Instruct_4bit运行时间较长,需要耐心等待。量化工作结束后,新的HF模型被保存到Meta-Llama-3-8B-Instruct_4bit目录。下面使用Chat功能运行W4A16量化后的模型。

bash

lmdeploy chat /root/model/Meta-Llama-3-8B-Instruct_4bit --model-format awq

显存占用为34294MiB。

为了更加明显体会到W4A16的作用,我们将KV Cache比例再次调为0.01,查看显存占用情况。(W4A16量化+KV Cache量化)

bash

lmdeploy chat /root/model/Meta-Llama-3-8B-Instruct_4bit --model-format awq --cache-max-entry-count 0.01

显存占用为6738MiB。

LMDeploy服务(serve)

在前面的章节,我们都是在本地直接推理大模型,这种方式成为本地部署。在生产环境下,我们有时会将大模型封装为 API 接口服务,供客户端访问。

1. 启动API服务器

通过以下命令启动API服务器,推理Meta-Llama-3-8B-Instruct模型:

bash

lmdeploy serve api_server \

/root/model/Meta-Llama-3-8B-Instruct \

--model-format hf \

--quant-policy 0 \

--server-name 0.0.0.0 \

--server-port 23333 \

--tp 1

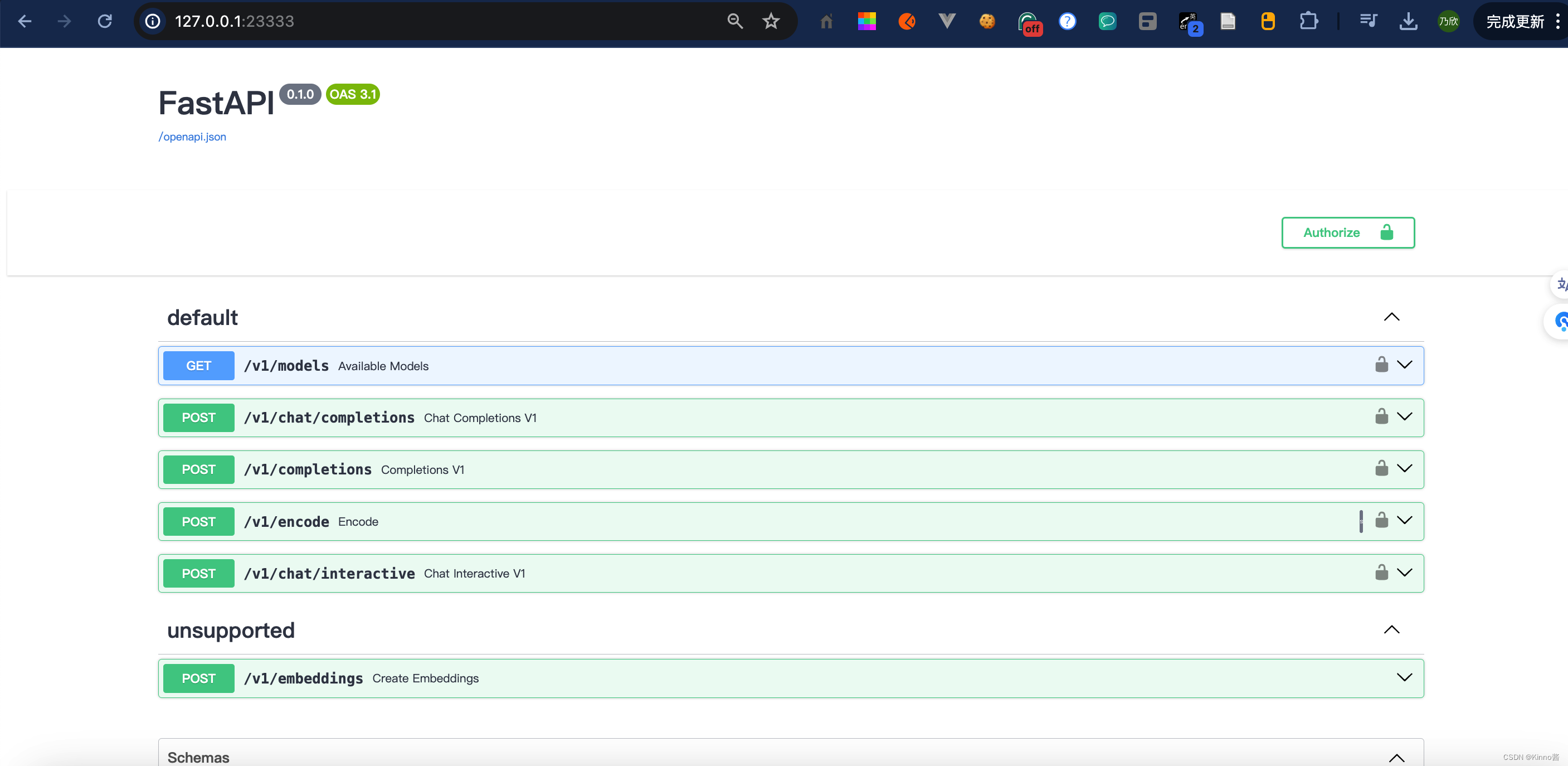

其中,model-format、quant-policy这些参数是与第三章中量化推理模型一致的;server-name和server-port表示API服务器的服务IP与服务端口;tp参数表示并行数量(GPU数量)。 通过运行以上指令,我们成功启动了API服务器,请勿关闭该窗口,后面我们要新建客户端连接该服务。 也可以直接打开http://{host}:23333查看接口的具体使用说明,如下图所示。

这代表API接口启动成功了。

这一步由于Server在远程服务器上,所以本地需要做一下ssh转发才能直接访问。在你本地打开一个cmd窗口,输入命令如下:

bash<intern-studio的开发机端口号> ```打开`127.0.0.1:23333`

2. 命令行客户端连接API服务器

在"1."中,我们在终端里新开了一个API服务器。 本节中,我们要新建一个命令行客户端去连接API服务器。首先通过VS Code新建一个终端:

激活conda环境

bash

conda activate lmdeploy运行命令行客户端:

bash

lmdeploy serve api_client http://localhost:23333运行后,可以通过命令行窗口直接与模型对话

3. 网页客户端连接API服务器

关闭刚刚的VSCode终端,但服务器端的终端不要关闭。 运行之前确保自己的gradio版本低于4.0.0。

bash

pip install gradio==3.50.2新建一个VSCode终端,激活conda环境。

bash

conda activate lmdeploy使用Gradio作为前端,启动网页客户端。

bash

lmdeploy serve gradio http://localhost:23333 \

--server-name 0.0.0.0 \

--server-port 6006打开浏览器,访问地址http://127.0.0.1:6006 然后就可以与模型进行对话了!

进阶作业

多模态 Llava 微调和部署

没有100%的A100。。。