使用spark基于出租车GPS数据实现车辆数量统计以及北京每个城区的车辆位置点数分析

本文将介绍如何使用pyspark以及scala实现的spark分析出租车GPS数据,具体来说,我们将计算每个北京城区内的车辆位置点数,以及统计出租车的数量。我们将使用两个数据集:district.txt 包含北京各城区的中心坐标和半径,taxi_gps.txt 包含出租车的GPS位置数据。以下是数据文件的示例内容

1、数据解析

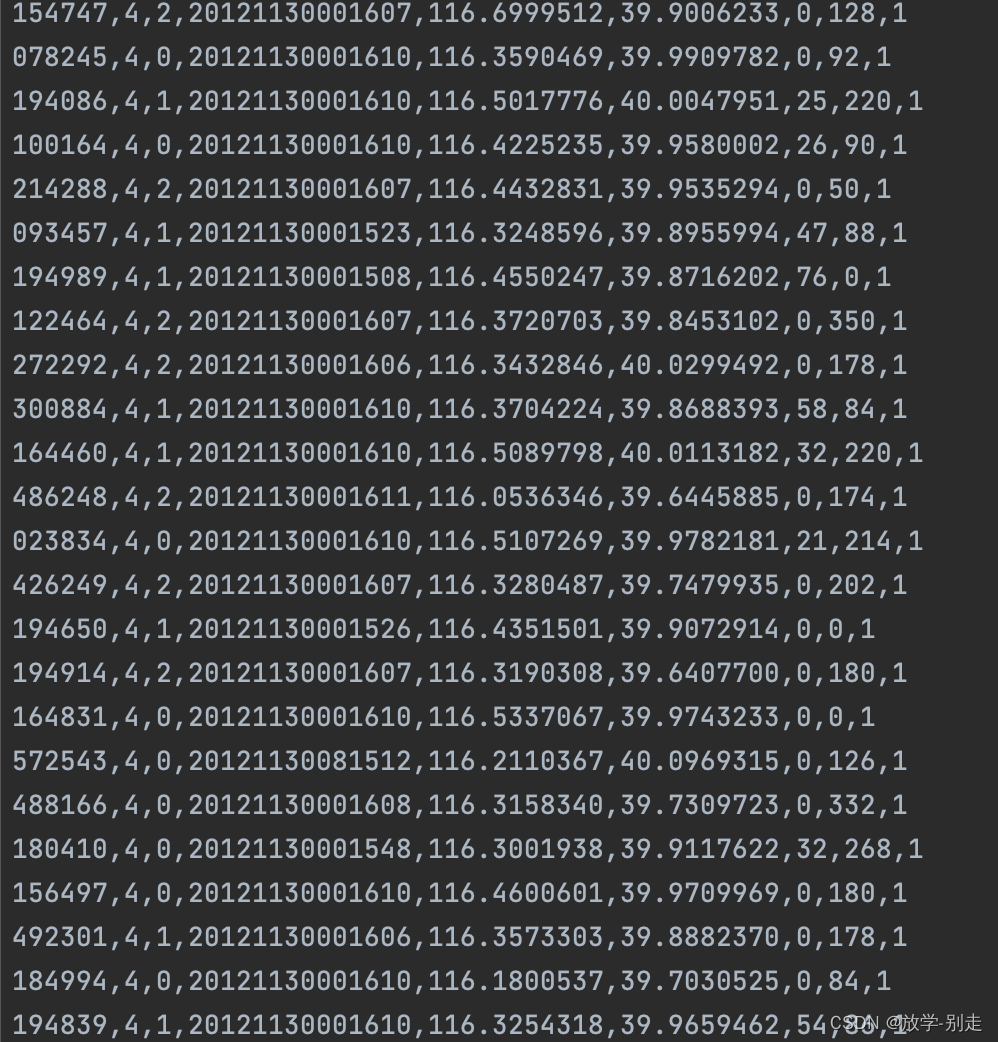

出租车GPS数据文件(taxi_gps.txt)

北京区域中心坐标及半径数据文件(district.txt)

2、需求分析

·能够输出以下统计信息

·A:该出租车GPS数据文件(taxi_gps.txt)包含多少量车?

·B:北京每个城区的车辆位置点数(每辆车有多个位置点,允许重复)

A输出:

·以第一列统计车辆数,去重·输出

B输出:

1.从(district.txt)文件中取第一个区的记录,获得其名称D、中心坐标M(xo,yo)和半径r;

2.从(taxi_gps.txt)中获取第一条位置点记录,获得其坐标N(xp,y)

3.利用欧几里得距离计算公式计算点M和N的距离dis,如果dis<r,则认为该位置记录属于区域D;得到<D¡,1>

4.继续从2开始循环,获得第二个位置记录;直至所有记录遍历完。·5.继续从1开始循环,获得第二个区的记录 district.txt

3、统计出租车的数量

接下来,我们统计出租车的数量。我们可以简单地读取taxi_gps.txt文件,然后使用countDistinct函数来统计不同车辆标识的数量。

python实现该功能的代码

python

from pyspark.sql import SparkSession

from pyspark.sql.functions import countDistinct

# 创建一个SparkSession

spark = SparkSession.builder \

.getOrCreate()

# 读取出租车GPS数据

taxi_df = spark.read.csv("data/taxi_gps.txt", header=False, inferSchema=True)

# 计算唯一出租车的数量

num_taxis = taxi_df.select(countDistinct("_c0")).collect()[0][0]

# 输出结果

print("出租车的数量为:", num_taxis)

# 停止SparkSession

spark.stop()scala实现该功能的代码

scala

import org.apache.spark.sql.SparkSession

import org.apache.spark.sql.functions.countDistinct

object CarCount{

def main(args: Array[String]): Unit = {

// 创建一个SparkSession

val spark = SparkSession.builder()

.appName("TaxiGPS")

.master("local")

.getOrCreate()

// 读取出租车GPS数据

val taxiDF = spark.read

.option("header", "false")

.option("inferSchema", "true")

.csv("data/taxi_gps.txt")

// 计算唯一出租车的数量

val numTaxis = taxiDF.select(countDistinct("_c0")).collect()(0)(0)

// 输出结果

println(s"出租车的数量为: $numTaxis")

// 停止SparkSession

spark.stop()

}

}

4、计算每个城区内每辆车的位置点数

首先,我们使用PySpark读取数据并计算每个城区内每辆车的位置点数。为了实现这一点,我们需要计算每个出租车位置与各城区中心的距离,然后检查距离是否在城区的半径范围内。

python实现该功能的代码

python

from pyspark.sql import SparkSession

from pyspark.sql.functions import col, countDistinct, udf

# 创建一个SparkSession

spark = SparkSession.builder \

.getOrCreate()

# 读取区域信息和出租车GPS数据

district_df = spark.read.csv("data/district.txt", header=False, inferSchema=True)

taxi_df = spark.read.csv("data/taxi_gps.txt", header=False, inferSchema=True)

# 提取区域信息

district_info = district_df.select(col("_c0").alias("area"),

col("_c1").cast("double").alias("center_a"),

col("_c2").cast("double").alias("center_b"),

col("_c3").cast("double").alias("radio"))

# 定义UDF以计算两点之间的欧几里得距离

def euclidean_distance(x1, y1, x2, y2):

return ((x1 - x2) ** 2 + (y1 - y2) ** 2) ** 0.5

calculate_distance = udf(euclidean_distance)

# 计算每个城区内每辆车的位置点数

result_df = district_info.crossJoin(taxi_df) \

.withColumn("distance", calculate_distance(col("center_a"), col("center_b"), col("_c4"), col("_c5"))).createTempView("car")

spark.sql("select _c0 as car,count(distinct(area)) as cnt from car where distance*1000 < radio group by _c0").show()

spark.stop()scala实现该功能的代码

scala

package org.example

import org.apache.spark.sql.SparkSession

import org.apache.spark.sql.functions._

import org.apache.spark.sql.expressions.UserDefinedFunction

object CarLocation {

def main(args: Array[String]): Unit = {

// 创建一个SparkSession

val spark = SparkSession.builder()

.appName("TaxiGPS")

.master("local[*]")

.getOrCreate()

// 读取区域信息和出租车GPS数据

val districtDF = spark.read

.option("header", "false")

.option("inferSchema", "true")

.csv("data/district.txt")

val taxiDF = spark.read

.option("header", "false")

.option("inferSchema", "true")

.csv("data/taxi_gps.txt")

// 提取区域信息

val districtInfo = districtDF.select(

col("_c0").alias("area"),

col("_c1").cast("double").alias("center_a"),

col("_c2").cast("double").alias("center_b"),

col("_c3").cast("double").alias("radio")

)

// 定义UDF以计算两点之间的欧几里得距离

def euclideanDistance(x1: Double, y1: Double, x2: Double, y2: Double): Double = {

math.sqrt(math.pow(x1 - x2, 2) + math.pow(y1 - y2, 2))

}

val calculateDistance: UserDefinedFunction = udf(euclideanDistance _)

// 计算每个城区内每辆车的位置点数

val resultDF = districtInfo.crossJoin(taxiDF)

.withColumn("distance", calculateDistance(col("center_a"), col("center_b"), col("_c4"), col("_c5")))

resultDF.createOrReplaceTempView("car")

spark.sql("SELECT _c0 AS car, COUNT(DISTINCT area) AS cnt FROM car WHERE distance * 1000 < radio GROUP BY _c0").show()

// 停止SparkSession

spark.stop()

}

}

总结

通过以上两个代码示例,我们使用PySpark成功地计算了北京各城区内每辆车的位置点数,并统计了出租车的数量。这些分析可以帮助我们更好地理解出租车在各个城区的分布情况,进而为城市交通管理提供数据支持。PySpark强大的数据处理能力和灵活的编程接口,使得我们能够轻松地处理和分析大规模的GPS数据。

如有遇到问题可以找小编沟通交流哦。另外小编帮忙辅导大课作业,学生毕设等。不限于MapReduce, MySQL, python,java,大数据,模型训练等。 hadoop hdfs yarn spark Django flask flink kafka flume datax sqoop seatunnel echart可视化 机器学习等