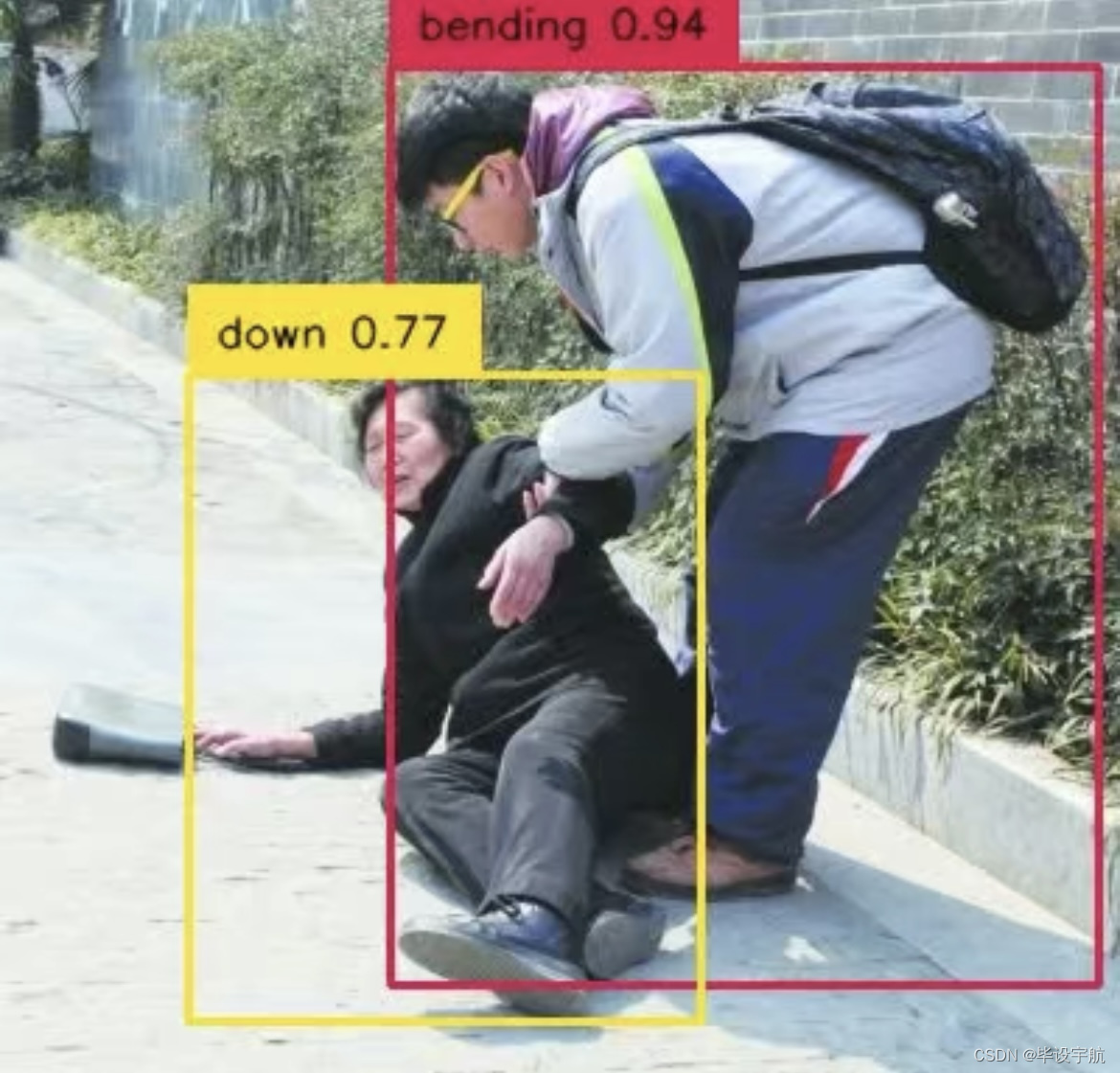

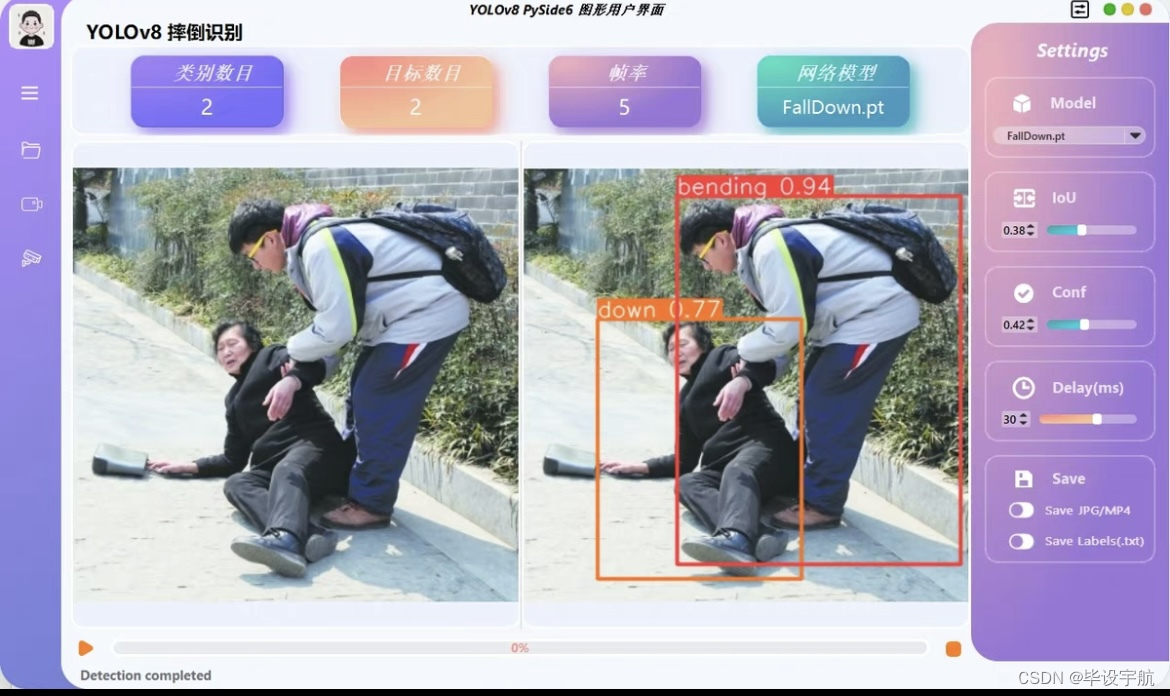

基于先进的YOLOv8模型,实现了一套高效可靠的人体摔倒检测系统。YOLOv8作为YOLO系列的最新成员,以其卓越的检测速度和准确性,在计算机视觉领域尤其是目标检测任务中表现出色。本系统不仅能够实时处理视频流或监控画面,还能对静态图像进行分析,识别出是否有人发生摔倒行为。

该项目主要包括以下几个核心环节:

- 数据准备:收集并标注包含摔倒动作的图像或视频数据,建立一个高质量的训练集和验证集。数据应涵盖不同年龄、服装、环境光照条件下的摔倒场景,确保模型泛化能力强。

- 模型训练:使用YOLOv8的预训练权重进行微调,针对摔倒检测任务优化网络。这一步骤涉及调整超参数、损失函数配置等,以适应特定的检测需求。

- 姿势估计:结合YOLOv8-Pose模型,进行人体关键点检测,分析人体姿态,这是判断是否摔倒的关键步骤。

- 摔倒判定逻辑:基于关键点信息,设计算法逻辑来判断个体是否处于摔倒状态。通常,这涉及到检查人体的关键部位(如头部、肩部、臀部等)之间的相对位置和角度。

- 系统集成:开发用户界面,提供图片/视频上传、实时摄像头输入等功能,并展示检测结果。系统还可能包含报警机制,当检测到摔倒事件时自动触发警报。

关键代码部分:

import cv2

from ultralytics import YOLO

from yolov8_pose_utils import draw_poses, detect_fall # 假设存在这样的实用函数

# 加载YOLOv8-Pose模型

model = YOLO('yolov8n-pose.pt') # 使用YOLOv8的姿势估计模型

# 视频处理部分

video_path = 'path_to_your_video.mp4'

cap = cv2.VideoCapture(video_path)

while True:

ret, frame = cap.read()

if not ret:

break

# 使用YOLOv8进行人体关键点检测

results = model(frame)[0]

# 绘制姿态关键点

frame = draw_poses(frame, results.keypoints)

# 判断是否发生摔倒

fall_detected = detect_fall(results.keypoints)

if fall_detected:

print("检测到摔倒!")

# 这里可以添加报警或其他响应逻辑

cv2.imshow('Fall Detection', frame)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cap.release()

cv2.destroyAllWindows()内负有超详细的数据集,项目源码及人性化的美观的GUI界面。